基于视觉传感器的汽车自主紧急制动控制算法研究

莫 夫

(广东科技学院 机电工程学院,广东 东莞 523083)

自主紧急制动(autonomous emergency break,AEB)系统是驾驶辅助系统领域的研究热点之一,可以准确地进行障碍物检测,在危险情况下发出告警信息并施加主动控制[1-2]。目前,各国都非常重视自主紧急制动系统的发展,欧洲新车安全评鉴协会(Euro NCAP)已将其纳入新车主动安全的评价规程。2018年,中国新车评价规程(CNCAP)也将AEB系统作为测试和评价的重要指标[3]。可见,对AEB系统的研究尤为重要。

当前比较常见的基于雷达的自主紧急制动系统虽有一定的控制效果,但对于行驶路径上的无害静止障碍物,如路边静止车辆、硬路肩、铁轨以及矮桥等,常常会引发虚假警报甚至引发紧急制动,容易产生安全隐患。加上雷达传感器价格昂贵,使其在应用上受到一定的局限。

近年来,视觉传感器以其低成本、易用性的特点,逐渐应用于各个领域。文献[4]将视觉传感器应用于采摘机器人目标果实识别系统中,实现了对目标果实的识别和精准定位,取得了很好的效果。文献[5]为了流水线机器人能精确定位抓取产品,采用了一种基于单目视觉和激光融合的定位方法,对机器人路径进行规划,引导机器人选择最优路径。文献[6]利用视觉传感器和计算机图形学技术,结合PLC自动化控制,设计了一种新型的船舶火灾监控报警系统,大幅提高了船舶火灾事故早期火焰的监控和识别精度。以上研究成果,为本研究的开展提供了新思路。

针对雷达传感器成本高以及对于静止物体存在“虚目标”等问题,本文利用视觉传感器实现雷达测距功能,使其具有更高的空间分辨率,并利用Kalman滤波器调整观测误差矩阵,用以降低估计误差,提高控制效果。

1 车道视觉信息识别算法

图像处理是目标识别的重要环节,主要通过安装在汽车上的照相机感知周围环境,捕捉路况信息,然后将采集的数据参数实时输入系统的预警算法中,以判断障碍物是否对车辆行驶构成危险。但由于环境光线影响、道路标线模糊以及障碍物复杂等因素的影响,使图像处理速度变慢,识别精度降低。本文在设计图像处理算法时考虑降低外界因素对算法性能的影响,以提高系统精度。

本文设计的基于视觉传感器的目标识别算法流程包括图像预处理、障碍物与车道线检测以及数据分析,如图1所示。

图1 图像处理流程

1)图像预处理。包括灰度化、方差图、自适应梯度二值化分割图等步骤,最终得到边缘粗提取图。

2)障碍物检测和车道线检测。采用霍夫变换和双曲线模型拟合检测出车道线像素,从而得到车道线参数。然后通过水平边缘合并及坐标细化,确定车辆底边阴影在边缘提取图中的位置,并结合对称性分析进一步确认所检测车辆,给出车辆水平边缘坐标。

3)数据分析。将检测出的车道线参数及车辆参数输入预警算法模块,为驾驶员发出预警信号或进行自动紧急制动。

2 基于视觉传感器的自动紧急制动算法

2.1 AEB系统工作原理

自动紧急制动系统利用传感器实时测感知前方道路环境,并预判其中的危险程度。当检测到存在碰撞危险时,系统立即发出预警提示,提醒驾驶员采取措施规避危险。当系统发现驾驶员没有对预警及时做出正确反应且碰撞危险进一步加剧时,系统会自动产生紧急制动,以减少碰撞发生机率和严重程度[7-9]。AEB系统工作原理如图2所示。

图2 AEB系统工作原理

有效的AEB系统需要精准识别障碍物的信息,并及时报警和制动,且不能虚报和进行错误制动,从而减小事故发生机率。通常情况下,人们希望报警和制动时机要合理:报警太早会影响驾驶员行驶注意力,太晚又使驾驶员来不及反应,起不到警示作用。而主动制动的时间不应过早,应保留驾驶员通过转向等方式避免碰撞的可能性,这就要求系统具有有效的安全制动算法,计算出合理的介入时刻,决定预警时机和制动逻辑。

目前,对于汽车安全制动算法的评价指标主要包括碰撞时间和安全距离,前者是通过计算两车间的碰撞时间与安全时间门槛值进行比较,从而判断是否制动,后者是指在汽车行驶的当前条件下,车辆避开与障碍物的碰撞需要保持的车辆到障碍物的最小距离。

2.2 碰撞时间

碰撞时间(TTC)是指某一时刻本车与目标车之间发生碰撞前的剩余时间,是衡量避撞算法有效性的重要参数,当TTC低于预设的门槛值时,AEB系统被触发并施加紧急制动,其表达式为[10-16]

其中:Z为本车到障碍物的相对距离;V是本车和障碍物之间的相对速度。

1)不考虑加速度的影响

因为相对距离和相对速度无法直接利用视觉传感器测量,所以将TTC表示成采样时间Δt内图像中物体像素尺寸变化的函数,这个值可以从图像帧序列中精确计算得到。

根据相机的小孔成像模型,如图3所示,则有

其中:wt是t时刻车辆在图像中的宽度;Zt是相机到物体的距离;W是车辆的实际宽度;f是相机的焦距。

图3 相机小孔成像模型示意图

定义尺寸变化率S作为两幅相邻图像之间物体成像宽度的比值:

当两幅图像之间的时间间隔足够小,可以表示为

所以

式(6)给出了根据车辆成像尺寸变化和时间计算TTC的方法。

2)考虑加速度的影响

上述计算TTC的方法的一个问题是忽略了两辆车之间的相对加速度。通常相对加速度发生在前车突然停止或主车减速以避免碰撞,两种情况对AEB系统都很重要。没有检测到主车减速将会给出错误的告警信息(如接近交通信号灯时),仅仅利用制动信号并不足够,因为有时候驾驶员不踩制动而只是将脚从油门踏板挪开利用发动机制动。考虑到相对加速度,则两车之间的相对距离可写成

TTC是Z=0时的时间:

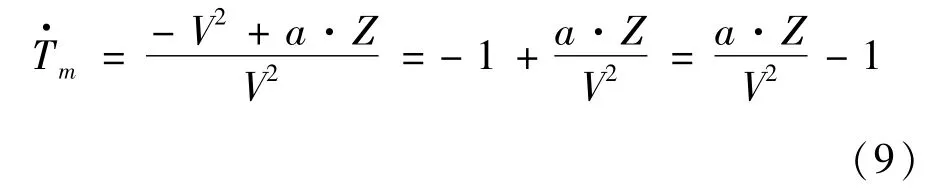

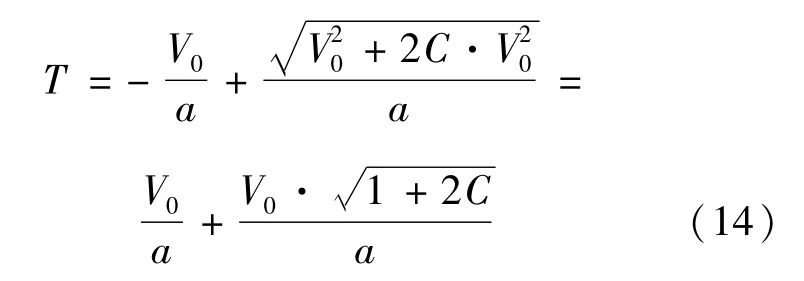

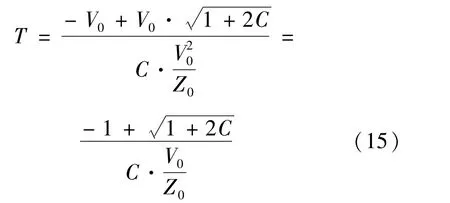

正如本文所述,距离、速度和加速度无法直接从图像中获取,利用车辆成像尺寸改变来计算。这里介绍一种常值加速度假设的TTC计算方法。对式(1)求导得

定义辅助变量:

则Tm和它的导数可从当前图像中获取,这时Z和V实际是Z0和V0,可以得到

从式(12)中提取a,得到

根据图像计算出的Tm和将式(13)代入式(8)中得

将式(13)代入式(14)得到

用Tm代替得到

其中C是的函数。

2.3 卡尔曼滤波

利用单目视觉传感器测距存在一定的误差,假设误差为e(h),那么准确的距离可以由式(19)表示:

式中:Z(h)表示根据行坐标映射所得的距离;e(h)表示h行像素的测距误差。那么在障碍物识别算法较为准确的情况下,该误差e(h)是有界的,即

利用Kalman滤波算法将该误差的方差代替Kalman滤波中的测量误差矩阵,将障碍物阴影行坐标根据小孔成像模型映射为两车距离,并利用各行像素的测距误差调整观测误差矩阵[17-18]。

式中:xk为n维向量;F为传递矩阵;wk为随机变量。

而测量值zk可能是对状态变量的直接测量或者间接测量,假设测量值为m维向量,则测量值为

式中:Hk为m×n矩阵;vk为m×m测量误差矩阵;xk表示车底阴影所在行坐标对应的不同的方差值。假设对k时刻状态的预测为则:

由此可以得出Kalman滤波更新率:

根据式(19)求得第k时刻真实值相对于已知的测量值和预测值的权重,由此可以求得xk和Pk的最优更新值:

最后,根据计算得到的xk更新计算相对距离。

3 仿真与分析

为了验证本文提出的基于单目视觉的自主紧急制动系统的有效性,通过仿真对基于视觉传感器的TTC计算方法进行验证。图4为AEB系统仿真示意图,图中设置装备AEB控制系统的测试车以及在主车车道的目标车,两车距离为12 m,相机架设高度为1.3 m,垂直视场角为40°,图像分辨率为320×240,分别以两车相对速度30 km/h匀速接近和匀加速接近两种工况进行仿真。

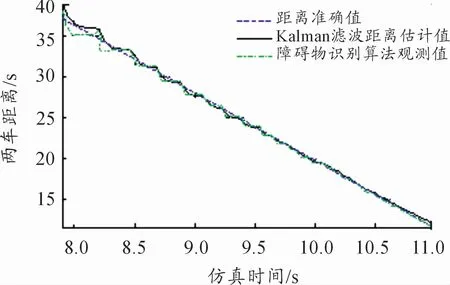

图5、6分别代表两种工况相对距离识别算法观测值、经过卡尔曼滤波后的距离估计值以及真实值之间的比较。通过对比可以看到:与障碍物识别算法的距离估计值相比,本文提出的时变观测误差矩阵Kalman滤波算法能有效降低估计误差。

图4 AEB系统仿真示意图

图5 两车30 km/h匀速接近相对距离计算

图6 两车匀加速接近相对距离计算值

图7、8分别代表两种工况下TTC计算值和真实值之间的比较。通过对比可以看到:当TTC准确值低于3 s时,TTC的估计值能有效收敛于准确值。

图7 两车30 km/h匀速接近TTC估计值与计算值比较

图8 两车匀加速接近TTC计算

4 结论

1)本文介绍的系统直接从相机的原始图像中的位置计算碰撞时间TTC以及发生碰撞的可能性。基于视觉传感器成像原理,推导了在图像坐标系计算TTC的方法,包括两车匀速接近及两车匀加速接近时的TTC计算。

2)为进一步提高TTC计算精度,采用卡尔曼滤波方法,通过各行像素的测距误差调整观测误差矩阵。

3)分别以两车相对速度30 km/h接近和两车匀加速接近两种工况进行仿真。结果表明:本文提出的时变观测误差矩阵Kalman滤波算法能有效降低估计误差,当TTC准确值低于3 s时,TTC的估计值能有效收敛于准确值。