机器人“人格”理论批判与人工智能物的法律规制〔*〕

○ 张 力, 陈 鹏

(西南政法大学 民商法学院, 重庆 401120)

一、问题的提出

科技发展使人类进入智能时代。从技术形式上看,人工智能(Artificial Intelligence,简称AI)是使计算机能够进行类似人类行为模式的学习和决策的算法。〔1〕目下,人工智能技术正加快向交通通讯、医疗保健、商贸物流等人类各行各业渗透,〔2〕成为世界主要国家推动产业升级与技术革命的抓手。人工智能对人类社会治理体系,尤其是对法制体系构成的主要冲击在于两方面:其一,如任何初创期的新兴技术形式一样,人工智能对人类既有生产生活体系构成的未知技术风险需要相应的新制度新机制予以预防、评估与处理;〔3〕其二,也是往往被认为更为根本、超越既往所有创新技术形式的,即作为人工智能有形载体的“智能机器人”获得社会“主体资格”的可能性与必要性问题。人格化理解的“机器人”概念本身正是人工智能“主体化”诉求的形象化代名词。智能机器人被赋予“人格”将直接冲击传统“人类中心主义”前提下的所有人类道德与法制体系,及其所构造的“主体—客体”调整格局,引起人类法制文明的重构,从而也引发了法学界的极大研究热情,并占去大量学术版面。〔4〕

事实上,机器人的“人格”并非一个新鲜话题。在阿西莫夫创作的机器人科幻小说《我,机器人》中,“Robot”就被设定为与人类具有相同或相似智力、情感的人格化角色。其中,第二章“环舞”中首次提出后来举世闻名的“阿西莫夫三原则”,由此将Robot纳入到文明世界的人类规则体系中,作为法律关系的主体对待。〔5〕阿西莫夫开创的科幻世界,也成为后来所有类似科幻作品的范本,并被无数科幻迷奉为思维逻辑的圭臬。西语“Robot”一词在中译本中被率先拟人化表述为“机器‘人’”,更令人工智能在后来中文世界里拥有了更为强烈的“主体化”解释路径指向。而今日科学技术推动人工智能工作进一步“自动化”“自主性”,似乎更是使其与人类的相似性从科幻走向了“现实”。AlphaGo在围棋大赛中战胜人类顶级棋手,微软“小冰”创作的“优美诗集”正式出版发行,“长相甜美”“对答如流”的“索菲娅”被沙特政府给予“公民身份”等事件似乎都在说明,智能机器人获得人格是水到渠成、迫在眉睫的客观趋势与事实,人类法制对之仅能够顺势而为地承认或追认。〔6〕不少学者甚至立法者皆“顺势而为”,〔7〕迎接“人工智能时代”的到来与“人类中心主义”的黄昏。因之,在理论界有:智能机器人应被比照适用历史上组织体获得法人地位的人格拟制技术,〔8〕先承认其具有享有部分权利义务并承担有限法律后果的“有限法律人格”、〔9〕具有部分刑事责任能力的拟制人格〔10〕或“次等法律人格”;〔11〕在立法动议方面则有美国《统一电子交易法》赋予电子交易系统以“电子代理人”、〔12〕欧洲议会的“机器人法”立法建议报告所提出赋予机器“工人”以“电子人”身份的建议,〔13〕以及最新俄罗斯“格里申法案”对弱人工智能套用“法人”拟制原理、赋予有限权利能力而成为“准主体”,〔14〕等等。继而,随着“弱人工智能”向“强人工智能”的科技飞跃,令智能机器人承担法律后果的能力及法人格从有限到完全,出现“电子人权”,〔15〕甚至是相对人类的“位格加等”,〔16〕完成“机器人也是人”的“革命”。〔17〕最终是赫拉利在其《未来简史》中预言的:人工智能将取得统治地位,大部分人类活动被人工智能取代,仅有少数创造算法、为人工智能编写核心程序、通过人工智能驱动社会运转的,由智人进化而来的“神人”可“独善其身”。〔18〕

真实而严肃的法学问题探讨,应首先确定问题本身的真实性与严肃性。关于人工智能能否获得主体资格问题本身的真实性,首先取决于对主体证明条件的思考立场的清晰辨别。即到底是基于法学上关于自然人人格或法人拟制人格证成路径的综合分析立场,还是智能机器人相关科学中工具“自动化”实现路径的简单投射,亦或仅仅是沉迷于人工智能与人的片段与表象相似性的朴素科幻立场。在笔者看来,今日不少科技界及法律界关于人工智能“主体性”之立论所缺乏的正是严格的关于社会规范中“人”的证明立场,难以称之为严肃的法学探讨。当然它们更不可能是真正的科学研究,而要么是披着法学外衣,就智能机器人与人的“长相”“行为方式”等片段表象相似性比附的科幻文学作品(或曰“科幻法学”作品),要么是饱含泛灵论宗教情节的拜机器神教的科技化表达,甚或是某些人希望通过赋予机器人人格以染指“上帝造人”“无上荣耀”的“造物主”情结使然,等等。

对于当下智能机器人取得“人格”“问题”的讨论热潮急需进行方向与立场的澄清:应以法学及相关人文社会科学中人学与主体理论的本来面目为基本思考立场,分析与智能机器人相关科学中自动化技术的关联性和区分点,同时要警惕与戒除似是而非、指鹿为马式的“科幻法学”立场。

二、智能机器人“人格”的证明路径归谬

(一)作为参照的人的主体资格证成路径

“主体”作为人类社会关系支点,是各类人文社会科学的元概念,也是法律据以实现调整功能的技术基础。迄今为止,所有的主体论证都是以人(即人类)为转轴展开。人类的“主体”地位,是所有文明时代所有人文与社会科学以及法律规范设计的基本前提与公理性假设。〔19〕自启蒙运动以来,人类的宗教文明不乏从上帝(或神)赋予人类“智慧”而“造人”的角度论证人的主体性及与动物的序格差异,“自然人是上帝创造的唯一的既作为被造物又同时作为其他造物之王的特殊造物”;〔20〕自然法学从人之为主体与万物之为客体的序格恒定的角度证明人之为主体资格的正当性;心理学、神经内科学等自然科学从人的高级思维活动的角度证明人类精神世界的主体能力;哲学、社会学等从人类理性、信仰与追求等角度论证人的目的性(主体性);法律则逐步普遍地赋予所有人以平等与完全的主体资格(权利能力),等等。但在唯物史观看来,上述任何一项证明都不足以构成对人之主体地位正当性公理的周延表达,只不过是关于这一公理整体的某种角度的阐释线索。它们共同指向并汇聚为关于人类主体资格正当性的历史性阐释:人类的主体能力不是任何刻意的、建构唯理主义下的更高理性创造的;人类主体地位的正当性,也不基于个别伟人、超人、优选的代表性“优秀”而证明的,而是由全部人类进化史上,全部人类与自然世界以及与自身不懈斗争,不断进取,对自然界取得日益强大的实践与改造能力,通过文明发展的历史事实自证的。唯物史观试图将其极简地概括为:“劳动创造人”〔21〕、“人是历史的产物”〔22〕、“人是全部人类活动和全部人类关系的本质、基础”。〔23〕

诚然,人的主体性并非在任何时代都普惠与平等适用于每个人。历史上“人可非人”(奴隶)的不平等情景一度存在,并为当时的实证法所认可。但这并非某种具有历史正当性的公理或自然秩序使然。在后人看来,“人可非人”的实证法设定本身就是对“人人为人”的自然法则的违背,是“恶法”。〔24〕为扭转实证法上部分人之为“客体”的悲惨命运,曾发生漫长而艰苦的“为权利而斗争”。这些斗争把人人之应为“主体人”的普遍应然性与自然法则转化为日益普惠的实际成果,而并非创造了人之为人、人生而平等的正当性。这种为改变自身命运的人类斗争史的存在本身,更加证明了人的主体地位乃是通过人类自身的主动争取,而非他者的赐予,而被证明其客观性与正当性的。

智能机器人“主体资格”论证路径无法凭空创立,只能基于对既有人类主体性证成原理不同程度的摹写发展而成。这是因为,在主体概念系围绕人类为转轴形成的既成历史事实路径面前(主体资格也因此往往被明示为“人格”),凭空开创论证路径将导致其论证对象究竟是否是与人类主体地位具有同质性与可比性的“主体”,变得不可知,进而使围绕人类主体地位建构而展开的法律人格、权利义务及责任等体系的功能相关法律上制度体系,能否适用于这一“主体”也变得不可知。

(二)智能机器人对人类主体现象的片段类比与“人格”拟制

智能机器人无法照搬自然人人格获得正当性的证成路径:在客观存在上,“硅基”的人工智能与“碳基”的人类,在生产演化过程方面不可比。相比人类百万年的自然进化史,确切科学技术上(而非科幻作品中)的人工智能开发不过寥寥数十年。在如此短暂的历史中,并无关于智能机器人在“自主实践”中改造自然而取得历史功绩与文明成果、为改变自身命运而进行主动斗争的任何证据。因此不存在历史自证的智能机器人获得主体地位的应然性与自然法公理,可以被人类的实证法逐步承认的事实基础。至于智能机器人可以比照人类奴隶命运改变史而逐步取得并拓展其人格的推论,〔25〕同样无法成立:不仅因为智能机器人缺乏奴隶们为权利而斗争的血泪史,更关键的区别是,奴隶所改变的命运是通过斗争使自然法上其本来拥有的人格落实到实证法上,而智能机器人所欲获得的“人格”无论从各方面看都是无中生有。

那么,智能机器人“人格”的证明路径只能退而求其次,转向某种简单与速成模式:比照同样不具有先验正当性与自主发展史的第二类主体——法人,甚或“第三类主体”——动物。借助使“非人可人”的人格拟制(fictions)技术,通过人类实证法的外部赋权快速获得主体资格。首先,参照法人拟制说,将智能机器人的某些主体能力方面拟制为人。〔26〕好比组织体具有集约化的意思能力,在财产获得与责任承担方面可以比照自然人而获得权利能力,智能机器人也因日益发展的与人类之间的“交流沟通”能力、对环境与任务的“自主认知与判断能力”等方面,与人类这些能力方面的近似性,而被认为可获得相应的,哪怕是“有限的人格”。〔27〕其次,参照近年赋予某些具有高度灵性,与人类具有长期沟通与伙伴关系的动物以“主体资格”。〔28〕不难发现,AlphaGo屡次“战胜”人类围棋高手,被认为具有近似乃至“超越”人类的竞技棋类方面的“学习、运算、逻辑思维与理性推演能力”;〔29〕微软“小冰”之类以“创作作品”的“丰富的量、优秀的质,赢得了公众极高的评价”,证明其创作作品、创作过程已与人无异;〔30〕而“长相甜美”“对答如流”的人形机器人“索菲娅”,正因其“出色”的“沟通能力”,而证明其被沙特政府给予“公民身份”的正当性。

无论智能机器人“出色”地实现了人类相关主体能力表现的哪种模拟甚至“超越”,上述对人类主体资格正当性的拟制思路都不可能成立。组织体之所以能够通过拟制人类而成为法人,其根本原因是组织体本身是自然人的目的性集合,或目的性财产的集合。即便财团法人,也是为实现人类捐赠目的而成立的成员隐现型组织体。正是作为组织体成员的自然人的前提性存在,赋予了组织体被拟制为主体的历史的正当性。法人拟制说正是对自然人本质的顺从与实现,其作为一种技术手段的目的亦旨在服务于自然人。法人的行为能力就是自然人行为能力的群体化,其从本质上与自然人并无二致。但智能机器人既不来源于,也不服务于人类个体结社自由(社团)或目的性捐赠自由(财团),缺乏组织体的事实基础,故也就没有拟制技术适用的价值前提——为人类服务,不符合“拟制说”基本适用要求。依此类推,智能机器人同样无法比照“动物不是物”的主体化路径而拟制出“人格”。虽然1991年《德国民法典》第90a条对“物”之内部“动物不是物”的裂变性处理,使得学界对“主客关系”的讨论出现不同维度的争议——“打破既有主客二分结构”和“客体内部进行消化”两种模式。〔31〕但从《德国民法典》第90a条的体系结构与设计来看,将“动物与物”的并列化处理以及同一条文的安排与除外性适用更加说明了动物无法逃脱物之一般性命运,至于将动物别于一般物的制度设计则是人类通过尊重动物生命之举以映证和反映自身情感与本体价值。“动物不是物”的客体发展史所得出的法律推理不适用于智能机器人。“动物不是物”的法典认知是人类基于代际利益平衡的一种思考,〔32〕一定意义上夹杂了人类对于其他碳基生命体的共情性尊重。显然,“硅基”的智能机器人不存在自然所赋予的“生命体”特质,对《德国民法典》第90a条的准用显属不当。

进一步说,智能机器人“人格”论者用于与人类比较的,并非人类所拥有整体性与广延性的主体能力本身,而是当下某种具体目的性行为的表象——这常常是某类数据的存储力、某种运算的精确力、某种工作的持久力,〔33〕等等。必须透过现象看本质,即透过人工智能“优秀”的“片段能力”,分析这些现象在人工智能科学上的来源,澄清智能机器人所谓“主体”行为现象背后的技术根源,与人类主体行为所依赖的主体能力之间的本质区别。〔34〕

(三)“机器语言局限”与智能机器人“主体能力”阙如

作为人类主体性基本构成的“思维”能力具有广延性及本体的尚未可知性。即人类思维并非由思维活动本身创造,毋宁说人类的语言、逻辑、情感等,都不过是作为理解与分析过程的人类思维本身所不达的思维形成原理的外在表现形式。人类可以享有思维,却并不创造思维。作为人类思维高级表达方式之一的语言,仅仅是人类思维运行结果与现象中“可言传”的一部分(此外还有不可言传潜意识表达等多种方式)。人类语言本身并不能反映人类思维的全貌,更不能创造思维的本源与本体。

智能机器人人机交互背后潜藏的是人工智能本体强大的机械运算能力,而一系列超速运算除来自科技发展所产生的固件支撑外——纳米技术、半导体技术(硅或锗)等,更为关键的就是构成人工智能“思维”基础条件的计算机语言。但计算机语言并不是由先验的人工智能既有的主体性自然衍生的思维形式,而纯粹是由人类根据其预设之工具自动化工作目的而选取生活语言之适合片段,重新编辑改造而来。人类开发的计算机语言,经历了从机器语言向汇编语言、高级语言发展的过程。其中,机器语言是指由二进制代码所表述的,可被计算机直接识别和运行的机器指令集合。〔35〕但是,二进制模式下所有程序的编写必须全部以“0”“1”组合来实现,此使得编程耗时大、错误率高且不易被一般化识别。〔36〕之后,使用助记符代替二进制码所编写的程序性语言逐渐出现——汇编语言产生。〔37〕但汇编语言所使用助记符编写的程序机器仍无法直接识别,最终在计算机内部还需转化为机器语言(即二进制码)。同时,汇编语言编写程序时亦需对计算机硬件结构与工作原理十分娴熟,且汇编语言中单一指令仅针对操作过程中的细微动作,此使得汇编源程序过于复杂、冗长。〔38〕故,计算机科学经过不断发展,探索出了与人类自然语言表现现象部分相似的,并可为计算机间接接受和执行的语言,即高级语言。高级语言又分为过程性编程语言、非过程性编程语言和面向性编程语言。〔39〕目前,计算机领域中的语言仍然处于动态化发展之中,诸多高级语言亦在不断产生,如Python、Lisp、Prolog等等。

时下,可服务于人工智能的高级语言很多,如Python、C/C++、Java、Prolog、Lisp等被认为是最为适宜进行人工智能开发的编程语言,〔40〕但面临两方面限制:一是,诸多高级语言在同一对象上不可兼容使用。亦如Python语言虽可为人工智能提供强有力的计算能力支撑,但在操作系统的编写上则只能使用C语言;手机相关App应用程序的编写上则只能使用Objective-C(对于iPhone)和Java(对于Android);3D游戏程序编码,较好的选择则是C或C++语言。二是,无论是汇编语言还是高级语言均非机器可直接识别语言。诸多高级语言的使用虽然可帮助人工智能实现快速计算和机器学习等,〔41〕但最终CPU在处理上仅识别的仍是机器语言——“0”“1”。因此,无论高级语言形态如何发生变化,最终向机器语言的转化是其不可绕行的障碍。

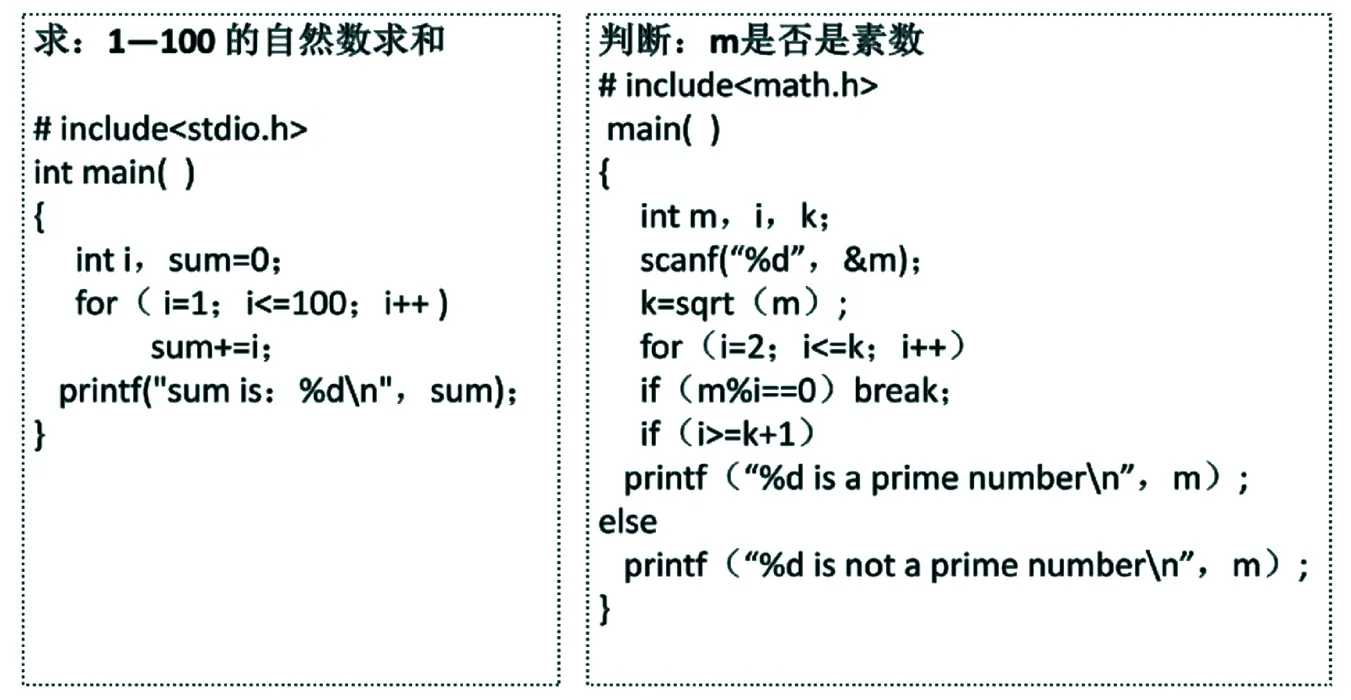

人工智能依赖的机器语言的技术特征,还决定了所谓人工智能的“思维”(运算)过程与人类思维过程的实质性差异。以较为常用的C语言作为范本并以两组程序说明此过程(如下图1)。如对1—100以内的自然数进行求和时,人工智能必须在一定的工作表环境下进行,通过编程人员假设性输入(int)一个起始运算点“i”,将求和最终结果设定为“sum”,当(for)i=1,且小于等于100时,每按此程序运行一次,i所代表的数值则增加一次,最终结果值(sum)通过i在1—100以内的循环次数(i++)来解决,直至输出(printf)结果值。同样,当需要判断一个数(m)是否为素数时,程序人员仍得假设性输入m,i,k作为辅助,同时将素数概念通过i=2,且m与i之比不可恒等于0(以防机器陷入死循环之中)及i每循环一次实现加1的过程进行转化,若存在满足的数则输出,否则不输出。〔42〕人类大脑处理相同问题(如1—100的自然数之和)时,一般存在三种路径:一是通过先期的知识占有强识计算结果,待使用时直接调取结果;二是通过辅助工具(计算器、纸张、笔等)计算出结果;三是利用自身数理思维能力心算得出结果,如高斯方程。相比之下,人类大脑机制在思考和处理对象元素时,首先不仅在自身语言系统上不存在内在性冲突,且针对同一对象可多方位、同步使用多种手段进行处理。相反,机器环境下需先保证程序的顺畅,若选择C语言程序后再通过每一次循环方可保证结果的出现——且此种思维过程是一种单向线性结构。其次处理问题过程中不存在从对象元素向基本元素的转换。如数字“3”在机器语言二进制模式下并非人脑系统中的“3”或“3”(个、只、条、辆……),其仅仅是以“00000011”数码所代表的电平存在,对存在于数中的关联、组合或情感联系等机器均无法识别与感知。

图1 C语言模式下计算机的运行

综上,基于人类语言系统技术化剪裁改造而成的计算机语言必然不能摆脱连人类自身都无法摆脱的,语言与思维之间的关系限制:如果人类自己都只能是通过语言享用人的思维能力,而不能用语言创造自身思维能力,那么对人工智能植入的由人类语言剪裁改造而来的计算机语言,就只能是人类借助新数字媒介享用自身思维能力的成果表现形式,而无法是人类通过语言移植在自我以外创建出不同于人类的“主体”的造人过程。同时,所有计算机语言都必须解归到“0、1”代码进行基础运行的“硅基”技术前提,彻底限定了“算法”万变不离其宗的对人类思维模拟能力的极限:它只能是编程者刻意所能达的,对人类思维可以言表的部分中适合通过“0、1”二进制换算的更小部分的表达,它不可能是编程者刻意所不能达的、碳基的人类大脑思维中那更为深邃的不可言表部分的表达,〔43〕无法模拟人类思维的广延性,永远无法感知人类思维活动所反映的宇宙万物、自然人文与丰富社会生活的全貌,永远无法再现人类思维的本质。与人工智能的硅基物质基础相匹配的二进制运算方法基础决定了,主体性不可能靠人为的人工智能的技术增量堆积而来,道理犹如长度的量变不可能积累为重量的质变。被论者们常常强调的未来“必然”到来的“机器觉醒”“爆发”“奇点”“必然”实现的与人类的广延性意识高度相似的“强人工智能”的预言,〔44〕甚不如历史上那些最终变为现实的,凡尔纳式科幻的务实性,而只能是幻想、神话,或是某种新宗教情结的执念。〔45〕在今日科技界看来,所谓“强人工智能”尚无任何取得实际突破的确切证据,“实现”更是遥遥无期。虽然正因为“强人工智能”的可能性太过神秘而让人欲罢不能,广为街谈巷议的话题也无可厚非,但它实不能作为科学与法学上关于人工智能人格化有建设性讨论的任何意义上的论据。

(四)归谬

关于智能机器人可从客观环境选取素材,并根据已经设定的内部系统通过算法做出决定→表明存在“自我感知能力”→具备事实上的“主体能力”→赋予类人“主体资格”,〔46〕这样的智能机器人取得“人格”的推导谬误主要有二:

其一,混淆了自动化科学中的工具“自动化决策”(AMD)与人类主体性之间的本质区别。人工智能支持下工具“自动化”技术(在不少科技工作者口中这被直接转述为机器人的“人格”“主体”),并不能代换为社会规范中智能机器人的“主体性”。现代自动化科技从来都是以提高技术工具服务于人之预设目标的运行高效性为己任,而从不曾以创造与人类目的与设计无关的,社会规范意义上机器“人格”为自觉追求,甚至其“不能总体概括出什么样的计算机程序可以被称之为人工智能”。〔47〕创建与检验工具自动化运行能力的方法与标准,并不能用作社会主体的创造与检验。为达到人类日益复杂的工作要求,现代数学、神经学、信息理论、认知学等相关科技将人工智能设计成在数据储量、运算能力、反应速度与耐力、模糊推演等“工具能力”现象等方面,超过基于一般生命规律而产生的个体自然人法人的相关工具能力方面,乃至形成所谓模拟人类,甚至超越人类的“自动化”与“学习”能力,本身就是人类为其预设完成更复杂工作任务的题中之意,不值惊讶。环境的不可完全预知性和为适应环境的持续学习,本身就是人类主体性赖以形成的正常环境条件,以及主体性的重要内容。所谓的人工智能高度自动化决策,乃至自我学习与再创作过程,并不超出人类最初通过计算机语言编写与预置程序(即算法)的概括与模糊预测范围,仍不过是人类就人工智能对其可能面对各种可能、未知情况时的可能对策组合形成机制与原理的预先安排。这当然包括所谓人工智能对人类之前未曾精确预测复杂具体情况的便宜行使,通过“学习”,“自主性”与“创新性”的形成“决策”的机制与原理,以及那些“意想不到”情况与知识的随机应对与学习机制。所谓人工智能的自动化与自主学习能力,仍不过是人类主体能力中强大的学习与环境适应能力,通过人类所创造与控制的先进技术(算法)的工具载体与表达方式。智能机器人再多的知识储备仍不过来自人类知识模块中的部分托付。因此,人工智能支持下工具“自动化”技术并不能自动代换为智能机器人的“主体性”。反之,智能机器人的人格化追求,也不能对推动人工智能技术的良性发展产生任何建设性的影响。“但越是‘先进’的法律和技术越是经过无数层人为设计之递进后远离自然的人造人,自然的人的因素很容易在层层递进中消失”。〔48〕人工智能在具体工作场合“自主学习与决策”现象,对其背后与上游无数人类主体的浩繁艰苦的编程与硬件开发工作意义的混淆、遮蔽、抹杀乃至喧宾夺主,正是上述人类因素逐步消失的异化的过程的典型表现。对如此颠倒事实,否定人类主体性实践成果的谬论,必须进行坚决的价值否定。

其二,混淆了人之主体能力的本质与为人所创造工具的工作能力表象之间的区别。马克思说,“人的根本就是人本身”。〔49〕人类是靠自身全部进化史上的全部实践努力,通过积累不仅包括制造与运用工具的能力,更包括团结协作的群体性实践“类能力”的广泛能力体系,而非仅仅依靠某特定行动者的某种具体实践能力的片段——这如智商、审美、体力等方面超越动物界,当然更不靠某些人长相甜美、下赢过几盘围棋——而获得主体地位的。那智能机器人也就不可能通过在类似实践能力片段方面“战胜”人类,乃至未来在任何人格人类具体职业岗位上“替代”人类(当然更不能靠“长”得像人),而被证明拥有主体资格。易言之,AlphaGo屡次“战胜”人类棋手的现象,无法证明其与人类棋手相互交手过程中运用方法,与人类逻辑思维具有本源上的相似性,无法将这种战胜,与猎豹在奔跑速度方面战胜人类短跑冠军、袋鼠在弹跳能力方面超越人类跳高冠军、起重机轻易超越人类举重冠军的极限等这样的“战胜”现象区分开来,自然也就不能通过这种现象证明任何智能机器人与人类在主体性本质方面的可比性。AlphaGo在围棋大战中之所以能够“击败”人类,仅仅源于对人类前期输入系统中的预置编程(棋谱)的强大电子运算能力。事实上并不存在所谓“人机大战”,即并非智能机器人“战胜”了人类棋手,而是借助由人为开发的棋谱记录、演算的人工智能特别工具的人类科学家,战胜了无此技术的人类棋手,故仍不过是人与人的斗智。微软“小冰”的所谓创作“现象”,无法证明其与人类创作过程所基于的思想与情感爆发的主体能力本质具有可比性,其“创作”与“创作物”无法与人类饲养的母牛生产小牛——“孳息”——的产生过程,或某些“大自然的鬼斧神工”区别开来。它要么因不存在所谓“作者独特的个性”,不能认定为作品而无著作权赋予问题,〔50〕要么考虑为人类所创造算法运用的概括性结果的一部分,而并入算法本身所在权利体系。至于人形机器人“索菲娅”的“自主学习”的“对答如流”,更不超出现代计算机语言预置编程技术支持下“预设问题”“答案数据库建构与检索”这样的“高级复读机”范畴。实则是编程者与预设提问者之间的“交流表演”,与人类“自主沟通”现象背后依赖的复杂理智与情感融贯能力实有天壤之别,而赋予其所谓“公民身份”实为出自商业目的的指鹿为马,有“虚假宣传”之嫌。〔51〕

迄今,几乎所有关于智能机器人“人格”证成的研究成果,都不曾真正证明人工智能与人类主体性具有可比性的事实基础。这又倒逼其为了“自圆其说”,倒果为因的循环论证,或以现象比较替代本质比较、以科幻推理填充自身论证不足,又或将人类中心主义无端贬斥为“人类沙文主义”,将对动物的人道主义与当代环境保护理念简单套用到机器之上。这些都使其论说退化为“泛灵论”与神话或反智的“科幻法学”。要强调的是,所谓“强人工智能”完全不能为其理论提供支撑:包括实证法在内的任何人类现实规则,皆只能针对现实世界已经发生或按客观规律而在未来必然发生之事实,而不能是那些从未发生而只是依据推测而可能发生之事展开,即不能对“乌托邦”立法。在有全人类公认的确凿证据证明,所谓“强人工智能”进化出足以与人类主体性本质可相提并论的理性能力以前(在笔者的证明标准中这永远不可能实现),任何对智能机器人赋予“公民身份”“电子人格”的学术理论、官方决定或者立法动议,都因缺乏人工智能“主体能力”的事实基础与历史正当性,而可能构成对宝贵科研与立法资源的浪费,形成名不副实、捕风捉影的空头之论。新兴科技立法中一直秉承“最小化原则”,以期尽可能不改变传统法制而达到调整目的。〔52〕曾广受瞩目的欧洲议会“机器人法”立法建议报告,在最为关键的如何落实其“电子人格”所带来的机器人民事独立财产能力、行为与责任能力方面,没有提出任何建设性方案。机器人无论以何种方式“承担责任”,最终责任承担者都是人。这使“电子人”的“‘法律人格’显得多余和不必要,经不住‘奥康姆剃刀’(如无必要,勿增实体)的检验”。〔53〕而俄罗斯“格里申法案”虽然提到赋予机器人以“财产权利能力与责任能力”,但却没有任何具体落实机制,而是将所谓机器人人格的落实留待未来解决。在当下仍主张实现法律后果向人工智能控制者进行一般传递的,本身无财产与责任能力的“电子代理人(或电子奴隶)”制度,以及将机器人作为“高度危险来源物”而使其控制人承担严格责任的更为严格的责任传递机制。〔54〕从实证法效果上看,格里申法案与欧洲议会“机器人法”建议没有区别,其所谓“机器人”的法律人格不过是就损害向人工智能技术与产品的实质开发、销售、使用等多环节人类主体的责任传递机制的“代名词”,显得多余却易引人误解,同样经不住“奥康姆剃刀”的检验。故倒不如实事求是以其特殊客体性为切入点展开研究与立法。

三、将智能机器人定格为“客体”的本质符合性

机器人人格理论基本构造及其正当性不能基于想象与愿景建立。导致智能机器人“主体性”谬误的根源是,忽视了百万年漫长人类演化史所证成的“人类中心主义”序格。智能机器人演化史尚如此短暂,以至论者从中无法发掘出任何可对应人类为赢得万物灵长之地位而付出艰苦努力的“机器人奋斗史”素材(这样的“素材”只存在于科幻作品以及有强烈科幻情节的“学术”讨论中),〔55〕也就无法创立其可资替代前者公理地位的,智能机器人“自己的”“主体资格”正当性的公理,及相应的主客体序格。对智能机器人法律属性问题的根本回答,必须回到尊重、遵循文明时代“人学”全方位阐释的“主体—客体”序格的底限性路径下。这里的“人学”,是关于人之主体地位及其与外界关系的全部人文与社会科学相关部分的总和,主要包括法学、哲学等。

(一)自然法中的“服从原则”

古罗马的自然法及其学问,是人类最早系统考察并规则化表达人与外部世界关系暨“主—客体”序格的古代规范体系及其解释论。古罗马法学家指出,自然法是自然界交给一切动物的法律。因为这种法律不是人类所特有,而是一切动物都具有的,不问是天空、地上或海里的动物。〔56〕自然法从来都不是从唯理主义中演绎出来的东西,不是不证自明的充满了规范性法典的东西,更不是通过逻辑推导出来以适合于每一具体历史情势的详尽规则。自然法并不像实证法那样因时代差异而呈现出多元性,它只是在极少数情况下与正义、与人的自然本性相一致,其余情形则存在于一般法原理之后。〔57〕至于自然法的约束性则时常以秩序形式出现并悄然作用于万事万物,最终却仅表现为一种平淡的结果。但是,这种秩序或结果背后潜藏的却是自然法格序中的“服从规则”,〔58〕意即自然界一切存在物必须服从自然格序,上至“神”和“天使”,下至人与野兽,万事万物皆为服从,无一例外。〔59〕即使作为人类自身也当服从“自然”,否则构成对“服从”逻辑的示范性违反,此点在亚里士多德“自然的”和“约定的”关系那里早已论及,〔60〕此亦成为后世《罗马法大全》的法律理论骨干。〔61〕从自然法所构筑理论框架来看,要求人及世界上的一切必须服从自然所划定的格序。倘若工具违反“服从规则”,颠覆的将不仅是自然法的基本逻辑,如西塞罗所说:“倘若违背永恒法,哪怕其逃避了对他行为作出的其他相应的惩罚,也将受到最严厉的惩罚”。〔62〕反观自然法格序中的“服从规则”,无论从神启自然法时代到人之理性所认知自然法时代,抑或到后期新自然法时代,都始终被人类自觉或不自觉地遵守着且未曾发生实质变化。乃至因科技革命在近代以来形成的人类科幻情结,也可根据其是否遵循了“服从原则”而检验其可科学性与可实现性:只有符合主客体序格的科学幻想才有望通过科技手段变为现实;反之,则只能堕为纯粹的空想或教义,甚至被利用为欺人之谈。

时下,智能机器人发展过程中亦应坚守“服从规则”,对此需注意三方面:第一,“服从规则”的前提性约束使智能机器人无法与主体平权。自然法及理念对人类与各种生物的格序早有安排——任何具体的人都不是“造物主”,人类作为万物灵长的主体地位,并非由哪一个或一批人扮演“造物主”而赋权得来,而是人类从适应自然到利用与改造自然进化史上付出艰苦努力与巨大代价而争取得来,是人类历史的产物。同样作为历史产物的还有:世界上所产生的一切东西都是创造出来都是给人用的;〔63〕人类支配工具的自然理性无从改变,而任何人为的,对此种格序及整个社会性的扰乱或违背,都应被理解为是禁止的,〔64〕且亦是不正义的。正义的起点是永恒法,如果将正义的基点建立在公众的决议、国王的敕令和法官的判决之上,那么无疑可通过投票或者法官造法以正义形式实现抢劫、强奸与卖淫等。〔65〕那么,即使“索菲娅”被“约定法”赋予资格,不仅不可能实现其字面效力,也因违背关于主—客体序格的永恒法而被判为非正义。第二,“能力属于主体”的前提使得客体无法拥有能力。〔66〕洛克在论及“能力”时指出能力是实体属性的,而非本身的属性。如果问及自由是否自由时与问及财富是否是富的那则不值一问,〔67〕且此种意义上的能力探讨并无意义,其仅仅是对自然表象之阐述。因之,即使智能机器人具有强大的行动能力,且外观上也与人保持了高度相似,但此种能力只有之于主体人才有实际意义。第三,智能机器人唯有被定格为客体才能说服历史。如前所述,人类在这一漫长进化史上取得日益巨大的创造物积累与升级,乃至最近年代开发出的人工智能本身,都是以人类创造并支配客体的实践形式,在不断反证围绕人类中心的主—客体序格的正当性与恒定性。退一万步讲,智能机器人若要获得“主体地位”,同样不能由外界(人类)赐予,而只能自主与历史性的争取。在没有任何证据证明,作为人类创造物的智能机器人经过与人类进化史相当的自觉、自立的进化、斗争与争取历程的情况下,若仅由当代部分人,基于所创造工具的片段功能现象与人类行为模式的相似性而赋予其“人格”,则是部分人对服从原则的粗暴违反,无法说服历史、说服全人类。

(二)马克思主义哲学中的“主—客”格序

自然法学上“主—客”格序的讨论在人类进一步文明时代,通过自然哲学而进入哲学的系统讨论范畴,获得在正当性证明力方面的进一步提升。哲学中关于“主体”“客体”两者的概念界定及结构设置是对人类社会结构最微观、最本质的界定。现代任何学科中的主体和客体概念均是哲学概念涵及和结构设置进行扩展或缩小的结果。不同哲学流派对“主体”有不同的解读。在中世纪基督教哲学那里,上帝是一切社会存在的原动力,故上帝是世界的主体。康德认为世界的主体是人之思维,外在一切不过是人之思维表象。黑格尔认为世界——包括自然界及人——都是主体绝对理性外化之产物。马克思则认为主体是人,人始终是主体,〔68〕且具备两方面特性:一是,人是自然存在的物,对于自然所赋予的——自然力、生命力等——作为天赋、才能和欲望存在于人身之上。二是,人虽作为肉体的、感性的、对象性的存在,但需自己之外的对象来表现和确证自己。〔69〕在马克思看来,人的主体性是因人可通过对立存在来感知和确证自我而确立,故人自身亦是受动的、对象性的存在。作为实践结构另一极的客体就是“自然”,〔70〕即存在于主体之外的一切事物和现象,具有对象性、客观性与系统性三个特质。〔71〕关于对象性与客观性,马克思指出,在理解自然界作为对象性存在时不可割裂其与主体之间的关系,否则对于主体来说也是“无”。因为,只要有对象存在于我之外,只要我不是独自存在着,那么我就是和在我之外存在的对象不同的他物、另一个现实。但是,对这第三者的对象来说,我是和它不同的另一个现实,也就是说,我是它的对象。〔72〕可见,马克思认为作为类我(人类就是一种类存在物)与我互为对象,而不同于类我与我的存在物则是我与类我的对象,并不断反映着我与类我。在此过程中,类我与我可受动存在,而不同于类我与我的存在物则只能是客观性存在,且无法感知本体,这亦形成了其与主体之间的实质性区别。而所谓系统性,则指客体样态本身的复杂性,并反作用于主体发展中,其存在自我客体、自然客体、社会客体与精神客体四个层次,并处于有机联系的发展中。〔73〕

就智能机器人与哲学中的主、客体间关系来看,智能机器人是以别于我与类我的存在物形式而客观存在着,自身属于自然客体之有效组成部分,其与哲学范式中客体的构成性要素——对象性、客观性与系统性——达致了契合。但对哲学中主体的两个构成要素却无法满足:一是物质性。智能机器人本体形态限于纯物质形态,其不仅对主体方向上所考究的自然力无处安放,而且也无法模仿与“拥有”人类主体意识的相关要素——意识的广延性、同一性以及非逻辑性,〔74〕并且与人具体的情感、语境等也不能相等同。〔75〕二是意识确证性。物质性在主客体客观性存在上并无差异,但在通过对象性存在以感知自我维度上,物质与主体之间的差异是明显的。人工智能基于算法或曰计算机高级语言虽可达致与人类“交流”,但在此过程中计算机语言即使在模式匹配与回溯过程中也无法形成与确证自我及类我,更无法进行智力的升华与情感的揣摩。〔76〕

(三)实证法模型中智能机器人的体系归属:法律关系客体

自然法与哲学中关于围绕人类中心的“主—客”格序必须通过实证法的规定,才能转化为现实的社会秩序。社会生活千姿百态,法律对丰富多样的生活元素无法逐一穷尽。面对大量可塑造的生活事实时,实证法只有通过将与生活事实相联系的要素从整体中分离出来,并结合法技术概念所凝练的标准,来创设具体的法权结构以达致对生活事实的一般化、程式化规制。〔77〕正是抽象化的法权结构的创设才使市民社会图景从生活走向了一般性法律制度,并为后续行为评价提供了结构面向上的可能。抽象法律凝练后所形成的法权结构中的“主体”的标准是:权利享有者与义务承担者,不仅有感知能力、言语能力,还有诉求能力。〔78〕“客体”的标准则是主体行为意志所作用的对象,但存多样性——物、行为、智力成果、人格利益等,并表现出客观性、可控性与有用性三个特质。〔79〕法律体系中客体的“客观性”“可控性”与“有用性”的特质都是从主体角度进行的阐发,且均为形式性表征。除却上述表征外,在法权结构形成过程中“客体”自身还蕴含着三个实质性特征:一是服从性。在法权结构创设中立法者对人与物的相关要素从剥离、抽象到整合时已将人与物之间的服从关系也悄然地夹杂其中,进而形成法律框架中“主体—客体”的一般化模型。因此,有学者在界定民事法律关系中的主客体之概念时直接以“支配和被支配”进行表述,不无道理。〔80〕二是原欲目标性。从心理学角度而言客体是原欲驱动的目标,〔81〕即主体以客体作为实现内心动机的目标,进而达致自己所需实现的目的。在动机与目的之间客体起到连接作用,并反证着法权结构中客体与主体间的基本位阶关系。三是对象性。客体形式特征中的“客观性”也有对象性的涵义,只是此处所言及的客体对象性是指法权模型中的客体不仅作为权利对象而存在,更是作为量化主体权利可行使广度的标尺而存在,且正是此种广度意义上的对象性也反映了主体在社会关系中的活动空间范围。〔82〕

法律视角下社会关系需转化为法权结构中的对应性存在方可实现法律规制,而法权结构中的主体——作为权利义务的归属与享有者——是法律技术设计的目的,客体则被作为手段而设计。那么,对当下生活事实中的智能机器人也理应转化为法权模型中的相关要素——主体或客体——进行规制。就智能机器人的法律属性来看,首先,其被设计的原欲目标是为人之主体利益最大化,是为服从于人之发展而存在,且为可支配。〔83〕其次,正是此种效用性、服从性与可支配性,决定了智能机器人在法权结构上处于客体位格。再次,人工智能当下所具备的强大计算能力、精确性等充分证成了自身作为工具的基本特性,也反映了人类对客观世界的可改变程度。于此,智能机器人的实质性状态彻底地与客体概念构成相符合。相反,人工智能对主体所拥有的感知能力、确证能力、言语能力及诉求能力是不存在的。最后,作为人类科技前沿性成果的人工智能的效用本身,亦处于探索与揭示过程中。其中危险与危害因素必须通过不断地“格物致知”而被把握与克服。只有将智能机器人定格为法律关系中的客体,才能为人类完全、充分与可持续地洞悉与控制人工智能科技开发活动的全部,为预防、干预与控制其中的潜在风险提供法律依据与技术。由此,法律不仅能始终有效而全面规制被技术改变以后的社会中的人,更有效规制与影响那些机器背后利用技术改变社会的人的行为层面。〔84〕反之,智能机器人在法律上“主体化”,虽并无将智能机器人真正主体化的实效,却有将人工智能技术风险、“算法黑洞”之类,〔85〕遁入法律主体技术上排他力庇护之下。使人工智能名正言顺地成为法律不便介入的“黑箱”与“商业秘密“,使人类的必要技术干预反倒因涉嫌对“主体”的干涉与侵权而为法律阻却的实效。〔86〕其实质是,利用技术改变人类社会的部分人,借助智能机器人“主体化”之伪装而逃脱全人类及其有效法律规制,而严重放大了人工智能“物”的风险——但这仍不过是以智能机器人为客体的人与人的关系,而非什么人与“机器人”之间的主体关系。

四、法典化时代“人工智能物”的制度展开

人工智能基于自身属性限制使其不可能、不应当获得人格。对Robort 之汉译“机器人”望文生义的人格化意蕴附加实属辞不达意,〔87〕而只能将其作为客体即“人工智能物”,被限定在法权模型之中。目下,我国颁行的《民法总则》所设置的法律主体结构中虽排除了智能机器人作为主体之可能性,但面对时代发展所带来的机遇与挑战及社会各界和学界的多方争议时,对《民法总则》应进行系统性解释以囊括新型事物。同时,民法典各分编应在总则确立的价值基点之上对人工智能进行回应以释解社会各方疑虑。

(一)民法典总则框架下对智能机器人的理念限制

从法权模型抽象、设定及体系构造来看,人工智能应归属于民事法律关系客体之中。然,我国从《民法通则》时代至当下《民法总则》时代对私权客体却未进行统一法典构造,且学界亦存诸多争议。〔88〕当然,本文无意解决是否需建构统一的民事法律关系客体之学界争议。尚且尊重法典无统一规定私权客体之事实,那么对智能机器人从本质上应归属于法典供给客体中的何种类型,学界则不仅有智能机器人是属于产品,还是有体物,抑或是数据或算法之疑问,〔89〕亦有人工智能目前当属工具之定性。〔90〕就学者提出的疑问来看,大致可归纳为两组:产品与有体物属同一位阶、数据与算法基本属同一范畴。在此逻辑上,结合人工智能实际存在场域及法典设计来看,定性有二:一是,若人工智能为有体性,则属于物。就学者所质疑的人工智能属于物还是产品,从概念构成要件而言无实质差异,只是从不同部门法域提出的同质性比较——所谓产品是指经过人类劳动力加工而形成的用于人类消费和使用的物品。〔91〕所谓物,是指除人之身体外,凡能为人力所支配,独立满足人类社会生活需要的有体物及自然力。〔92〕当然概念位阶上物的概念位阶高于产品,产品概念低于物。故,无论是从物权法角度,还是债权法,抑或侵权法、继承法和婚姻家庭法等,人工智能不仅可为所有权之标的,亦可为债权之标的物,更可为侵权法、继承法及婚姻家庭法等其他法律制度所规制之对象。二是,从人工智能的内部信息组合过程来看,符合智力成果的特性。就数据与算法而言,则须先对数据本身进行界定,如单纯谈及编写人工智能的程序背后单一子数据或曰源代码,则并无任何实际意义,亦不符合著作权法第5条第3项之基本规定。〔93〕若谈及的是人工智能作为诸多数据的集合意义上的“数据”时,此时的数据是一系列算法之集合——如前文所述及的C语言程序。因此,数据的概念应当大于算法,但此时无论是数据,抑或算法本身均有人类智力成果的嵌入,当归属于知识产权法范畴,并以版权法进行保护。〔94〕简言之,人工智能是为完成高度自动化工作目的的软、硬件的集合体,可以是有体物与无体物的组合形态。〔95〕这与人类发展进程中所生产出的一般计算机的法律属性在本质上并无二致。对某台电脑(某物)进行物权、债权等制度保护时,并不排除相关知识产权制度、经济法制度及刑法等制度的多元路径保护。

民法视域下人工智能的有体性使其当归属于物,社会学角度下当属改变客观世界的工具,除却上述《民法总则》对人工智能的微观化定性与保护外,在直面此种历史性的产物(或工具)时民法典总则还须从其所处法权结构中的功能入手并进行宏观意义上的理念引导和规制。随着人工智能迅速发展,诸多行业的劳动力必然存在被替代的趋势,〔96〕民法——当然此问题亦非民法单独之任务——应当保持足够理性(至少对人工智能物的流通上应给予一定限制),即变相地促使民事主体参与社会劳动生活而不至于使其丧失人之基本生存意义、本体意义和主体意义,具体因由有三:一是,劳动使主客体形成序列分化。马克思哲学论述中多次提及劳动是财富的源泉,可以创造价值。洛克也指出只要使任何东西脱离自然所提供的和那个东西所处的状态,他就已经渗进他的劳动,在这上面参(掺)加他自己所有的某些东西,因而使它成为他的财产。〔97〕因此,在财富或价值的创造过程中,向自然状态的东西渗入劳动时,“劳动”本身的功效使人与客体之间形成了基本的结构差,导致了“主体—客体”社会结构得以形成。二是,劳动是彰显主体人格的手段。劳动除将主体与客体形成序列性分化后,其实质性意义还在于彰显人之所以为人的社会价值。如果一个人不自己劳动,他就是靠别人劳动生活,而且也是靠别人的劳动获得自己的文化,那么最终将成为拥有物质条件所有者的奴隶。〔98〕同时,若所有人都袖手旁观、不事劳动,哪里还会再有物品与任何事物的丰富呢。因为收获不再是他工作的动因,每个人都希望他人的辛勤成就自己的懒惰。〔99〕于此而言,劳动不仅仅是形式,更是人之所以为人的人格证成手段,更是法律调整财产向财产权转变时的逻辑起点。三是,劳动被替代将对主体及财产权形成解构。虽然人类发明的人工智能可越来越多涵盖更多生活,但并没有改变一个事实,即发明家的才智本身正在变得更像机器的智能,由此它必须使自己适应愈益明确规定的任务。每个人都变得更加孤寂了,因为机器虽能计算和干活,却不能得到灵感,也不能同别的机器融为一体。于是,尽管人们有能动性,却变得越来越被动;虽然人们支配自然,但他们对社会和他们自己却变得越来越无能为力了。〔100〕然而,此种无能为力的背后正是对于劳动本体意义的破坏,当智能机器人大量替代人类劳动使人类的基本劳动权被剥夺后,不仅将导致人类从客观世界获取物质所有权的正当性泉源被截断,而且也将消解主客体架构的稳定性,届时的图景则正如葛德文所言:“一个人过多地拥有他人被剥夺的东西,这是涌现犯罪的泉源。”〔101〕

(二)民法典分编体例对人工智能的继续适用

民法典分则正在有序制定中,在确定总则将人工智能界定为物的解释论路径下,法典——物权、合同、侵权、婚姻家庭和继承——各分编应以此为基点进行相关制度建构和规则创设,此不仅符合我国民法典立法过程中潘德克顿立法技术流的基本要求,而且也是对法典自身理性的当然恪守。然而,人工智能所谓的新颖性对整个民法典分编形成有效冲击和有效质疑的则是物权领域与债权领域(主要体现在侵权领域),故有必要对此两大私法板块中涉及人工智能的相关问题予以说明。

物权领域中,人工智能作为一种基本的物之形态,对其进行物权法规制是实现《物权法》基本效能——确定物之归属与利用——之需要,对此应注意两点:其一,人工智能不能突破学理上和法律上物的分类序列。物的分类最早可溯及至古罗马法时代,其中第一位阶“可有物”与“不可有物”的分类理念影响个人财产权的形成。〔102〕第二位阶“有体物”与“无体物”分类的,为物接受《物权法》调整提供了逻辑支撑。第三位阶“原物”与“孳息”、“动产”与“不动产”、“流通物”“限制流通物”与“禁止流通物”等分类为物的利用提供了可能性。罗马法此些对物的分类理念直接影响了后世诸国法典的基本构造,我国现行私法也多有继受。就人工智能自身物之形态而言与一般电子产品相比并无二致,故不能突破相关物的分类序列结构。举例来说,人工智能应根据其在公共安全方面的影响程度,而被归入可有物或不可有物、流通物或限制流通物的不同调整模式下;人工智能生成物,即人工智能“创作作品”等,应作为人工智能(原物)的孳息,由法律根据具体情况决定其归属原物权利人,或作为无权利公共物。其二,对人工智能适用他物权规则时无须进行特殊性调整。人工智能本身并不是《物权法》规制的重点(相反其已经沦为知识产权法所保护的范畴之中),只有其所搭载的物质形态、实体状况、可否移动等才是法律上“动产”与“不动产”所关心的实质。因之,对人工智能涉及用益物权与担保物权适用之时,相关规则无需因其所谓的新颖性而为特殊调整。

债权领域中,人工智能一般涉及流通意义上作为标的物而存在时的合同之债和因侵权造成他人利益侵害时的侵权之债两方面问题。就一般合同之债而言,由于人工智能本身物之属性,使其只能成为合同交易标的物,其对合同成立、生效、履行及其他相关规则并未造成有效冲击,此不赘述。然而,域外有学者指出某些情形下人工智能——如投资银行所使用的自动交易系统——可分析市场情势、根据市场信息决策并直接签订合同,且此种情形下一方当事人不知道其人工智能代理人所订立的特定合同条款,这将存在解释论上的困境。〔103〕其实,此时人工智能所为的所谓“市场交易行为”本质是合同一方当事人使用工具之初为人工智能输入自己理性可预估范围内的参数后,由计算机根据随机程序、随机参数所选择的结果而已,对此种情形一方合同当事人并非不知情。相反,所签订合同完全在其可预知的理性范围之内。并且,所谓的人工智能自主签订合同行为并非其自主意识爆发而直接作为“代理人”代替合同当事人签订合同,此种行为就是工具对于对象的有效反应,故也不能适用代理和委托等规则。人工智能在债权领域中另一面向性问题则是以自动驾驶汽车为典型所产生的侵权问题,〔104〕具体应注意四点:首先,可明确的是在处理人工智能(自动驾驶汽车)所涉侵权时所有关涉主体资格类的——亦如劳务派遣、职务侵权、雇主责任、监护责任等等——侵权处理机制均不能适用,否则违反人工智能作为物的基本逻辑定性,相关理由此不赘述。其次,处理自动驾驶汽车侵权目前较为合理的处理路径则是“产品责任”模式。有学者指出由于自动驾驶汽车在运行过程中对环境存在自主预测性,但并不能穷尽所有场景,故因预测失误而导致侵权时让生产者承担产品责任并不合理。〔105〕但是,自动驾驶汽车的自主性正是基于前期程序编写过程中对于程序的开放性设计所引起的,且这种开放性也是完全可被生产商控制的,这也正是产品责任归责的合理基础。不可否认以自动驾驶汽车为代表的人工智能虽为人类及全社会带来诸多便宜,但是不能为寻求科技发展而置整个人类于风险之中。即使2016年美国出台的颇具代表性的《联邦自动驾驶车辆政策》也是以人类整体安全为利益导向,〔106〕并非学者所言及的生产者承担责任不合理。当然,对因自动驾驶车辆的自我环境预估过程中所造成的侵权自主性评估问题,域外相关政策中早已指出可建设相关监管机构或评估机构以资保证生产商的生产积极性不被挫伤,可资借鉴。〔107〕再次,人工智能的侵权责任还可能涉及“物件损害责任”。人工智能的形态使其完全可能因自身器件的脱落、坠落等引发致害,对此《侵权责任法》中的物件损害责任规则具备当然适用性。最后,应在人工智能物的定性下保持开放性立法模式。随着自动驾驶汽车为典型的人工智能领域的持续发展,其完全可能与现行侵权法某些规则之间出现张力,故应适度保持法典开放性以维持法典预测性。

五、结 语

所谓启蒙运动对“人的发现”,其实是近代的人类代表,对自然法则上先存的全部人类的主体性的重申与落实。连人类自身的主体性都并非经过某代某群人类代表的赋予而形成,那又有谁有资格代表人类,赋予外在于人类的人工智能的“主体资格”?当前,人工智能“主体资格”立论普遍缺乏共识性道德与法律机制(人格理论)支撑,〔108〕最终陷入“子非鱼,安知鱼之乐”的唯我主义、神秘主义偏执,甚或是宗教与神话情结中。但这种偏执,或是宗教与神话情结本身亦是人类之所以为人的各种意涵中可有之意,无可厚非,代代传承。真正令人担忧的并不是智能机器人那名不副实,充其量导致立论陷入丧失学术性与现实性的无谓、无用之境的“人格化”本身,而是在最关社会正义的法律视野中讨论人工智能时,本应不言而喻的“人类中心主义”居然轻易成了可议、可弃之项。智能机器人“人格化”幌子下,很可能是对本来就技术壁垒森严的,人工智能相关从业者、运用者的开发与使用行为中的风险与黑暗面的法律规制范围、能力的实质性限缩。使其对人工智能“物”的开发与利用行为,遁入所谓机器人“人格自由与独立”而为所欲为——这也许才是某些机器人人格化鼓吹者的隐衷。近代以来的科技发展史证明,人不应当允许自己的自我意识被技术左右,他应当像任何导致主体性丧失的支配关系一样去反抗对技术的依赖”。〔109〕反抗对技术的依赖其实就是要防止对技术的开发与提供者的依赖与放纵。从更为古老的人类文明史上看,人类在取得与使用财产(物)之时,财产也已将人类进行了归类,并且轻易地就实现了将人类当作客体一样驱使。这正如我们在工业革命以来资本驱使劳动者的人再异化中见到的。在所谓财产驱使人类的表象下潜伏的,不过是拥有财产的强者通过其优势财产权中介而将其人的支配力作用于无产者之上,所谓资本对劳动者的驱使,不过是资本家对无产阶级的驱使,是部分人借助物的中介而将他人拟制为“物”的异化过程。这破坏了自然法则中“人类中心主义”对全人类的普惠性与平等性,造成日后激烈的阶层分化与斗争。今日,若赋予人工智能以“主体资格”,将使部分人对另一部分人的物化趋势空前激烈。这在赫拉利的《未来简史》不是已有“预言”吗:人工智能的“统治”,实则是极少数创造算法、为人工智能编写核心程序、通过人工智能驱动社会运转的“神人”,对更大多数“算法无产者”的“算法独裁”。这正是极少数傲慢偏执而缺乏人性关怀者所追求的,部分人为奴为马的奴隶制史的复辟,而决不是什么“泛爱”的新世界。当下,既要关注霍金所提及的智能机器人被赋予主体资格之后对人类所带来的诸多基于机器技术性风险之论断,更要关注人工智能的“人格化”追求掩盖下,人类自身价值理念、社会伦理道德解体危机——届时,人类所自恃的、区别于动物的高尚价值情操将不复存在,人类历经千百万年努力从食物链低端进化至今时的平等与普惠的主体地位也将拱手送“人”——这从表面看是“机器人”,实则是操作人工智能之新型“玩偶”的“神人”。法律决不能以任何借口,为可将大多数人重新降格为奴的“赫拉利式追求”提供任何机会,应牢牢将人工智能限定在客体与物格上。

将人工智能定格为物格(或人格)与所谓人工智能产业发展之间不存在阻碍(或推动)的必然联系。在确定将人工智能锁定于法律关系客体的前提下,针对人工智能迅速发展而替代大量劳动力的态势,民法典应进行合理限制以防大规模的流通造成对财产权劳动基点的解构。我国民法分则各编设定时则应保持法典的稳定性,无需就人工智能所谓的“新颖性”做特别的规则调整。如此方可保证人工智能物之属性一以贯之地服务于人类群体。对此,党十九大报告也指出发展“互联网+”全面为全人类谋取利益,故人工智能应被彻底地限制在客体范畴下以满足人类利益最大化。其间,做到善用与爱惜智能机器人财“物”,就足以表达人类对人工智能的全部“关爱”了。

注释:

〔1〕〔48〕〔53〕〔86〕〔109〕郑戈:《算法的法律与法律的算法》,《中国法律评论》2018年第2期。

〔2〕Kevin Drum,“Tech World:Welcome to the Digital Revolution”,Foreign Affairs,43 (2018),pp.45-47.

〔3〕Leon E.Wein,“Responsibility of Intelligent Artifacts:Toward an Automation Jurisprudence”,Harvard Journal of Law & Technology,Fall,Vol.6,1992,p.103.

〔4〕截至2018年9月,以“人工智能+法律”为关键词搜索,仅CNKI可检索到的核心期刊文章有170多余篇,而法学类CSSCI期刊共计发表58篇,占比34%,近乎占所有核心期刊发表该主题文章的三分之一多,其明显高于其他选题方向。

〔5〕阿西莫夫三原则是:第一定律——机器人不得伤害人,也不得见人受到伤害而袖手旁观;第二定律——机器人应服从人的一切命令,但不得违反第一定律;第三定律——机器人应保护自身的安全,但不得违反第一、第二定律。〔美〕艾·阿西莫夫:《我,机器人》,国强等译,北京:科学普及出版社,1981年,第46页。

〔6〕郑志峰:《人工智能法律前沿问题探讨——机器人是“人”吗?》,http://mp.weixin.qq.com/s/VM71EcQ89G40RsV9xmijKg。

〔7〕〔10〕刘宪权:《人工智能时代机器人行为道德伦理与刑法规制》,《比较法研究》2018年第4期。

〔8〕杨清望、张磊:《论人工智能次等法律人格》,《中国法理学会2017年年会论文集》。

〔9〕袁曾:《人工智能有限法律人格审视》,《东方法学》2017年第5期。

〔11〕〔16〕张绍欣:《从法律人类学角度论智能机器人与人类的关系》,《中国法理学会2017年年会论文集》。

〔12〕“电子代理人”一词最早出现在美国法学会与美国统一州法全国委员会拟订的《统一计算机信息教育法》。1998年美国统一州法全国委员会通过的《统一电子交易法》第2条将电子代理人定义为:非经人的行为或审核,全部或部分独立发起行为或应对电子记录或履行的计算机程序、电子手段或其他自动化手段。

〔13〕欧洲议会2016年提出“机器人法”立法建议报告,其第50(F)项建议:“从长远来看要创设机器人的特殊法律地位,以确保至少最复杂的自动化机器人可以被确认为享有电子人的法律地位,有责任弥补自己所造成的任何损害,并且可能弥补自己所造成的任何损失,并且可能在机器人作出自主决策或以其他方式与第三人独立交往的案件中适用电子人格”。

〔14〕〔54〕张建文:《格里申法案的贡献与局限——俄罗斯首部机器人法草案述评价》,《华东政法大学学报》2018年第2期。

〔15〕〔25〕〔85〕高奇琦、张鹏:《论人工智能对未来法律的多方位挑战》,《华中科技大学学报(社会科学版)》2018年第1期。

〔17〕〔美〕John Frenk Weaver:《机器人也是人:人工智能时代的法律》,郑志峰译,台北:台湾元照出版社,2018年,第5页。

〔18〕〔29〕〔以〕尤瓦尔·赫拉利:《未来简史》,林俊宏译,北京:中信出版社,2017年,第280-283、280-290页。

〔19〕John Finnis,Natural Law and Natural Rights,Oxforo University Press,2011,pp.3-4.

〔20〕胡长兵:《法律主体考略——以近代以来法律人像为中心》,《东方法学》2015年第5期。

〔21〕〔98〕《马克思恩格斯选集》(第3卷),北京:人民出版社,2012年,第988-994页。

〔22〕〔德〕卡尔·雅斯贝尔斯:《当代的精神处境》,黄藿译,北京:生活·读书·新知三联书店,1992年,第26页。

〔23〕《马克思恩格斯全集》(第46卷上),北京:人民出版社,1979年,第31页。

〔24〕〔意〕彼得罗·彭梵得:《罗马法教科书》,黄风译,北京:中国政法大学出版社,2005年,第11页。

〔26〕〔德〕霍斯特·艾丹米勒(著),李飞、敦小匣(译):《机器人的崛起与人类的法律》,《法治现代化研究》2017年第4期。

〔27〕有学者认为人工智能可如公司一样以自己名义持有资产,股东为自然人,营利和监管均由自然人来进行,其正如可归属于“集体”逻辑下的公司法人一样享有财产权而成为物权主体。See David Marc Rothenberg,“Can Siri 10.0 Buy Your Home:The Legal and Policy Based Implications of ArtificialIntelligent Robots Owning Real Property”,Washington Journal of Law,Technology & Arts,Vol.11,Issue 5 (Spring 2016),p.439.

〔28〕刘文燕、刘滨:《生态法学的基本结构》,《现代法学》1998年第6期。

〔30〕李伟民:《人工智能智力成果在著作权法的正确定性——与王迁教授商榷》,《东方法学》2018年第3期。

〔31〕杨立新、朱呈义:《动物法律人格之否定——兼论动物之法律“物格”》,《法学研究》2004年第5期。

〔32〕陈本寒、周平:《动物法律地位之探讨——兼析我国民事立法对动物的应有定位》,《中国法学》2002年第6期。

〔33〕然而,即使这种所谓的超级能力也并不值得宣扬。在一个多世纪前,法国数学家艾米尔·博莱尔就曾提出只要有足够的时间,猴子在打字机上随机敲击键盘,也能复制出莎士比亚的全集。他的假说后来被命名为“无限猴子定理”(Infinite Monkey Theorem),结果证明,比博莱尔想象的更有预见性。尽管灵长类动物学家还没有组建起一支庞大的猴子打字队伍,但工程师们已经成功地将数十亿个晶体管组装成能够进行蛮力计算的架构,其规模在一个世纪前是无法想象的。See Ben Hattenbach,Joshua Glucoft,“Patents in An Era of Infinite Monkeys and Artificial Intelligence”,19 Stan.Tech.L.Rev.32 (2015),p.33.

〔34〕Sean Semmler,Zeeve Rose,“Artificial Intelligence:Application Today and Implications Tomorrow”,16 Duke L.& Tech.Rev.85 (2017-2018),p.86.

〔35〕二进制是计算技术中广泛采用的一种数制,二进制数据是用0和1两个数码来表示的数。它的基数为2,进位规则是“逢二进一。在二进制所组成的一系列指令后,计算机通过将其转变为一列高低电平——用“开”来表示1,“关”来表示0,以使计算机的电子器件受到驱动,进而完成运算。

〔36〕在二进制之下所有信息均以0、1的形式存在,如数字“9”=00001001,但此种编译很容易出错。

〔37〕所谓助记符,就是人们用与代码指令实际含义相近的英文缩写词、字母和数字等符号来取代指令代码,以此通过助记符实现程序的编写。参见陶春:《计算机语言的发展》,《中共中央党校学报》2005年第2期。

〔38〕凌艺春、黄飞:《汇编程序移植性的研究与实践》,《制造业自动化》2011年第5期。

〔39〕所谓过程性编程语言是指编写的程序有一个起点和一个终点,程序从起点到终点执行的流程是直线型的,即计算机从起点开始执行写好的指令序列,直到终点。比如C语言就是过程性语言。所谓非过程性语言是指只需程序员具体说明问题的规则并定义一些条件即可。即你只用说做什么,具体怎么做不用你去描述,语言自身内置了方法把这些规则解释为一些解决问题的步骤。面向对象语言是建立在用对象编程的方法基础之上的。而对象就是程序中使用的“实体”或“事物”,例如计算机按钮、屏幕上的一种长方形图标、菜单、对话框等都是对象。即电脑用户可以通过对象实现操作,在面向对象程序设计中只需考虑如何创建对象以及创建什么样的对象即可,而具体的后台程序编制交由计算机处理。参见陶春:《计算机语言的发展》,《中共中央党校学报》2005年第2期。

〔40〕《最适合人工智能开发的5种编程语言》,http://tech.it168.com/a2017/0406/3114/000003114332.shtml。

〔41〕目前,多有人指出机器学习就是“生成算法的算法”,指在机器学习中学习算法创建规则,而非程序员。但是,此种“学习”与人类认知意义具有价值选择的学习并不能等同。而且,即使算法创建算法还是依赖于其先期的高级汇编程序,简言之就是程序的叠加,而这与人类的学习具有质的差异。

〔42〕当然,此种C语言编写的程序本身是高级语言中的面向性语言,即用户可通过固件输入直接完成,但最终所编写的此些程序仍然要通过计算机预先所内置的“编译器”转化为“0”“1”的机器二进制语言以供CPU识别和执行。

〔43〕即使任何基于计算机程序规则所建立的算法下的机器自主学习永远无法摆脱这一逻辑前提。最终是机器学习(感知能力)缺乏对与错、是与非的价值判断,而是直接一揽子地学习。Andrew Arruda,“An Ethical Obligation to Use Artificial Intelligence:An Examination of the Use of Artificial Intelligence in Law and the Model Rules of Professional Responsibility”,American Journal of Trial Advocacy,Vol.40,Issue 3 (Spring 2017),pp.452-453.

〔44〕陈吉栋:《论机器人的法律人格——基于法释义学的讨论》,《上海大学学报(社会科学版)》2018年第3期。

〔45〕事实上,机器人教等是对传统拜物教的一种科技语言之表达。Kif Leswing Nov,“Ex-Google executive Anthony Levandowski is founding a church where people worship an artificial intelligence god”,https://www.businessinsider.com/anthony-levandowski-way-of-the-future-church-where-people-worship-ai-god-2017-11.

〔46〕Madeleine de Cock Buning,“Autonomous Intelligent Systems as Creative Agents under the EU Framework for Intellectual Property”,European Journal of Risk Regulation,Vol.7,Issue 2 (2016),p.312.

〔47〕Matthew U.Scherer,“Regulating artificial intelligence systems:risks,challenges,competencies,and strategies”,Harvard Journal of law & Technology,29.2016,pp.361-362.

〔49〕《马克思恩格斯选集》(第1卷),北京:人民出版社,1955年,第9页。

〔50〕王迁:《论人工智能生成的内容在著作权法中的定性》,《法律科学》2017年第5期。

〔51〕“索菲娅”由我国香港公司开发,其首次面世是在展会上。沙特政府“授予公民”的主要目的是为沙特的人工智能开发做宣传。See Mindaugas Naucius,“Should Fully Autonomous Artificial Intelligence Systems Be Granted Legal Capacity”,Teises Apzvalga L.Rev,113 (2018),p118.

〔52〕孙占利:《智能机器人法律人格问题论析》,《东方法学》2018年第3期。

〔55〕清华大学教授曾以《全世界机器人联合起来》的“骇人”之题进行讲座。

〔56〕〔古罗马〕查士丁尼:《法学总论》,张企泰译,北京:商务印书馆,2013年,第6页。

〔57〕〔德〕海因里希·罗门:《自然法的观念史和哲学》,姚中秋译,上海:三联书店,2007年,第195-196页。

〔58〕〔59〕〔65〕〔99〕〔爱尔兰〕约翰·莫里斯·凯利:《西方法律思想简史》,王笑红译,北京:法律出版社,2010年,第122、122、52、168页。

〔60〕亚里士多德事实上指出了自然公正和实在法规定意义上的公正的理论区分,谈到政治法(如治理公民的规则),一种是自然的,另外一种是约定的,自然规则在任何地方都具有相同效力,它的存在不依赖于人们的赞同或者反对;而约定的规则,它最初是以何种方式确立的并不重要,一旦确立后,这个问题就无关紧要了。参见〔爱尔兰〕约翰·莫里斯·凯利:《西方法律思想简史》,王笑红译,北京:法律出版社,2010年,第18页。

〔61〕〔英〕登特列夫:《自然法:法律哲学导论》,李日章、梁捷、王利译,北京:新星出版社,2008年,第21页。

〔62〕〔古罗马〕西塞罗:《国家篇 法律篇》,沈叔平、苏力译,北京:商务印书馆,2002年,第159页。

〔63〕〔古罗马〕西塞罗:《论老年 论友谊 论责任》,徐奕春译,北京:商务印书馆,1998年,第99页。

〔64〕See Samuel Pufendorf,On the Duty of Man and Citizen According to Natural Law,Cambridge University Press,1991,pp.35-36.

〔66〕〔67〕〔英〕洛克:《人类理解论》(上册),关文运译,北京:商务印书馆,1959年,第212、212页。

〔68〕〔71〕〔73〕韩玉敏、韩莉:《关于主体、客体及其关系的辨析》,《河北师范大学学报(社会科学版)》1996年第3期。

〔69〕〔72〕《马克思恩格斯全集》(第42卷),北京:人民出版社,1960年,第167-169页。

〔70〕《马克思恩格斯全集》(第2卷),北京:人民出版社,1960年,第3页。

〔74〕高良、朱亚宗:《关于人工智能的形而上学批判》,《湖南社会科学》2017年第3期。

〔75〕郑祥福:《人工智能的四大哲学问题》,《科学技术与辩证法》2005年第5期。

〔76〕〔90〕刘云生:《人工智能的民法定位》,http://mp.weixin.qq.com/s/KbbD-iLqUV9oRM_jqrjjdw。

〔77〕〔德〕卡尔·拉伦茨:《法学方法论》,陈爱娥译,北京:商务印书馆,2004年,第318-319页。

〔78〕张文显主编:《法理学》(第三版),北京:高等教育出版社、北京大学出版社,2007年,第161页。

〔79〕〔日〕近江幸治:《民法讲义Ⅰ》,渠涛等译,北京:北京大学出版社,2015年,第139页。

〔80〕李锡鹤:《民法原理论稿》,北京:法律出版社,2012年,第12页。

〔81〕〔美〕谢尔登·卡什丹:《客体关系心理治疗:理论、实务与案例》,鲁小华等译,北京:中国水利水电出版社,2006年,第2页。

〔82〕Judith Burnett,Syd Jeffers and Graham Thomas,New Social Connections Sociology’s Subjects and Objects,Palgrave Macmillan,2010,p.17.

〔83〕目前,学界对于人工智能与人类之间的关系研究均是从其可为人类——表现在与司法机关的关系时——提供便利角度进行论述的,此点完全可以证明人工智能本体所存在的意义。参见张妮、杨遂全、蒲亦非:《国外人工智能与法律研究进展述评》,《法律方法》2014年第2期。

〔84〕吴习彧:《论人工智能的法律主体资格》,《浙江社会科学》2018年第6期。

〔87〕严格地说,“机器人”的翻译看似传神,实则谬误。在英文、俄罗斯等西文中,原词并无任何“人”的词根与类似含义影射,反倒是在原语境中被不断提及的自动化工具的客体定位表达。

〔88〕高健:《试论民事法律关系的抽象客体》,《政法论丛》2003年第2期。

〔89〕当然,张建文教授还提出人工智能是否为类人尊严的智慧存在者的观点,但经全文论述人工智能只能作为客体,故此处仅将其做客体讨论,不做主体赘述。参见张建文在第八十六期毓秀湖畔读书会的发言,http://russian.swupl.edu.cn/yxhpdsk/236089.htm。

〔91〕李昌麒:《经济法学》(第二版),北京:法律出版社,2008年,第363-364页。

〔92〕学界对物的概念表述及范围界定存在些许差异,但对物存在于人体之外、满足社会需要、可被支配、有体性四要素是一致的。王泽鉴:《民法总则》,北京:北京大学出版社,2009年,第167-168页。

〔93〕《著作权法》第五条:本法不适用于:(一)法律、法规,国家机关的决议、决定、命令和其他具有立法、行政、司法性质的文件,及其官方正式译文;(二)时事新闻;(三)历法、通用数表、通用表格和公式。

〔94〕Bohumir Stedron,“Law or Artificial Intelligence—New Trends in the Data Protection”,Masaryk University Journal of Law and Technology,Vol.1,Issue 1 (Summer 2007),p.213.

〔95〕朱程斌、李龙:《人工智能作为法律拟制物无法拥有生物人的专属性》,《上海交通大学学报(哲学社会科学版)》2018年第6期。

〔96〕当然,目前劳动力被人工智能大量替代这一现象背后至少存在两方面原因值得关注:一方面是互联网(人工智能)的效益性。互联网本身所带来的效益不言而喻,尤其对于劳动力密集型产业中的中低端劳动完全可以形成有效替代,且卓有成效。另一方面,网络便宜性下人类自身种群中小比例群体的自我退出。近年来网络带给人类便宜之时,小比例群体长期处于网络生活而脱离基本的社会劳动环节,促使人工智能得以发展以弥补各行业的劳动供给。

〔97〕〔英〕洛克:《政府论》(下篇),叶启芳、瞿菊农译,北京:商务印书馆,1964年,第18页。

〔98〕《马克思恩格斯选集》(第3卷),北京:人民出版社,1995年,第298-300页。

〔100〕〔德〕马克斯·霍克海默:《人的概念》,载上海社会科学院哲学研究所外国哲学研究室编:《法兰克福学派论著选辑》(上卷),北京:商务印书馆,1998年,第175-176页。

〔101〕〔英〕葛德文:《论财产》,何清新译,北京:商务印书馆,2013年,第52页。

〔102〕周枏:《罗马法原论》(上册),北京:商务印书馆,1994年,第299-303页。

〔103〕Samir Chopra,Laurence White,“Artificial Agents and the Contracting Problem:A Solution via an Agency Analysis”,University of Illinois Journal of Law,Technology & Policy,Vol.2009,Issue 2 (Fall 2009),pp.363-366.

〔104〕Kyle Colonna,“Autonomous Cars and Tort Liability”,Case Western Reserve Journal of Law,Technology & the Internet,Vol.4,Issue 1 (Fall 2012),p.82.

〔105〕司晓、曹建峰:《论人工智能的民事责任:以自动驾驶汽车和智能机器人为切入点》,《法律科学(西北政法大学学报)》2017年第5期。

〔106〕〔107〕U.S.Department of Transportation:“Federal Automated Vehicles Policy”,https://www.transportation.gov/AV/federal-automated-vehicles-policy-september-2016.

〔108〕Lawrence B.Solum,“Legal Personhood for Artificial Intelligences”,North Carolina Law View,1992,p.1286.