基于无监督特征选择和卷积神经网络的图像识别算法

万 萌,冯新玲

(郑州工业应用技术学院 信息工程学院,河南 郑州 451100)

1 引言

随着技术的发展和高清设备的普及,图像的分辨率越来越高.在机器视觉以及模式识别中高维数据会增加内存的消耗以及时间的开销,带来维数灾难[1].图像识别首先通过对原始图像进行预处理去除噪声,继而选取重要的数据特征提高分析数据的质量,增加数据的预测性能以及降低计算的复杂度即所谓的特征选择,最后将提取的特征数据输入分类器并结合深度学习思想进行分类器的设计及训练,进行分类决策得到图像的最终识别效果[2].图像识别具体流程如图1所示.

图1 图像识别基本流程

2 无监督特征选择

2.1 特征选择方法

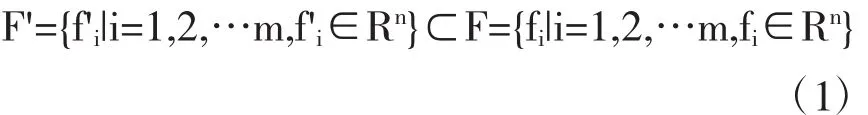

定义特征的相关性,不同的特征选择方法采用了不同的标准如独立性、重构误差、距离等.为了从高维数据中得到低维空间的表示形式,通过某种定义,从样本数据集的m个特征中抽出具有代表性的k个特征子集,即为特征选择[3].用数学方法表示为:假设F={fi|i=1,2,…m,fi∈Rn}为给定的一个特征集合,特征选择即为F中抽取子集F'={f'i|i=1,2,…k,f'i∈Rn},其中:

其中,样本总数为n,特征总数为m,fi为n维向量.

特征选择方法可以分为多种类型,根据选择对象的不同可以分为不同的类型,具体特征选择算法分类如图2所示.

图2 特征选择算法分类

根据标记方式可以将特征选择分为无监督、半监督和有监督[4].无监督特征选择中训练样本不进行标记,根据学习得到的评价标准从原始特征数据中选择最具有代表性的特征,进行聚类分析.根据与后续算法的结合可以将特征选择分为:Fisher得分法即为了提高特征的可分性将不同样本数据类别取不同值,同类别样本取近似值[5].假设样本数据为X=(X1,X2,…Xn),与样本数据对应的分类为y=(y1,y2,…yn),那么Fisher得分可以表示为:

式中,第j类特征fi的平均值为μij,标准差为σij,样本数为nj.为了尽可能地保持数据的局部结构,需要计算样本点互相之间的关联权值,即为拉普拉斯得分法.拉普拉斯得分法对每个特征进行独立选择,得出分数最高的m个特征;为了使特征与类别之间的相关性最大化,同时将各个特征之间的冗余性最小化,即为最大相关性和最小冗余性的特征选择算法.

2.2 无监督特征选择

在没有类别标记的前提下,得到原始数据的类别信息是无监督特征选择的目的;而如何对原始数据的内部几何结构进行建模并用特征子集表示数据的内在结构是无监督特征选择面临的基本问题[6].典型的无监督特征选择算法主要有三种模式:利用统计的方法、通过相似度求解的方法以及稀疏表示的方法[7].

基于统计的无监督特征选择,利用统计特性独立的分析数据特征,是一种滤波型特征选择.由于需要忽略部分冗余的特征数据,该算法适合离散数据的特征提取,因此利用统计的无监督特征选择时需要先将采集的特征数据集离散化,代表的方法有基于最小方差的特征选择(LV)[8].最小方差的特征选择,利用阈值属性,通过去除方差低于阈值的特征得到选择性特征[9].具体方法为:由布尔特征组成样本数据集,特征值只有0、1两种类型,即与样本具有相同值的特征方差为0,否则为1,设方差为1的概率为p,那么最小方差特征选择表示为:

基于相似度的无监督特征选择,通过距离标准得到特征值之间的相似度.假设存在样本数据集X∈Rn×m即数据集为m维n个样本,利用相邻矩阵S∈Rn×n对数据集进行相似度编码,相邻矩阵为n阶对称矩阵,用Sij表示两个样本之间的相似度,第i个样本xi和第j个样本构成第(i,j)个元素,样本相似度越大,Sij数值越大,数学表示为:

对s,f进行邻接矩阵和归一化得到S',f',特征数据f的功效函数通过SC得到,通过式子(4)可知在特征集合F中得到一个能够最大限度保留相邻矩阵相似结构信息的特征子集,即为基于相似度的无监督特征选择,代表性的有拉普拉斯积分法(LS)、谱特征选择(SPEC)等[10].

基于稀疏表示的无监督特征选择,代表有多簇特征选择法、判别信息的特征选择法、非负判别特征选择算法、自表达的无监督特征选择等[11].稀疏表示以多尺度分析理论为基础,利用尺度较大的稀疏系数对原始信号进行逼近处理.存在数据y∈RN,R为数据集,N为长度,y可以被RN正交基线性表示:

基矩阵为 Ai∈A,A∈RN×N,线性组合系数为 x=[x1,x2,…xn],假设k<N即在基矩阵中有k个非零项,那么:

k为稀疏度,||·||0为零范数,非零项的个数.稀疏表示特征选择如图3所示:

图3 稀疏表示特征选择

3 卷积神经网络

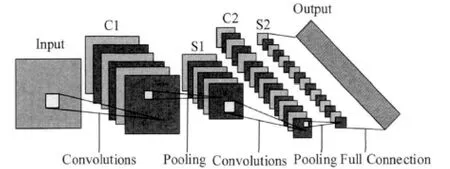

作为多层前馈神经网络的代表卷积神经网络,依靠反向传播算法(BP)实现,卷积神经网络直接以图像原始数据作为输入,忽略了图像噪声以及扭曲和变形没有预处理阶段[12].卷积神经网络通过局部感受野、权值共享以及子采样对图像进行分类识别,无须考虑图像的大小、形状以及位置的变化,因此不需要对图像进行预处理.卷积神经网络由输入层、卷积层、激励层、池化层和全连接层构成,具体如图4所示,C1,C2为卷积层,S1,S2为池化层.

卷积层:由多个特征图构成,下层特征图由上层特征和卷积核进行卷积运算得到.卷积运算公式为其中 f(x)、g(x)为数据集 R 上的 2个可积函数.卷积层直接输入图像数据前几层输入低级特征如边缘、颜色等,然后通过卷积核进行卷积运算得到复杂的纹理特征,最终利用深度高层网络学习得到不同类型的特征信息.

激励层:对卷积层的输出数据进行非线性映射,一般为Relu函数即修正线性单元作为激活函数.卷积神经网络不仅包括高维数据的低维变换,还包含一个非线性变换(空间的弯曲)和三个线性变换(旋转、平移、放大缩小),而激励层主要完成弯曲空间的变换.

池化层:通过对特征图进行尺度缩小,即对特征图进行下采样,避免因原图像经卷积运算以后产生的大量数据,而导致过拟合现象的产生.常用的池化操作有平均池化和最大池化,以计算图像区域的平均值和最大值为依据.平均池化:poolavg(Rk)=代表多个区域,a为神经元.

全连接层:卷积神经网络利用卷积层得到图像特征,利用池化层对得到卷积特征进行下采样避免产生过拟合,通过交替堆叠进行.虽然这种方式在得到图像特征的同时降低了数据复杂度,但同时也丢失了部分特征信息,因此需要在输出特征数据之前利用全连接层进行数据的收集.数学表示为,最大池化其中f为激活函数,n是l-1层的神经元个数,l为当前层为 l层第 i个单元与l-1层第j单元的连接参数为当前层的第i个单元的输出值和偏置项.

图4 卷积神经网络结构

4 无监督特征学习与深度卷积神经网络的结合

无监督特征提取(UFL),提取的是图像的局部特征,即UFL算法的输入需要从原始图像中抽取部分图像的局部特征,假如抽取的图像的局部大小为w×w,C为颜色通道数,N=w×w×c,则局部大小可以通过实数向量RN表示,抽取m个局部向量组成p={p(1),p(2),…p(m)}作为UFL算法的输入,具体流程为:

(1)原始数据中随机抽取m个无标号局部块,大小为 w×w,构成 p,且 p(i)∈RN;

(2)为了得到像素间标准化方差函数,需对p做预处理,进而构成pw;

(3)在pw上应用无监督特征选择算法,进行特征提取.

对图像进行无监督特征提取以后,需要对得到的特征进行卷积处理.通过映射函数f对图像块p提取 k 个特征 f:m×RN→k×RN,得到 y(y∈Rk为 k 维向量),y(i)=Φi(p)即第i个特征Φi对p进行映射得到y(i).具体实现为,通过大小为w×w的局部块p(i)对整幅图像I(n×n)进行扫描,利用Φi对整幅图像I在窗口范围内的部分进行映射,得到特征映射图M维度为(n-w+1)×(n-w+1),特征Φi对图像I在窗口范围内的部分I(j,k)进行映射得到Mi,(j,k),以此类推,假设原始数据集包含m个图像I大小为n×n,特征窗口尺寸为w×w,利用特征Φi对数据集图像进行卷积运算得到维度为m×k(n-w+1)×(n-w+1)批量卷积M.

对得到的批量卷积 M(M∈R)m×k(n-w+1)×(n-w+1)I(j,k)进行特征采样,从而减少网络参数,降低系统计算量.对原始图像I大小为n×n,进行采样,采样窗口取大小为s×s,且n/s必须为整数,那么采样后得到的特征维数为(n/s)×(n/s)是原来维数的1/s2,输入数据的向量维数变为k×m×(n/s)×(n/s).

对原始数据进行降采样以后,开始对特征数据进行分类.全连接层作为卷积神经网络的最后一层,分类器的训练主要集中在这一层.假设原始数据为m个n×n图像,特征维数为k,采样窗口尺寸为s×s,采用的局部图像块尺寸为w×w,那么分类器的输入项为k×(n-w+1)/s×(n-w+1)/s,分类器的最终输出分类类别数为c.

5 实验与仿真

图5 MNIST图像样本

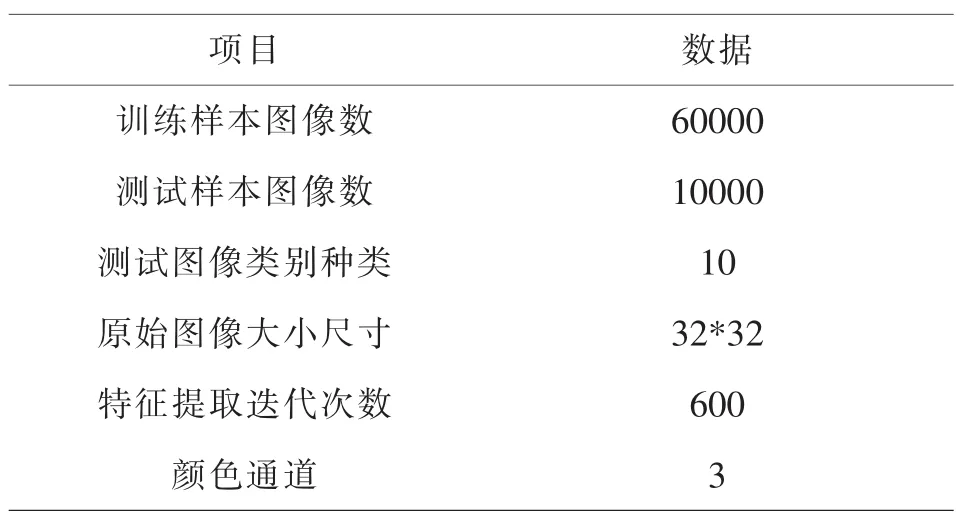

表1 实验参数设置

无监督特征学习的依据是从训练数据集中找出具有鉴别特征的数据,且训练数据集具有无标签性,所以训练数据的样本数量和多样性对实验有很大影响.本文采用MNIST数据集如图5所示,MNIST数据集包含10000个测试样本、60000个训练样本总共70000个样本数据,可以满足无监督特征学习对训练样本数量的要求;同时,MNIST数据集内容包含0~9这10个数字,由于手写样式各异,因此满足了无监督特征学习对训练样本多样性的要求.

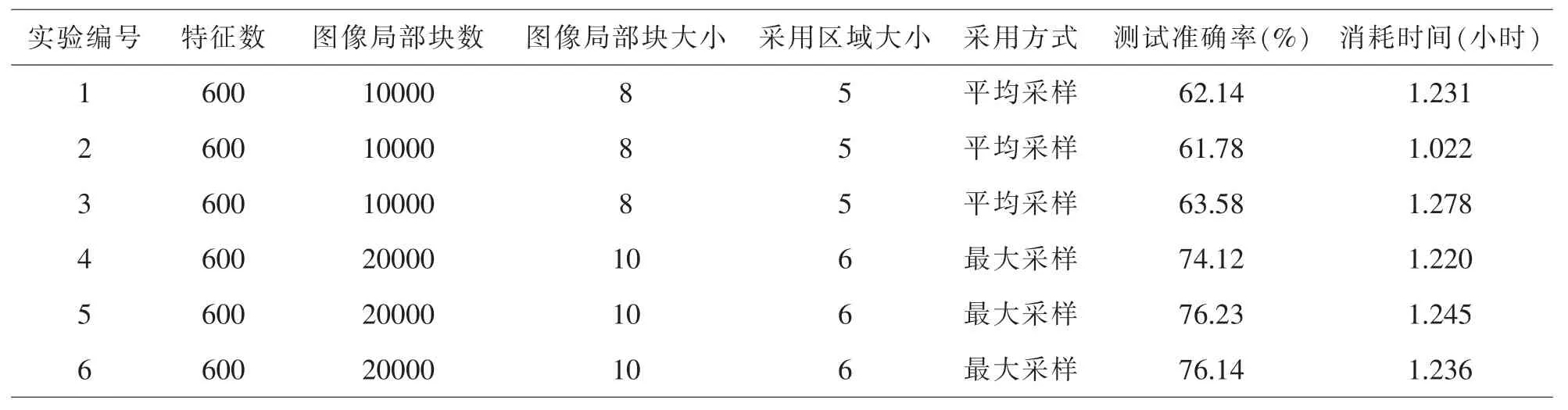

实验参数具体设计如表1所示.

基于无监督特征学习和卷积神经网络在MNIST数据集上进行测试,硬件采用酷睿i7处理器,16G内存,程序采用MATLAB7.0,实验结果如表2所示.

通过实验数据可知,图像块尺寸越大包含的信息越多,尺寸过小则不能满足图像识别的需要,当图像块的尺寸为10×10时,识别率最高;同时图像的识别效果还受采样方式以及采样区域大小的影响.另一方面,识别精度的提升不可避免地带来时间的消耗,如何在提升识别精度的同时提高时效性是我们下一步研究的重点.

表2 实验结果

6 总结与展望

本文首先分析了传统特征提取的方法以及优缺点,深入讨论了无监督特征提取的思路以及具体实现;继而分析了卷积神经网络的实现过程,以及在实现过程中卷积神经网络中局部感受野、权值共享以及子采样对图像进行分类识别的影响;最后将无监督特征学习和卷积神经网络结合起来,在MNIST数据集上进行验证算法的有效性.实验结果表明,基于无监督特征选择和卷积神经网络的图像识别算法提升了图像识别的精确度,但在时效性上还有待进一步研究.