建立全球人工智能伦理规范的挑战

(欧亚集团)

人工智能的伦理和安全问题无论对中国还是美国,亦或是欧盟,都是必须要应对的问题,当然欧盟的情况相对复杂一点,但我们仍然需要讨论在人工智能的伦理规范方面如何达成广泛的国际共识。我认为AI的伦理和安全是两个全然不同的问题:伦理有关公平和透明度,而安全相对更复杂,我注意到中文的“安全”对应为英语的 “security”或者“safety”这两个单词,但这两个英语单词实际内涵并不相同,这可能也是增加其复杂度的缘由之一。因此,第一个挑战就是如何在语义层面统一,并能给出对策办法。

我曾在今年2月参加了北京人工智能大会,在那段时间发生了一件与人工智能有关的交通事故,由Uber公司开发的无人驾驶车在美国亚利桑那州的道路测试中撞死了一名骑自行车的人,因此安全问题就理所当然地成为了北京AI会议的讨论重点。

当前美国、欧盟、中国等国的人工智能政策、建议、计划等层出不穷。2017年中国发布了具有里程碑意义的人工智能发展计划,欧盟计划在人工智能领域设立基准,准备在今年年底前发布人工智能伦理指导框架。就在我参加大会的路上,美国布鲁克林研究机构发布报告,认为现在所有的企业都是人工智能企业,因此建议所有企业都要建立严格的应对伦理问题的人工智能流程,涵盖审查委员会、培训等等。

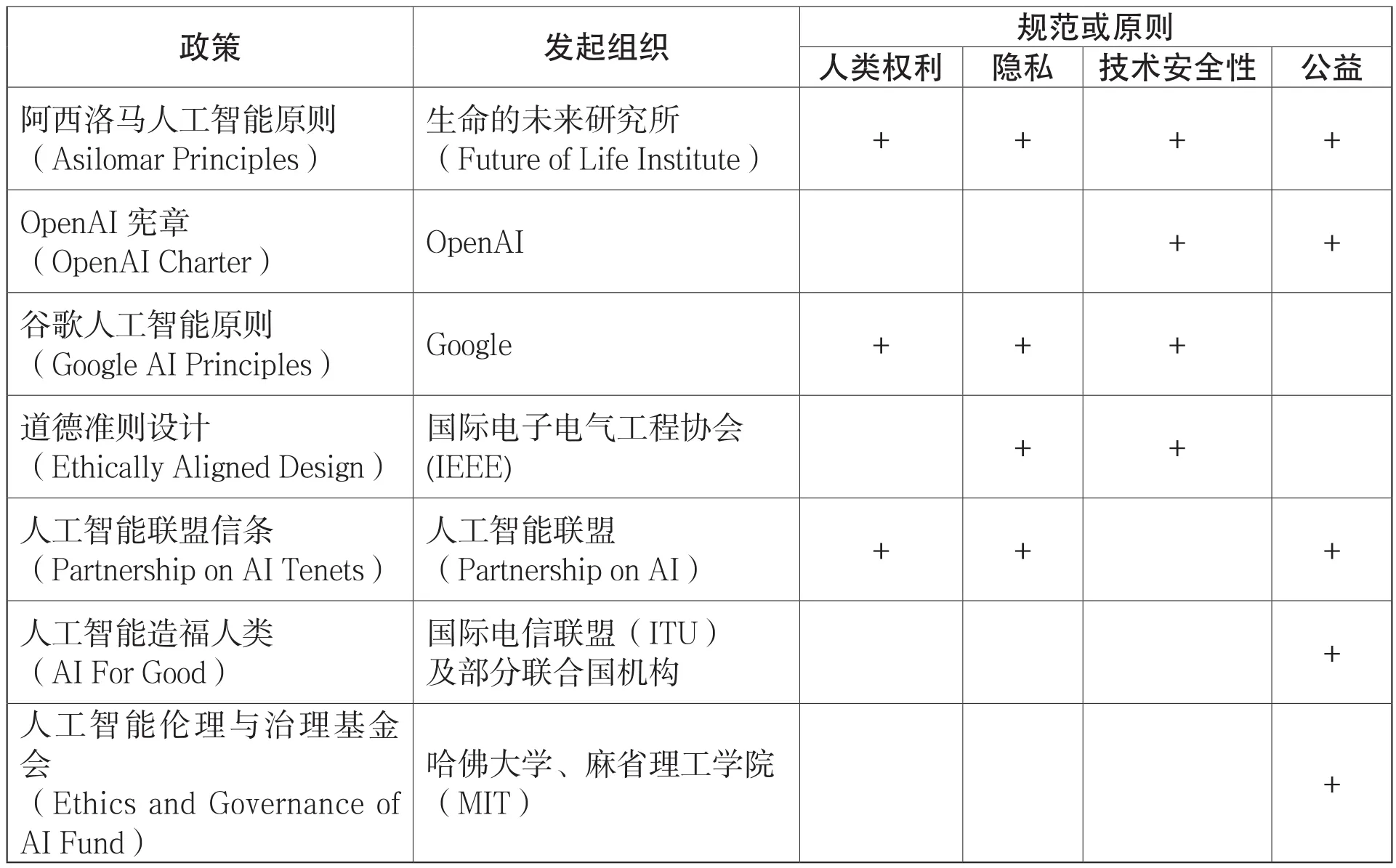

当前国际上已经达成的较有影响力的AI共识可参考表1,共识议题相对复杂,尤其是政府、产业等应该扮演什么角色十分关键。每一个国家或者组织都有自身的原则,如欧盟最近发布了AI指引,腾讯公司也制定了自己的政策等。关键是找到诸多原则中的共同点,我们大致都同意AI应该是要造福人类的,肯定没人希望AI危害人类。在昨天的上海全球人工智能大会上,有演讲嘉宾提到不必害怕AI,但由于AI问题相对复杂,因此这个观点说起来容易做起来难。还有一名演讲者提到了信任AI,信任固然很重要,但须知不同国家和文化对信任的认知并不相同,所以要信任AI也同样不容易。当然不害怕和信任都是比较基本的原则,相信不会有人提出异议,目前全球也都在朝这个方向努力,尤其是美国一直倡议将伦理和安全特征化。美国在过去两年一直试图出台一个包含人类权利、隐私、安全等在内的指导框架,如前所述对于安全我认为此领域并不能统一,这个问题相对复杂。例如将AI应用于网联汽车后,其实只是庞大系统中的一小部分。原则大家也容易达成一致,这就有助国际上形成AI安全及其子领域的标准。ITU还将在10月份中讨论AI的可持续发展等问题。

另一个易于达成国际共识的是AI应造福全人类,但其难点在于隐私问题,人工智能广泛

表1 国际上较影响力的人工智能共识

对于美国AI企业来说人工智能联盟(Partnership on AI,AI联盟)是非常重要一个组织,像谷歌、微软、脸书等企业都是AI联盟的关键成员,也期待中国的企业也参与到这个联盟中。当前政府、学术界和企业界都在努力达成AI原则,如MIT及一些科技公司,比如谷歌,都已发布过自己的AI原则。

更关键的是哪些原则能够获得国际普遍认可?在安全方面,已经有核能源、太空科技等先例,相信针对自动驾驶、无人机系统的安全应用的障碍显然是极难平衡的隐私问题。不同国家的处置方式不同,中国已经出台网络安全法,欧盟则有GDPR,由于都有涉及数据隐私保护的条款,也给AI带来了挑战。

未来AI应用和合作中的一些领域也是可能达成国际共识,国际社会已经在网络规范和网络空间协作方面做了大量工作,已经有了一些初步共识,但还不是普遍共识。在网络领域中一个成功的经验是私营行业共同支持数字日内瓦公约,这当中微软公司起了主导地位,也许可以类推到AI联盟,毕竟AI联盟也同样源于私营行业。

2017年中国、法国、德国、欧盟等都发布了AI计划,这些计划中或多或少都有关于伦理和安全的部分,说明国际社会对这些方面还是比较关注的,接下来的问题就是国际合作的机制是什么?在这一问题上,当前除欧盟之外政府之间少有合作,欧盟的成员国协作比较多。在我参与的部分外交活动中,如ITU及部分隐私和设立标准的组织等,这类非政府的二轨外交对这类问题都有所涉及。还有今年早些时候,ISO/IEC在北京召开了关于AI的会议,除安全这个老生常谈的问题外,也开始讨论伦理议题。IEEE也在AI安全领域做了很多工作,例如P7009标准就涵盖如何处理自动驾驶的安全问题。

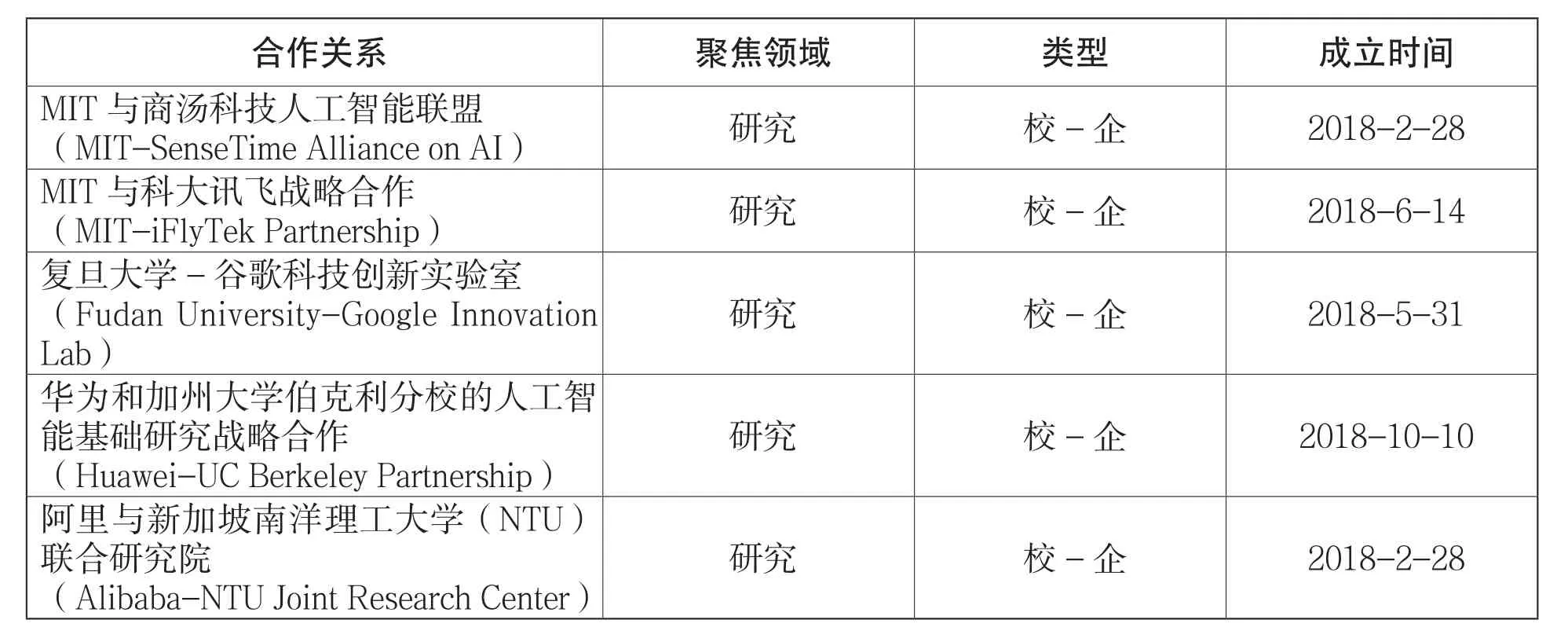

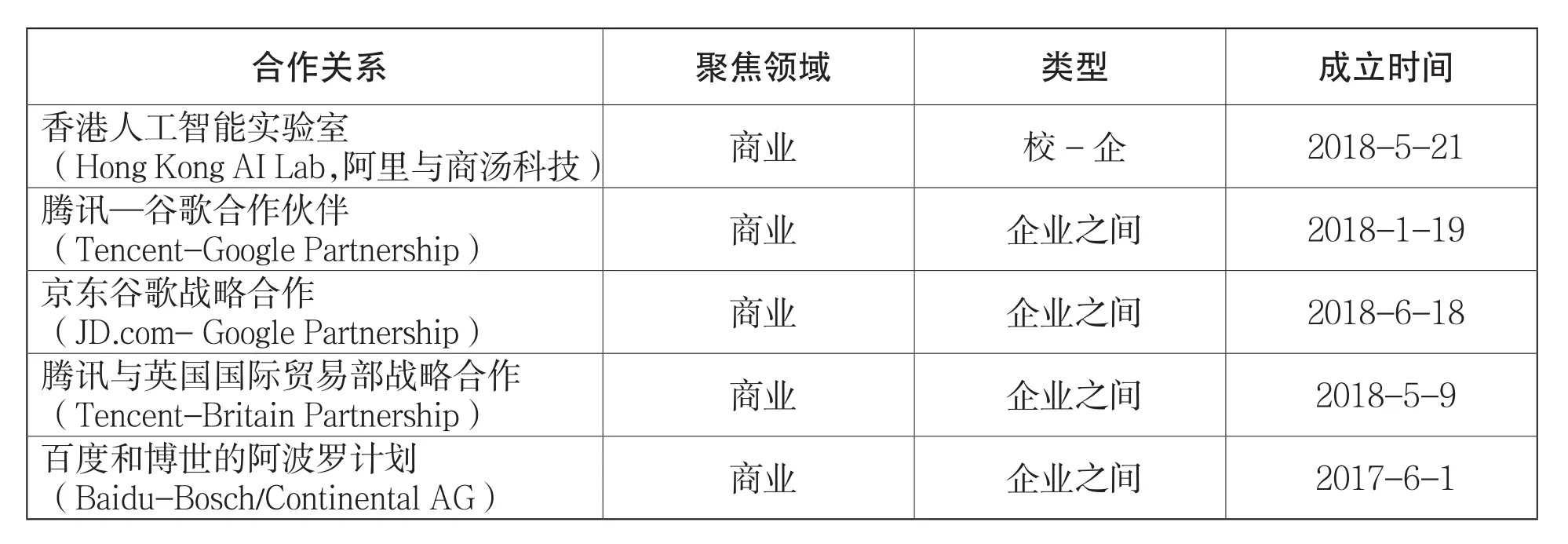

中国和美国是全球最大的两个AI国家,如果中美两国之间如果没有达成某种共识,那该是何种景象?欧盟固然很重要,但是影响相对较小,因为欧盟在人工智能领域没有大企业。我认为中美之间应该要达成某种共识,虽然现在感受到是“中美关系,越来越糟”,但我仍然期望中美关系能得到改善。也要看到好的一面,在企业层面有许多合作关系,目前大多是企业在主导合作伙伴关系,如美国的谷歌、微软、亚马逊等纷纷在中国进行相关AI安全相关的研究。可以看到中国的人工智能产业发展联盟(AIIA)及美国的AI联盟都是很好的载体,中国还有许多新成立的AI合作研究中心,这些会对中美的合作产生重要影响(见表2中美企业间的合作研究)。我们也看到中国新近成立了不少新的研究机构,而且大都是去年成立的,如360人工智能研究院、哈工大人工智能研究院、苏州大学人工智能研究院、科大讯飞与广汽研究院共创人工智能汽车技术创新中心、上海交通大学人工智能研究院、北京前沿国际人工智能研究院、清华大学图灵人工智能研究院等,其中某些研究机构应该会研究人工智能的伦理问题。

所有人对AI的应用前景满怀期待,但如果隐私问题得不到解决,人们将难以信任AI算法,从而危害整个行业,这是一个不容忽视的问题,我认为该问题需要人们投入更多关注。

合作关系 聚焦领域 类型 成立时间MIT与商汤科技人工智能联盟(MIT-SenseTime Alliance on AI) 研究 校-企 2018-2-28 MIT与科大讯飞战略合作(MIT-iFlyTek Partnership) 研究 校-企 2018-6-14复旦大学-谷歌科技创新实验室(Fudan University-Google Innovation Lab)研究 校-企 2018-5-31华为和加州大学伯克利分校的人工智能基础研究战略合作(Huawei-UC Berkeley Partnership)研究 校-企 2018-10-10阿里与新加坡南洋理工大学(NTU)联合研究院(Alibaba-NTU Joint Research Center)研究 校-企 2018-2-28

合作关系 聚焦领域 类型 成立时间香港人工智能实验室(Hong Kong AI Lab,阿里与商汤科技) 商业 校-企 2018-5-21腾讯—谷歌合作伙伴(Tencent-Google Partnership) 商业 企业之间 2018-1-19京东谷歌战略合作(JD.com- Google Partnership) 商业 企业之间 2018-6-18腾讯与英国国际贸易部战略合作(Tencent-Britain Partnership) 商业 企业之间 2018-5-9百度和博世的阿波罗计划(Baidu-Bosch/Continental AG) 商业 企业之间 2017-6-1

还有一个问题,AI产业的发展应当自我约束还是采用制度约束呢?《金融时报》曾经提到个观点:“基于有预见性及敏捷的监管可以让创新能在改善生活和维护公共利益之间的调节紧张关系方面发挥积极作用。要实现这一点,需要科学界和监管部门进行更有效的沟通。政府尽管事务繁忙,也应投入资源让公众了解人工智能的益处。”但普遍的观点是现在讨论规制人工智能产业还为时过早,还有一个问题是由谁来监管AI?由法院来监管可能并不妥当,可能由非政府组织或政策建议性团体来监管人工智能产业发展问题更好一些,他们可为政府应该在人工智能哪些方面进行监管提供建议。美国、中国、欧盟在AI问题上处理的方式不尽相同,多方共同协作将是一个挑战。美国倾向于在无人驾驶、无人机等特定子领域提出监管,中国面临的问题是行业监管还是成立新监管部门,而欧盟情况略有不同,最近有很多说法是欧盟越来越来像“管家婆”,事实也就像他们说的那样:欧盟喜欢监控一切事物。GDPR的第22章(Article 22)就提到人们应该能够对AI算法做出的决策进行解释,本条款实际并不可行。欧盟认定如何保护个人隐私、如何解释算法、算法如何导致最后的决策等这类问题很重要,但问题是并不容易实现算法的透明度。

我还是愿意再介绍一下美国的白皮书和中国的AI国家发展战略,这些建议为国际社会如何在AI领域,诸如安全和伦理问题的合作提供了思路。而欧盟在这些问题上有非常成熟的研讨,不仅是AI安全,还关注工业机器人、协作机器人、服务机器人及基于软件的AI代理。

最后我要说的是中、美两个大国,都有做AI的大公司,也有许多初创公司,像中国有阿里巴巴、百度等企业,它们将主导中国的人工智能行业。而欧盟在企业数量和规模上都无法与中美相媲美,因此他们更希望在监管上占上风,明白这一点很重要,毕竟中、美企业都希望在欧盟做生意,故而欧盟在此问题上的方案设定就比较关键,相信要不了多久他们就会出台详尽的监管框架。