智能视觉感知与理解研究态势分析

张 迪,鲁 宁,李宜展,滕 飞,王 丽

1.中国科学院 文献情报中心,北京 100190

2.中国科学院大学,北京 100190

3.中国科学院 自动化研究所,北京 100190

1 引言

视觉感知与理解是客观事物通过人的视觉在人脑中形成的直接反映,以及进一步的理解和认识。智能视觉感知与理解研究利用计算机系统解释视觉图像,实现类似人类或其他高等生物视觉系统理解外部世界的行为,是当前计算机领域的研究热点和难点。从1966年学科建立(Summer Vision Project,MIT)至今,尽管智能视觉感知与理解领域仍有大量难以理解,尚待解决的问题,该技术还是取得了长足的进步,尤其是随着视频内容的井喷发展,智能视觉感知与理解研究获得了大量的数据支撑,同时也获得了重要的应用场景。智能视觉感知与理解开始在智慧交通、智能安防、医疗影像分析、自动驾驶、机器人等领域获得重要的应用,各国也进行了相应的规划制定和项目部署,数据量的增加使大范围视觉感知和理解以及无人平台的视觉感知与理解成为重要的研究方向,行业各相关公司也都推出了重要的视觉感知与理解相关产品。

2 政策规划与项目部署

2.1 政策规划

视觉感知与理解技术是人工智能、智慧城市、智慧交通、智能安防等领域的重要研究内容。在人工智能、智慧城市、智慧交通、智能安防相关的规划部署文件中,都不同程度地提到对视觉感知设备和理解方法的研发需求和培育要求。

人工智能是信息时代的尖端科技,各国政府皆不遗余力的推进一系列人工智能战略和产业规划。美国在人工智能方面起步较早,科研机构、企业和军方为人工智能贡献了大量的技术和应用。智能视觉感知作为人工智能的主要研究领域,国家组织了大量的力量进行研究攻关,其中,2015年底,美国国家科学基金会(NSF)“国家机器人计划第四轮”联合国防部(DOD)、国防部高级研究计划局(DARPA)、国家航空航天局(NASA)、国立卫生研究院(NIH)、农业部(USDA)等联邦机构部门宣布,将投资3 700万美元用于推动协作机器人(corobots)的开发与使用,其中感知和理解方面,就涉及传感器/生物传感器系统和网络,针对特定目标的高空间分辨率和高时间分辨率的实时环境感知系统,各种光照条件下的目标识别感知系统和增强智能感知的策略等。2016年12月,白宫发布了一份名为《人工智能、自动化和经济》[1]报告,提出了联邦政府对智能监控方面的需求。韩国也非常重视人工智能领域的研究,韩国投资了引人瞩目的人工智能计划“Deep View”,该项目就是一项计算机视觉相关项目。我国人工智能虽然起步较晚,但政府也一直努力推进人工智能的研究,《“十三五”国家科技创新规划》明确人工智能作为发展新一代信息技术的主要方向,在围绕新一代信息技术等十大领域构建现代产业技术体系中明确指出“发展自然人机交互技术,重点是智能感知与认知、虚实融合与自然交互、语义理解和智慧决策”[2]。2016年8月26日,国家发展改革委发布《关于请组织申报“互联网+”领域创新能力建设专项的通知》[3],批准建立了由百度、清华大学、北京航空航天大学等组成的“深度学习国家队”,该国家队将在听觉、视觉感知和语言理解三个人工智能基础领域实现技术突破。发改委推出的机器人产业发展规划(2016—2020年)[4]提出重点围绕人工智能、感知与识别、机构与驱动、控制与交互等方面开展基础和共性关键技术研究。除了美国、韩国和中国之外,欧盟发起的“蓝脑计划”“人类大脑工程”也引领了人工智能前沿技术的发展,英国的“数字英国战略”、日本的“机器人新战略”、人工智能产业化路线图,都在国家层面对人工智能领域进行了部署。这些人工智能项目都涉及感知与理解的相关研究和部署。

智慧城市方面,日本“第5期科技基本规划”,提出名为“超级智能社会”[5]的未来社会构想,要最大限度应用物联网、机器人、人工智能、大数据等信息通讯技术,建设继狩猎社会、农耕社会、工业社会、信息社会之后的超智慧社会(社会5.0)。美国国家科学基金会(NSF)利用“产业与高校合作研究中心项目”(IUCRC)[6]鼓励以产研结合的方式加强物联网平台、智慧城市、交通及其管理系统方面的研究。智慧城市的建设离不开感知与理解技术的研发。

智慧交通方面,2017年2月,我国国务院印发了《“十三五”现代综合交通运输体系发展规划》[7],在提升交通发展智能化水平方面,提出了检测设备与交通设施同步建设,建立网络平台,形成动态感知、全面覆盖、泛在互联的交通运输运行监控体系。美国的《智能交通系统(ITS)战略规划2015—2019年》[8]提出包括实时监测、探测区域性交通流运行状况,快速收集各种交通流运行数据,及时分析交通流量运行特征、预测变化,制订最佳应变措施和方案,将远程信息处理网络连入车载装置等感知理解相关内容。

智能安防方面,我国《关于加强公共安全视频监控建设联网应用工作的若干意见》[9]提出截止2020年,相关部门将加大安防视频监控力度,使用人工智能等技术实现全网覆盖、全网监控,建立公共安全视频监控网和视频分析平台的指示。《中国安防行业“十三五”(2016—2020年)发展规划》[10]提出用视频结构化描述技术改造传统的视频监控系统,使之形成新一代的视频监控系统智慧化、语义化、情报化的语义视频监控系统,同时开展有关视频结构化描述数据的应用服务模式研究,针对典型应用环境制定视频结构化应用的系统及解决方案。

综合人工智能、智慧城市、智慧交通、智能安防方向的政策部署来看,视觉感知与理解都将在其中扮演重要的角色,政策着力点大多在于基础设置的建设以及相关感知与理解技术的研发。

2.2 项目部署

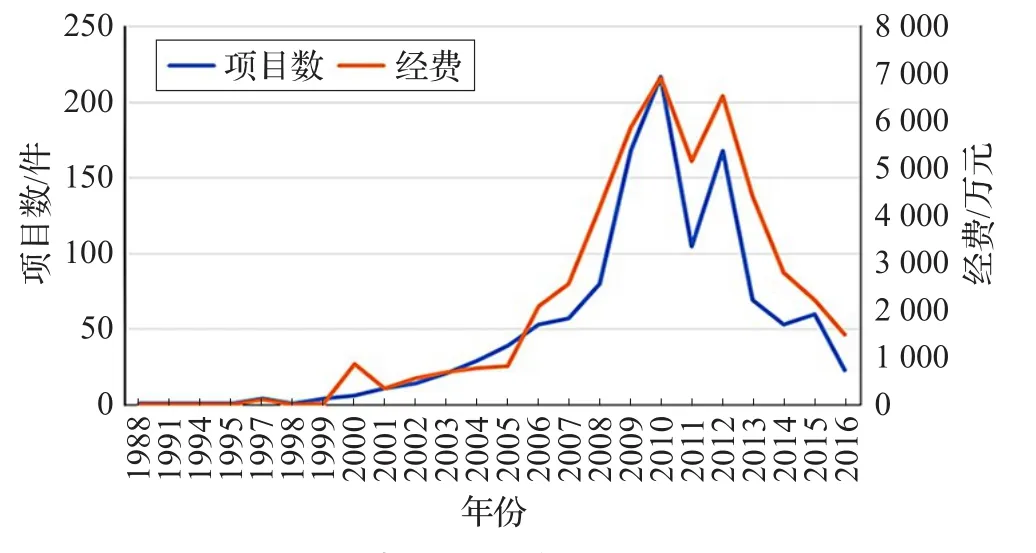

利用国家自然科学基金NSFC数据库数据对我国视觉感知与理解相关的项目进行分析,可以看出我国国家自然科学基金对该领域的项目支持力度是非常大的,截止2016年(由于数据库收录2016年之前数据),项目数量1 186项,经费近5亿。资助的项目从1988年开始,数量在2010年达到峰值。从项目类型来看,面上项目、青年科学基金项目、重大研究计划项目和重点项目的经费超过总额的85%。覆盖面也是较为广泛的,除主要的面上项目、青年科学基金项目外,还支持了专项基金项目、联合基金项目、地区科学基金项目、国际合作交流项目等,如图1和表1所示。

图1 国家自然科学基金项目资助趋势

表1 国家自然科学基金资助项目类型分布

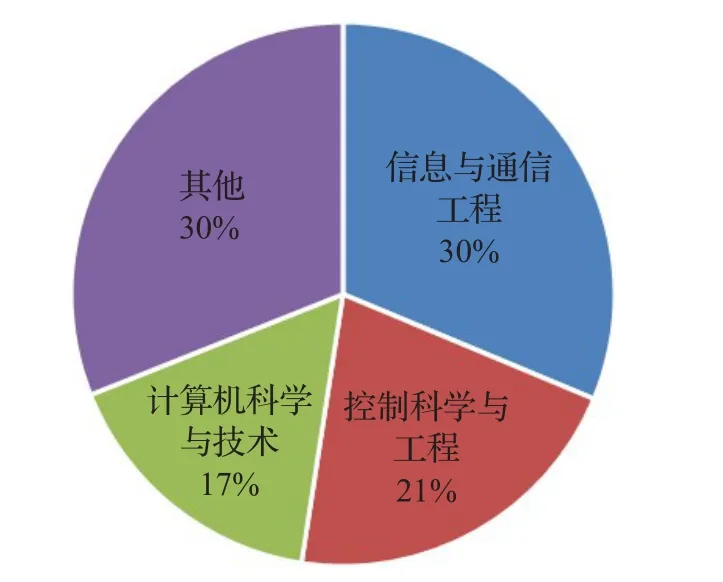

从项目所属的学科来看(图2),信息与通信工程、控制科学与工程、计算机科学与技术三大领域的项目数量最多,分别占总量的31%、21%和17%。在其他类型中,包含了地理学、生物、交通运输、管理工程、海洋等多个学科。从此也可以看出,视觉感知与理解领域的技术应用前景广阔。

图2 国家自然科学基金资助项目所属学科分布

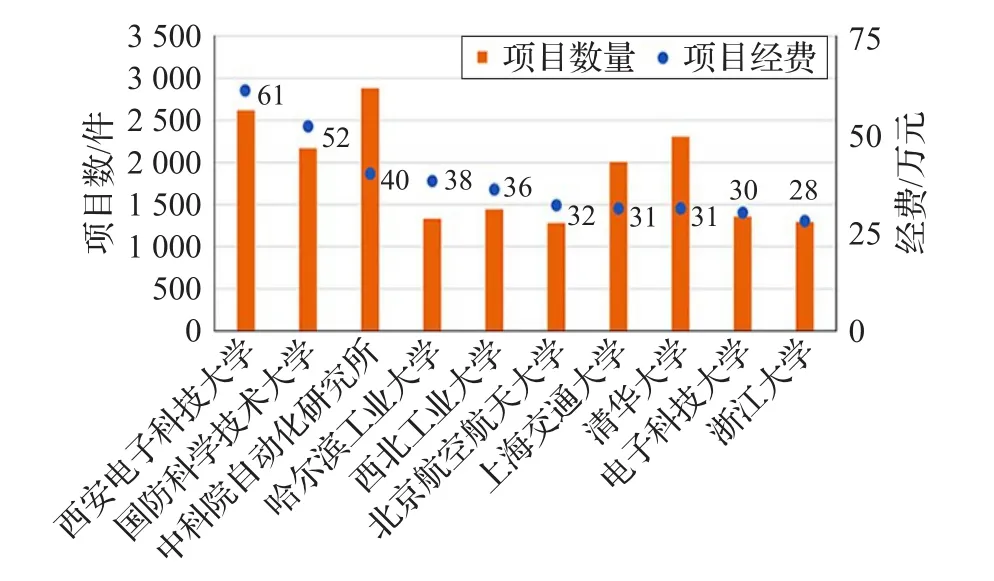

从项目申请的机构来看(图3),西安电子科技大学以61个科研项目排名第一,经费为2 614万元。中科院自动化研究所申请科研项目40项,虽然项目数不及西安电子科技大学,但经费数量2 885万元,排名第一。

图3 国家自然科学基金资助项目申请量TOP10机构

3 大范围视频视觉感知与理解研究态势

随着数字视频监控技术的发展和国际安全形势的日趋严峻,世界各国部署的视频监控系统越来越密集,摄像头等设备数量上的增加带来了大范围视觉采集的可能,通过人工处理这些海量的视频数据,变得很不现实的。基于计算机视觉的大范围视频内容识别和理解,就成为了大范围视频解析平台必不可少的核心技术。

黄凯奇等综述认为[11]基于视频的视觉识别与解析理解技术方法主要包括目标检测、目标分类、目标跟踪和行为分析四个方面,涉及特征选择与提取、特征降维、融合增强、姿态识别、个体识别、行为识别、事件分析等众多技术分支。单言虎[12]等综述了人的视觉识别行为研究,认为更为真实的使用场景,深度学习在时序数据中的应用,新型传感器数据将为视觉识别带来契机。姜丹[13]等综述了视频处理在智能交通中的应用现状及发展趋势,对基于内容的视频分析与检索视频检索系统进行了介绍。

本文通过对Web of Science数据库收录的大范围视频视觉感知与理解论文的计量分析,也可以观察近年来大范围视频视觉感知与理解的研究动态和应用情况。

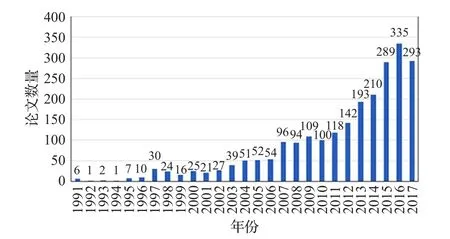

从图4可以看出,在20世纪90年代已经出现涉及大范围视频视觉感知与理解技术的研究,近年来的年发文量增长显著,尤其是在2013年之后,每年的增长量都在50篇左右(2017年数据不完整,仅供参考)。这说明视频视觉感知与理解的研究成果越来越多,研究受到了越来越多的关注。

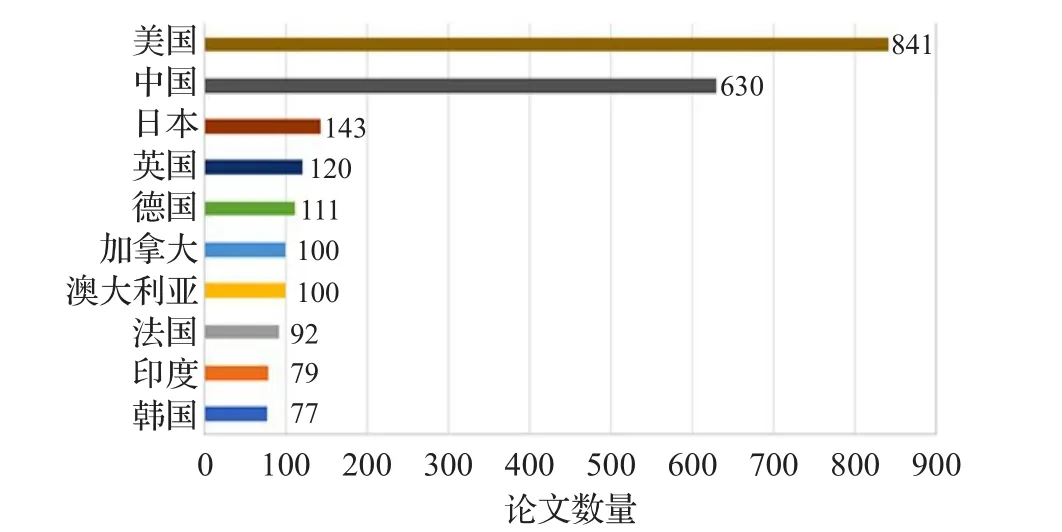

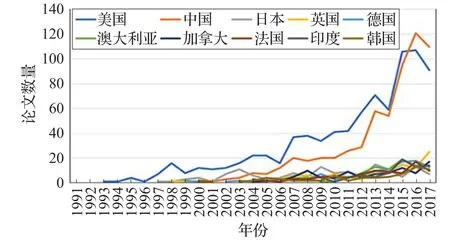

从发文国家来看(图5),美国和中国的产出较多,分别占总量的35%和26%,其后是日本、英国、德国、加拿大、澳大利亚、法国、印度和韩国。从美、中两国年度发文趋势来看(图6),美国的年发文量基本维持在年发文总量的30%~40%,而中国自2012年以来快速增长,出现明显的赶超趋势,其他国家的发文量保持缓慢增长的趋势。

图4 大范围视频视觉感知与理解方向发文趋势

图5 大范围视频视觉感知与理解方向论文国家分布

图6 大范围视频视觉感知与理解方向各国发文趋势

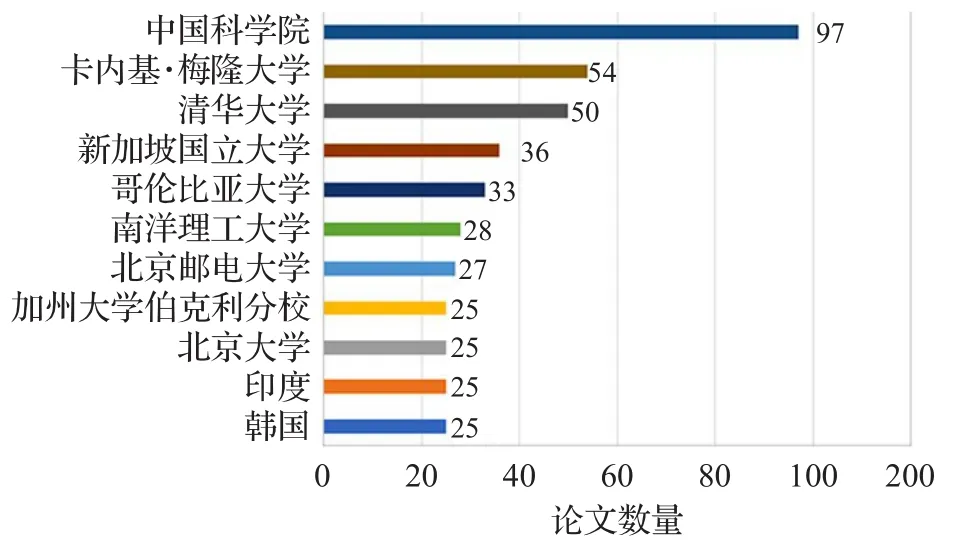

对发表论文的主要机构进行分析(图7),可以看出,大范围视频视觉感知与理解方面重要的研究机构是中国科学院、卡内基-梅隆大学、清华大学、新加坡国立大学、哥伦比亚大学、南洋理工大学、北京邮电大学、香港大学、微软亚洲研究院、北京大学和加州大学伯克利分校。

图7 大范围视频视觉感知与理解论文发表主要机构

基于此次构建的数据集分析,该领域的相关工作约有三分之二(1 616/2 383)发布在国际级的学术会议上,表2是排名前7的会议及其近期主题词。从这些会议的主题词的变化历程来看,研究内容和热点从目标检测与跟踪等底层算法向高层的行为分析技术转变,近年在复杂事件识别与分析、社会行为分析、人群分析等技术方向的研究热度颇高。另外,面部识别、相似行为(跑步与慢跑)等的识别也对算法提出了更为精细化的要求。同时,随着视频数据获取越来越容易,视频资源越来多丰富,针对大型数据的,基于语义的快速检索、去冗余、视频注释、摘要、字幕的生成技术也受到关注,在这些技术中也涉及到对图片、音频、属性的灵活应用,测试数据集也更为丰富和多元化,如Youtube、Google等。

从涉及的方法来看,对卷积神经网络(CNN)算法在精度、效率、新的辅助信息上的改进较多,另外深度学习、学习转移等方法在时序数据中的应用研究成为热点。

表2 大范围视频视觉感知与理解重要会议发文与主题分布

在应用来看,会议中报道了与大范围视觉感知相关的利用人的服装细粒度属性识别失踪人口[14];基于运动信息语义、建筑物的车辆检测[15];基于人群分析的报警系统与误报控制[16];利用网络视频重构近地尺度的图像以替代卫星数据[17];基于3D重建技术的航空广域运动分析[18];利用无人机视频分析以弥合地面和航空影像之间的差距[19];基于对象和场景解析技术的自动驾驶案例[20];基于行为分析的烹饪、外科手术的监控和评估[21]等等。可以看出,智能视频监控的应用领域也在快速地扩展。

4 无人平台视觉感知与理解研究态势

在摄影测量或遥感方面,原本需要靠高精度的地面控制点才能精确解算出影像的姿态信息和位置,随着定位精度和IMU灵敏性的提高,无人平台能够在不利用地面控制点的情况下获取精确的影像姿态位置信息[22];在侦查领域方面,可进行现场照片、指纹识别、手迹识别、印章识别等进行处理和辨识模糊人像等。此外,在智能汽车[23]、消防救援[24]、在产品质量检测、生产过程的自动控制、CAD/CAM等方面都有应用[25]。无人平台图像分析水平的高低直接决定了无人平台应用水平的高下,开发无人平台影像高效、自动化处理系统,建立无人平台图像信息深度挖掘体系,是目前关注的热点和研究的难点[26]。

如图8,揭示了无人平台视觉感知与理解技术Web of Science(2 997篇)收录论文数量的年度统计情况,可以看该技术呈现递增趋势。引用率高达887次的无人平台视觉识别技术出现在2007年,Davison等人在IEEE Transactions on Pattern Analysis and Machine Intelligence发表的“MonoSLAM:Real-time single camera SLAM”[27],该论文提出了一种实时算法,是依靠一个单一控制相机的移动机器人在纯视觉SLAM方法领域的首次成功应用,实现了从结构到运动方法的实时但无漂移的性能。主要创新点包括运用主动的方法来映射和测量,使用一般的运动模型、平滑的摄像机运动、单眼特征初始化和特征方向估计提供解决方案,目前的主要应用有实时三维定位。

图8 无人平台视觉感知与理解技术论文发表趋势

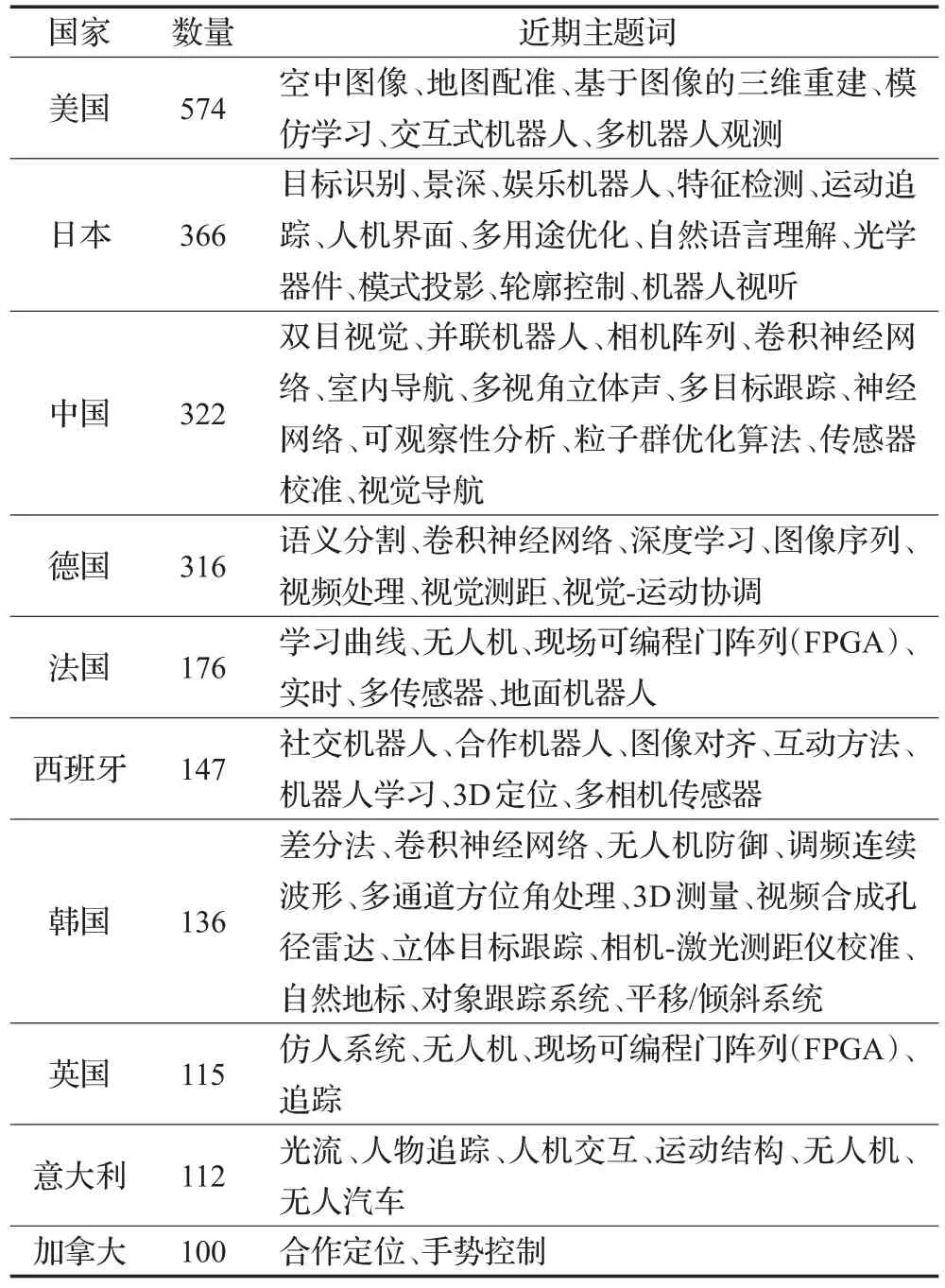

无人平台的视觉感知与理解技术主要研发国家是美国、日本、中国和德国,美国处于绝对领先地位,日本、中国和德国研发量相当。法国、西班牙、韩国、英国、意大利和加拿大紧随其后,如表3所示。对主题分析可以看出,近年来,无人平台视觉感知与理解的对象包括空中图像和地面对象,静态图像和动态图像;应用目标主要是静态或动态目标的检测、识别、追踪和分析,从而实现视觉导航和人机交互等功能;方法层面,差分法、光流法和统计学习模型依然是常用的方法,卷积神经网络算法的不断改进、语义理解和仿生视觉研究的加入也为无人机视觉感知与理解注入活力,3D定位和3D测量、3D目标跟踪等3D视觉技术在无人平台研究热点较高。形式层面,无人机、无人车、交互式机器人、并联机器人、娱乐机器人、社交机器人、合作机器人等无人平台形式拓宽了应用的同时为视觉感知和理解提出了更高的要求。

表3 无人平台视觉感知与理解技术论文发表国家分布情况(TOP10)

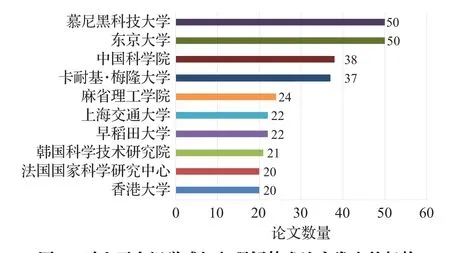

如图9,揭示了无人平台视觉感知与理解技术主要研究机构。排名前10位的分别是慕尼黑理工大学、东京大学、中国科学院、卡耐基梅隆大学、麻省理工学院、上海交通大学、早稻田大学、韩国科学技术研究院、法国国家科研中心和香港大学。

图9 无人平台视觉感知与理解技术论文发表的机构(TOP10)分布

5 产业应用

智能视觉感知与理解在智慧城市、智能交通、智能安防方面已经取得了一些好的应用案例,如韩国松岛智慧互联城市[28]利用思科统一的服务平台进行,核心技术组件是思科相关视频技术,这些嵌入街道和建筑物的传感器,可以检测从温度、湿度到道路交通条件等问题,帮助城市提高反应速度和运行效率。智能交通方面,智能视觉感知与理解技术为智能交通系统提供了更为直观方便的分析手段,可以在交通监控系统、交通指挥与诱导系统、自动驾驶与导航系统、辅助驾驶系统、智能收费系统、交通违章系统等方面开展应用。上海平安浦东视频联网监控[29]、苏州工业园自适应交通管控[30]、香港交通监控[31]、伦敦交通[32]、东京交通[33]都已经采用了智慧交通的理念。智能安防方面,波士顿爆炸案[34]中,社交媒体监视、互联网通讯分析、案发现场图像视频检索分析、监控摄像头硬件供应等技术发挥了强大的作用。

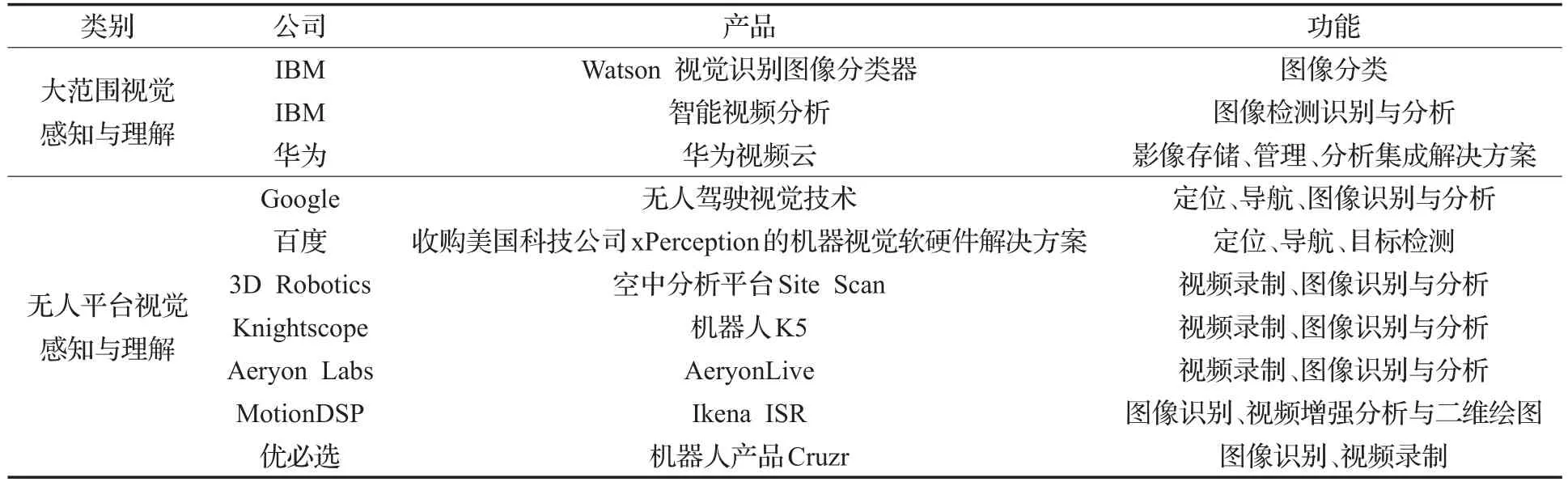

公司方面,大量行业相关公司研发或者布局了相关的技术和产品,表4举例介绍了典型的大范围视觉感知与理解和无人平台视觉感知与理解相关公司产品。

大范围视觉感知与理解方面,IBM公司[35]的Watson视觉识别图像分类器(Watson Visual Recognition)使用深度学习算法来分析场景、对象、脸和其他内容的图像,可以通过训练自定义分类器创建专门类,其采用了图形处理器(GPUs)的分布式网络,将所有信息融合到具有数万标签的卷积神经网络,并研发出利用语义推理优化图片描述的新推论方法。IBM智能视频分析可与Genetec、Milestone、Cisco、Acti和Pelco等视频管理软件和网络视频录制解决方案相集成,可轻松地集成其他支持Microsoft Direct Show Filter的解决方案,支持活动搜索、交叉关联和趋势分析,目前可以进行移动摄像分析、高级人脸检测与识别、支持CJIS密码政策、权限管理和视频文件的摄入。中国亦有大量公司推出相关的产品和服务,华为视频云[36]解决方案通过VCN和OceanStor两种方案实现城市监控视频的整体存储、跨域共享,保护视频数据安全,并支持弹性建设,平滑扩容。华为VCN平台将视频接入、流媒体转发、视频存储管理、录像点播、设备业务管理、录像备份、磁盘阵列各硬件设备单元合为一体,单台支持最高256路视频接入,并支持堆叠。不同警局单位的VCN节点可以通过网络组成监控云,最高支持20万路视频接入。华为OceanStor 9000视频云存储系统提供视频流整合、智能预取、IO直通等技术,使视频图像检索效率得到显著提升,支持4∶1存储读写比例。另外系统具有支持上千路视频并行分析处理的能力,可以对来自前端数千个高清摄像机的并发视频数据做到负载均衡、动态管理。针对原始视频、分析过程视频或图片、涉案事件视频或图片的信息关联管理,提供分布式并行检索与关联分析,让刑侦办案处于更有序的管理状态,帮助公安客户高效快速进行事件过滤筛选。华为智能分析云平台产品有VCM5020和VCM5010两种型号。VCM5020单机支持816路并发智能分析,实现千倍速视频采集摘要,视频快速搜索,车牌识别,行为分析,视频增强修复等丰富功能。VCM5010关键特征与VCM5020类似,单机支持96路并发智能分析。华为eLTE宽带集群解决方案,基于最先进的LTE无线宽带技术,上行吞吐量可达50 Mb/s,下行吞吐量达100 Mb/s。一网支持多媒体集群语音、视频调度,高清无线视频监控,远程数据采集和移动办公业务。目前,华为视频云解决方案已运用于敦煌安全旅游城市、信息科技下的平安龙岗、上海嘉定高清平安城市等项目中。

无人平台视觉感知与理解方面,行业领军的Google无人驾驶视觉技术借助了美国工业知觉公司的3D视觉系统[37],通过用OpenCV(计算机视觉和机器学习库)等分析由激光传感器等收集的图像,例如追踪物体的动态、物体识别、图像缝合、抓取风景提供虚拟现实功能等,来判断安全行驶路线,实现自动驾驶汽车上的图像识别和深度分析;Google通过与Jetpac公司在图像识别技术上的融合,对行驶道路上的目标障碍物的检测和识别匹配得到改进,体现在匹配识别时间的缩短和相关识别复杂程度的提升,并解决了在检测图像质量不佳的情况下提升其道路标示的可确定性,同时还增加了对行驶天气环境的感知,进一步获取更多行踪条件信息;对检测部件的改进体现在计算点阵、电控线路等方面。百度全资收购了专注于机器视觉软硬件解决方案的美国科技公司xPerception[38],面向机器人、AR/VR、智能导盲等行业客户提供以立体惯性相机为核心的机器视觉软硬件产品,其核心技术是惯性视觉定位与构图(Visual Inertial SLAM),其智能感知计算模块,集成了感知、定位、避障和导航技术,为第三方手机、VR设备、机器人等提供包括定位、识别、3D重建等功能在内的软硬件一体化解决方案。美国3D Robotics公司与索尼和Autodesk等公司合作[39],推出了直观、功能强大、开放的空中分析平台Site Scan,通过无人驾驶飞机提供易于执行、高分辨率的现实捕捉,网站提供了扫描数据的一键采集、处理和分析,易于商业用户从现场获得高保真的数据。美国Knightscope公司的机器人K5[40],可以使用其传感器在指定区域收集车牌、面部识别和人的运动等实时现场数据,分析数据时使用来自商界和政府的数据集作为参考,从而决定何时提醒社会和当局的关注。一旦警报响起,K5将打开所有的传感器,为整个社区审查数据和提供实时信息。Aeryon Labs公司的AeryonLive[41]是一个实时视频&遥感和机队管理的无人机系统平台,它是一个集成解决方案,可以保障Aeryon SkyRanger的现场视频和飞机遥测通过一个安全、可靠的结蜂窝网络进行在线传输,该公司的Vector™可用于实时高效的视频处理,其基于NVDIA TK1(提供一个四核2.2 GHz处理器和专用GPU)芯片搭建,嵌入于Aeryon的payload系列产品中,其图像处理功能提供运动目标的自动识别和跟踪。跟踪算法可实时锁定目标,即使目标位置变化或被其它对象阻碍视线,操作者可以在视场内直观地标注10个移动物体,显示器自动高亮显示目标,同时数字图像稳定。MotionDSP公司的Ikena ISR[42]是一款实时视频增强与二维绘图软件,ISR的图像处理算法,解决了震动、灰霾、照明等带来的问题,尽可能全部实时地获取无人机和安全摄像头的视频,操作者可以实时进行空中视频流的处理和增强,几分钟内从视频创建二维地图,检测和跟踪移动物体的精确到1~2像素。主要用于军事和公共安全领域。优必选公司的机器人产品Cruzr[43],可以通过SLAM算法,自主规划路径移动到目标位置,并能够实时避障。系统可以应用在视频监控领域,能够对运动物体进行检测,还可以对异常情况进行拍照或录影取证,并发送警报信息。另外,可以“行走”的机器人也能够实现动态的巡逻功能。

表4 智能视觉感知与理解典型公司与产品

6 总结与展望

智能视觉感知与理解技术作为人工智能、智慧城市、智慧交通、智能安防等领域的重要内容,具有重大的战略意义,近年来一直是战略部署以及项目支持的重要方向,预计随着智能社会的发展,其战略地位将进一步提升。

从学术角度来看,大范围视频视觉感知与理解的学术研究量呈现逐年增加的趋势,研究内容和热点从目标检测与跟踪等底层算法向高层的行为分析技术转变,针对大型数据的、基于语义的快速检索、去冗余、视频注释、摘要、字幕的生成技术也受到关注。理论方法方面,对卷积神经网络(CNN)算法在精度、效率、新的辅助信息上的改进较多,另外深度学习、学习转移等方法在时序数据中的应用研究成为热点。同时,亦可以看出应用领域的快速扩展,如失踪人口识别、车辆检测、烹饪、手术监控等。研究开始加速提高洞悉大数据的能力,追求更高水平的数据细节,对于科学家而言仍然是一个挑战,也将成为重要的突破方向。无人平台视觉感知与理解的学术研究量也呈现逐年增加的趋势,主题方面,差分法、光流法、统计学习模型一直在寻求改进,与此同时,卷积神经网络算法、语义理解、仿生视觉研究成为无人机视觉感知与理解研究的热点方法,3D视觉技术、无人机或机器人之间的交互协作成为热点技术方向。然而,无人平台视觉感知与理解的精确度、实时度、效率的提高依然需要探索的脚步。基于视觉技术的无人平台减少人为干预,实现多个无人设备之间的自主决策协同工作将是重要的发展目标。

从产业角度来看,大量智能视觉感知与理解的应用场景和公司产品促进了行业的繁荣,基于大规模数据的视频视觉感知与理解,以及无人平台的视觉感知与理解也成为产业应用的重要领域。大规模的深层学习和基于语义层面的可视化建模促进了视觉识别能力的提高,云平台等集成的产品形态和应用模式,综合的系统架构促进了应用向更深更广方向上的突破。无人平台技术和视觉感知理解技术的进一步融合,进一步拓宽了应用领域。然而,应用场景和产品用户的不同,硬件设备改造、软件集成以及本地计算设施的部署要求就不同,呈现一定的个性化定制特征,算法、技术的实际功效均是建立在对客户真实业务场景深层理解之上的针对性开发,开发成本高。缺乏标注数据是几乎所有应用场景普遍存在的挑战。虽然,将智能视觉感知与理解相关技术从实验室扩展到工业化应用的过程本身依然面临很大的挑战,但相信随着技术的改进,集成解决方案的发展,产业链的进一步成熟,智能视觉感知与理解产业将催生出更多深入消费者市场内部的优秀产品。