基于Oriental-Harris的特征匹配算法

赵瑞欣,向麒文

(西华大学计算机与软件工程学院,成都 610039)

0 引言

图像匹配技术是计算机视觉研究领域中的一个关键研究方向,也是许多计算机视觉理论与应用的基础。其主要目标是寻找同一场景或不同场景的两幅或多幅图之间的同质区域,进而根据同质区域的映射,建立起图像之间的空间对应关系。图像匹配技术在航空影像自动制图、图像三维重建、遥感融合、目标识别、目标跟踪、医学图像分析、影像理解等领域内都有着广泛的应用。在图像局部不变特征的研究中,需要解决三个核心问题:第一,如何提取特征点;第二如何描述特征点;第三,如何匹配特征点。其中,常见的基于角点的检测算子Moravec检测算子和Harris检测算子SU⁃SAN检测算子以及FAST检测算子等;典型的基于Blob的检测算子有Hessian检测算子、高斯差分检测算子、Hessian-Laplace检测算子等;基于区域的检测算子主要包括Harris-Affine检测算子、ERB检测算子、MS⁃ER检测算子等。角点检测只局限于角点,没有好的描述无法匹配;然而基于Blob的检测算子的描述,先统计特征周围信息,再确定主方向,在运动目标边缘处受到很大影响。为解决此类不足,本文提出在Harris检测算子基础上,对角点的角度大小和角度朝向做分析,并且通过角度朝向确定主方向,对特征点周围有用信息做统计。

1 特征描述

1.1 点角度大小和朝向

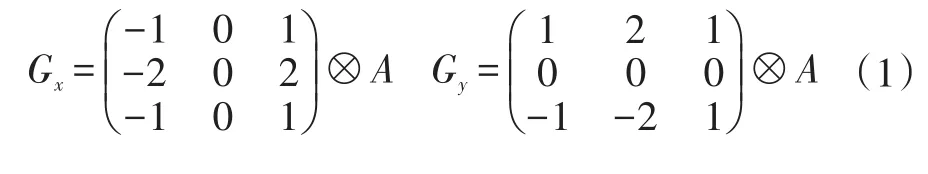

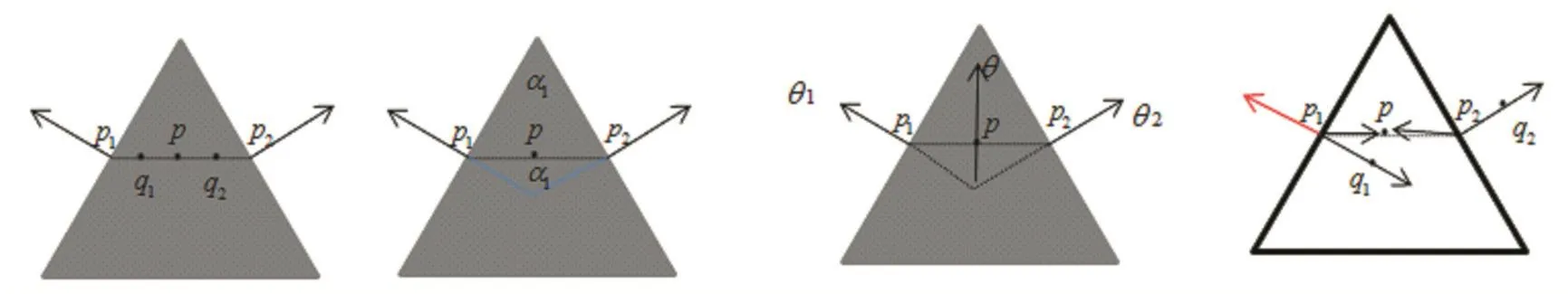

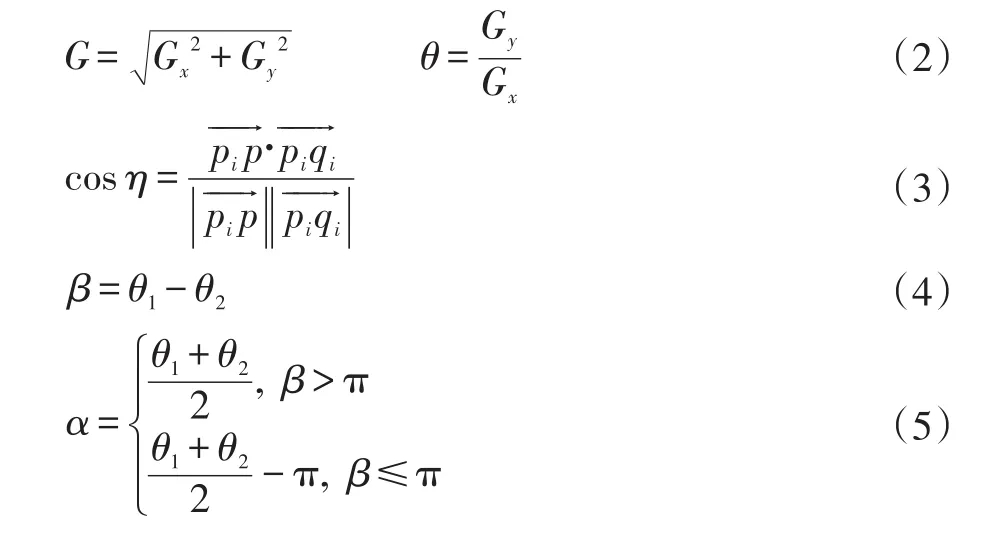

本文通过Harris角点检测,得出角点集合Q{q1,q2,…,qn},如图1所示:通过如下公式计算图像梯度以及梯度方向信息。其中,A为待处理的图像,Gx为A的x方向的偏导,Gy为y方向的一阶偏导,G为其梯度幅值,θ为梯度方向。在检测到的角点附近,通过找梯度内部点p的对称点p1和p2如图1(a)所示,由p1和p2的梯度方向计算角度朝向和角度大小,如图1(d)所示,根据公式(3),把“异常”梯度方向矫正(相对本文计算角度思路为异常,实际梯度方向是正常的),若cos η为正,方向水平翻转如图1(c);若cos η为负,不做改变。再由公式(4)和公式(5)计算角度大小公式(4),和角度朝向公式(5)。

图1 角度朝向计算过程

1.2 特征描述

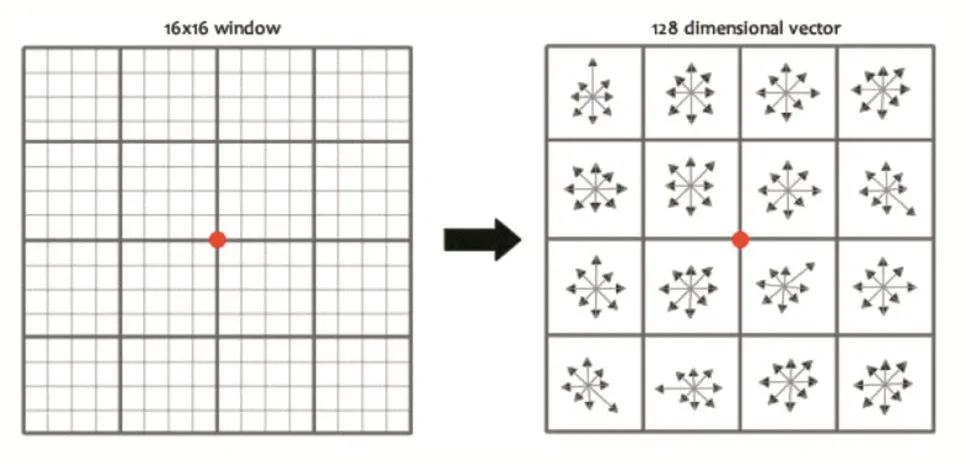

本文采用SIFT类似的描述子做描述。通过上文检测出角点的角度大小和角点朝向。其中角度朝向作为主方向,统计角点沿角点朝向负方向的梯度信息做统计。根据SIFT算法特征描述,如图2所示。在种子区域的梯度直方图在0-360度之间划分8个方向区间,每个区间为45度,即每个种子点有8个方向的梯度信息。把0-360度分为16个小的种子点,分别做统计,这样就形成16×8=128维稳定描述子。

图2 SIFT描述子

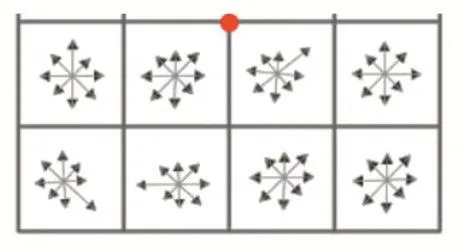

根据前面对SIFT类型描述子缺点分析,128维描述子虽然稳定,但是在目标边缘处包含背景信息太多,导致目标边缘处的特征点无法匹配的上。如图3所示,本文中把128维向量特征减为64维,就是根据角点朝向信息,提取有用的信息进行统计,这样既有SIFT特征向量的稳定性,又能最大保证统计信息的可靠性,从而提高匹配率。

图3 文章描述子

2 实验结果分析

为检验本文算法的有效性,如图4,在室外场景的车辆行驶过程中匹配结果和SIFT算法匹配结果对比。两帧之间的车辆,在目标车辆的车头车尾车轮和车窗部分都有匹配信息,从而可以准确把握运动目标整体的运动矢量信息,而SIFT算法只有在车尾部分比较集中,其他地方匹配上的比较稀少。通过对比可以看出本文算法相对于SIFT算法在运动目标上匹配是有优势的。

图4 和SIFT算法对比

3 结语

本文算法中,在运动目标匹配上对SIFT类型算法很有优势,但是角点的角度大小和角度朝向都依赖于角点附近的梯度信息,一旦梯度信息较弱,很有可能会对本文算法产生影响,另外角点可能是几个不同属性的部分交叉在一起的,这里只保留其中一个,导致部分信息丢失,后续工作应该把不同属性的点都保留下来做匹配,会进一步提高运动目标的匹配率。

[1]Loncomilla P,Ruiz-Del-Solar J,Martinez L.Object Recognition Using Local Invariant Features for Robotic Applications:A Survey[J].Pattern Recognition,2016,60:499-514.

[2]Verhagen B,Timofte R,Gool L V.Scale-Invariant Line Descriptors for Wide Baseline Matching[C].IEEE Winter Conference on Applications of Computer Vision,2014:493-500.

[3]Montazer G A,Giveki D.Content Based Image Retrieval System Using Clustered Scale Invariant Feature Transforms[J].Optik-International Journal for Light and Electron Optics,2015,126(18):1695-1699.

[4]Lenc L,Král P.Novel Matching Methods for Automatic Face Recognition Using SIFT[M].Artificial Intelligence Applications and Innovations.Berlin:Springer,2012:254-263.

[5]Chen Meng-ting,Yan Dong-mei,Wang Gang.Algorithm of High-Resolution Remote-Sensing Image Matching Based on Harris Corner and SIFT Descriptor[J].Journal of image and Graphics,2012,17(11):1453-1459.

[6]YUAN Liang.Visual Localization for Mobile Robot with Harris-SIFT,2014(6):19-24.

[7]Moravec H P.Rover Visual Obstacle Avoidance[C].International Joint Conference on Artificial Intelligence,1981:785-790.

[8]Manoranjitham R,Deepa P.Novel Interest Point Detector Using Bilateral-Harris Corner Method[C].International Conference on Advanced Computing and Communication Systems.IEEE,2017:1-4.

[9]Smith S M,Brady J M.SUSAN-A New Approach to Low Level Image Processing[C].International Journal of Computer Vision,2015:45-78.

[10]Rosten E,Drummond T.Machine Learning for High-Speed Corner Detection[J],2006,3951:430-443.