面向单体异形建筑的无人机单相机实景三维建模

刘 春, 曾劲涛,2,3, 张书航, 周 源

(1. 同济大学 测绘与地理信息学院, 上海 200092; 2. 流域生态与地理环境监测国家测绘地理信息局重点实验室, 江西 吉安 343000; 3. 井冈山大学 电子与信息工程学院, 江西 吉安 343000;4. 上海同繁勘测工程科技有限公司, 上海 200092)

城市建筑实景三维建模为城市数字化建设的重要组成部分,引发人们广泛的关注.现有建模方法主要分为3类.第一是利用3DS MAX、AutoCAD等建模软件,模拟建筑物的外形、尺寸和纹理,通过手工绘制获得建筑物的三维模型;但该方法建模周期长、效率低,且模型纹理的真实度不高,较难到达实景的要求.第二是利用激光扫描仪获取建筑的三维点云数据,并对点云进行三角格网化和纹理映射等处理,即可获得带纹理的三维模型[1];但该方法可能因建筑自身特点和扫描设站的客观限制而无法采集完整的建筑信息,故无法保证建模质量.第三是基于无人机倾斜摄影的建模方法[2-6],具有作业面积大、建模效率高和平均成本低的优点,目前已被广泛应用于城市建筑实景三维建模[7].该方法采用中、小型无人机、倾斜相机与垂直相机的组合阵列作为航摄装备低空采集建筑的多视角影像,并对采集的影像进行处理以生成建筑的实景三维模型.为此,影像采集的效率和质量直接影响了最终建模的效率和质量.

城市现代化建设促使单体异形建筑[8]不断出现,例如北京鸟巢国家体育场和苏州的东方之门等,它们通常为城市的地标型建筑,因而成为实景三维建模的重点对象,具有重要的建模价值.异形建筑相对于传统建筑,具有更复杂的外形结构和更丰富的纹理类型,因而具有更高的建模难度.现有的无人机倾斜摄影建模方法在应用于单体异形建筑时仍存在2个缺点.第一,无人机航高和相机倾角被固定,易造成观测盲区,导致信息采集不完整,影响建模的质量;第二,在大区域作业环境下,若单体建筑的高度远异于周围其余建筑,则作业需增加针对单体建筑的至少一次数据采集,导致采集效率降低、数据冗余度增大,影响建模的效率.除现有的无人机倾斜摄影建模方法外,亦有人尝试手动控制无人机对单体建筑进行摄影建模,但该方法涉及过多的人为操控,较难保证建筑信息采集的完整性,也易造成影像数据的大量冗余,同时也可因影像重叠度不足而导致建模失败.因而,目前仍然缺乏一种高效的适应于单体异形建筑的无人机实景三维建模方法.

本文针对单体异形建筑的实景三维建模问题,提出了一种无人机单相机建模方法.该方法选用小型旋翼无人机和单相机作为航摄装备,采用了一种环绕式的航路规划策略,可实现对单体建筑自动化、多高度和多角度的三维立体观测,以提升建筑信息采集的质量和效率,进而提升建模的效率和质量.本文对一个真实的单体异形建筑进行了建模试验,并从建模效率和建模质量两方面对比本文方法和无人机倾斜摄影建模方法的优劣.

1 无人机单相机实景三维建模方法

1.1 航摄装备

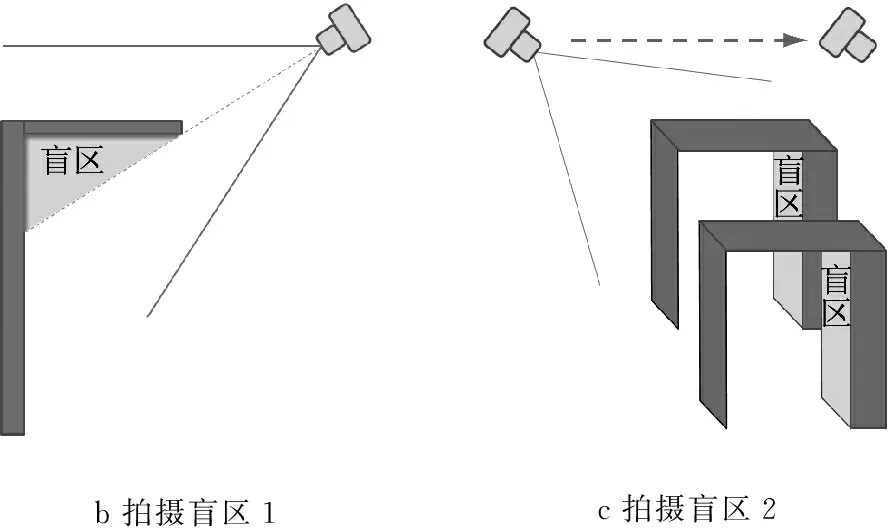

目前无人机倾斜摄影建模方法较常用的航摄装备为小型旋翼无人机和五拼相机阵列(含1个正射相机和4个不同方向且固定倾角的倾斜相机),如图1a所示.无人机以某一航高在单体异形建筑上方采用航带网式航路规划[9]进行航摄,如图2a所示.由于无人机高于建筑且相机倾角被固定,可能出现图2b所示的拍摄盲区1;同时由于航带的平行特性,可能出现图2c所示的拍摄盲区2.这些拍摄盲区将降低建筑信息采集的完整性,影响三维建模的质量.同时,含五拼相机的无人机倾斜摄影装备较适合大区域作业,可显著提升数据采集的效率,但若被应用于单体建筑,可导致数据采集的大量冗余,影响数据处理的效率.

显然,无人机倾斜摄影建模方法出现的拍摄盲区问题和数据冗余问题源于航摄装备和航路规划的限制.因此,本文提出了一种基于无人机单相机的实景三维建模方法,首先在航摄装备上采用了一种含单相机的小型旋翼无人机摄影装备,如图1b所示,其相机可通过配备的双轴云台调整倾角(0至90°)和方位角(0至90°),其具有高度不低于300 m的飞行能力,为实现对建筑的多高度、多角度观测提供了硬件基础.为提升数据采集的效率和质量,设计了环绕式航路规划.

a 含五拼相机的无人机倾斜摄影装备

b 含单相机的无人机摄影装备图1 无人机摄影装备Fig.1 UAV photogrammetry equipment

a 航路规划

b拍摄盲区1c拍摄盲区2

图2无人机倾斜摄影的航路规划和拍摄盲区

Fig.2PathplanningandblindviewareaofUAVobliquephotogrammetry

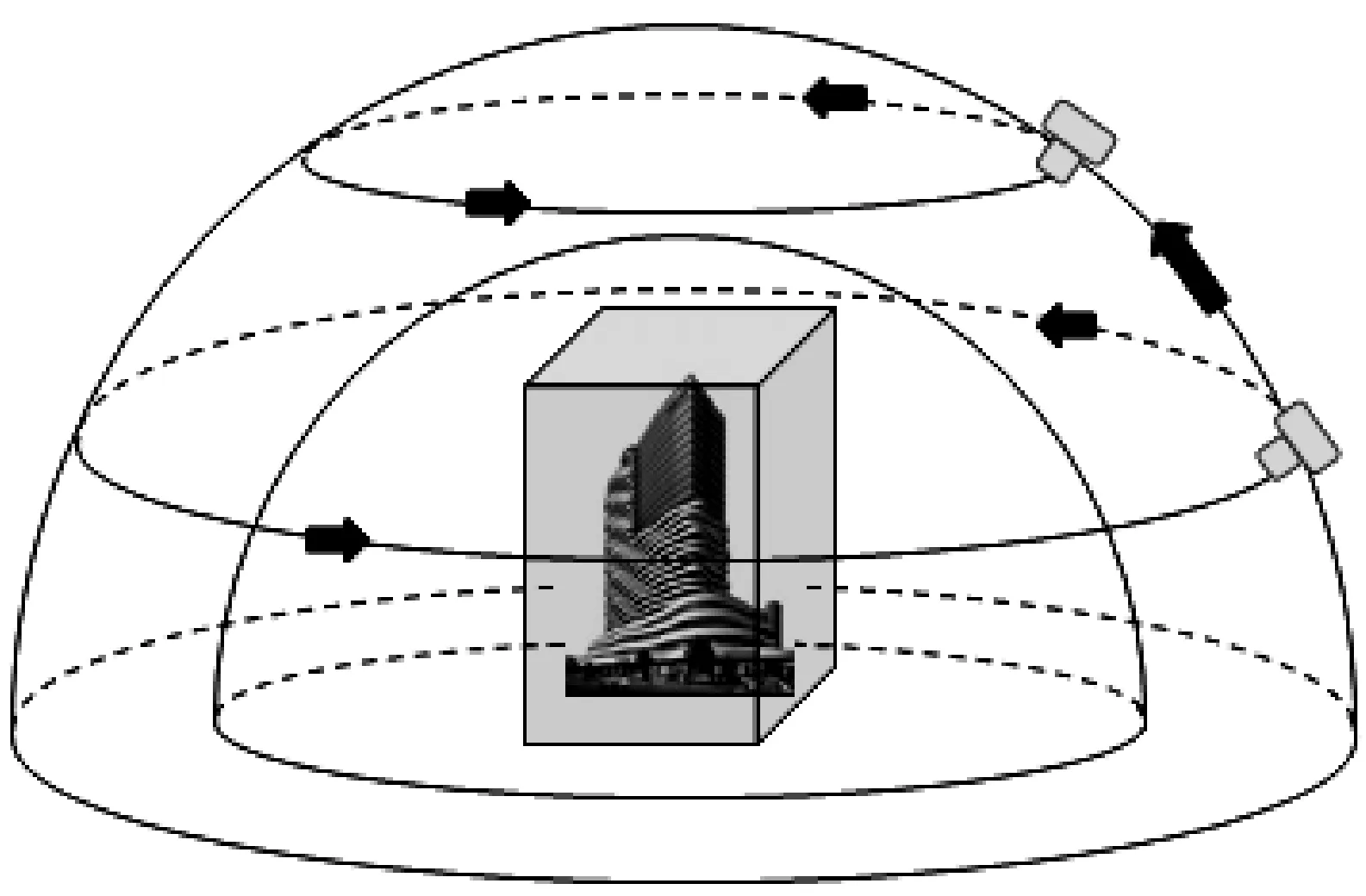

1.2 环绕式航路规划

在航路规划方面借助包围盒和包络球的思想[10].首先建立建筑物的最小长方体包围盒,以包围盒的底面中心点为球心建立包围盒的最小外接半球面;然后在外接半球面外建立一个同心的航路半球面,作为无人机的航路范围,如图3a所示;让无人机以某一航高和相应半径环绕建筑物飞行,通过云台调整使相机始终朝向球心,利用环绕航路,可实现对建筑物的多角度观测,可减少图2c所示的拍摄盲区,而多条不同航高和半径的环绕航路则可减少图2b所示的拍摄盲区.

a 异形建筑的包围盒、外接球面及航路球面

b 旁向影像重叠区的重叠圆弧

c 航向影像重叠区及重叠圆弧图3 异形建筑的包围盒、外接球面、圆形环绕航路及影像重叠区

Fig.3Boundingbox,circumscribedsphere,surroun-dingpathplanningandphotooverlapareaofaspecial-shapedbuildingunit

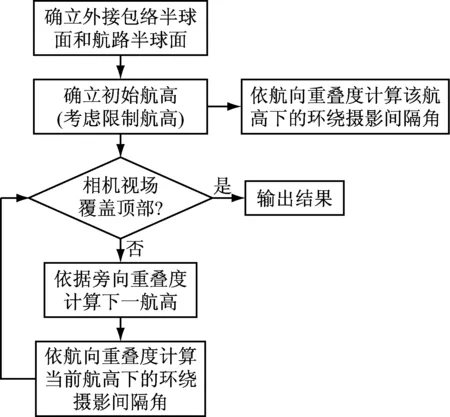

环绕航路数学模型的输入参数包含:建筑长宽高、航向重叠度、旁向重叠度、限制航高、相机垂直视场角、相机水平视场角、相机焦距、相机像素大小和影像空间分辨率.环绕航路数学模型的输出参数则包含:每条环绕航路的航高、每条环绕航路的半径和每条环绕航路的摄影间隔角.为求解环绕航路数学模型,除考虑建筑信息采集的完整性,还考虑环绕航路内的影像重叠度(航向重叠度)和环绕航路之间的影像重叠度(旁向重叠度).影像重叠度过低会降低数据后处理的质量,甚至导致建模的失败,而重叠度过高则会造成不必要的数据冗余,降低数据处理的效率.环绕航路数学模型的求解流程如图4所示,具体实现步骤和方法如下.

图4 无人机环绕航路数学模型的求解流程Fig.4 Solution of UAV surrounding pathplanning model

步骤1: 首先根据建筑的长、宽和高估算建筑的最小长方体包围盒的长、宽和高;然后建立包围盒的最小外接包络半球面;再建立一个与包络半球面同心的航路半球面,依据影像空间分辨率、相机焦距和相机像素大小计算相机到被拍摄对象的距离,可近似为航路半球面上相机到包络半球面的距离,即2个同心半球面的半径之差,从而确立航路半球面的半径大小.

步骤2: 确定初始航高.图3b为长方体包围盒、包络半球面和航路半球面的过包围盒对角面的垂直截面,C3和C4为无人机处于2条不同航高环绕航路的相机位置,O为圆心,O′为长方形上边的中点,OC3和OC4为相机的中轴线,θv为相机的垂直视场角,P5、P6、P7和P8为相机垂直视场的边界面与内圆弧的交点.由于相机中轴线指向球心,若已知相机中心轴与水平线的夹角α(相机倾角),则可计算出相应的航高.初始位置的相机倾角可根据异形建筑的实际情况设定,设置原则为尽量采集完整的建筑中下部信息,然后即可计算初始航高;同时考虑建筑周围可能存在障碍物,无人机须高于障碍物(限制航高),故应将计算的初始航高和限制航高两者中的较大值作为最终的初始航高.

式中:Oc为输入的航向重叠度;r1和r2分别为包络半球面和航路半球面的半径大小;θh为相机的水平视场角.

式中:r1和r2分别为包络半球面和航路半球面的半径大小;h1为当前环绕航路的航高;h2为下一条环绕航路的航高;Os为输入的旁向重叠度.

步骤6: 依据航向重叠度计算当前航高下的环绕摄影间隔角(参考步骤3的方法),并跳转至步骤4.

1.3 数据处理流程

采集的建筑影像数据需进行处理生成建筑的实景三维模型,其处理流程如图5所示.首先基于影像和定位定姿(position and orientation system, POS)信息借助光束法平差方法进行空中三角测量[11],获得影像的精确外方位元素;接着依据影像的内、外方位元素获取多视影像的同名点坐标,进行影像密集匹配[12],生成建筑的密集点云;然后计算点云的法向量并构建三维不规则三角网(triangulated irregular network, TIN)[13];最后进行纹理映射[14],针对TIN的每个三角形,选择最优的图像进行贴图,最终生成建筑的实景三维模型.

图5 数据处理建模流程Fig.5 Flow chart of true 3D modelling by data process

2 实景三维建模实例

2.1 试验区域和设备

试验采用了图1a和1b所示的2套无人机航摄装备,其配备的相机型号均为Sony A7,镜头焦距为35 mm,垂直视场角约为35.3°,水平视场角约为53.5°.试验对象为一幢大礼堂建筑.该大礼堂是一种典型的单体异形建筑,其东、西2个立面为曲面状,由占据整个立面90%左右的玻璃、钢架构成;其东面底部为一个两段式阶梯;其南、北2个立面都镶嵌了一个马鞍状的立柱,该立柱约占据整个立面的20%,除立柱之外的立面部分与地面垂直,立面主要由砖混墙面、玻璃和钢架组成;其顶部为3个曲面的组合,材质为钢、铁和铝的混合.该建筑的长、宽和高约为78 m、45 m和30 m(由于结构不规则,故都选取了最大值).

2.2 影像采集及建模

依倾斜摄影建模方法,无人机定高70 m,航向重叠度和旁向重叠度都为0.70,无人机按图6a所示的航路规划进行建筑物的观测.5个相机共采集了建筑的665张影像.

a 无人机倾斜摄影建模方法

b 无人机单相机建模方法图6 2种建模方法的航路规划图Fig.6 UAV path planning of two modelling methods

依提出的无人机单相机建模方法,环绕航路数学模型的输入参数为:建筑长宽高(78 m、45 m、30 m)、航向重叠度(0.85)、旁向重叠度(0.77)、限制航高(不低于50 m)、相机垂直视场角(35.3°)、相机水平视场角(53.5°)、相机焦距(35 mm)、相机像素大小(0.004 25 mm)和影像空间分辨率(1 cm).经计算,环绕航路数学模型的输出参数为:3条航路的航高(50.0 m、65.5 m、79.3 m)、3条航路的环绕半径(100.0 m、90.8 m、78.8 m)、3条航路的环绕摄影间隔角(5.31°、4.84°、4.03°).图6b为无人机单相机建模的航路规划图, 其中c1、c2和c3表示3条环绕航路.相机共采集了建筑的232张影像.

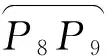

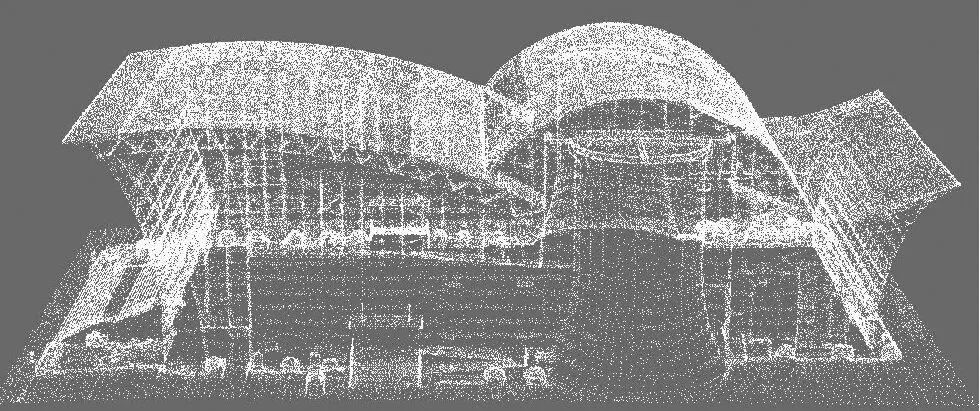

依前述数据处理方法,2种建模方法采集的影像数据被处理后生成了相应的密集点云、三维TIN和实景三维模型,如图7所示.

a 倾斜摄影密集点云

b 倾斜摄影三维TIN

c 倾斜摄影实景三维模型

d 单相机密集点云

e 单相机三维TIN

f 单相机实景三维模型图7 2种建模方法生成的密集点云、三维TIN和实景三维模型Fig.7 Dense point cloud, 3D TIN and true 3D model from two modelling methods

3 效率与质量评估

3.1 建模效率

为评价无人机倾斜摄影建模方法和无人机单向机建模方法的优劣,基于建模实例,从建模效率和建模质量2个指标对2种方法进行评估.

建模效率评估考虑了航行路程、影像数量和数据处理时间3个指标.数据处理的计算机环境包含CPU(i7 6700HQ)、内存(16G)和GPU(GTX980M).从表1可知,无人机单向机建模相对于无人机倾斜摄影建模具有较少的航行路程、较小的影像数据量和较少的数据后处理时间,表明具有较高的建模效率.

3.2 建模质量

建模质量评估考虑了量测精度和纹理细节2个指标,并参考了细节层次(level of detail, LOD)标准[15],判断2种方法建模分别达到的LOD级别.

表1 2种建模方法的效率对比Tab.1 Comparison between two modelling methodson efficiency

3.2.1 量测精度

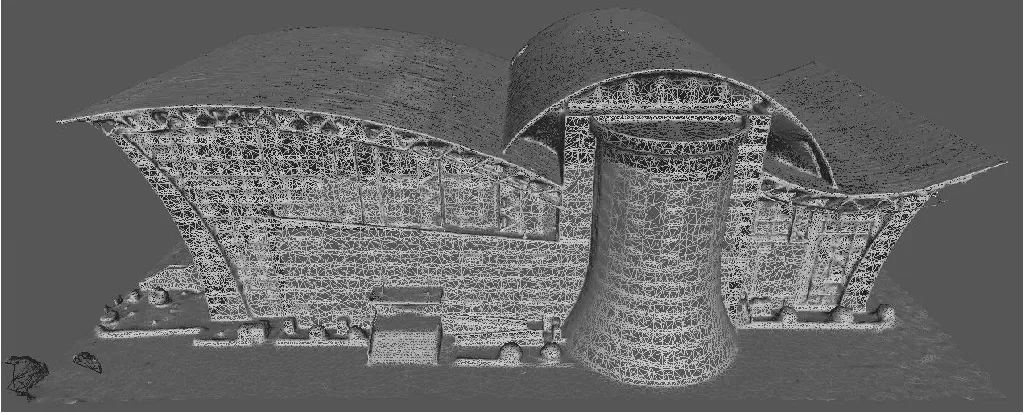

采用模型量测值与实景真值对比的方法评估建模精度,包含两点距离和两点高差的精度对比.首先,使用SOKKIA CX102全站仪量测了大礼堂建筑各个面的共38个检测点的站心坐标系坐标,作为实景真值.根据这38个点的相对坐标,计算了15个两点距离值和18个两点高差值,同时分别量测了三维模型对应检测点的距离值和高差值.图8显示了2种建模方法所建模型的距离量测值与真值的差值,结果表明2种方法具有较好的一致性.图9对比了高差量测值,显示两者有一定差异形,但总体差异不大.从表2的统计结果可知,在距离量测上,基于无人机倾斜摄影建模方法的模型量测值和真值的差值范围为(0.08±0.27)m,基于无人机单相机建模方法的模型量测值和真值的差值范围为(0.09±0.27)m;而在高差量测上,前者的模型量测值和真值的差值范围为(-0.05±0.06)m,后者的模型量测值和真值的差值范围为(-0.06±0.06)m.以上结果表明无人机倾斜摄影建模方法和无人机单相机建模方法的量测精度总体相当.

图8 2种建模方法所建模型的距离量测值与真值的差值

Fig.8Differencebetweendistancefromthemodelsbytwomodellingmethodsandcorrespondingtruth-value

3.2.2 纹理细节

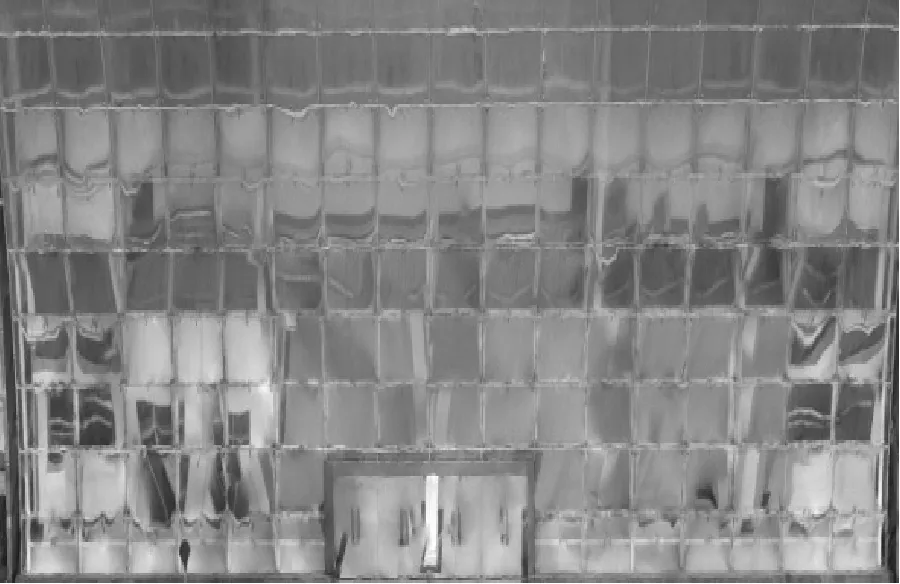

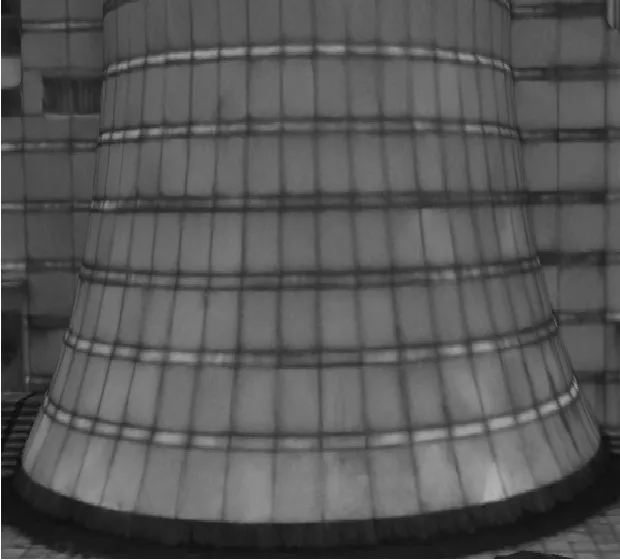

选取具有代表性的建筑纹理区域(图10),从完整性和一致性2个方面对比2种建模方法的建模质量.由于无人机单相机建模试验时的日照较无人机倾斜摄影建模试验时的日照弱,故获得的原始影像也较暗,最终生成三维模型的纹理亮度也较低.从图10a和10e的对比可以发现,无人机倾斜摄影建模的格网线条连贯性较差,出现了错落现象,而无人机单相机建模的效果较好,故具有更优的一致性;两者都没有纹理缺失,可认为两者的完整性相当.对比图10b和10f,无人机倾斜摄影建模存在较多纹理缺失,而无人机单相机建模则具有较完整的纹理细节,故具有更优的完整性.该结果缘于无人机单相机建模方法可实现多高度、多角度观测,能有效减少观测盲区,这同时也解释了图10g优于10c的结果.图10d和10h为大礼堂的一个以玻璃架构为主的立面,可以发现2种建模方法的效果都不是特别理想,但无人机单相机建模在完整性和一致性上都略优于无人机倾斜摄影建模.

图9 2种建模方法所建模型的高差量测值与真值的差值

Fig.9Differencebetweendifferenceofheightinthemodelsfromtwomodellingmethodsandcorrespondingtruth-value

表22种建模方法所建模型的距离量测值和高差量测值的对比

Tab.2Comparisonbetweenthemodelsfromtwomodellingmethodsondistanceanddifferenceofheight

精度指标距离量测值与真值的差值/m高差量测值与真值的差值/m无人机倾斜摄影建模无人机单相机建模无人机倾斜摄影建模无人机单相机建模最小差值0.0100.010最大差值0.840.890.160.19均值0.080.09-0.05-0.06标准差0.270.270.060.06

a 倾斜摄影建模局部1

b 倾斜摄影建模局部2

c 倾斜摄影建模局部3

d 倾斜摄影建模局部4

e 单相机建模局部1

f 单相机建模局部2

g 单相机建模局部3

h 单相机建模局部4图10 无人机倾斜摄影建模与单相机建模局部对比Fig.10 Detail comparison between UAV oblique photogrametry and single camera modeling

为进一步量化对比2种方法,定义模型“完好率”指标,将 “完好”定义为模型纹理不存在缺失或变形等与真实不相符的现象,并将“完好率”定义为单位面积内完好面积所占的比率.将单体建筑的4个外立面和1个外顶面分别用平面网格进行均匀划分(图11为某个外立面的示例),将每个网格作为一个面积计算单位,估算每个单位的完好率,并将5个面所有单位的完好率之和除以单位总数作为整个建筑模型的完好率.经统计,无人机倾斜摄影建模的完好率约为0.67,而无人机单相机建模的完好率约为0.79.

图11 均匀划分建筑外立面的平面网格Fig.11 Planar grids evenly partitioning the facade

依据LOD标准,LOD2规定模型量测精度不大于2m,LOD3规定模型量测精度不大于0.5m且模型具有完整的外部结构.依据本文试验的分析结果,2种建模方法所建立的模型都位于LOD2至LOD3 之间,且模型若经后期修补,可达到LOD3级别,但显然无人机单相机建模比无人机倾斜摄影建模具有更少的修补工作量.

4 结语

针对单体异形建筑的实景三维建模问题提出的无人机单相机建模方法相对于广泛使用的无人机倾斜摄影建模方法,简化了航摄硬件配置,提升了建筑信息采集的质量和效率,并在保证建模精度不降低的前提下提升了建模的效率和质量.该方法是现有基于无人机的城市建筑实景三维建模方法的一个补充,并具有良好的可行性、有效性和适应性,若被应用于建模工程实践,将有助于提升工程的效率和质量.后续研究将尝试不同的包络体类型,例如椭球、圆柱体等,以确立环绕立体观测的最优方式;可考虑2架或多架无人机的协同建模方法.同时,由于无人机需要在一定的高度飞行,单体建筑的中、下部分可能因为周围建筑或植被的遮挡而产生一些拍摄盲区,针对该情况,未来研究可考虑结合地面近景摄影测量,实现空、地一体的三维建模方法,并寻求该方法建模质量和建模效率的优化和平衡.

参考文献:

[1] HEO J, JEONG S, PARK H K,etal. Productive high-complexity 3D city modeling with point clouds collected from terrestrial LiDAR[J]. Computers, Environment and Urban Systems, 2013, 41: 26.

[2] YALCIN G, SELCUK O. 3D city modelling with oblique photogrammetry method[J]. Procedia Technology, 2015, 19: 424.

[3] 桂德竹. 基于组合宽角相机低空影像的城市建筑物三维模型构建研究[D]. 徐州: 中国矿业大学, 2010.

GUI Dezhu. Study on construction of 3D building based on wide-angle and combine camrera images from UAV[D]. Xuzhou: China University of Mining and Technology, 2010.

[4] 李德仁, 肖雄武, 郭丙轩, 等. 倾斜影像自动空三及其在城市真三维模型重建中的应用[J]. 武汉大学学报(信息科学版), 2016, 41(6): 711.

LI Deren, XIAO Xiongwu, GUO Bingxuan,etal. Obique image based automatic aerotriangulation in 3D city model reconstruction[J]. Geomatics and Information Science of Wuhan University, 2016, 41(6):711.

[5] PETRIE G. Systematic oblique aerial photography using multiple digital cameras[J]. Photogrammetric Engineering & Remote Sensing, 2009, 75(2): 102.

[6] HÖHLE J. Photogrammetric measurements in oblique aerial images[J]. Photogrammetrie, Fernerkundung, Geoinformation, 2008 (1): 7.

[7] 黑龙江测绘地理信息局. 全国倾斜摄影技术联盟百城巡展2016年首次活动在香港举办[EB/OL]. [2017-03-01]. http://www.sbsm.gov.cn/xwfb/gzdt/dfdt/201601/t20160115_211648.shtml.

Heilongjiang Bureau of Surveying and Mapping Geoinformation. The first tour covering a hundred cities of national oblique photogrammetry association was held in hongkong in 2016. [EB/OL]. [2017-03-01]. http://www.sbsm.gov.cn/xwfb/gzdt/dfdt/201601/t20160115_211648.shtml.

[8] 李清志. 异形建筑[M].[S.l.]: 三联书店, 2006.

LI Qingzhi. Special-shaped building[M]. [S.l.]: Joint Publishing Press, 2006.

[9] 冯文灏.近景摄影测量[M].武汉:武汉大学出版社,2002.

FENG Wenhao. Close-range photogrammetry[M]. Wuhan: Wuhan University Press, 2002.

[10] CHENG P, KELLER J, KUMAR V. Time-optimal UAV trajectory planning for 3D urban structure coverage[C]// IEEE/RSJ International Conference on Intelligent Robots and Systems, 2008. Nice: IEEE, 2008:2750-2757.

[11] 张祖勋,潘励,王树根.摄影测量学[M] .2版. 武汉: 武汉大学出版社,2009.

ZHANG Zuxun, PAN Li, WANG Shugeng. Photogrammetry[M]. 2th ed. Wuhan: Wuhan University Press, 2009.

[12] FURUKAWA Y, PONCE J. Accurate, dense, and robust multiview stereopsis[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2010, 32(8):1362.

[13] LABATUT P, PONS J P, KERIVEN R. Efficient multi-view reconstruction of large-scale scenes using interest points, delaunay triangulation and graph cuts[C]// IEEE, International Conference on Computer Vision. Rio de Janeiro: IEEE, 2007:1-8.

[14] NGUYEN H M, WÜNSCHE B, DELMAS P,etal. High-definition texture reconstruction for 3d image-based modeling[C]∥21st International Conference in Central Europe on Computer Graphics, Visualization and Computer Vision in Cooperation with Eurographics Association. [s.l.]:Vaclav Skala Union Agency, 2013:39-48.

[15] GRÖGER G, KOLBE T H, NAGEL C,etal. OGC city geography markup language (CityGML) encoding standard, version 2.0[EB/OL]. [2017-03-01]. http://www.opengis.net/spec/citygml/2.0.