无人机近红外传感器数据匹配方法

李迁, 甘拯, 支晓栋, 刘玥, 王建超, 金鼎坚

(1.中国地质大学(北京),北京 100083;2.中国国土资源航空物探遥感中心,北京 100083;3.长江空间信息

技术工程有限公司(武汉),武汉 410010;4.北京航空航天大学自动化科学与电气工程学院,北京 100191)

无人机近红外传感器数据匹配方法

李迁1,2, 甘拯3, 支晓栋2, 刘玥4, 王建超2, 金鼎坚2

(1.中国地质大学(北京),北京 100083;2.中国国土资源航空物探遥感中心,北京 100083;3.长江空间信息

技术工程有限公司(武汉),武汉 410010;4.北京航空航天大学自动化科学与电气工程学院,北京 100191)

随着无人机低空遥感技术的不断发展,其已成为一种重要的遥感技术手段。无人机传感器也从普通可见光向多/高光谱传感器发展,但鉴于无人机载荷小对传感器的限制,这些新型传感器数据质量较差,现有方法难以直接处理。因此,以无人机近红外传感器所获取数据为研究对象,基于尺度不变特征转换(scale-invariant feature transform,SIFT)匹配方法进行参数优化和粗差剔除,以解决无人机多/高光谱数据后期成图应用的关键技术,并对该方法进行实验验证。实验结果表明,通过该方法能够获取稳健的匹配结果,对提高无人机多/高光谱等新型传感器的应用效果具有重要价值。

SIFT匹配; 无人机; 近红外影像

0 引言

无人机低空遥感技术以其方便灵活、使用成本低、响应快速和可获得cm级数据成果等优势迅速得到各行各业的认可,并成为航空和航天遥感的重要补充手段。但是,无人机平台也存在很多不足,如有效载荷较小,极大地限制了机载传感器的发展。目前无人机传感器以可见光数码相机为主,在测绘等领域取得了较好的应用效果。然而对于地质、环境等领域,数据光谱范围较窄,使其应用范围受限。

随着无人机传感器的快速发展,已由传统可见光转向多/高光谱方向,出现了不少重量在3 kg以内的小型传感器。但由于这些传感器大多并不只为遥感应用设计,数据质量及其成像模式与传统遥感数据不同,存在相幅较小、噪声较大等问题,再加上无人机平台本身姿态差等劣势。在后期成图处理中,传统处理软件难以适应这类数据,匹配结果不能满足处理需要,较难实现数据成图及发挥遥感的“大视野”优势。

目前,在无人机影像匹配方面,传统的角点检测算法包括: Harris[1],FAST(features from accelerated segment test)[2],BRIEF(binary robust independent elementary features)[3],MSER(maximally stable external regions)[4],FREAK(fast retina keypoint)[5]和SIFT(scale-invariant feature transform)。但是,Harris算子不能很好地处理不同尺度的影像[1]; FAST和BRIEF特征不是旋转不变的[6]; MSER算法在高对比度的影像区域表现更好[7]。其中SIFT算法是最被认可的算子,但SIFT算法是以解决可见光影像为主,其参数设置都以可见光影像为对象,直接将SIFT算法应用于近红外影像匹配难以得到准确的匹配结果,甚至导致匹配失败。

基于无人机近红外数据特点,利用SIFT算法,通过优化SIFT匹配参数和随机抽样一致算法(random sample consensus,RANSAC)粗差剔除,获得可靠的匹配结果,通过图形处理器(graphics processing unit,GPU)的应用,提高算法效率,本文方法不仅能够满足实际应用的需要,还可为无人机近红外传感器的应用提供支持,并进一步提高无人机在地质、环境等领域的应用能力。

1 无人机传感器概况

在民用遥感领域,主要使用的是翼展3 m左右、续航2 h、有效载荷5 kg以内的小型无人机系统,该类无人机系统操作简单,系统稳定,起降适应性好。传感器是无人机遥感系统的重要组成部分,其性能决定了无人机遥感的应用范围及效果。主流无人机系统传感器是2×107像素左右的可见光数码单反相机。但随着科学技术的不断进步,近几年传感器小型化成为一种发展趋势,也为小型无人机系统扩展传感器类型提供了机会。

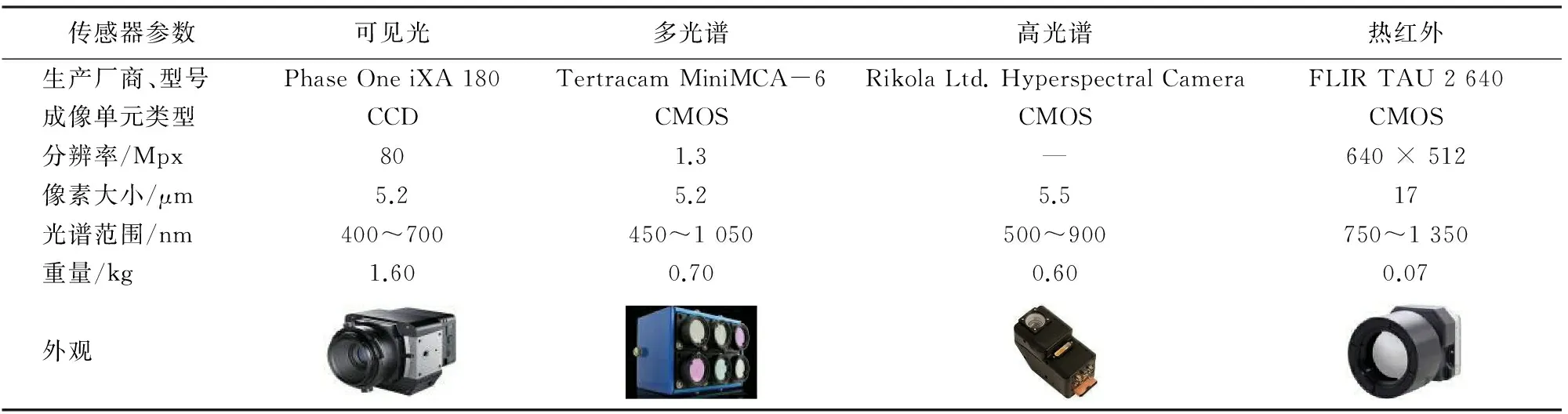

目前无人机上可搭载的遥感传感器包括中小幅面可见光波段相机、多光谱相机、高光谱相机、热红外相机、激光探测与测量(light detection and ranging,LiDAR)和合成孔径雷达(synthetic aperture Radar,SAR)等覆盖整个电磁波谱段的遥感设备。重量基本在2 kg以下,LiDAR和SAR的重量稍重,也都控制在4 kg以下,如RIEGL VUX-1(3.6 kg),IMSAR NanoSAR B(1.58 kg)。目前可应用于无人机的几种新型传感器及其主要性能如表1所示。

表1 无人机新型传感器性能

虽然上述多/高光谱传感器性能与传统可见光传感器差别不大,但其数据质量不同于传统可见光遥感数据。对于近红外传感器来说,由于目标及背景的近红外热辐射在传输过程中会受到大气吸收和随机散射作用,使得近红外影像目标与背景的对比度、清晰度和分辨率要低于可见光影像; 近红外数据方差变化小,影像边缘平滑,纹理信息弱; 而且其小型化与无人机搭载,造成其数据幅面小,影像姿态差和旋转角度大等问题。上述质量问题使得传统处理方法难以适用该类数据。

2 无人机近红外影像SIFT匹配方法

2.1 SIFT算法概况

SIFT算法通常在Lowe[8]设置的默认参数下运行,由于一般不针对不同的影像类型进行参数调整,造成一些特殊的影像数据难以获取足够多的特征点。为了匹配非可见光频谱范围数据,一些学者也提出了SIFT的改进方法,例如尺度限制准则[9]和描述子改进方法[10],或者通过更改SIFT参数使得在多波段数据集的特征点检测和匹配中获得成功,例如近红外灰度影像、高光谱短波红外影像和可见光影像之间的匹配[11-12]。

2.2 SIFT算法步骤

SIFT算法共包含4个步骤: 极值检测、特征点定位、主方向分配和特征点描述子生成。控制第一步骤的3个主要参数为组数(octave),每组第一级的初始高斯平滑模板大小(由尺度空间因子σ决定)和每组的尺度数(nScales)。第二步骤中,低对比度区域的不稳定潜在关键点用对比度阈值参数(contrast threshold,CT)去除,位于边缘的不稳定潜在关键点用边缘阈值参数(edge threshold,ET)去除。控制最后2个步骤的9个参数详见文献[13]。匹配描述子时需要确定距离比率(nnRatio)参数,用于排除错误匹配,推荐值为0.8。

虽然SIFT匹配算法共有15个参数控制,但在考虑其重要性、参数敏感性和控制优化复杂度基础上,选择了其中的5个参数:σ,nScales,CT,ET和nnRatio进行重点分析。

2.3 参数分析

σ决定了影像的平滑程度,σ值大对应大尺度(低分辨率),反之,σ值小对应小尺度(高分辨率)。大尺度对应影像的概貌特征,小尺度对应影像的细节特征。

nScales即组内层数S,为了在每组中检测S个尺度的极值点,则高斯差分(difference of Gaussian,DoG)金字塔每组需S+2层影像,而DoG金字塔由高斯金字塔相邻2层相减得到,则高斯金字塔每组需S+3层影像。

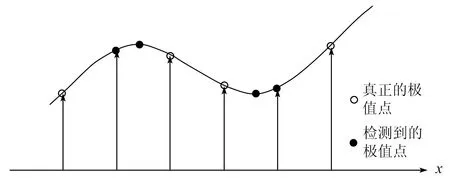

CT用于消除低对比度的点。但是,离散空间的极值点并不一定是真正的极值点,采用子像素插值方法(sub-pixel interpolation)可以利用已知的离散空间点插值得到连续空间极值点。图1显示了二维函数离散空间插值得到的极值点与连续空间极值点的差别。

图1 利用子像素插值得到的极值点

为了提高关键点的稳定性,需要对尺度空间DoG进行曲线拟合。CT也用来控制极值点的反复插值收敛。

由于DoG算子会产生较强的边缘响应,还需要利用ET剔除不稳定的边缘响应点。一个定义不好的高斯差分算子极值在横跨边缘方向有较大的主曲率,而在垂直边缘方向有较小的主曲率。

为了排除因为影像遮挡和背景混乱而产生的无匹配关系的关键点,Lowe提出了比较最近邻距离与次近邻距离的方法,距离比率nnRatio小于某个阈值时认为是正确匹配。对于错误匹配,由于特征空间的高维性,相似的距离可能有大量其他的错误匹配,从而nnRatio比较高。

3 实验

3.1 实验数据

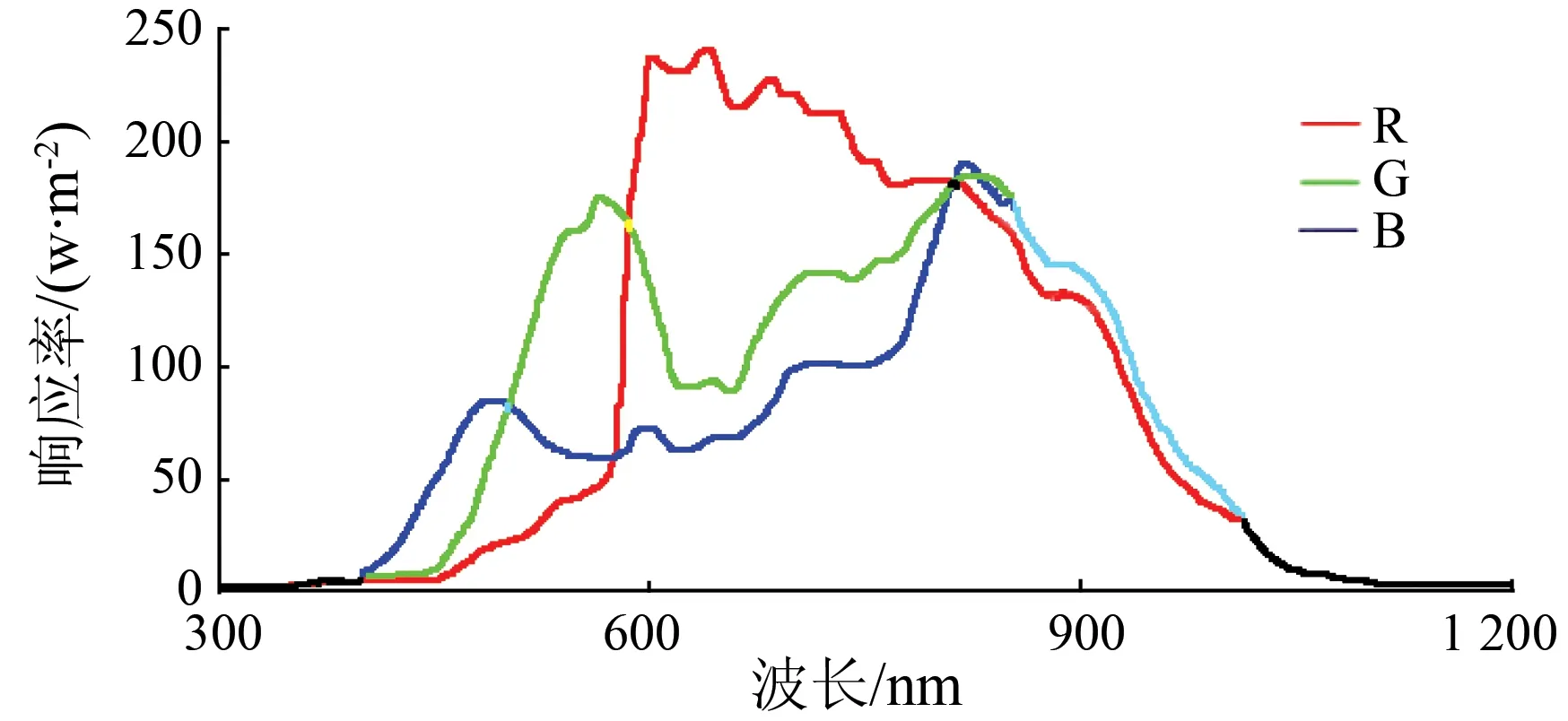

实验选用的传感器为Tetracam无人机近红外传感器,是由美国Tetracam公司研制设计,重量仅为200 g。该传感器获取的多光谱数据频谱范围包括红光、绿光和近红外波段(图2)。

图2 Tetracam相机波段特征

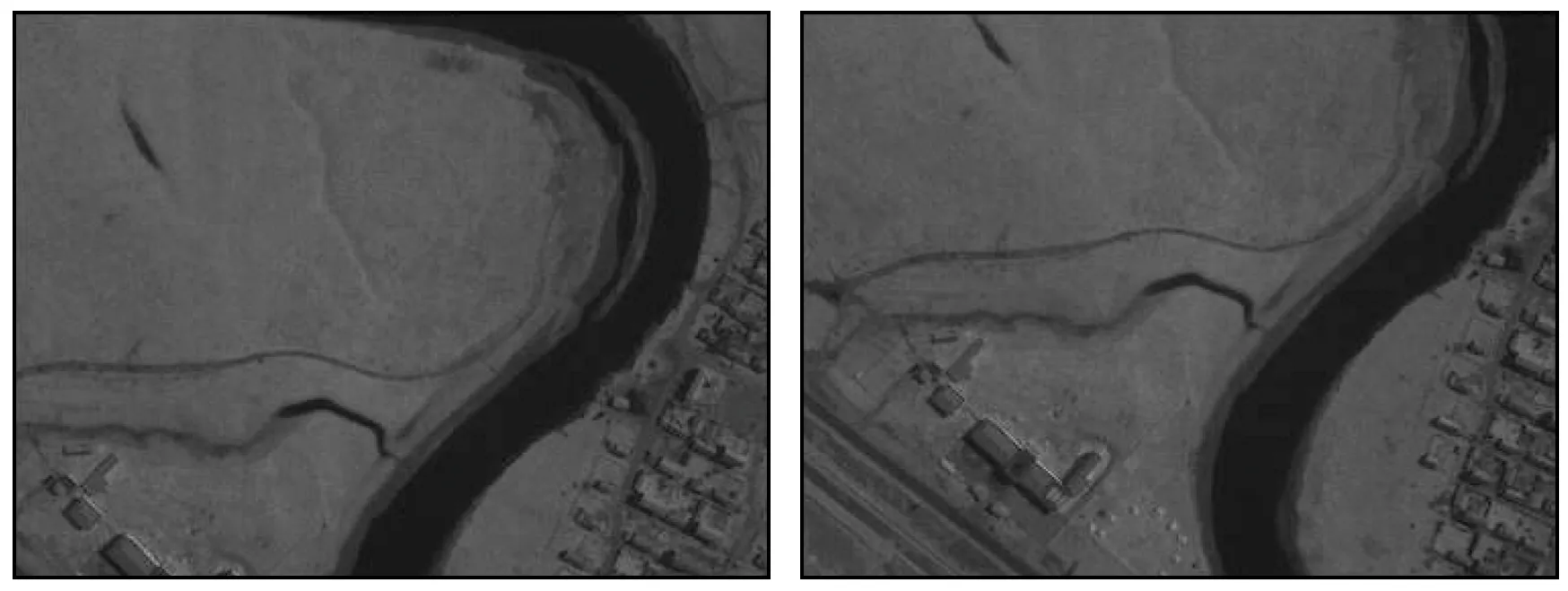

无人机近红外数据由中国国土资源航空物探遥感中心于2013年8月在四川若尔盖地区飞行获取,部分影像如图3所示。

(a) 影像1 (b) 影像2

(c) 影像3 (d) 影像4

(e) 影像5 (f) 影像6

图3 近红外波段灰度影像

Fig.3 NIR band grayscale image

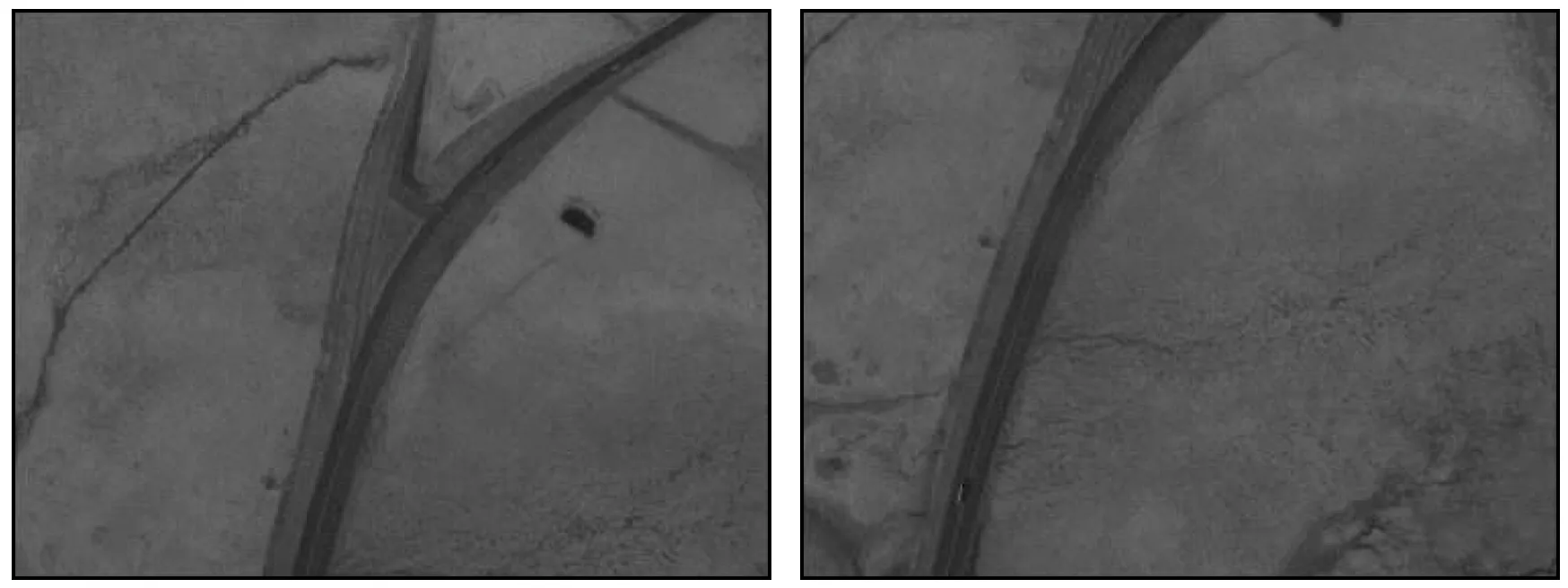

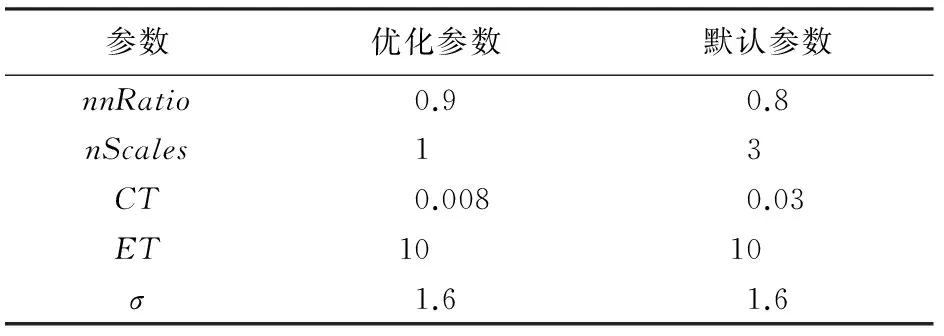

选择一组纹理特征好的建筑区和纹理特征差的草原区作为实例数据,如图4所示。

(a) 建筑区1(b) 建筑区2(c) 草原区1(d) 草原区2

图4 实例数据

Fig.4 Sample data

3.2 实验结果

3.2.1 参数优化

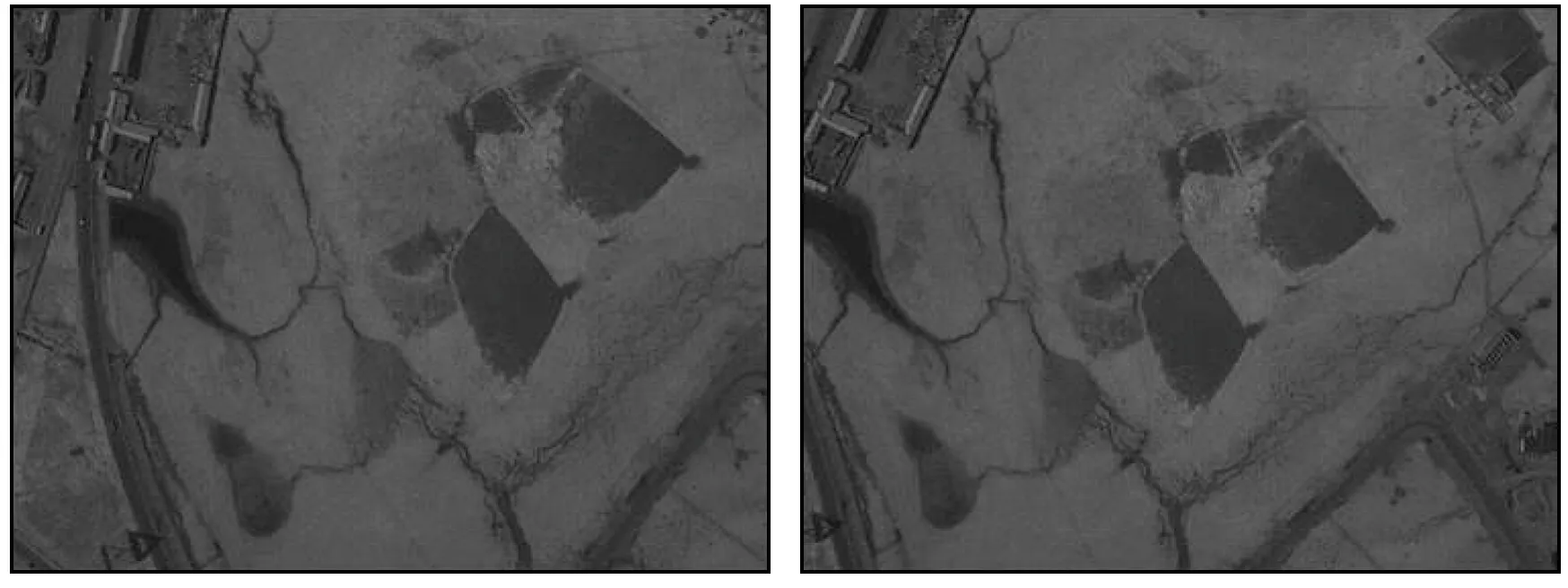

由于近红外影像纹理差,在增加特征点来获取更多匹配结果的同时,还应尽量减少错误匹配。针对实例数据,通过反复测试和结果统计,SIFT匹配优化参数和默认参数对比如表2所示。

表2 优化参数和默认参数对比

经过对比分析,针对各参数得到如下参考依据: ①对于近红外影像纹理较弱的特点,可以将nnRatio从默认的0.8提高到0.9~0.98,以增加匹配点数,然后再利用RANSAC算法剔除错误匹配结果,但是,由于该算法基于统计学,不依据影像本身的信息,nnRatio过大会留下个别错误匹配结果,所以该参数限定在0.9较好; ②对于可见光影像,增大nScale可以增加匹配点数,从3提高到6时,匹配点数提高了2.9倍,但同时也会延长处理时间,对于近红外影像,当CT取0.008且nScale取1时得到的匹配点数反而最多,继续降低CT,增大nScale才会提高匹配点数,但错误匹配结果也会随之增多,所以建议nScale取值为1; ③将CT从默认的0.03降低到0.01,会显著增加低对比度影像的匹配点数,但是取值过小会大幅增加错误匹配结果,多组数据测试发现,该参数不低于0.006 7时能有效控制错误匹配数量; ④相较其他参数,在本文实验中ET对匹配点数影响很小,可保持默认值10; ⑤虽然减小σ将得到更多匹配点,但是会造成匹配点过于集中并显著延长处理时间,经过反复对比测试,该参数仍取默认值1.6最佳。但是,仅根据本文实验结果不能确定ET和σ是否会对其他传感器获取的影像匹配结果产生影响,因此ET和σ也是下一阶段工作的研究重点。

3.2.2 匹配结果对比

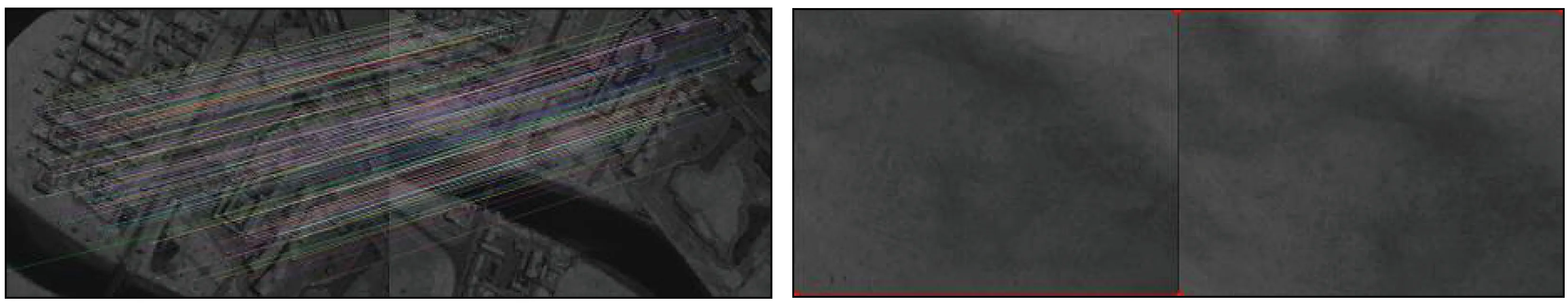

采用SIFT默认参数对近红外影像进行匹配的结果如图5所示。

(a) 建筑区 (b) 草原区

图5 默认参数匹配结果

Fig.5 Default parameters matching results

通过图5可知,默认参数的SIFT匹配对建筑区等纹理较好的区域能够获取较多匹配结果,但对于草原等纹理较差的区域默认参数难以获取可用的匹配结果。

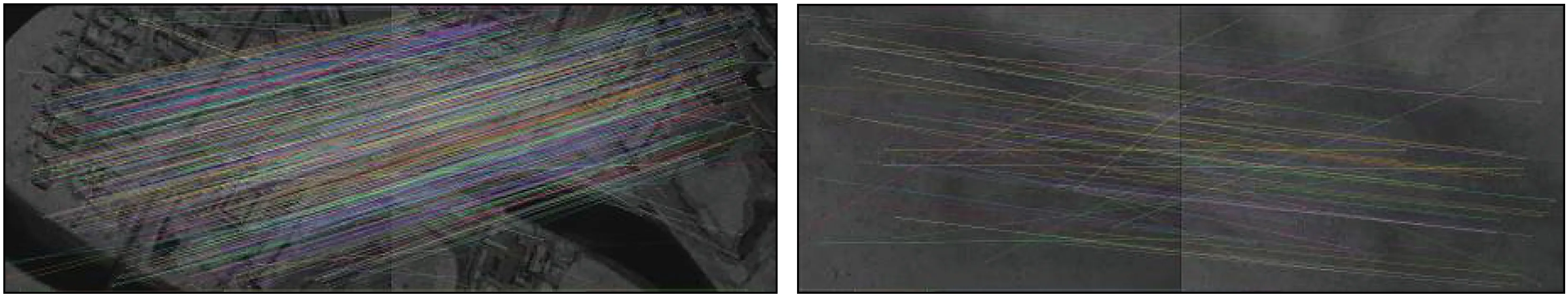

通过本文优化的匹配参数进行处理,可得到匹配结果如图6所示。

(a) 建筑区 (b) 草原区

图6 优化参数匹配结果

Fig.6 Optimized parameters matching results

通过图6可知,优化后参数能够显著增加匹配点数量,尤其是对草原弱纹理区域亦能获取较均匀的匹配结果,但同时也带来了较多错误。

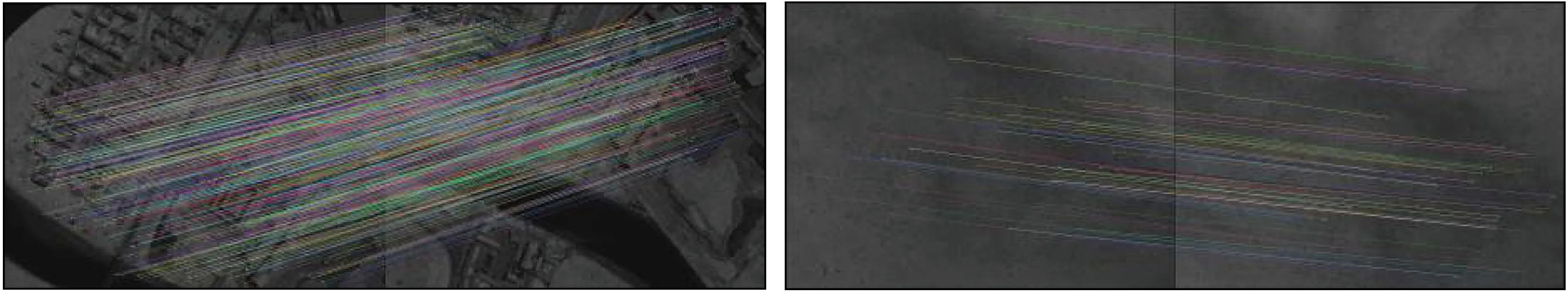

为了有效剔除错误匹配点,本文对优化参数的匹配结果采用RANSAC算法进行错误剔除。其结果如图7所示。

(a) 建筑区 (b) 草原区

图7 RANSAC算法错误剔除后匹配结果

Fig.7 RANSAC algorithm eliminate errors matching results

通过图7可知,利用本文优化参数及RANSAC算法错误剔除,近红外影像获得了可靠的匹配结果,在此基础上实现了相机姿态解算。

表3对比了2种影像在默认参数和优化参数及RANSAC算法作用下的匹配效果。

表3 匹配点数量对比

由表3、图5—7可见,本文提出的算法增加了建筑区影像的匹配点数,匹配结果分布均匀并在默认参数未实现匹配的一些区域也获得了可靠的匹配结果; 而针对草原区影像,在默认参数下未实现匹配,但本文算法却获得了足够数量的匹配点。研究表明,本文算法可有效改善近红外影像的SIFT匹配结果,以满足后期应用需要。

4 结论

本文基于近红外影像特点,分析并优化了SIFT算法的5个匹配关键参数,并利用RANSAC算法进行匹配结果错误剔除,从而得到了可靠的匹配效果,保证了本文所用近红外传感器数据的后期成图应用。各个参数选择依据的总结,对其他相似数据的匹配具有重要价值。

但本文仅针对某一传感器的参数进行测试,其优化过程不能实现自动化,在下一阶段工作中,继续研究影像质量评价及参数智能优化算法,更好地推进无人机多/高光谱数据的深入应用,为地质灾害调查及环境监测等工作提供有力的支持。

[1] Harris C,Stephens M.A combined corner and edge detector[C]//Proceedings of the 1988 Alvey Vision Conference.Manchester,UK:AVC,1988:147-152.

[2] Rosten E,Drummond T.Machine learning for high-speed corner detection[M]//Leonardis A,Bischof H,Pinz A,eds.Computer Vision-ECCV 2006.Berlin Heidelberg:Springer,2006:430-443.

[3] Calonder M,Lepetit V,Strecha C,et al.Brief:Binary robust independent elementary features[M]//Daniilidis K,Maragos P,Paragios N,eds.Computer Vision-ECCV 2010.Berlin Heidelberg:Springer,2010:778-792.

[4] Matas J,Chum O,Urban M,et al.Robust wide-baseline stereo from maximally stable extremal regions[J].Image and Vision Computing,2004,22(10):761-767.

[5] Alahi A,Ortiz R,Vandergheynst P.FREAK:Fast retina keypoint[C]//Proceedings of 2012 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Providence:IEEE,2012:510-517.

[6] Rublee E,Rabaud V,Konolige K,et al.ORB:An efficient alternative to SIFT or SURF[C]//Proceedings of 2011 IEEE International Conference on Computer Vision(ICCV).Barcelona:IEEE,2011:2564-2571.

[7] Morel J M,Yu G S.ASIFT:A new framework for fully affine invariant image comparison[J].SIAM Journal on Imaging Sciences,2009,2(2):438-469.

[8] Lowe D G.Object recognition from local scale-invariant features[C]//The Proceedings of the Seventh IEEE International Conference on Computer Vision,1999.Kerkyra:IEEE,1999,2:1150-1157.

[9] Zheng Y,Cao Z G,Xiao Y.Multi-spectral remote image registration based on SIFT[J].Electronics Letters,2008,44(2):107-108.

[10]Aguilera C,Barrera F,Lumbreras F,et al.Multispectral image feature points[J].Sensors,2012,12(9):12661-12672.

[11]Meierhold N,Spehr M,Schilling A,et al.Automatic feature matching between digital images and 2D representations of a 3D laser scanner point cloud[C]//Proceedings of the ISPRS Commission V Mid-Term Symposium on Close Range Image Measurement Techniques.Newcastle:ISPRS,2010,38:446-451.

[12]Sima A,Buckley S J,Kurz T H,et al.Semi-automatic integration of panoramic hyperspectral imagery with photorealistic Lidar models[J].Photogrammetrie-Fernerkundung-Geoinformation,2012(4):443-454.

[13]May M,Turner M J.Scale invariant feature transform:A graphical parameter analysis[C].//Proceedings of the BMVC 2010 UK.Aberystwyth,UK:BMVC,2010:1-11.

(责任编辑: 陈理)

Research on matching algorithm of UAV infrared sensor data

LI Qian1,2, GAN Zheng3, ZHI Xiaodong2, LIU Yue4, WANG Jianchao2, JIN Dingjian2

(1.ChinaUniversityofGeosciences(Beijing),Beijing100083,China; 2.ChinaAeroGeophysicalSurveyandRemoteSensingCenterforLandandResources,Beijing100083,China; 3.ChangjiangSpatialInformationTechnologyEngineeringCo.,Ltd,Wuhan410010,China; 4.SchoolofAutomationScienceandElectricalEngineering,BeihangUniversity,Beijing100191,China)

Low-altitude UAV remote sensing technology has become an important means of remote sensing technology. With the continuous development of the technology, its sensors have also changed from the visible ones to the multi/hyperspectral ones. However, due to the limitations of a small UAV payload on the sensors, the data quality of these new types of sensors is poor and hence it is difficult to deal with existing methods directly. Therefore, the authors studied the data obtained by UAV infrared sensors and then optimized parameters and removed gross errors based on the SIFT matching algorithm. This method has made robust matching results and can solve the key technology of the late mapping application of multi/hyperspectral data. The authors used a set of UAV infrared data to test and verify this method. The experimental results show that this method is capable of obtaining robust matching results and has a great value in improving applications of UAV multi/hyperspectral sensors.

SIFT matching; UAV; infrared image

10.6046/gtzyyg.2017.01.13

李迁,甘拯,支晓栋,等.无人机近红外传感器数据匹配方法[J].国土资源遥感,2017,29(1):86-91.(Li Q,Gan Z,Zhi X D,et al.Research on matching algorithm of UAV infrared sensor data[J].Remote Sensing for Land and Resources,2017,29(1):86-91.)

2016-06-22;

2016-09-27

中国国土资源航空物探遥感中心对地观测技术工程实验室航遥青年创新基金项目“基于红外光学传感器的低空遥感应急监测方法研究”(编号: 2013YFL09)和中国地质调查局地质调查项目“地质灾害低空遥感应急监测方法技术研究”(编号: 1212011120219)共同资助。

李迁(1983-),男,工程师,在读博士研究生,主要从事遥感技术应用方面的研究和管理工作。Email: bubb.lee@qq.com。

支晓栋(1983-),男,博士,主要从事无人机低空遥感、摄影测量与计算机视觉及遥感地质应用等方面的研究。Email: zhixdong@163.com。

TP 751.1

A

1001-070X(2017)01-0086-06