基于多视觉特征融合技术的高速机床刀具状态视诊方法研究

刘晓杰+范洪辉+朱洪锦+张旻

2摘 要: 传统多传感器融合的刀具磨损检测方法,通过依据特征变换的特征降维方法,完成多传感器融合的刀具特征降维处理,其对特征的描述性差,检测效率低。因此,设计基于多视觉特征融合技术的高速机床刀具状态视诊系统,该系统通过固定摄像机A采集整体刀具图像,可控摄像机B采集刀头图像。两个摄像机的视频图像都输入到图像采集卡中的数据采集电路进行处理。系统通过数据采集电路获取刀具图像数据后,将数据传递给数据处理模块进行存储和模/数转换等处理。采用STC89C52单片机设计显示报警模块,用于显示刀具磨损状态。系统实现部分给出了系统软件流程图,并通过BP神经网络方法融合多视觉特征信息,检测高速机床刀具的磨损情况。实验结果表明,所设计系统可准确检测出刀具的磨损状态,具有较高的检测精度和鲁棒性。

关键词: 多视觉特征融合; STC89C52; 高速机床; 刀具状态

中图分类号: TN911?34; TP39 文献标识码: A 文章编号: 1004?373X(2017)04?0167?05

Research on high?speed machine cutter condition diagnosis method based on

multi?vision feature fusion technology

LIU Xiaojie1, FAN Honghui2, ZHU Hongjin2, ZHANG Min2

(1. School of Electrical & Information Engineering, Jiangsu University of Technology, Changzhou 213001, China;

2. School of Computer Engineering, Jiangsu University of Technology, Changzhou 213001, China)

Abstract: The cutter wear detection method of the traditional multi?sensor fusion is used to perform the cutter feature dimension reduction according to the feature dimension reduction method of the feature transform, which has poor feature description and low detection efficiency. Therefore, a high?speed machine cutter condition diagnosis system based on multi?vision feature fusion technology was designed, in which the images of the whole cutter are collected by the fixed camera A, and the images of the cutter bit are collected by the controllable camera B. The video images of the two cameras are input into the data acquisition circuit in the image acquisition card for processing. After acquiring the cutter image data through the system′s data acquisition circuit, the data is transmitted to the data processing module for storage, A/D conversion, etc. The single chip STC89C52 is adopted to design the display alarm module to display the cutter wear condition. The system software flow chart is given in System Implementation paragraph in this paper. The multi?vision feature information is fused with the BP neural network method to detect the wear conditions of the high?speed machine cutter. The experimental results indicate that the system can detect the cutter wear condition accurately, and has high detection accuracy and robustness.

Keywords: multi?vision feature fusion; STC89C52; high?speed machine cutter; cutter condition

0 引 言

当前的高速机床在工业生成中具有广泛的应用价值,在机床加工过程中,刀具磨损问题成为刀具失效的关键因素。刀具失效导致工件加工质量低,使得机床出现故障,大大降低企业生成效率[1?3]。因此,寻求可靠方法对高速机床刀具状态进行准确检测,具有重要应用价值。传统多传感器融合的刀具磨损检测方法,通过依据特征变换的特征降维方法,完成多传感器融合的特征降维处理,其对特征的描述性差,检测效率低[4?6]。

文献[7]采用CCD照相机采集刀头图像,明确刀头区域同刀具磨损区域,进而准确检测出刀具磨损边缘点,运算出刀具的磨损量,但是该方法的抗噪性能较差,检测精度较低。文献[8]分析了依据传感器检测的刀具磨损状态检测方法,对传感器信号进行分析和采集,可运算出刀具状态变量,但是该方法的准确率低,主要应用于小范围的机械加工,具有较大局限性。文献[9]分析了基于多传感器融合的刀具状态检测方法,其通过依据特征变换的特征降维方法,完成多传感器融合的特征降维处理,但是该方法对特征的描述性差,检测效率低。文献[10]采用对滤式的特征选择算法完成刀具检测,该方法先塑造刀具的特征评估函数,并运算刀具特征间的冗余度,采用学习算法分析选择后的刀具特征准确率,完成刀具磨损状态的识别。但是该方法的检测精度较低,存在较高的偏差

为了解决上述问题,设计基于多视觉特征融合技术的高速机床刀具状态视诊系统。实验结果表明,所设计系统可准确检测出刀具的磨损状态,具有较高的检测精度和鲁棒性。

1 高速机床刀具状态视诊系统设计

1.1 系统结构

所设计的基于多视觉特征的高速机床刀具状态视诊系统硬件结构如图1所示。该系统通过双摄像机联合定位跟踪机床刀具,增强刀具信息采集的精度,通过一系列刀具特征采集和跟踪算法,采集同刀具磨损相关的视觉特征信息,通过BP神经网络方法融合多视觉特征信息,检测高速机床刀具的磨损情况。

系统通过双摄像机同时采集高速机床刀具图像。其中固定摄像机A采集整体刀具图像,可控摄像机B采集刀头图像。两个摄像机的视频图像都输入到图像采集卡中的数据采集电路接口,采用数据处理模块将模拟信号变换成数字信号。PC机采集刀具的数字视频图像后,采用基于BP神经网络的图像分析算法,获取刀具磨损信息,并通过显示报警模块呈现刀具磨损信息。采用UV60M一体化高速球型摄像机作为可控摄像机,该摄像机具有较高的转速和采集精度,满足高速机床刀具图像信息采集实时性的要求。

多视觉特征融合是对人脑综合复杂问题的功能模拟,多视觉特征融合系统中,不同摄像机采集不同的刀具信息特征,这些特征间存在一定的关系。信息融合可充分利用不同的摄像机资源,通过对不同摄像机及其观测信息的合理分配,可全面描述刀具的特征,为刀具状态检测提供了可靠的分析依据。

1.2 数据采集电路设计

高速机床刀具状态视诊系统要求实时准确采集和处理刀具图像信息,并且要求硬件系统尽可能小,安装到高速机床刀具中。

采用MEMS加速度传感器和无线射频芯片CC2430作为系统采集卡的核心,CC2430是嵌入式ZigBee应用的片上系统,其支持2.4 GHz 802.15/ZigBee协议,集成了高性能2.4 GHz射频收发器和工业级的控制器。CC2430是数据采集卡中的关键部分,其用于接收摄像机A和摄像机B采集的刀具视频图像数据,其硬件电路设计主要包括传感器电路、无线发射/接收电路、串口电路以及纽扣电源。将传感器电路、无线发射电路以及纽扣电源集成在一块数据采集和发射电板上,将串口电路和无线接收电路集成在另一块数据接收电路板上。数据采集和发射电路原理如图2所示,其采用串口将接收到的刀具视频图像数据传送到数据处理模块中进行处理。

系统将ADXL321当成机床刀具振动信号的加速度传感器,其可检测刀具的动态加速度和静态加速度。其电路原理图如图3所示。

加速度传感器的输出引脚分别接入到CC2430的P0.0和P0.1引腳。通过设定一组SFR寄存器的位和字符,能够确保P0.0和P0.1引脚作为连接ADC 的外围设备I/O口使用。

在机床刀具切割过程中,刀具同工件间相关作用形成振动。数据采集同发射电路部署在刀具上,通过加速度传感器检测x,y平面中的相互垂直方向上的加速度,将数据反馈给处理器CC2430中进行操作。

1.3 数据处理模块设计

系统数据采集电路获取摄像机采集到的刀具视频图像数据后,将数据传递给数据处理模块进行存储和模/数转换等处理。信号采集处理模块是刀具状态检测系统的关键部分,由中央处理器模块、FPGA 模块、模/数转换模块、存储器模块组成,如图4所示。

采用来自于TI公司的32位高速浮点数字信号处理器(DSP)TMS320C6713当成中央处理器,设置其运行的最大频率为280 MHz。该处理器具备超长指令字功能,程序运行256 位指令,能够在同一时刻被分配到6个并行的功能单元,具有高达2 200 MB/s的处理能力。

FPGA(Field Programmable Gate Array)为现场可编程门阵列,是一种半定制电路,含有大量的触发器和 I/O引脚,具有效率高、功耗低的优势。选择EP2C8F256C8的FPGA芯片,对摄像机采集的刀具图像信息进行模/数转换,并将转换后的数据存储到存储器中,同时可对数据的存储和传输进行控制。

1.4 显示报警模块设计

采用STC89C52单片机设计显示报警模块,通过RS 232接口同数据采集处理模块相连,采用显示屏呈现刀具磨损状态。如果刀具磨损量高于阈值,则单片机驱动蜂鸣器产生报警,促使监测器件中的指示灯亮,提示操作者调换刀具。

2 系统实现

2.1 软件流程

高速机床刀具状态视诊系统的原理结构图如图5所示。先对摄像机A采集到的图像进行刀具定位操作,按照定位到的刀具位置信息以及摄像机的参数信息,向摄像机 B传递出控制指令,确保其可对刀头进行准确拍摄。系统对摄像机B采集到的刀头图像进行分析操作,采集磨损信息。最终PC机通过BP神经网络方法对刀具磨损特征进行融合和检测。

摄像机A采集刀具信息并控制云台转动,处理摄像机A采集到的视频图像算法有Camshift刀具定位、串口通信和刀头信息采集。摄像机B采集刀头的磨损信息,处理摄像机B采集到的视频算法为刀波检测、刀纹信息采集、刀裂信息采集。

2.2 基于BP神经网络的刀具磨损状态检测实现

2.2.1 特征层融合

特征层融合的结构示意图如图6所示。

特征层融合将每个摄像机获得的刀具图像数据进行特征提取,再将这特征值输入融合中心完成特征的融合,并按照融合后的特征对高速机床刀具磨损状态进行分析。采用关联操作将特征向量划分成不同的集合,再通过BP神经网络完成特征信号的融合分析。

2.2.2 网络结构参数的确定

神经网络的塑造特征同刀具磨损量间的映射关系模型,依据该模型的映射关系运算出刀具的实际磨损量。神经网络的参数以及样本分布决定了刀具状态检测精度的高低。神经网络参数的确定包括确定输入特征、隐含层单元以及样本训练算法。

(1) 网络输入特征选择。分析摄像机A和摄像机B采集到的刀具特征融合结果,从中采集同刀具磨损状态最相关的3个视觉特征值,分别是刀头特征值,刀身特征值和刀柄特征值,将这些刀具视觉特征值当成神经网络的输入值。

(2) 网络结构选择。因为是3个特征值的输入,因此设置神经网络的输入层节点数是3。输出为刀具的实际磨损量,输出层节点数是1。依据Kolmogorov理论,隐含层神经元是具有2×网络输入层数N+1的三层神经网络,能够完成非线性映射。因此用三层网络塑造网络输入特征同刀具磨损间的映射关系,网络结构初步确定为3?7?1(输入节点3个、隐含层神经元7个、输出层节点1个)。选择Levenberg?Marquardt算法对神经网络权系数进行调整和运算。

(3) 样本的选择和归一化处理。按照实际状态选择训练样本数量,设置训练样本数为10个,分别表示不同的刀具磨损量,任意采集5个检验样本检测神经网络性能。因为输入网络的各特征值的属性不同,需要过滤其中的干扰因素。因此,对不同的样本输入特征向量进行归一化处理,采用式(1)确保各输入的特征向量处于[0.1,0.8]区间中。

(1)

式中:表示归一化后的刀具特征值;表示输入刀具特征值;表示最大输入刀具特征值;表示最小输入刀具特征值。

2.2.3 神经网络检测刀具磨损结果

按照上述塑造的神经网络,其含有3个神经元的输入层、3个输入特征数以及7个神经元的隐含层,对高速机床刀具状态进行视觉诊断,将神经网络的激活函数设置成双曲正切函数,对不同输入刀具样本特征空间进行划分;输出层为 1 个神经元,设置激活函数为线性函数,最终可输出刀具磨损状态的检测结果。

3 实验分析

通过实验检测本文设计的基于多视觉特征融合技术的高速机床刀具状态视诊方法的有效性,实验对象为某工厂的高速机床刀具。实验过程中,将 CCD 摄像机及可控云台固定在被检测刀具前0.3 m,分别实时采集刀头、刀身和刀柄图像,并通过视频采集卡将模拟视频信号转化成数字信号输入到 PC机进行磨损分析。实验结果如表1所示。其中,各项指标计算公式如下: (2)

(3)

分析表1可得,当刀头处于小幅度运动情况下,本文方法和多传感器融合方法的磨损检测率和磨损警率都较高,并且较为接近。当刀头处于大幅度运动情况下,并且方法的磨损检测率和误检率都优于多传感器融合方法。

实验以机床刀具的初期磨损阶段、正常磨损阶段以及急剧磨损阶段为例,分别分析本文方法在不同刀具磨损阶段的检测精度。设置检测精度的阈值为2%。

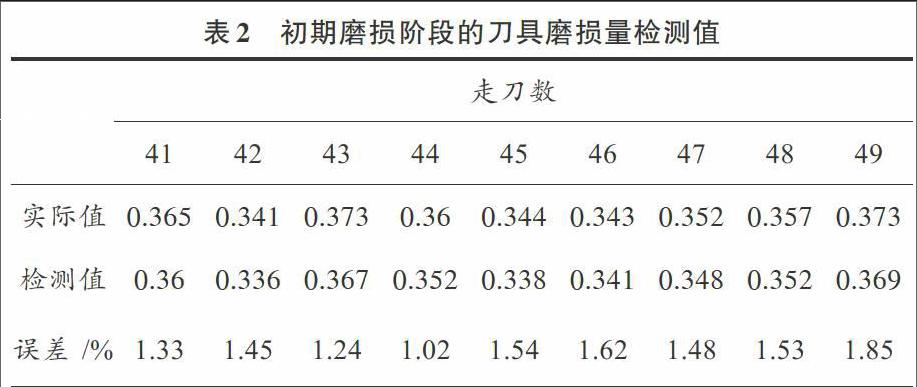

本文方法对于刀具初期磨损阶段的磨损量检测结果如表2所示。

从表2中可得,在机床刀具初期磨损过程中,其磨损量变化较为平稳,本文方法检测值与实际值间的平均误差为1.62%,低于阈值2%。

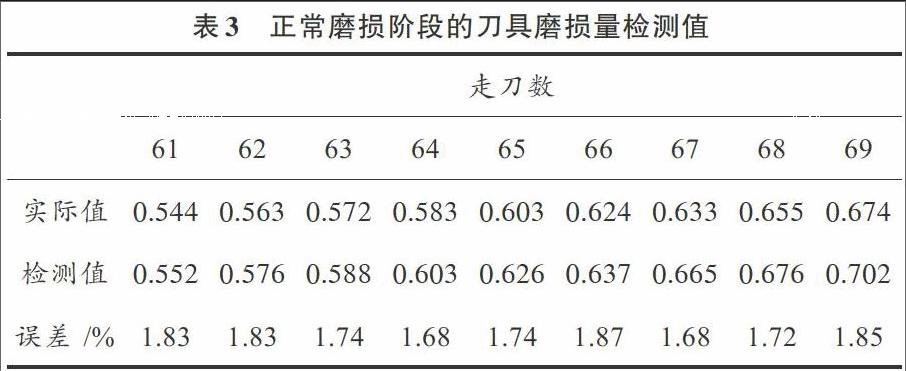

当机床刀具处于正常磨损阶段时,本文方法检测到的磨损量结果如表3所示。可以看出,该阶段的刀具磨损量波动较高,并且随着走刀数的增加,本文方法的检测误差也不断增加。本文方法的检测值同实际值间的平均误差为1.86%,低于阈值2%。

表3 正常磨损阶段的刀具磨损量检测值

急剧磨损阶段的刀具磨损量检测结果如表4所示。

从表4可以看出,在急剧磨损阶段下,本文方法的刀具磨损量检测值同实际值间的平均误差为1.93%,低于阈值2%。说明本文方法能够较高精度地检测到磨损阶段的刀具磨损量,对噪声的适应性较强且具有较高的鲁棒性。

4 结 论

本文设计基于多视觉特征融合技术的高速机床刀具状态视诊系统,系统通过固定摄像机A采集整体刀具图像,可控摄像机B采集刀头图像。两个摄像机的视频图像都输入到图像采集卡中的数据采集电路进行处理。系统通过数据采集电路获取刀具图像数据后,将数据传递给数据处理模块进行存储和模/数转换等处理。采用STC89C52单片机设计显示报警模块,用于显示刀具磨损状态。系统实现部分给出了系统软件流程图,并通过BP神经网络方法融合多视觉特征信息,检测高速机床刀具的磨损情况。实验结果表明,所设计系统可准确检测出刀具的磨损状态,具有较高的检测精度和鲁棒性。

参考文献

[1] 刘继承,孙慧琳,赵洪涛.基于多特征融合的Camshift结合Kalman预测的实时性视觉跟踪算法研究[J].自动化技术与应用,2014,33(5):54?57.

[2] 郑均辉,宫蕾.基于皮沟特征的无语言能力病人多种状态视觉识别[J].科学技术与工程,2014,14(16):102?106.

[3] 王晓文,赵宗贵,庞秀梅,等.基于视觉显著图的图像融合方法[J].吉林大学学报(工学版),2014,44(4):1203?1208.

[4] 肖华军,侯力,游云霞.一种基于图像融合的多线结构光立体视觉测量方法[J].四川大学学报(工程科学版),2015,47(3):154?159.

[5] 应玉龙,项明.局部相位量化特征的织物瑕疵检测算法[J].西安工程大学学报,2015,29(5):541?545.

[6] 张石平,王智明,杨建国.机床刀具可靠性及寿命评估[J].计算机集成制造系统,2015,21(6):1579?1584.

[7] 刘然,傅攀.基于粗糙集和BP神经网络的刀具状态监测[J].机床与液压,2015,43(5):49?52.

[8] 罗忠良,卢万强.基于电流信号和振动信号的刀具失效监测研究[J].机床与液壓,2015,43(15):139?141.

[9] 郭新,葛英飞,付细群,等.铝合金薄壁中空结构件重负荷铣削刀具寿命及刀具磨损研究[J].工具技术,2014,48(8):43?47.

[10] 耿欣,顾红光.基于多通道位移传感器的刀具断裂检测[J].机床与液压,2015,43(22):161?163.