车道障碍目标参数测量的分析

阎 俊, 王 娟

(西安电子工程研究所 生产2室, 陕西 西安 710100)

车道障碍目标参数测量的分析

阎 俊, 王 娟

(西安电子工程研究所 生产2室, 陕西 西安 710100)

针对车载视频中的障碍目标,通过单目视觉测距法对目标位置进行测量;利用物像位置公式推倒障碍目标的外形求解方法;基于视频跟踪系统,采用帧差法得到运动目标的速度参数、方向参数、加速度参数等计算障碍目标的大致运行轨迹。结果表明,对参数的实时测量分析能有效避免车道的防偏和防撞问题,为车载视频系统捕捉多个目标、分析处理多个目标、及时合理规避目标障碍等提供了一定的理论依据。

车载视频;障碍目标;单目视觉;自动驾驶

随着第三代移动通讯技术等在汽车上的广泛应用,现代汽车正向着智能化方向发展。利用安装于车上的各式各样的传感器,在第一时间收集车内外的环境参数及车周围的景物参数,通过计算机进行静态、动态目标的辨识、测量、追踪等技术上的分析处理,确定有无干扰目标障碍,制定合理行车动作,避免事故发生及行车动作时的浪费。

对车载视频行车道上障碍目标位置、外形尺寸、相对运动等参数的判定有多种测量方法。如激光测距[1-2]、激光雷达测距、连续波雷达测距、单脉冲雷达测距[3]、双摄像头成像测距、超声波测距仪[4-5]、无源红外测距仪等。文献[6~8]利用已安装的激光雷达对目标测距;文献[9]通过安装激光脉冲测距仪来测距,利用理想光学系统的光学测距原理来反推目标的外形尺寸,该方法克服了超声波测距误差过大的缺陷,测距精度可达到毫米级别,但作用距离较短且电路复杂。本文对车载视频图像中如何监测本车与前方障碍目标之间参数的测量算法进行研究,立足于单目视觉技术[10]来实现车道保持和进行障碍物检测的实时测量;应用光学测距原理,利用物像位置公式推倒障碍目标的外形求解方法;基于视频跟踪系统,采用帧差法[11]得到运动目标的速度参数、方向参数、加速度参数等计算障碍目标的大致运行轨迹。

1 视频画面内障碍目标分析

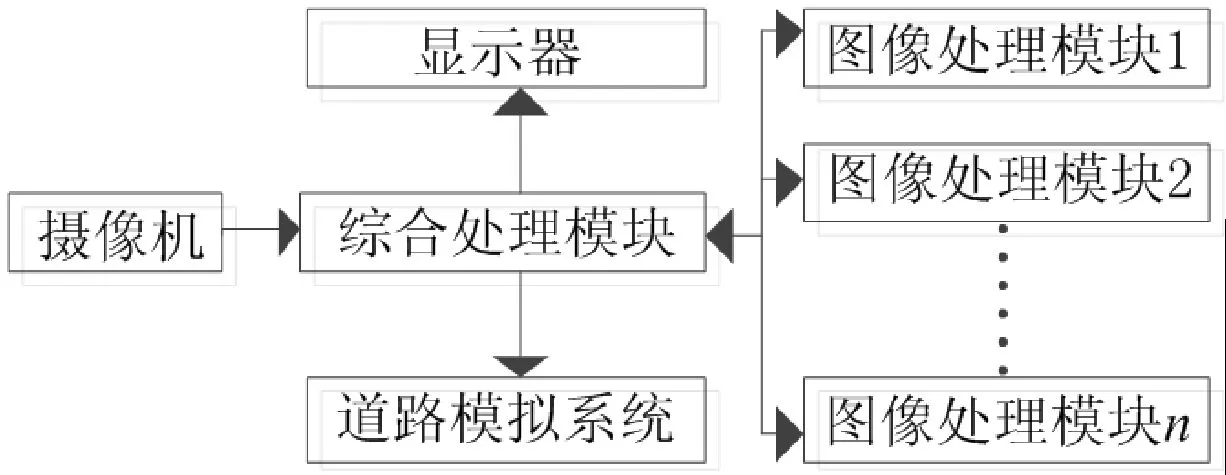

自动驾驶汽车[12-14]由卫星导航系统根据驾驶员所给定的目的地设定行驶路线;由主动巡航系统中的探测,设备对汽车周围环境进行实时探测并反应至主控计算机进行解算、目标识别,做出环境模拟,制定详细的行车动作;行车过程中会遇到各种意外情况,自动驾驶安防系统可对其做出正确处理,如前方突然出现障碍物等;当汽车到达目的地后,停车动作由停车系统进行处理,同时车后轮上的位置评估器对行车动作进行验证。其工作原理如图1所示

图1 自动驾驶原理

主动巡航系统中的关键技术是车载视频图像处理技术。其中,车载视频行车道上正向防撞需要检测本车道前方的障碍目标,如果每一幅视频图像均检测定位目标,那么一定会影响系统的实时性,所以最实际的解决方法就是根据已分析出的目标信息预测目标可能出现的位置,并进行跟踪检测。首先对视频画面上所有目标标记后进行初步分析,并对无影响车辆行驶的目标进行排除,有影响的目标建立车辆行驶方向的车道线和汽车自身安全行驶所需的双车道线。对于在双车道线以外的目标,只需对目标进行跟踪即可,若目标图框不进入双车道线内,则不需要对目标其它参数进行计算;若目标进入双车道线,则需根据进入双车道线目标距离汽车远近程度,优先进行参数测量分析计算,得到详细的参数后,将参数信息输入3D环境图中,以便计算机根据情况设计行车计划。

对障碍目标参数的测量主要包括:目标距离、目标外形尺寸、目标与本车相对行进方向及相对速度、计算目标行进方向与本车行进方向交点位置及时间等。

2 障碍目标参数测量方法

2.1 单目视觉实时测距法

一般情况下,摄像机所拍摄到的画面是空间三维场景在二维空间的投影。然而,利用机器视觉对道路状况进行识别的过程中,就需要一种逆求解的过程,将二维画面还原成空间三维路面图像,这一过程就是获取目标距离信息的算法。目前单目视觉系统一般采用对应点标定法来获取目标的距离信息。即通过不同坐标系中对应点的对应坐标求解坐标系的转换关系。然而对于应用在自动驾驶汽车上的摄像机来说,由于汽车行驶过程中会有颠簸,致使摄像机的参数发生变化,所以适用性受到了限制。

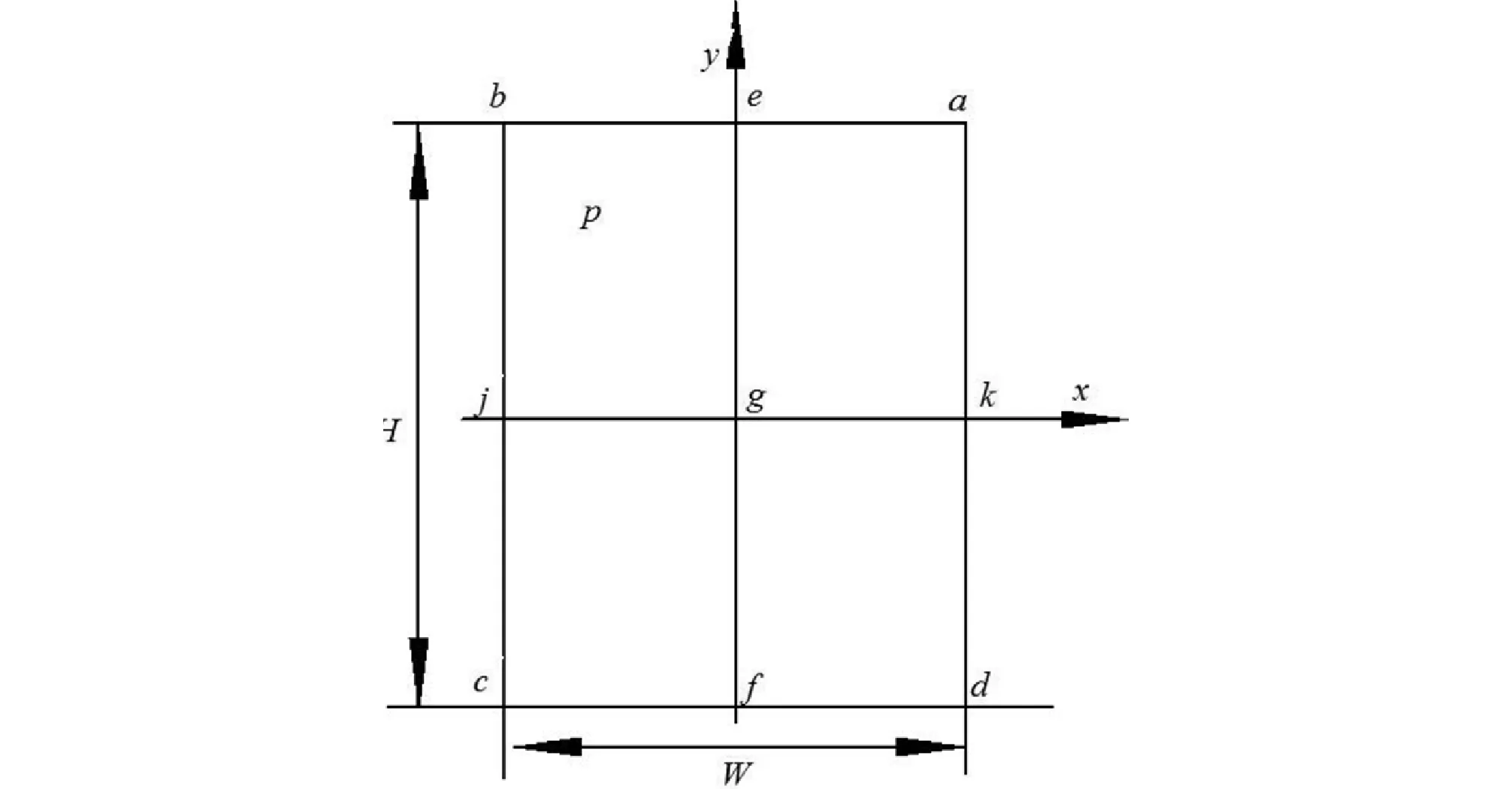

根据摄像机投影模型,通过几何推导得到路面坐标系和图像坐标系之间的关系。基于几何关系推导法,提出了利用单目视觉监测本车与前方障碍物之间距离的实时测距算法[10]。由于试验分析表明摄像机的俯仰角对算法的精度有较大影响,因此提出了利用道路边界平行约束条件来实时计算摄像机的动态俯仰角度的算法,其可以获取较为准确的目标距离信息,并已通过静态实车试验和动态实车试验验证了算法的准确性和实时性。根据小孔成像模型,可以将单目视觉系统简化为摄像机投影模型,如图2和图3所示。

图2 摄像机投影模型-投影关系

图3 摄像机投影模型-投影平面

图2中平面ABU代表道路平面,ABCD为摄像机拍摄到的道路平面上的梯形区域,O点为摄像机镜头中心点,OG为摄像机光轴,G点为摄像机光轴和道路平面的交点(同时也是视野梯形的对角线交点),I点为O点在道路平面上的垂直投影。在路面坐标系中,将G点定义为坐标系原点,车辆前进方向定义为Y轴方向。G、A、B、C、D各点在图像平面内的对应点如图3所示:a、b、c、d为像平面矩形的4个端点,H和W分别为像平面的高和宽。定义图像矩形的中点g为像平面坐标系的坐标原点,y轴代表车辆前进方向。取道路平面上一点P,其在道路平面坐标系的坐标为(XP,XP) ,P点在图像平面内的对应点为p,其在像平面坐标系的坐标为(xp,yp) ,利用几何关系可以推导出如下路面坐标与图像坐标之间的对应关系

(1)

其中

(2)

(3)

式(2)~式(3)中,H为图像的高;W为图像的宽;h为摄像机的安装高度;2β0为摄像机镜头的水平视野角;2α0为摄像机镜头的垂直视野角;γ0为摄像机的俯仰角。式(1)的前两式为像平面到路平面的映射关系;后两式为路平面到像平面的逆映射关系。

假设本车与前方障碍物的真实距离为dr,根据单目视觉的测距算法计算得到的本车与前方障碍物的距离为dc。dc=d1+d2,其中d1为摄像机最近视野到本车前端的距离,d2是由图像上得到的最近视野与障碍物的距离。求解d2的方法如下:(1)通过摄像机得到视野前方图像;(2)通过障碍物识别算法识别出图像中的障碍物,并用矩形框将其标记出来;(3)求取该矩形框底边中点的图像平面坐标u1、v1;(4)求取图像平面底边中点的图像平面坐标u2、v2;(5)将图像平面坐标u1、v1、u2、v2通过前文提到的几何关系推导成道路平面坐标x1、y1、x2、y2;(6)d2= ((y1-y2)2+(x1-x2)2)0.5。

2.2 障碍目标外形的测量

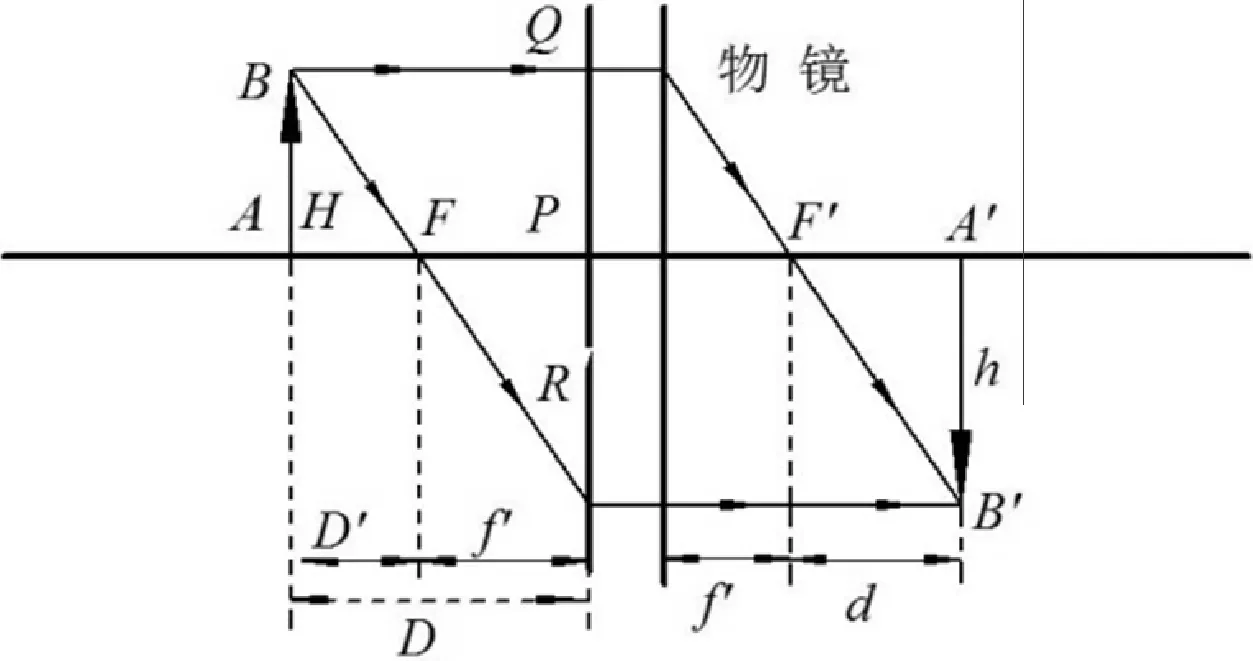

理想光学系统中物与像处于同一介质,故图4中物方焦距与像方焦距相等,都用f′表示。

图4 理想光学测距原理

图中AB=H,AF=D′,A′B′=h,PF=f′。根据物象位置公式(即牛顿公式)H/h=D′/f′,距离估算过程中D≈D′, 求得目标的近似距离:D≈(H/h)f′。

基于文中单目视觉实时测距法所测距离,利用物象位置公式计算目标的外形大小为H≈(D/f′)h。 其中,D为目标近似距离;H为目标实际高度;h为目标相高;f′为焦距。

目标的外形图像利用图像处理等技术可以单独提取出来,并计算出像的外框大小,根据H≈(D/f′)h可以计算出目标的外形尺寸。

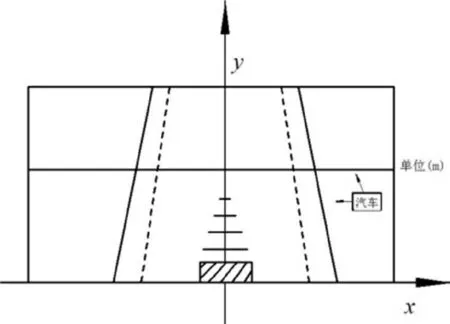

2.3 障碍目标运动参数的测量

如何对目标的运动参数进行测量,首先要能做到对运动目标进行跟踪。视频跟踪系统是具有一定智能的图像跟踪装置,它能在比较复杂的背景下按照标准电视制式,逐场提取与分离视场内的运动目标,提取目标亮度与结构特征,测定目标中心相对中心轴的方位与俯仰角误差,该跟踪角误差信息经变换后反映到道路模拟画面上,实现对目标的实时自动跟踪。视频跟踪仿真如图5所示。

图5 视频跟踪仿真图

对于动态场景,由于目标与摄像头之间存在复杂的相对运动,运动检测富有挑战性。传统的帧差法[15-16]已经不再适用,如何能对全局的运动进行估计和补偿,成为问题的关键。要检测动态场景中的运动目标,关键在于对场景的运动进行估计,通过估计出的运动参数补偿其运动,最后使用帧差法得到运动目标,如图6所示。

图6 帧差法得到运动目标

将目标提取出来,此时就可以计算出目标的位置和形状参数,投影到模拟道路画面上,记录为t1时刻,如图7所示;经过Δt时间后,目标的位置已经发生变化,其形状也有了轻微的变化,对此时的视频画面再次进行分析,并与上一个画面进行差分对比,就可以得出目标新的位置和形状的参数信息,将得到的参数投影到模拟道路画面上,记录为t2时刻,如图8所示;再经过Δt时间后,对视频画面再次进行分析,并与上一个画面进行差分对比,得出目标新的位置和形状的参数信息,将得到的参数投影到模拟道路画面上,记录为t3时刻,图9所示。

图7 t1时刻目标位置

图8 t2时刻目标位置

图9 t3时刻目标位置

以此类推,利用式(4)计算出目标的运动速度参数、方向参数

(4)

式(4)中,V表示目标的矢量速度;L1、L2表示目标在t1时刻和t2时刻的时候与坐标原点(即本车位置)的矢量距离。对式(4)求导可得出目标的加速度参数、运动曲线参数等。然后利用得出的速度参数、方向参数、加速度参数就可以计算出目标的大致运行轨迹和经过时间t后将处于的位置。

得出目标的运动参数后,此时,目标的运动参数应为目标相对于本车的运动参数,与本车的运动参数矢量相加,则为目标的绝对运动参数,根据其绝对运动参数则可以判断出目标为静止目标还是运动目标,为自动驾驶汽车的行驶提供了参考依据。

3 结束语

本文主要对车载视频中如何监测本车与前方障碍物之间参数的测量算法进行研究。(1)立足于单目视觉技术来实现车道保持和进行障碍物检测的实时测量,证实该算法具有较高的准确性,可满足测距要求;(2)应用光学测距原理,利用物像位置公式推倒障碍目标的外形求解方法;(3)基于视频跟踪系统,采用帧差法得到运动目标的速度参数、方向参数、加速度参数等计算障碍目标的大致运行轨迹。

车载视频中目标参数的测量能够准确的探测并跟踪本车前方的障碍物,解决了在自动驾驶汽车过程中本车道的防偏和防撞问题,为车载视频系统捕捉多个

目标、分析处理多个目标、及时合理规避目标障碍等提供了一定的理论依据。

[1] 郑大青,陈伟民,陈丽,等.一种基于相位测量的快速高精度大范围的激光测距法[J].光电子·激光,2015,35(2):303-308.

[2] 权贵秦,郝睿鑫,于洵.一种室内标定激光测距准确度方法的研究[J].国外电子测量技术,2013,32(9):42-45.

[3] 聂涛.应答式单脉冲雷达测距精度分析[J].中国无线电,2014,10(4):12-15.

[4] 仲园,郁昊.基于超声波测距原理的倒车防撞预警器的设计[J].电子设计工程,2016(5):158-161.

[5] 苑洁,常太华.基于STM32单片机的高精度超声波测距系统的设计[J].电子设计工程, 2011 (15):76-76.

[6] 姜海娇,来建成,王春勇,等. 激光雷达的测距特性及其测距精度研究[J].中国激光, 2011, 21(5):15-20.

[7] 姚金良,严惠民,张秀达,等.一种应用图像配准叠加提高成像激光雷达测距精度的方法[J].中国激光,2010,37(6):33-37.

[8] 焦宏伟,秦石乔,胡春生,等.一种脉冲激光雷达与摄像机标定方法的研究[J].中国激光,2011,38(1):21-24.

[9] 周睿,孔东.一种高精度相位激光测距方法的实现[J].科学技术与工程,2009,21(9):6337-6342.

[10] 郭磊,徐友春,李克强,等.基于单目视觉的实时测距方法研究[J].中国图像图形学报,2006,11(1):74-77.

[11] 邱道尹,张文静,顾波,等.帧差法在运动目标实时跟踪中的应用[J].华北水利水电学报,2009,30(3):45-46.

[12] Richard Bishop.Intelligent vehicle technology and trends[M].MD,USA:Artech House Publishers,2005.

[13] 陈大明,勐海华,汤天波.全球自动驾驶发展现状与趋势[J].华东科技,2014(10):68-70.

[14] 马春江.自动驾驶技术的讨论与展望[J].信息与电脑:理论版,2014(12):53-54.

[15] 张晓慧.视频监控运动目标检测算法的研究与实现[D]. 西安:西安电子科技大学,2012.

[16] 吕国亮,赵曙光,赵俊.基于三帧差分和连通性检验的图像运动目标检测新方法[J].液晶与显示,2007,22(1):87-93.

Measurement of Parameters for Barriers to the Target In Lane

YAN Jun, WANG Juan

(Production Room 2, Xi’an Electronic Engineering Research Institute, Xi’an 710100, China)

Barriers to target of vehicle-mounted video, such as the target location, is measured by the monocular vision algorithm. The shape solving method is obtained by the image formula. The target trajectory of speed, direction and acceleration are obtained by the frame difference method in the video tracking system. Results show that parameter measurement avoids the car collision effectively. It provides a theoretical basis for the vehicle-mounted video system to capture multiple targets, analyze and deal with multiple targets, and timely avoid obstacles.

vehicle-mounted video; barrier to target; monocular vision; auto-pilot

2016- 04- 06

闫俊(1985-),女,硕士,助理工程师。研究方向:雷达技术。

10.16180/j.cnki.issn1007-7820.2017.02.024

TN949.293; TP391.1

A

1007-7820(2017)02-090-04