基于线激光视觉的机器人焊缝跟踪鲁棒控制方法

陈 忠,邓 汛,李小辉,张宪民

(华南理工大学机械与汽车工程学院,广州 510640)

基于线激光视觉的机器人焊缝跟踪鲁棒控制方法

陈 忠,邓 汛,李小辉,张宪民

(华南理工大学机械与汽车工程学院,广州 510640)

为了解决机器人在高速状态下进行焊缝跟踪时在拐角处产生的失真变形问题,提出了一种基于线激光视觉的机器人焊缝跟踪鲁棒控制方法;该方法通过视觉系统的预测量获得焊缝轮廓信息,对焊缝拐点进行识别并辨认拐角区域,对不同的轮廓部分采用不同的控制策略,同时引入自动校正过程,校正实际生产过程中的装配误差;实验结果表明该方法可以实现可靠的检测与跟踪,解决了高速状态下的运动轨迹失真问题,有效地提高了机器人焊缝跟踪的速度与精度,并确保系统在外界干扰的情况下仍能保持准确和稳定的运动,增强了系统的鲁棒性。

机器人焊缝跟踪;控制;鲁棒性;线激光

0 引言

机器人视觉伺服控制[1]是当今智能机器人研究和发展的一个重要领域。与传统的机器人控制方法相比,机器人视觉伺服控制具有精度高、实时性好、灵活性高等众多优点,在工业中得到更多的关注与应用,驱使机器人技术向智能化方向发展。

机器人视觉伺服控制因其自身的优越性而在众多领域中得以应用,其中在机器人焊缝跟踪领域应用最广泛。目前,基于视觉传感器的机器人焊缝跟踪控制方法[2]主要包括两种:视觉示教跟踪与自动跟踪。视觉示教跟踪指的是预先通过视觉传感器检测焊缝位置信息,然后指导离线编程系统完成轨迹规划。但是该方法不能消除在焊接过程中因热变形而产生的动态误差,因此容易导致跟踪性能不佳。

对于传统的自动跟踪方法,机器人能够通过视觉传感器感知外部环境的变化,实时地调整自身姿态和运动方向以较好地完成跟踪任务。国内外的学者已经在这方面进行了较多研究,例如,Liu[3]提出了一种基于激光视觉的机器人实时焊缝跟踪方法,Ma[4]提出了一种针对薄板对焊的焊缝跟踪方法。这些方法都表现出了较好的跟踪精度和稳定性,可是这些方法都只是适用于低速和焊缝近似为直线型的情况,在高速和焊缝为锯齿形等非纯直线型的情况下并没有进行讨论。

关于控制方法鲁棒性的研究,Kim[5]曾指出一种具有鲁棒性的基于视觉的焊缝跟踪方法,Haug[6]也试图利用新的算法来消除焊接过程中产生的飞溅和强光对图像处理的影响。但是,以往的这些研究主要集中在如何利用新的信号处理技术来过滤图像的噪声,很少研究者会关注如何消除在实际生产过程中由于装配误差而导致的畸变。

本文提出一种基于线激光视觉的机器人焊缝跟踪鲁棒控制方法。该方法能够有效利用焊缝的轮廓信息,根据不同的轮廓段采用不同的控制策略,当应用于高速和锯齿形焊缝的情况时仍能表现出很好的跟踪精度。同时该方法具有可以校正装配误差的自动校正功能,提高了系统的鲁棒性。

本文的章节安排如下。第1节详细介绍焊缝跟踪原理和方法,包括焊缝轮廓的重建原理、特征点的识别方法、伺服控制方法和自动校正原理。第2节详细描述焊缝跟踪实验并讨论所提方法的优越性和可行性。第3节为结论部分。

1 焊缝跟踪原理和方法

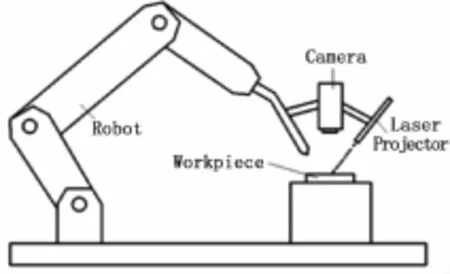

机器人视觉焊缝跟踪系统由两部分组成,分别是工业机器人和基于线激光的视觉系统。其中工业相机和激光器均固定在机械手的末端,组成eye-in-hand手眼系统。

1.1 焊缝轮廓的重建原理

根据三角测量原理,对焊缝轮廓进行重建。如图1所示,当机器人向前运动时,激光器发射出一束线激光照射在焊缝表面,相机捕获得到变形的激光条纹图像。激光条纹的变形情况与焊缝的轮廓形状、激光器和工业相机的位置关系均有十分密切的关系。而且,激光条纹的形状偏差和不连续性与焊缝的深度息息相关。当激光器和工业相机的位置关系经过标定且保持不变时,焊缝轮廓的空间信息可通过激光条纹的图像坐标来获得。

图1 系统框架图

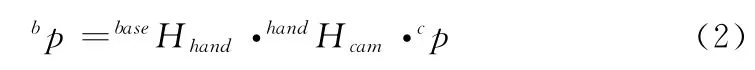

假设激光条纹上任意一点的像素坐标为m=[u,v]T,则它所对应的相机坐标cp=[xc,yc,zc]T可通过激光平面的标定参数计算得到。该坐标的转换关系可由以下的方程进行表示:

其中:baseHhand代表机械手末端坐标系到机器人基坐标系的转换矩阵,可通过机器人运动学标定获得,handHcam代表机械手末端坐标系到相机坐标系的转换矩阵,可通过机器人手眼标定获得,因此该点在机器人基坐标系下的空间坐标bp=[xb,yb,zb]T可由以下方程求得:

因此,当获得激光条纹上的所有特征点坐标后,就能完成对焊缝轮廓的重建工作。

1.2 特征点识别方法

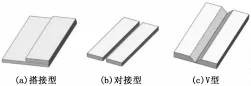

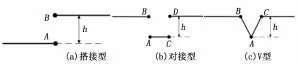

由于激光条纹的形状会根据不同的焊缝类型而发生变化,因此找到正确的特征点识别方法是十分必要的。这里的特征点指的是焊缝轮廓和激光条纹的交点。图2所示的是3种常用的焊缝类型分别为搭接型、对接型和V型,图3则是它们所对应的激光条纹图像。

图2 各种类型的焊缝

图3 各种焊缝对应的激光条纹

对于搭接型和对接型焊缝,由于激光条纹是断续的,因此可通过计算两相邻点的距离对特征点进行识别,图3(a)中的B点和图3(b)中A点和C点的中点分别就是各自的特征点。对于V型焊缝如图3(c)所示,最低点A点被视为其特征点。

1.3 伺服控制方法

本文提出的伺服控制方法称为tracking with prediction (TP)方法。以锯齿形焊缝为例,该方法可按照以下几个步骤进行。

步骤一:焊缝轮廓预测量。为了更好地利用焊缝轮廓信息,可通过视觉系统预先对工件进行测量。首先控制机器人以较低的速度沿着焊缝的延伸方向运动,然后使固定在机械手末端的相机开始捕获图像,并将识别出的特征点进行坐标变换,将空间坐标信息传送到控制器中。该过程需要确保相机和工件在一个合适的距离范围内以保证特征点能始终出现在相机的视场中。另外,为了获得更多的焊缝轮廓点以求取更精确的轮廓信息,机器人的运动速度也需控制在较低的范围内。最后预测量得到的焊缝轮廓将以点数据的形式保存在控制器的数据存储器中。

步骤二:拐点识别与拐角辨认。如图4所示,焊缝轮廓由拐角与直线段组成。因为当机器人运动到拐角处时容易出现视野盲区或发生速度突变,进而影响跟踪的准确性与运动的稳定性,因此为了获得更好的跟踪性能,应在不同的轮廓段使用不同的控制策略。为了辨认拐角区域的位置,需快速有效地对拐点进行识别。首先,在直线段上任意选取5个均匀分布的点并拟合成一条直线,然后按顺序计算出其他各点到该拟合直线的距离。当某一点与拟合直线之间的距离大于设定阈值,而与它相邻的前一个点与拟合直线的距离小于或等于设定阈值时,该点就被识别为拐点,而与拐点相邻的前后5个点所覆盖的区域则被认为是拐角区域。

图4 锯齿形焊缝工件

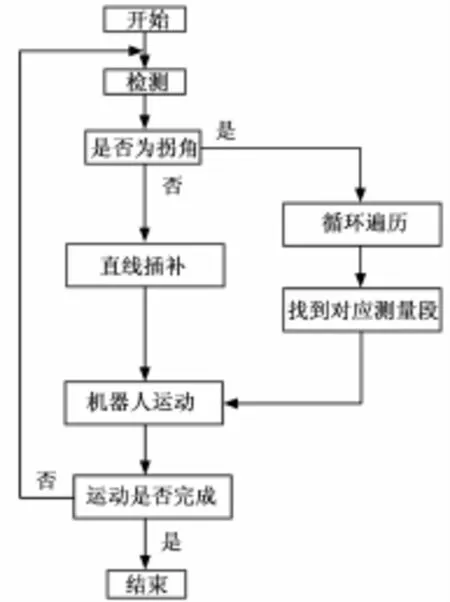

步骤三:实时焊缝跟踪。机器人会根据视觉系统的检测和判断进行跟踪运动。每一次的检测循环都会识别一个特征点,该特征点在这过程中也被称为检测点。检测过后系统会进行判断,并根据不同的轮廓部分采用不同的控制策略。具体的流程如图5所示。

在轮廓为直线段的部分,因为两个检测点之间的轮廓可以近似认为是一条直线,因此可以用简单的直线插补进行插补运动。为了使机器人的运动更加稳定,在两个相邻的检测点之间插补合适个数的插补点以确保相邻的运动点之间的距离足够小。该运动点指的是输入到控制器中的数据点。

机器人在进行实时焊缝跟踪时,由于相邻的两个检测点之间的距离会随着运动速度的增加而增大,因此在拐角处使用直线插补会导致运动轨迹与实际工件轮廓不符,产生变形失真问题,且速度越大变形失真越严重。为了避免变形失真问题,系统在拐角处将不再单纯地使用直线插补,而是将检测点与存储在数据存储器中的预测量焊缝轮廓数据点进行比较,截取一部分合适的数据点作为当前拐角处的轮廓,并在下一个检测循环到来之前,控制机器人根据辨认的数据点进行运动。

图5 流程图

1.4 自动校正原理

由于装配误差和外部因素的影响,在1.3节步骤一中测量获得的焊缝轮廓信息并不总是准确的,有可能会导致跟踪运动的失败,因此系统需采用自动校正以确保跟踪系统的准确性与稳定性。

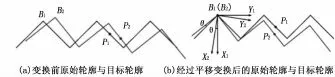

以锯齿形焊缝工件为例,机器人快速运动到拐角区域,视觉系统进行拐点识别检测。将拐点坐标与1.3节步骤一中测量获得的点坐标进行比较,测量点数据将会根据自动校正算法更新一次形成目标轮廓。坐标点经过平移变换与旋转变换后,原始的轮廓坐标将转换成目标轮廓坐标。假定工件是安装固定在一个平面上的,那么它的位置误差总是约束于XOY平面上,而Z方向上的坐标也是保持不变的,因此可以仅根据投影在XOY平面上的二维轮廓图求得准确的工件轮廓信息。图6为自动校正的示意图,展示了从原始轮廓到目标轮廓的转变过程。

图6 自动校正过程

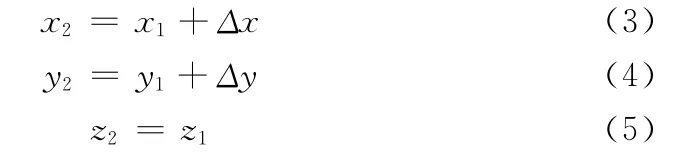

步骤一:假设P1(x1,y1,z1)是原始轮廓上的任意一点,P2(x2,y2,z2)是目标轮廓上与P1(x1,y1,z1)相对应的点,B1和B2分别是两个轮廓上的拐点。B1和B2之间的距离被认为是两个轮廓之间的平移距离,分别用Δx,Δy和Δz来表示。由于工件固定在一个平面上,因此大部分的装配误差只存在于X和Y方向上,Δz可以近似认为是零,P2的坐标可由以下方程组求得:

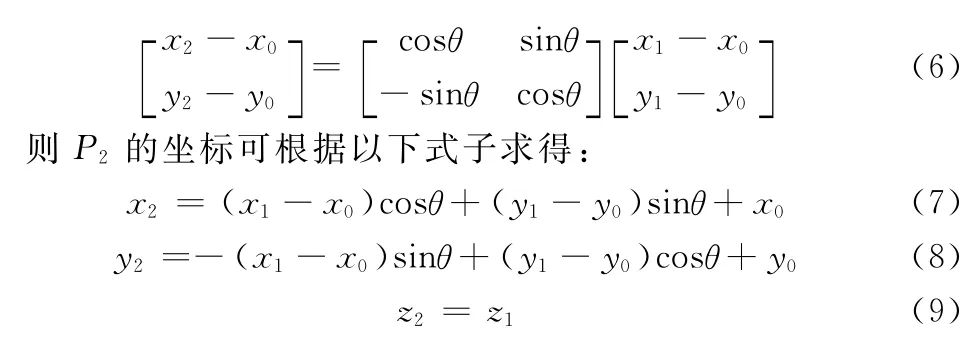

步骤二:同样地,工件在Z方向上的坐标依然保持不变。设B2坐标为(x0,y0),两个轮廓之间的旋转角度为θ。以B2作为坐标原点,建立两个夹角为θ的直角坐标系,那么P2在X1B2Y1坐标系下的坐标为 (x2-x0,y2-y0),在X2B2Y2坐标系下的坐标为(x1-x0,y1-y0),两个坐标系之间的坐标变换可由以下方程表示:

所以,当自动校正完成后测量数据将再次获得更新。

2 实验与讨论

2.1 实验设置

机器人视觉跟踪系统由工业相机、激光器、六轴工业机器人和控制器组成,其中工业相机和激光器通过夹具固定在机械手末端执行器,图中的激光跟踪仪被放置在机器人前方,与机器人保持适当的距离,用于测量机械手末端的运动轨迹。为了简化误差分析,在实验中获得的所有焊缝轮廓都以其在XOY平面上的二维投影图表示。

2.2 视觉系统的可靠性测试

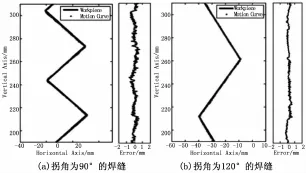

本实验应用两种不同类型的工件:一种是拐角为90°的锯齿形焊缝;另一种是拐角为120°的锯齿形焊缝,它们的形状信息都能通过加工图纸获得,与视觉系统测量误差相比,工件的加工误差可忽略不计。

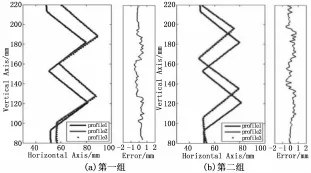

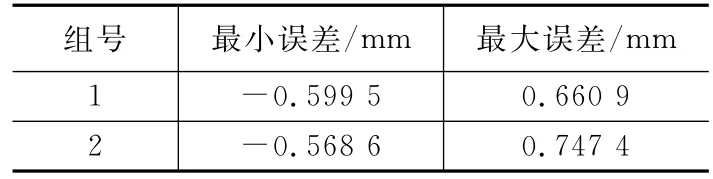

首先,控制机器人按照视觉系统测量获得的点数据进行运动,与此同时,利用激光跟踪仪记录机械手末端位置以获得运动轨迹。将由加工图纸获得的工件轮廓轨迹和激光跟踪仪记录得到的运动轨迹放置在图7中进行对比,求取两条轨迹之间的偏差,并以误差曲线图的形式在图7中显示。其中线型符号代表工件轮廓轨迹,点型符号代表运动轨迹。

图7 轨迹对比以及误差曲线图

表1 视觉系统的测量误差

如图7所示,对于这两种类型的焊缝,两条轨迹无论是在直线段处还是拐角处均保持着十分高的重合度。另外,如表1所示,视觉系统的极限误差在-0.662 5至0.692 4 mm的范围内,验证了测量数据的准确性与该视觉系统的可靠性。

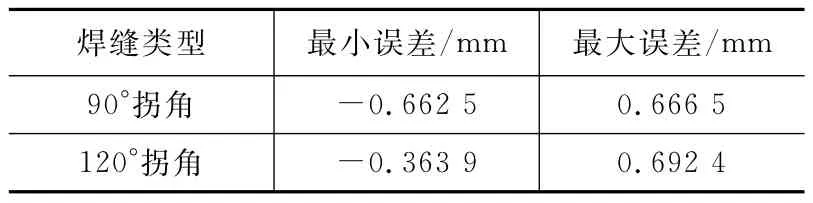

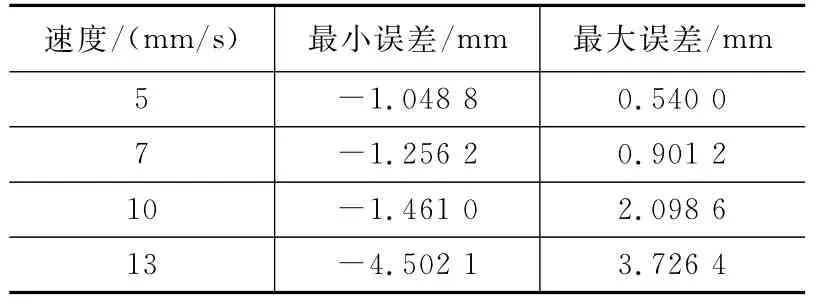

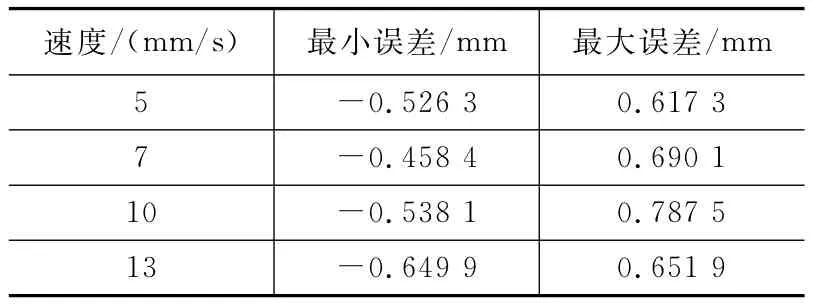

2.3 对比实验

为了更好地进行对比和分析,分别采用传统的自动跟踪方法和本文所提出的TP方法在多种速度状态下进行机器人焊缝跟踪实验,运动速度的变化范围控制在5 mm/s到13 mm/s之间。图8和图9分别展示了不同控制方法下机器人的运动轨迹以及对应的误差曲线,其中线型符号代表工件轮廓轨迹,点型符号代表运动轨迹。表2和表3则分别展示了不同控制方法下的系统跟踪误差。

图8 多种速度情况下应用传统的自动跟踪方法的运动轨迹与跟踪误差

图9 多种速度情况下应用TP方法的运动轨迹与跟踪误差

表2 应用传统的自动跟踪方法时系统跟踪误差

表3 应用TP方法时系统跟踪误差

应用传统的自动跟踪方法时,随着运动速度的增加,机器人运动轨迹虽然在轮廓的直线段部分与工件轮廓保持着一致性,但是在拐角处却发生了明显的失真变形问题,该现象表明了传统的自动跟踪方法在高速状态下的不适用性。相反,应用TP方法时,在高速状态下,运动轨迹无论是在直线段部分还是拐角处部分均与工件轮廓保持着高度的一致性,并且没有发生类似的失真问题。此外,应用TP方法后系统在高速状态下的跟踪误差也明显地减小。以上实验结果表明本文所提出的TP方法在高速状态下的性能明显优于传统的自动跟踪方法。

2.4 鲁棒性评价

为了更好地进行鲁棒性评价,该实验人为地引入装配误差。在完成焊缝轮廓预测量后,在平面上对工件进行移动以模拟实际生产过程中可能出现的装配误差情况。图10展示的是两组的实验结果,其中轮廓1(profile 1)和轮廓2(profile 2)分别代表的是工件移动前后的轮廓,轮廓3(profile 3)代表的是经过自动校正后机器人的运动轨迹。从图中可以明显地看出运动轨迹与轮廓2(profile 2)十分吻合,而表4中所示的系统跟踪误差也在一个可接受的误差范围内。实验结果验证了自动校正过程的正确性,也表明了本文所提方法具有强健的鲁棒性。

图10 具有装配误差的焊缝跟踪轨迹和系统误差

表4 具有装配误差的焊缝跟踪系统误差

3 结论

本文提出了一种基于线激光视觉的机器人焊缝跟踪鲁棒控制方法,总结得出以下结论:

1)应用本文所提出的控制方法可以实现可靠的焊缝轮廓检测与跟踪,解决了机器人在对锯齿形焊缝进行高速跟踪时在拐角处产生的变形问题,并有效地提高了机器人焊缝跟踪的速度与精度。

2)应用本文所提出的控制方法可以使机器人视觉跟踪系统在受到外界干扰的情况下仍然保持准确和稳定的跟踪运动,有效地提高了系统的鲁棒性。

[1]Kuo H C,Wu L J.An image tracking system for welded seams using fuzzy logic[J].Journal of Materials Processing Technology,2002,120(1):169-185.

[2]Lee S K,Chang W S,Yoo W S,Na SJ.A study on a vision sensor based laser welding system for bellows[J].Journal of Manufacturing Systems,2000,19(4):249-255.

[3]Liu S Y,Liu L T,et al.Study of robot seam tracking system with laser vision[A].IEEE International Conference onMechatronics and Automation[C].2009:1296-1301.

[4]Ma H B,Wei S C,Sheng Z X,et al.Robot welding seam tracking method based on passive vision for thin plate closed-gap butt welding[J].International Journal of Advanced Manufacturing Technology,2009,48(9-12):945-953.

[5]Kim J S,Son Y T,Cho H S,et al.A robust method for visionbased seam tracking in robotic arc welding[A].Proceedings of the 10th IEEE International Symposium on Intelligent Control[C].1995:363-368.

[6]Haug K,Pritschow G.Reducing distortions caused by the welding arc in a laser stripe sensor system for automated seam tracking [A].Proceedings of the IEEE International Symposium on Industrial Electronics[C].Bled(Slovenia),1999:12-16.

A Robust Control Method for Robot Seam Tracking Based on Sheet of Laser Light Vision

Chen Zhong,Deng Xun,Li Xiaohui,Zhang Xianmin

(Institute of Mechanical and Automotive Engineering,South China University of Technology,Guangzhou 510640,China)

This paper presents a robust control method for robot seam tracking based on sheet of laser light vision in order to solve the distortion problem which occurs at the corners in high-speed seam tracking.Pre-measurement is implemented first to gain the seam profile,and inflection points are detected to identify the corners areas.Different control strategies are chosen for the different parts.Moreover,automatic correction is adopted in the proposed method to eliminate the assembly error in actual situation during a production process.The experimental results indicate that the reliable detection and tracking of the seam can be achieved and the distortion problem can be solved with the proposed control method,which effectively improves the robot seam tracking speed and precision.And the system can maintain the normal operation of seam tracking in the case of external disturbance,which shows the strong robustness of the system.

robot seam tracking;control;robustness;sheet of laser light

1671-4598(2016)08-0107-04

10.16526/j.cnki.11-4762/tp.2016.08.029

:TH122

:A

2016-02-29;

:2016-03-16。

广东省科技攻关项目(2014B090917001,2015B020239001);广州市科技计划项目(2015090330001)。

陈 忠(1968-),男,四川成都人,副教授,主要从事精密测量、检测与诊断方向的研究。

张宪民(1964-),男,陕西人,教授,主要从事精密装备与现代控制方向的研究。