采用显著性分析与改进边缘方向直方图特征的红外与可见光图像配准

徐 军,付天宇,杨 健,丰 苏

(1.武汉大学 测绘遥感信息工程国家重点实验室,湖北 武汉 430079;2.北京市混合现实与新型显示工程技术研究中心 北京理工大学 光电学院,北京 100081;3.国家质量监督检验检疫总局 信息中心,北京 100088)

采用显著性分析与改进边缘方向直方图特征的红外与可见光图像配准

徐 军1*,付天宇2,杨 健2,丰 苏3

(1.武汉大学 测绘遥感信息工程国家重点实验室,湖北 武汉 430079;2.北京市混合现实与新型显示工程技术研究中心 北京理工大学 光电学院,北京 100081;3.国家质量监督检验检疫总局 信息中心,北京 100088)

为了实现红外图像与可见光图像的信息融合,弥补单一模态图像的不足,提出了一种基于显著性分析与改进的边缘方向直方图EOH(Edge Orientation Histogram)特征的红外与可见光图像配准算法。该算法首先利用显著性分析技术找到可见光图像中的重要信息,得到显著性图;将其与可见光图像融合,实现可见光图像中重要信息的划分。然后,利用自适应FAST(Features from Accelerated Segment Test)算法,探测可见光与红外图像上的特征点;利用改进的EOH,描述特征点。最后,根据描述计算特征点的相似性,在可见光与红外图像上找出对应的特征点,实现红外与可见光图像的匹配。在3种不同情况下对红外与可见光图像数据进行了配准实验。结果表明:在红外图像与可见光图像采集条件相似情况下,特征点正确匹配率为96.55%,而在图像采集条件差异较大的情况下,特征点正确匹配率可达74.21%。该算法可实现红外与可见光图像的精确快速匹配,即使红外图像与可见光图像采集的角度与位置均存在较大差异的情况下,仍可以满足红外与可见光图像匹配对精度和稳定性的要求。

图像配准;红外图像;可见光图像;显著性分析;自适应特征点提取;边缘方向直方图;特征描述

1 引 言

可见光传感器的工作波长大致位于400~760 nm,红外传感器的工作波长位于760 nm~1 mm。可见光图像主要反映了拍摄场景内物体的物理位置信息,其存在感兴趣区域不突出等缺点;而红外图像则主要反映了物体的热量信息,其存在成像质量低等问题[1-3]。图像配准技术是通过提取红外图像与可见光图像上的特征点,将处于不同光谱图像的对应特征点进行匹配,实现多源信息的融合[4-6],在国土资源调查、军事侦察等领域有着广泛的应用[7-8]。

对于红外图像与可见光图像的配准,主要流程包括[9]:特征点提取,特征点描述以及特征点匹配。由于待配准图像所处的波段不同,所以对同一物体的成像结果也不同,导致利用SIFT(Scale-Invariant Feature Transform)等角点检测器提取的特征点质量较差[10],而且不同点的特征描述区分度较低,无法满足多源图像精确配准的需求[11]。为了解决SIFT在红外与可见光图像匹配中存在的问题,李健等人[12]通过先选择适当的阈值对红外与可见光图像进行二值化处理,然后利用SIFT提取图像特征,从而改善了红外图像信噪比低,纹理较弱造成的匹配率低的现象。但是当红外图像包含复杂信息时,无法确定出合适的阈值对图像进行二值化。为了提高特征描述区分度,Yi. Z.等人[13]提出了有尺度限制条件的SIFT匹配算法SRSIFT。他们通过设定尺度范围,滤除已匹配的超出尺度范围的特征点对,以减少在多源图像配准情况下,由SIFT特征描述偏差引起的误匹配率。但是当可见光图像与远红外图像配准时,由于图像间所处的波段差异较大,尺度限制条件失效,导致匹配效果较差。Huang等人[14]提出RNGM(Registration based on NSCT and Gradient Mirroring)算法,其利用非下采样Contourlet变换(Nonsub-Sampled Contourlet Transform,NSCT)增强图像中物体的结构信息,同时保证结构信息在多源图像中具有不变性。因此,在NSCT图像上,利用SIFT可以提取到更多的特征点,此外,他利用GM(Gradient Mirroring)计算特征方向,以改善SIFT特征方向只受灰度差异影响等问题,提高了特征描述区分度,实现了红外图像与可见光图像精确匹配。但是,当匹配图像纹理较弱时,特征点的匹配精度则降低。通过研究现有算法,本文提出了一种基于显著性分析与改进的EOH(Edge Orientation Histogram)特征的红外可见光图像配准算法,实现红外可见光图像精确匹配。并通过实验验证了算法性能。

2 配准流程

本文所提出的匹配算法流程如图1所示。首先,对可见光图像进行显著性分析,对表达丰富信息的区域进行识别。然后,利用显著性结果,对可见光图像进行感兴趣区域与非感兴趣区域的划分。其次,在不同区域上,通过自动设置相应的参数,利用FAST(Features from Accelerated Segment Test)特征点检测算法,快速提取可见光图像与红外图像的特征点。之后,基于特征点与感兴趣区域与非感兴趣区域的位置关系,提出改进的EOH特征描述算子对特征点进行描述,使特征点之间区分度增大。最后,利用归一化的互信息以及相对位置约束条件,对两图像上的特征点进行匹配,同时利用随机一致性(RANSAC)对匹配的特征点进行筛查,剔除误匹配点,实现红外与可见光图像的最优匹配。

Fig.1 Flowchart of registration between infrared and visible images

3 显著性分析与感兴趣区域划分

图像的显著性体现了人们对图像不同位置的关注度。对于一幅图像,其中最重要的信息通常集中于局部关键区域,即感兴趣区域ROI(Region of interest),而背景则通常处于非感兴趣区域NROI。通过显著性分析,可以识别出图像的关键区域,在该区域内采用与其它区域不同的特征点提取方法,不仅可以增加ROI周围特征点的数量,提高匹配精度,同时还可以减小搜索区域,提高特征点匹配速度。

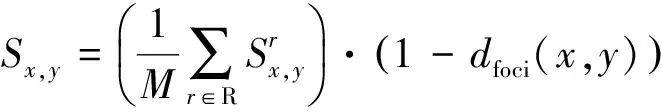

基于上下文感知的显著性探测算法[15],是利用心理学准则,来识别图像中感兴趣区域的,同时可以保留感兴趣区域周围重要的背景信息。该方法首先定义单一尺度以及局部-全局显著性,综合像素点之间的位置,颜色(灰度)以及局部-全局差异,将边界以及物体特点区域凸显出来,获得图像的初始显著图。然后利用多尺度方法增强图像的初始显著性图,同时减弱纹理单一的背景区域的显著性,提高显著性与非显著性区域对比度,得到图像增强后的显著图。其次,提取增强后显著图中显著性较强的区域作为感兴趣区域,而周围的像素则根据与该区域的距离被赋予不同的权重,将权重与像素点的显著值相乘,提高感兴趣区域周围重要背景区域的显著性,同时减小远离感兴趣区域像素的显著性,使图像中上下文信息得到传递,从而获得到修正后的图像显著性图S,点(x,y)处的显著性Sx,y计算公式如下:

(1)

(2)

红外与可见光图像匹配阶段,利用可见光图像的显著性图,识别感兴趣区域(Region of Interest,ROI),在该区域与其它区域采用不同的方法选取特征点,可以实现多光谱图像的快速精确匹配。

(a)可见光图像

(b)可见光图像显著性分析结果

图2展示了可见光图像的显著性分析结果,其中(a)为可见光图像,(b)为可见光图像对应的显著性图。在图2(a)中,房屋与道路的显著性较高,而纹理单一的土地的显著性较低。对于显著图,通过设定阈值,将图像划分为感兴趣区域(ROI)与非感兴趣区域(NROI),即像素值大于阈值的区域为ROI区域,像素值小于阈值的区域为NROI区域,且通常选择0.5作为阈值。但是,如果可见光图像中部分显著性较大的区域并不在红外图像中,那么在这些区域内筛选特征点,将会影响匹配精度。所以如果一幅图像中存在多个ROI,则需要将它们与NROI的相对位置关系加入特征描述,用于匹配过程中误匹配点的滤除。

4 自适应FAST特征点检测

FAST是一种快速特征点检测算法,该方法只利用待选像素点与周围像素的比较信息判断该点是否为特征点。具体通过检测统计待选特征点周围的像素值,如果候选点邻域内有足够多的点与该候选点的灰度值的差异超过设定阈值,则判断该待选点为特征点。在实际计算过程中,对于图像I,一般通过设置最小对比率确定阈值,其公式如下:

Threshold=MC*max(I(x,y)),

(3)

其中:Threshold为滤出特征点的阈值,MC为最小对比率,大小介于0~1之间, max(I(x,y))则表示图像I中最大的像素值。图3为不同最小对比率对应的特征点提取结果,其中图(a)(b)(c)对应的值分别为0.01,0.1以及0.5。从图中可以看出,如果阈值较大,则无法筛选出部分幅值较低的边界点,造成特征点数量较少;如果阈值较小,在提取边界特征点时,则由于受背景噪声的影响较严重,从而会选出大量低质量的特征点。所以,利用固定阈值筛选特征点尽管计算简单,但是却无法满足不同图像以及图像中不同区域特征点的筛选需求[16]。

(a)最小对比率为0.01时特征点提取结果

(b)最小对比率为0.1时特征点提取结果

(c)最小对比率为0.5时特征点提取结果

本文基于显著性图,对图像ROI与NROI采用不同的特征点搜索策略。如图2所示,房屋与道路等与周围差异较大或边界明显区域的显著性较高,所以需设置较低的MC值,以获得更多的特征点,而土地的显著性较低,所以MC值需设置的高些,以获得更有代表性且边界幅值较大的特征点,以避免在单一纹理区域选取过多的特征点,造成较高的误匹配率。综合感兴趣区域与非感兴趣区域灰度信息,本文MC值选取方法如下:

(4)

(5)

(a)原始可见光图像

(b)可见光图像显著性分析结果

(c)ROI区域划分结果

(d)可见光图像特征点提取结果

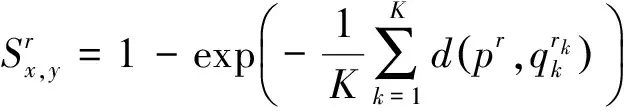

对于红外图像,其每个像素点的灰度值反映了对应的热量信息,即不同的热量值对应不同的灰度值,热量愈大的点对应的灰度值越大,且受光照等环境因素的影响相对较弱。利用统一MC值,可以在不同采集环境下的红外图像中快速获得热量变化较大区域的特征点,同时由于红外图像边界扩散程度较大,不利于ROI的划分,所以在求解红外图像的特征点时,将采取统一阈值,以实现特征点的快速提取。红外图像特征点提取结果如图5(彩图见期刊电子版)所示,其中采用的MC值为0.23。

图5 红外图像特征点提取结果

5 改进的EOH特征描述与特征点匹配

EOH特征综合了特征点周围不同方向上的边界信息,实现对边缘方向以及幅值的描述。EOH在边缘检测结果的基础上,通过计算以特征点为中心的矩形框范围内,所有点在多个方向的梯度值,生成特征点的边缘方向直方图。公式(6)用于计算点(x,y)处边缘强度,公式(7)定义了其边缘方向。

(6)

(7)

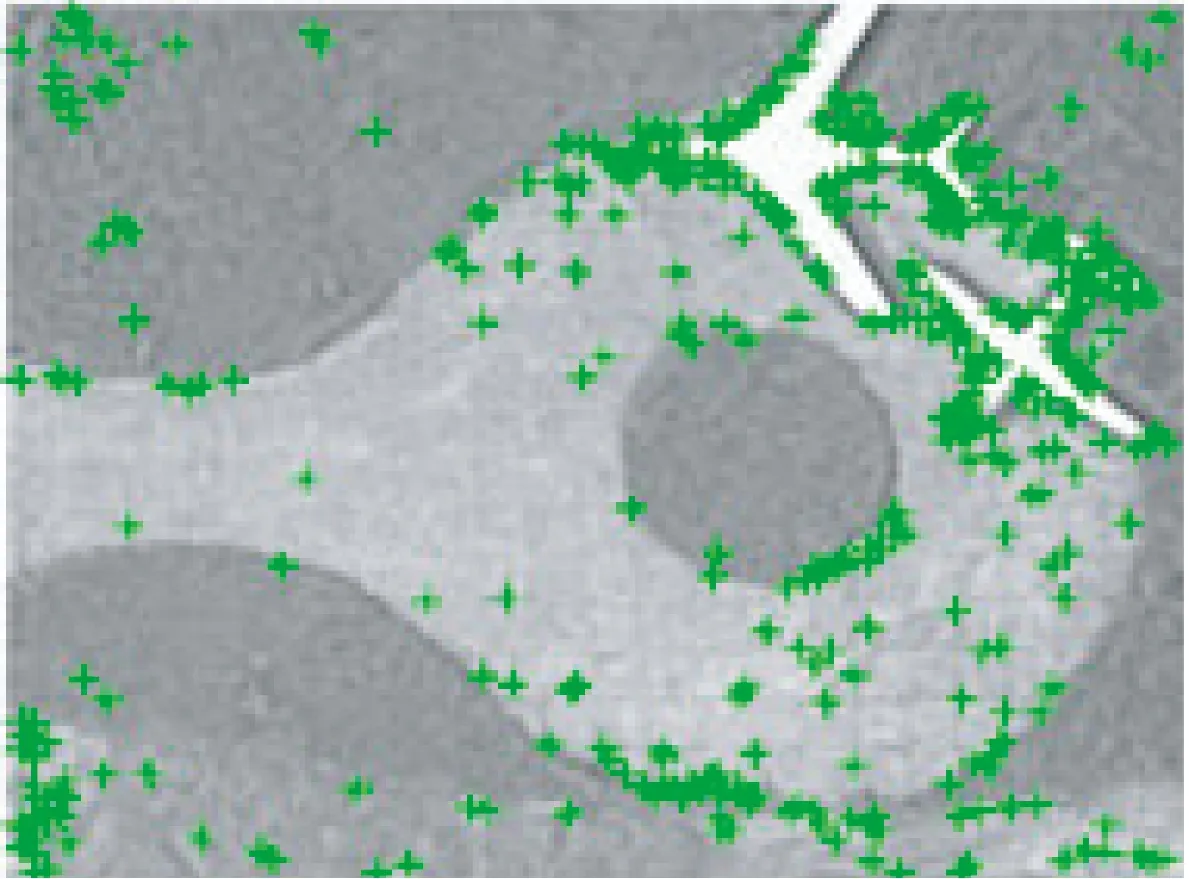

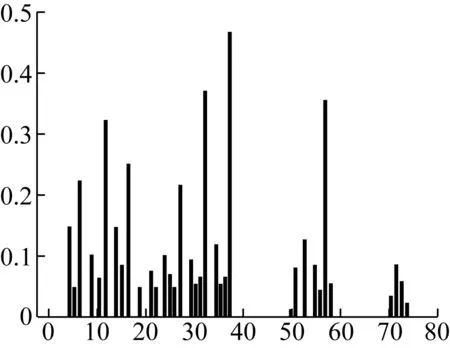

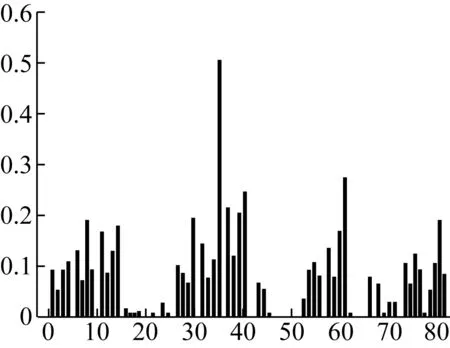

传统EOH特征描述需要手动为特征点设置窗宽,在窗宽范围内检测图像的边缘信息,所以窗宽大小会严重影响描述精度。如果窗宽过大,不仅会增加特征描述的计算时间,同时降低了相邻特征点之间的区分度及匹配精度。如果窗宽过小,则将导致描述的边缘信息过细,增加特征点误匹配的概率。图6为采用EOH特征描述[1]对同一特征点在不同窗宽下获得的80维特征的直方图,其中6(a)为可见光图像,图中十字为特征点,以特征点为中心选取边长分别为60、100以及140 pixel的正方形区域,而6(b)~6(d)为分别采用3个不同的窗宽时对应特征点的EOH特征。从图中可以发现,窗宽对特征描述的影响较大。

本文采用公式(8)为特征点p设置不同的窗宽:

(8)

即为特征点到最邻近非该点所处区域的最短距离,如果p点位于ROI,则其对应的窗宽为该点到NROI的最短距离,而如果p点位于NROI,则其对应的窗宽为该点到不同ROI的最短距离与对应ROI显著性均值的乘积和的均值。通过公式(8),将特征点的位置信息融入EOH特征中。

根据自适应窗宽获得EOH特征描述后,对每个来自可见光图像的特征点,在红外图像中计算与其特征描述最相似的特征点,利用归一化的互信息作为特征描述间的相似性测度。然后利用随机抽样一致算法(RANdom SAmple Consensus,RANSAC)对匹配的特征点进行筛选提纯,最终获得红外与可见光图像的匹配结果。

(a)可见光图像特征点以及特征点对应的窗口

(b)窗宽为60像素时特征点 EOH特征的统计直方图

(c)窗宽为100像素时特征点 EOH特征的统计直方图

(d)窗宽为140像素时特征点 EOH特征的统计直方图

6 实验结果

本文选择了3种不同情况下的红外与可见光图像数据进行配准,选用SIFT、SRSIFT[13]、基于EOH的SIFT算法、RNGM[14]等4种匹配算法与本文算法做对比。为了客观评价匹配效果,将利用两图像中匹配的特征点间的坐标误差,求解均方根误差RMSE(Root-Mean-Square Error),以准确评估本文算法的精度。

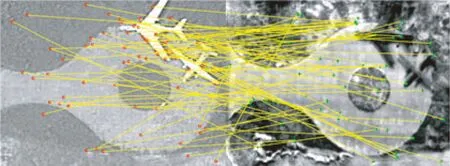

第一种情况:红外图像与可见光图像采集的角度与位置大致相同,即红外图像中包含可见光图像中全部的ROI。如图7(彩图见期刊电子版)所示,红外图像与可见光图像的采集条件差异较小,其中,红外图像的尺寸为486×333,可见光图像尺寸为250×188。图7(a)为利用SIFT算法求得的特征点匹配结果,图7(b)为利用SRSIFT算法求得的特征点匹配结果,其中尺度范围为0.02~1.51,图7(c)为利用FAST进行特征提取,MC值为0.1,然后将EOH作为特征描述算法求得的特征点匹配结果,图7(d)为利用RNGM算法求得的特征点匹配结果,图7(e)为利用本文方法求得的结果。从结果可以看出,本文方法不同于其它4种算法,它在可见光图像中背景纹理均一的区域,选择较高的阈值,筛选出边缘幅值较大且数量较少的特征点,在ROI区域内,即飞机以及其周围区域内,自适应的选择阈值,筛选出飞机上重要的特征点,然后利用自适应窗口的EOH求解特征,最终实现精确匹配。对于SIFT算法,当处理多光谱影像时,由于红外与可见光图像在同一物体区域的灰度分布存在差异,单纯利用SIFT特征无法实现精确匹配。对于SRSIFT算法,其在SIFT算法结果的基础上,除去了一定量的误匹配特征点对,但是由于SIFT算法的精度较差,造成SRSIFT无法获得更高的精度。而对于FAST算法来说,受背景区域的影响较大,为了获得高质量的特征点,可以设置较小阈值进行特征点提取,但是低阈值将使该算法在纹理均一的背景区域选取较多的点,同时由于红外图像中对应的背景区域呈现的纹理特性与红外图像差异很大,导致匹配精度降低。对于RNGM算法,由于图像背景纹理较弱,通过边缘增强后,大量的特征点位于飞机与机场边缘,所以获得了较高的匹配精度。

第二种情况:红外图像与可见光图像采集的角度与位置均不同,但红外图像中包含可见光图像中全部的ROI。如图8所示,红外图像与可见光图像对应的区域之间存在平移变换,其中红外图像尺寸为320×256,可见光图像尺寸为1 024×1 024。图8(a)为利用SIFT算法求得的特征点匹配结果,图8(b)为利用SRSIFT算法求得的特征点匹配结果,其中尺度范围为0.01~1.63,图8(c)为利用FAST与EOH算法求得的特征点匹配结果,其中MC值为0.05,图8(d)为利用RNGM算法求得的特征点匹配结果,图8(e)为利用本文方法求得的结果。从结果可以看出,本文方法获得了精确的特征点匹配结果。对于SIFT与FAST以及基于SIFT的SRSIFT算法,尽管红外与可见光图像间平移量较小,但是由于两图像背景区域的纹理特性存在差异,导致误匹配率增大。对于RNGM算法,由于图像背景纹理较弱,通过边缘增强后,大量的特征点位于道路边缘,所以获得了较高的匹配精度。

第三种情况:红外图像与可见光图像采集的角度与位置均不同,红外图像中包含可见光图像中部分的ROI。如图9所示,红外图像拍摄的区域只占可见光图像中较少的部分,且采集角度差异较大,其中红外图像的尺寸为256×320,可见光图像的尺寸为2 420×1 916。图9(a)为利用SIFT算法求得的特征点匹配结果,图9(b)为利用SRSIFT算法求得的特征点匹配结果,其中尺度范围为0.03~1.45,图9(c)为利用FAST与EOH算法求得的特征点匹配结果,其中MC值为0.1,图9(d)为利用RNGM算法求得的特征点匹配结果,图9(e)为利用本文方法求得的结果。从结果可以看出,由于可见光图像中包含大量的与红外图像相似但并不对应的区域,使得SIFT与FAST算法的误匹配率增大。对于RNGM算法,尽管边缘增强后,可见光图像中房屋以及道路得到凸显,但是由于图像纹理单一且存在大量相似纹理,故增加了误匹配率,降低了匹配精度。而对于本文算法,在公路或街道附近,即ROI区域,重点提取特征点,但在房屋区域,即纹理较单一的背景区域,则选择较大阈值,筛选高质量的背景特征点。同时本文方法在计算特征点EOH特征时,包含了其与ROI、NROI的相对位置信息,所以在匹配特征点时,尽管红外图像并不完全包含可见光图像中的ROI区域,但是依然获得了较高的匹配精度。

特征点匹配率与整体运算时间对比如表1所示,其中特征点匹配正确率为正确匹配的特征点占所有特征点的比率。通过3种情况的数据测试知,本文算法在匹配准确性方面明显优于其它4种算法。尤其是对于第三组数据,在红外与可见光图像的采集角度与位置存在较大差异时,本文算法可以在ROI与NROI,自适应选择窗宽的大小,增加了特征点间的区分度,所以本文算法仍可以保证74.21%的匹配正确率,受图像纹理单一且存在大量相似纹理的影响,其他算法的特征匹配率较低。这表明本文方法鲁棒性强、稳定性高。但是由于本文需要首先求解可见光图像的显著图,而求解显著图的耗时与图像大小有关,所以当可见光图像尺寸较大时,本文方法所需时间也将增大。

根据本文算法求解的3组数据特征点匹配结果,求解仿射形变矩阵,将红外图像与可见光图像进行配准。图10(a~c)分别展示了3组图像的配准结果。对于第一组与第二组数据,红外图像中包含可见光图像中全部的ROI,故最终的匹配效果较好,而对于第三组数据,由于本文方法匹配的特征点主要集中于公路周围,所以最终的匹配结果只在公路周围的效果较好。3组匹配结果对应的RMSE值分别为0.078,0.109和0.274。

(a)SIFT算法匹配结果

(b)SRSIFT算法匹配结果

(c)基于EOH的SIFT算法匹配结果

(d)RNGM算法匹配结果

(e)本文算法匹配结果

Fig.7 Feature points matching results of three methods on the first data set

(a)SIFT算法匹配结果

(b)SRSIFT算法匹配结果

(c)基于EOH的SIFT算法匹配结果

(d)RNGM算法匹配结果

(e)本文算法匹配结果

Fig.8 Feature points matching results of three methods on the second data set

(a)SIFT算法匹配结果

(b)SRSIFT算法匹配结果

(c)基于EOH的SIFT算法匹配结果

(d)RNGM算法匹配结果

(e)本文算法匹配结果

Fig.9 Feature points matching results of three methods on the third data set

表1 特征匹配率与整体运算时间对比

(a)第一组数据配准结果

(b)第二组数据配准结果

(c)第三组数据配准结果

7 结 论

本文利用显著性分析、自适应阈值的FAST特征点识别以及改进的EOH特征实现多光谱图像匹配。实验证明,本文提出的算法在处理不同的红外与可见光图像时,均获得较好的匹配效果,尤其适用于红外与可见光图像信息融合等图像位置角度差异较小的场合。而对于角度发生较大改变或场景范围差异较大时,利用本文方法,在ROI区域仍可以实现稳定的特征点提取与可靠的特征点匹配。

[1] AGUILERA C, BARRERA F, LUMBRERAS F,etal.. Multispectral image feature points [J].Sensors, 2012, 12(9): 12661-12672.

[2] 蒋宏,任章.红外与可见光图像配准和融合中的关键技术[J]. 红外与激光工程,2006,35(增): 7-12. JIANG H, REN ZH. Key technologies in registration and fusion for infrared and visible images [J].InfraredandLaserEngineering, 2006,35(Suppl.): 7-12.(in Chinese)

[3] 柏连发,韩静,张毅,等.采用改进梯度互信息和粒子群优化算法的红外与可见光图像配准算法[J]. 红外与激光工程,2012,41(1): 248-254. BAI L F,HAN J, ZHANG Y,etal.. Registration algorithm of infrared and visible images based on improved gradient normalized mutual information and particle swarm optimization [J].InfraredandLaserEngineering, 2012,41(1): 248-254.(in Chinese)

[4] 李新娥, 班皓,沙巍,等. 一种大视场TDICCD相机的多传感器图像配准方法[J]. 液晶与显示,2014,29(4): 644-648. LI X E,BAN H, SHA W,etal.. Registration method of large field view and multi-sensor images of TDICCD cameras [J].ChineseJournalofLiquidCrystalsandDisplay, 2014,29(4): 644-648.(in Chinese)

[5] 臧丽,王敬东.基于互信息的红外与可见光图像快速配准[J]. 红外与激光工程,2008,37(1): 164-168. ZANG L, WANG J D. Infrared and visible light image fast registration based on mutual information [J].InfraredandLaserEngineering, 2008,37(1): 164-168.(in Chinese)

[6] 杨桄,童涛,陆松岩,等.基于多特征的红外与可见光图像融合[J]. 光学 精密工程,2014,22(2): 489-496. YANG G, TONG T, LU S Y,etal.. Fusion of infrared and visible images based on multi-features [J].Opt.PrecisionEng., 2014,22(2): 489-496.(in Chinese)

[7] 程国华,王阿川,陈舒畅,等.多源遥感影像高精度自动配准方法研究[J]. 液晶与显示,2016,31(6): 604-612. CHENG G H, WANG A CH, CHEN SH CH,etal.. High accuracy-automatic registration method research on multi-source remote sensing image [J].ChineseJournalofLiquidCrystalsandDisplay, 2016,31(6): 604-612.(in Chinese)

[8] 谭东杰,张安.方向相关与互信息加权组合多模图像配准方法[J]. 红外与激光工程,2013,42(3): 836-841. TAN D J, ZHANG A. Multi-model image registration based on weighted orientation correlation and mutual information [J].InfraredandLaserEngineering, 2013,42(3): 836-841.(in Chinese)

[9] 余先川,吕中华,胡丹.遥感图像配准技术综述[J]. 光学 精密工程,2013,21(11): 2960-2972. YU X CH, LV ZH H, HU D. Review of remote sensing image registration techniques [J].Opt.PrecisionEng., 2013,21(11): 2960-2972.(in Chinese)

[10] 丘文涛,赵建,刘杰.结合区域分割的SIFT图像匹配方法[J]. 液晶与显示,2012,27(6): 827-831. QIU W T, ZHAO J, LIU J. Image matching algorithm combining SIFT with region segmentation [J].ChineseJournalofLiquidCrystalsandDisplay, 2012,27(6): 827-831.(in Chinese)

[11] 刘畅,崔桐,贺成龙,等.基于高曲率特征点匹配的红外可见光图像配准[J]. 指挥信息系统与技术,2016,7(1): 13-17. LIU CH,CUI T, HE CH L,etal.. Infrared-visual image registration based on high-curvature feature matching [J].CommandInformationSystemandTechnology, 2016,7(1): 13-17.(in Chinese)

[12] 李健,王滨海,李丽,等.基于SIFT的电力设备红外与可见光图像的配准和融合[J]. 光学与光电技术,2012,10(1): 75-78. LI J, WANG B H, LI L,etal.. Electrical equipment IR and visible images registration and fusion based on SIFT [J].Optic&OptoelectronicTechnology, 2012,10(1): 75-78.(in Chinese)

[13] YI Z, ZHI G C, YANG X. Multi-spectral remote image registration based on SIFT [J].ElectronicsLetters, 2008,44(2):107-108.

[14] HUANG Q, GAO Q, YANG J,etal.. Visible and infrared image registration algorithm based on NSCT and gradient mirroring [C].ConferenceonMultispectral,Hyperspectral,andUltra-spectralRemoteSensingTechnologysandApplicationsV, 2014.

[15] GOFERMAN S, ZELNIK-MANOR L, TAL A. Context-aware saliency detection [J].IEEETransactionsonPatternAnalysis&MachineIntelligence, 2011, 34(10): 1915-26.

[16] 丁尤蓉,王敬东,邱玉娇,等.基于自适应阈值的FAST特征点提取算法[J]. 指挥控制与仿真,2013,35(2): 47-53. DING Y R, WANG J D, QIU Y J,etal.. FAST feature detection algorithm based on self-adaptive threshold selection [J].CommandControl&Simulation, 2013,35(2): 47-53.(in Chinese)

徐 军(1970-),男,云南楚雄人,96658部队工程师,现为武汉大学博士研究生,主要从事航天摄影测量、遥感图像处理、打击效果评估等方面的研究。E-mail: junxu70@163.com

付天宇(1991-),男,北京人,博士研究生,2013年于山东大学获得学士学位,主要从事图像配准算法研究。E-mail: fty0718@163.com

(版权所有 未经许可 不得转载)

Registration of infrared image and visible image based on saliency and EOH feature analysis

XU Jun1*, FU Tian-yu2, YANG Jian2, FENG Su3

(1.State Key Laboratory of Information Engineering in Surveying,MappingandRemoteSensing,WuhanUniversity,Wuhan430079,China;2.BeijingEngineeringResearchCenterofMixedRealityandAdvancedDisplay,SchoolofOpticsandElectronics,BeijingInstituteofTechnology,Beijing100081,China;3.InformationCenter,GeneralAdministrationofQualitySupervision,InspectionandQuarantineofthePRC,Beijing100088,China)

To realize the information fusion of infrared and visible images and make up the deficiency of the single modality image, a new algorithm based on saliency and Edge Orientation Histogram(EOH) features was proposed. Firstly, the saliency analysis was used to find the important information of the visible image and to obtain the saliency map. By fusing it with the visible image, the important information in the visible image was divided. Then, adaptive Features from Accelerated Segment Test(FAST) algorithm was employed in detecting feature points on the visible image and infrared image, and the improved EOH was used to describe the detected feature points. Finally, corresponding feature points were found by calculating the similarity of feature points in the visible and infrared images and the infrared and visible images were matched. An image matching experiments at three conditions were carried out, and the results indicate that when the collection conditions between the infrared and visible images are similar, the feature matching accuracy reaches 96.55%. When the difference of collection conditions between the infrared and visible images is large, the feature matching accuracy still can reach 74.21%. The algorithm realizes fast and accurate matching of infrared and visible images, and meets the requirements of image matching for accuracy and stability, especially under a collection condition that the infrared and visible images are bigger different.

image fusion; infrared image; visible image; saliency analysis; adaptive Features from Accelerated Segment Test(FAST); Edge Orientation Histogram(EOH); feature point descriptor

2016-07-15;

2016-09-07.

中国博士后科学基金资助项目(No.2015M580962)

1004-924X(2016)11-2830-11

TP391.4

A

10.3788/OPE.20162411.2830

*Correspondingauthor,E-mail:junxu70@163.com