基于改进特征袋模型的奶牛识别算法

陈娟娟 刘财兴 高月芳 梁云

摘要:针对特征袋(BOF)模型中存在特征计算耗时、识别精度低的不足,提出一种新的改进BOF模型以提高其目标识别的精度和效率,并将其应用于奶牛个体识别。该算法首先引入优化方向梯度直方图(HOG)特征对图像进行特征提取和描述,然后利用空间金字塔匹配原理(SPM)生成图像基于视觉词典的直方图表示,最后自定义直方图交叉核作为分类器核函数。该算法在项目组自行拍摄的数据集(包含15类奶牛、共7500张奶牛头部图像)上的实验结果表明,使用基于SPM的BOF模型将算法的识别率平均提高2个百分点;使用直方图交叉核相比使用高斯核将算法的识别率平均提高2.5个百分点;使用优化HOG特征,相比使用传统HOG特征将算法识别率平均提高21.3个百分点,运算效率为其1.68倍;相比使用尺度不变特征变换(SIFT)特征,在保证平均识别精度达95.3%的基础上,运算效率为其7.10倍。分析结果可知,该算法在奶牛个体识别领域具有较好的鲁棒性和实用性。

关键词:特征袋模型;图像识别;梯度直方图特征;空间金字塔匹配;尺度不变特征变换特征

中图分类号:TP391.41

文献标志码:A

0引言

互联网的兴起使得现今各行业逐渐朝着工业化、智能化方向发展,其中奶业发展是农业发展中国家十分关注的问题。随着信息技术和多媒体技术的飞速发展与广泛应用,图像数量日益增多,图像识别和分类的研究与应用成为计算机视觉领域中越来越重要的课题[1]。基于计算机视觉技术,利用奶牛图像进行奶牛个体识别和分类是实现奶牛信息化管理的有 效手段,对奶业的飞速发展起着至关重要的作用。

传统的图像识别与分类算法有很多,特征袋(Bag of Features, BOF)[2]是最具代表性的一类。该算法由文本领域的词袋(Bag of Word, BOW)算法发展而来,其出现为基于内容的图像描述和处理以及对图像的语义理解开拓了新思路。该算法主要用于计算机视觉领域的图像分类、目标识别和图像检索[3-4],近年来,也开始用于显著性区域检测[5]、行为识别[6]、糖尿病患者的食物识别系统[7]和人喉表皮样癌细胞 (HEp-2)的识别分类[8]。随着该算法在各领域的广泛应用,其存在的计算效率低、识别精度有限等问题成为研究者们越来越关注的内容,为此,不断有研究者尝试新的方法以改善上述问题。为提高算法计算效率,有学者提出较快速的局部特征描述子DAISY[9]和快速鲁棒特征(Speeded Up Robust Features, SURF)[10]来替换尺度不变特征变换(Scale Invariant Feature Transform, SIFT)进行图像特征提取以缩短特征提取时间。为提高算法识别率,有学者尝试提高BOF表示的判别力,例如,文献[11]提出利用均值漂移方法对视觉单词进行聚类以产生具有更高判别力的高序语义级视觉词典;文献[12]把视觉单词的空间分布信息考虑在内提出了一种更有判别力的视觉单词空间合并方法;文献[13]提出了一种新的基于直方图向量的无监督降维框架,以创建一个紧凑和有判别力的BOF表示;文献[14]则提出了一种用于目标跟踪的软分配BOF算法,试图利用软分配来提高BOF表示的判别能力;此外,文献[15]提出采用多种特征描述符相结合的方式进行图像特征描述以提高算法的识别精度。

上述方法在一定程度上提高了BOF算法的识别精度和计算效率,但是这些方法仅适用于某种特定的情境。为进一步提高BOF的计算性能和识别精度并将其应用于奶牛个体识别,本文提出了一种新的改进BOF模型。该模型将优化后的方向梯度直方图(Histogram of Oriented Gradient, HOG)特征[16]引入到基于空间金字塔匹配(Spatial Pyramid Matching, SPM)[17]的BOF模型中,并使用自定义的直方图交叉核(Histogram Intersection Kernel)[18]作为分类器的核函数。使用基于SPM的BOF模型和基于直方图交叉核的分类器可提高算法识别精度;使用本文优化HOG特征相比使用传统HOG特征既提高了算法计算性能,又改善了算法识别性能;相比使用SIFT特征在保证识别精度的基础上大大改善了算法计算性能。将本文算法用于奶牛个体识别,奶牛个体的实验用数据集为该奶牛在不同姿态、不同背景、不同角度下拍摄得到的若干张具有判别力的图像,因此可将奶牛个体视为目标识别中的一个类别来分析处理。实验中,用本文算法分别对5类、8类、10类、12类、15类奶牛识别分类,在每类奶牛有500张图像(80%作训练集,20%作测试集)的情况下,识别精度平均可达95.3%,分析结果表明本文算法在奶牛个体识别领域。

1基于SPM的BOF模型

在自然语言处理和信息检索领域中有一种比较常见的用于文本分类的模型——词袋(BOW)模型,该模型将文本看作是若干单词的集合,忽略单词之间的语法和语序关系。随后,图像研究领域的学者将这一思想引入到图像检测和图像识别领域中,将图像看作是局部特征的集合,BOF模型由此诞生。BOF模型应用在图像识别领域主要包括以下步骤:首先是特征提取和特征描述,BOF模型多采用SIFT特征对图像进行描述;然后是构造视觉词典,选择一种聚类算法对图像的特征描述符进行聚类,通常采用的聚类算法是K-均值(K-means);最后是训练分类器对结果识别分类,比较常用的分类器是支持向量机(Support Vector Machine, SVM),常用的核函数有高斯核和线性核。

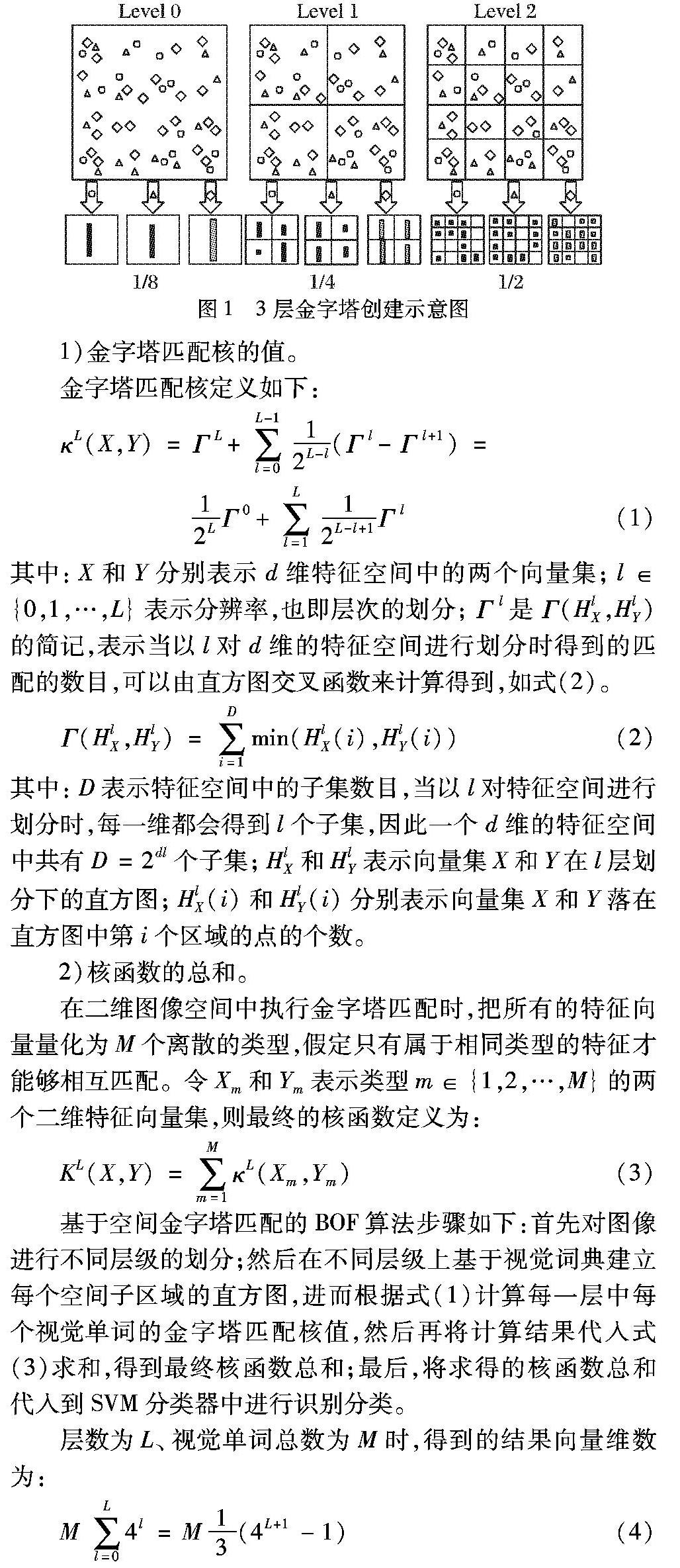

将场景分类中常用的空间金字塔匹配原理引入到BOF模型中,即可得到基于SPM的BOF模型[16]。该模型的基本思想是利用空间金字塔对图像进行匹配、识别和分类,其工作原理如图1,图中的圆形、菱形和三角形分别表示三种不同的特征类型,三种不同分层方法的权重分别是1/8,1/4,1/2。空间金字塔匹配方法将特征集映射到多分辨率的直方图空间,在该空间中计算加权的直方图交叉结果,以此寻找特征集的最佳匹配。因此,空间金字塔匹配的核心思想在于将图像的特征集映射到高分辨率的空间内进行匹配,匹配的最终结果是不同分辨率下经过不同加权后匹配结果的和。

2改进的BOF模型

BOF模型存在计算性能差、识别精度低的不足,上述基于SPM的BOF模型虽然提高了该模型的识别精度,但其计算性能仍有待提高。BOF模型的运算耗时主要集中在特征提取和描述阶段,其中SIFT特征维数较高、计算复杂度较大、特征计算耗时、执行效率低是导致算法计算性能差的一个很大因素。为此,本文将优化后HOG特征引入基于SPM的BOF模型替换SIFT特征以改善算法计算性能。优化HOG特征相比SIFT特征减少了特征维度,降低了特征复杂度,缩短了特征计算时间,从而提高了整个算法的计算性能。选择适当的特征提取算法对图像进行特征提取后,需要利用提取到的图像特征完成识别分类任务,此时分类器的选择至关重要。为进一步提高算法识别精度,本文分析对比了基于高斯核和直方图交叉核的两种SVM分类器的识别性能,实验表明后者更适合于本文的奶牛识别算法,因此最终选择后者作为本文算法的分类器。

2.1优化HOG特征

HOG是计算机视觉领域中常用于目标检测的描述符,传统HOG特征实现步骤为:首先对图像进行归一化处理,将检测窗口内的图像划分为若干个cell(细胞单元);然后统计每个cell中各像素点的梯度或边缘的方向为每个cell建立直方图,将相邻的若干个cell组成block(块),统计整个块的直方图并对其进行归一化;最后,把所有block的直方图组合得到HOG特征描述符,即36维的HOG特征。

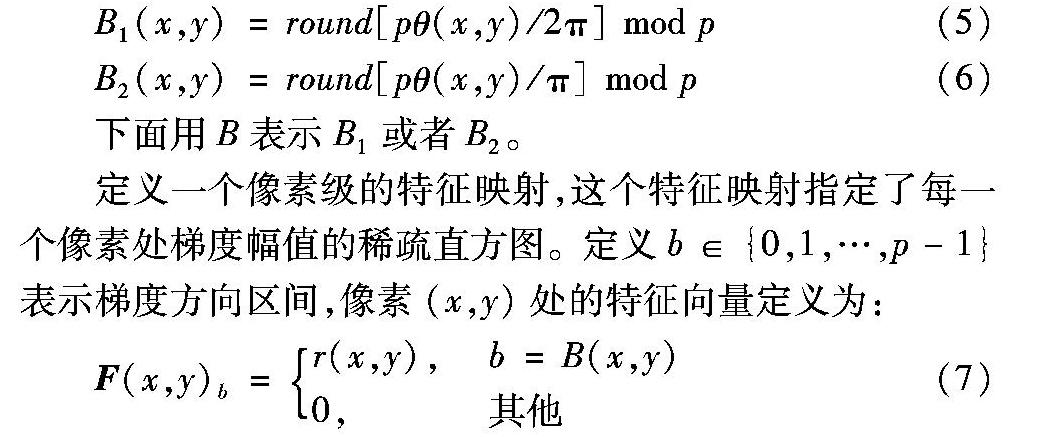

为进一步降低特征复杂度,提高算法计算性能,本文采用与文献[19]相似的思想,在不引起性能损失的前提下对传统36维HOG特征解析降维,得到31维的优化HOG特征并将其作为本文特征描述符。优化HOG特征相比传统HOG特征省去了计算稠密特征映射时的投影过程,减少了特征维度,降低了特征复杂度,节省了特征计算时间,缩短了整个算法的运行时间,从而提高了算法计算效率,但是识别性能并未因此受到影响。优化31维HOG特征的具体实现如下:

在实际使用中发现,有些目标类别适合使用对比度敏感特征,有些则适合使用对比度不敏感特征。为了使本文的优化HOG特征能适用于尽可能多的目标类别,文本既使用了对比度敏感特征又使用了对比度不敏感特征。假设C是聚合有9个对比度不敏感方向基于cell的像素级特征映射,D是聚合有18个对比度敏感方向基于cell的像素级特征映射。使用式(8)定义C和D的4种归一化因子,从而得到4×(9+18)=108维的特征向量F(i, j)。本文没有直接使用这个108维的特征向量,而是对其解析投影降维:27个在不同归一化因子上的累加和,F中的每个方向通道对应一个;4个在不同方向上的累加和,每个归一化因子对应一个。这样最终得到的特征映射是31维:27维对应不同的方向通道,其中包括9个对比度不敏感方向和18个对比度敏感方向;另外4维捕获(x,y)周围4个cell组成的block的梯度能量信息。

2.2直方图交叉核

若要实现图像的识别分类,在提取得到图像的优化HOG特征后,要选择适当的分类器利用提取到的特征完成识别分类任务,BOF算法多采用SVM作为分类器,因此本文也选用SVM作为分类器。SVM作为分类器时,一个很关键的步骤是核函数的选取[20-21],选择适当的核函数可在一定程度上提高算法的识别性能,本文在3.3.1节中为对比分析高斯核与直方图交叉核的识别性能进行了大量实验,最终确定选用后者作为本文SVM分类器核函数。直方图交叉核是图像分类领域常使用的核函数,常适用于图像的直方图特征分类。直方图交叉核的形式可表示为:

2.3算法描述

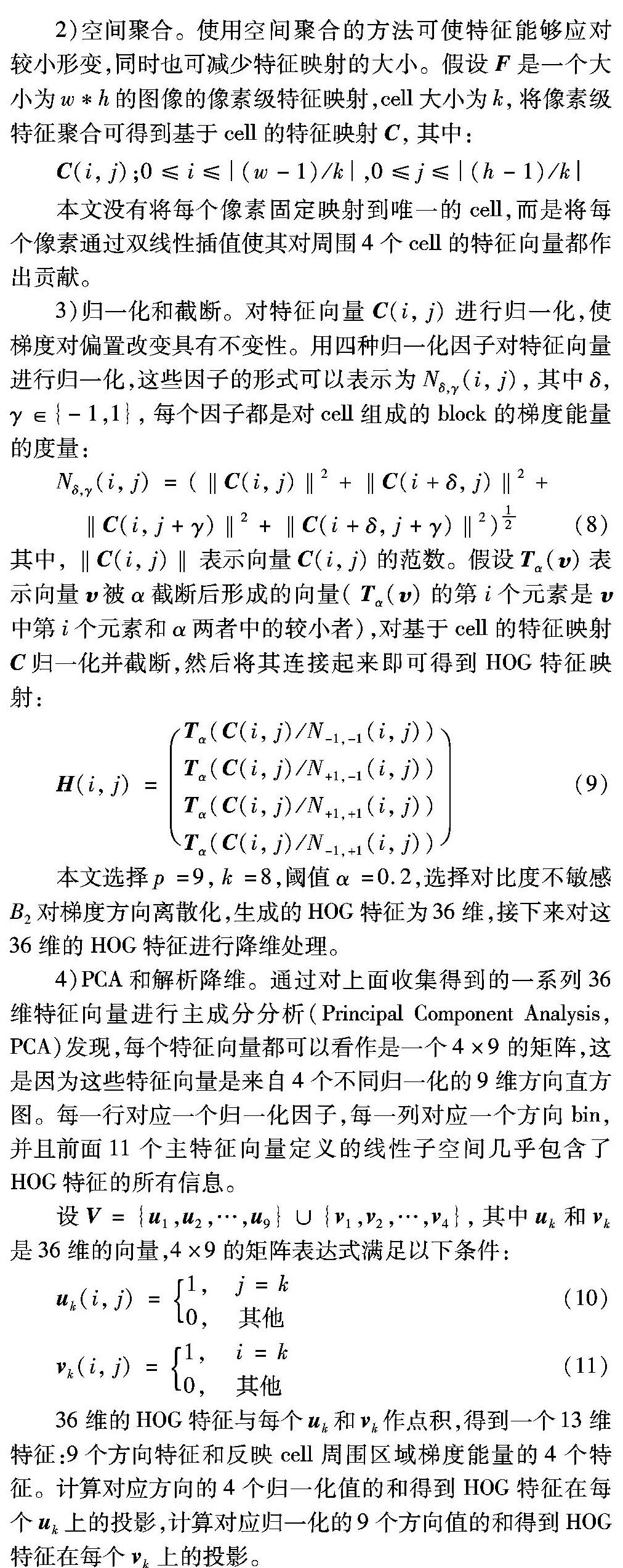

本文算法在BOF模型基础上,通过引入优化HOG特征等对其进行了一系列优化改进。算法具体流程如图2,图中SVM分类过程使用LIBSVM软件包实现,选择的SVM类型为C-SVC,松弛变量为200,所用核函数为自定义的直方图交叉核。

将从牛场拍摄得到的奶牛头部图像规格化,统一命名,初始化算法的一系列路径变量,为所有图像分配指定标签(用数字表示),如第一类奶牛的标签为1。将图像名称、存储位置、标签等相关信息以mat文件保存。

提取优化HOG特征

利用优化HOG特征提取算法对预处理后的奶牛头部图像进行特征提取和描述,获取每张奶牛头部图像的特征信息。在local文件夹中为每张图像建立一个文件夹,将每张图像的HOG特征以mat文件的格式保存在相应的文件夹中。

K-Means聚类

用K-Means聚类算法构造视觉词典,本文初始聚类质心随机选取,通过限定迭代次数收敛出最终的聚类中心,构造出视觉词典。构造的视觉词典以mat文件的形式保存在global文件夹中。

引入SPM对图像进行基于视觉词典的直方图表示

利用第1章介绍的方法生成所有奶牛头部图像的直方图表示,结果以mat文件的格式保存在global文件夹内。

SVM分类器识别分类

该过程直接使用由林智仁等开发出来的LIBSVM软件包[17]实现,核函数选用本文自定义的直方图交叉核。

3实验结果与分析

3.1实验环境

本文实验是在64位的Windows 7操作系统下完成,Matlab版本为2014a;主机内存为4.0GB,CPU为4核的i5-3470,主频为3.2GHz。

3.2实验数据集

本文实验用奶牛头部图像是项目组从牛场中实地拍摄而来,包含15类奶牛,共7500张奶牛头部图像。每类奶牛有500张图像,将该类奶牛所有头部图像统一命名后按照名称排序,取前400张作为训练集,其余100张作为测试集。本文将奶牛头部图像规格化为400×400像素大小,选择cellsize=8,p=9,因此每张图像的优化HOG特征为(400/8)×(400/8)×31维。字典大小为200,金字塔层数为3。该数据集取自现实自然场景,奶牛姿态比较多,图像背景比较复杂,部分图像光照条件不好,比较模糊。数据集中部分图像截图如图3所示。

3.3实验结果与分析

本节在收集得到的数据集上对基于直方图交叉核和高斯核的分类器的识别性能进行比较分析,并分析研究空间金字塔匹配原理对识别性能的影响,最后对基于传统HOG特征算法、基于SIFT特征算法和本文算法的识别性能和计算性能比较分析,以验证本文算法的有效性和合理性。实验中算法计算性能用运算时间衡量,识别精度用平均正确率衡量。

3.3.1识别性能分析

1)直方图交叉核提高识别精度。

为了验证选用直方图交叉核的合理性,本文分析对比了两种核函数:高斯核和直方图交叉核。实验分为5组,将15类奶牛按照名称排序后分别对其中的前5类、8类、10类、12类和15类奶牛识别分类。表1给出的是BOF模型中选用优化HOG作为特征描述符,使用高斯核和直方图交叉核作为分类器核函数时的识别精度情况。选择的SVM类型为C-SVC,松弛变量为200,其中高斯核参数gamma=2,直方图交叉核为本文自定义核,N表示类别数目。

由表1可知,在实验环境和参数设置相同的条件下,选用直方图交叉核和高斯核作为分类器核函数时,算法的平均识别精度分别可达93.3%、90.8%,选用直方图交叉核作为核函数比选用高斯核作为核函数能将算法的识别性能平均提高将近2.5个百分点,并且随着奶牛类别数目的增多,其提高的识别率整体上呈现增大的趋势。因此,本文算法选用直方图交叉核作为分类器核函数以提高识别性能。

2)空间金字塔提高识别精度。

为了验证金字塔匹配原理的有效性,本文同样是进行了5组对比实验,将15类奶牛按照名称排序后分别对前5类、8类、10类、12类和15类奶牛识别分类。表2给出了将优化HOG特征分别引入BOF模型和基于空间金字塔匹配的BOF模型时的识别精度情况,分类器核函数为本文自定义直方图交叉核。将优化HOG特征引入到基于SPM的BOF模型即为本文算法,N表示类别数目。

由表2可知,本文算法和BOF模型的平均识别精度分别可达95.3%、93.3%。本文算法能够将算法的识别精度平均提高将近2个百分点,验证了本文算法使用基于金字塔匹配的BOF模型的有效性。

3.3.2与基于其他特征的算法对比分析

本文算法,选用直方图交叉核作为分类器核函数,对BOF模型的识别性能作出优化。为验证本文优化HOG作为特征描述符相比传统HOG作为特征描述符在不引起性能损失的前提下提高了算法的计算效率、相比SIFT作为特征描述符在保证识别精度的基础上提高了算法的计算性能,同样是进行了上述5组对比实验。表3将本文算法与其他算法对比分析,给出了本文算法,分别使用传统HOG、优化HOG、SIFT作为图像特征描述符时算法的运行时间和识别精度。为使实验数据具有可比性,实验中基于传统HOG、SIFT特征的算法其图像大小、金字塔层数、字典大小等参数设置与本文算法完全一致,分类器核函数均为本文自定义直方图交叉核。

从表3的结果可知,在实验环境和参数设置完全相同的条件下,本文算法和基于传统HOG特征算法的平均识别精度分别可达95.3%、74.0%。使用本文优化HOG特征相比使用传统HOG特征,算法识别性能平均提高21.3个百分点,运算效率为其1.68倍,证明本文优化HOG特征的优越性。

另一方面,在实验环境和参数设置相同的条件下,文本算法和基于SIFT特征算法的平均识别精度分别可达95.3%、95.6%。导致本文算法平均识别精度较低的主要原因在于第2组实验中二者的识别精度相差较大,这与本文算法中K-Means的初始聚类质心是随机选择的有关。与使用SIFT作为特征描述符的算法相比,使用优化HOG作为特征描述符的本文算法在保证识别精度平均达到95.3%的基础上,计算性能为其7.10倍,并且随着奶牛类别数目的增多,优化HOG作为特征描述符时的识别精度逐渐超过SIFT作为特征描述符时的识别精度,其提高的计算性能也出现增多的趋势。

综合分析表3的结果可知,本文算法具有较好的鲁棒性和实用性,在实验数据集部分图像噪声较多、干扰较大的情况下依然能够取得好的实验结果。

4结语

本文算法在BOF模型的基础上,引入空间金字塔匹配原理对其加以改进,并引入优化31维HOG特征作为图像特征描述符,在此基础上选用图像处理领域中常用于直方图特征分类的直方图交叉核作为分类器的核函数。将该算法用于奶牛个体识别,在本文数据集上的实验结果表明,本文算法具有较好的鲁棒性和实用性,使用基于空间金字塔匹配的BOF模型和基于直方图交叉核的分类器提高了算法的识别性能,优化HOG作为特征描述符在保证识别精度的基础上改善了算法的计算性能,缩短了计算时间。本文接下来的研究方向为针对具体的奶牛个体识别问题,在K-Means聚类阶段制定更好的初始质心选取规则,以降低识别精度的随机性。

参考文献:

[1]王澍,吕学强,张凯,等.基于快速鲁棒特征集合统计特征的图像分类方法[J].计算机应用,2015,35(1):224-230. (WANG S, LYU X Q, ZHANG K, et al. Image classification approach based on statistical features of speed up robust feature set [J]. Journal of Computer Applications, 2015, 35(1): 224-230.)

[2]CSURKA G, DANCE C R, FAN L, et al. Visual categorization with bags of keypoints [EB/OL]. [2015-11-06]. http://www.cs.haifa.ac.il/~rita/vision_lab_course/2007/Project3_files/csurka_dance_bags_keypoints.pdf.

Proceedings of the 2004 Workshop on Statistical Learning in Computer Cision. 2004: 1-2.原稿这个查不到完整要素,ECCV 04与这个会议全称完全不一样

[3]WU L, HOI S C H, YU N. Semantics-preserving bag-of-words models and applications [J]. IEEE Transactions on Image Processing, 2010, 19(7): 1908-1920.

[4]UIJLINGS J R R, SMEULDERS A W M, SCHA R J H. Real-time visual concept classification [J]. IEEE Transactions on Multimedia, 2010, 12(7): 665-681.

[5]ZHENG Z, ZHANG Y, YAN L. Global and local exploitation for saliency using bag-of-words [J]. IET Computer Vision, 2014, 8(4): 299-304.

[6]YU J, JEON M, PEDRYCZ W. Weighted feature trajectories and concatenated bag-of-features for action recognition [J]. Neurocomputing, 2014, 131: 200-207.

[7]ANTHIMOPOULOS M M, GIANOLA L, SCARNATO L, et al. A food recognition system for diabetic patients based on an optimized bag-of-features model [J]. IEEE Journal of Biomedical and Health Informatics, 2014, 18(4): 1261-1271.

[8]SHEN L, LIN J, WU S, et al. HEp-2 image classification using intensity order pooling based features and bag of words [J]. Pattern Recognition, 2014, 47(7): 2419-2427.

[9]ZHU C, BICHOT C-E, CHEN L. Visual object recognition using daisy descriptor [C]// ICME 11: Proceedings of the 2011 IEEE International Conference on Multimedia and Expo. Washington, DC: IEEE Computer Society, 2011: 1-6.

[10]BAY H, TUYTELAARS T, VAN GOOL L. SURF: speeded up robust features [C]// ECCV 06: Proceedings of the 9th European Conference on Computer Vision — Volume Part Ⅰ. Berlin: Springer-Verlag, 2006: 404-417.

[11]WANG M, ZHANG C, SONG Y. Extraction of image semantic features with spatial-range mean shift clustering algorithm [C]// Proceedings of the 2010 IEEE 10th International Conference on Signal Processing. Piscataway, NJ: IEEE, 2010: 906-909.

[12]MU G, LIU Y, WANG L. Considering the spatial layout information of Bag of Features (BoF) framework for image classification [J]. PloS One, 2015, 10(6): e0131164.

[13]CUI J, CUI M, XIAO B, et al. Compact and discriminative representation of bag-of-features [J]. Neurocomputing, 2015, 169: 55-67.

Learning for Visual Semantic Understanding in Big Data

ESANN 2014 — Selected papers from the 22nd European Symposium on Artificial Neural Networks, Computational Intelligence and Machine Learning (ESANN 2014)

Industrial Data Processing and Analysis — Selected papers from the 11th World Congress on Intelligent Control and Automation (WCICA2014)

[14]REN T, QIU Z, LIU Y, et al. Soft-assigned bag of features for object tracking [J]. Multimedia Systems, 2014, 21(2): 189-205.

[15]ABDULLAH A, VELTKAMP R C, WIERING M A. Ensembles of novel visual keywords descriptors for image categorization [C]// Proceedings of the 2010 11th International Conference on Control Automation Robotics & Vision. Piscataway, NJ: IEEE, 2010: 1206-1211.

[16]DALAL N, TRIGGS B. Histograms of oriented gradients for human detection [C]// CVPR 2005: Proceedings of the 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2005, 1: 886-893.

[17]LAZEBNIK S, SCHMID C, PONCE J. Beyond bags of features: Spatial pyramid matching for recognizing natural scene categories [C]// CVPR 06: Proceedings of the 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2006, 2: 2169-2178.

[18]CHANG C-C, LIN C-J. LIBSVM: A library for support vector machines [J]. ACM Transactions on Intelligent Systems and Technology, 2011, 2(3): Article No. 27.

[19]FELZENSZWALB P F, GIRSHICK R B, MCALLESTER D, et al. Object detection with discriminatively trained part-based models [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2010, 32(9): 1627-1645.

[20]陈永健,汪西莉.FCM预选取样本的半监督SVM图像分类方法[J].计算机应用,2014,34(1):260-264. (CHEN Y J, WANG X L. Semi-supervised SVM image classification method with pre-selected by fuzzy C-mean [J]. Journal of Computer Applications, 2014, 34(1): 260-264.)

[21]王朔琛,汪西莉.参数自适应的半监督复合核支持向量机图像分类[J].计算机应用,2015,35(10):2974-2979. (WANG S S, WANG X L. Semi-supervised composite kernel SVM image classification with adaptive parameters [J]. Journal of Computer Applications, 2015, 35(10): 2974-2979.)