一种主动式全景立体视觉传感器设计

汤一平, 周静恺, 徐海涛

(浙江工业大学 信息工程学院,浙江 杭州 310023)

一种主动式全景立体视觉传感器设计

汤一平, 周静恺, 徐海涛

(浙江工业大学 信息工程学院,浙江 杭州 310023)

摘要:现有的三维激光扫描仪无法实时、全自动地计算空间三维信息,需要对获得的点云数据进行配准。为解决这些问题,研制了一种新型主动式全景立体视觉传感器(ASODVS),并且从影响ASODVS测距精度的各个因素进行了分析。实验结果表明:设计的ASODVS能自动、实时地进行空间物点深度测量,并得到相应的点云数据。

关键词:主动式全景立体视觉传感器; 面激光发生器; 单视点; 深度测量; 三维重构

0引言

与传统的测量技术相比,三维激光扫描技术能够快速、精确、无接触地完成复杂表面的测量和建模[1]。但三维激光扫描仪的制造成本和维护成本十分昂贵[2],并且需要对不同传感器的同名特征点进行配准。由于三维激光扫描技术在不同扫描站获得的空间三维数据分别采用各自的局部坐标系,因此,需要将它们配准到统一坐标系下。任何一种拼接都可能产生误差,并且还需要花费较大的计算资源[3]。

为解决上述问题,很多研究者从主动式全景立体视觉技术出发,通过集成全方位视觉传感器和激光信息解决了传统立体视觉中存在的特征点匹配问题[4~7]。视觉传感器的全方位成像特点使得这种技术在应用于空间三维信息测量和点云数据获取时无需对数据进行拼接。但是,目前这种技术最大问题是难以应用同一传感器对全景空间物点实现几何和色彩信息的同步获取,并且测量过程无法满足实时性、自动化的要求。

为此,本文结合实验室自主设计的全方位视觉传感器(omni-directional vision sensor,ODVS)[8]和移动面激光发生器实现了一种新型主动式全景立体视觉传感器(active ste-reo omni-directional vision sensor,ASODVS),并对其精度和适用情况进行了分析。ASODVS研究的贡献在于能够实时获取实际物体的几何、颜色信息,从视频信号获取源上解决计算机视觉测量领域中的准确性、实时性及鲁棒性等方面的问题。

1ASODVS的设计

1.1设计原理

主动式全景立体视觉技术通常涉及四个坐标系:全景摄像机坐标系(camera coordinate system,CCS)、世界坐标系(global coordinate system,GCS)、移动面激光发生器坐标系,即扫描坐标系(scan coordinate system,SCS)和数字化图像平面坐标系(image coordinate system,ICS)。大多数情况下,激光发生器、被测物和摄像机均处于不同的空间位置,因此,四个坐标系不能构成简单的关系,这样就使得测量时需要对坐标系进行配准和转换。坐标系之间的转换不仅会增大计算复杂度,也会降低测量数据的精度和鲁棒性。

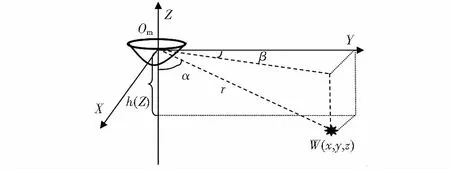

为了解决这个问题,ASODVS在设计时充分利用ODVS的单视点特性[8],以单视点在水平地面的投影点上为原点建立GCS,并且使ODVS的轴心和带动移动面激光发生器移动的螺杆轴心完全重合。使得GCS,CCS和SCS在垂直方向上构成直接关系重合。如图1所示,SCS与CCS的XOY平面互相平行,并在Z轴方向上相距h(Z),h(Z)的值通过估计激光发生器的移动速度和时间得到[9]。

ASODVS的设计降低了计算的复杂程度、提高了检测精度和鲁棒性。

图1 ASODVS各个坐标系之间的关系Fig 1 Relationship between coordinate systems of ASODVS

1.2硬件组成

ASODVS由移动面激光发生器和ODVS构成,系统的硬件结构如图2所示。为了与ODVS的全方位成像特点相匹配,移动面激光发生器由四个相隔90°的绿色线激光组成,其发射出的激光能够覆盖空间水平面的360°范围。通过步进电机的转动使得移动面激光发生器上下运动从而扫描场景,电机由型号为M542(4.2A,50 V)的驱动器驱动。四个绿色线激光发生器的型号为FU53212L10—BD22,波长为532 nm,形成的光斑模式为一字线状,功率为10 mW。

图2 ASODVS硬件结构图Fig 2 Hardware structure of ASODVS

2ASODVS测距原理

ASODVS在进行空间点三维测距时采用了三角测距原理[10],相比于其他激光测距原理,三角测距法的激光扫描效率更高,并且系统复杂度更低。

ASODVS在进行空间三维信息测量时,启动移动面激光发生器并对场景进行扫描,同时获得一系列带有激光信息的全景图像。通过对全景图像中的激光点进行解析[9]能够获得相应的入射角α和方位角β,根据式(1)、式(2)和式(3)可以计算该点的三维坐标值,如图3所示。在空间三维坐标计算的同时,ASODVS能够根据全景图像得到对应点的颜色信息,实现空间点几何信息和颜色信息的同步获取。ODVS的具体标定方法参考文献[11],标定结果如表1所示。

表1 ODVS的标定结果

(1)

(2)

式中‖u″‖为成像平面上的点到平面中心的距离,α0,α2为ODVS的标定参数,h(Z)为W点到视点Om的垂直距离,称为基线距,rw为W到Om的距离,βw为W相对于Om的方位角,αw为W相对于Om的入射角。空间点三维坐标分别为

(3)

其中,α为入射角,r为空间某一点与坐标原点之间的深度值,β角为水平面与X轴正向的夹角,即全方位图像上对应像素点的方位角。

图3 三维坐标的计算Fig 3 Calculation of 3D coordinates

3实验研究

为验证ASODVS空间三维坐标计算的准确性,将其放置在一个大小约为25 m2的场景内进行测距。表2为测得的数据,根据数据绘制的误差曲线如图4所示。由图可知,空间点到单视点的距离最大测量误差在3 %以内。应用ASODVS在图5所示场景中扫描可得如图6所示三维点云模型。

3.1基线距对测距误差的影响

对式(1)中的基线距h求偏微分可得到

(4)

表2 距离估算数据

图4 距离误差与方位角的关系曲线Fig 4 Curve of relationship between distance error and azimuth angle

图5 十个测距位置Fig 5 Ten ranging positions

图6 场景的三维点云Fig 6 3D points cloud of scene

由公式可知,入射角α越大,φh的值越大,即基线距误差对测距误差的影响越大。

3.2入射角对测距误差的影响

对式(1)中的入射角α求偏微分可得到

(5)

式中φα为测量误差对入射角的敏感系数,其与入射角和测量距离的关系曲线如图7所示。当测量距离r和入射角α越大时,φα的值越大。当入射角接近90°时,入射角误差对测距误差的影响非常大。

图7 φα关系曲线Fig 7 φα relationship curve

3.3图像分辨率对测距误差的影响

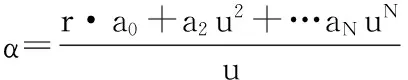

完成ODVS的标定之后,空间某一点相对于单视点Om的入射角α可以通过式(6)进行计算

(6)

将式(6)代入式(5),并将|u″‖记为u可以得到式(7)

(7)

其中,a0,…,aN为ODVS的标定参数,并且a4,…,aN近似为0。

因此,入射角对的变化关系可以用式(8)计算,对式(8)进一步处理可得到式(9)

(8)

(9)

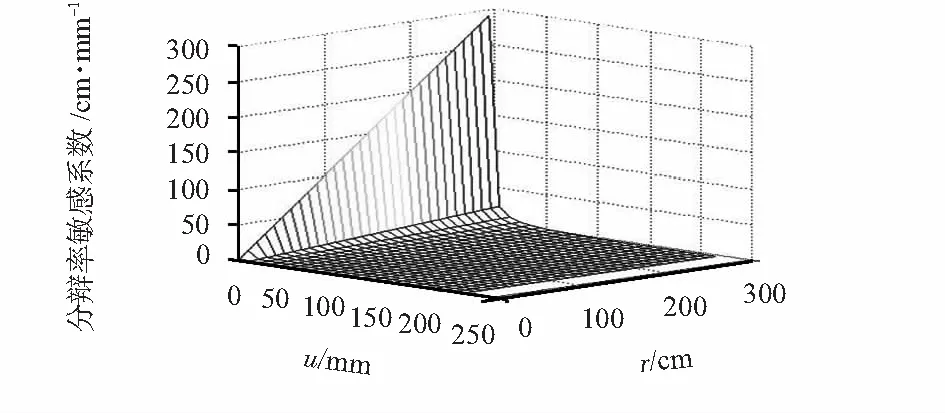

式中φu为测量误差对像素距离的敏感系数。图8为φu与r和u的关系曲线,当估算距离越大,像素距离越小时,φu越大。由于像素距离u的值可以反映图像的分辨率,因此,当估算距离r不变时,图像分辨率越高,φu越小,即像素误差对距离测量误差的影响越小。

图8 φu关系曲线Fig 8 φu relationship curve

4结论

本文设计的ASODVS能够实时、快速、准确地计算场景的空间三维坐标,并同时得到点云对应的颜色信息。通过上述精度分析可知,从以下三个方面改进ASODVS可以提高三维测量的精度:

1)提高h的精度:系统通过估算电机的运动速度和运动时间来得到h值,如果采用位移传感器直接实时获取激光光源的移动距离,可以进一步提高三维测量精度。

2)增大图像分辨率:增大图像分辨率可以从硬件和软件两方面进行改进。在硬件方面,本文的ODVS分辨率为1280像素×720像素,可以采用更高分辨率的成像芯片。在软件实现方面,可以通过对图像进行超分辨率重构的方式提高分辨率。

参考文献:

[1]Qingguo T,Yujie Y,Xiangyu Z,et al.An experimental evaluation method for the performance of a laser line scanning system with multiple sensors[J].Optics and Lasers in Engineering,2014,52:241-249.

[2]Stoyanov T,Mojtahedzadeh R,Andreasson H,et al.Comparative evaluation of range sensor accuracy for indoor mobile robotics and automated logistics applications[J].Robotics and Autonomous Systems,2013,61(10):1094-1105.

[3]Kwang-Ho B,Derek D L.A method for automated registration of unorganized point clouds[J].ISPRS Journal of Photogrammetry and Remote Sensing,2008,63:36-54.

[4]Orghidan R,Mouaddib E M,Salvi J.Omnidirectional depth computation from a single image[C]∥International Conference on Robotics and Automation,2005:1222-1227.

[5]Yi S,Suh J,Hong Y,et al.Active ranging system based on structured laser light image[C]∥SICE Annual Conference,2010:747-752.

[6]Kenki Matsui,Atsushi Yamashita.3D shape reconstruction of pipe with omnidirectional laser and omnidirectional camera[C]∥Asian Symposium for Precision Engineering and Nanotechnology,2009:1701-1706.

[7]Zhang C,Xu J,Xi N,et al.Development of an omnidirectional 3D camera for robot navigation[C]∥Advanced Intelligent Mechatro-nics, Kaohsiung:IEEE,2012:262-267.

[8]汤一平,叶永杰,朱艺华,等.智能全方位视觉传感器及其应用研究[J].传感技术学报,2007,20(6):1316-1320.

[9]徐海涛,周静恺,林璐璐,等.基于ASODVS的全景点云数据获取技术的研究[J].计算机测量与控制,2014,22(7):2284-2287.

[10] 李冬冬,王永强,许增朴,等.激光三角法在物面倾斜时的测量误差研究[J].传感器与微系统,2015,34(2):28-36.

[11] 周宗思.全方位视觉技术及其在移动机器人导航中的应用[D].杭州:浙江工业大学,2009:10-20.

Design of an active stereo omni-directional vision sensor

TANG Yi-ping, ZHOU Jing-kai, XU Hai-tao

(College of Information Engineering,Zhejiang University of Technology,Hangzhou 310023,China)

Abstract:Existing three-dimensional laser scanners cannot calculate three-dimensional information in real-time and automatically,and data registration is essential after acquisition of points cloud.In order to solve these problems,a new kind of active stereo omni-directional vision sensor(ASODVS)is developed,and factors influence ranging precision are also analyzed.Experimental results demonstrate that the proposed ASODVS system can automatically measure 3D panorama space in real-time,and corresponding points cloud datas will also be acquired.

Key words:active stereo omni-directional vision sensor(ASODVS); planar laser generator; single view point; depth measurements; 3D reconstruction

DOI:10.13873/J.1000—9787(2016)02—0109—04

收稿日期:2015—05—19

中图分类号:TP 391

文献标识码:A

文章编号:1000—9787(2016)02—0109—04

作者简介:

汤一平(1956-),男,浙江杭州人,博士,教授,研究领域为计算机视觉、全方位视觉传感器、物联网技术。