深度学习提升智能IPC准确率的一线曙光

□ 文/周宇杰

深度学习提升智能IPC准确率的一线曙光

□ 文/周宇杰

究其根本,智能IPC的核心为图像识别技术。通过各类视频智能分析技术,解决传统视频监控必须依赖人工查看视频的问题,实现有效信息的结构化数据提取,让视频监控的使用者真正告别人工安防,走进自动化安防的新时代。而现在,深度学习正带动图像识别技术的一大变革,对智能IPC而言,也许能够解决困扰其多年的难题——准确率。

图像识别,智能IPC的技术核心

图像识别的能力来源于人类,图像刺激作用于感觉器官,人们辨认出它是经验过的某一图形,甚至能感知到图像距离或者形状的改变,这一过程叫做图像再认。简单来说,就是“之前见过一只狗,再看到类似狗的目标时,能够将其认出来”的过程。在图像识别中,既要有当时进入感官的信息,也要有记忆中存储的信息,只有通过存储的信息与当前信息进行比较的加工过程,才能实现对图像的再认。

计算机的图像识别技术,则是利用计算机对图像进行处理、分析和理解,以识别各种不同模式目标和对象的技术。图像识别所研究的问题,是如何用计算机代替人类去自动处理大量的无力信息,解决人类所无法识别或者识别过于耗费资源的问题,从而很大程度上解放人类的劳动力。

图像识别技术可应用于各行各业,而对于安防行业而言,它的意义是显而易见的。随着国家对平安城市建设力度的加大,监控覆盖面、密度越来越大,这在提升城市整体防控能力的同时,也给公安工作人员带来了巨大的负担——单独一个高清视频监控点每天约产生40G的视频图像数据,一个城市的监控体量达到万级也不少见,要全部看完这些监控视频,并提取、保存其中的重点线索,工作量可想而知。利用计算机图像识别技术,就能对这些视频进行智能分析,提取出其中关键的图片、语义信息,并进行以图搜图、语义搜图等大数据应用,避免“99%的视频还没经过梳理采集,就被自动覆盖”的窘况。

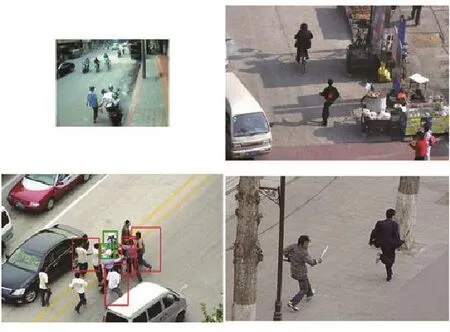

在安防领域,以图像识别技术为核心的视频智能分析主要有两种产品形态:前端智能和后端智能。而随着IPC内置运算芯片性能的不断提升,智能前端化已成为监控行业发展的大趋势,在某些前端建设的项目中,已有客户明确提出“智能IPC要占到全部建设点位数20%~40%”的要求。以科达感知型摄像机为代表,智能IPC通过将智能分析算法嵌入到前端摄像机中,前端摄像机在采集高清视频的同时,对视频内容进行实时分析,提取出画面中关键的、感兴趣的、有效的信息,形成结构化的数据,并传送给后端大数据平台做存储或深入分析。

目前,智能IPC主要能够对人、车目标进行分析,且针对不同的目标、应用场景拥有不同的类别。科达感知型摄像机分为车辆卡口、人员卡口、结构化、枪球联动4大类别:

● 车辆卡口主要针对机动车道监控,能提供车辆目标检测、车牌识别、车辆颜色识别、车型识别等功能;

● 人员卡口主要针对人形通道监控,能提供人脸检测抓拍、行人检测抓拍、行人基本属性分析(包括性别、行进方向、颜色、有无口罩等)功能;

● 结构化摄像机主要针对一般监控场景,如人车混行的道路,提供车辆/人员目标检测抓拍,结构化属性分析功能;

● 枪球联动主要针对广场类的开阔场景,枪机负责检测监控视野中的运动目标,球机在枪机的指令下对目标进行跟踪特写以及抓拍,同时分析目标的结构化属性。

这4类摄像机基本覆盖了平安城市项目中各类监控场景,通过智能前端化,实现智能视频监控的规模化部署。

准确率,智能IPC的应用难点

图像识别技术应用智能IPC的市场前景以及意义是非凡的,然而,从目前来看,大部分智能IPC在实际应用中仍受到各种各样的质疑,其中最为突出的问题就是准确率。智能IPC识别准确率根本上取决于图像识别技术所使用的算法,而在很长一段时间里,“图像识别模型”为主流方法。

图像识别模型,是人们为了编制模拟人类图像识别活动的计算机程序而提出的,模板匹配模型为其中之一。这种模型认为,识别某个图像,必须在过去的经验中有这个图像的记忆模式(又叫模板),当前的刺激如果能与大脑中的模板相匹配,这个图像也就被识别了。但这种模型强调图像必须与脑中的模板完全符合才能加以识别,有一定的局限性,为此,格式塔心理学家又据此提出了一个原型匹配模型。原型匹配模型认为,在长时记忆中存储的并不是所要识别的无数个模板,而是图像的某些“相似性”,从图像中抽象出来的“相似性”就可作为原型,拿它来检验所要识别的图像;如果能找到一个相似的原型,这个图像也就被识别了。但是,这种模型没有说明人是怎样对相似的刺激进行辨别和加工的,它也难以在计算机程序中得到实现。因此又有人提出了一个更复杂的模型,即“泛魔”识别模型……

应用图像识别模型,安防行业已有较为成熟的应用案例,如车牌识别。对车牌识别而言,在标准卡口的架设条件下,车牌识别率普遍可以达到98%以上,甚至99%。这是因为,在车牌识别的过程中,车辆通过卡口时的姿态一般是固定的,车牌的安装位置也比较固定,这为识别创造了很好的条件;同时,车牌识别只需识别几十个汉字、10个数字和26个字母,这进一步降低了识别的难度。

与车牌识别出色、稳定的准确率相比,人脸识别的准确率最难把控,而人脸识别却也是安防市场中最受关注、应用范围最广的智能模块。所谓人脸识别的“准确率”,是指基于全世界最权威的人脸数据库LFW进行比对测试的成绩。LFW由美国马萨诸塞大学阿默斯特分校管理,可以认为是一个考察深度学习系统人脸识别能力的“题库”,它从互联网上提取6000张不同朝向、表情和光照环境下的人脸照片作为考题,可以让任何系统在里面“跑分”。跑分过程如下:LFW给出一组照片,询问测试中的系统两张照片是不是同一个人,系统给出yes或no的答案。99%的准确率,意味着在测试的所有题目中,人脸识别系统答对了99%的题目。

然而问题的关键是,LFW以及类似数据库FDDB等,只是一个纯粹实验室级别、学术性质的测试工具,在样本量可能达到十万级、百万级的实际商业场景下,测试得分高的系统不一定能保持已有成绩,其误识率将直线上升,甚至可能根本没法用。部分真实复杂场景测试中,十万分之一的误识率下,98%的人脸识别准确率会直线下降到70%左右。且人脸识别系统在安防实际应用中,对安装环境、安装角度等要求较高,目前距离用户实战要求仍有一定距离。

深度学习,攻克准确率难题的曙光

现阶段比较受欢迎的图像识别基础算法为深度学习法,深度学习模型属于神经网络,而神经网络的历史可追溯至上世纪四十年代,曾经在八九十年代流行。神经网络试图通过模拟大脑认知的激励,解决各种机器学习的问题。

后来,由于种种原因,大多数学者在相当长的一段时间内放弃了神经网络,转而采用诸如支持向量机、Boosting、最近邻等分类器。这些分类器可以用具有一个或两个隐含层的神经网络模拟,因此被称作浅层机器学习模型。它们不再模拟大脑的认知机理;相反,针对不同的任务设计不同的系统,并采用不同的手工设计的特征,例如语音识别采用高斯混合模型和隐马尔可夫模型,物体识别采用SIFT特征,人脸识别采用LBP特征,行人检测采用HOG特征。

深度学习在计算机视觉领域最具影响力的突破发生在2012年,Hinton的研究小组采用深度学习赢得了ImageNet图像分类的比赛。ImageNet是当今计算机视觉领域最具影响力的比赛之一,它的训练和测试样本都来自于互联网图片,训练样本超过百万,任务是将测试样本分成1000类。自2009年,包括工业界在内的很多计算机视觉小组都参加了每年一度的比赛,各个小组的方法逐渐趋同;2012年,排名2到4位的小组都采用的传统模拟识别方法,他们准确率的差别不超过1%,而首次参赛的Hiton研究小组采用的是深度学习的方法,且准确率超出第二名10%以上。这个结果在计算机视觉领域产生了极大的震动,掀起了深度学习的热潮。

与传统模式识别相比,深度学习最大的不同在于它是从大数据中自动学习特征,而非采用手工设计的特征模型。在过去几十年模式识别的各种应用中,手工设计的特征处于统治地位,它主要依靠设计者的经验知识,很难利用大数据的优势;由于依赖手工调整参数,特征的设计中只允许出现少量参数。深度学习的优势则显而易见——大数据中可以包含成千上万的参数,用来训练深度学习的数据越多,深度学习算法的鲁棒性、泛化能力就越强。

目前,深度学习算法的数据普遍都是几十万、上百万级,像一些互联网行业的IT巨头们,他们的训练数据会是上千万、甚至上亿级别,这也是国外如Google、FaceBook、Microsoft等,国内如百度、腾讯等IT巨头在深度学习算法的应用效果上有着一定优势的原因。但IT企业与安防企业所用的训练数据不同:IT巨头拥有的是互联网,安防企业拥有的则是安防大数据。二者图像识别技术的关注点也有不同,IT巨头的人脸识别技术是服务于他们的商业目标,比如图像检索、身份认证、无人驾驶等,而安防企业主要关注的是人脸识别技术在公共安全领域的应用。

经过庞大数据量的训练后,深度学习不断积累多种场景下的样本数据,可逐步提升图像识别的准确率。在车辆分析方面,原先车辆卡口摄像机只能做到车辆检测、车牌检测、车型分析等功能,依托深度学习,除了可以提升原有的智能算法的准确性,还可以扩展更多的智能分析领域,例如车辆子型号、年款的分析、车内司乘人员的检测、安全带检测、打电话检测等;对于最难的人脸检测,深度学习基于海量的经验积累,可明显改善复杂场景下人脸识别技术的准确率。

理论上讲,深度学习可以取代现有的很多传统特征提取、目标检测技术,在大幅提升图像识别准确率上已有成功案例,我们有理由期待深度学习让人脸识别等复杂的识别技术落地于实际项目应用中。

作者单位:苏州科达科技股份有限公司