农业机器人田间导航参照点测距的新方法

朱弘亮,马兆敏,胡 波,贾海斌

(广西科技大学 电气与信息工程学院,广西 柳州 545006)

农业机器人田间导航参照点测距的新方法

朱弘亮,马兆敏,胡波,贾海斌

(广西科技大学 电气与信息工程学院,广西 柳州545006)

摘要:传统双目视差测距法的测量值为参照点P到双目摄像机基线中心的距离,而农业机器人上的摄像头装置通常被安装在距离地面一定高度,与水平方向呈一定倾角的位置,利用传统双目视差测距法将无法得到导航参照点到机器人机身的水平距离。为此,提出了一种解决农业机器人田间导航参照点测距的新方法。通过改进的BP神经网络标定下的双目系统、改进的SIFT特征匹配,输出导航参照点在世界坐标系下的坐标X,Y),则导航参照点距机器人机身的水平距离可表达为。实验表明:该方法在实际田间测试中的结果最大偏差0.479cm,最小偏差0.032cm,精度高达99%,测距过程耗时共计55ms,计算量较传统双目视差测距显著减小,具有一定的工程实用性与可行性。

关键词:农业机器人;导航参照点;双目视差;SIFT

0引言

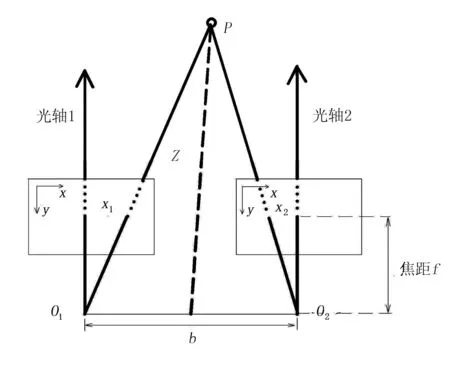

基于视觉传感器的距离检测方法中最常用的方法是平行双目立体视觉方法,其中心思想是利用双目视差的原理[1]:由同一点在左右摄像机的成像平面中不同的成像位置构建双目视差,根据几何学中三角形两两相似的方法(见图1),利用已知的左右相机基线距离b、相机焦距f、同一参照点P在左、右摄相机成像面上对应的横坐标x1和x2,计算出参照点P到双目相机基线中心的距离为

(1)

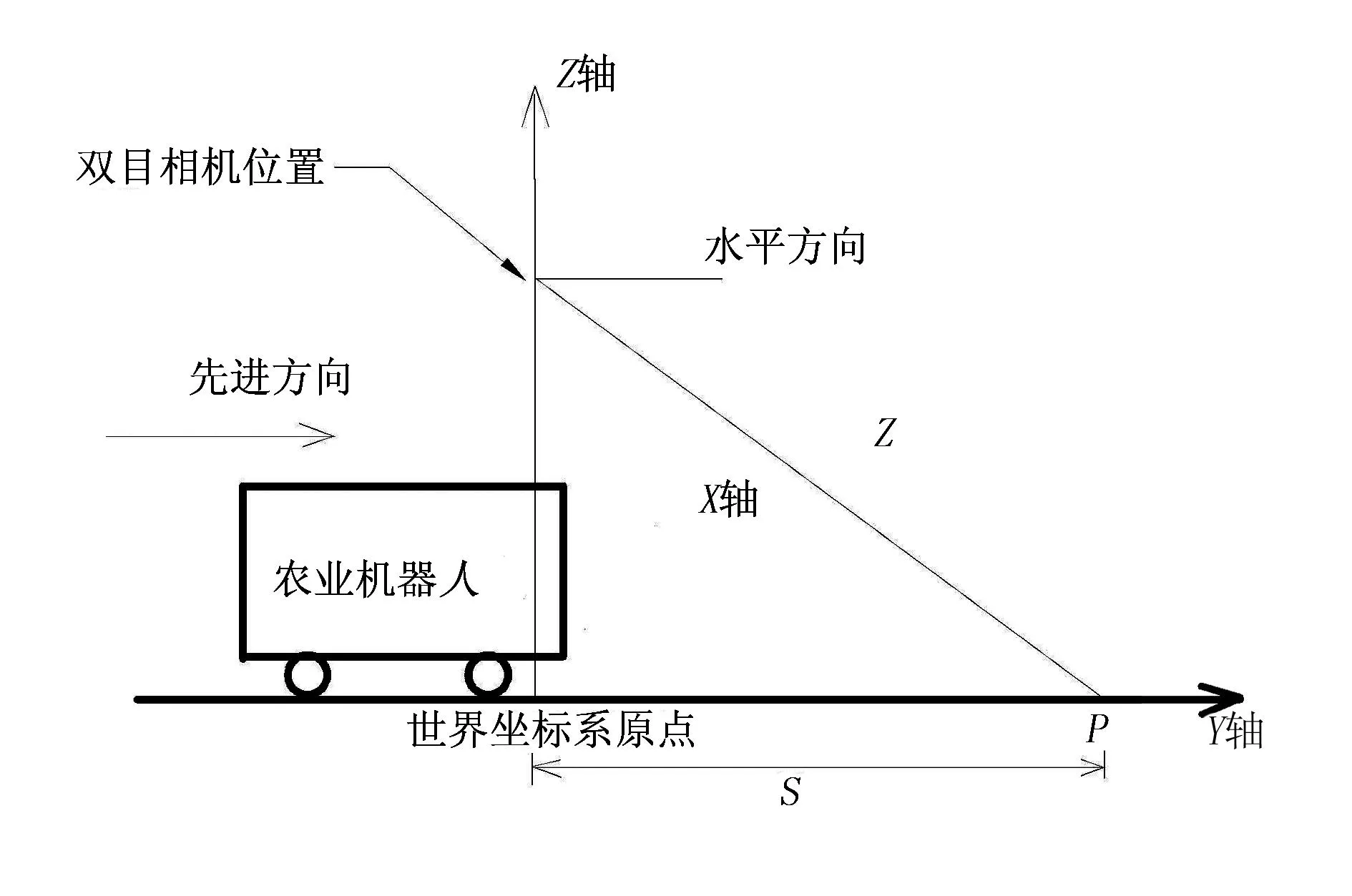

但是,农业机器人由于田间作业的要求,需要实时捕获田间地面上作物的图像与前方行进方向上的路径信息,如农药喷洒机器人、除草机器人及自动插秧机器人[2],因此其视觉传感器设备往往安装在距离地面一定高度,与水平方向成一定俯角的位置,如图2所示。

此时,如果再利用传统的平行双目视差测距法得到的将是图2中的距离Z,而研究人员往往更感兴趣的是参照点P与机器人本体的水平距离S,它对农业机器人田间作业时位置与姿态的控制起到关键作用。

针对上述问题,本文提出了一种农业机器人田间导航参照点测距的新方法。实验表明:本文方法在解决农业机器人田间地面导航点测距问题方面是行之有效的。

图1 平行双目视差测距法原理

图2 农业机器人作业模型

1农业机器人双目系统的建立与标定

1.1 双目系统的建立

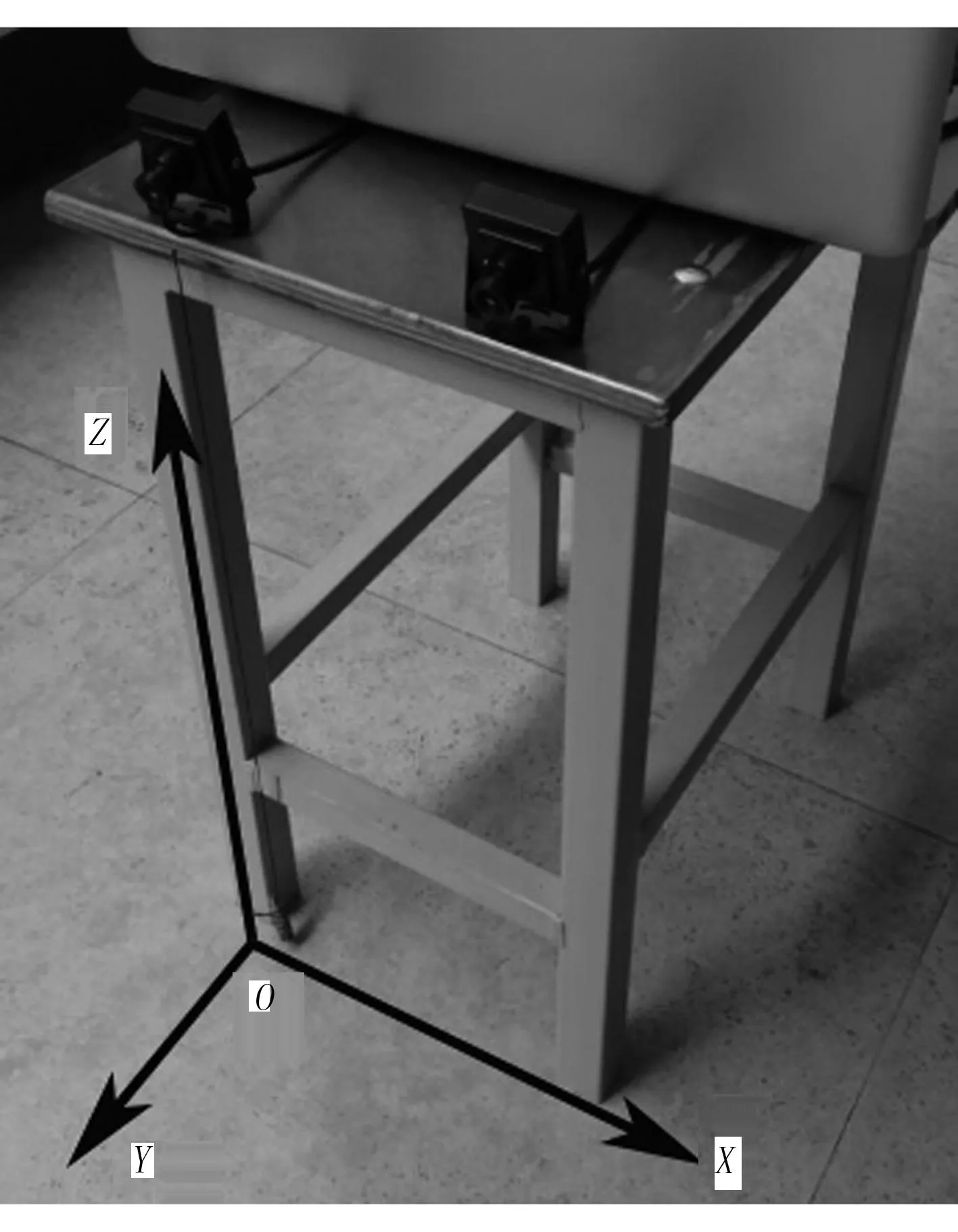

本文以方凳模拟农业机器人本体,左右相机安装高度47.5cm,左右相机与水平方向倾角为35.7°,基线距离18cm,工控机CPU 2.5GHz,内存8G;同时以左相机为中心向下做一条铅垂线,铅垂线与地面的交点定为世界坐标系的原点O,X轴沿农业机器人机身水平向左,Y轴沿相机的光轴方向垂直于X轴,Z轴垂直与地面向上,如图3所示。

图3 本文所搭建的农业机器人双目系统

由于本文所选取的导航参照点均在田间地面上,故令Z平面始终等于0,即无论农业机器人行进至何处,世界坐标系都以此方法建立,从而获得导航参照点相对于农业机器人机身的世界坐标。

1.2 BP神经网络标定

农业机器人的作业环境通常处于非结构化环境的农田中,地面的凹凸不平导致机器人在行进过程中机身水平面与地面产生不同的角度。这时,如果利用传统相机线性标定算法获得的相机内外参数进行计算,其结果:一是计算量会非常巨大,影响农业机器人田间作业的时效性;二是由于镜头光学系统加工误差的存在,往往得不到非常精确的结果。根据多层神经网络映射定理可知:包含隐含层的3层神经网络结构可对任意的非线性函数进行任意精度的逼近。故本文选用包含输入层、隐含层、输出层的BP神经网络对双目系统标定。但由于原始BP算法是梯度下降法,其中心思想是将迭代优化搜索的方向指向性能函数的下降方向,这就会产生一个问题,即BP网络的训练速率较慢且陷入区域最小值的几率增大。为此,本文利用基于Fletcher-Revees共轭梯度法的BP学习算法构建BP神经网络:

1)令k=0,i=0,设学习速率的最大值C>0和优化目的值ε>0,随机产生一个初始权值序列w(0);

3)选择搜索方向d(0),d(0)=-g(0);

5)调节BP网络参数w(i+1)=w(i)+ηid(i);

6)置k=k+1,i=i+1;

7)若E(w(i))<ε,算法终止;

g(i)=▽E[w(i)];

10)计算d(i)。若i

1.3 标定实验

将一张1 100mm×870mm标定纸平铺在1.1中搭建好的双目系统的正前方,左右相机分别拍摄标定纸,如图4所示。

图4 本文双目系统下标定实验

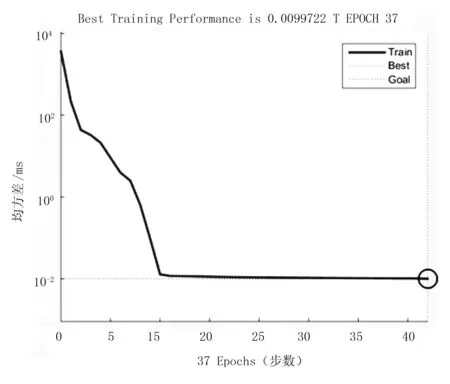

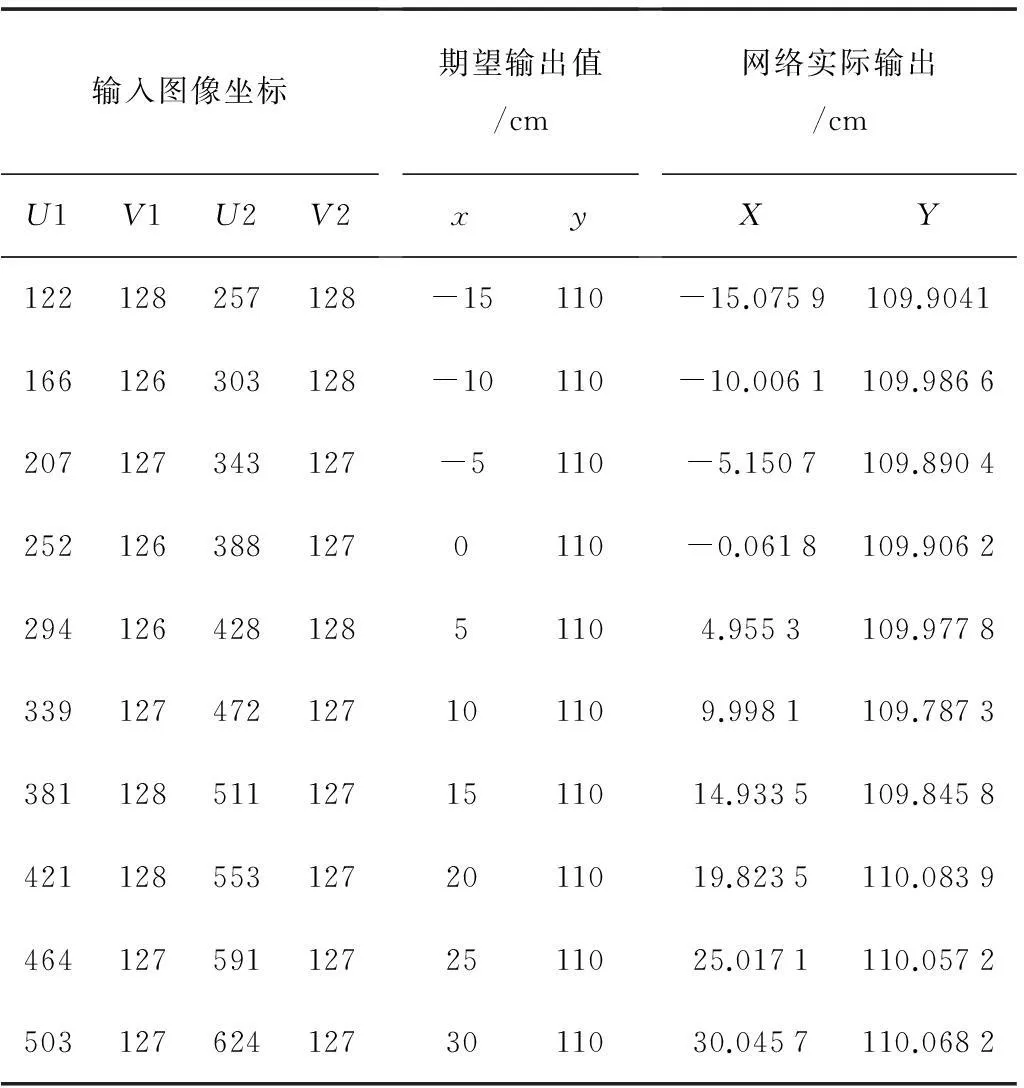

利用Harris角点检测分别获取公共视场内的X角点,即标定点的图像坐标(U1,V1)(U2,V2),并依次测量各标定点在1.1节中双目系统下构建的世界坐标系中的坐标(X,Y),将(U1,V1)(U2,V2)作为输入,(X,Y)作为输出构建BP神经网络。此次共标定200个点,取其中150个点作为训练样本,50个点作为测试样本,保存训练好的神经网络。实验结果显示:改进的BP神经网络仅用37步收敛,MSE均方误差0.009 97,耗时20ms。BP网络训练效果图如图5所示,标定结果如表1所示。

图5 改进的BP神经网络训练效果

输入图像坐标U1V1U2V2期望输出值/cmxy网络实际输出/cmXY122128257128-15110-15.0759109.9041166126303128-10110-10.0061109.9866207127343127-5110-5.1507109.89042521263881270110-0.0618109.906229412642812851104.9553109.9778339127472127101109.9981109.78733811285111271511014.9335109.84584211285531272011019.8235110.08394641275911272511025.0171110.05725031276241273011030.0457110.0682

2田间导航参考点的获取与测距

农业机器人在田间作业行走时通常会选取一些前方行进路面上已存在的实物作为导航参照点,以该参照点为基准计算机身与此点的距离和航向角,为进一步行进姿态控制做准备;又因为土壤的颜色与作物根部的颜色有较大的区分,故本文选取作物的根部作为农业机器人导航参照点。而SIFT方法中的低层次特征提取是选取那些显著的特征,这些特征具有图像尺寸和旋转不变性,而且对光照变化具有一定程度的不变性,还可以减少由遮挡、杂乱和噪声所引起的低提取概率[3]。该方法特别适用于农业机器人田间作业环境;但在SIFT方法中,特征点描述符生成这一步中往往需要耗费大量的时间,原因在于128维的特征点描述算子的生成使算法效率大大降低。考虑到农业机器人田间作业时效性的问题,提出稳、快、准的要求。本文从降低描述算子维数的思路出发,将原始算法中特征点描述向量的维数由128减至16,以特征点为圆心,提取一个半径从1~4m的同心圆圈区域,如图6所示。

图6 本文所利用的改进的SIFT特征描述符

先计算每个圆圈内各个像素梯度的模值和方向,然后用梯度直方图统计方法在每个圆圈内统计出4个方向(0°,90°,180°,270°)的梯度累加值;利用图形高斯加权窗口进行加权,对每个圆圈内的梯度累加值大小依次从大到小排列,最终生成1×16维向量作为特征点的描述向量。

3实验与结果分析

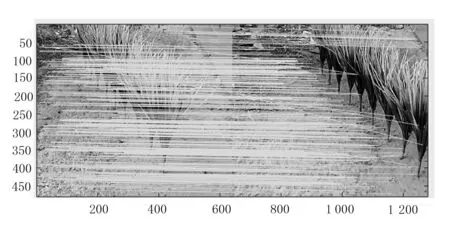

本实验与2015年6月9日下午对广西科技大学内一处农田取景,将1.2节中标定完成的农业机器人双目系统整体移入田间;在不同的两处位置A和B用左右相机采集作物图像,选取每株作物的根部位农业机器人的导航参照点;分别测量农业机器人在不同位置时每株作物的根部到左相机铅垂线与地面交点的直线距离。图7为原始SIFT匹配下的作物图像匹配。

图7 原始SIFT算法下的作物匹配图像

图8为本文所利用的改变SIFT特征描述符向量维数方法下的作物图像匹配。由图8可知:该方法大大减少了无用匹配点的数量,耗时仅为35ms。表2为农业机器人处于位置A时导航参照点的测距结果,表3为农业机器人处于位置B时导航参照点的测距结果。表2、表3共计16组数据,从中得出利用本文测距方法的测量距离与实际距离最大误差0.479cm,最小误差0.032cm,平均误差为0.14cm。

图8 改进的SIFT特征描述符算法下的图像匹配

Table 2Results of ranging in positionAcm

神经网络输出世界坐标XY本文方法所测距离实际距离误差19.22556.32660.032600.03221.12561.24765.122650.12223.44566.76570.113700.11327.45369.06375.166750.16629.92175.56480.041800.04134.75778.39485.189850.18939.22382.82290.112900.11241.99786.31395.179950.179

表3 机器人处于位置B时导航参照点的测距结果

4结论

提出了一种基于双目系统的农业机器人地面导航参照点测距的新方法,该方法适用于任何角度与高度下的摄像机安装位置。利用改进的BP神经网络对农业机器人双目摄像机进行标定,然后由改进的SIFT特征匹配得出参考点的左右图像坐标并输入标定时保存的受训完成的BP神经网络,从而输出导航参照点相对于农业机器人机身的世界坐标,最终获得参照点与农业机器人机身之间的水平直线距离。实验结果表明:在一定视野范围内,田间导航参照点测距总耗时55ms,精度高达99%,能够满足农业机器人在大多数情况下的作业要求。

参考文献:

[1]张方明,应义斌.机器视觉在农业车辆导航系统中的研究进展[J].农业机械学报,2005,36(5):133-136.

[2]李建平,林妙玲. 自动导航技术在农业工程中的应用研究进展[J].农业工程学报,2006,22(9):232-236.

[3]张磊,王书茂,陈兵旗,等.基于双目视觉的农田障碍物检测[J].中国农业大学学报,2007,12(4):70-74.

[4]苏丽颖,李小鹏,么双立.双目摄像机快速标定新方法[J].中南大学学报,2013,44(12):364-367.

[5]刘源泂,孔建益,王兴东,等.双目立体视觉系统的非线性摄像机标定技术[J].计算机应用研究,2011,28(9):3398-3400.

[6]刘盼,王金海.基于平行双目立体视觉的测距系统[J].计算机应用,2012,32(S2):162-164.

[7]崔莉娟,朱洪俊,王明盛,等.双目立体摄影测量中的标定方法[J].机械,2010,37(12):24-27.

[8]Widodo Budihorto, Ari Santoso, Djoko Purwanto, et al. A navigation system for service robot using stereo vision and kalman filting[C]//2011th International Conference on Control System.Tokyo:Jason,2011:165-172.

Abstract ID:1003-188X(2016)08-0068-EA

A New Method of Distance Measurement for Agricultural Robot’s Field Navigation Reference Point

Zhu Hongliang, Ma Zhaomin, Hu Bo, Jia Haibin

(Department of Electronic Information and Control Engineering, Guangxi University of Science and Technology,Liuzhou 545006, China)

Abstract:The distance measured by the classical binocular parallax value is the one from the reference point P to the center of the binocular cameras baseline .But the binocular cameras on the agricultural robot are usually settled in the position that is some height from the earth and a certain angle to the horizontal. A new way to solve the measuring the distance between agricultural robot and the navigation reference point is proposed in this paper. By using the improved BP neural network and the improved SIFT to export the world coordinates (X,Y).The horizontal distance between the agricultural robot and the reference P can be expressed .Experiments show the maximum deviation is 0.479cm, the minimum deviation is 0.032cm.The amount of the whole calculation is much less than the classical measuring method which is helpful to the research of agricultural robot’s positioning control in the farm field.

Key words:agricultural robot; navigation reference; binocular disparity; SIFT

中图分类号:S127;TP391.76

文献标识码:A

文章编号:1003-188X(2016)08-0068-04

作者简介:朱弘亮(1990-),男,安徽马鞍山人,硕士研究生,(E-mail)zhuhongliang0225@126.com。通讯作者:马兆敏(1975-),女,安徽亳州人,副教授,(E-mail)254494046@qq.com。

基金项目:广西教育厅高校科研基金项目(LX2014199)

收稿日期:2015-07-09