基于多特征融合的烟雾检测

吴冬梅, 李白萍, 沈 燕, 王 静, 何 蓉

(1. 西安科技大学通信学院,陕西 西安 710054;2. 江苏省环境监测中心,江苏 南京 210004)

基于多特征融合的烟雾检测

吴冬梅1, 李白萍1, 沈 燕2, 王 静1, 何 蓉1

(1. 西安科技大学通信学院,陕西 西安 710054;2. 江苏省环境监测中心,江苏 南京 210004)

针对传统火灾探测技术的应用弱点,研究基于视频的火灾烟雾探测方法。首先,根据烟雾的颜色特征,提取视频序列中的疑烟区域。然后,在疑烟区域中提取烟雾的3个动态特征——扩散特征、轮廓不规则特征和使背景模糊特征。最后,利用BP神经网络对这些动态特征进行融合判定。实验结果表明,基于多特征融合的烟雾检测方法能够准确、实时、有效地识别视频中的烟雾。

烟雾;颜色特征;动态特征;BP神经网络

由于传统的基于传感器的火灾探测系统在一些大型室内空间或通风场所会容易失效,研究一种基于计算机视觉和视频图像处理的新型火灾探测方法[1]具有重要意义。通常情况下,“烟为火始”,若能在视频中及时地检测到烟雾则可提供更早的火灾预警。利用视频图像处理技术监测场景中的烟雾具有以下优点:①不受距离空间环境限制;②响应速度快;③探测直观主动,保护面积大。而且在各式建筑物中,视频监控系统已大量使用,利用视频来探测火灾的技术将得以推广。

目前,国内外已经提出了 3种视频烟雾的探测算法:①基于颜色特征的烟雾检测[2],利用统计像素点的信息对比确定烟雾出现的可能性。②基于变换域视频烟雾分析技术[3],进行小波变换后,再利用连续帧之间的动态变化差别识别烟雾区域。③基于累计运动方向模型的烟雾检测[4],运用

烟雾出现的趋向性对烟雾区域进行判断。以上方法对烟雾的检测能够起到一定的效果,但检测的准确性有待提高。本文针对现有方法准确性不高且适应性不强等问题,提出了将烟雾的静态特征和动态特征相结合,利用BP神经网络对这些特征进行融合判定,提高了烟雾检测的准确率,多特征的融合也使适应性有了较大提高。

1 视频烟雾检测算法架构

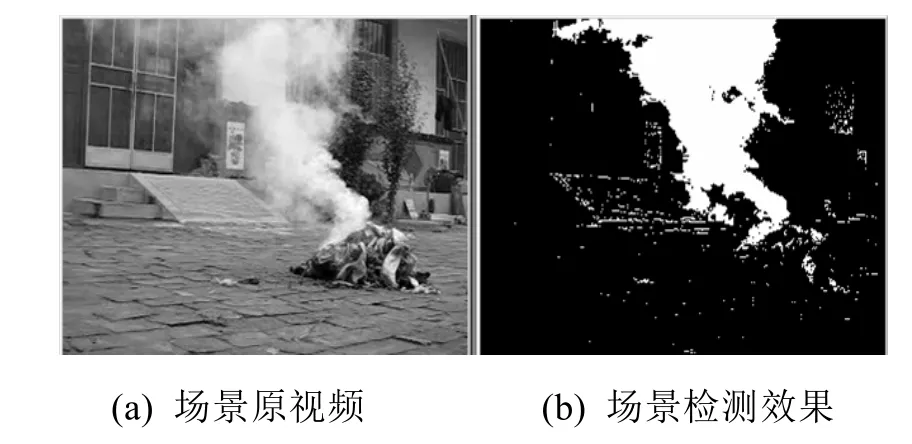

视频中的烟雾为运动目标,且烟雾具有独特的静态及动态特征。首先,利用混合高斯背景建模的方法提取视频序列中的运动目标,并对其进行颜色分析和判断,找到疑烟区域。然后,进一步在疑烟区域内分析和提取烟雾区别于其他运动物体的独特的动态特征,即扩散特征、轮廓不规则特征和使背景模糊特征。最后,利用BP神经网络将提取的烟雾动态特征融合,最终综合判断。其软件算法流程如图1所示。

图1 视频烟雾检测算法流程

2 基于RGB空间的疑烟区域检测

在RGB彩色模型中,强度最高的红、绿、蓝组合产生白色,而等值的红、绿、蓝相加可产生自然的灰色,较低值时产生深灰色,而高值时则产生浅灰色。为了利用颜色特征区分烟雾和其他运动物体,首先要分析烟雾颜色信息数据。经研究发现,对大部分燃烧材料,当温度较低时,烟雾的颜色从青白色过渡到白色;随着温度的升高,直至燃烧,烟雾颜色逐渐加深,从灰白色过渡到灰黑色。

图2给出了典型的烟雾图像颜色在RGB三维空间中的分布情况,其中三维坐标分别代表R、G、B三个分量。经过一些典型烟雾颜色的数据分析,可发现烟雾的颜色基本上是分布在一条较为紧凑的窄带中。即颜色分布在立方体的对角线上,其R、G、B三个分量值基本上相等。Chen等[5]基于此原理提出了一种烟雾颜色检测的方法。

图2 烟雾颜色在RGB三维空间中的分布

本文算法中烟雾颜色检测模型是在文献[5]的研究基础上提出的,以下几个准则可判断是否有类似烟雾颜色的区域存在,从而去除一些明显的非烟区域。具体算法分析如下:

图3 某场景的烟雾颜色检测效果图

3 动态特征的提取

烟雾的视觉特征除了包含颜色、运动这些基本特征外,还有其特有的动态特征,而提取并分析烟雾的这些动态特征可进一步排除具有相似颜色的非烟物体。需重点分析烟雾扩散时面积的增加、轮廓的不规则和背景变模糊这3个动态特性。

3.1 烟雾扩散的面积增长特征

视频中若出现了疑似烟雾区域,则将第 ti时刻烟雾疑似区域的面积记为 Ai,第 ti+k时刻的烟雾疑似区域的面积记为 Ai+k,则 Ai+k- Ai表示 ti+k时刻相对于第 ti时刻烟雾疑似区域面积发生的变化。从第 ti时刻到第 ti+k时刻烟雾疑似区域面积增长率[6]定义为:

为便于计算机程序实现,将式(4)中烟雾区域的面积用提取的像素数量来表示,而时间差用一段时间内间隔的帧的数目表示。则上式可转化为:

式(5)中 Pi表示第 ti时刻图像的烟雾疑似区域的总的像素数, Pi+k为第 ti+k时刻烟雾疑似区域的像素数,则dP是像素数量的变化。(i + k) -i即k表示两帧图像之间相隔的帧数, ΔAdi是从第i到 i+k帧之间的烟雾疑似区域的像素数目的变化率,描述了从第i帧到 i+k帧这段时间的烟雾区域的面积变化情况。归一化面积增长率的数值,通过计算烟雾的绝对面积增长率,作为BP神经网络的输入,其表达式用像素数表示则为:

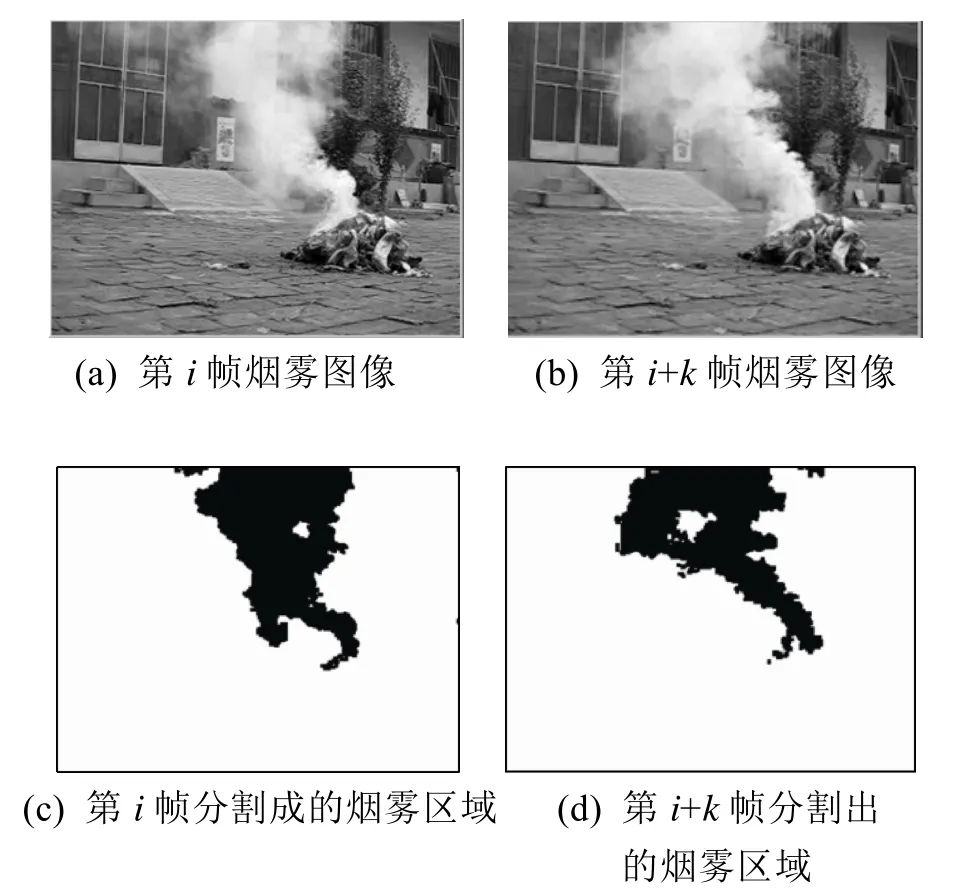

图 4(a)~(d)分别为一段含烟雾的视频的第i帧和第 i+k帧的烟雾原始视频图像和提取的面积,经计算,各自的连通区域的像素个数分别为 66 753个和69 101个。

图4 烟雾面积增长特征提取

3.2 烟雾轮廓不规则特征

火灾发生初期,烟雾会不停地从发烟点开始无规则地向周围扩散,其扩散不同于其他运动物体,烟雾在运动过程中的边缘轮廓始终呈现不规则状态[7-8]。通过提取并计算烟雾疑似区域的边缘长度与面积之比,实现对烟雾轮廓的形状在扩散过程中的不规则性这一特征的判断,判别公式如下:

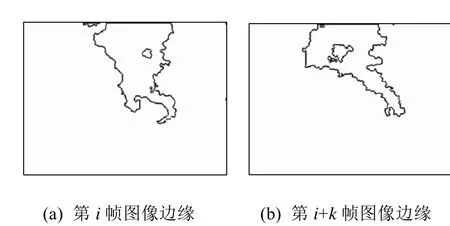

式中,SEP表示被提取出来的烟雾区域的周长,通过计算边缘像素总数来表示,STP表示被提取出来的烟雾疑似区域的面积,用包含的连通区域的像素总数描述。以图 4的烟雾区域的两帧图像为例,进行边缘提取后如图5所示。

图5 烟雾边缘不规则性

图 5(a)为第i帧图像的轮廓,边缘像素数为1 863个,图 5(b)为 i+k帧图像的边缘,像素总数为2 714个。用该特征判据作为BP神经网络的第

二个输入特征。

3.3 背景模糊特征

随着燃烧继续,烟雾的浓度不断提高,透明度则会降低;烟雾图像具有半透明的特征,其他非烟雾图像多将背景区域完全覆盖,透过运动区域不能直接看到背景的纹理,而烟雾在未完全覆盖整个场景之前,会使图像的边缘变平滑,导致图像的边缘和细节信息减少,与之对应的高频分量减少[9]。用小波变换的方法来分析烟雾区域的模糊性。

一幅视频序列图像经二维离散小波变换后,被分解成4幅子图像:1幅是低频分量子图像,3幅高频分量子图像分别包含了原始图像在水平方向(HL)、竖直方向(LH)和对角方向(HH)的纹理信息,如图6所示。

图6 烟雾图像的二维离散小波变换

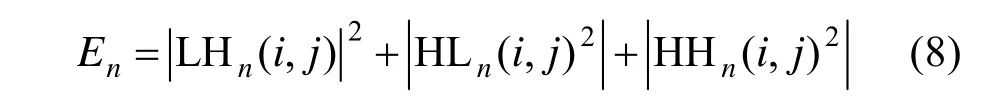

随着烟雾的出现以及逐渐蔓延,覆盖并占据大幅图像空间后,HL、LH、HH图像的细节信息是会逐渐减少的。假设 En表示包含了视频序列的第n帧采集图像中所有高频图像的高频能量,高频能量的公式表示如下:

则用 en表示第n帧烟雾疑似区域图像的高频能量、 ebn表示烟雾疑似区域对应背景图像经二次小波变换后的高频能量, en和 ebn由式(8)的方法得到。▽ en表示第n帧疑似区域的图像所对应的背景图像的高频能量减少的特性,即烟雾出现使图像变模糊的特征:

当视频中出现烟雾时,通常会使 3幅高频分量子图像HL、LH、HH的总能量值减少。大量试验得出其他物体的高频衰减一般远小于0.1,而有烟雾出现时 ▽en的值大约为 0.2~0.8,将这一判据作为BP神经网络的第3个输入特征。

4 融合烟雾动态特征的神经网络检测

根据烟雾检测的实际需要设计一个BP神经网络,选取烟雾的 3个动态特征作为神经网络的输入,输出为一个状态信息。BP神经网络的输入:①IN1:扩散性特征;②IN2:形状不规则特征;③IN3:背景模糊特征。输出只有一个,输出层用Sigmoid激发函数,使输出值限定在0~1之间,用Out表示,判断结果划分为:为火灾烟雾状态;为无烟正常状态。

BP算法的基本思想是采用最速下降法(梯度法),使网络输出值与实际的期望输出值间的误差平方和最小[10-11]。本文中网络用于训练的图像需要人为地给出输出结果,如果图像含有烟雾,输出为1,对于没有烟雾图像,则输出为0。

选取在各种动态环境下拍摄的早期火灾烟雾及含干扰现象的视频序列来作为网络的学习样本,视频部分为自己拍摄,也有在互联网站上下载得到的,其中含烟雾的视频18个、同时含烟雾和火焰的视频有3个、公路车流视频2个、行人视频 2个、每个视频提取两组数据,总共得到输入数据50组,然后对该BP神经网络进行了训练,步长为0.01,训练的次数10 000次。

5 实验结果分析

由于目前的烟雾视频没有统一的视频测试标准库,本实验的测试视频来源于网络和个人实验拍摄,选取的视频为各种场景下的烟雾视频和非烟雾视频。利用已经训练好的BP神经网络对训练样本之外的20个火灾烟雾视频和干扰视频进行测试,提取数据40组,部分测试数据如表1所示。其中,序号7和序号9视频为非含烟视频,其余组中都含有烟雾,由实际输出结果可以看出,含烟视频均为大于0.7小于1的输出数值,而非含烟视频的输出也是远小于0.7,说明已训练好的BP神经网络来检测烟雾具有较好的准确性和可靠性。

为了更直观地说明本文基于视频的烟雾检测算法的整体准确有效性,将某个典型的测试视频序列的检测效果进行帧提取并分析如下:该段视频总共有2 345帧,帧大小是320×240,帧率25 fps。

视频在开始时没有烟雾,第75帧时有人出现并在290帧的时候放出烟雾,在本段视频中有两个人在烟雾周围行走,远处有公交车驶过,并且该视频中的行人所穿衣服的颜色和汽车的颜色都与烟雾颜色极为相近,这个过程中程序未对运动车辆和具有类似颜色的运动行人出现误判情况。算法能够准确并及时标注出烟雾,如图7。

表1 部分测试样本数据

图7 典型视频的检测效果

图8 测试视频

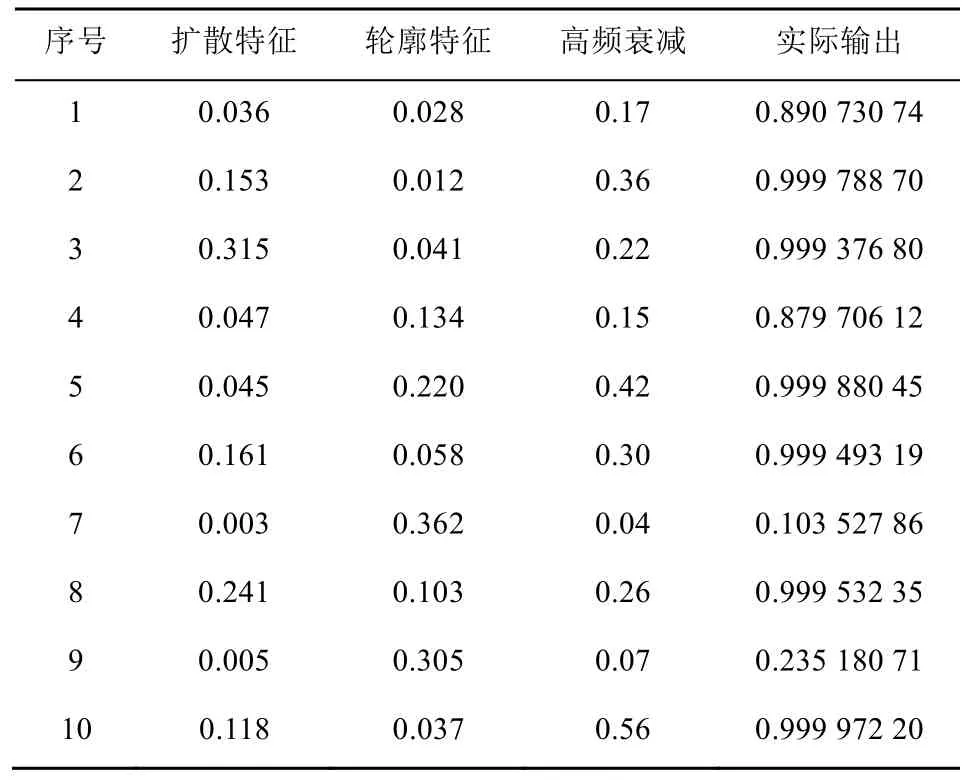

由于视频烟雾检测尚无标准测试库,已发表的文献大多采用自拍的视频烟雾进行测试,无法进行全面的定量比较。本文根据背景场景的不同、镜头远近的不同,同时烟雾的浓度和其他干扰都不同,对 5个视频进行检测,以检验算法的准确性和环境适应性。图8是测试视频的截图。

表2给出了烟雾帧检测结果。帧平均准确率S依据式(10)计算。

其中,S代表视频总帧数,F代表误检帧数,M代表漏检帧数,n代表测试视频数。计算得出此算法每帧的平均准确率在87%左右。

在以上实验数据中,视频播放速率为 25帧/秒,用25帧/秒作为观测长度,若是出现单一的报警信号,则认为此视频中的运动目标为非烟雾,对误检目标进行有效剔除,可避免将不存在非烟视频检测为烟雾视频的情况。即对带有烟雾视频能够测出目标,而对于非烟视频做到不发生误报。若以 4 s为检测时间要求(从出现烟雾到发出报警信号),对测试视频的烟雾检测准确率可达到99%。表明本算法具有较好的准确性、较强的实时性,环境适应性也较好。

表2 烟雾帧检测结果

6 结 束 语

本文根据烟雾的颜色特征,提取了视频中的疑烟区域,进而在疑烟区域中提取烟雾区别于其他物体所特有的3个动态特征,利用BP神经网络对这些动态特征进行融合判定。经大量的实验测试表明,融合多特征的烟雾检测方法,只对极个别的视频(发生源太远且持续时间较短)出现漏判,而对大部分的视频,程序都能在 4 s内(帧率为25 fps)做出正确的判断,具备较好的实时性、准确性和抗干扰能力,并且对硬件资源占用少。

[1] 薄立矗. 图像型火灾探测技术及发展前景展望[J]. 武警学院学报, 2010, 26(8): 14-16.

[2] Maruta H, Nakamura A, Yamamichi T, et al. Image based smoke detection with local hurst exponent [C]// Proceedings of 2010 IEEE 17th International Conference on Image Processing. Hong Kong, China, 2010:4653-4656.

[3] Rafiee A, Tavakoli R, Dianat R, et al. Fire and smoke detection using wavelet analysis and disorder characteristics [C]//2011 3rd International Conference on Computer Research and Development. Shanghai, China, 2011: 262-265.

[4] 袁非牛. 基于运动累积和半透明的视频烟雾探测模型[J]. 数据采集与处理, 2007, 22(4): 396-400.

[5] Chen T H, Kao Chengliang, Chang S M. An intelligent real-time fire-detection method based on video processing [C]//Proceedings of the IEEE 37th Annual (2003) International Carnahan Conference on Security Technology. Taipei, China, 2003: 104-111.

[6] Hong Wenbing, Peng Jianwen, Chen C Y. A new image-based real-time flame detection method using color analysis [C]//Proceedings of the 2005 IEEE International Conference on Networking, Sensing and Control. Tucson, Arizona, USA: IEEE Press, 2005: 100-105.

[7] Chen T H, Yin Y H, Huang Shifeng, et al. The smoke detection for early fire-alarming system base on video [C]//Proceedings of the 2006 International Conference on Intelligent Information Hiding and Multimedia Signal Processing (IIH-MSP'06). California, USA, 2006: 806-813.

[8] 文永革, 何红洲, 李海洋. 一种改进的 Roberts 和灰色关联分析的边缘检测算法[J]. 图学学报, 2014, 35(4):637-642.

[9] 闫建强. 基于DM642和图像分析的林火烟雾检测系统研究[D]. 杭州: 杭州电子科技大学, 2010.

[10] Li Zhangqing, Khananian A, Fraser R H, et al. Automatic detection of fire smoke using artificial neural networks and threshold approaches applied to AVHRR imagery [J]. IEEE Transactions on Geoscience and Remote Sensing, 2001, 39(9): 1859-1870.

[11] 李晓歌, 邵丽红, 李 娜. 人工神经网络BP算法的实现[J]. 人工智能及识别技术, 2007, 23(12): 921-923.

Smoke Detection Based on Multi-Feature Fusion

Wu Dongmei1, Li Baiping1, Shen Yan2, Wang Jing1, He Rong1

(1. Department of Communication, Xi′an University of Science and Technology, Xi′an Shaanxi 710054, China; 2. Jiangsu Envoronmental Monitoring Center, Nanjing Jiangsu 210004, China)

A new smoke detection method based on video is researched due to the weakness of the traditional fire detection technology. Firstly, according to the characteristic of the smoke color, the suspect smoke regions are extracted in video sequences. Then, looking for three dynamic characteristics of smoke in the suspected smoke area, there are three features extracted, which respectively are the growth of the area in the smoke spread, irregular contour feature of the smoke region and the background to blurred when smoke appeared. And those three dynamic characteristics are fused by a BP neural network to determine smoke or not. Test results show that the multi-feature fusion smoke detection algorithm can identify smoke in video accurately, real-time and effectively.

smoke; color feature; dynamic characteristics; BP neural network

TP 391

A

2095-302X(2015)04-0587-06

2014-12-18;定稿日期:2014-12-30

陕西省工业攻关计划资助项目(2012K06-16);国家自然科学基金-青年科学基金资助项目(61302133);西安科技大学博士启动金资助项目(2014QDJ066)

吴冬梅(1964–),女,浙江义乌人,教授,硕士。主要研究方向为图像压缩、图像识别及视频分析等。E-mail:wdm562@163.com