基于CamShift 的压缩跟踪方法

杨丰瑞,刘 亭,刘雄风

(1.重庆邮电大学,重庆400065;2.重庆重邮信科(集团)股份有限公司,重庆400065)

近年来,运动目标跟踪技术被大量应用到人们的生产和生活中,人们对目标跟踪领域的研究也在不断的深入,并取得了许多不错的成果。根据对目标外观的建模方式,可以把目标跟踪方法大致分为[1]:基于生成模型的跟踪方法与基于判别模型的跟踪方法。基于生成模型的目标跟踪算法主要是在上一帧目标位置的相邻区域进行搜索,得到最为相似的区域即为目标区域。这类算法在跟踪的同时必须在线更新外观模型,而更新环节又很容易引入误差,带来漂移等问题。

基于判别模型的目标跟踪算法是利用训练好的分类器将目标和背景分为两类,这种算法同时使用了背景和目标信息,可以有效减少目标漂移的问题。Babenko 等人[2]提出的MIL多示例学习方法有效地解决了因部分遮挡和外观变化引起的漂移问题。但是,该算法不能对长时间完全遮挡进行准确跟踪。Zhang 等人[3]提出了压缩跟踪算法。该算法简单高效且鲁棒性好。然而当外观模型不能准确描述目标时,该算法对目标的跟踪就会出现漂移等问题。针对这一问题,本文采用CamShift 和压缩跟踪算法相结合的方法,从不同角度预测目标位置,利用CamShift 的预测位置对压缩跟踪算法得到的不准确的位置进行矫正。又由于CamShift 算法是根据目标的H分量颜色特征进行位置预测的,容易受到背景中相似色的干扰,所以本文采用目标的H-S 二维概率分布直方图作为目标特征来解决背景中的相似色干扰问题。除此之外,压缩跟踪算法的跟踪框大小是由初始目标大小决定的,而在跟踪过程中目标的尺度显然是变化的。为了解决这一问题,本文利用CamShift 自适应调整窗口大小和位置的原理,对跟踪结果的窗口进行自适应调整。

1 压缩跟踪算法

压缩跟踪算法(Compressive Tracking,CT)是在压缩感知理论[4-5]基础上提出的一种快速鲁棒算法。首先根据压缩感知理论的RIP 条件,生成非常稀疏的随机矩阵,通过该矩阵对图像的Haar-Like 特征进行降维,然后把降维后的特征输入到朴素贝叶斯分类器中分类。再对每一帧进行在线学习采集正负样本更新分类器。

1.1 随机测量矩阵和特征提取

由压缩感知理论可知,一个可压缩的高维信号x∈Rm可以通过以下关系式投影到一个低维空间v∈Rn上,并且高维信号x 的信息被完整地保留在低维信号v 中,即

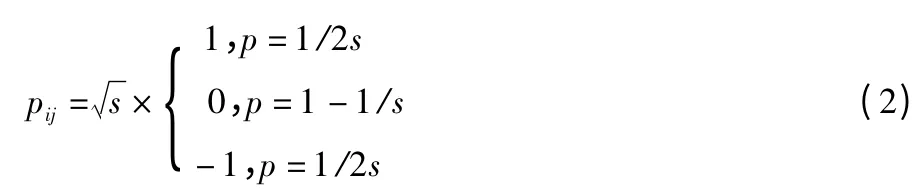

式中,P∈Rn×m是一个符合RIP 条件的稀疏矩阵,n≤m。文献[2]将随机测量矩阵P 定义为

其中,s 随机取得2 或3。提取目标降维后的特征公式[4]为

式中:N 表示特征图像块的数目,其值随机取得2 或3;R 表示在候选区域内随机选取的图像块。

1.2 分类器的构建与更新

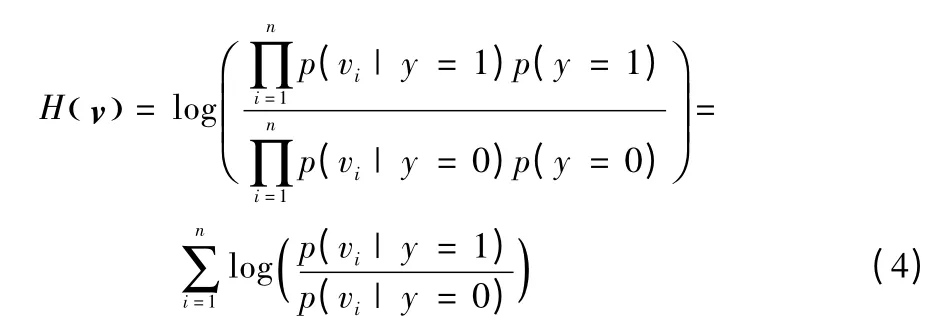

采集到的每个样本的低维特征v 中的每个元素都是由一组Haar-Like 特征线性组合而成,并且假定它们都是独立分布的,正负样本的条件概率p ( vi|y )=0 和p(vi|y=1)均服从高斯分布,利用朴素贝叶斯分类器[6]对特征进行建模。

其中,y 取1 和0,分别表示正样本和负样本。假设分类器中两个类的先验概率和特征v 中每个元素的条件概率分布如下

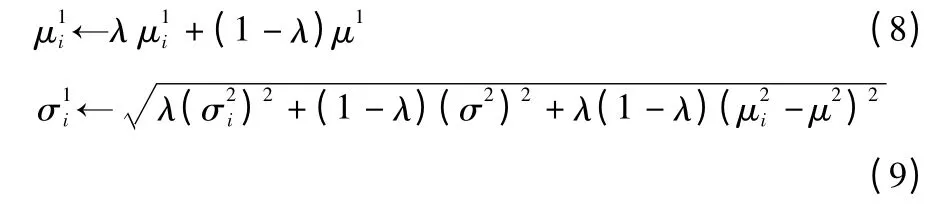

最后,通过比较每个样本在分类器中H(v)值的大小,找到H(v)最大值所对应的候选样本,则该样本即为本帧的目标位置,然后重新采集正负样本,根据样本信息对相关参数进行更新

式中,λ 为学习因子,0 <λ <1,且为常数,表示分类器的更新程度。

2 CamShift 算法

CamShift 算法是基于MeanShift 的改进算法,运行效率较高。算法的流程如下:

1)初始化跟踪窗口;

2)计算目标的反向投影图;

3)执行MeanShift 算法,不断循环计算跟踪框内图像的质心,移动跟踪框的位置使跟踪框的中心与质心重合,当移动的距离小于指定值或循环的次数足够多时,终止循环;

4)根据步骤3)得到的结果,计算出窗口的位置坐标和尺度大小,即为这一帧的跟踪结果;

5)进入下一帧,跳转至步骤2)。

3 基于CamShift 的压缩跟踪算法

3.1 算法概述

本文提出的基于CamShift 的压缩跟踪算法主要是为了解决3 个问题:

1)压缩跟踪算法一旦出现跟踪漂移,就很难再找回目标,本文利用改进的CamShift 得到的位置信息来矫正压缩跟踪算法不准确的跟踪位置,增大目标和背景的差异性,提高算法的准确性。同时CamShift 采用H-S 二维直方图的反向投影图来预测目标位置能够有效的解决相似色干扰带来的跟踪不准确的问题。

2)压缩跟踪算法在整个跟踪过程中窗口的大小一直等于初始化阶段的跟踪窗口的大小,然而在运动过程中视频序列捕捉到的目标大小却很难保持不变[7]。当运动目标尺度变大时,跟踪框外存在大量的目标信息,使得采集到的负样本中可能包含目标的特征,从而降低了目标和背景的差异性;当目标缩小或姿态变化时,跟踪框内包含许多的背景信息,影响目标的参数模型,进而导致跟踪漂移或者跟踪失败[8]。针对这一问题,本文采用CamShift 自适应调节窗口大小的原理,在得到目标中心点位置后,根据目标位置的各阶矩自适应调整窗口的大小和角度。

3)压缩跟踪算法采用固定不变的更新方式,即更新分类器的学习因子是预先设定保持不变的,这样不仅易于引入噪声和误差,而且很容易偏向新样本而遗忘之前学习的样本。另外,CamShift 算法中目标模板也是由初始帧决定的,在跟踪过程中一旦目标结构变化较大时就容易导致跟踪失败。对于模板更新问题,本文通过计算前一帧和当前帧之间的匹配程度,来更新学习参数和目标模板。

3.2 算法流程

基于CamShift 的压缩跟踪算法的大致流程如下:

输入第t 帧图像,上一帧目标位置为pt-1。

1)根据上一帧位置,利用改进的H-S CamShift 算法预测第t 帧目标的位置pt0。

2)在t-1 帧目标位置pt-1周围小于一定范围内采样N 个图像块,然后提取这些图像块的降维特征。

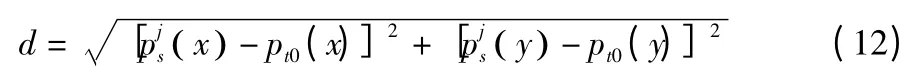

3)计算各个样本图像块与预测位置之间的距离

4)将样本权重wj和样本特征输入到分类器判别函数

找到H1(v)最大值所对应的样本即为本帧目标位置pt。

5)根据前后两帧图像的巴氏距离[9]p 判断图像的匹配程度。若p >ε,接受更新,学习因子为:λ'=λ/ρ,CamShift 的目标模板为当前帧跟踪窗口内图像;反之,若ρ≤ε,前后两帧跟踪到的图像差异较大,可能出现遮挡等情况,为了避免引入噪声,此时不更新参数和模板。

6)在目标位置周围采集正负样本,依据新的学习因子更新分类器。

7)根据目标位置图像的各阶矩调整跟踪窗口的大小,输出跟踪窗口即为目标位置。

本帧算法结束,读取下一帧。

4 实验结果及分析

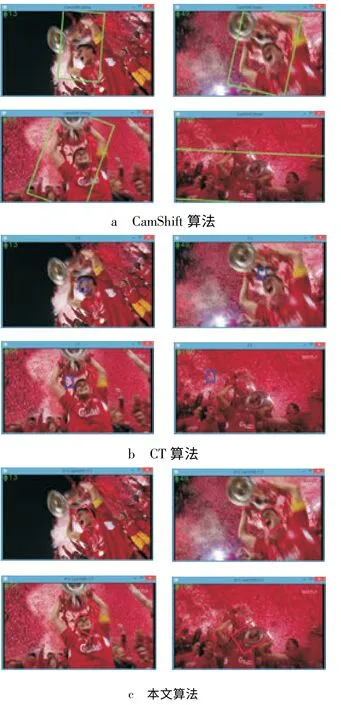

本实验在Visual Studio 2013 和OpenCV2.4.8 环境下进行。选取三组各大经典算法提供的测试视频序列:lemming,skating 和soccer 作为本实验的测试序列,这些视频序列存在着相似色干扰、目标尺度变化、姿态变化、运动模糊、目标遮挡等问题。然后将本文改进后的算法、CT 算法和CamShift 算法的跟踪结果进行比较,着重分析本文算法与压缩跟踪算法的差异。实验结果如图1,2 和3 所示。

相似色干扰:根据图1,2,3 得,当出现相似色干扰时,CamShift 算法不能准确地跟踪目标,而本文算法和CT 算法都能较好地处理相似色干扰问题。

尺度旋转:从lemming 序列的第135 帧、soccer 序列的第13 帧可以看出,当目标变大时,CT 算法的跟踪框外包含了许多目标信息,这将导致负样本的采样过于靠近目标区域,使得背景和跟踪目标的可区分度降低。而本文算法可以自适应调整窗口的大小,使得目标能包含在跟踪窗口内。由skating 的第56,68 帧和soccer 的第49,68 帧可以得出,当目标旋转、尺度变化时,CT 算法的模型参数中引入了许多背景信息,出现跟踪漂移,甚至跟踪失败。

运动模糊:lemming 序列的第232 帧由于目标移动过快而导致运动模糊时,CT 算法出现跟踪错误,而本文算法仍能很好的跟踪目标。

图1 lemming 视频序列的跟踪结果(第135,232,350,393 帧)

图2 skating 视频序列的跟踪结果(第56,86,120,298 帧)

目标遮挡:遮挡现象是目标跟踪中较为常见的问题。由lemming 序列的第350,393 帧和skating 序列中的第120,298帧可以看出,当目标被遮挡或消失后,本文算法仍能准确地跟踪目标,而CT 算法则出现错误。

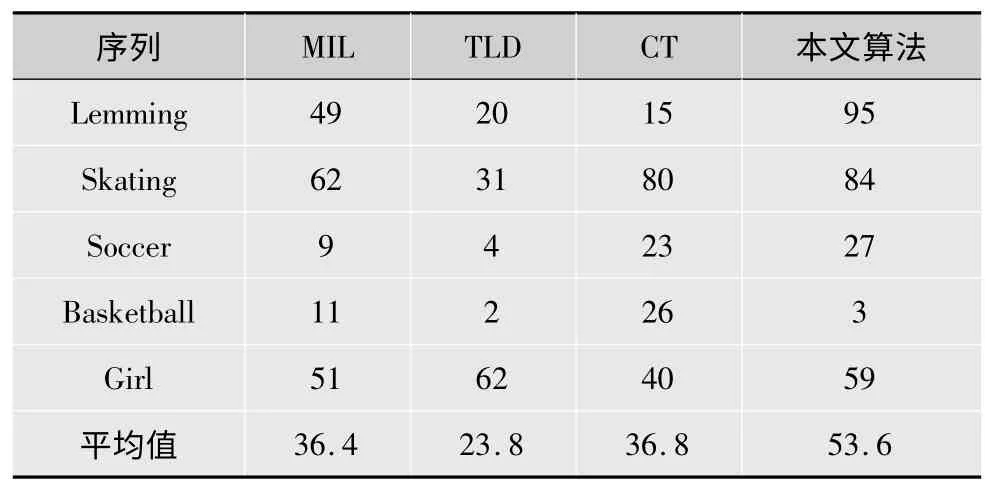

选择5 个具有代表性的视频序列进行测试,比较本文算法与经典算法:多示例学习MIL,TLD,CT 算法的跟踪成功率。各算法的跟踪成功率如表1 所示。

表1 跟踪成功率 %

图3 soccer 视频序列的跟踪结果(第13,49,68,100 帧)

由表1 可以看出,本文算法性能稳定,对于不同的视频序列仍具有较强的鲁棒性和稳定性。

5 小结

本文提出的改进跟踪算法能够根据目标尺度变化自适应调整跟踪窗口,在目标受相似色干扰、目标旋转或目标的外观发生变化的情况下仍能准确跟踪目标。利用稀疏感知矩阵降低了图像特征的维度,在保证跟踪准确性的同时,减少了算法的运行时间,能够满足实时性要求。本论文研究的目标遮挡是短时的部分遮挡,对于目标的长时间或完全遮挡是本文下一步研究的方向。

[1]朱建章.复杂场景下实时视觉目标跟踪的若干研究[D].武汉:武汉大学,2014.

[2]BABENKO B,YANG M H,BELONGIE S. Robust object tracking with online multiple instance learning[J]. IEEE Trans. Pattern Analysis and Machine Intelligence,2011,33(8):1619-1632.

[3]ZHANG K,ZHANG L,YANG M H.Real-time compressive tracking[C]//Proc. 12thEuropean Conference on Computer Vision.Florence,Italy:[s.n.],2012:866-879.

[4]DONOHO D. Compressed sensing[J]. IEEE Trans. Information Theory,2006,52(4):1289-1306

[5]喻玲娟,谢晓春.压缩感知理论简介[J].电视技术,2008,32(12):16-18.

[6]朱秋平,颜佳,张虎,等.基于压缩感知的多特征实时跟踪[J].光学精密工程,2013,35(2):437-444.

[7]钟权,周进,吴钦章,王辉,雷涛.一种改进的实时压缩跟踪算法[J].光电工程,2014,41(4):1-8.

[8]张路平,韩建涛,李飚,等.尺度自适应特征压缩跟踪[J].国防科技大学学报,2013,35(5):146-151.

[9]SWAIN M J,BALLARD D H. Color indexing[J]. International Journal of Computer Vision,1991,7(1):11-32.