一种基于视觉显著性的图像融合算法

胡 甚,张基宏,,柳 伟,张正瑞

(1.深圳大学 信息工程学院,广东 深圳 518060;2.深圳信息职业技术学院 可视媒体处理与传输深圳市重点实验室,广东 深圳 518029)

一种基于视觉显著性的图像融合算法

胡 甚1,张基宏1,2,柳 伟2,张正瑞1

(1.深圳大学 信息工程学院,广东 深圳 518060;2.深圳信息职业技术学院 可视媒体处理与传输深圳市重点实验室,广东 深圳 518029)

基于视觉显著特征提出一种新的图像融合算法。首先对源图像进行小波分解,得到低频系数和高频系数;然后针对低频系数提出一种基于视觉显著性的融合规则,对高频系数采用绝对值取大的融合规则;最后对融合后的低频系数和高频系数进行小波逆变换得到最终融合图像。该方法能完好地将源图像的细节融合在一起。仿真实验表明,该算法在视觉效果上比传统及改进方法更好,同时互信息、平均结构相似性、信息熵等传统客观评价指标有所提高。

图像融合;显著性;显著特征;小波变换

图像融合广泛应用于图像处理和计算机视觉领域,如特征提取、目标识别。通过图像融合来自相同场景的不同图像能被合成单一图像[1]。融合图像能提供此场景更丰富的信息,对人类和机器感知有很大作用。小波分析方法是一种多尺度、多分辨率的方法,其融合图像在各分解层上分别进行,突出源图像重要特征、细节及边缘细节信息,因此能达到比较好的效果。源图像经过一次小波分解得到1幅低频子图像和3幅高频子图像。对于低频图像,传统的加权平均融合方法会降低图像对比度,分解层数低时表现得更为明显,本文将视觉显著特征应用到低频系数融合中,提出一种新的小波变换图像融合算法。该方法符合人类的视觉特征,更加突出源图像中的细节信息,可以获得比传统图像融合算法及一些新方法更好的融合效果[2-6]。

1 视觉显著模型

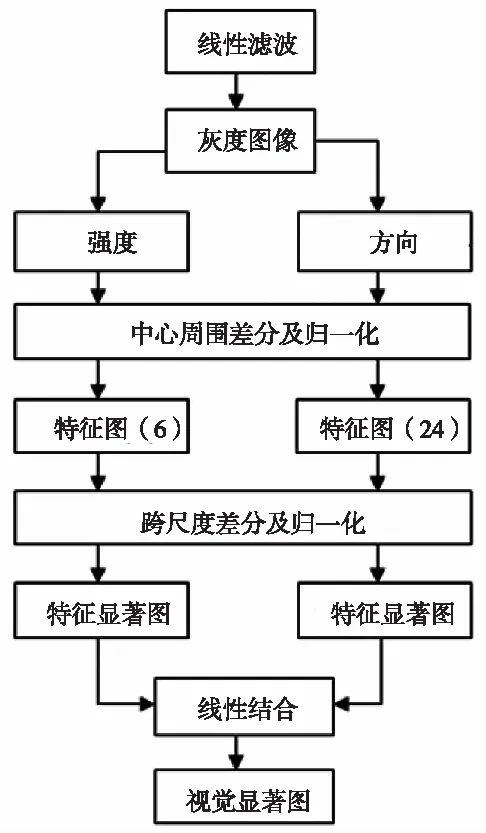

通过对人类视觉系统(HVS)的研究发现,在一个复杂的场景中,人类视觉系统能够迅速将注意力专注于少数显著的视觉对象上,该过程称为视觉注意。Itti和Koch等人在文献[7]中提出一种自底向上的视觉注意模型,本文将该模型进行改进,生成灰度图像显著图,并将该模型与小波分析方法结合进行图像融合。生成灰度图像显著图的过程如下:以强度和方向作为输入图像的视觉特征,分别在不同的尺度上产生高斯金字塔,对高斯金字塔进行“中心—周围差分”(Center-surround Difference)及归一化,分别获得强度、方向上的特征图(Feature Map);然后对特征图进行跨尺度融合(Across-scale Combinations)及归一化;最后生成对应于图像强度和方向的特征显著图(Conspicuity Map)。该过程如图1所示。

图1 生成视觉显著模型

1.1 获取早期特征

用灰度图像的像素值表示图像强度I,将I创建高斯金字塔I(σ),σ∈{0,…,8},中心尺度c和周围尺度s间进行中心—周围差分“Θ”,由细尺度差值运算与逐点提取操作获得[7],从而得到特征图

I(c,s)=|I(c)ΘI(s)|

(1)

式中:c∈ {2,3,4};s=c+δ;δ∈{3,4}。

局部方向信息通过Gabor金字塔O(σ,θ)[6],其中σ∈{0,…,8}代表尺度;θ∈{0°,45°,90°,135°}代表方向。经过中心周围差分,获得方向特征图

O(c,s,θ)=|O(c,θ)ΘO(s,θ)|

(2)

式中:c∈{2,3,4};s=c+δ;δ∈{3,4}。

总共获得30幅特征图:6张强度特征图和24张方向特征图。

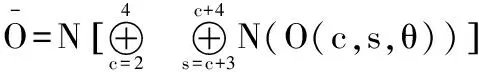

1.2 合成视觉显著图

获得视觉显著图的目的是为了表示图像的空间显著性分布,将强度和方向特征图合成特征显著图,通过Itti模型中的归一化算子N(·),将强度和方向特征图进行归一化,该归一化算子分成如下3步:

1)将特征图值统一到固定范围[0,M]。

2)计算除全局最大值[0,M]。外的各局部最大值的平均值m。

3)将整张图乘以(M-m)2。

(3)

(4)

然后将两个特征显著图线性合成视觉显著图,用S表示

(5)

式中:α与β为加权系数,图像强度与方向分量权重不同,也会产生不同的融合效果,且满足α+β=1,本文实验中α=0.667,β=0.333。

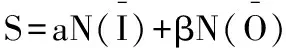

视觉显著图在某处值越大,图像在该位置越显著,将该图用于小波分析的图像融合中,对图像的细节信息有很好的增强效果。图2a为两组源图像,图2b是由上述显著模型生成的视觉显著图。

图2 两组源图像及其显著图

2 结合视觉显著特性与小波变换的图像融合

设A、B两幅源图像,本文提出的融合算法如图3所示。

图3 显著性融合算法流程

具体步骤如下:

1)分别对图像A、B进行N层小波分解,得到低频分量和高频分量。

2)对低频分量采用本文提出的“显著性融合”的融合规则,设SA(i,j)与SB(i,j)分别表示源图像在位置(i,j)处的显著性值,融合图像低频系数选择源图像显著性值S较大对应位置的低频系数。

3)高频系数融合:因为源图像经过小波分解后的高频系数便是图像的边缘细节,因此高频系数采用绝对值取大的方法进行融合。

4)将融合后的低频系数与高频系数进行小波反变换,从而得到最终的融合图像。

3 实验与讨论

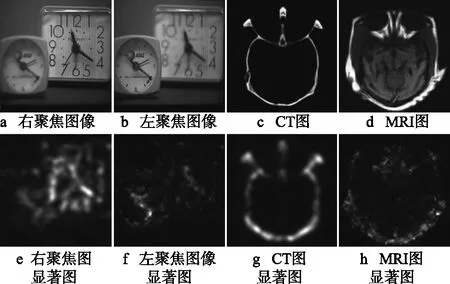

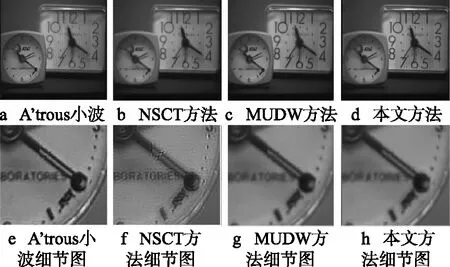

为证明本文所提出算法的有效性,对两幅多聚焦图像、CT与MRI图像分别进行仿真实验,并且与传统方法及一些改进算法进行了比较。本文所用方法是对已有多尺度图像融合算法的低频融合规则的改进,所以将其与传统A’trous小波、NSCT[2]和改进算法MUDW[8]这3种多尺度变换进行比较,如图4所示。

图4 多聚焦图像不同方法融合图像

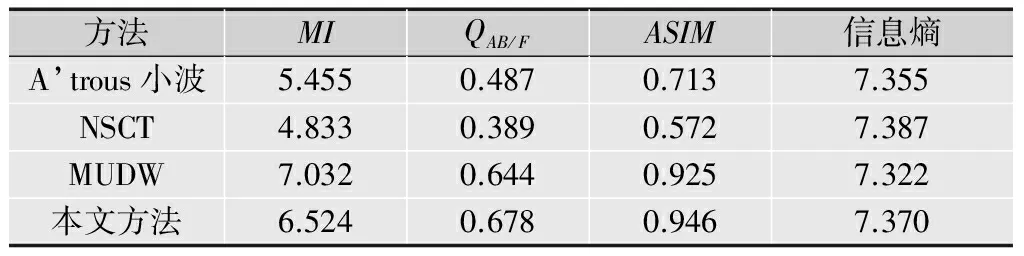

通过客观评价指标评价,本文选取常用的性能指标:互信息(MI)[3]、边缘保持度(QAB/F)[4]、平均结构相似度(ASIM)[9]、信息熵(entropy)[3],一般这些指标越大,融合图像的质量越高,表1是以上几种算法得到的客观评价指标值。

表1 多聚焦图像融合结果客观评价指标比较

从图4看出,由图4e与图4f指针处有明显的伪迹,图4g与图4h虽然裸眼看不出有明显不清晰的地方,但是由表1可看出本文方法在客观评价指标QAB/F、ASIM、信息熵上优于MUDW方法。由此说明本文算法在视觉效果上与客观评价指标上优于传统算法及改进算法,融合图像更清晰;MRI与CT图的融合与多聚焦图像融合类似,不再赘述。

4 结论

本文将视觉显著图应用到小波变换中,提出一种对低频系数显著性的融合方法,高频分量采用系数绝对值取大的方法,取得了较理想的融合效果。该方法本文还应用于医学图像MRI与CT图的融合,也取得了比较好的效果,由此证明了本文算法的广泛实用性。

[1]GOSHTASBY A A,NIKOLOV S.Image fusion:advances in the state of the art[J].Inf.Fusion,2007,8(2):114-118.

[2]ZHANG Q,GUO B.Multifocus image fusion using the non-subsampled contourlet transform[J].Signal Process,2009,92(7):1334-1346.

[3]敬忠良,肖刚,李振华.图像融合——理论与应用[M].北京:高等教育出版社,2007.

[4]XYDEAS C,PETROVIC V.Objective image fusion performance measure[J].Electronics Letters,2000,36(4):308-309.

[5]LI Shutao,KANG Xudong,HU Jianwen.Image fusion with guided filtering[J].IEEE Trans.Image Processing,2013,22(7):2864-2865.

[6]LEVENTHAL A G.The neural basis of visual function:vision and visualdysfunction[M]Boca Raton,Fla.:CRC Press,1991.

[7]ITTI L,KOCH C,NIBURE.A model of saliency-based visual attention for rapid scene analysis[J].IEEE Trans.Pattern Analysis and Machine Intelligence,1998,20(11):1254-1259.

[8]邓苗,张基宏,柳伟,等.基于形态非抽样小波的实时图像融合方法[J].计算机应用,2012,32(10):2809-2813.

[9]ZHOU W,ALAN C B,HAMID R S,et al.Image quality assessment:from error visibility to structural similarity[J].IEEE Trans.Image Processing,2004,13(4):1-14.

责任编辑:时 雯

Image Fusion Method Based on Visual Saliency

HU Shen1,ZHANG Jihong1,2,LIU Wei1, ZHANG Zhengrui1

(1.CollegeofInformationEngineering,ShenzhenUniversity,GuangdongShenzhen518060,China;2.ShenzhenKeyLaboratoryofVisualMediaProcessingandTransmission,ShenzhenInstituteofInformationTechnology,GuangdongShenzhen518029,China)

A new approach for image fusion is proposed based on visual saliency in this paper.Sourse images are decomposed by wavelet to get coefficients of low and high frequency,then the part of low frequency is fused using salient method proposed and the part of high frequency is fused by selecting large absolute wavelet coefficients.Fused image is got by wavelet inverse transformation.Details of source images is fused beautifully using this method.It proves that method proposed outperforms the traditional and improved method in visual effect and some assessment criteria are advanced,such as mutual information,average structural similarity,entropy and so on.

image fusion;saliency;salient feature;wavelet transformation

国家自然科学基金项目(61271420);广东省自然科学基金项目(S012020011034)

TN949.6

A

10.16280/j.videoe.2015.05.010

胡 甚(1988— ),硕士生,研究方向为图像融合;

张基宏(1964— ),教授,博士生导师,研究方向为图像处理与传输;

柳 伟(1973— ),博士,教授,研究方向为信号处理与模式识别;

张正瑞(1986— ),硕士生,研究方向为集成电路。

2014-03-10

【本文献信息】胡甚,张基宏,柳伟,等.一种基于视觉显著性的图像融合算法[J].电视技术,2015,39(5).