基于视觉注意机制的目标跟踪方法*

张巧荣,张慧娟

(河南财经政法大学计算机与信息工程学院,河南 郑州 450002)

基于视觉注意机制的目标跟踪方法*

张巧荣,张慧娟

(河南财经政法大学计算机与信息工程学院,河南 郑州 450002)

提出一种基于视觉注意机制的运动目标跟踪方法。该方法借鉴人类的视觉注意机制的研究成果,建立视觉注意机制的计算模型,计算视频中各部分内容的视觉显著性。结合视觉显著性计算结果,提取视频图像中的显著性目标。利用颜色分布模型作为目标的特征表示模型,与视频中各显著目标进行特征匹配,实现目标的跟踪。在多个视频序列中进行实验,并给出相应的实验结果及分析。实验结果表明,提出的目标检测与跟踪算法是正确有效的。

目标检测;目标跟踪;视觉注意;视觉显著性;显著图

1 引言

随着信息技术的快速发展,视频已经成为现代社会信息的主要来源。视频监控在交通管理、民用安防以及军事等领域发挥着作用。智能视频监控技术已经成为计算机视觉和模式识别领域的研究热点。运动目标检测和跟踪在智能视频监控中是一个非常重要的研究领域,其结果是行为分析、理解等后续处理的基础[1]。

目前目标跟踪算法框架主要可以分为两类:全局性的目标跟踪算法和局部性的目标跟踪算法。全局性的目标跟踪算法主要利用目标模板与图像之间的相似性寻找极大值点,通过在全局图像中穷尽搜索的方式定位目标,例如模板匹配法[2]和协方差跟踪法等[3]。局部性的目标跟踪算法则在局部范围内找到与目标模型最为接近的图像区域,例如均值漂移法[4,5]和粒子滤波[6,7]等。全局性跟踪算法可以实现全局定位目标,但对目标形状变化较敏感。局部性跟踪算法能够适应目标的形状变化,能够得到目标准确的状态,但是不能处理目标在全局范围内转移或快速运动的情况,丢失目标后不能自动恢复。

为了满足实时的需要,要求计算机能够快速地在视频信息中搜索感兴趣目标并进行跟踪。然而要处理的视频数据是海量的,而计算机的处理能力却是有限的。

为了有效地减少处理的信息量,降低计算复杂度,一些研究者逐渐开始关注生物视觉智能特别是人类视觉智能,试图从中发掘出可供计算机视觉借鉴的新思路和新方法[8,9]。视觉生理学和视觉心理学的研究表明,视觉注意机制可以用于解决当前视觉目标跟踪算法中的通用性和实用性问题。借助于视觉注意机制,从复杂的视觉信息中筛选出少量的有用信息提供给目标检测和跟踪算法,提高信息处理的效率[7]。

本文根据人类视觉注意机制的研究成果,提出一种基于视觉注意的目标检测和跟踪方法。首先建立视觉注意的计算模型,根据该计算模型计算视频图像中各部分内容的视觉显著性。

结合显著性计算结果,检测提取图像中的显著目标。对相邻帧中各显著目标进行特征匹配,实现目标的跟踪。

2 视觉注意计算模型

图1为本文提出的用于目标检测和跟踪的视觉注意计算模型。针对输入视频的每一帧图像提取亮度特征及颜色特征,根据亮度特征及颜色特征计算图像的空域显著图;根据每帧图像及相邻帧提取运动特征,计算时域显著图;将空域显著图及时域显著图进行融合,生成综合显著图。

Figure 1 Computational model of visual attention图1 视觉注意计算模型

2.1 特征提取

首先利用公式(1)进行颜色空间转换,将输入图像从RGB空间转为HSI空间,提取其H通道和S通道作为颜色特征,I通道作为亮度特征。

(1)

运动特征可以由公式(2)得到:

(2)

其中,f(x,y,t)和f(x,y,t-1)分别为像素(x,y)在t时刻和t-1时刻的帧图像中的取值。

2.2 显著性计算

视觉显著性是由于输入图像中各部分与其周围环境的特征对比引起的,差异越大越显著。因此,本文通过计算特征图中各区域相对于其周围领域的局部特征对比来计算特征显著性。

(3)

其中,f(x,y)表示像素(x,y)的特征值,M*N为特征图像的大小。

在频域中,相位谱和幅度谱分别包含了不同的图像信息。幅度谱表示图像中每一个频率下信号变化的大小,而相位谱则指明了信号变化的位置。视觉显著性计算的目的就是通过计算图像中各像素的显著程度,从而找出比较显著的位置。利用图像的相位谱得到的重构图像中具有较大值的位置就对应于原始图像中特征值出现较大变化的位置,而这些位置的集合就是 “显著区域”。因此,仅利用相位谱对输入图像进行重构,再进行傅里叶反变换得到的重构图像就是反映原始图像视觉显著性的显著图[10],如公式(4)所示:

(4)

2.3 特征融合

根据前面的方法分别得到亮度、颜色以及运动显著图后,首先对亮度和颜色显著图进行融合,生成空域显著图;然后将空域显著图与时域显著图(运动特征显著图)进行融合,生成综合显著图。

视觉心理学的研究成果表明,运动特征相对于亮度、颜色等视觉特征更容易引起注意。在一个视觉场景中,人们在观察该场景时首先注意到的就是运动的物体;如果场景中没有运动物体,则人类视觉系统更容易被一些视觉反差较强的特征吸引。因此,本文在特征融合时采用动态加权策略,如公式(5)所示:

(5)

其中,SS和ST分别表示空域和时域显著图,wS和wT为其权值,Const为一常量,PVarT为衡量运动特征显著程度的值。

从公式(5)可以看出,如果存在显著的运动特征,则PVarT就比较大,相应的wT就较大,wS就比较小,融合时,给予时域显著图较大的权值;否则,给予空间显著图较大的权值。

最终得到的综合显著图是一幅灰度图像,其大小和输入图像大小相同,各个像素的取值表示了输入图像中对应位置的显著性大小。

3 目标检测与分割

为实现运动目标的跟踪,需要先将目标从视频序列中分割出来并分别加以标记。目前图像分割算法很多,绝大多数分割算法虽然结果精确,但算法复杂度较高,不能满足实时性的要求。

本文采用一种基于视觉显著性的目标检测与分割方法。利用第2节的方法得到综合显著图之后,在综合显著图中那些显著值大于或等于指定阈值T的像素称为显著点,小于指定阈值T的像素称为非显著点。利用公式(6)对综合显著图进行阈值分割:

(6)

阈值T可以通过公式(7)计算得到:

(7)

其中,fL=0,1,2,…,L表示显著图中像素灰度值取值范围,L为显著图中像素灰度值的最大值,p(t)表示灰度值为t的概率,pi为灰度值为i的概率。

分割后得到的二值图像B(x,y)中取值为1的像素即为显著点,取值为0的像素即为非显著点。提取所有连续的显著点就得到了图像中的一些显著区域,这些显著区域对应视频图像中的显著目标。

4 目标跟踪

4.1 跟踪算法

本文目标跟踪算法如下:

Step1初始化,将首次分割出来的n个目标存入目标库,包括每个目标的标号、位置、尺寸、颜色分布及消失计数(初始为0)。

Step2提取下一帧图像,计算视觉显著性,检测分割显著目标。

Step3按照显著性大小提取最显著目标,与目标库中目标分别进行匹配。如果找到匹配的目标,将目标库中与之匹配的目标标号赋给当前显著目标,并更新目标库目标的信息;如果未找到匹配的目标,说明出现新目标,将其信息加入目标库。

Step4重复步骤3,直到当前帧中所有显著目标处理完毕。

Step5当前帧所有目标处理完后,如果目标库中存在未匹配的目标,则可能该目标暂时消失,为了避免该目标因为遮挡或其他原因未检测到,将此目标的消失计数值加1。当目标的消失计数值到达一定阈值时,认为该目标已经消失,从目标库中删除。转到步骤2,继续运行。

目标跟踪算法流程如图2所示。

Figure 2 Diagram of object tracking algorithm图2 跟踪算法流程图

4.2 目标模型

目标模型用颜色直方图表示[8]。假设整个颜色空间被分为m个子区域,计算输入图像中的颜色向量落到每个子区域的像素的个数,生成含有m个柱子的颜色直方图。同时,增加核函数k(d)融合空间信息,计算像素位置对颜色分布的影响,k(d)的计算方法如公式(8)所示:

(8)

其中,d为某像素点到图像中心的距离。

Figure 3 Results of visual attention calculation and object detection图3 视觉注意计算及目标检测结果

(9)

4.3 特征匹配

将当前目标颜色分布模型与目标库中目标的颜色分布模型分别进行匹配,采用两个颜色分布模型之间的的Bhattacharyya距离来作为两目标的相似性判定值[9],如果两个目标的相似值小于某个阈值,则认为特征匹配。

(10)

5 实验结果与分析

为了验证本文提出的利用视觉注意机制的目标跟踪算法的正确性和有效性,我们在Intel Pentium 2.53 GHz、内存2 GB的微机上,利用Visual C++编程实现,在公开测试视频数据集上进行实验,检测算法的性能。

5.1 视觉注意及目标检测结果

分别对室内环境和室外环境进行实验,图3为部分视觉注意计算及目标检测结果。

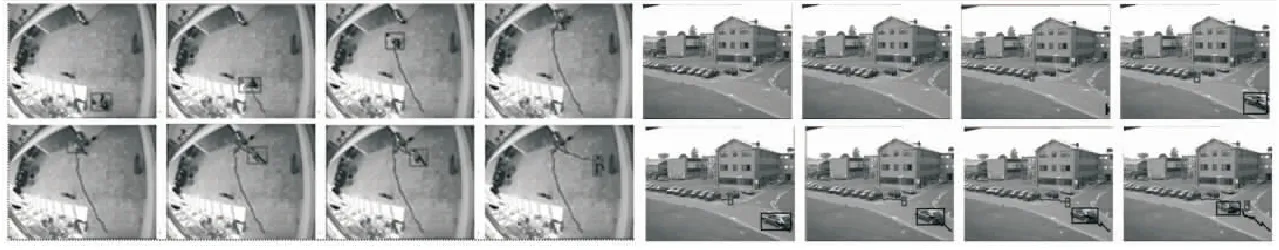

5.2 跟踪结果

分别对室内环境和室外环境进行跟踪实验,图4为一个室内测试视频和一个室外视频的跟踪结果。视频中,目标在运动过程中存在光照、姿态以及形状的变化,本文算法可以精确地跟踪目标。室外视频中有多个运动目标,本文方法可以正确地分割提取运动目标,并能正确地处理新目标出现以及目标消失的情况。

其中室外测试视频的跟踪过程中,目标模型及目标库的变化情况如表1所示。

5.3 算法性能比较分析

与基于颜色特征的粒子滤波算法进行了实验比较,图5是其中一个测试视频的跟踪对比结果。从图5中可以看出,当存在较强的光照变化时,粒子滤波算法的跟踪结果逐渐出现偏差,最终丢失目标,而本文方法则能够正确地对目标进行跟踪。

为了衡量跟踪算法的性能,采用跟踪结果与Ground Truth的x坐标误差、y坐标误差以及非重叠区域比来度量跟踪结果的准确程度[11]。非重叠区域比的计算方法如公式(11)所示:

(11)

Table 1 Process of object tracking表1 跟踪过程

Figure 4 Tracking results图4 跟踪结果

Figure 5 Comparison results of tracking results图5 跟踪结果对比

表2为两种方法在几组实验中跟踪结果的平均x、y坐标误差以及非重叠区域比。从表2可以看出,本文提出的利用视觉机制的跟踪算法的结果无论x、y坐标误差还是非重叠区域比都小于基于颜色特征的粒子滤波跟踪结果。

时间上,在粒子个数为200的情况下,基于颜色特征的粒子滤波跟踪算法平均每帧耗时22 ms,本文方法平均每帧耗时10 ms。因此,本文方法既保证了跟踪结果的正确性,又消耗较少的时间。

Table 2 Comparison of tracking errorand the non-overlapping regions表2 两种方法的跟踪误差及非重叠区域比

6 结束语

本文提出了一种利用视觉机制的目标检测与跟踪算法。首先建立一个动态视觉注意计算模型,用于对视频图像进行分析。提取视频图像的颜色、亮度以及运动等特征进行视觉显著性计算,结合显著性度量结果从视频中提取运动目标。采用颜色分布模型作为目标的表示模型,通过在显著目标之间进行特征匹配进行目标跟踪。在多个视频序列中进行实验,实验结果表明本文提出的利用视觉注意机制的目标检测和跟踪算法是正确有效的。

本文算法采用颜色分布模型作为目标的表示模型,然而长时间的遮挡、剧烈的特征、光照变化会引起目标的颜色分布模型发生变化,使得跟踪失败,因此,除了颜色特征之外,进一步考虑其它更为有效的特征、对目标进行更合理的表示、实现更为鲁棒的目标跟踪是本文需要进一步努力的方向。

[1] Zhou Shang-bo,Hu Peng,Liu Yu-jiong.Target tracking based on improved Mean-Shift and adaptive Kalman filter [J]. Journal of Computer Applications, 2010, 30(6):1573-1576.(in Chinese)

[2] Xu Dong, Xu Wen-li. Tracking moving object with structure template[J]. Journal of Electronics & Information Technology, 2005, 27(7):1021-1024.

[3] Liu Qing, Dou Qin, Guo Jian-ming, et al. Covariance tracking based on multi-characteristic combination [J].Engineering Journal of Wuhan University, 2009, 42(4):512-515. (in Chinese)

[4] Liu Xian-ru,Cai Zi-xing.Real time object tracking using Mean shift combined UKF[J]. Journal of Central South University (Science and Technology), 2011, 42(5):1338-1343. (in Chinese)

[5] Li Yuan-zheng, Lu Zhao-yang, Gao Quan-xue. Particle filter and mean shift tracking method based on multi-feature fusion[J]. Journal of Electronics & Information Technology, 2010,32(2):411-415. (in Chinese)

[6] Wang Yi-mu, Pan Yun, Yan Xiao-lang. An improved color-based particle filter and its full hardware implementation[J]. Journal of Electronics & Information Technology,2011,33(2):448-454. (in Chinese)

[7] Zhu Ming-qing, Wang Zhi-ling, Chen Zong-hai. Human visual intelligence and particle filter based robust object tracking algorithm[J]. Control and Decision, 2012, 27(11):1720-1724. (in Chinese)

[8] Zeng Zhi-hong, Zhou Chang-le, Lin Kun-hui, et al. Visual attention computational model based on tracking target[J]. Computer Engineering, 2008, 34(23):241-243. (in Chinese)

[9] Zhang G, Yuan Z, Zhang N, et al. Visual saliency based on object tracking [C]∥Proc of the Asian Conference on Computer Vision, 2009:193-203.

[10] Hou Xiao-di,Zhang Li-qing.Saliency detection:A spectral residual approach[C]∥Proc of IEEE Conference on Computer Vision and Pattern Recognition (CVPR’07), 2007:1-8.

[11] Li Pei-hua. A novel color based particle filter algorithm for object tracking[J]. Chinese Journal of Computers, 2009, 32(12):2454-2463. (in Chinese)

附中文参考文献:

[1] 周尚波,胡鹏,柳玉炯. 基于改进Mean-Shift与自适应Kalman滤波的视频目标跟踪[J]. 计算机应用, 2010, 30(6):1573-1576.

[3] 刘清,窦琴,郭建明,等. 基于多特征组合的协方差目标跟踪方法[J].武汉大学学报(工学版), 2009, 42(4):512-515.

[4] 刘献如,蔡自兴. UKF与Mean shift算法相结合的实时目标跟踪[J]. 中南大学学报(自然科学版), 2011, 42(5):1338-1343.

[5] 李远征,卢朝阳,高全学. 基于多特征融合的均值迁移粒子滤波跟踪算法[J].电子与信息学报, 2010,32(2):411-415.

[6] 王一木,潘赟,严晓浪.基于颜色的粒子滤波算法的改进与全硬件实现[J].电子与信息学报,2011,33(2):448-454.

[7] 朱明清,王智灵,陈宗海. 基于人类视觉智能和粒子滤波的鲁棒目标跟踪算法[J].控制与决策, 2012, 27(11):1720-1724.

[8] 曾志宏, 周昌乐, 林坤辉,等. 目标跟踪的视觉注意计算模型[J]. 计算机工程, 2008, 34(23):241-243.

[11] 李培华.一种新颖的基于颜色信息的粒子滤波器跟踪算法[J].计算机学报, 2009, 32(12):2454-2463.

ZHANGQiao-rong,born in 1978,PhD,associate professor,her research interests include image processing, and artificial intelligence.

Objecttrackingbasedonvisualattention

ZHANG Qiao-rong,ZHANG Hui-juan

(College of Computer and Information Engineering,Henan University of Economics and Law,Zhengzhou 450002,China)

An algorithm for moving object tracking based on visual attention mechanism is proposed. Human visual attention mechanism is introduced in the proposed algorithm and a computational model of visual attention is constructed. Based on the computational model, the visual saliency of each part in videos is computed. Salient objects are detected according to the visual saliency results. Using the color distribution model as the representation model of the object, objects are tracked by calculating the similarity of salient objects in the two successive frames by. The algorithm is tested on many video sequences. Experimental and analysis results show that the proposal is robust and effective for object detection and tracking in videos.

Object detection;object tracking;visual attention;visual saliency;saliency map

1007-130X(2014)08-1549-06

2012-10-16;

:2013-03-26

河南省基础与前沿技术研究计划资助项目(122300410379);河南省教育厅科学技术研究重点资助项目(14A520025)

TP391.4

:A

10.3969/j.issn.1007-130X.2014.08.022

张巧荣(1978-),女,河南郑州人,博士,副教授,研究方向为图像处理和人工智能。E-mail:zqrzqh@126.com

通信地址::450002 河南省郑州市文化路80号河南财经政法大学计算机与信息工程学院

Address:College of Computer and Information Engineering,Henan University of Economics and Law,80 Wenhua Rd,Zhengzhou 450002,Henan,P.R.China