基于双线性模型的人脸表情识别技术

徐 欢

(北京工业大学,北京 100124)

0 引言

人脸面部表情的研究从提出[1]到现在有了突飞猛进的发展。分析这些研究结果,不难看出,在人脸表情识别的过程中识别效果较好的大部分是二维的图像数据[2-3],而基于三维数据的则更多的是用于人脸的面部识别过程[4-6]。然而随着近些年三维数据处理技术的提高[7],研究人员发现一些人脸面部的三维模型中也同样包含了许多有价值的信息[8-9]。在科学研究中,把这些带有丰富信息的三维数据加入识别人脸表情的过程中对表情更加高效的识别是一条行之有效的途径,例如采用多视角模型[10]或三维模型[11-14]。

一些研究人员已经尝试进行了基于中性人脸图像信息与已知身份的人脸表情的识别,然而在实践过程中,仍然存在着一些问题亟需改进。综合算法复杂度与人脸表情识别率等多方面因素的考虑,本文采用一种利用双重特征即身份特征和表情特征的双线性模型进行研究,对Iordanis Mpiperis等人[15]提出的基于双线性模型的表情识别方法进一步改进。首先,需要完成的是异构的三维人脸数据点云对齐,本文选用基于模型手动选取特征点与TPS(thin-plate spline models,薄板样条)变形算法[16]相结合来实现人脸三维数据的非刚性数据配准过程。在建立好对应点云数据之后,试图建立基于三维数据的“身份-表情”的双线性模型,以获得身份特征和表情特征。在识别过程中,对原有的识别算法加以改进,最大程度地降低身份特征对于表情识别过程的影响,期望通过对身份特征和表情特征在最终识别过程中的分步计算处理,最终达到提高人脸表情识别率的目的。

1 基于TPS算法的三维数据对齐处理

TPS可以被看作从一个三维实空间到另一个三维实空间的映射,即TPS可以被定义为f:R3→R3。TPS的变形过程需要2组三维输入数据,1组为待变形的点云数据,另一组为目标点云数据。为了方便描述,2组点云数据分别被定义为:

其中N1与N2分别代表点云数据F1与点云数据F2内三维点的个数,并且N1≤N2。F1与F2的对应控制点集分别定义为:

其中,M是控制点的个数,这些控制点可以被认为是TPS变形中源点云与目标点云的对应控制点,并满足映射条件:

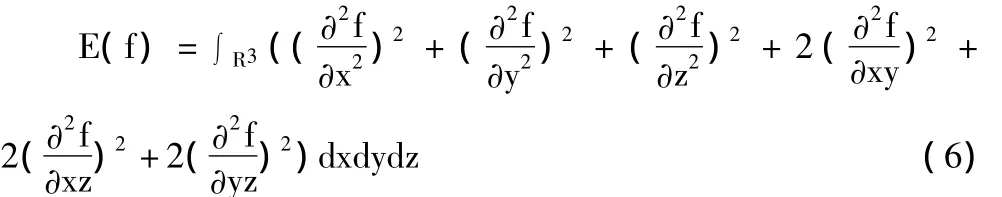

同时,根据TPS的变形理论,TPS变形的过程中还应满足混合平滑约束,即满足下述的能量函数:

同时,TPS可以被分解为仿射变换部分与非仿射变换部分,即用如下公式表示:

其中:P为源点云F1中的点且其齐次坐标为P(x,y,z,1);d为4×4仿射矩阵;K为TPS核函数且K可以表示为1 × M 阶向量 K=(K1(P),...,KM(P)),其中Kj(P)=‖P -L1j‖,j=1,...,M;w 为非仿射变换矩阵且表示为M×4阶矩阵。

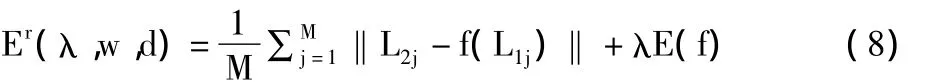

求解TPS变形过程,即为求解矩阵d与w的过程。通常有2种方法:插值法与非插值法。如果TPS中不需要进行插值,则可以通过最小化公式来确定最优解:

其中λ为平滑约束参数,给出一个适合的λ值可以更好地优化公式(8)表示的能量函数。

在可插值的情况中,公式(5)的条件被满足。将公式(7)代入到公式(5)中并对w进行非仿射变换约束:w=0,进一步,可以通过公式直接求解d与w:

其中:M1'与M2'分别为控制点M1、M2的齐次坐标,且表示为M×4的矩阵;K为M×M阶矩阵,表示源点云中控制点的空间关系。K中的每一个元素kij以下述方式构成:

在本文中,待变形点云即为数据库中每张表情人脸点云,目标点云选取第1个人的中性表情人脸点云数据,特征点为手工标定的83个面部特征点信息。在定义以上的数据信息之后,即可通过TPS变形完成三维点云的数据对齐处理工作。

2 基于对称型的双线性模型

在获得配准数据的基础之上,考虑利用比较典型的模式对人脸表情进行分类,然而传统模式的分类方法存在着一些对识别结果不利的因素,例如:在测试一张浮肿人脸时,无法确定造成脸部这种浮肿的状态是由于测试个体的原因,如他是一个肥胖者,或者是由于测试个体做了一个微笑的表情。因此为了解决身份因素对于表情识别过程中的影响,可以考虑分离身份特征和表情特征,这样在分离后的识别过程中,身份特征对于表情识别的干扰将变得微乎其微。综合以上所说的因素,通过双线性模型来对身份特征和表情特征进行分离。

在双线性模型的建立过程中,用vxp代表数据库中的一个样本三维人脸,其中x代表表情,p代表身份,由于每张人脸在经过上一步对齐处理之后已经有了相同的点云数量,所以这里用N代表每张人脸的点云数,用K代表每张人脸的维度,则K=3N,至此,三维人脸中的每一个元素都可以用双线性模型加以表示:

设定在数据库中T表示人脸的总数,Tp代表数据库中的人数,在第p个人中又包含了x种表情,用Tx代表所有表情的种类,则上述公式(12)又可用下述公式(13)表示:

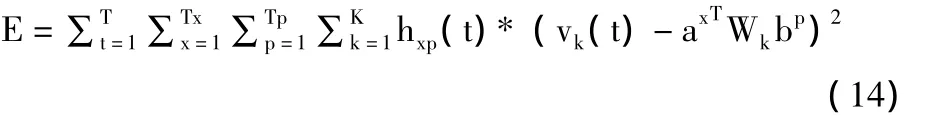

为了确定双线性模型在表示人脸表情方面的可行性,建立下面的误差函数:

其中hxp(t)为0-1函数,当v(t)中拥有p身份x表情的人脸是同一张人脸时,hxp(t)=1;其余的时候该函数均当作零处理。

对误差函数求偏导数,并令偏导函数等于0,分别得到关于变量ax,bp,Wk的等式方程:

其中:nxp代表参加训练的样本总数代表训练集中所有样本对应点之和。

通过对公式(15)~(17)的多次迭代,最终可以得到控制向量ax、控制向量bp以及关系矩阵Wk。不过在计算迭代过程中需要特别注意的是,迭代过程是否收敛还要取决于控制向量ax的维度I和控制向量bp的维度J,当I小于或者等于表情的种类且J小于或者等于身份的种类时,迭代过程才收敛,因此在实验过程中,须选取合适的I和J的值来保证迭代的收敛性。

3 基于单幅图像的双线性模型

这里提出的新的方法是基于对称型双线性模型建立成功的基础之上,在通过双线性模型得到3种参数后,不再直接利用识别人脸v进行计算,而是利用双线性模型的特殊性质,即当一个特征为定值时,双线性模型即转化成线性模型,可以利用模型的这个特点得到身份特征和表情特征都不知道的识别人脸的2组参数特征,具体的过程为:

1)对识别人脸的身份特征进行赋值操作,数值等于双线性模型建模中得到的身份特征的均值:

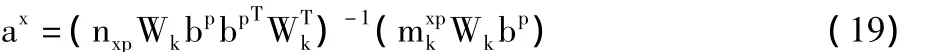

2)在三维人脸表情数据v、关系矩阵Wk以及身份特征bp这3组变量都知道的情况下,原双线性模型转化为线性模型,更新表情特征:

3)在三维人脸表情数据v、关系矩阵Wk以及公式(19)中所更新的ax这3组变量都知道的情况下,更新身份特征:

重复步骤2)和步骤3),直到收敛为止。

至此,得到了三维人脸的表情参数和身份参数,利用表情参数和身份参数这2组参数进行参数识别,具体算法流程将在下一节中进行阐述。

4 基于双线性模型表情识别的改进算法

现有大部分的识别算法在人脸识别计算过程中仍然会涉及能够体现身份属性的身份特征的计算,即前文所提到的bp身份特征,由于身份特征参数的加入,这在一定程度上会影响到单独表情的识别过程,因为不同的人所具有的面部轮廓的不同直接导致了在做不同表情时,每个人的人脸表情轮廓的不相同,而人类作为一个统一的整体,人脸在做不同表情的时候又有着内在的联系,因此考虑在原有识别算法的基础之上进行修改,不再将身份特征与表情特征同时进行计算,而是采用先处理身份特征,再计算表情特征的方法,目的就是为了能够更加彻底地分离出2种独立特征,使人脸表情识别过程中身份特征对于表情特征的影响尽量降低到最低的范围之内,以达到更加理想的识别效果。

具体的修改算法如下:

1)不改变双线性模型的建立过程,首先对整体训练集中多人的人脸表情数据建立整体的双线性模型,在模型建立完成后,获得身份特征、关系矩阵和表情特征。

2)利用基于单幅图像改进的双线性模型对训练集中每张具体的表情人脸进行建模操作,得到每张人脸的1对特征,由于样本中每个人都拥有多种表情,因此对于同一个人也就存在多组身份特征,需要对这多组身份特征进行均值化处理,处理后的均值身份特征即可以很好地表达此人的身份属性:

其中bij代表第j个人带有第i种表情的人脸的身份特征。

3)对识别人脸进行基于单幅图像的双线性模型建模操作,得到识别人脸的身份特征和表情特征。这里考虑到人脸轮廓的差异性,例如:欧美人的脸部整体轮廓相对于亚洲人要更加棱角分明,而具有相似脸部结构的个体在做同一种表情时更加接近,因此在识别过程中需要剔除一些与识别人脸身份特征差距较大的样本,选取身份特征更加接近的样本集进行识别。筛选过程中用识别人脸的身份特征与训练集中的多组身份特征分别做二范数,得到多组数值,如公式(22)所示:其中b表示识别人脸的身份特征,bj表示b与第j个人的身份特征的二范数。

对公式(22)的结果按照降序排列,截取前N组值,定义为与识别人脸身份特征最接近的N个人,N的取值取决于训练集中样本的分布及数量,可通过多组实验获得。

4)然后将N个人对应的表情特征进行处理,每种来自于不同人的相同表情特征取均值,作为最终的人脸表情识别模板:

其中ain表示截取后的数据中的第n个人带有第i种表情的表情特征。

5)最后利用识别人脸的表情特征分别与做均值化后的表情识别模板进行计算,如公式(24):

其中函数f(i)表示第i种表情的函数值,a为识别人脸的表情特征,ai为均值化处理后的表情特征模板。

5 实验结果与分析

5.1 三维数据库中数据的选择

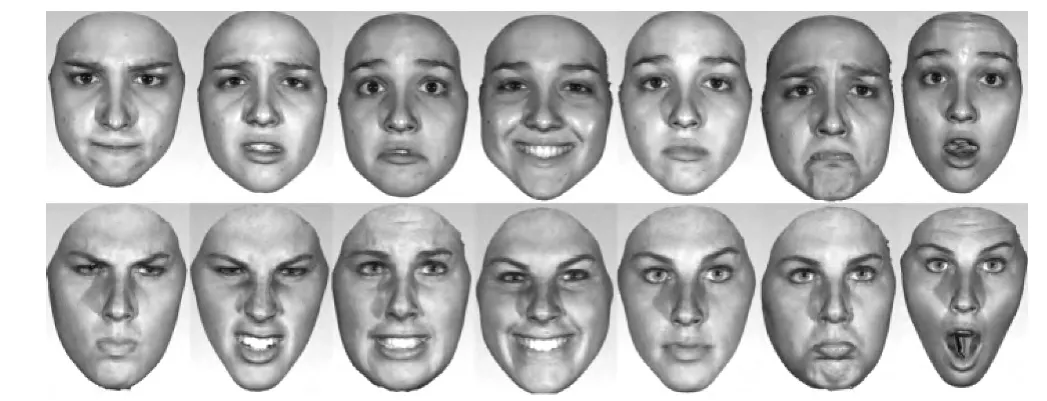

在整个实验进行的过程中,考察了多个研究机构的三维人脸及表情的数据库,包括 BU-3DFE[17]、FRGC[18]、GavabDB[19]。最终选择了 BU-3DFE 人脸数据库来对实验的结果进行评估测试,该数据库中共包含100个不同人的表情信息,每组个体样本在该数据库中共包含7种不同的表情,分别为生气、失望、害怕、高兴、伤心、惊讶以及中性表情。除中性表情仅为1张外,每组样本人脸的其余6种表情中的每一种表情又可以被细分为4种不同程度,分析这4个等级的表情,level-1和level-2程度相对较低,在表达表情时面部肌肉的伸展幅度相对较小,在表情识别的过程中,各个表情的区分不是特别的明显,而level-3和level-4则可以更好地表达。如图1所示。

图1 基于level-4的不同表情

本文的实验是表情识别,为了能够得到较好的区分表情,得到理想的实验效果,所以采用level-4的表情数据作为实验数据。

5.2 实验结果

为了验证身份特征的提取对于识别效果的影响,拟进行多组独立实验,实验选取数据库中100个人中每个人强度为level-4的7种表情进行训练,表情特征的维度和身份特征的维度通过实验1获得,N的确定通过实验2获得,测试集选取100个人中强度为level-3的7种表情进行识别。

1)实验1。

在实验1中,采取单变量的原则分别进行2组实验确定身份特征和表情特征的维度,实验1.1中,设置身份特征的维度为90保持不变,改变表情特征的维度为4,5,6,7进行实验,实验结果如图2所示。

图2 基于不同表情特征维度的识别情况

在实验1.2中,设置表情特征的维度为实验1.1中使识别率最高时的7不变,改变身份特征的维度分别为60,70,80,90进行实验,实验结果如图3所示。

图3 基于不同身份特征维度的识别情况

通过2组实验,并综合考虑算法时间复杂度以及识别率2方面的因素,确定表情特征的维度为7,身份特征的维度为80。

2)实验2。

通过实验1,确定了身份特征和表情特征的维度,接下来的实验2中,试图确定N的取值情况。

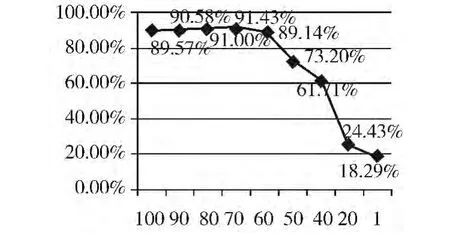

分别改变N的值,得到如图4所示的实验结果。

图4 基于不同N值的识别情况

6 结束语

本文提出了一种基与改进后的双线性模型的人脸表情识别技术,基于BU-3DFE的三维表情数据,利用TPS算法对点云数据进行对齐处理。在获得配准数据的基础上,建立对称型的双线性模型,并在获得关系矩阵后,对原有识别算法加以改进,分离出身份特征与表情特征,利用身份特征对训练集数据做筛选操作,再利用表情特征进行最后的识别处理。

实验结果表明改进后的算法对表情识别起到了一定的贡献,当有效地设置最近邻人数N时,表情的识别率会有一定程度的增加,但当N值设置不合理时,对表情的识别情况会起到一定的反作用,同时在新算法中也有一些不足之处,需要日后更深入的研究:1)加入身份特征筛选过程,使得原有算法更加复杂,计算时间更长,实时性得不到保证;2)在实验中对于N值的确定需要大量的对比实验,每当训练集数据改变时都需要重新计算N值,这极大地增加了算法的计算量。

[1] Ekman P,Friesen W V.Facial Action Coding System:A Technique for the Measurement of Facial Movement[M].Consulting Psychologists Press,1978.

[2] Pantic M,Rothkrantz L J M.Automatic analysis of facial expressions:The state of the art[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(12):1424-1445.

[3] Fasel B,Luettin J.Automatic facial expression analysis:A survey[J].Pattern Recognition,2003,36(1):259-275.

[4] Lu Xiaoguang,Jain A.Deformation analysis for 3D face matching[C]//Proceedings of the 7th IEEE Workshops on Application of Computer Vision.2005,1:99-104.

[5] Samir C,Srivastava A,Daoudi M.Three-dimensional face recognition using shapes of facial curves[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2006,28(11):1858-1863.

[6] Chua Chin-Seng,Han Feng,Ho Yeong-Khing.3D human face recognition using point signature[C]//Proceedings of the 4th IEEE International Conference on Automatic Face and Gesture Recognition.2000:233-238.

[7] 徐成华,王蕴红,谭铁牛.三维人脸建模与应用[J].中国图象图形学报,2004,9(8):893-903.

[8] Bowyer K,Chang Kyong,Flynn P.A survey of approaches and challenges in 3D and multi-modal 3D+2D face recognition[J].Computer Vision and Image Understanding,2006,101(1):1-15.

[9] Chang Kyong,Bowyer K,Flynn P.An evaluation of multimodal 2D+3D face biometrics[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(4):619-624.

[10] Pantic M,Rothkrantz L J M.Facial action recognition for facial expression analysis from static face images[J].IEEE Transactions on Systems,Man,and Cybernetics,Part B:Cybernetics,2004,34(3):1449-1461.

[11] Braathen B,Bartlett M,Littlewort G,et al.An approach to automatic recognition of spontaneous facial actions[C]//Proceedings of the 5th IEEE International Conference on Automatic Face and Gesture Recognition.2002:360-365.

[12] Wen Zhen,Huang Thomas S.Capturing subtle facial motions in 3D face tracking[C]//Proceedings of the 9th IEEE International Conference on Computer Vision.2003,2:1343-1350.

[13] Zalewski L,Gong Shaogang.Synthesis and recognition of facial expressions in virtual 3D views[C]//Proceedings of the 6th IEEE International Conference on Automatic Face and Gesture Recognition.2004:493-498.

[14] Mayer C,Wimmer M,Eggers M,et al.Facial expression recognition with 3D deformable models[C]//Proceedings of the 2nd IEEE International Conferences on Advances in Computer-Human Interactions.2009:26-31.

[15] Mpiperis I,Malassiotis S,Strintzis M G.Bilinear models for 3-D face and facial expression recognition[J].IEEE Transactions on Information Forensics and Security,2008,3(3):498-511.

[16] Hu Yongli,Zhu Xianghui,Sun Yanfeng,et al.Multi-sample 3D face registration based on TPS transformation and linear combination model[C]//Proceedings of the 4th IEEE International Congress on Image and Signal Processing.2011,3:1343-1348.

[17] Yin Lijun,Wei Xiaozhou,Sun Yi,et al.A 3D facial expression database for facial behavior research[C]//Proceedings of the 7th IEEE International Conference on Automatic Face and Gesture Recognition.2006:211-216.

[18] Phillips P J,Flynn P J,Scruggs T,et al.Overview of the face recognition grand challenge[C]//Proceedings of the 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition.2005,1:947-954.

[19] Moreno A B,Sanchez A.GavabDB:A 3D face database[C]//Proceedings of the 2nd COST Workshop on Biometrics on the Internet.2004:77-82.