小型无人直升机着陆高度单目视觉测量方法*

郑晓平,韩 波,李 平,张 宇

(1.浙江大学工业控制研究所,浙江杭州310027;2.浙江大学导航制导与控制研究所,浙江杭州310027)

0 引言

小型无人直升机(small unmanned helicopter,SUH)由于飞行灵活、搭载方便等特点,在灾区探查,边界巡逻,农业灌溉等领域有着很大的应用优势。其中机体离地高度信息的测量对于无人机自主降落起着关键性的作用。目前,离地高度数据通常由INS/GPS和声纳配合使用获得,当姿态发生变化时,声纳所测的数据准确性下降,且容易受近地面环境的影响,而在野外山区或天气不佳,GPS信号则容易受阻导致高程数据误差较大,且非差分GPS精度不高,不能满足无人机自主降落要求,而差分GPS则价格昂贵。

随着机器视觉技术的发展,基于视觉的导航系统可以快速处理大量的图像信息,计算获得SUH的飞行状态和离地高度信息,不受地面效应与环境影响,具有较高的定位精度,能有效地弥补传统方法的不足。

文献[1]采用视觉方法检测和提取特征点,通过摄像机透视模型解算得到直升机相对位置与姿态,Yakimenko O A等人则研究了在机载摄像机可观察到母舰上至少3个可辨识点的条件下,确定相对于母舰的位置问题[2]。Billingsley J根据已知的姿态角信息与合作目标提供的视觉信息估计出位置参数。在无人机高度为5 m时,视觉信息得到的位置参数误差小于 10 cm[3]。文献[4]充分利用跑道的两条边线和地平线所构造的几何关系,描述了求解姿态角和高度值估计的算法。

基于单目视觉的测量方法是以直线和圆作为图像识别特征,在降落图标实际尺寸未知的情况下,通过图像和声纳传感器,利用已知的姿态信息和摄像机投影模型,解算获得机体的离地高度。实验表明:算法特征识别率高,输出结果的实时性和准确性均能满足SUH自主降落要求。

1 测量系统流程

在SUH自主降落过程中,自主降落系统根据视觉导航系统提供的相关信息,控制SUH平稳降落,而机体离地高度属于导航信息的一部分,其测量系统流程如图1所示。

图1 测量系统流程图Fig 1 Flow chart of measurement system

离地高度测量系统需要提前标定摄像头,获得内参数,而实时的机体姿态信息,可以由INS/GPS组合导航提供或者基于视觉的姿态算法计算获得。在自主降落过程中,首先,通过处理摄像头获得的图像与起飞过程声纳传感器的数据,获得特征直线在图像坐标系和世界坐标系下的描述方程,然后,利用已知姿态信息求解旋转矩阵,最后,根据摄像头的投影模型实时输出机体离地高度数据。

2 降落图标设计与视觉图像处理

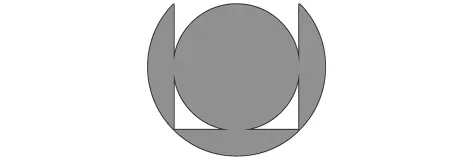

识别降落图标并根据投影关系求解机体离地高度信息,需要知道降落图标上特征几何元素在世界坐标系与图像坐标系的具体位置。为了使降落图标易于识别,缩短视觉导航系统采集处理数据所需要的时间,设计降落图标如图2所示。图标包含圆和直线段2种简单的几何元素,深色区域为红色或其他易于识别的颜色,其余区域为白色。

图2 降落图标Fig 2 Landing icon

由图1可知,视觉图像处理部分在其中起着关键性的作用,其主要任务是处理从摄像头得到的视频数据,输出降落图标上特征直线在图像坐标系与世界坐标系中的描述方程,主要包括图像阈值化、划分连通域、识别特征圆与特征直线、求解特征直线的描述方程等,如图3所示,具体过程如下:

1)先对视频图像进行自适应阈值处理[5],将周围环境与降落图标分离出来,获得二值图像。

图3 对降落图标的图像处理过程Fig 3 Image processing for landing icon

2)在二值图像中,分离像素值为0或者1的部分,并将像素值为0的区域连接成0区域,同理划分出1区域,并舍弃像素面积过小和面积纵横比相差太大的区域。

3)在SUH起飞阶段,使用随机Hough变换算法识别特征圆,并计算圆的直径像素长度Lu。由于起飞迅速,SUH姿态可认为基本不变,假设成像平面与着陆平面平行,由投影关系可得f/h=Lu/Lw,其中,f为摄像头焦距,h为声纳所测的实时离地高度,即可求得特征圆在世界坐标系的直径长度Lw。

4)使用Hough变换方法识别特征直线,并在图像坐标系下求得其描述方程ajxu+bjyu+cj=0(j=r,l)。根据特征圆与两特征直线相切的已知条件,可知道特征直线在世界坐标系的描述方程为yw=±0.5Lw。

3 机载摄像头投影模型与离地高度算法

为了使SUH平稳降落,在搜寻到降落图标后,SUH在飞控程序控制下保持悬停状态,逐渐下降高度并微调水平位置。在实际降落过程中,由于机身姿态的改变,摄像头的成像平面与着陆平面存在一定的夹角,导致利用线性关系估算高度产生误差,因而,基于视觉图像估算离地高度需要考虑姿态变化带来的影响。

SUH自主降落的过程可认为是连续变化的,机载摄像头与着陆平面的几何关系如图4所示。A为摄像头的成像平面,B为降落图标所在的着陆平面,世界坐标系owxwywzw为北东地坐标系[6],坐标原点定于着陆目标圆心 ow处。t时刻,SUH机体坐标系可记为otxtytzt,坐标原点ot为无人机质心,otxt轴沿机身对称轴指向机头方向,otyt轴垂直于飞机对称平面指向右方,otzt垂直于otxtyt平面指向下方。另外,摄像头坐标系为otxcyczc,图像坐标系为ouxuyu。定义otxc与 otyt重合,otzc与 otzt重合,otyc与 otxt方向相反。

设降落图标上任意一点Pi在成像平面A的透视投影点为 Pi,u,Pi在 owxwywzw下的齐次坐标为

图4 机载摄像头与着陆平面的几何关系Fig 4 Geometric relationship between on-board camera and landing plane

Pi,w=[xi,wyi,wzi,w1]T,Pi在 otxtytzt下的齐次坐标为

Pi,t=[xi,tyi,tzi,t1]T,Pi在 otxcyczc下的齐次坐标为

Pi,c=[xi,cyi,czi,c1]T,Pi,u在 ouxuyu下的齐次坐标为

Pi,u=[xi,uyi,u1]T,则机载摄像头投影模型可表示为

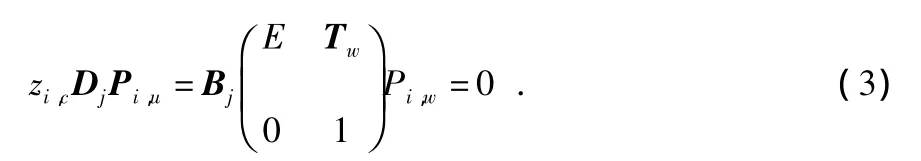

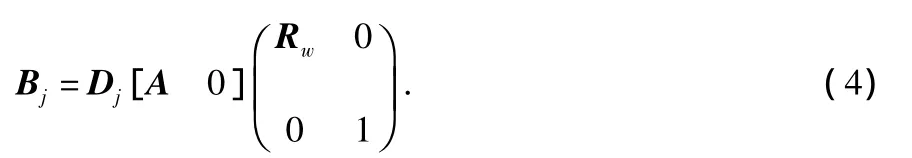

t时刻,特征直线j在图像坐标系的描述方程可表示成矩阵形式

其中,Dj=[ajbjcj]为特征直线的系数行向量。

将式(2)代入投影模型式(1)可得

其中,行向量

由于特征直线在世界坐标系上的描述方程始终为

则式(3)与式(5)等价,可化简得

其中,Bj1,Bj3分别代表行向量的第一和第三个元素。

根据以上分析可知,在旋转矩阵 Rw,j×j=fi×j(θ,φ,ψ)和内部参数矩阵A已知的情况下,由两条以上的特征直线信息,即可估算世界坐标系到机体坐标系在z方向上的平移Tz,即机体当前的离地高度,表达式如下

实际降落过程中,机体横滚角θ,俯仰角φ与偏航角ψ由机载INS/GPS模块测得,从而求得旋转矩阵Rw,摄像头内部参数矩阵A,则可于SUH起飞前通过摄像头标定获得。针对不同的应用场景,特征直线在owxwywzw下的描述方程可以作为先验信息,也可以于起飞过程中,配合声纳与视觉图像计算获得。最终由式(4)可实时得到Bi,进而估算SUH的离地高度Tz。

4 实验与结果分析

将摄像头与声纳传感器固联于INS/GPS模块,实验装置以不同的姿态角度拍摄位于水平面的降落图标,并以上述图像处理方法和高度估计算法做了大量实验。

实验主要步骤如下:

1)对摄像头所采集的图像进行鱼眼矫正,再标定获得摄像机的内参数[7]:焦距为 198.4 像素(pixels),约为2.1 mm,光学中心坐标为(160,120)。

2)将世界坐标系原点设于降落图标中心点,并根据组合导航所提供的偏航角大小调整降落图标中2条相互平行的特征直线位置,使其与世界坐标系的xw轴平行。

3)配合声纳传感器,利用第2节的方法模拟起飞过程,获得降落图标中圆直径的实际长度,从而避免使用先验知识。

4)在不同的离地高度下,连续改变姿态并使降落图标始终处于摄像头视野范围内,如图5所示。根据INS/GPS组合导航提供的数据与图像信息,实时估算摄像头离地垂直高度数据。

图5 不同高度下的图像处理结果Fig 5 Image processing results of different heights

在离地高度分别为30,75,100,150 cm时,在一段时间内,摆动实验装置使姿态角在0°~30°之间连续变化,并选取其中连续的5s作数据分析,如图6所示。

由实验结果可知,离地高度的增加会导致测量高度绝对误差的增加,在离地高度为150 cm时,最大相对误差为4.67%。针对圆直径为15 cm的降落图标,在姿态角较大时,为使相对误差控制在5%以下,算法的有效测量范围为30~150 cm,在自主降落的实际过程中3个姿态角均偏小,一般在10°以下,则有效的测量范围可达30~200 cm。

图6 不同高度下的测量结果Fig 6 Measurement results of different heights

算法的准确性主要取决于导航姿态数据与特征直线描述方程参数的准确性。以90级无人直升机为例,其支架高度约为30 cm,开始进入自主降落模式的安全高度约为200 cm,随着离地高度的不断下降,算法测得的离地高度最大绝对误差逐渐收敛,能满足自主降落对离地高度准确性的要求。

在验证测量方法的实验中,缩小降落图标的尺寸,会使测量范围变小,但有利于实验数据的测量。在实际应用中,配合分级降落图标,通过识别大尺寸的降落图标,测量范围则可以进一步扩大,而对于较高的离地高度,选择大图标来识别特征直线,可以有效降低相对误差。

5 结论

在SUH自主降落过程中,对于离地高度测量的实时性。针对姿态发生变化导致声纳传感器测量不准和非差分GPS高程精度不高的情况,提出了一种基于特征直线的单目视觉高度测量方法,实验表明:该方法实时性良好,测量范围与精度均能满足自主降落的要求。

[1]Sharp CS,Shakemia O,Sastry SS.A vision system for landing an unmanned aerial vehicle[C]∥Proceedingsof 2001 IEEEInternational Conference on Robotics and Automation(ICRA),Seoul,South Korea,2001:720-1727.

[2]Yakimenko O A,Kaminer I I,Lentz.W J,et al.Unmanned aircraft navigation for shipboard landing using infrared vision[J].IEEE Transactions on Aerospace and Electronic System,2002,38(4):1181-1200.

[3]Billingsley J,Bradbeer R.Mechatronics and machine vision in practice[M].Berlin,Heidelberg:Springer,2007:181-191.

[4]尚佳佳.无人机着陆图像辅助导航方法研究[D].西安:西北工业大学,2007.

[5]章毓晋.图像分割[M].北京:科学出版社,2001.

[6]邓正隆.惯性技术[M].哈尔滨:哈尔滨工业大学出版社,2006:2.

[7]Bradski G,Kaebler A.Learning OpenCV[M].USA:O'Reilly Media,2008.