影像特征提取及分类器的设计

栗 业 周汝良 王云飞 芦 珊

(1.西南林业大学,云南 昆明 650224;2.中国林业科学研究院 资源信息研究所,中国 北京 100091)

1 影像区域分割

1.1 分割原理

Edison采用的是基于均值漂移原理的影像分割,如果影像维数为p,当空间位置向量与颜色向量一起合为“空间-颜色”域时,维数为p+2,作为防辐射对称核和欧几里德多元核表示为:

式中,xs为特征矢量的空间部分;xr为特征矢量的颜色部分;k[x]在空间和颜色域中都是用相同的核;hs、hr分别为空间带宽与色度带宽;C为相应的归一化常数。因此,带宽参数(hs,hr)就成为均值漂移分割过程中的重要参数。

对于基于均值漂移的影像分割过程,设xi为d维输入影像,zi(i=1,...,n)为其滤波影像,Li为分割影像的第i个像元,则分割过程为:①进行均值滤波,存储d维滤波数据zi=yi,c;②对所有空间域小于hs且范围域小于 hr的 zi进行聚类{Cp},p=1,...,m;③对于每个 i=1,2...,n,计算Li={p|zi∈Cp};④瓷都合并过程,将连续空间域小于合并尺度M个像元的区域进行进一步合并。

1.2 分割实现

首先,均值漂移分割算法需要将RGB色度空间转换到LUV特征空间,以更好地实现其特征空间的分离,这是因为RGB空间为非线性,不具有较好地空间统计性及尺度对应关系,而LUV可以更好地应用分割过程中的影像不同像元的光谱信息并进行统计。对于彩色影像来说,假设彩色图像的特征空间为L,则图像中不同颜色的物体,就对应特征空间上不同的聚类。彩色图像映射到特征空间L后,再结合像素在图像中的位置,即空间信息(X,Y),就能得到每个像素在5维特征空间中的值,即(X,Y,L*,U*,V*)。其中,L*表示图像的亮度,U*和V*分别表示色差。在此基础上采用聚类算法,就可以吧空间和颜色欧式距离相近的点归为一类,从而实现彩色图像的分割。

确定算法的和函数及带宽后就可进行基于空间与颜色域的均值滤波过程,即均值漂移书案发的主题部分。对于算法的多尺度实现方法,有效确定不同尺度的算法合并位置,并对前期处理的中间结果进行存储,建立或更新影像的尺度层次关系,可有效避免同一影像、同一参数在不同分割时的重复性工作,达到提高分割效率的目的。多尺度分割的实现过程中,确定不同尺度的合并序列{M1,M2,...,Mn},并在滤波结果的基础上进行迭代,通过对滤波结果的存储能够达到多尺度分割过程的尺度M。[1]

2 构建区域结构体

2.1 标记矩阵

在Matlab中通过函数实现图像区域中灰度值小于阈值的点的合并。

首先设置与影像像元个数相同的区域结点,根据像元个数与影像维数建立各个区域的模式。将影像的类别标记矩阵的初始值设定为-1,并建立判别像元是否已经被访问过的逻辑型标记矩阵。

为方便处理,将图像波段邻域转化为由中心位置与周围相邻的八个位置共同组成的九维矩阵,从而建立判别图像位置关系的邻域矩阵,同时建立与之相对应的位置索引矩阵。

将LUV小于指定阈值的像元标记为同一区域来获得非连通图的极大连通分量。顺序扫描所有顶点,利用判别矩阵判断该点是否已经被访问,如果没有,则访问这个连通分量。

确定连通区域的过程中,对每一定点采用广度优先搜索方法,建立访问标记矩阵,将当前点取进队列,获得当前处理点对应的行列坐标,从队列中退出顶点,获得连通的邻域位置索引集合,如果当前点未访问过且未被其他区域标记,则当前点进入队列。搜索的同时更新访问判别矩阵的标记和类别标记矩阵,并完成对区域的编号。

2.2 区域邻接图

依据区域标记矩阵,获得每个结点的边。统计计算当前点的标号与右、下、右下、左下的标号是否相同来确定区域邻接关系,判定完毕后进行排序,将重复的区域消除。最后完成对邻域信息的更新。

3 特征提取

3.1 获取DNVI

DNVI是植被影像解译的重要参考,其计算方法如下:

其中NIR代表近红外波段,R代表红波段。

表1 TM影像DNVI值Tab.1 DNVI of TM image

3.2 获取其他属性特征

使用Matlab中的regionprops函数提取由分割影像构建的标记矩阵所标记的各个区域的面积 (Area)、存储区域像素的索引下标(PixelIdxList)等属性特征。

将DNVI值与源影像一起构造线索特征集合,并计算区域光谱及NDVI均值集合和区域光谱及NDVI方差集合。

最后选择所有特征,包括波段区域的光谱均值、NDVI均值、光谱方差、NDVI均方差、面积记性数据范围归一化。

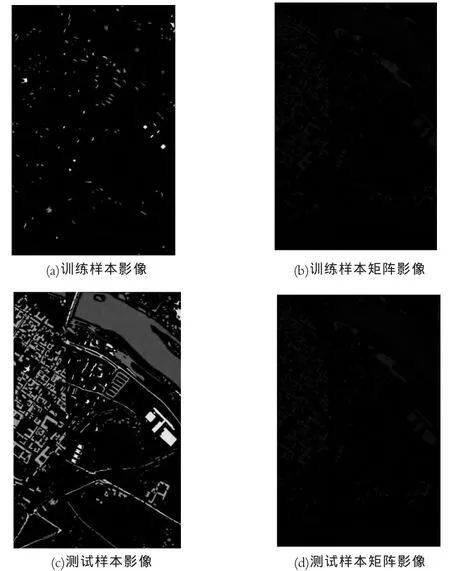

4 生成样本矩阵

对预先生成的训练样本影像和测试样本影像生成训练样本矩阵和测试样本矩阵,以用于分类和结果检验。其分类的依据是根据各类别样本在影像中所对应的亮度值不同。

图1 样本影像及其样本矩阵Fig.1 Sample Image and Sample Matrix

5 生成训练样本集

读取训练样本矩阵,对各类样本建立对应的训练区域标号和区域特征,获得每个类别所有训练样本的区域编号。遍历样本点,考察其类别是否为空,若为空则添加类别,同时比较源影像与训练样本之间的相似程度,为影像分类做准备。

6 分类器计算

采用最小距离分类器对源影像进行分类,先计算每个类别的均值,再调用分类函数,获得每个区域的类别变换。最小距离分类器的原理很简单,即计算每个区域到训练样本各类别的距离,然后取其最小值为区域分类。计算距离的实现方法为:

其中d为所求距离;M为与模式矩阵x列数相同的矩阵,其行为类别均值向量的集合;x为模式矩阵;W为样本个数。

7 结果分析与精度评价

7.1 建立混淆矩阵

读取测试样本的样本矩阵,提取测试样本的个数,遍历样本,查找标记类型为u而测试类型为v的样本个数,从而建立混淆矩阵。

表2 混淆矩阵Tab.2 confusion matrix

7.2 计算总体精度

混淆矩阵对角线位置的元素代表判别正确的对象个数,将其求和后与总体测试样本个数相比,得到总体精度。

7.3 计算Kappa系数

把测试样本总数乘以混淆矩阵对角线的和,再减去某一类中测试样本总数与该类中被分类样本总数之积对所有类别求和的结果,再除以样本总数的平方减去某一类中测试样本总数与该类中被分类像元总数之积对所有类别求和的结果所得到的。其公式如下:

其中^K是Kappa系数,r是混淆矩阵的行数,xii对角线上的值,xi+和x+i分别是第i行的和与第i列的和,N是样本总数。

7.4 用户和生产者精度

生产者(制图)精度:指假定地表真实为A类,分类器能将一幅图像的像元归为A的概率,即混淆矩阵对角线元素与其所在行元素和的比;用户精度:指假定分类器将像元归到A类时,相应的地表真实类别是A的概率,即混淆矩阵对角线元素与其所在列元素和的比。

[1]沈占锋,骆剑承,胡晓东,孙卫国.高分辨率遥感影像多尺度均值漂移分割算法研究[J].计算机研究与发展,2012,35(3):313-316.Shen Z F,Luo J C,Hu X D,Sun W G.Researchof Multiple Dimensioned Mean Shift Segmentation Algorithm for High Resolution Remote Sensing Image[J].Geomatics and Information Science of Wuhan University,2012,35(3):313-316.

[2][美]Rafael C.Gonzalez,Richard E.Woods,Steven L.Eddins.冈萨雷斯数字图像处理(MATLAB 版)[M].阮秋琦,等,译.北京:电子工业出版社,2005:367-36.