一种基于二值图角点匹配的台标识别方法

金 阳,程江华,任 通,库锡树

(国防科技大学电子科学与工程学院,湖南 长沙 410073)

电视视频中的台标包含了台名、信号来源、节目类别等信息,可作为检索、识别未知视频的重要依据,在视频信息导航、安全等领域应用广泛。在海量视频库中,台标可作为检索工具,将视频节目进行分类;在视频安全监控中,台标可作为重要的特征,监测播放内容的合法性;在视频转播中,识别替换原始台标,避免出现两个台标的情况[1]。研究台标自动识别的意义在于设计一种能够在视频序列中有效检测、提取和识别台标的方法,提高电视视频监测效率,为后续的视频分析、理解和检索工作提供重要信息。

按照状态的不同,台标可分为静态和动态两种,当前绝大多数台标是静态的。根据透明度不同,台标又分为不透明和半透明标两种[1]。针对静态台标识别问题,Ozay等[2]提出一种基于平均时间边界和支持矢量机(SVM)的台标识别方法,能够有效提取不透明和半透明台标区域和实现台标的识别,但在单独台标区域获取以及描述的过程中计算复杂。杨强等[3]提出了台标区域分割及小波特征参数提取算法,并利用小波参数匹配实现台标识别,但存在准确率不高的问题。史迎春等[4]采用HSV空间彩色直方图方法对台标特征进行描述,并采用知识库辅助直方图统计的方法进行台标识别。该算法使用遍历识别,随着知识库中台标数量的增加,计算效率会逐步下降,且对半透明台标识别效果不是很理想。

本文针对当前占绝大多数的静态台标识别和匹配存在的问题,如台标区域提取和描述复杂,实时台标图像匹配准确度不高等,提出一种基于二值图像角点匹配的识别方法,该方法可有效解决不透明和半透明静态台标的识别和匹配问题。

1 系统总体设计

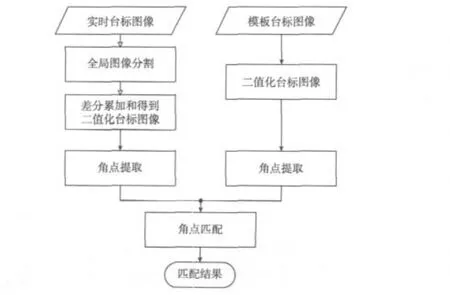

本文提出的基于二值图像角点匹配的台标识别方法的系统流程图如图1所示。

图1 系统流程图

具体的台标识别和匹配方法主要分成3个阶段:在台标分割阶段,运用二值化的视频图像差分累加和取平均分割的方法,获得台标图像区域;在台标图像角点提取阶段,充分利用Susan角点提取算法中不涉及梯度运算这一特性,在二值化的分割图像上实现Susan角点提取方法;在台标图像角点匹配阶段,利用极坐标域条件下,图像角点对于灰度、对比度、旋转、镜像和尺度缩放等具有不变性的优势,结合角点对的匹配思想,综合利用极坐标和有效差值方法,对视频图像中的实时台标进行匹配。

2 台标识别和匹配

2.1 关键帧提取和台标模板图像分割

直接对电视视频图像全图进行台标搜索,计算量大,且复杂度高。根据先验知识,目前绝大多数的电视台标位于图像画面的左上角或右上角区域,可以直接选取视频图像左上角或右上角长宽均为原始图像四分之一大小的图像区域作为待分割的区域,所以在对台标图像进行分割前,进行台标图像区域提取,可以有效减少后续方法的计算量。

在关键帧提取阶段,由于视频图像帧总数较大,实验中用到的视频分辨率为720×576,时长4分52秒,其容量为117 Mbyte,图像帧总数达到了5万多帧。针对大容量图像帧视频,可以直接采用镜头方法提取图像关键帧,规定从一段视频中所要获得的图像帧数,每隔相同数量的图像帧数进行采集。

目前台标分割主要采用对关键帧进行差分处理,并与人工设定的阈值比较进行分割,结果受阈值的影响较大。本文采用Otsu图像自动分割方法[5],获得二值化台标图像,在二值台标图像上进行差分累加求和取平均的方法,避免了灰度图像阈值选取的问题。

对实时台标图像进行全局阈值分割以后,一般不能得到只含有单个台标图形的二值化图像,可能同时包含其他非目标成分。本文采用多幅不同关键帧的全局阈值分割图像相叠加求平均的方法,其累加取平均的结果是在台标的区域所得的值仍然是1(白色),而非台标部分均值则小于1,以1为阈值,得到二值图像分割结果。图2a为对湖南卫视一段视频的关键帧图像进行的二值化处理后的结果,图2b为对得到的二值化图像进行差分累加取平均,再进行阈值分割得到的单个台标图像。从分割结果可以看出,本文方法可以有效去除台标图像中其他干扰成分。

2.2 台标图像角点提取

图2 二值化台标模板图像分割结果

角点具有旋转不变性、受光照影响小等特点,适合作为一种判别因子,应用于特征区域变化较为频繁和明显的视频图像。台标作为一种视频图像中特殊图案的存在,其一般具有规则或者较为规则的特点,且存在较为丰富的角点信息,故对台标图像进行角点提取,并将其作为一种表示台标信息的重要特征,在复杂的视频图像中,能够为后续的台标匹配提供一种重要的特征描述。

经典的角点提取算法有 Harris[6]、Susan[7]等,其主要思想是根据像素点的灰度或梯度特征提取角点。Harris角点提取算法将由任意方向偏移引起的最小灰度变化值大于某一特定阈值的点定义为角点[8]。Susan角点提取算法检测到的角点准确度较高,并可以根据USAN区域获得角点的夹角信息,但对阈值的依赖性很大,且计算复杂。

为了避免在Susan角点提取方法中阈值选取问题以及运算的复杂性,提出一种针对台标图像的改进Susan角点提取方法,以二值图像为基础,利用Susan角点提取算法不涉及梯度运算的特性,可以有效避免角点响应函数CRF和自适应阈值选取时的复杂运算。首先我们考虑USAN区域的定义:模板内像素与模板中心像素灰度之差小于一定阈值,则认为该点与中心像素具有相同的灰度值,由满足此条件的像素组成的区域称为USAN。所以从USAN的定义可以看出Susan算子不需要一阶、二阶导数运算,而在二值图像中,模板内的其他像素只存在和中心点像素相同或相反两种情况,只要统计模板内像素点和中心点相同的像素点个数,就可以求得角点响应函数值。每个像素点对应的USAN区域计算为

式中,c是比较函数,具体计算公式为

式中:r0是中心像素点坐标;r是模板内其他像素点坐标;t是模板内像素与中心像素的差值门限。令t=0即可对模板内像素点和中心点进行比较,对比原Susan算法中n(r0)的计算式(3),虽然将灰度图像转换为二值图像,损失较多的灰度信息,但是有效避免角点响应函数(4)中算式n(r0)的复杂6次方运算以及阈值T的选取问题,g为设定的门限值。

以湖南卫视台标模板图3a为例,Harris角点提取算法,Susan角点提取算法及改进的Susan角点提取方法的实验结果如图3b至图3d所示。

图3 不同角点提取算法得到的台标图像角点

由改进的二值图像Susan角点提取方法对比传统的Harris角点提取算法和Susan角点提取算法实验结果可知,亦能够有效地提取出台标角点,较为平坦的边缘上未分布有虚假角点,在外圈圆形平坦圆弧边缘上也没有分布,而在弯折形状部分分布明显,这也符合客观实际,计算的复杂程度有所下降,且得到的角点准确性较高,能够较好地满足后续的实验要求。

2.3 台标图像角点匹配

实时视频图像在传输、保存过程中难免存在旋转、位移等形变问题,且由于视频格式转换的存在,在不同的分辨率情况下,实时视频台标图像亦可能发生尺度变换等情况。利用台标图像提取出的角点进行匹配,可以有效克服上述实时台标图像存在的问题,正确识别出台标信息。

2.3.1 极坐标角点匹配思想

传统的图像匹配方法,是直接标注两幅待匹配图像之间匹配的角点。李兆烽等[9]提出了基于对数极坐标变换的景象匹配新方法,在实时图发生任意角度旋转、亮度变化、尺度变化和Susan角点提取方法的情况下仍可以保持很高的匹配精度,由于变换具有非均匀性,处理的对数极坐标变换图的像素较少,且轴向投影是一维的,一次只需较少的匹配运算量,具有较快的匹配速度。郭明明等[10]提出了一种基于角点特征的界限圈匹配算法,特点是使用二值化图像,用角点与重心组成的星状结构来简化目标形状,在极坐标域进行表述,并使用界限圈法,得到两幅待匹配图像之间的角点对应点数和差异点数,形成匹配图像之间的相似度表述函数。魏振忠等[11]提出了基于环向特征的快速旋转不变性匹配算法,构造了环向特征投影不变量,用环向特征作匹配,摒弃了图像中心的数据,而这部分数据在转换到极坐标下时,因差值量过大极易导致误匹配,因此剔除这部分数据不但提高了匹配准确率,而且有效地提高了匹配速度。

针对视频台标这一特殊条件下的图像,若直接利用上述方法进行匹配运算,则都存在不足或缺陷。基于对数极坐标变换的景象匹配新方法,极坐标变换以后的坐标值用对数表示,然而台标图像本身较小,不适合运用对数表示;基于角点特征的界限圈匹配算法,其利用二值化图像的特点比较适合本文,但其界限圈的核心思想是直接比较实时图和模板图的角点在极坐标下的误差是否满足其所定义的界限,不具备尺度不变性;基于环向特征的快速旋转不变性匹配算法,其中心思想就是要摒弃中心区域像素,这显然在视频台标图像中应用时是不合理的,因为许多台标在中心区域很有可能存在较为丰富的角点信息,若直接摒弃,必将影响到匹配的准确度。

2.3.2 基于极坐标角点对的匹配方法

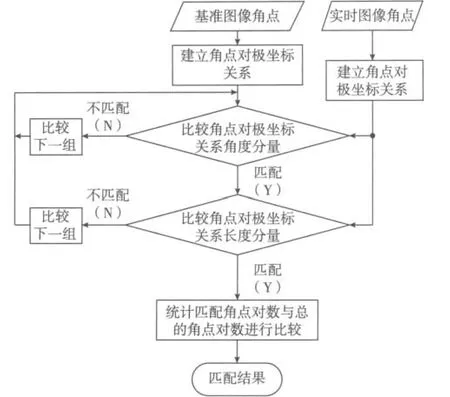

针对上述存在的问题并结合视频台标图像的特殊性,提出一种新的基于极坐标角点对的匹配方法,其流程如图4所示。

图4 基于极坐标角点对匹配流程图

传统的图像匹配方法,是直接标注两幅待匹配图像之间匹配的角点,而本文综合利用极坐标和有效差值的角点对匹配方法,不是直接比较实时图和模板图中具体哪两个角点是否匹配,而是以角点对的形式进行比较,通过计算成功匹配的角点对数在所有角点对中所占的比例来判断实时台标和模板台标之间的匹配程度。在实时图和模板图中,以任意三个角点作为一个角点对,在这个角点对中,形成极坐标下的长度分量和角度分量,具有很好的旋转不变性和抗尺度缩放性能。

具体步骤如下:

1)利用二值化台标图像进行改进的Susan角点提取,得到模板图角点,令其为ci(i=1,2,…,n ),其中n为模板图角点的个数,取其中第一个角点c1;

2) 遍历角点ci(i=2,3,…,n),建立基底 rc1ci,再遍历角点 cj(j=2,3,…,n;j≠ i) ,建立基底 rc1cj;

3)令r1ij=,θ1ij为基底rc1ci和rc1cj之间的夹角,定义角度的方向以逆时针为正方向,建立极坐标形式的角点对关系(r1ij,θ1ij),如图5所示;

图5 角点对关系建立示意图

4)再取下一个角点ck(k=2,3,…,n),依次执行步骤2)和步骤3)得到角点对的极坐标关系(rkij,θkij);

5)依次遍历实时台标图像角点对极坐标关系中的角度分量,判断是否存在满足这样的θ'kij,在模板图角点对极坐标关系中能够找到这样的θkij,使得θ'kij∈θkij×(1±δθ) ,δθ是一个较小的常量;

6)若在遍历的过程中找到了这样的θ'kij,就继续比较实时图和模板图θ'kij和θkij分别对应的长度分量r'kij和rkij,判断这两个分量是否满足条件r'kij∈rkij×(1±δr),若满足条件,标记角点对(k,i,j)为1,否则标记为0;

实验证明这种不是直接比较具体哪两个角点之间是否匹配,而是以成功匹配角点对在所有模板角点对中所占的比例作为匹配与否的判决条件的方法的有效性。

3 实验结果及分析

首先为了验证本文方法的有效性,设计实验1和实验2两个实验;同时,针对视频图像在传输、保存过程中存在的旋转、变形等形变问题,在不同的分辨率情况下,实时台标图像发生尺度变换等情况,设计实验3和实验4两个实验。

实验1:不同电视台实时图分别与湖南卫视模板进行匹配,实验结果如表1所示。

表1 不同模板台标间匹配结果

由实验1结果可知,只有相应的电视台标实时图与模板图之间才能达到较高的匹配精度。

实验2:各电视台实时台标与各自模板台标进行匹配,实验图和实验结果如图6和表2所示。

由实验2结果可知,随着角点数目的增多,匹配精度会随之提高,同时增加运算的复杂程度。

图6 不同电视台的二值化台标模板(左)和实时图像(右)

表2 不同模板台标与实时台标匹配结果

结合实验1和实验2的数据,很好地证明了该方法在实时台标图像匹配中的有效性,相同的实时台标图像匹配的精度很高,不同的实时台标图像匹配的精度较低,且只有在和自身实时台标图像相同的模板台标图像进行匹配时,才能够达到一个比较高的匹配精度。进一步证明了通过计算匹配的角点对数在所有模板角点对中所占的比例作为实时台标和模板台标之间的匹配率这种方法的有效性。

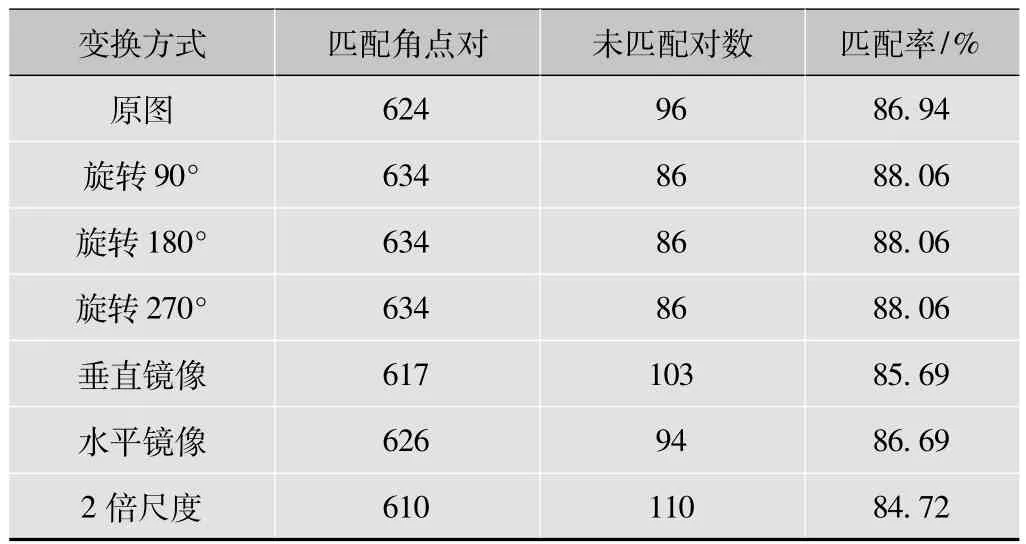

实验3:以湖南卫视台标模板图为例,不同条件变换下与变换前进行匹配,实验结果如表3所示。

表3 模板台标变换前后角点匹配结果

由实验3结果可知,模板台标的匹配精度受旋转、镜像翻转、尺度缩放等的影响很小。这里直接用模板图像进行变换后作为一组实验进行检测,用来检验在标准台标图像的条件下,变换以后角点匹配所能够达到的一个匹配率,进一步验证了本文方法的有效性。

实验4:以湖南卫视台标为例,实时图像变换后与模板图像进行匹配。这种情况模拟实际实时视频图像,实时视频受传输、保存以及分辨力不同等各方面影响,其台标可能发生旋转、缩放、尺度变换等形变。实验结果如表4所示。

表4 实时图像变换后与模板台标的匹配结果

由实验4结果可知,实时图像和模板图像在旋转、镜像翻转、尺度缩放等变换的条件下,依然能够实现很高的匹配精度,与原实时图像和模板图像匹配的精度相比较,误差在允许的范围内,由此验证了本文方法在模拟实际情况下对实时台标图像识别和匹配的有效性。

4 小结

实时视频台标图像由于各种原因,造成与模板台标图像之间存在各种形变,如尺度缩放、旋转等,针对这些问题,本文提出一种基于二值图像角点匹配的三步骤台标识别方法,方法有效可行。在台标分割阶段,运用二值化的视频图像差分累加和取平均分割的方法,获得台标图像区域;在台标图像角点提取阶段,充分利用Susan角点提取算法中不涉及梯度运算这一特性,在二值化的分割图像上实现改进的Susan角点提取方法;在台标图像角点匹配阶段,利用极坐标域条件下,图像角点对于位移、灰度、对比度、旋转、镜像和尺度缩放等具有不变性的优势,结合角点对的匹配思想,综合利用极坐标和有效差值方法,对视频图像中的实时台标进行匹配,得到了较好的结果。

[1]OZAY N,SANKUR B.Automatic TV logo detection and classification in broadcast videos[C]//Proc.of 17th European Signal Processing Conference.Glasgow,Scotland:[s.n.],2009:839-843.

[2]OZAY N,SANKUR B.Automatic TV logo identification[C]//Proc.IEEE 16th Signal Processing Communication and Application Conference.[S.l.]:IEEE Press,2008:1-4.

[3]杨强,程玉昆,马森.基于小波特征的台标识别[J].计算机应用与软件,2009,26(3):63-64.

[4]史迎春,周献中,方鹏飞.综合利用形状和颜色特征的台标识别[J]. 模式识别与人工智能,2005,18(2):217-222.

[5]GONZALEZ R C,WOODS R E,EDDINS S L. 数字图像处理:MATLAB版[M].阮秋琦,译.2版.北京:电子工业出版社,2005.

[6]HARRIS C,STEPHENS M.A combined corner and edge detector[J].Proc.of fourth Alvey Vision Conference.[S.l.]:Plessey Company,1988:189-192.

[7]SMITH S M,BRADY M.Susan-a new approach to low level image processing[J].International Journal of Computer Vision,1997,23(1):45-78.

[8]唐永鹤.基于特征点的图像匹配算法研究[D].长沙:国防科学技术大学,2007.

[9]李兆烽,李言俊.基于对数极坐标变换的景象匹配新方法[J].红外与激光工程,2008,36(2):285-288.

[10]郭明明.形状匹配及其在剪纸中的应用研究[D].桂林:广西师范大学,2007.

[11]魏振忠,雷鸣,张广军.基于环向特征的快速旋转不变性匹配算法[J]. 光学技术,2009,35(2):284-287.