基于双目视觉的触摸技术研究*

朱丽进 ,吴建国 ,2,郭 星 ,李 炜 ,2,刘 君

(1.安徽大学 计算智能与信号处理教育部重点实验室,安徽 合肥 230039;2.安徽大学 计算机科学与技术学院,安徽 合肥 230039)

基于双目视觉的触摸技术研究*

朱丽进1,吴建国1,2,郭 星1,李 炜1,2,刘 君1

(1.安徽大学 计算智能与信号处理教育部重点实验室,安徽 合肥 230039;2.安徽大学 计算机科学与技术学院,安徽 合肥 230039)

设计了一种基于双目视觉技术的触摸屏实现方法,采用两个普通摄像头作为传感器实时捕捉触摸物的存在及其动作,并利用计算机视觉技术实现对普通显示屏幕的虚拟触摸功能,使其具有单击、双击、拖动以及多点触摸等功能。

计算机视觉;触摸屏;图像处理;人机交互;序列图像

触摸是人类最简单和最本能的行为之一,触摸屏技术方便了用户对计算机的操作。与鼠标、键盘、手写板相比,触摸屏技术实现了人机互动的最简单、最直接的方式。尤其是近年来iphone手机风靡全球,使得“多点触摸”成为另一热点话题。它将进一步推进触摸屏的流行,同时也将推升多点触控功能的深入人心。但目前对于超大触摸屏硬件实现成本很高,多点触摸技术还不成熟。因此,触摸行业仍有很大的提升空间,具有十分广阔的研究前景。

用软件代替昂贵的硬件从而降低成本将成为可能,计算机视觉技术成为首选。基于视觉的手势交互领域中存在许多困难和挑战[1],如复杂背景和光照变化的影响、人手快速运动的变形、手指之间的相互遮挡等,这无疑使得精确的图像分隔和特征提取成为难点[2]。为降低视觉处理的复杂性,人们用特殊标记手套等辅助工具来获取手的位置和方向[3]、手部自然色信息进行特征提取[4]、利用三路或四路摄像头分组获取图像,从而定位手指[5]等,以实现人机交互。

本文提出了一种新的基于双目视觉的手指屏幕交互方法。该方法主要采用两个摄像装置来构建,通过对获取的双图像进行分析,并计算触摸点位置和定义触摸的过程。

1 系统概述

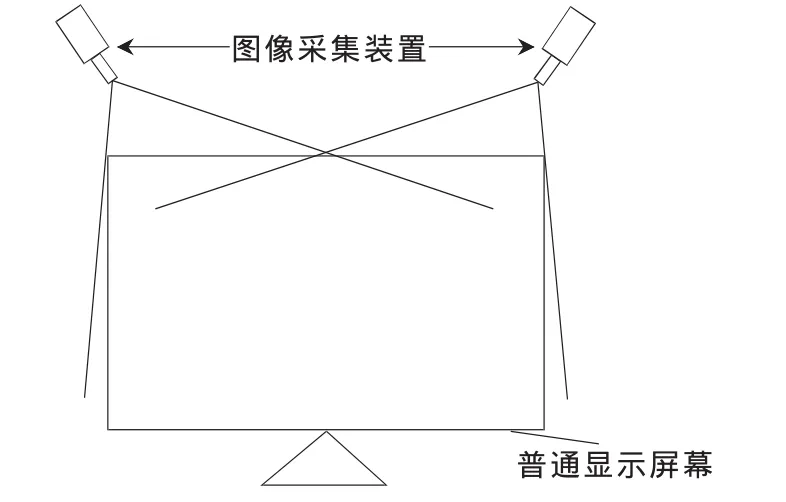

基于双目视觉技术来[6]实现对普通显示屏的触摸功能,系统主要由两个一维图像采集装置(摄像头)、普通显示屏幕和计算机识别定位软件三部分组成。系统装置参考图如图1所示。

两个图像采集装置安装在显示屏幕的同侧任意位置,但要保证两者的视角范围覆盖整个显示屏幕。在每个图像采集装置获取到的一维图像中,显示屏幕均以一条直线形式呈现。构建一个虚拟的触摸屏平行于显示屏幕的正前方,当触摸物接触到虚拟触摸屏就能立即被摄像头捕捉到。在一维图像显示屏幕的直线上会有点出现,进而用识别定位软件进行转换处理,为虚拟触摸屏中的二维坐标,并完成相应的触控操作,以此来实现人机交互功能。系统实现原理示意图如图2所示。

图1 系统装置参考图

图2 系统实现原理示意图

2 系统标定

系统标定的目的是分别确定两个摄像头的图像坐标系与屏幕坐标系之间的映射关系[7]。本文的屏幕坐标系是指显示器用于图像显示的坐标系,本实验选用的是47英寸液晶电视机作为显示屏幕。

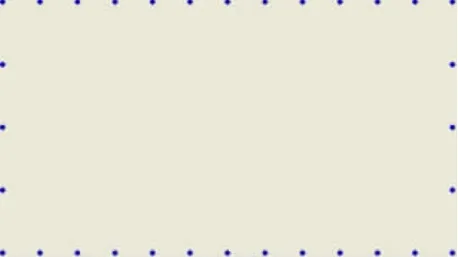

在显示屏幕的每边上逐一显示如图3所示的若干个均匀分布的参考点,一旦有接触物接触显示屏幕,分别由两个摄像头采集这组点在图像中的位置,计算机记录下图像坐标与屏幕坐标的对应关系(x1)(x2)⇔(x,y)。其中,x1和x2分别为两个摄像头采集的一维图像中的坐标,(x,y)为对应的虚拟触摸屏四边上的二维坐标。

图3 用于标定的参考点

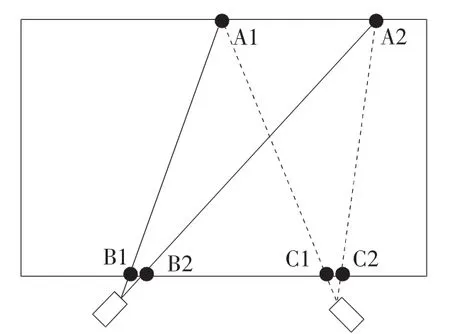

本系统的摄像头安装在屏幕的下边沿两角上。摄像头逻辑坐标的确立是在坐标映射之后自动完成的,默认采用的是屏幕上边沿中间和右上角两个参考点A1和A2,利用二分法查找[8]并确定屏幕下边的对应参考点B1和B2,连接参考点A1和B1获得屏幕内的左下角摄像头的一条直线,连接参考点A2和B2获得另一条直线,两条直线相交,获得左下角摄像头的逻辑坐标。同理,可以确定右下角摄像头的逻辑坐标。摄像头逻辑坐标确立方法如图4所示。

图4 摄像头逻辑坐标确立方法

3 触摸定位和动作判定

3.1 触摸定位

在摄像头采集到的一维图像上,整个虚拟触摸屏显示为一条直线段;触摸物在虚拟触摸屏上的点击显示为在直线段上出现的一个点;触摸物在虚拟触摸屏上的运动显示为点在直线段上的移动。在两个摄像头采集的两幅图像中直线段上的点和二维虚拟触摸屏四边上的点存在一一对应的关系。

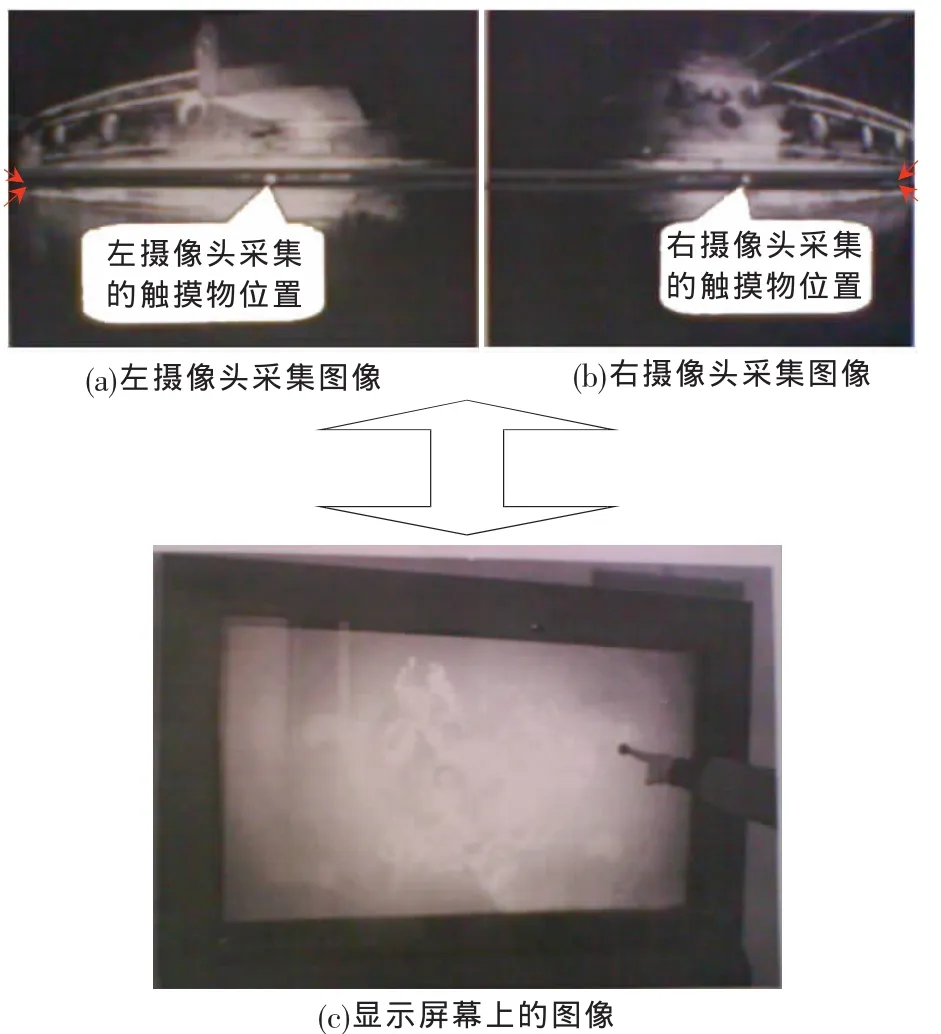

当触摸物在显示屏幕上任意一X处进行触摸时,其在两个摄像头采集的图像直线段上有对应位置X′和X″。根据坐标映射已知的一维图像坐标与二维屏幕四边上坐标的对应关系,可获得与X在两个摄像头的图像直线段上位置相同的屏幕边上的点Y1和Y2。连接Y1和已知的左下角摄像头以获得屏幕内的过触摸点X的一条直线,连接Y2和已知的右下角摄像头以获得屏幕内的过触摸点X的另一条直线,两条直线相交,得到的就是触摸点的坐标,从而完成触摸物的定位。图5(a)、(b)为左右两个摄像头采集的图像,中间区域为虚拟触摸屏的一维图像线阵,图5(c)为显示屏幕上的图像,亮点为对应的坐标位置。

图 5 触摸物坐标定位示意

3.2 动作判定

动作判定包括单击、双击、移动和多点触控动作等。设 P1,P2,…,Pn为 n 幅序列图像[9],若对于所有的 i、j,满足 1<i<j<n,并且 P1,P2,… ,Pi-1与 Pj+1,Pj+2,… ,Pn中有触摸物而Pi,…,Pj中无触摸物,则认为触摸物在此位置单击。

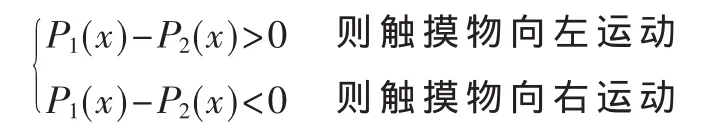

通过前后两帧的图像分析触摸物的移动方向。设前一帧中触摸物的位置为 P1(x,y),后一帧中触摸物的位置为P2(x,y)。可以根据X方向的位移大小来判断左右方向如下:

同理,可以根据Y方向的位移大小来判断触摸物体的上下方向运动。其中,坐标系左上角为(0,0)点。

通过以上类似的方法来定义为双击、拖动和多点触控等动作。

4 实验结果

本实验所使用的计算机的主频为2.0 GHz,内存为 1 GB,图像采集设备为普通的网络摄像头,显示屏幕选用的是47英寸液晶电视机。两个摄像头同步地采集序列图像,分别跟踪手指运动的轨迹,从而实现手指运动和点击操作的实时检测。实验系统的视觉处理部分速度可以达到15帧/s。实验中不断用手指在显示屏幕上任意位置点击测试,记录系统跟踪获取的触摸位置与人工标定真实值之间的对比结果。将整个显示屏幕分成5个区域,用手指点触任意位置进行测试,记录并分析测试结果如表1所示。

表1 测试结果

实验结果表明,由于受到图像采集装置角度的限制以及大屏幕显示器的长宽比约束,4个角区域的定位误差稍比中间区域大,但误差率最大不超过2个像素,整体来讲,对于显示屏幕系统可以对触摸物进行鲁棒性的跟踪,完成比较精确的触摸物定位,迅速响应点击操作,从而有效地实现了人机交互的功能。并且系统抗干扰能力强,在环境光照发生很大变化时也能很好地运行。

本文介绍了一种新的基于双目视觉技术的触摸屏实现方法,通过触摸物在显示屏幕上的移动和点击很好地完成人机交互操作。该方法使用两个普通摄像头来实现,摄像头只要求安装在显示屏幕的四周,获取整个显示屏幕呈直线就可以,其逻辑坐标完全是通过触摸物点击屏幕进行坐标映射后自动完成的。本文有效地避免了手指的互相遮挡等问题,使得实时鲁棒的触摸点跟踪和动作的判定成为了可能。而且对周围光照等没有严格的要求,可以应用在多种人机交互、信息展示以及娱乐场所。

目前,本系统实现了触摸物的定位和点击功能,今后如何有效地定义右击、并且区分单击、双击,以及如何有效地对多点触摸物进行定位和动作上的判定,尤其是多点的识别区分是难点等,还有待进一步深入研究,以构建更加强大、更人性化的人机交互系统。

[1]侯义斌,陈晨.视觉交互系统中的目标检测与运动分析[J].计算机工程与应用,2004,40(27).

[2]PAVLOVIC V I,SHAMA R,HUANG T S.Visual interpretation of hand gestures for human computer interaction:a review[J].IEEE Transaction on Pattern Analysisand Machine Intelligence,1997.19(7):677-695.

[3]ULHAASK D,SCHMALSTIEG D.Fingertrackingfor interaction in augmented environments[C].Proceeding of the 2nd ACM/IEEE InternationalSymposium on Augmented Reality,New York,USA,October 29-30,2001.

[4]HALL D,GAL C L,MARTIN J,et al.Magicboard.a contribution to an intelligent office environment[J].Robotics and Autonomous Systems,1999,35(3-4):211-220.

[5]王德鑫,张茂军.四路摄像头分组重建的多触点定位方法[J].电子与信息学报,2010,32(2).

[6]周亦鹏.双目视觉技术在计算机辅助检测中的应用研究[J].计算机测量与控制,2008.16(5).

[7]于舒春,朱延河,闫继宏.基于新型双目机构的立体视觉系统标定[J].机器人,2007,29(4).

[8]冼允廷,路小波,施毅.基于投影二分法的车牌字符分割方法[J].交通与计算机,2007,25(5).

[9]孙艳忠,柴毅,尹宏鹏.基于边缘检测与改进最大类间方差法的火箭序列图像分割算法[J].计算机应用,2009(11).

The touch technology research based on binocular vision

Zhu Lijin1,Wu Jianguo1,2,Guo Xing1,Li Wei1,2,Liu Jun1

(1.Key Laboratory of Computing& Signal Processing,Ministry of Education,Anhui University,Hefei 230039,China;2.Computer Science and Technical Institute,Anhui University,Hefei 230039,China)

This article has designed an implementation method of touch screen based on binocular vision technology.It mainly adopts two ordinary cameras as sensors to capture the existence of the touch material objects and actions in real-time.And using computer vision techniques to achieve virtual touch functionality on the normal display screen to make it to click,double-click,drag and multi-touch capabilities.

computer vision;touch screen;image processing;human-computer interaction;image sequences

TP391.41

A

1674-7720(2011)01-0026-03

安徽省教育厅重点科研项目(kj20100A023)

2010-08-04)

朱丽进,女,1986年生,硕士研究生,主要研究方向:图像处理。

吴建国,男,1954年生,教授,博士生导师,主要研究方向:中文信息处理,数字系统 EDA/CAD,智能识别技术。