改进YOLOv5 模型在自然环境下柑橘识别的应用

摘要:在复杂的自然环境中绿色柑橘生长形态各异,颜色与背景色相近,为有效识别绿色柑橘,提出一种基于混合注意力机制并改进YOLOv5模型的柑橘识别方法。首先,改进YOLOv5的网络结构,在主干网络中添加混合注意力机制,即在主干网络中的第2层嵌入SE(squeeze and excitation)注意力,第11层嵌入CA(coordinateattention)注意力;其次,改进网络模型特征融合结构,将YOLOv5模型Concat特征融合操作的下层分支放在模型C3模块之前,再与另一条上层分支进行特征融合;最后,改进模型分类损失函数,将YOLOv5模型的分类损失函数改成Varifocal Loss函数,加强绿色柑橘特征信息的提取,提高绿色柑橘检测精度。根据自然环境和柑橘自身的特点,对自建数据集进行分类,设计3组不同分类场景下柑橘的对比试验以验证其有效性。试验结果表明,改进后的YOLOv5-SC模型准确率为91.74%,平均精度为95.09%,F1为89.56%,在自然环境下对绿色柑橘的识别具有更高的准确率和更好的鲁棒性,为绿色水果智能采摘提供技术支持。

关键词:目标检测;YOLOv5;注意力机制;损失函数;绿色柑橘

doi:10.13304/j.nykjdb.2022.0994

中图分类号:S126;S225.93 文献标志码:A 文章编号:1008‑0864(2024)07‑0111‑10

中国是柑橘的重要原产地,柑橘资源丰富,品种优良繁多,表皮颜色分为黄色和绿色[1‑2]。传统的水果采摘仍以人工作业为主,随着人工智能技术与中国农业高质量发展,柑橘类果实的采摘方式逐渐转向智能化。智能果实采摘机器人能有效节约劳动力成本,满足实际生产需要,促进农业的智能化发展[3-5]。

机器视觉技术是实现农业智能化采摘的关键技术之一,它能利用算法对相机等设备采集到的图像进行分析,替代人眼检测与定位。随着深度学习技术的发展,以Faster RCNN、YOLO(you onlylook once)为代表的深度学习算法模型相继出现[6],使机器视觉技术在农业智能采摘、果实识别、产量预估、病虫害检测等方面发挥着重要的作用。但绿色柑橘与自然背景颜色相似,且生长形态各异,识别时易受到枝叶遮挡、果实重叠、天气变化等自然环境因素的影响[7‑8]。因此,如何实现自然环境下绿色柑橘的准确识别是亟待解决的重要问题。

利用机器视觉技术对柑橘进行了智能化检测。Wang 等[9] 基于局部二值模式(local binarypatterns,LBP)特征研发一种自适应AdaBoost分类器,对绿色柑橘识别的准确率达到85.6%。Lu等[10]基于LBP特征和层次轮廓提出一种未成熟柑橘检测方法,准确率达到82.3%。Gan等[11]通过主动热成像系统来检测未成熟的柑橘类水果,并根据主动热成像系统构建深度学习模型,平均精度达到87.2%。韩文等[12] 提出Tiny-Dense-YOLOv3 网络模型,采用卷积层替换Tiny的池化层以减少目标信息丢失,并借鉴DenseNet网络在Tiny网络中嵌入2个层密集块,最终准确率达到88.98%。Zheng等[13]利用多尺度卷积神经网络检测自然环境中的绿色柑橘,最终模型的平均准确率达到91.55%。陈文康等[14]通过改进YOLOv4网络模型对果园柑橘进行检测,对先验框的选择和损失函数进行优化,同时利用密集连接形成多尺度融合,该模型对果园环境下不同生长期柑橘检测的准确率达到良好的效果。黄彤镔等[15]在YOLOv5网络模型的基础上,引入CBAM(convolutional block attentionmodule)注意力机制,并用α-IoU 损失函数替代GIoU损失函数作为边界框损失函数来检测柑橘果实,平均精度达到91.3%。

绿色柑橘是柑橘类果实的重要组成部分,其营养价值丰富,但绿色柑橘生长环境复杂,颜色与背景相近,果实数量、形态等具有多样性,识别难度较大。智能采摘机器人作业过程中,对果实更准确地识别和定位是主要难点[16]。因此,本文提出一种改进YOLOv5模型,对自然环境下柑橘进行识别。该模型采用混合注意力机制,将通道注意力SE(sequeeze and excitation)[17]和协同注意力机制CA(coordinate attention)[18]融入模型的主干网络,改进模型的特征融合连接结构和分类损失函数,引入Varifocal Loss[19]分类损失函数,可实现自然环境下绿色柑橘的有效识别,为绿色水果智能采摘技术提供支持。

1 材料与方法

1.1 柑橘图像采集与分类

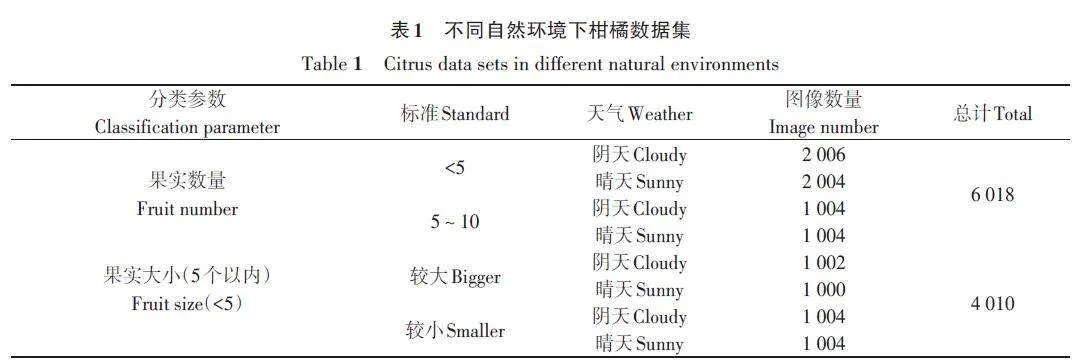

柑橘图像的采集地点位于广西壮族自治区桂林市灵川县九屋镇。采集设备为三星S10手机,图像的分辨率为4 032 像素×3 024 像素(大小约3.9 MB),保存格式为JPEG。拍摄时天气条件为晴天和阴天,共采集柑橘图像6 018幅。对采集到的柑橘图像按果实数量和大小进一步分类,得到柑橘数据集(表1)。

1.2 数据预处理

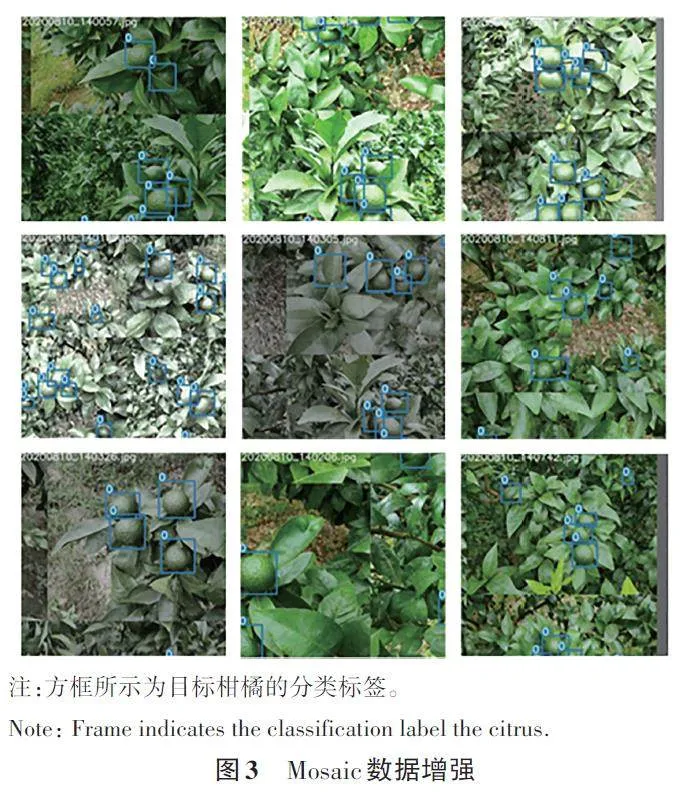

YOLOv5 模型利用Mosaic 对数据进行增强,能保证图像样本的均衡性。Mosaic随机选取4幅图像进行预处理,将其拼接到1幅图上进行训练,该方法不需要增加最小批次的大小,可以直接计算4幅图像的数据,能有效拟合训练集中的图像,减少GPU(graphics processing unit)的使用率,使模型的鲁棒性更好。

1.3 自然环境下的绿色柑橘检测模型

1.3.1 YOLOv5 模型

YOLOv5 模型的主干网络主要分为Focus模块和C3模块,Focus模块在图像进入主干网络之前对图像进行切片操作,将图像相邻的4个位置进行堆叠,把高分辨率的特征图拆分成多个低分辨率特征图,实现下采样的同时减少计算量,提升网络速度。C3 模块通过改进BottleneckCSP[20]模块,使其结构比BottleneckCSP少1个卷积层,模型体积变小。特征融合后,卷积模块中的激活函数替换成SiLU函数,检测性能不断增强。Neck 中采用了FPN(feature pyramidnetworks)[21]与PAN(path aggregation network)结合的结构,其主要思想来源于PANet(path aggregationnetwork)[22]网络结构。FPN是一种自顶向下的结构,将下层特征与上层特征连接,再与自底向上的特征金字塔结合,增强模型的语义信息。模型检测(predict)采用CIOU_Loss[23]作为边界框损失函数,网络共输出3个尺寸的特征图,用于检测不同尺寸的目标对象,最后生成的图像通过预测的边界框和类别进行标记。

1.3.2 改进YOLOv5模型

根据自然环境下绿色柑橘的特点,对YOLOv5模型进行改进,提升自然环境下柑橘的识别效果:①在主干网络中融入混合注意力机制,即将通道注意力SE和协同注意力CA结合使用;②将模型所有Concat特征融合操作的浅层特征分支连接在C3模块之前,再与深层特征分支特征进行融合;③改进模型的分类损失函数,引入新的分类损失函数Varifocal Loss。改进后的模型如图1所示。

1.3.3 混合注意力机制

由于绿色柑橘图像与自然环境背景色相近,导致模型通道特征信息和图像的像素值有限,因此需要加强模型通道间特征信息的训练。此外,为了让模型更精准地定位和识别柑橘对象,需要加强位置感知信息的训练。

SE机制利用压缩(squeeze)操作,在深层次网络中优化学习特定类别的特征信息,再经过激发(excitation)操作,如式(1)所示。

X̂ = Xσ (ẑ) (1)

ẑ= T2 (ReLU(T1 (z ))) (2)

式中,σ 表示sigmoid激活函数,X 表示输入的特征图,X̂表示最终输出的特征图,ẑ是转换函数生成后的结果。T1和T2是2个线性变换,用来捕获每个通道的重要性,对通道间的特征进行加权后,将通道间的权值与原始特征图的特征相乘,得出新通道权值。

CA机制不仅关注了通道间的信息,同时还关注方向感知和位置感知。CA机制在水平和垂直方向,利用全局平均池化对每个通道进行编码,从而嵌入了坐标信息,得到2个特征图。将2个特征图Concat连接,使用1个共享的1×1卷积变换函数进行操作。然后沿着空间维度,分成2个独立的张量fh和fw。为了使张量的通道数相同,再利用2个1×1卷积变换分别对fh和fw进行变换,得到扩展的注意力权重gh和gw,如式(3)所示。

yc (i,j ) = xc (i,j ) × ghc(i) × gwc( j ) (3)

式中,yc (i,j ) 表示第c 个通道(i,j ) 位置处最终的输出,xc (i,j ) 表示嵌入坐标信息后的输出,ghc(i)和gwc( j ) 分别表示高度为h、宽度为w 方向上生成的协同注意力参数。

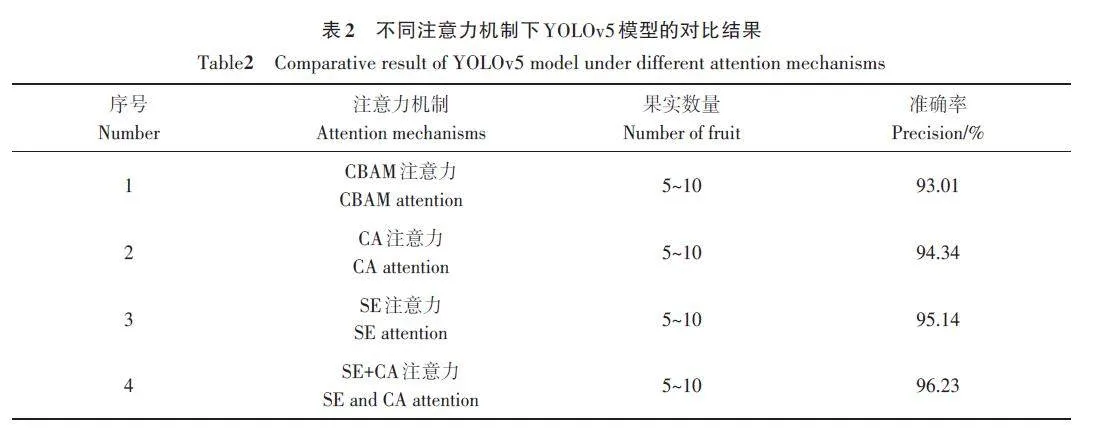

本文将2种注意力机制结合,称作混合注意力。分别将SE注意力和CA注意力机制添加到模型的第2层和第11层,不仅能捕获方向和位置信息,也能捕获通道信息,让模型更好地提取、定位柑橘图像的特征。为验证混合注意力机制的有效性,设计以下几组对比试验进行验证:①模型第2层不嵌入注意力机制,第11层嵌入CBAM注意力机制;②模型第2层不嵌入注意力机制,第11层嵌入CA注意力机制;③模型第2层不嵌入注意力机制,第11层嵌入SE注意力机制;④模型第2层嵌入SE注意力机制,第11层嵌入CA注意力机制。

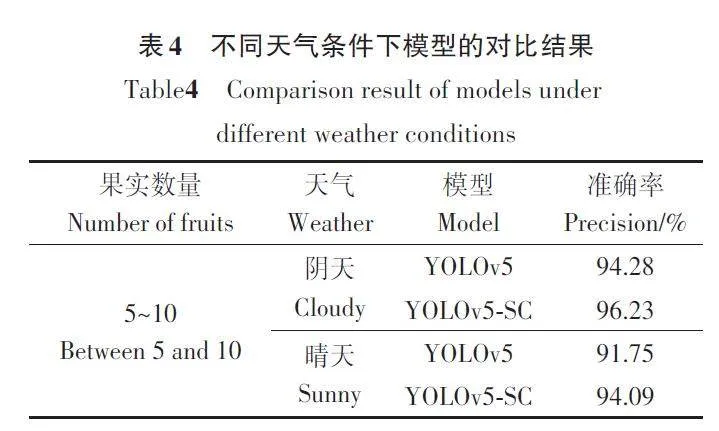

1.3.4 改进模型特征融合连接结构

卷积神经网络能更好地提取图像的特征信息,YOLOv5模型的C3模块可防止在卷积过程中产生的梯度爆炸和网络退化的问题,所以YOLOv5模型使用大量C3 结构。同时,为了丰富上下文特征信息,YOLOv5模型采用Concat方法将深层特征分支与浅层特征分支进行特征融合。但由于C3模块内部仍然存在多个卷积结构,导致模型后续特征融合时参数量过大,在特征提取过程中也容易出现特征信息丢失的问题。为减少浅层特征分支的卷积次数和特征融合时的参数量、反馈多尺度间特征的重要性及相关性,同时提高网络模型识别柑橘的性能,本文将浅层特征分支连接在C3模块之前,再与深层特征分支进行特征融合,改进后结构如图2所示。

1.3.5 改进分类损失函数

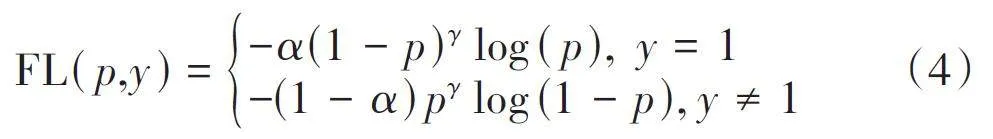

YOLOv5模型的损失函数可以分为分类损失函数和回归损失函数2类,YOLOv5模型的分类损失函数采用的是FocalLoss( FL),其定义如下。

式中,y∈{±1},表示真实类;p∈[0,1],表示前景类的预测概率;α 表示用来平衡正负样本的权重;(1-p)γ和pγ用来调整每个样本的权重;Focal Loss对于正负样本的处理相同。

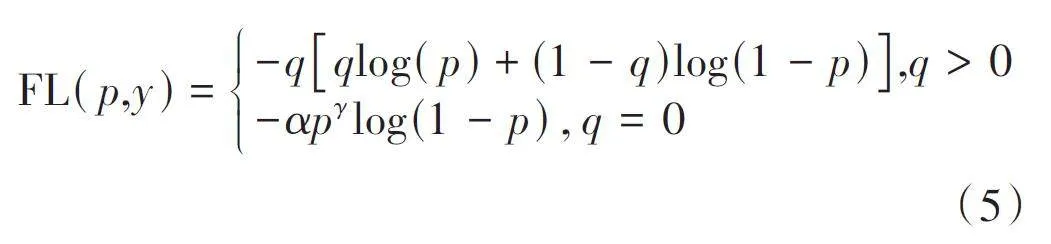

本文引入Varifocal Loss替换YOLOv5原网络模型的Focal Loss。Varifocal Loss 是在Focal Loss基础上进行改进的分类损失函数,其对于图像正负样本的处理不同,能够更加平衡柑橘图像正负样本的损失,定义如下。

式中,p 是预测的分类得分,q 是目标IoU(intersection over union)的得分,α 表示用来平衡正负样本的权重,pγ表示缩放系数。

与Focal Loss不同的是,增加q 来对正样本加权,如果正样本的真实IoU得分较高,则损失函数的权重会更大,可以使训练聚焦在质量高的样本上。由于正样本的数量较少,为了充分利用正样本的监督信息,缩放系数pγ只会对负样本进行调节。为了平衡整体的正负样本数量,使用α 对负样本进行加权。

1.3.6 试验平台及评价指标

试验硬件环境采用Intel(R) Xeon(R) CPU E5-2630 v4 @ 2.20GH 处理器,内存64GB,操作系统为Ubuntu 16.04 LST 64位,深度学习框架为Pytorch,CUDA 11.2版本,使用Tesla P40显卡对图像进行加速处理。

为验证模型的有效性,选取准确率(P)、平均精度均值(mean average precision,mAP)和调和平均数(F1)为整体评价指标,准确率表示模型预测为正样本确实为正样本的概率,平均精度均值将每个类别的平均精度(average precision,AP)计算均值,F1表示准确率和召回率(R)的调和平均数,反映模型的整体性能,计算公式如下。

式中,TP表示真正例数,FP表示假正例数,FN表示假负例数,APi 为第i 类检测准确率,N(number)为类别数量。

2 结果与分析

2.1 图像数据增强分析

柑橘图像数据集使用Mosaic 数据增强通过随机剪裁、随机缩放、随机排列等方式进行拼接,使得数据集得到有效填充,样本的均衡性更强,训练出来的模型鲁棒性更好,如图3所示。

2.2 模型优化对比分析

2.2.1 混合注意力优化分析

试验在阴天条件下5~10个柑橘的维度内进行。将SE、CBAM、CA注意力机制分别嵌入模型第11层进行对比试验,试验结果如表2所示。经验证,在第2层加入SE注意力机制后模型准确率更高,相较于单独添加CBAM、CA、SE 注意力机制,准确率分别提高了3.22%、1.89%和1.09%。

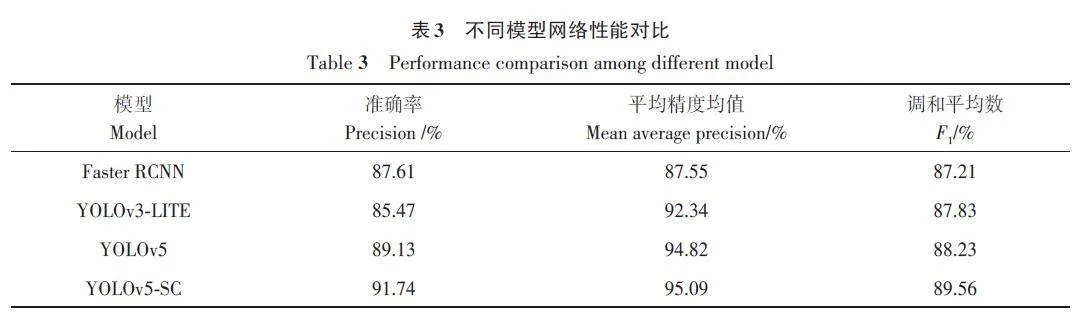

2.2.2 模型性能对比分析

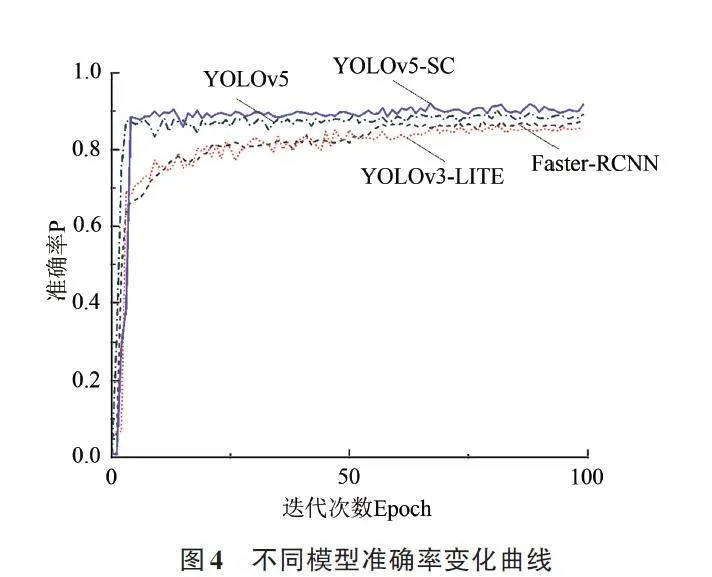

模型改进后,在整体数据集上进行验证,并将改进后的YOLOv5模型取名为YOLOv5-SC模型,不同模型的性能对比结果如表3所示。YOLOv5-SC模型准确率更高,与YOLOv5、Faster RCNN、YOLOv3-LITE网络模型相比较,准确率分别提高2.61%、4.13% 和6.27%。在平均精度均值和F1值方面也表现更好,分别达到95.09% 和89.56%。从模型准确率的变化(图4)可以看出,经过100 次迭代后,改进后的YOLOv5-SC模型准确率趋于稳定,准确率优于各对比模型。这表明YOLOv5-SC模型具有更强的柑橘检测能力。

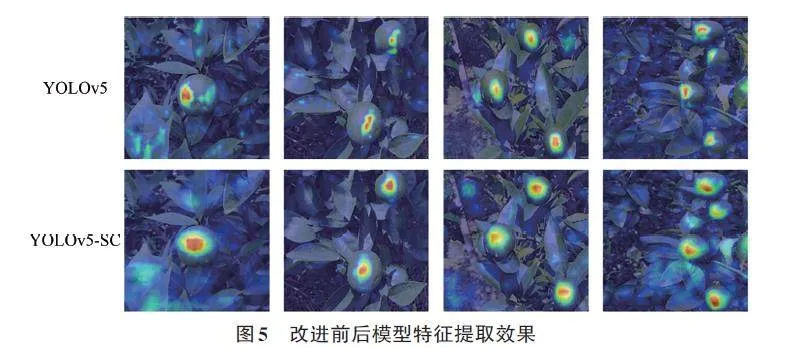

从图5可以看出,改进后的YOLOv5-SC模型能提取更多关于柑橘的特征信息,提升了自然环境下柑橘的检测效果。

2.3 不同分类场景下检测性能分析

绿色柑橘与自然背景色相似,但在实际自然环境中绿色柑橘还会受到其他复杂情况的影响。果实重叠、枝叶遮挡、天气条件变化、果实大小等复杂情形对果实采摘机器人的检测和采摘效果造成不同的影响。选取3个自然条件(天气条件、果实数量、果实大小)下的检测效果进行对比试验,从柑橘数据集中选取合适的类别,并按7∶3的比例划分训练集及测试集,以验证改进后的模型在自然环境下的检测效果。

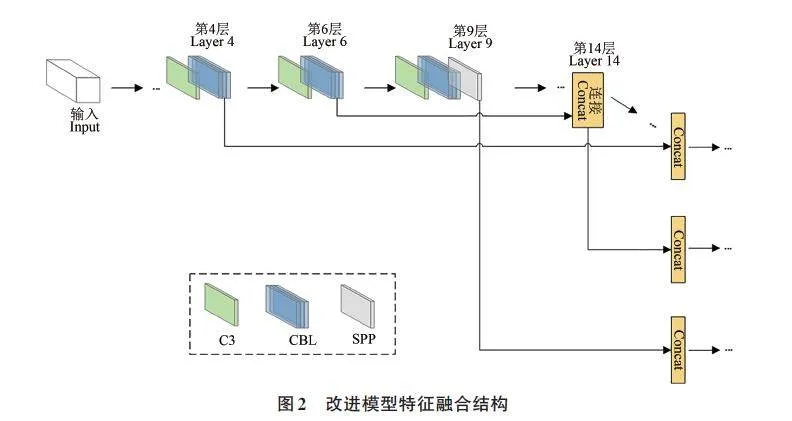

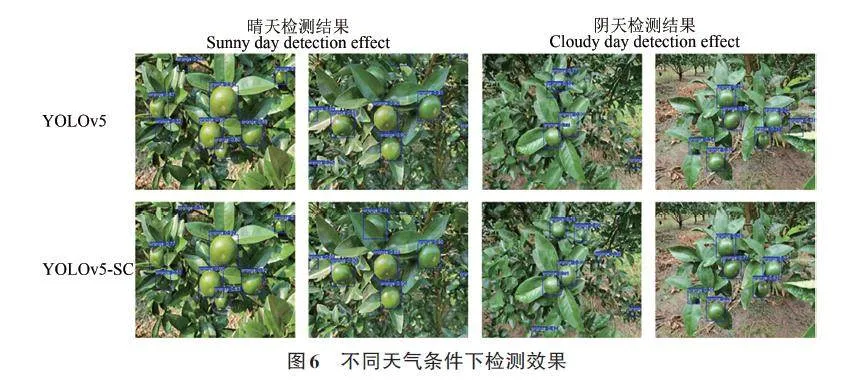

2.3.1 不同天气条件下性能分析

由于晴天和阴天光照强度不同,柑橘会呈现不同的光泽、对比度和饱和度。在晴天条件下,柑橘饱和度更强,其本身的色彩会更加鲜艳,光照越强柑橘光泽更亮,而在阴天条件下则恰好相反,这会对模型的识别效果产生一定的影响。本研究在5~10个柑橘的维度内进行试验,分析不同天气条件下对柑橘的检测效果,结果如图6所示。可以看出,在不同天气场景下,改进后的YOLOv5-SC模型对柑橘的检测效果更好,其不仅能识别出更多数量的柑橘,还能改善模型将绿色背景识别成绿色柑橘的情形。YOLOv5-SC模型比YOLOv5模型准确率更高,在阴天条件下准确率提高1.95%,在晴天条件下准确率提高2.34%(表4)。

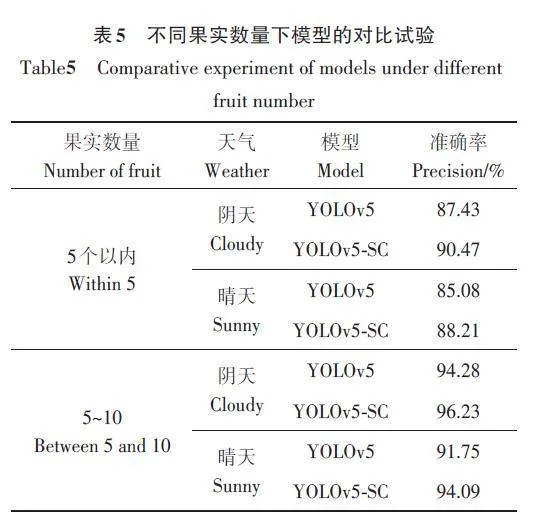

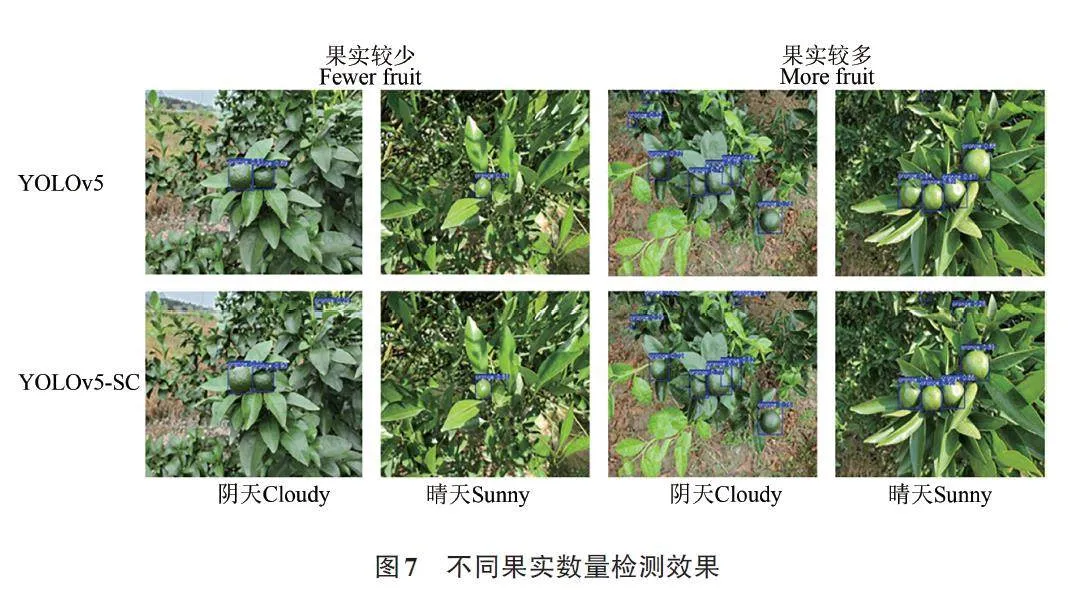

2.3.2 不同果实数量下性能分析

在柑橘图像拍摄过程中,随着拍摄角度和距离的移动,每幅图像包含的柑橘个数不同。如果图像中柑橘数量较少,柑橘对象往往完整清晰,受环境因素的影响少;反之,包含的柑橘数量较多,它们会受到枝叶遮挡、果实重叠等自然因素的影响,其检测难度提升。在不同天气条件下,本节通过对比试验验证不同果实数量下模型的检测效果,试验在少量(lt;5个)和多量(5~10个)柑橘2个维度进行,检测效果如图7所示。可以看出,针对不同果实数量下的柑橘图像,YOLOv5-SC模型比YOLOv5模型准确率更高。在阴天和晴天天气下,如果柑橘果实数量在5个以内,准确率能分别提高3.04、3.13个百分点。当果实数量较多时,准确率能分别提高1.95、2.34个百分点。在自然因素条件下,仍能检测出更多的柑橘(表5)。

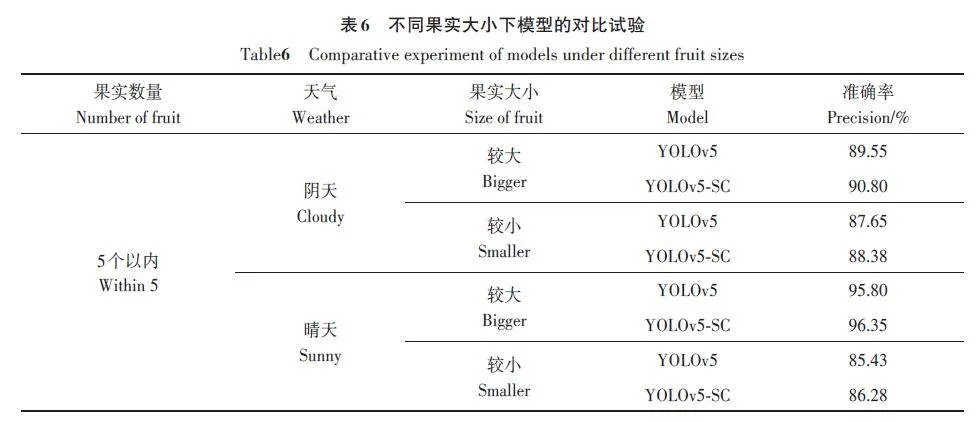

2.3.3 不同果实大小下性能分析

在不同果实数量情况下,柑橘图像呈现大小不一的形状,影响果实采摘机器人的采摘效率。在单果实图像中,近焦拍摄果实呈现单一较大的形态,远焦拍摄果实呈现单一较小的形态。在实际工作中,机器人识别果实也会自助调焦来识别果实,这会导致果实的大小不同。因此,本节在5个以内柑橘的维度进一步研究果实大小对识别性能的影响,结果如图8所示。可以看出,YOLOv5-SC模型仍能检测出更多柑橘,并能改善将绿色背景误检成绿色柑橘的情形,相较于YOLOv5模型准确率更高。较大和较小的柑橘经过模型识别后,在阴天条件下准确率能分别提高1.25、0.73个百分点。在晴天,准确率能分别提高0.55、0.85个百分点(表6)。

3 讨论

柑橘生长环境复杂,会受到遮挡、重叠、天气等因素的影响,且绿色柑橘颜色与自然环境相近,识别难度较大。早期的机器视觉技术能根据柑橘的轮廓、纹理、形状等特征设计识别算法,或利用高光图谱、热成像系统等方式进行识别,取得一定的研究成果。但是,这些方法需要人工对柑橘图像进行特征提取,其识别效果有待提升,部分技术的研究成本也较高。随着机器视觉技术的发展,能通过深度卷积神经网络对柑橘图像进行特征提取,由数据本身来驱动特征及表达关系的自主学习[24]。YOLO 是端到端的深度卷积神经网络模型,能识别和定位对象,检测速度快[25]。YOLOv5模型结构与YOLOv4模型相似,其核心是将目标检测作为单一回归任务,但YOLOv5模型均值权重文件更小,推理速度和时间更短。本文以YOLOv5深度学习模型为基础对绿色柑橘对象进行了研究,并提出了一种改进的YOLOv5-SC模型对绿色柑橘进行识别。对比原模型,添加了混合注意力机制,优化了特征融合结构和分类损失函数,准确率提升了2.61个百分点,说明提出的改进方法能提升对绿色柑橘的识别效果。

为验证模型优化方法的有效性,本研究添加混合注意力机制,与单独添加一种注意力机制相比模型的准确率更高。模型优化完成后,YOLOv5-SC模型准确率最高,其平均精度和F1值也最高,对绿色柑橘的特征提取效果更好。

本文数据集能覆盖多种自然环境条件,再利用YOLOv5的Mosaic数据增强策略,增加了图像样本的均衡性。针对绿色柑橘复杂的生长环境,本文进一步研究了不同自然环境下绿色柑橘的检测性能。分别在不同天气、不同果实数量、不同果实大小条件下,YOLOv5-SC模型准确率能得到一定的提升。从识别效果来看,YOLOv5-SC能识别出更多柑橘果实,也能有效减少绿色背景被误检成绿色柑橘的情形。

本文通过改进YOLOv5模型来识别自然环境下的绿色柑橘,能为绿色水果智能采摘领域提供理论研究与技术支撑。为了让模型更好地与智能采摘落地,未来在最小损失模型精度的前提下,需要减少模型体积,提升模型检测速度,以实现模型轻量化部署与检测。

参 考 文 献

[1] 王林惠,兰玉彬,刘志壮,等.便携式柑橘虫害实时检测系统的研制与试验[J].农业工程学报,2021,37(9):282-288.

WANG L H, LAN Y B, LIU Z Z, et al .. Development andexperiment of the portable real-time detection system for citruspests [J]. Trans. Chin. Soc. Agric. Eng., 2021,37(9):282-288.

[2] CHEN W, ZHOU Y, CHEN Y. The environmental impacts ofcitrus residue management in China: a case study in the threegorges reservoir region [J]. Waste Manage., 2021, 133(6):80-88.

[3] TANG Y, CHEN M, WANG C, et al .. Recognition andlocalization methods for vision-based fruit picking robots: areview [J/OL]. Front. Plant Sci., 2020, 11:510 [2022-12-14].https://doi.org/10.3389/fpls.2020.00510.

[4] YE L, DUAN J, YANG Z, et al .. Collision-free motion planningfor the litchi-picking robot [J/OL]. Comput. Electron. Agric.,2021, 185: 106151 [2022-12-14]. https://doi.org/10.1016/j.compag.2021.106151.

[5] 赵德安,吴任迪,刘晓洋,等.基于YOLO深度卷积神经网络的复杂背景下机器人采摘苹果定位[J].农业工程学报,2019,35(3):164-173.

ZHAO D A, WU R D, LIU X Y, et al .. Apple positioning basedon YOLO deep convolutional neural network forpicking robotin complex background [J]. Trans. Chin. Soc. Agric. Eng.,2019,35(3):164-173.

[6] 许德刚,王露,李凡.深度学习的典型目标检测算法研究综述[J].计算机工程与应用,2021,57(8):10-25.

XU D G, WANG L, LI F. Review of typical object detectionalgorithms for deep learning [J]. Comput. Eng. Appl., 2021,57(8):10-25.

[7] 易诗,李俊杰,张鹏,等.基于特征递归融合YOLOv4网络模型的春见柑橘检测与计数[J]. 农业工程学报,2021,37(18):161-169.

YI S, LI J J, ZHANG P, et al .. Detecting and counting of springseecitrus using YOLOv4 network model and recursive fusionof features [J]. Trans. Chin. Soc. Agric. Eng., 2021, 37(18):161-169.

[8] 杨婷婷,郭志勋,雷定湘,等.机器视觉技术在农业中的应用[J].安徽农学通报,2021, 27(18):110-111.

YANG T T, GUO Z X, LEI D X, et al .. Application of machinevision technology in agriculture [J]. Anhui Agric. Sci. Bull.,2021,27(18):110-111.

[9] WANG C, LEE W S, ZOU X, et al .. Detection and counting ofimmature green citrus fruit based on the Local Binary Patterns(LBP) feature using illumination-normalized images [J]. Precis.Agric., 2018,19(6):1062-1083.

[10] LU J, LEE W S, HAO G, et al .. Immature citrus fruit detectionbased on local binary pattern feature and hierarchical contouranalysis [J]. Biosys. Eng., 2018,171:78-90.

[11] GAN H , LEE W S, ALCHANATIS V, et al .. Active thermalimaging for immature citrus fruit detection [J]. Biosys. Eng.,2020,198:291-303.

[12] 韩文,魏超宇,刘辉军.基于Tiny-YOLOv3的田间绿色柑橘目标检测方法[J].中国计量大学学报, 2020, 31(3):349-356,392.

HAN W, WEI C Y, LIU H J. Green citrus detection based onTiny-YOLOv3 in field [J]. J. China Metrol. Univ., 2020,31(3):349-356,392.

[13] ZHENG Z, XIONG J, LIN H, et al .. A method of green citrusdetection in natural environments using a deep convolutionalneural network [J/OL]. Front. Plant Sci., 2021, 12: 705737[2022-12-28]. https://doi.org/10.3389/fpls.2021.705737.

[14] 陈文康,陆声链,刘冰浩,等.基于改进YOLOv4的果园柑橘检测方法研究[J].广西师范大学学报(自然科学版),2021,39(5):134-146.

CHEN W K, LU S L, LIU B H, et al .. Real-time citrusrecognition under orchard environment by improved YOLOv4 [J]. J.Guangxi Norm. Univ. (Nat. Sci.), 2021,39(5):134-146.

[15] 黄彤镔,黄河清,李震,等.基于YOLOv5改进模型的柑橘果实识别方法[J].华中农业大学学报,2022,41(4):170-177.

HUANG T B, HUANG H Q, LI Z, al.el. Citrus fruit recognitionmethod based on the improved model of YOLOv5 [J]. J.Huazhong Agric. Univ., 2022,41(4):170-177.

[16] 杨长辉,刘艳平,王毅,等. 自然环境下柑橘采摘机器人识别定位系统研究[J].农业机械学报,2019,50(12):14-22.

YANG C H, LIU Y P, WANG Y, et al .. Research andexperiment on recognition and location system for citruspicking robot in natural environment [J]. Trans. Chin. Soc.Agric. Mach., 2019,50(12):14-22.

[17] JIE H, LI S, GANG S, et al .. Squeeze-and-excitation networks[C]// Proceedings of 2018 IEEE/CVF Conference on ComputerVision and Pattern Recognition (CVPR) . IEEE, 2018:7132-7141.

[18] HOU Q, ZHOU D, FENG J. Coordinate attention for efficientmobile network design [C]// Proceedings of the IEEE/CVFConference on Computer Vision and Pattern Recognition.IEEE, 2021:13713-13722.

[19] ZHANG H, WANG Y, DAYOUB F, et al .. Varifocalnet:A n iouawaredense object detector [C]// Proceedings of the IEEE/CVFConference on Computer Vision and Pattern Recognition. IEEE,2021:8514-8523.

[20] WANG C Y, LIAO H Y M, WU Y H, et al .. CSPNet:A newbackbone that can enhance learning capability of CNN [J/OL].2019, 1911: 11929 [2022-12-28]. https://doi.org/10.48550/arXiv.1911.11929.

[21] LIN T, DOLLAER P, GIRSHICK R, et al .. Feature pyramidnetworks for object detection [C]// Proceedings of the IEEEConference on Computer Vision and Pattern Recognition. IEEE,2017:936-944.

[22] LIU S, QI L, QIN H, et al .. Path aggregation network forinstance segmentation [C]// Proceedings of 2018 IEEE/CVFConference on Computer Vision and Pattern Recognition(CVPR). IEEE,2018:8759-8768.

[23] ZHENG Z H, WANG P, LIU W, et al .. Distance-IoU Loss:Faster and Better Learning for Bounding Box Regression [C]//Proceedings of The Thirty-Fourth AAAI Conference onArtificial Intelligence 2017: 12993-13000.

[24] 宋中山,刘越,郑禄,等.基于改进YOLOV3的自然环境下绿色柑橘的识别算法[J]. 中国农机化学报, 2021, 42(11):159-165.

SONG Z S, LIU Y, ZHENG L, al. el. Identification of greencitrus based on improved YOLOV3 in natural environment [J].J. Chin. Agric. Mechan., 2021,42(11):159-165.

[25] 刘芳,刘玉坤,林森,等.基于改进型YOLO的复杂环境下番茄果实快速识别方法[J].农业机械学报,2020,51(6):229-237.

LIU F, LIU Y K, LIN S, et al .. Fast Recognition method fortomatoes under complex environments based on improvedYOLO [J]. Trans. Chin. Soc. Agric. Mach., 2020,51(6):229-237.

基金项目:国家民委中青年英才培养计划项目(MZR20007);湖北省科技重大专项(2020AEA011);武汉市科技计划应用基础前沿项目(2020020601012267);中南民族大学研究生学术创新基金项目(3212022sycxjj333)。