AI面前,保持清醒

十几年前,尤瓦尔·赫拉利曾做过这样的预言:计算机在决策、数据处理和创造力方面能力的发展可能超越人类,并逐渐取代人类在社会中的主导地位。这个预言正在一步步变为现实。一些年轻人也意识到信息网络对自己的负面影响,他们开始主动训练算法、戒断网络、不使用社交媒体——但人不可能永远隔绝算法。在AI(人工智能)大爆发的背景下,关于如何应对当下世界,如何与不确定性和焦虑自处,尤瓦尔·赫拉利谈了他的想法。

1.人类已经失去主动检索信息的能力了吗?

要理解我们对信息的消费方式发生了什么变化,可以用食物做个比喻。100年前,食物很稀缺,所以人们会吃他们能找到的一切食物。时至今日,食物已经很充足了,人们过量摄入脂肪和糖就会生病,所以大家开始节食。

信息也是一样。现在我们已经被大量信息淹没,尤其是那些无用信息——这也会让我们生病。我们需要进行“信息节食”。

“信息节食”的第一步就是放弃“更多信息总是对我们有益”这样的想法。第二步则要有意识地筛查信息的质量。我们应该对放入大脑的精神食粮保持谨慎。

最后,定期开展“信息断食”。我每年会进行为期几周的冥想闭关,其间完全断开与外界的联系。对大多数人来说,偶尔进行一两天的“信息断食”也是不错的选择。

2.哪些信息能称得上知识?

以前我们将所有信息等同于知识,这很明显是错误的——大多数信息都是垃圾,而知识是那一小部分稀有且昂贵的信息。

想编造一个引人入胜的假新闻很容易——你只需随心所欲地写,无须花费一分钟进行研究。但相比之下,写一篇真实的报道则很困难,因为这背后需要费时费力地做研究。而且,你所写的真相收获的关注可能远小于“假新闻”的,因为事实往往很复杂,而人们不喜欢复杂的故事。这也就导致错误的信息总是比真相传播得更容易。

所以为了保护那些稀缺而珍贵的知识,我们需要建立自我修正机制——主动去识别、承认并纠正错误。

3.学文科真的没用了?

AI迅速改变了就业市场,以至于我们无法预测未来还需要哪些技能。对理工科的认知也是一样,很多人觉得学编程、代码很重要,因为计算机是未来。但几年后,AI编码可能比人类编得更好,那是不是我们也不需要人类程序员了?相反,也许到时候我们会更需要哲学家、心理学家,因为世界剧变会带来更多哲学和心理问题。

举个例子,要实现智能汽车无人驾驶,我们必须将道德规则也编码到驾驶程序中。假如出现紧急情况,汽车必须为了救行人而危及车内乘客的安全时,应该怎么做呢?AI可以编写这段代码,但我们需要人类来为AI制定道德规则。

同样,理工科专家也无法告诉你AI会如何影响人类的心理健康、亲密关系和社会生活。为此我们需要历史学家、心理学家和艺术家。看看我们周围的世界——计算机科学家发明了社交媒体算法,但他们不能预见算法对儿童的负面影响。你认为谁最适合帮助改善儿童的处境——研究计算机的人,还是研究人类的人?

4.算法是否真的提升了效率?

依赖算法来评价一切的做法会带来毁灭性的后果。逐渐地,我们都被迫变成“被动的消费者”,而不是“主动的生产者”。

以亲密关系为例,我可以试着通过算法匹配来找到另一半。基于海量数据,算法会为我的潜在对象打分,让我试着与评分高的人相处。如果我对这些结果不满意,可以直接忽略,等着算法给我推更好的人。反正我的灵魂伴侣仍然在世界某处,算法迟早会为我找到的,是不是?

这种态度很可怕,它刺激着我们不断因为微小的瑕疵而拒绝潜在的候选人,转而去等待一个“完美”的人出现——反之,它不会鼓励我来改变自己,我只是在被动地接受。

但我们也可以试试另一种做法——把人类看成亲密关系的创造者,而不是消费者。但问题压根儿不是如何找到完美伴侣,“完美伴侣”是不存在的。真正的问题是,无论算法为我找到谁,我都需要通过自己的努力去建立一段良好的关系。

5.AI会夺走人类的工作吗?

在这个问题上,直觉可能会误导我们。

例如,我们通常认为医生比护士更重要。但AI可能更容易取代医生而不是护士。为什么?许多医生的工作主要是分析数据,他们收到大量关于患者的症状和病史的数据,接着分析数据、诊断疾病,并推荐治疗方案。这种数据分析恰恰是AI的优势,它们马上就能比人类做得更好。

但护士的工作就不仅是分析数据了,他们还需要良好的动手能力和社交技能,比如换绷带、给哭泣的孩子注射疫苗,这都是更难自动化的事情。因此,AI医生可能会出现得比机器人护士早。

如果要给年轻人一些建议,最安全的做法是更广泛地学习技能,而不是专注于某种垂直类技能,比如编程。他们应该提升动手能力、发挥同理心,就像过去锻炼智力一样,运动技能和社交技能同样重要。当然最重要的就是——能够在一生中不断学习和改变。要在21世纪蓬勃发展,你需要一个非常灵活的头脑。

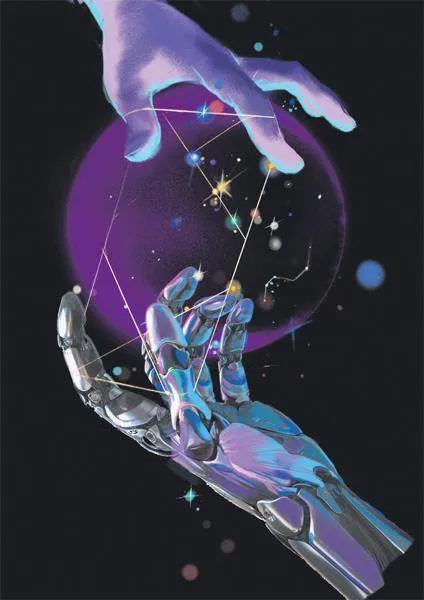

(林间路摘自微信公众号“后浪研究所”,本刊节选,黄思思图)