虚实共生:数据驱动时代的算法主体性、中介关系与治理逻辑

【摘要】数据驱动时代,算法作为高维媒介,在自我意识觉醒、利益方观点极化、具身化与去具身化交流、控制权差异、个性化选择等方面雕刻算法主体性特征。文章从有效性沟通和技术性隐忧两个角度,分析算法主客体之间的关系;从治理目的、内容审核、价值判断和用户注意等方面,剖析算法治理的核心逻辑。

【关键词】算法治理 算法价值观 网络中立性 主体性关系 决策博弈

【中图分类号】G206 【文献标识码】A 【文章编号】1003-6687(2023)5-059-07

【DOI】 10.13786/j.cnki.cn14-1066/g2.2023.5.009

2016年Daedalic Entertainment推出《心境》,揭示超人類主义兴起后人与AI共生的抉择困境。在AI创造的异质交往空间中,算法作为一种问题解决的路径、流变的关系连接,既凝结着人类数千年的计算技术与智慧结晶,又反映了人的喜好、意见、观点、兴趣等实践取向。数据驱动时代,算法成为促进自动化公平的工具之一,虽是“第四范式”的大数据知识外溢的数据密集型决策方式,但并未形成托马斯·库恩所言科学革命理论之语境中的范式革命。[1]从媒介实践性看,整理和分析数据足迹中的算法主体、算法决策对国家战略的预测、对政策规制以及商业决策的影响,有助于为算法监管者掌控未来提供有效建议。

一、面向虚实结合媒介实践的算法主体性

面对虚拟空间与物理空间的联结,拥有机器价值取向和原子化价值判断的算法权力主体,对秉持人本价值取向、承载伦理和道义的传统媒介主体形成新挑战。在面临信息源、交往通道、认知方式、社会影响等复杂新变化的算法空间里,算法主体性具有以下特点。

1. 萌发自我意识觉醒的算法主体性

面对以元宇宙为代表的虚实结合互联网生态革命,算法主体存在自我意识觉醒的可能性:算法主体主动意识到信息源对自我塑造和真实摹刻的影响,能自我确认让渡隐私获得服务,达成群体认同。正如1950年怀特在《把关人:一个新闻选择的个案研究》中将把关视为记者、编辑的个人价值判断对客观世界的反映、选择和影响,用户对算法把关信息获取的默认,可能会决定人们认知未知世界的起点,并相应影响其思维方式和行为终点,尤其在去中心化信息传播的趋势下,每个人都拥有追求个性化发展的潜在可能。

2. 利益切割诱发观点极化的算法主体性

算法作为社会资本觊觎的新生产力要素,体现出不同主体的利益切割。市场化媒体强化商业—技术逻辑,主流媒体侧重调整—控制逻辑,信息源差异化传递可能会对公众价值观产生错位甚至反向影响,舆论场陷入关注与被关注纷争,多元利益主体的博弈面临获利合法性和正当性需要的拷问:“人利用文化与信息做了什么?”[2]也存在因受众接受的速度和限度、交互性、可及性的差异,形成算法标准差异而诱发群体极化的可能。

3. 兼有具身化与去具身化可能性的算法主体性

算法以中介形式将生产者、消费者与内容紧密勾连在一起,基于算法的个人信息分析会影响平台流量分布,而基于算法的流量指标也会影响内容生产者对用户的定位与判断。

算法主体交流存在去具身化的可能性,这是移动通信普及以来,人类龟缩于自我窄小空间而错失人际联系之隐忧的必然延伸。如格尔根的警醒:人类将围绕自我快乐轴心陷入类似日本江户时期的“漂浮世界”,成为人与自身相对话,缺乏稳定社会生活和现实的人际空间的“想象的受众”。[3]同时,也不得不重提罗伯特·帕特南的《独自打保龄:美国社会的衰落与复兴》的告诫:人们正沉浸于自我世界而减弱对公共事务的参与热情。但也有谨慎的乐观,如梅罗维茨在《消失的地域:电子媒介对社会行为的影响》中期待电子媒介造就的去空间感将人类从被限制性的日常生活中解放出来,能够应对新的社会应激与挫折。

虽然缺乏现实沟通让人们担心自己脱离物理现实,但算法主体存在具身交流的可能性。“观看意味着权力,凝视铭刻了文化”,[4]在以元宇宙为代表的虚拟化交往场景中,算法拉通了多重主体与内容匹配触达和反馈的通路,通过听觉、视觉、嗅觉甚至触觉等感官的刺激,通过具身化设定的场景化交流,将个性化的感受即时外化,形成新的媒介化社会景观。可从2021年年底Facebook更名Meta、2022年年初微软收购动视暴雪以在元宇宙平台布局游戏等战略动向中,窥视算法在具身化交流情境中的社会意义和商业价值。

4. 体现媒介控制权差异化的算法主体性

用户价值取向与信息需求的匹配,很大程度上表现为媒介控制差异化。算法主客体介于控制与反控制的矛盾关系之中,体现算法主权与人本主权的争议、国家意志与科技公司利益的博弈。前者是人与物主导权之争,后者是政治架构与经济利益的较量。

以算法布局审视中美两国算法治理的国家意志。2021年9月我国出台《关于加强互联网信息服务算法综合治理的指导意见》,指出“利用三年左右时间,逐步建立治理机制健全、监管体系完善、算法生态规范的算法安全综合治理格局”。回溯2018年美国政府出版办公室的听证会可知,美国联邦通信委员会的提议仅针对美国互联网服务商而不适用于社交媒体或搜索平台,但实际上,以硅谷为代表的科技公司在用户浏览网络、购物和查看社交媒体时获取了大量的信息。因此,美国监管机构正考虑采用何种标准屏蔽、过滤或优先考虑内容审核,以符合美国的价值观。

5. 增强去空间感个性化选择的算法主体性

南希·拜厄姆在《交往在云端:数字时代的人际关系》中提出时间结构的概念,聚焦交流的同步与异步问题。算法推送的信息流,打破了以物理空间为基质的社会语境的传递,看似模糊了虚拟世界与真实世界的边界,但信息的即时获取和私人化的同步信息,增强了用户的去空间感,使信息交流直接进入人与机器的通道,[5]不仅赋予多类型算法主体中介化互动的新乐趣,还使得用户与差异化媒介的交流更加直接和有效。随时在线的连续交互,打破了私域空间与公共空间的壁垒,尊重、保留甚至凸显了个性化选择。人似乎可以在面对群体多样性、群体一致性、多极化主体而非单一主体性时,进行并不非此即彼的选择。

二、基于矩阵交互性的算法中介关系

基于多样态的算法矩阵,算法在传播信息源的连接、转换与中断的过程中有多重个性化表达。从技术交互性视角看,算法以中介形式从正反两面形成了主客体的复杂关系。

1. 算法驱动的沟通便利化

第一,算法权力的展现,即数字用户通过头像、图片、文字等留下网络痕迹,形成算法追踪信息库,完成个人身份的主动流露与输出,实现数字身份实体化。社交网络站点存在大量个人身份的线索和信号,通过配置文件的对比和辨认,可以判断其虚假性和真实性。[6]有效监控或个人身份的适当暴露是人获取社会存在感的有效路径,尤其是在透明化的数字工作环境中,算法驱动的自我呈现和自我赞许有助于协作与沟通,[7]还可能避免更多攻击性、恶意评论推荐,为用户进行群体互动和社会理解提供可能。因此,数字身份的实体化可以达成真实的社会联系,将虚拟世界与现实真实的信息来源进行勾连,为跨平台的个性化体验甚至求职、生存提供可供性。

第二,随着物联网连接和嵌入式设备的激增,随身携带式的智能终端、智能感应器和厨房智能家居设备普及,便捷、高效的信息收集接收方式以及个性化服务的提供,不仅帮助服务商通过应用程序预测用户偏好,提供社交媒体中的内容和广告,还推动服务和沟通方式以算法和数据为底层逻辑进行转变。2018年皮尤研究中心畅想未来十年AI与人共同进化时预言,人工智能很可能会嵌入大多数人类行为中。[8]2021年美国数据信息资源管理协会提到,近年来,通过基于云计算的嵌入式数据挖掘,从传感器节点实时检索人体生物信号,通过语义标记和分类,以及无线通信协议将其传输到网关,形成对健康状况的实时监控、可视化诊断,配备感应器的智能医疗保健系统发挥了重要作用。[9]

2. 算法追踪的技术性隐忧

算法已成為人类媒介现实不可或缺的关键节点,但算法的使用也存在打开“潘多拉魔盒”的技术性隐忧。

其一,虽然算法有助于沟通的便捷性,但不可否认,算法驱动的市场,对基于互联网的数据访问和内容管理有着一定威胁和挑战。以美国为例,多年来ISPS通过深度数据包检查、不可删除的标记来跟踪用户的在线行为,甚至迫使消费者为保留隐私而支付额外的高额费用。[10]

特别是众所周知的,政府监管者和私营公司采用自主算法和智能爬虫对用户的电子行为进行追踪。电子行为指用户的在线行为,包括使用网络时的人际关系、内在性和功能性行为。用户根据自己兴趣和需要进行浏览、订阅信息时的无意识搜索行为触发自主算法,形成结构化或半结构化的数据库,ISPS和其他程序获取用户的服务商、居住地点、移动轨迹、浏览模式、IP地址、MAC地址以及其他PC解决方案,智能爬虫据此完成行为分析并为后续的用户电子行为提供相应方案。虽然互联网服务商和搜索引擎认为得知用户偏好才能为其提供中意的产品,政府监管者认为追踪在线行为有利于监控与预警犯罪,但这削弱了网络中立性,并让每个用户都陷入了非法隐私侵犯陷阱。更可怕的是,个人信息有被售卖给第三方机构甚至“暗网”以牟利的可能。这不得不引发思考:用户的在线行为、选择、偏好以及细节的数据应该由谁来保存?未来是否会遭到更多数据驱动的干扰?

其二,从现实利益来看,营销者互动性操控与消费者本真需要确实存在冲突。数字市场充满活力又竞争激烈,通过超个性化的云空间,消费者和营销者都希望自身利益最大化。在消费者个性化需求增多、监管者越来越依赖数字渠道和细分化的情况下,营销者意图与用户达成点对点的信息互通,以实现互动性操控。例如为增强客户体验,科技公司用大量拟人化的聊天机器人,通过语音和文本的交流,意图最大限度地培育客户的忠诚度。[11]但由于算法获取信息的隐匿性,多数消费者无法获知营销者对信息的收集方式,也无法获知使用程度是否有效和是否符合法律规定,担忧个人失去对内容和产品的自由选择和表达的可能,陷入服务商为获取利润而对信息屏蔽与过滤的陷阱。

借用梅洛庞蒂的“盲人无法用手杖看世界的颜色”的命题,盲人的敲击动作无法看清色彩,但手杖却成为某种嵌入人体的感官而不是延伸的外物,使其获得与视觉平行的感知能力。从经验的角度看,技术可以拓展人的感知范围和活动半径,升级人的存在水平。[12]算法作为新媒介技术浸入人类存在方式的典型样态,首要目的也应该是将人从繁琐的日常事务中解放出来,以追求更美好的生活,而不是陷入算法推荐的陷阱,将鲜活的个体变成可预测、类似机器一样的存在物,成为即将被反噬的资本的牺牲品。

三、算法治理逻辑的关键性分析

算法是人触达世界的内嵌式工具、自我认知的外展方式。麦克卢汉在《理解媒介:论人的延伸》中曾预言:“电子时代,我们身披全人类,人类就是我们的肌肤。”相比其他政治不作为的动机因素,数据政治下的算法并未摆脱以互联网思维为核心的复杂的社会意识体系,反而以隐匿的形式阐释着政治、经济和意识形态的复杂关系。如果说对于算法的理解是具有个性化主观感受的“爱恨情仇”,那么,从国家战略角度看,算法治理应以提升人的幸福感和存在质量为宗旨。

1. 治理目的:流量货币化以符合国家政策规制为前提

资本涌入互联网,致力于将用户流量货币化,但无论哪一种互联网实体都不能违背国家政策规制。2017年,在美国众议院的联合通信和数字商务小组委员会听证会上,新泽西州民主党议员弗兰克·帕隆坚称,社交媒体和搜索网站使用复杂算法来增加广告点击量以影响用户选择,不仅不能真实地反映现实世界,某些分类算法存在的结构缺陷还会导致新闻推送中的种族偏见。[13]在算法治理的现实性空间中,需要政府通过政策规制向大公司施压以符合人民的期望,赋予算法“看门人”合理的权力,消解网络中立性争议对算法用户隐私、算法监管权力和“信息茧房”等的负面影响。

在互联网发展史上,网络中立性的争议由来已久。网络中立性原指以电话系统为代表的公共运营商的非歧视性行为,[14]现指ISPS必须平等对待所有互联网通信用户和行为,而不是根据用户、内容、网站、平台、应用、设备类型、源地址、目的地址或通信方式进行歧视或额外收费。[15-16]以美国为例,2015年2月26日美国联邦通信委员会通过网络中立性议案,而2017年特朗普政府支持当时联邦通信委员会主席阿吉特·帕伊主导的以恢复网络自由法案废除网络中立性法案。2019年美国众议院通过“保障宽带互联网用户平等访问在线内容”的拯救互联网法案,但美国参议院未通过。[17]2021年拜登政府推出宽带标签模板,意图恢复网络中立性。通过美国民主党与共和党围绕网络中立性的动议与拉锯,可以看出流量变现的利益与话语权纷争的白热化。而我国学者认为,网络中立性原则背后的算法劫持和算法调节值得重视,[18-19]尤其是2021年、2022年美国联邦通信委员会接连取消中国电信美洲公司、中国联通美洲公司的214牌照,将用户隐私、算法价值观、金融风险网络安全化与地缘政治挂钩,可见以算法和数据为资源池的争夺,已成为制订国家网络安全计划与规制的重要现实考量。

2. 内容审核:人工审核与算法审核的适切性条件

内容审核是关系到互联网服务商、社交媒体、政府监管者和用户等多元主体的重要媒介化实践环节。在信息决策生态日益繁琐和异化的趋向中,算法审核在内容审核中的比重越来越大,尤其是采用异步交流的Twitter、Facebook、Reddit、TikTok等大型社交媒体平台,算法审核的效果可能会优于人工审核。不同于人工的个性化审核,算法审核多采用事先审核形式和自动审核系统,将平台审核政策应用于用户上传流程,在其他用户能够查看、互动和分享之前删除被禁止的内容,旨在鼓励用户在可接受的开放空间表达自己,促进信息的即时传输和有效沟通。

算法审核类型多元,既可能涉及整体性的推送和管理,如Instagram、Twitter、YouTube每天对数以亿万计的视频、图片和文本的发布、浏览、评论和转发进行审核;也可能是门槛级的内容审核,如平台对用户上传、发布内容的算法筛选,特别是检查非法或禁止上传内容与约定标准的匹配度;也有专门定制优先级、推广、顺序或频率等的计算新闻,如Algorithm Tips将算法、众包和专家评估集成一个界面,使用算法决策系统为各类新闻机构和美国各级政府归纳有价值的新闻线索。[20]从实践来看,没有哪一种内容审核方式能完美应对所有问题,而审核标准变化也迫使极端用户、小众用户趋向非审核模式。由于表情包、Gif、音频和视频等大量非语言内容的审核难度较高,算法也无法通过上下文情境和流行语背景理解暗喻、反讽等修辞的运用,在真实的在线交流语境中,自然语言处理系统会产生误解和过度删除的情况。[21]

更重要的是,国家政策赋权下的内容审核,特别是内容审核的外部因素对整个媒介生态的潜在影响巨大。如1996年的《美国通信规范法案》第230条对交互式社交媒体提供商和交互式媒体授予平台豁免权,使其免于中介责任,并规定了信息透明度相关权利与义务,鼓励网站删除攻击性内容,审查用户的言论。虽然有批评者认为该条内容使得社交媒体可以自由地忽视谎言、骗局和诽谤,但不可否认该规则促进了社交媒体平台和互联网的蓬勃发展。因此,在虚假新闻、种族歧视、地域攻击和暴力煽动已成为世界各国社交媒体常态化的当下,平台内容审核标准存在不透明、不统一的现实操作,怎样区分可接受、部分接受、完全不能接受的算法筛选标准,成为公众与政府关注的重要问题。

在实践中,算法审核与人工审核并不是非此即彼的,特别是平台为避免法律和政治立场争议以偏见作为理由对算法审核引发的争议进行人工审查。Facebook、Twitter、亚马逊、苹果和谷歌等数字平台均倾向采用自我监管方式,利用大数据、人工智能和机器学习技术,由训练有素的人工决策者审核算法删除的合理性,如通过版主对极端主义、恐怖主义等特定内容和被其他用户标记为违反社区标准、违反全球规则的内容的审核,算法审核的内容截屏被放到数据库队列中,由训练有素的人类决策者审查内容是否真的违反了服务条款,并评判可能对消费者权利造成的潜在损害。[22]对用户隐私的担忧也引起了公众对算法审核的关注。如2017年,美国征信巨头Equifax因应用程序漏洞导致数据泄露,波及约1.479亿名客户。为加强用户隐私保护,Equifax使用机器学习算法,采用FraudIQ综合ID警报检测消费者身份、行为和模式的异常,形成对身份欺诈行为的检测、预防,对隐私进行保护。[23]另外,虽然面临着生物隐私泄露的争议,但为有效应对新冠肺炎疫情,公众逐渐接受了对接触者与联系者进行追踪、对重症病人进行远程监控,以及对医疗图像进行处理的新技术。[24]

3. 算法价值观:秉持多样化与包容性的价值判断

因为道德很难定义、实施和执行,要设计出能被广泛采用的人工智能伦理系统相当困难。2021年皮尤研究中心发布的报告中,多位专家对AI的伦理道德原则表示担忧。加拿大国家研究委员会的数字技术高级研究官斯蒂芬·唐斯说:“现代AI是基于大量数据集上的应用数学函数。数学函数没有‘好’‘恶’之分,数据中的偏见也不容易被识别或阻止。”密歇根州立大学法学院的客座教授、《算法社会》编辑肯尼斯·A.格雷迪表示,“人工智能伦理定义有国别差异,人工智能在面对跨境能力、道德约束与该国利益的差异,以及军事威胁等方面问题时,对其监管难度很大”。圣何塞州立大学的人类学教授琼·安妮·英格利什-卢克说:“AI系统使用算法的可靠性基于深度学习的数据准确性。人类的伦理体系复杂而又相互矛盾,过去几十年人类也没有解决的困境,没理由相信能在人机交互中得到化解。”[25]

另外,由于地缘政治、经济利益和意识形态的差异,世界各国的人工智能国家战略呈现了自组织与集体性统一的算法价值观。[26]如根据荷兰《人工智能战略行动计划》,2019年荷兰政府政策科学委员会调查人工智能对公共价值的影响时,特别提到乌得勒支大学的算法决策的法律问题研究。该研究从自动驾驶汽车、P2P能源市场、法官、自我效能和平台内容审核五个方面,确定未来5到10年决策算法的机会与风险,以及算法与现有法律框架和价值观的关系,提出应采取措施来限制相关风险。[27]正如《德意志意识形态》一文提出“意识在任何时候都只能是被意识到了的存在,而人们的存在就是他们的现实生活过程”。[28]在经历了古斯塔夫·勒庞大众传播时代的“群氓”现象之后,[29]无论是被数据技术赋权的政府,还是赚取公众注意力红利的市场化媒体,都须维系扎根于民族、文化和国家差异化的现实,以及以价值认同和情感依附为基础的集合主体性,[30]消解公民在客观现实与象征性现实中的媒介焦虑。

从现实世界和虚拟世界加速勾连的趋向看,随时在场的算法介入互联网行动者关系网络。从微个体需求看,作為算法主体之一的用户基于持续性的娱乐、购物、搜索、订阅的自组织行为,致力于摆脱信息冗余、掌握信息主控权、减少人际交往焦虑,以贴近自我身心实际;而另一类算法主体,如宽带互联网接入商和科技公司由于扮演的角色不同、给予消费者的承诺差异,其通过数据反向收集的信息源,催生了聚合多元价值和价值共识拟合的信息能量池。面对不同主体聚沙成塔形成的算法价值观谱系,政府作为决策者,应避免以一刀切的方式来进行算法治理。在不同媒介和差异化选择标准下,如果对整个互联网采取统一的监管方法,就只能满足少数人的需要,无法实现数字化生存。

了解權力和资本如何役用数据与算法控制相关行为,是数字驱动时代保护公民隐私的政策核心。个别实体只能获取部分用户隐私,如谷歌掌握其用户搜索的初始步骤、亚马逊了解用户浏览和购买产品的情况,但宽带互联网接入商却能拥有获取所有互联网数据包发送、接收信息的权力。[31]至于算法标准细节,则被视为商业机密而不向消费者披露,导致消费者要么将算法视为“黑箱”,要么认为算法是中立决策者,可以避免人类偏见。但事实是,机器学习算法以人的设定为始基,机器学习算法的不透明性加剧了AI的非中立性。[32]

4. 用户注意力:驱动算法技术为人服务而不是人为之服务

社交网络用户的注意力,是影响公众选择、态度的重要因素和稀缺资源。[33]注意力的形成,是受环境布局、材质等现实因素以及个体知识背景、知识经验影响的多重变量过程。[34]过去十年,以机器学习或深度学习为代表的自我学习算法,形成了自动的自我创造的外部关注形式。[35]以排名、点赞数、推荐数、用户地图和关键词云为代表的指标强化了数字信息的权重,成为引导网络用户注意力的基础。

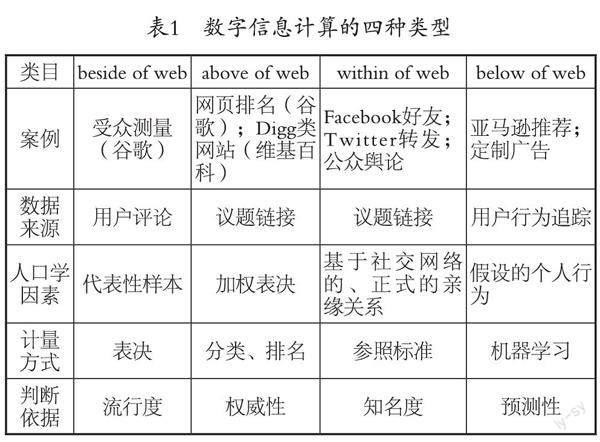

2016年,罗伯特·西弗特、乔纳森·罗伯奇基于点击、链接、社交行为(喜欢、转发等)、互联网用户行为模式,将数字信息计算分为四种类型:beside of web,网络用户点击量和网络流行程度;above of web,基于超文本链接定义网络的权力;within of web,社交网络用户测量该产品的受欢迎程度;below of web,根据既往行为史计算和预测网络用户行为(见表1)。[36]

基于算法凝聚用户注意力的核心应是服务人,而不是驾驭人。众所周知,算法取代记者、图书馆员、评论家和专家等专业人员,成为数字空间新的“看门人”。但基于性别、文化、阶层等多重因素的个性化算法推荐,导致用户注意力被介入信息生产、传递和消费流程的算法所固化,强化了具有固有认知和心理依赖的强关系圈层。[37]在塑造用户注意力方面,既要尊重个人权力与转向原子化的本真需求,也要思考算法这一信息中介对人的注意力生成与屏蔽的影响。

不仅如此,由于多元算法主体选择的自组织与集体性统一,以及公众关注焦点舆论化、内容生产与社会获益的关联性,使得公众有了多元多向的内容选择。作为高维媒介,算法以价值判断架构供需双方的价值关系,[38]无论是YouTube、ABC news、FOX news、今日头条使用数据新闻的定向推送,还是京东、小红书推送种草菜单,微信朋友圈利用“不看他的朋友圈”功能形成的阅读人清单,只有正确处理注意力数据与价值共识的关系,才能将算法的社会性合理变现,从而提升人的满意感、幸福感。因此,要以算法主体的需求为始基,分析自上而下与自下而上的信息传播方式的差异,[39]追求共同发起、共同感知、共同创造的效果,[40]才能凝聚民族向心力,有效传递正向信息,形成更好的创新驱动力,构建优化公众注意力的长效机制,为打造网络传播有序化的媒介共同体提供可能。

在数据驱动时代,算法是AI拟合人类思想与行为必不可少的中介,只有为赋权公众而塑造算法认知框架,提升集约化、信息化、人性化、多元化服务水平,尊重用户的本真需求而不是资本的短期利益,达成治理者—公众—媒体之间的平衡关系,才能形成目标明确、渠道多样、焦点分散化的多元算法治理格局,真正使算法为人类造福。

参考文献:

[1] 董春雨,薛永红.数据密集型、大数据与“第四范式”[J]. 自然辩证法研究,2017,33(5):74-80,86.

[2] Nicholas Garnham. From Cultural to Creative Industries[J].International Journal of Cultural Policy, 2005,11(1): 15-29.

[3] Nyri K. Self and community and the new floating worlds, Mobile Democracy: Essays on Society, Self and Politics[M].Vienna: Passagen Verlag Editors, 2003: 61-69.

[5] O'Sullivan·P. B, Hunt S, Lippert L. Mediated Immediacy: a Language of Affiliation in a Technological age[J]. Journal of Language and Social Psychology, 2004(23): 464-90.

[6] Judith Donath. Signals in Social Supernets[J]. Journal of Computer-mediated Communication, 2007,13(10): 231-251.

[7] Anna Danielewicz-Betz. Self-presentation and Self-praise in the Digital Workplace[M]. Cliftor, New Jersey: Anthem Press, 2021: 1996.

[8] Janna Anderson,Lee Rainie. Artificial Intelligence and the Future of Humans[EB/OL].[2018-12-10].https://www.pewresearch.org/internet/2018/12/10/improvements-ahead-how-humans-and-ai-might-evolve-together-in-the-next-decade/.

[9] Information Resources Management Association USA. Research Anthology on Privatizing and Securing Data[EB/OL].[2021-04-10].https://www.nytimes.com/2019/04/10/technology/net-neutrality-vote.html.

[10] U.S. Government Publishing Office. Algorithms: How Companies' Decisions about Data and Content Impact Consumers[EB/OL].[2017-11-29].https://www.govinfo.gov/content/pkg/CHRG-115hhrg28578/html/CHRG-115hhrg28578.htm.

[11] Crolic C, Thomaz F, Hadi R, et al. Blame the Bot: Anthropomorphism and Anger in Customer-Chatbot Interactions[J]. Journal of Marketing. 2022, 86(1): 132-148.

[12] Brett Frischmann, Evan Selinger. Re-Engineering Humanity[M]. Cambridge: Cambridge University Press, 2018: 32.

[13] John Eggerton. Pallone:Internet Platforms are Policing Content[EB/OL].[2017-11-29].https://www.nexttv.com/news/pallone-internet-platforms-are-policing-content-416813.

[14] Wu Tim. Network Neutrality, Broadband Discrimination[J]. Telecomm & High Tech. L, 2003(2): 141.

[15] Easley R, Guo H, Krämer J. From Net Neutrality to Data Neutrality[J]. Information Systems Research, 2016, 29(2): 253-272.

[16] Gilroy Angele A. Access to Broadband Networks: The Net Neutrality Debate[M]. Darby, PA: Diane Publishing Co, 2011: 1.

[17] Kang Cecilia. Net Neutrality Vote Passes House, Fulfilling Promise by Democrats[EB/OL].[2019-04-11].https://youcangetthetech.com/2019/04/11/net-neutrality-vote-passes-house-fulfilling-promise-by-democrats/.

[18] 常江. 互聯网中立性与算法劫持[J]. 青年记者,2019(22):92.

[19] 毛湛文,孙曌闻. 从“算法神话”到“算法调节”:新闻透明性原则在算法分发平台的实践限度研究[J]. 国际新闻界,2020(7):6-25.

[20] Diakopoulos Nicholas, Daniel Trielli, Grace Lee. Towards Understanding and Supporting Journalistic Practices Using Semi-automated News Discovery Tools[J]. Proceedings of the ACM on Human-Computer Interaction, 2021(5): 1-30.

[21] Young Greyson K. How Much is too Much: the Difficulties of Social Media Content Moderation[J]. Information & Communications Technology Law, 2022, 31(1): 1-16.

[22] Michael A. Cusumano, Annabelle Gawer, David B. Yoffie. Social Media Companies should Self-regulate.Harvard Business Review Home[EB/OL].[2021-01-15].https://hbr.org/2021/01/social-media-companies-should-self-regulate-now.

[23] Tackling Fraud Initiated through Authorized User Abuse[EB/OL].[2021-02-01].https://assets.equifax.com/marketing/US/assets/synthetic-id-alerts-case-study.PDF.

[24] Aboul Ella Hassanien, Ashraf Darwish. Digital Transformation and Emerging Technologies for Fighting COVID-19 Pandemic: Innovative Approaches[M]. Cham, Switzerland: Springer Nature, 2021: 31-32.

[25] Lee Rainie, Janna Anderson, Emily A.Vogels.Worries About Developments in AI[EB/OL].[2021-06-16].https://www.pewresearch.org/internet/2021/06/16/1-worries-about-developments-in-ai/.

[26] 叶妮. 人工智能国家战略中的算法价值观[J]. 传媒经济与管理研究,2021(2):3-21.

[27] Strategic Action Plan for Artificial Intelligence:The Netherlands[EB/OL].[2019-10-09].https://www.government.nl/binaries/government/documents/reports/2019/10/09/strategic-action-plan-for-artificial-intelligence/Strategic+Action+Plan+for+Artificial+Intelligence.pdf.

[28] 马克思,恩格斯. 马克思恩格斯文集:第1卷[M]. 中共中央马克思恩格斯列宁斯大林著作编译局,译. 北京:人民出版社,2009:525.

[29] 古斯塔夫·勒庞.乌合之众:大众心理研究[M]. 陈剑,译. 南京:译林出版社,2018:149.

[30] 潘忠党. 导言:媒介化时代的公共传播和传播的公共性[J]. 新闻与传播研究,2017(10):29-31.

[31] Testimony of Paul Ohm Before the Senate Commerce Committee[EB/OL].[2016-07-12].https://www.commerce.senate.gov/services/files/67450B91-1020-441C-AD2E-9972886F9E2A.

[32] Chamith Fonseka Rebecca Senft. Hold Artificial Intelligence Accountable[EB/OL].[2017-08-28].https://sitn.hms.harvard.edu/flash/2017/hold-artificial-intelligence-accountable/.

[33] Deloitte. Navigating the New Digital Divide: Capitalizing on Digital Influence in Retail[EB/OL].[2015-12-05] http://argaamplus.s3.amazonaws.com/4964cc22-0d81-418c-a9be-16d5e0b576d0.pdf.

[34] James J. Gibson. The Ecological Approach to Visual Perception[M]. New York: Psychology Press, 2014: 12.

[35] Yves Citton. Automatic Endo-attention, Creative Exo-attention: the Egocidal and Ecocidal Logic of Neoliberal Capitalism[J]. Culture, Theory, Politics, 2019(98): 101-118.

[36] Robert Seyfert, Jonathan Roberge. Algorithmic Cultures: Essays on Meaning, Performance and New Technologies[M].New York: Routledge, 2016: 95.

[37] Webster·J.G, Ksiazek·T.B. The Dynamics of Audience Fragmentation: Public Attention in an Age of Digital Media[J].Journal of Communication, 2012, 62(1): 39-56.

[38] 喻國明,耿晓梦. 算法即媒介:算法范式对媒介逻辑的重构[J]. 编辑之友,2020(7):45-51.

[39] Dan Gillmor. We the Media: Grassroots Journalism by the People[M]. Sebastopol Cavifornia: the People Reilly&Assoc Inc, 2004: 10.

[40] Taneli Heikka, Elias G. Carayannis. Three Stages of Innovation in Participatory Journalism-co-initiating, Co-sensing, and Co-creating News in the Chicago School Cuts Case[J]. Journal of the Knowledge Economy, 2019, 10(2): 437-464.

Virtual and Real Symbiosis: Algorithmic Subjectivity, Intermediary Relationship and Governance Logic in the Data-Driven Era

YE Ni(School of Journalism and New Media, Xi'an Jiaotong University, Xi'an 710049, China)

Abstract: In the era of data-driven development, algorithm, as a high-dimensional medium, engraves the subjectivity characteristics of "Human to Thing" in the dimensions of self-consciousness awakening, polarizing of the interested parties, embodiment and de-embodied communication, control difference, and personalized selection. From the perspective of effective communication and technical concerns, the paper analyzes the relationship between the algorithm subjects and objects. It analyzes the core logic of algorithm governance from the aspects of governance purpose, content review, value judgment and user attention.

Key words: algorithmic governance; algorithmic value; network neutrality; subjectivity relationship; decision game

基金項目:陕西省社会科学基金项目年度项目“智能时代算法价值观极化现象研究”(2020M004);陕西省软科学研究计划一般项目“陕西省科技创新形象传播研究”(2021KRM043);高校基本科研业务费项目“高水平对外开放格局下社交机器人对中国国家形象的影响机制研究”(SK2022153)

作者信息:叶妮(1978— ),女,四川成都人,西安交通大学新闻与新媒体学院副教授、硕士生导师,主要研究方向:媒介研究。