提防利用“AI换脸”技术犯坏

李颖

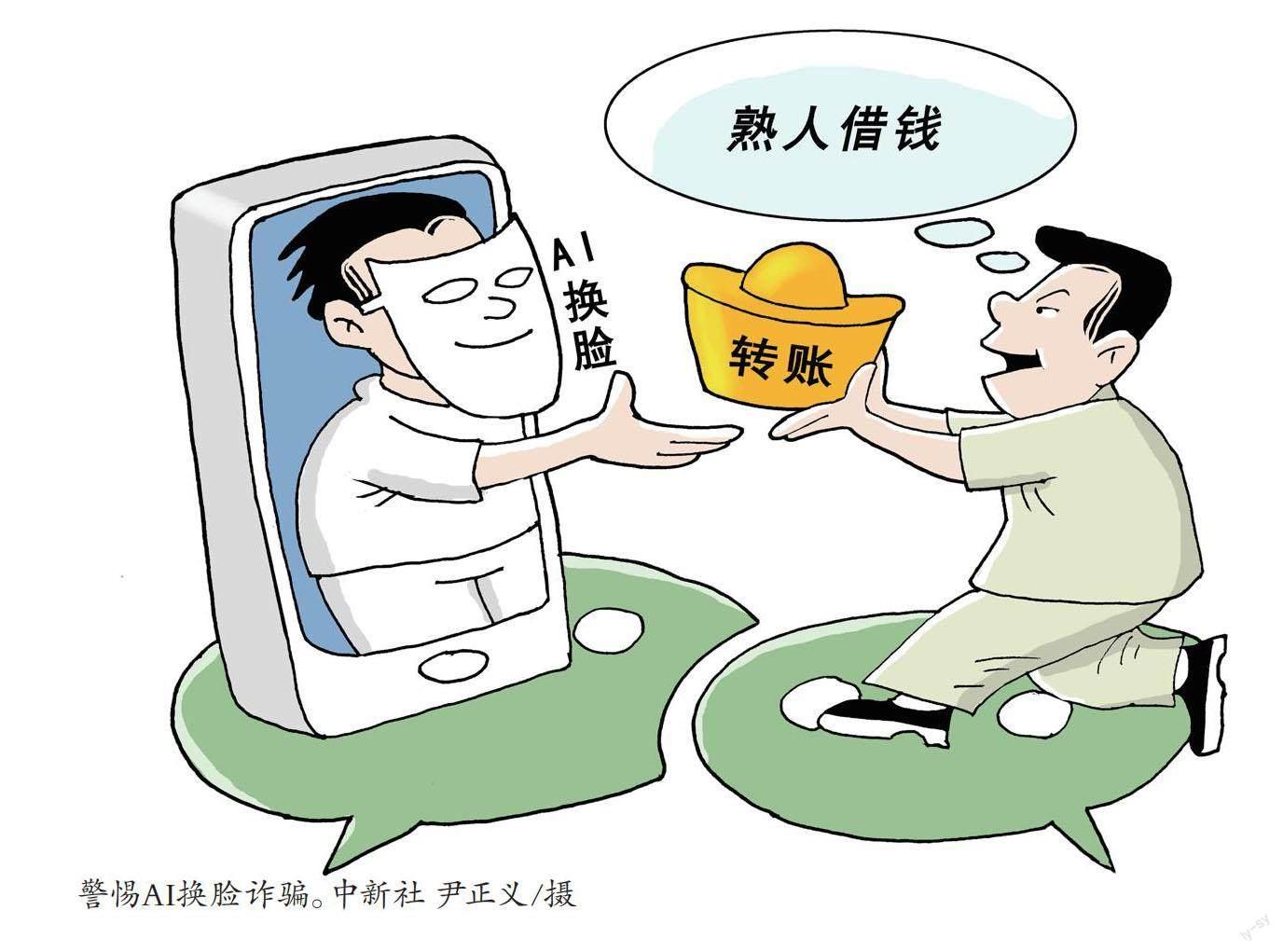

点开直播间乍一看,卖货的竟是当红女星。再定睛一看,“明星”其实是使用人工智能(AI)实时换脸技术的普通主播……近期,“AI换脸”的应用范围越来越广,但存在滥用之嫌,甚至有人利用AI换臉实施犯罪,“AI诈骗正在全国爆发”冲上微博热搜。

揭秘“换脸”骗局

“双刃剑”效应明显

张嘴、摇头,摄像头捕捉到人的动作后,屏幕上原本静态的人像可以动起来,动作幅度和真人一致,还能眨眼和露齿微笑,仿真度颇高,几分钟内就能生成一段视频,脸还能被任意替换。这就是“AI换脸”技术。

据了解,“AI换脸”背后采用的是深度合成技术,利用深度学习、虚拟现实等生成合成类算法,制作图像、音频、视频等信息,目前在社交、影视、广告、医疗等诸多领域不断深化应用,有较大的技术价值和商用潜力,不过也存在着一定的安全隐患,“双刃剑”效应明显。

全联并购公会信用管理委员会专家安光勇对表示,目前AI换脸技术主要通过深度学习和计算机视觉技术实现。它使用了深度神经网络来分析和识别视频中的人脸,并将一个人的脸部特征映射到另一个人的脸上。

在微信视频中,犯罪分子可能会通过发送特制的视频或使用特定的换脸应用程序,将自己的脸替换为受害者的脸,以获取对方的信任并实施诈骗行为。

AI技术存在滥用风险

为规范人工智能发展,去年12月,《互联网信息服务深度合成管理规定》正式发布,明确了合成数据和技术管理规范。其中提到:深度合成服务提供者对使用其服务生成或编辑的信息内容,应当添加不影响使用的标识。提供智能对话、合成人声、人脸生成、沉浸式拟真场景等生成或者显著改变信息内容功能的服务的,应当进行显著标识,避免公众混淆或者误认。

近期,也有平台和企业发布了“关于人工智能生成内容的平台规范暨行业倡议”,明确禁止利用生成式人工智能技术创作、发布侵权内容,包括但不限于肖像权、知识产权等,一经发现,平台将严格处罚。

对于个人而言,除了在形形色色的“明星脸”中保持清醒,避免陷入虚假宣传,更重要的是面对花样翻新的AI诈骗,必须保持防范意识。

中国质量万里行提醒,涉及资金转账时,公众要提高安全意识,通过见面、电话等多种方式核验对方身份;可将转账到账时间设定为“24小时到账”,以预留处理时间;针对支付软件以及网银软件,要使用多种登录及转账验证方式。

针对花样翻新的智能AI诈骗,要提高防范意识,谨慎使用各类“AI换脸”“AI变声”软件;加强个人信息保护意识,避免注册不需要的账号、填写不必要的个人信息,以防个人信息泄露;对不断更新的网络技术和诈骗方式,坚持不轻信、不透露、不点击、不转账。

如不慎被骗或遇可疑情形,请注意保护证据,并立即拨打96110报警。