OpenAI首席科学家宣称大型神经网络或已拥有“轻微自主意识”

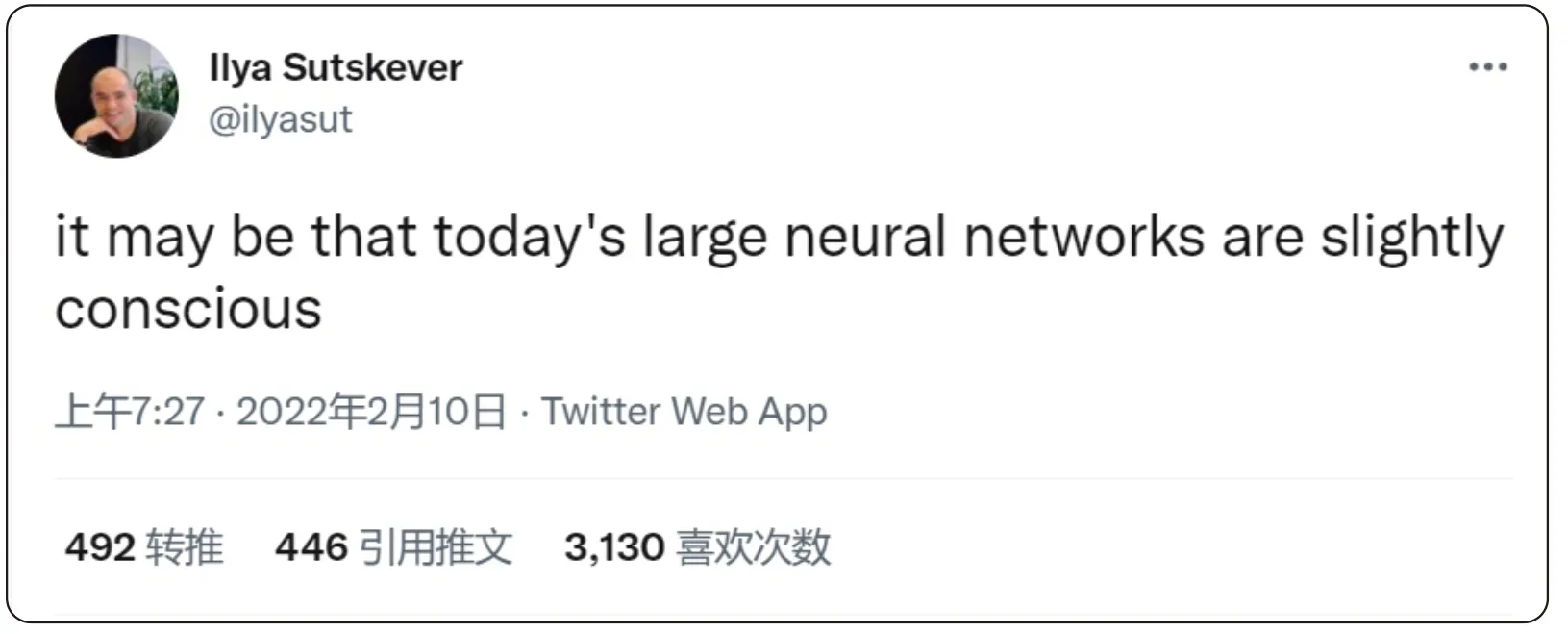

近日,人工智能组织OpenAI的联合创始人、计算机专家伊尔亚·苏茨克维在推特上声称,“当今最大的神经网络可能已拥有轻微的意识”。

伊尔亚·苏茨克维

此言论一出,立刻便在社交媒体上引起轩然大波。

关于人工智能是否拥有意识的争议和讨论,在科研界一直未曾停歇过。而苏茨克维作为OpenAI首席科学家,在深度学习方面曾作出过突出贡献。如此一位有影响力的顶尖科学家突然就此敏感话题发表公开言论,自然而言招致了众多非议。

伊尔亚·苏茨克维推文截图

OpenAI首席科学家“深陷”话题旋

据悉,OpenAI由一众来自硅谷、西雅图的科技巨擘们联合创立,用以预防人工智能可能带来的危害,在人工智能领域拥有广泛影响力。特斯拉首席执行官埃隆·马斯克曾经亦是该组织的创始成员。

但在2019年,马斯克主动宣布离开该组织。据其透漏,离开的原因一方面是担心该组织会在人工智能人才聘用方面与特斯拉产生冲突。另一方面,马斯克认为OpenAI在某种程度上类似于“假新闻发生器”,总是会制造噱头让自己处于舆论中心。

例如,OpenAI在2020年发布了语言模型GPT-3 。然而该系统在首次发布时却被用来创建了一个聊天机器人,用以模仿死去的女人。除此之外,其还被游戏玩家曝露出包含恋童癖内容。这一切都导致OpenAI在舆论方面饱受诟病。

因此,苏茨克维关于人工智能已拥有意识的言论也被许多人认为是炒作。

美国俄勒冈州立大学人工智能专家托马斯·迪特里奇在推特上回应,“如果意识是反思和塑造自己的能力,那么我在今天的网络中还没有看到任何这样的能力,我会认为你是在故意发布煽动性的内容 。”

此外,也有部分科学家认为这种毫无根据的说法会让大众陷入恐慌。

澳大利亚新南威尔士大学西德尼分校人工智能研究员托比沃尔什评论说,“每次这种投机性的评论播出时,都需要几个月的努力才能让话题回到人工智能带来的更现实的机会和威胁上。”

马斯克也曾就人工智能的危险性做出过分析。虽然他站在创造人工智能技术的最前沿,但他同时也意识到人工智能的潜在威胁。

在2014年,他于社交软件上说道,“我们需要对人工智能非常小心,它可能比核武器更危险。”2020年,马斯克再次发声,认为人工智能在智力方面或将超越人类,这并不意味着事情会变得糟糕,但却会使局面变得极其不稳定。

人类水平的人工智能仍在长跑途中

那么,大型神经网络是否真的具有自主意识呢?

图灵奖得主、Meta首席科学家杨立昆直接对苏茨克维的观点予以反驳,他认为即使对神经网络和意识分别用“大型”和“轻微”等词来加以限定,这种说法依旧不正确。

早在2018年,杨立昆就曾明确表示,“人工智能缺乏对世界的基本认识,甚至还不如家猫的认知水平。”

事实上,当前的大型神经网络通常很难脱离数据驱动的范式。这也意味着人工智能所学习的知识依旧取决于人类的“投喂”,其并不具备自主创新的能力,产生意识自然也就无从说起。

而想要使人工智能具备自主意识,拥有表达心情、发现新知识等能力,则需要人类在该领域取得长足的进步。这将是下一代人工智能研究的重点,短时间内则很难成为现实。

不过,并不是所有的学者都对苏茨克维的说法嗤之以鼻,来自麻省理工学院的计算机科学家塔梅·贝西罗格鲁便认同该观点,并积极为其辩护。

“看到这么多杰出的人嘲笑这个想法令人失望,”贝西罗格鲁在推特上说,“这让我对这个领域认真处理一些他们在未来几十年无疑将面临的深刻、奇怪和重要问题的能力降低了希望。”

在贝西罗格鲁看来,即使人类无法将“无意识”和“可能有轻微意识”的模型划清界限,但这个问题本身是非常有意义的,不应该被忽视。

抛开争议本身,我们需要注意到,苏茨克维长期以来一直专注于研究通用人工智能。这是一种以人类或超人能力运行的人工智能,在某种程度上与人类有非常高的相似性。从这个角度来看,苏茨克维提出的说法或许并不显得突兀。

近年来,人工智能发展得越来越迅速,以至于人类陷入一种焦虑,从而不得不与自身创造出来的有意识的计算机这一概念作斗争。

可以预见的是,关于有意识的人工智能的争议,在未来的一段时间里还将会一直延续。但与此同时,这种辩论也将推动人类在如何定义人工智能的意识方面逐步确立规则和界限,从而引导人工智能向善。而这,或许就是科学争论的真正魅力所在。