自动驾驶汽车障碍物检测技术综述

杨晨曦 李军

重庆交通大学 机电与车辆工程学院,重庆 400074

0 前言

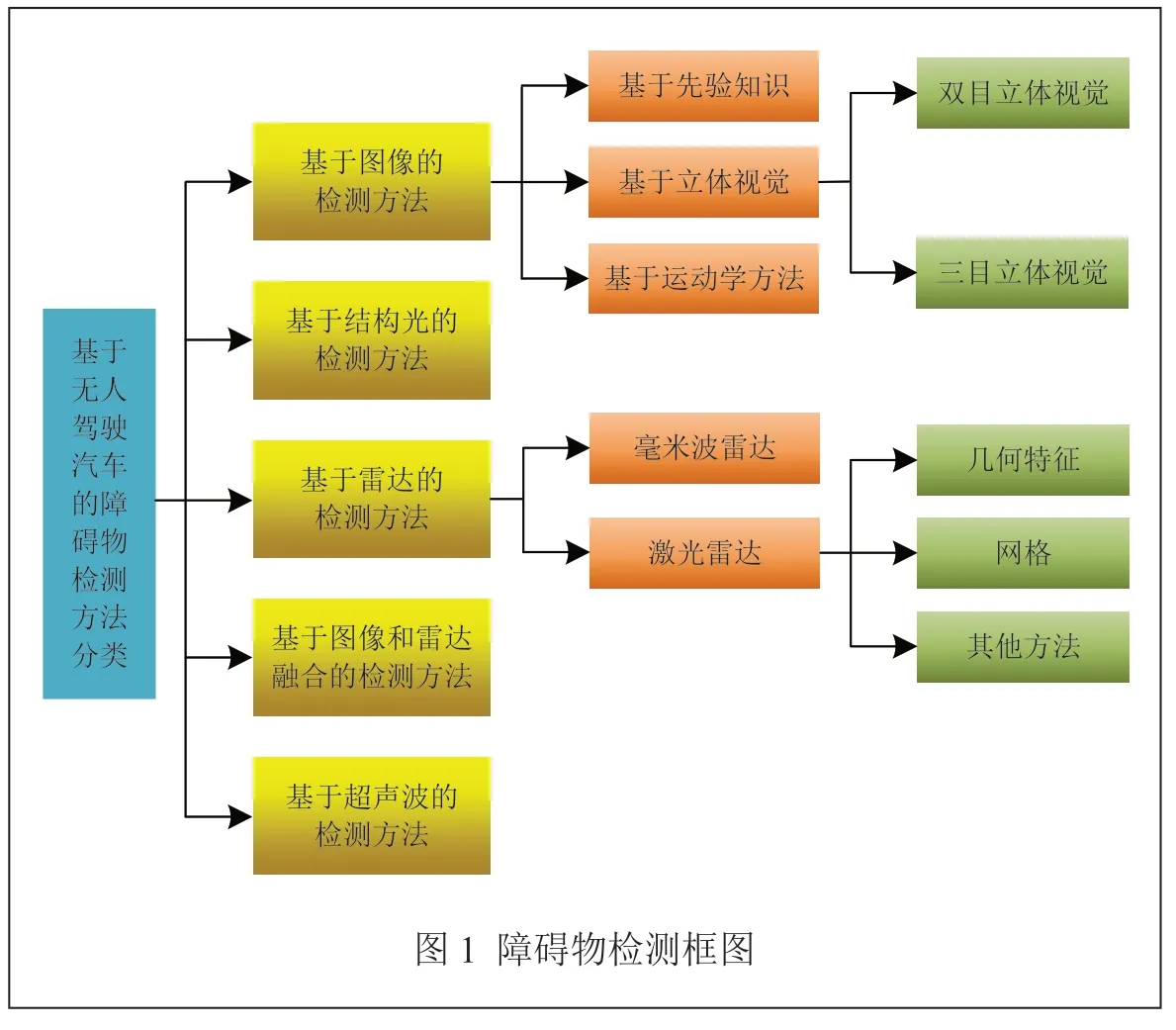

自动驾驶车辆是一个集成了多种ADAS(Advanced Driver Assistance System)的平台,其中,感知系统是开发ADAS 的一个非常重要的部分,如图1 所示,它必须实时、可靠、准确地执行,没有任何误报。针对汽车行驶路线上的障碍物检测技术,研究者提出了多种计算与实现手段,如基于激光雷达的方法,多传感器信息融合的方法和神经网络训练的方法等。本文介绍了电磁波信号、图像信息和多信息融合3 种检测方法,并综述了无人驾驶汽车障碍物检测技术的研究现状。

1 电磁波信息的障碍物检测

1.1 二维激光雷达

激光雷达测量精确,成本低,并能很好地应用于车辆,但对环境条件很敏感,如反射光、发射器和接收器表面的降雨、路面上的水坑、水滴等因素会显著降低检测性能。其中,二维激光雷达可用于平面扫描,结构比较简单,成本较低,系统也相对稳定。

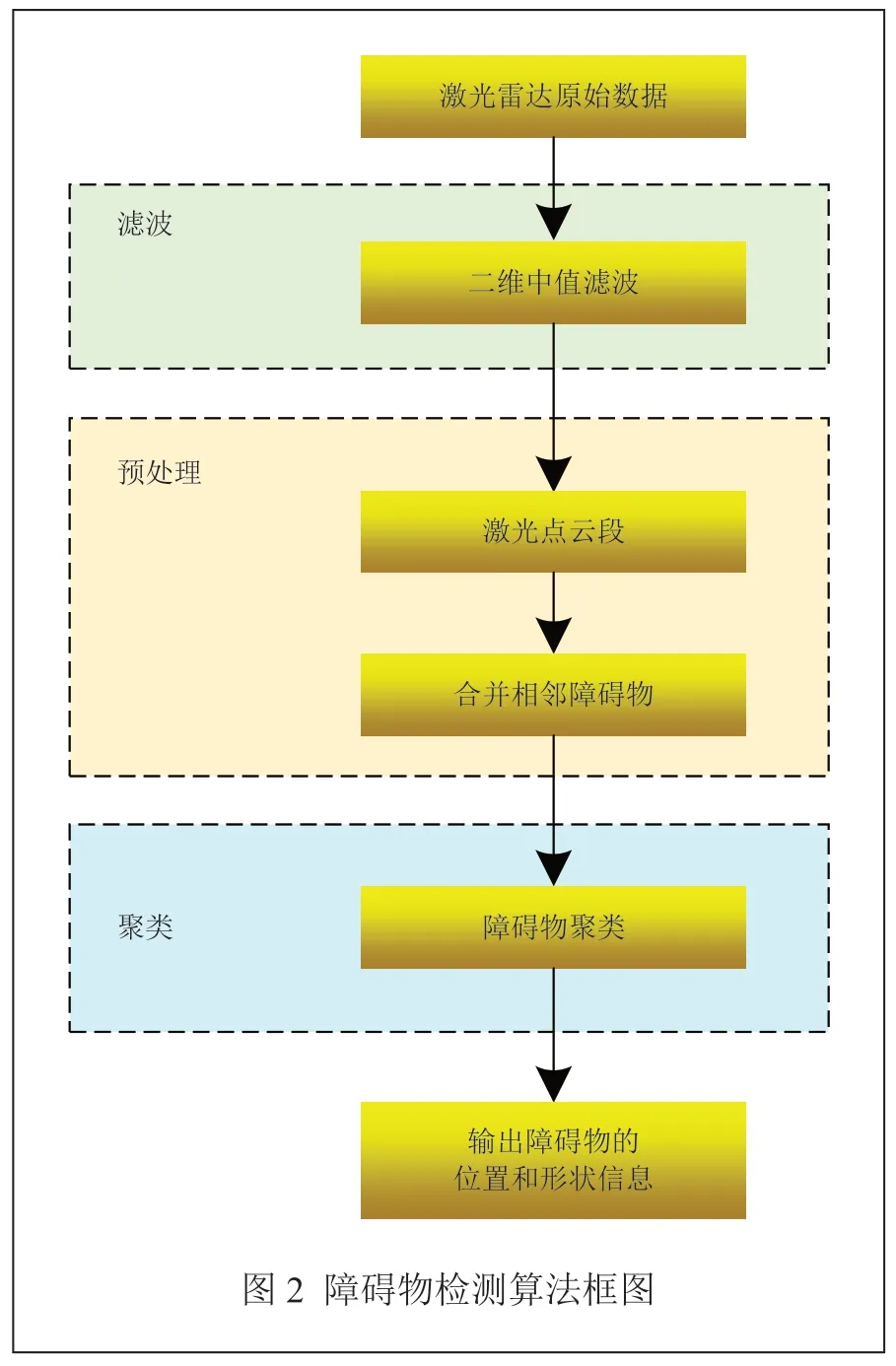

PENG Y 等人[1]提出了一种基于二维激光雷达信息的、安全高效的障碍物检测和自动避障算法,算法框图如图2 所示。该检测算法可通过计算机对激光雷达点云数据信息进行滤波运算和聚类分析,以实时获取障碍物信息,并使用KITTI 数据库得到的实验结果验证了所提出的方法在城市场景中的适用性和有效性。该障碍物检测和避障算法具有数学模型简单、实时性好的优点,但同样只能检测静态障碍物,具有一定的局限性。

为解决上述问题,TAKAHASHI M 等人[2]开发了一个基于二维激光雷达和高速嵌入式微控制器的紧急避障模块。该模块可以用来检测静态和动态障碍物,包括人行道上的路肩、行人和车辆等。其中,激光雷达用来检测障碍物,微处理器用来预估障碍物的运动以及快速启动紧急避障系统。此方法弥补了不能检测动态障碍物的缺陷。

1.2 三维激光雷达

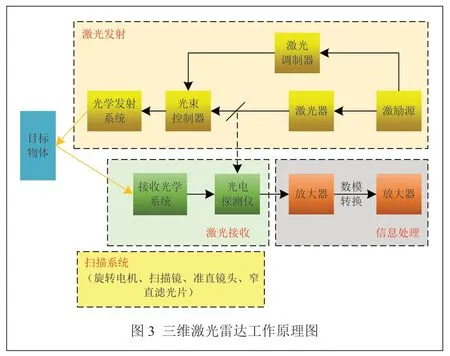

与二维激光雷达相比,三维激光雷达能够获取更全面的空间三维信息,更广的检测范围,实现更优的检测效果。其工作原理图如图3 所示。

LARSON J 等人[3]提出了一种利用三维激光雷达检测负障碍物的方法。首先对地形进行分析和估计,然后利用支持向量机(support vector machine,SVM)分类器来识别地形中的负障碍物。负障碍检测的最佳解决方案是短距离SVM 和远程负障碍检测的结合。在此基础上,SHANG E 等人[4]提出了一种新的三维激光雷达装置,以提高扫描线的密度,使其检测负障碍物更容易。采用支持向量机对背景中的负障碍进行分类,同时,在贝叶斯框架下对特征进行组合,试验验证了该方法的有效性。

1.3 毫米波雷达

毫米波雷达传感器是一个工作频段在毫米波波段以上的高精度传感器。与其他激光雷达产品相比,毫米波雷达系统对雾、烟、灰尘、云的检测、穿透、拦截能力极强,受外界恶劣环境干扰影响小,但过于昂贵,并且在向多个方向探测目标方面表现也不够好,其工作原理图如图4 所示。南京航空航天大学吴荣燎等人[5]应用毫米波雷达来设计自动安全行车驾驶及辅助系统,省去许多人工反应时间。

毫米波雷达传感器技术在高速路面动态障碍物信息实时检测及采集处理方面也进行了广泛和深入的研究以及应用,主要是用来实时检测体积密度较大和结构复杂的块状障碍物,但实际上,它实时输出后得到的低速路面动态障碍物信息还是相当复杂,对雷达信号和滤波电路等信号处理算法方面仍然有着很高的计算性能要求,并且还是比较难以快速深入地检测道路障碍物的具体细节。

2 图像信息的障碍物检测

虽然雷达和激光传感器可以高精度地测量到障碍物的距离,但很难获得它们的横向位置。然而,横向位置信息是估计碰撞可能性所必需的,此时就需要用到基于视觉的障碍物检测系统。

2.1 单目视觉

单目视觉用一个摄像头就可以完成相应工作的检测技术[6]。基于实时单目视觉的车辆智能障碍物识别系统是当今全球智能车辆机器视觉算法的一大主流。但单视觉方法存在的缺点是在距离估计、被检测物体的识别以及在匹配不同位置物体真实尺寸的同时,对物体类别进行分类算法的复杂性。

SAHA S 等人[7]提出了一种基于实时单目视觉的障碍物检测、规避与识别技术,并设计了一个实时数学模型来准确估计出从摄像机到障碍物之间的一个实时的相对安全距离。该技术响应速度快,但因为捕获的图像中检测不到足够的特征点,所以在图像模糊和黑暗环境下表现效果不好。

为了解决这一问题,JIA B 等人[8]提出了一种能够有效地通过阴影和路面标记来区分障碍物的实时障碍物检测方法。该方法通过连续帧分离出真实的障碍物和具有运动特征的路面标记,然后引入滤波器来增加正确检测障碍物区域的概率,最后有一个更新过程以减少假阳性。

2.2 立体视觉

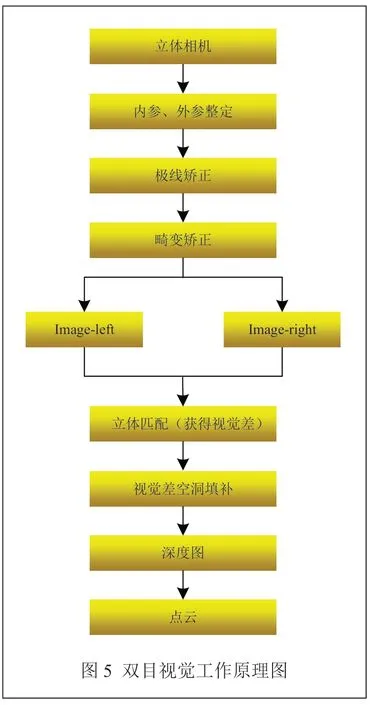

双目立体视觉通常是指用两台一样的摄像机,从两个视角观察同一景物,其工作原理图如图5 所示[9]。双目摄像头因其成本较低,测量距离较为精准,而且可以测量障碍物深度等优点而被广泛应用于障碍物检测技术[10]。

但是双目摄像头也有它的局限性。当图像包含复杂的道路场景时,神经网络分类器在检测特征方面的性能会受到限制,此外,神经网络需要大量的图像样本和训练时间,计算负荷较大[11]。

为解决这一问题,HUH K[12]根据检测到的车道信息,选择感兴趣区域(region of interest,ROI)以减少计算负担。障碍物检测系统被设计为可以提供领先车辆和切入车道的侧方车辆的位置。采用鲁棒方法选择检测到的障碍物的数据对,并通过特征匹配和特征聚合来确定合格的对。在初始检测后,系统对障碍物执行跟踪算法,并对自身车辆与障碍物之间的距离和航向角等参数进行估算,可以有效地进行障碍物检测与避障。

3 多信息融合的障碍物检测

车辆环境感知功能的实现以传感器对车辆周围环境信息的采集为基础,所采集数据的准确性与完整性直接影响到后续感知识别的准确性,而单传感器进行数据采集时往往存在环境鲁棒性低,稳定性差,检测盲区明显等缺点。为了能够全面地获取驾驶环境信息,使用多传感器进行环境感知成为了当下的主流。

3.1 融合方式

无人驾驶汽车的多传感器信息融合技术是最近的研究热点[13]。目前,主要有三种用于障碍物检测的传感器组合,包括相机与激光雷达(camera and laser radar,CL)、相机与毫米波雷达(camera and millimeter-wave radar,CR),以及相机-激光雷达-毫米波雷达(camera,laser radar and millimeter-wave radar,CLR)传感器组合,其中最常用的是相机与毫米波雷达的传感器组合[14]。

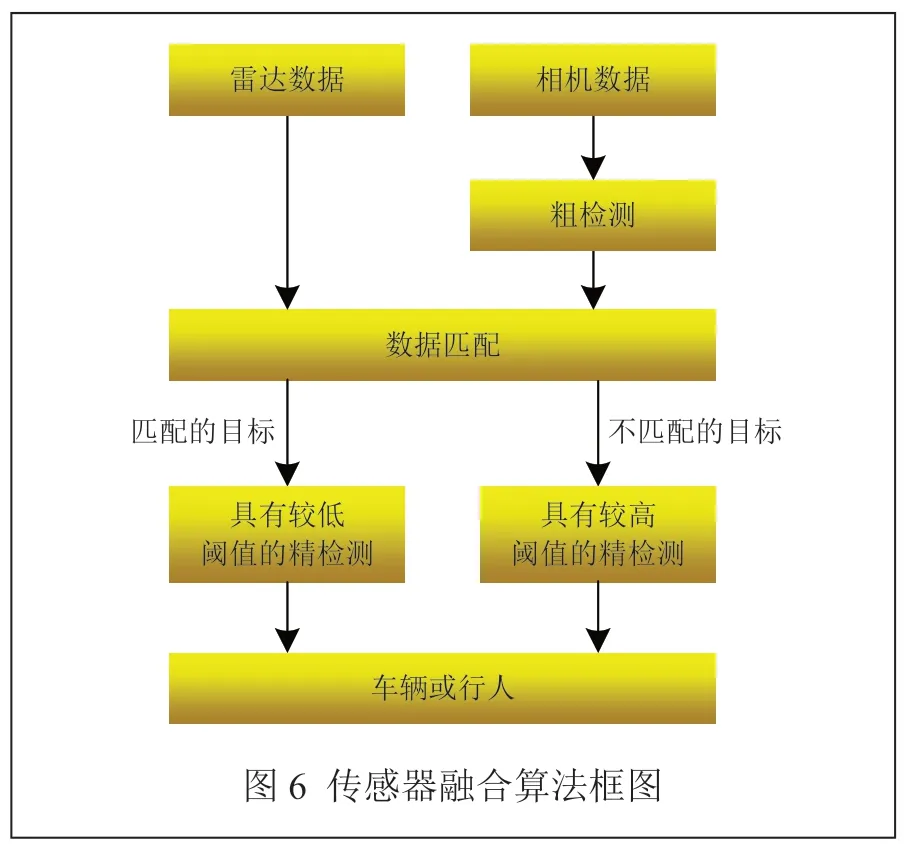

BI X 等人[15]提出了一种基于毫米波雷达信号和相机图像信息的动态车辆追踪检测技术和静态行人的跟踪与检测的新方法,融合算法框图如图6 所示。

上述方法能有效对障碍物进行检测,但存在以下问题:(1)毫米波雷达和相机数据融合后计算量较大;(2)雷达的ROI 的大小是基于先验知识来设置的;(3)ROI 的大小和位置都是估计值,可能会导致信息不完整或信息过多,增加了分析的难度。

ZHANG X 等人[16]利用毫米波雷达来获取障碍物的信息,并通过对数据进行滤波,提取出有效的目标;然后,利用坐标系转换和摄像机参数校准,将有效目标投影到图像平面上,生成感兴趣区域;最后,基于图像处理和机器学习技术,对ROI 中的车辆目标进行检测和跟踪。该方法不需要对整个图像进行处理,大大减少了数据处理量,提高了算法的效率,更有利于工程实现。

CL、CLR 传感器组合可以提供更大范围的分辨率,并通过激光雷达点云和深度地图信息精确地了解周围环境,提高整个自主系统的安全冗余度[17]。WU T E等人[18]研究了基于激光雷达与相机融合的行人检测技术,利用激光雷达深度传感器返回的三维点云信息对物体的形状进行进一步的检测,以减少在基于相机的行人检测中经常出现的假阳性率和物体遮挡问题,其提出的激光雷达与相机融合设计弥补了两个传感器的缺点,在检测方面比其他传感器更稳定。

3.2 融合水平

除了上述分类方法,传感器信息融合还可以分为高水平融合(high-level fusion,HLF)、低水平融合(low-level fusion,LLF)和中级融合(mid-level fusion,MLF)。高级融合是指每个传感器分别执行检测或跟踪算法,然后将结果组合成一个全局决策。SHAHIAN JAHROMI B 等人[19]利用高水平融合的方法来融合处理后的数据,即独立地处理雷达信号和激光雷达点云信号,然后使用非线性卡尔曼滤波方法来检测障碍物和目标跟踪。

YOO J H 等人[20]提出了一种新的三维目标检测方法,使用低水平融合的方法来处理激光雷达和相机的数据,使用基于感兴趣区域的特征池分别融合激光雷达和相机的特征。该方法可有效融合从相机和激光雷达数据中分别提取的空间特征图,并在KITTI 和nuScenes 数据集上对所提出的方法进行评估,其目标检测结果优于KITTI 排行榜中先进的3D 目标检测器。但是,在实践中,LLF 方法也带来了许多挑战,尤其是在其实现方面,需要对传感器进行精确地校准。

MLF 也被称为特征级融合,是LLF 和HLF 之间的一个抽象级别。它融合了从相应的传感器数据中提取的多目标特征,如从雷达和激光雷达的图像或位置特征中提取的颜色信息,然后对融合的多传感器特征进行识别和分类。LI Y 等人[21]提出了一种特征级融合的框架,用于在计算和通信能力有限的情况下,以较低的错误率实现对动态环境的目标检测。利用符号动态滤波(symbol dynamic filtering,SDF)算法从多个红外传感器中提取低维特征,然后将提取的特征融合为集群,用合成聚类(agglomerative hierarchical clustering,AHC)算法进行移动目标的检测。但是,其需要很大的训练集来找到最重要的特征子集。在提取和融合每个传感器的特征之前,需要进行精确的传感器校准。

4 结束语

本文分别介绍了基于电磁波信息、图像信息和多信息融合3 种方法对周围环境进行感知,分析了其各自的优缺点(见表1)。综合上述分析,车辆环境感知功能的实现以传感器对车辆周围环境信息的采集为基础,所采集数据的准确性与完整性直接影响到后续感知识别的准确性,而单传感器进行数据采集时往往存在环境鲁棒性低,稳定性差,检测盲区明显等缺点,难以应对全天候、全天气、全场景的驾驶环境。如果将多种传感器获取的信息进行综合分析,就可以大大提高系统的准确性和鲁棒性,提高无人驾驶车辆的安全性。因此,利用多传感器融合技术对环境进行感知正在得到越来越多的应用,也是科研人员的研究热点。然而,传感器融合面临着很多问题,比如时空同步问题,各模态数据增强后的特征如何对齐,如何有效融合实现1+1>1,如何实时在车辆上运行等,这将是需要进一步去解决的问题。

表1 各检测类型的优缺点