基于YOLO v4+HSV的成熟期番茄识别方法

李天华,孙 萌,丁小明,李玉华,2,张观山,2,施国英,2,李文显

基于YOLO v4+HSV的成熟期番茄识别方法

李天华1,2,4,孙 萌1,丁小明3,李玉华1,2,张观山1,2,施国英1,2※,李文显1

(1. 山东农业大学机械与电子工程学院,泰安 271018; 2. 山东省农业装备智能化工程实验室,泰安 271018;3. 农业农村部规划设计研究院设施农业研究所,北京,100125; 4. 农业农村部黄淮海设施农业工程科学观测实验站,泰安 271018)

为解决成熟番茄采摘识别中由于藤蔓、叶片、果实遮挡或光照影响而引起的误识别问题,该研究提出了一种基于YOLO v4与HSV(Hue, Saturation, Value)相结合的识别方法,以实现自然环境下成熟期番茄的准确识别。在YOLO v4网络的检测框内通过HSV方法对番茄的红色区域进行分割,并将分割面积在检测框中达到一定占比的番茄作为目标输出。通过对比不同占比下该算法对测试集的识别效果,将16%作为成熟期番茄识别算法的占比,该占比下YOLO v4+HSV算法的正确率为94.77%,在工作站中检测单幅图片的速度为25.86 ms。为验证算法的性能,对改进前后算法进行了比较,改进后的正确率比改进前提高了4.30个百分点,说明通过HSV处理能够提高原网络识别成熟期番茄的准确性。此外,为测试算法的实用性,统计了在不同类型设备上该算法从调用深度相机到检测到第一个目标番茄所用的时间,经计算,其在工作站上所用的平均时间为0.51 s,在微型工控机上为1.48 s,均可满足实际采摘需要。该研究可为果蔬采摘的准确高效识别提供借鉴。

图像分割;识别;番茄;采摘;YOLO;HSV

0 引 言

番茄采摘作为其生产的重要环节之一,目前仍以人工为主,劳动强度大,成本高。机械采摘可降低成本,提高效率,已成为近年来研究的热点[1-3]。识别是实现采摘的前提,提高识别准确率可减少机械采摘非目标番茄的次数,对采摘效率的提升具有重要意义。实际生产中存在的重叠、遮挡等多种干扰因素为正确识别带来一定困难,而成熟的番茄若不及时采摘,则会影响果实的品质与经济效益。因此,准确高效识别是实现番茄机械采摘的前提[4]。

对于与背景颜色差异较大的目标果实,利用颜色特征提取图像中的目标果实区域是较为简单的方法[5]。滕大伟等[6]通过融合G-B(Green-Blue)因子和空间信息的区域生长法,实现了茄子的识别分割。孙建桐等[7]利用2R-G-B(Red, Green, Blue)法突出图像中红色分量,得到了成熟番茄果实区域。董建民等[8]通过融合HIS(Hue, Saturation,Intensity)颜色空间和Lab(CIELAB)颜色空间的分割结果对西红柿进行了识别。梁喜凤等[9]通过对R-G(Red-Green)直方图采用最大类间方差法(Otsu)对目标番茄串进行了分割。利用颜色空间对成熟番茄进行分割的识别方式,具有计算速度快、实时性高的优点,但鲁棒性低,难以适应复杂环境下的识别分割。

传统的深度学习目标检测算法主要分为2种:一种是one-stage目标检测法,不产生候选区域,检测速度较快[10],代表算法有YOLO[11]、SDD[12]等。赵德安等[13-15]基于YOLO v3对苹果进行了检测。吕石磊等[16-18]通过改进YOLO 网络实现了柑橘的识别。陈燕等[19]将YOLO v3与DenseNet进行结合,实现了荔枝串的检测。刘芳等[20]提出了一种改进型多尺度YOLO算法——IMS-YOLO(Improved multiscale YOLO),对番茄进行检测。周伟亮等[21]利用SSD算法对荔枝进行快速品质检测。另一种是two-stage目标检测法,其通过对获得的建议区域进行分类实现检测,检测速度较低,但精度较高,代表算法有FasterR-CNN[22]、Mask R-CNN[23]、Cascade RCNN[24]等。闫建伟等[25]基于FasterR-CNN实现了对刺梨果实的识别。王文杰等[3]通过扩展Mask R-CNN算法模型对粘连番茄果实进行了区分识别。岳有军等[26]利用改进的Cascade RCNN网络实现了对绿果番茄与不同成熟阶段番茄的区分识别,但没有进一步区分转色期和成熟期的番茄。

由于实际采集的成熟期番茄图像中存在被藤蔓、叶片、果实遮挡及颜色发生变化的样本,受该部分样本影响,网络进行学习后,存在将转色期番茄错误识别为成熟期番茄的情况。本文在YOLO v4网络的检测框内通过增加HSV处理,分割番茄的红色区域,并将分割部分面积在检测框中达到一定占比的作为目标输出,减少了误识别率,提高了识别正确率,满足了精细化采摘的要求。

1 图像采集及数据集制作

训练与测试中所用的番茄图像拍摄于2020年12月18日至2021年1月8日,拍摄时间为上午9:00-10:00和14:00-16:00,拍摄地点位于山东农业大学南校温室,共获取含有成熟期番茄的有效图片885张,包含单果189张、多果696张,遮挡及重叠625张等多种样本。图像采集设备为Realsense D435i相机,保存为640×480像素的RGB图像。

为进一步增加样本多样性,同时适当控制样本数量,减小模型训练时间,随机挑选500张图像通过模糊、增亮、昏暗、旋转和噪声5种方法进行数据增强,如图1所示。去掉增强后不清晰的图片,最终保留2 871张图片。按照8:2的比例对数据集进行划分,其中2 330张图片作为训练集,541张作为测试集。通过双线性插植法对图片进行缩放,使其最终尺寸均为416×416像素,并按VOC数据集的格式对图像中的成熟期番茄进行人工标注。

2 成熟期番茄识别方法

2.1 基于YOLO v4的番茄检测模型

相比于YOLO v3,YOLO v4[13]在Darknet 53的每组Residual block 中均加入了一个 CSP(Cross Stage Partial)结构[27],以减少计算量和内存消耗。CSP将输入分为2部分,一部分通过block进行计算,另一部分直接通过一个shortcut进行连接,如图2所示。此外,将SPP(Spatial Pyramid Pooling)附加模块与PANet(Path Aggregation Network)路径聚合作为网络的颈,可更好地融合所提取的特征。

注:w为宽度;h为高度;i为输入通道数;o为输出通道数。

基于YOLO v4的检测过程如图3所示。首先将输入图像的尺寸调整为416×416像素,然后通过网络中不同的卷积层分别获得52×52、26×26、13×13三个不同尺度的特征图,最终实现目标的检测。检测结果中包含了5个预测参数:、、、和置信度,其中和代表目标番茄的坐标,和代表番茄外接检测框的宽度和高度,置信度为预测框与地面真值间的交并比IoU(Intersection over Union),反映了检测框预测的准确度。

注:CSPDarknet53为网络的主干部分;SPP为空间金字塔池化;PANet为路径聚合网络。

2.2 基于YOLO v4改进的识别方法

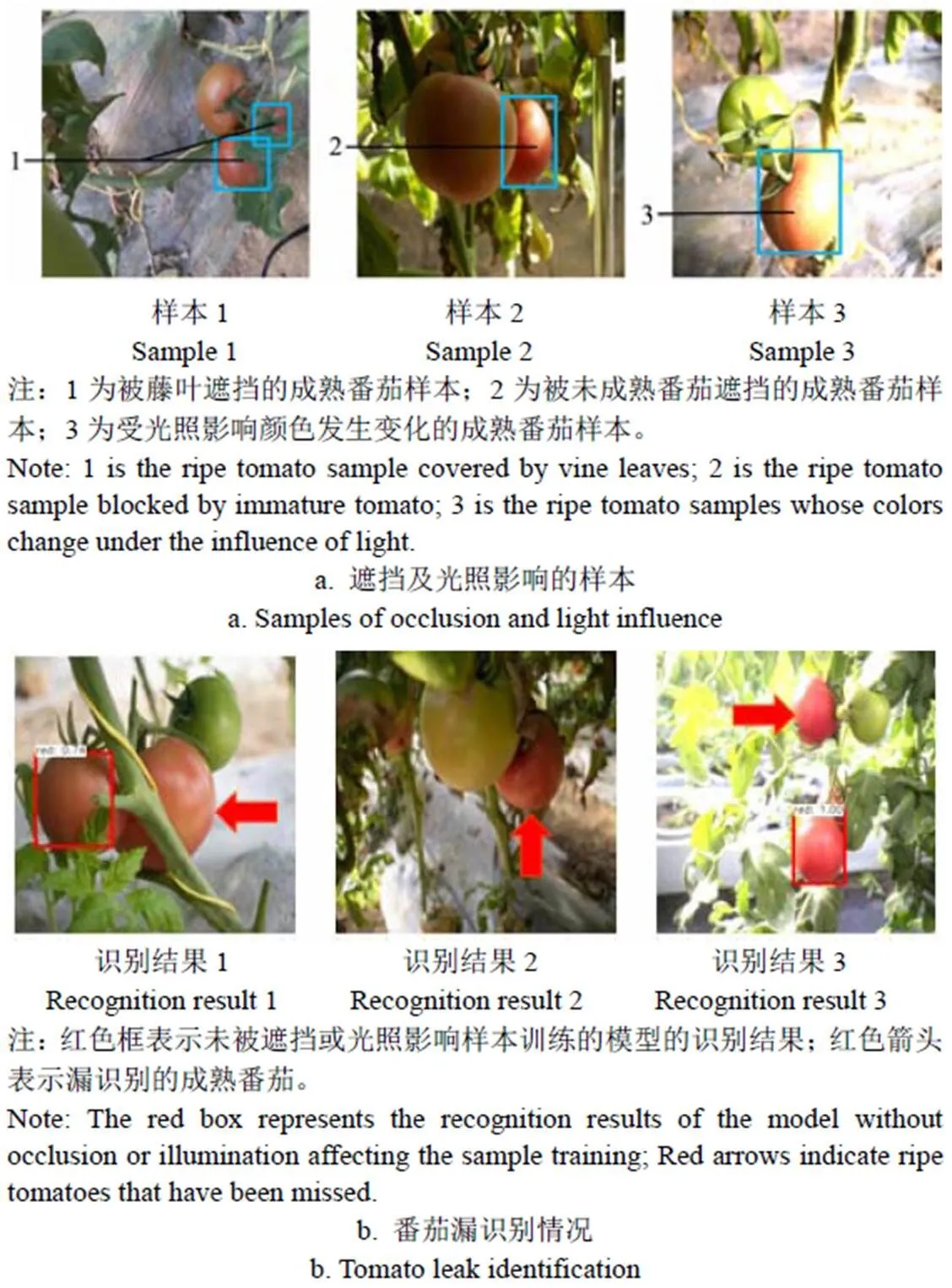

由于番茄实际采摘环境比较复杂,使得拍摄的图像中存在藤蔓、叶片、果实遮挡及受光线影响颜色发生变化的样本,如图4a所示。前期研究发现,在未加入此类样本训练时,模型在测试集的漏检率高达26.37%,存在较多成熟番茄被漏识别,如图4b所示;加入此类样本训练后,模型的漏检率降低至3.59%,但识别错误率增加了2.76个百分点,误识别情况如图4c所示。由于成熟番茄与背景颜色差异较大,利用颜色特征可较为简单地提取出图像中的果实区域且计算成本较低[2],因此本文在YOLO v4的基础上加入了HSV(Hue, Saturation, Value)颜色分割,以剔除遮挡与光照对样本影响,提高识别正确率。

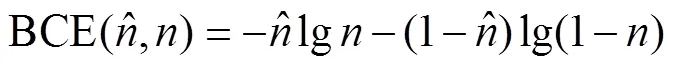

HSV(Hue, Saturation, Value)与RGB(Red, Green, Blue)相比能够更直观的表达颜色的明暗程度、鲜艳程度以及色调,且亮度对色彩的影响较小,常用于分割指定颜色的目标。首先从图像中提取出YOLO v4的检测框部分,并将框内的RGB图像转换为HSV图像,其转换公式如下:

式中为色调;为饱和度;为亮度;为红色值;为绿色值;为蓝色值。

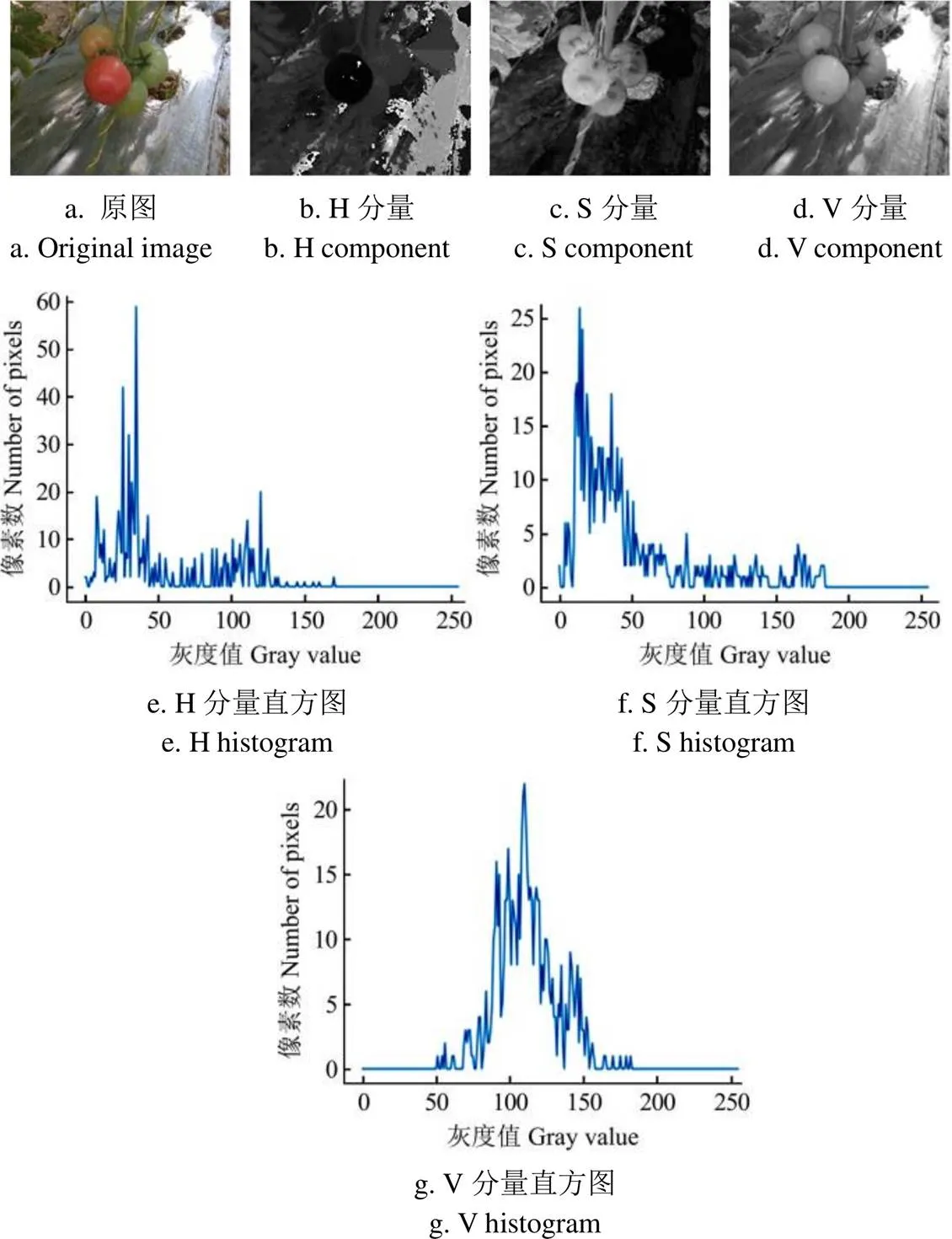

将得到的HSV图像转化为H、S、V 三个颜色通道图像,各通道图像及直方图如图5所示,由图可知在H通道下,直方图具有2个差距较大的波峰,因此将H分量作为分割背景和成熟期番茄的依据。

图5 HSV各通道图像及对应直方图

沿H分量对检测框内的红色部分进行分割,并进行二值化处理,计算分割部分在检测框内的面积占比。由于分割部分大多为不规则图形,为了准确地表示分割部分在检测框内的占比情况,本文用像素数量代表面积,通过计算分割部分的像素数在检测框总像素数中的占比,判断检测框内的果实是否为成熟番茄。像素占比计算公式如下:

式中为红色番茄在检测框内的占比;为分割部分的像素;和分别为YOLO v4检测框的宽度和高度。

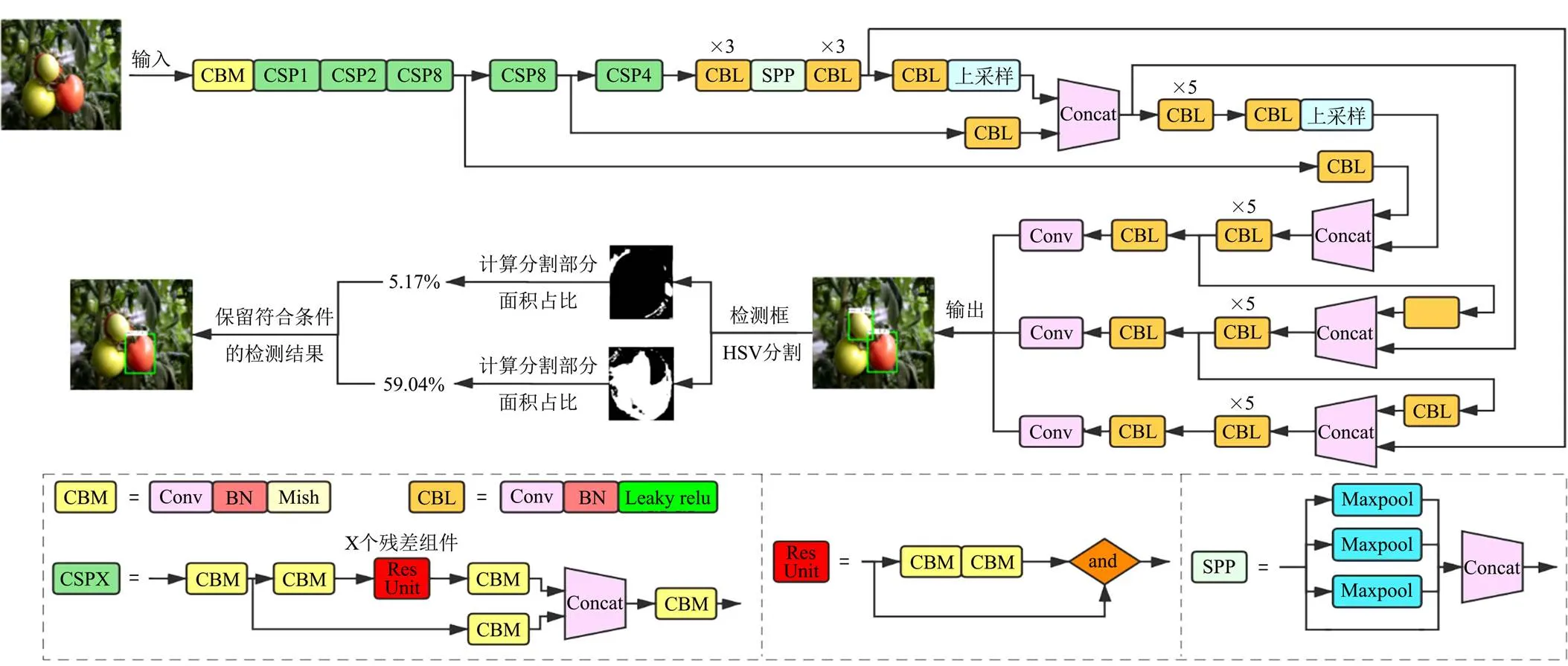

选择合适的占比可以提高识别正确率,但占比设置过大,意味着番茄的红色部分需要在检测框内占有较大的面积,对于遮挡较多的果实易出现筛选过度的情况,使得目标遗漏;若占比设置过小,则对未成熟番茄不能起到筛选的作用。通过比较不同占比时的识别正确率、漏检率和错误率,选取合适的占比作为筛选条件,将超过该占比的作为目标并输出检测结果,未达到该占比的目标剔除,具体识别过程如图6所示。如图6所示,模型主要由下方虚线框内的模块组成:其中,CBM (Convolution, Batch normalization, Mish)和CBL (Convolution, Batch normalization, Leaky relu)模块均用来提取图像特征;CSP(Cross Stage Partial)模块用于提高网络的学习能力;SPP(Spatial pyramid pooling)模块包括了不同尺度的最大池化层,用于增加感受野。

注:Conv为卷积;BN为标准化;Mish和Leaky relu为激活函数;Maxpool为最大池化。

3 YOLO v4训练与模型测试

3.1 硬件及软件配置

网络的训练在工作站进行,其主要配置为i9-9900k CPU @3.60GHz *16、64 GB内存和显存8 GB的GeForce RTX 2080SUPER GPU。所用系统为Ubuntu18.04LTS,使用Darknet框架搭建网络,且安装有CUDA 11.0、CUDNN 8.0.1和python 3.7。

训练时将32 张图片为一组迭代到网络,动量(Momentum)设置为 0.949,权值衰减(decay)设置为 0.000 5,起始学习率(learning rate)设为 0.001,当迭代至6 400次和7 200次时均衰减10倍。此外设置老化(burn_in)参数为1 000,以稳定模型。

3.2 模型测试与评估

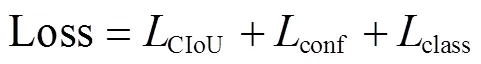

本次训练共迭代了8 000次,其Loss变化曲线如图7a所示,由边界框损失(CIoU)、置信度损失(conf)和类别损失(class)3部分组成[28]。其计算公式如下:

式中IoU为交并比;为预测框和真实框2个中心点之间的欧氏距离,像素;为最小包围框的对角线距离,像素;为权重系数;为长宽相似比;gt和gt分别为真实框的宽和高;和分别为预测框的宽和高,像素。

由图7a可知,模型在前1 000次迭代中Loss值迅速降低,在4 000次迭代后逐渐趋于平稳,模型达到稳定状态。

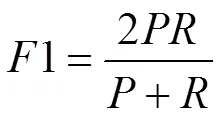

本次训练中,设置每1 000次迭代输出一个权重(weights)文件,并通过平均精度均值(Mean average precision, mAP)与1值对模型性能进行评估。1值综合考虑了准确率和召回率,可以反映模型的稳定程度,其值越大代表模型越稳健,其计算公式为

式中为准确率;为召回率。

准确率()表示在所有检测为正样本的结果中真正的正样本所占的比例,可以反映模型对负样本的区分能力,其计算公式为

式中TP为预测与实际均为正确的样本;FP为检测误以为正确的样本。

召回率()表示在整个数据集中真正为正样本的结果中被检测到的正样本所占的比例,可以体现模型对正样本的识别能力,其计算公式为

式中FN为检测误以为错误的样本。

平均精度均值(mAP)表示各类别平均精度的平均值,用于评价模型的整体性能。

式中为类别的数量;()为准确率相对于召回率的变化情况,即-曲线。

本文先比较了8个weights文件的mAP值,其中迭代7 000和8 000次时weights文件的mAP值相对最高,分别为0.983、0.977。然后比较了2个文件的1值,分别为0.91和0.92,并绘制了对应的-曲线,如图7b所示。由图7b可知,迭代7 000次时所保存的权重文件性能更优,因此选取其作为识别成熟期番茄的模型。

图7 Loss值变化曲线与P-R曲线

4 试验结果与分析

为确定占比选取,比较了不同占比下本算法的识别效果;为了验证算法的实用性,分别在工作站和配置为i7-7600U CPU的微型工控机上,测试了改进后的YOLO v4 算法从调用Realsense深度相机到检测到目标番茄所用的时间。试验中所用的测试集中共有541张照片,包括遮挡、未遮挡、顺光、逆光等多种成熟番茄样本共计760个。

4.1 占比选取

利用HSV对检测框内番茄的红色区域进行分割,并计算分割部分在检测框中的面积占比,占比越高,检测结果是成熟期番茄的可能性越大,但漏检番茄数也会增加;占比越低,漏检番茄数越少,但难以排除非成熟期番茄。将目标番茄总数与误识别的番茄数量作为总体(Sum,),识别出的成熟番茄在总体中的占比作为识别的正确率(Accuracy, %),误识别的非成熟番茄的占比为错误率(Error rate, %),未检测出的成熟番茄的占比为漏检率(Missing recognition rate,, %),计算公式如下:

式中为正确率,%;为错误率,%;为漏检率,%;为番茄总体数;1为识别出的成熟番茄数;2为误识别的非成熟番茄数;3为未识别出的成熟番茄数。

前期分析表明,在占比大于20%和小于10%时识别正确率下降较大,严重影响识别结果。为进一步确定占比选取,对10%~20%区间占比的识别效果进行了测试,如图8所示。由图8可知,占比为16%时正确率最高,为94.77%,漏检率和错误率分别为4.58%和0.65%;占比为20%时,错误率为0,但漏检率相较于占比为16%时增加了0.95个百分点,且随着漏检番茄数的增加,正确率降低。综合考虑各指标,本文选取了正确率最高的16%作为成熟期番茄识别算法设置的占比。

图8 分割像素占比在10%~20%时的识别效果

4.2 算法性能对比试验分析

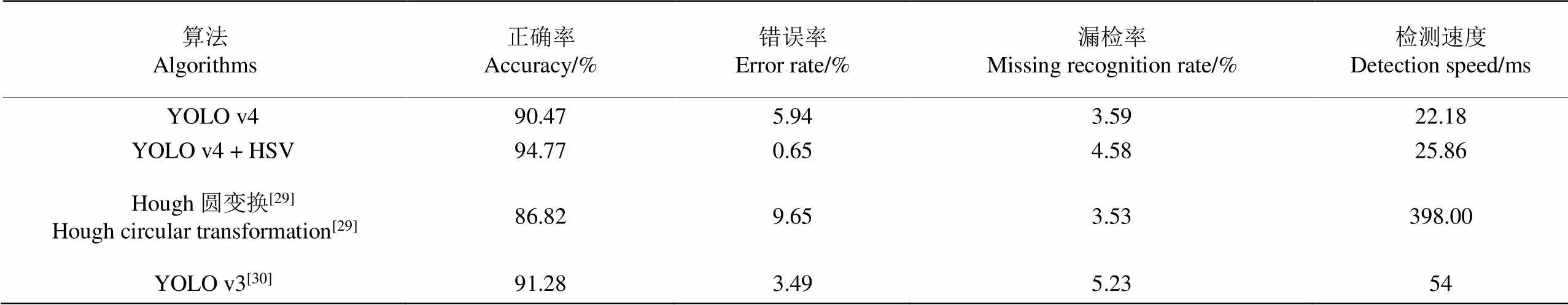

为了验证改进后算法的性能,与YOLO v4、冯俊惠等[29]提出的改进Hough圆变换算法、Liu等[30]提出的改进YOLO v3算法进行对比,计算结果如表1所示。由表1可知,YOLO v4 + HSV算法识别的正确率为94.77%,比改进前增加了4.30个百分点。YOLO v4的识别错误率为5.94%,误识别的结果中72.92%是转色期番茄,27.08%是绿熟期番茄;改进后算法的识别错误率为0.65%,比改进前降低了5.29个百分点。改进后算法的漏检率相较于原算法增加了0.99个百分点,其中83.33%是受果实颜色变化影响的结果,16.67%是由于遮挡较多引起。改进前后的识别效果如图9所示。由图9可知,改进后算法相比于改进前能够有效去掉误识别的未成熟番茄。

表1 不同算法的性能对比

注:图9b和9c中的绿色框分别表示YOLO v4和YOLO v4+HSV的识别结果;9b中的蓝色箭头表示误识别的未成熟番茄。

相比于识别目标同为成熟期番茄的改进Hough圆变换算法,本文的识别正确率增加了7.95个百分点;对于改进的YOLO v3算法,识别正确率增加了3.49个百分点。

岳有军等[26]提出的改进Cascade RCNN算法将转色期与成熟期番茄均作为成熟番茄进行识别,为了更直观的呈现识别结果的差异,对YOLO v4 + HSV与改进的Cascade RCNN算法的识别效果进行了对比,如图10所示。由图10可知,本文的算法能够去掉Cascade RCNN算法识别的转色期番茄,且能够识别出图像中遗漏的成熟期番茄。

注:图10b和10c中的绿色框分别表示Cascade RCNN和YOLO v4+HSV的识别结果;10b中的蓝色箭头表示误识别的未成熟番茄,红色箭头表示漏识别的成熟番茄。

4.3 实时识别试验

在机器人采摘应用中,通常采用对相机获取的画面直接进行识别的方式,为了测试本算法的实用性,比较了YOLO v4 + HSV算法在不同设备上从调用相机获取画面到识别出首个目标番茄所用的时间。试验中采用的相机为Realsense深度相机,将工作站和微型工控机各为一组,每组进行检测前改变目标番茄的位置,共移动10次,检测时间如表2所示,最后计算出每个设备上本算法从调用相机到检测到第一个目标番茄所用的平均时间。经计算,YOLO v4 + HSV在工作站上所用的平均时间为0.51 s,在微型工控机上为1.48 s,两者均可满足实际采摘需求。

表2 工作站和工控机的实际检测时间

5 结 论

1)针对部分藤蔓、叶片、果实遮挡及光照影响样本影响YOLO v4模型学习,而引起目标番茄误识别问题,本文提出了一种将YOLO v4与HSV分割相结合的成熟期番茄识别方法。该算法在YOLO v4检测框内通过HSV处理,对番茄的红色部分进行分割,并输出分割部分的面积在检测框内超过一定占比的检测结果,实现了成熟期番茄的识别,提高了识别的准确性。

2)比较了不同占比下本算法检测成熟期番茄的正确率、漏检率和错误率,通过综合考虑各指标影响,最终将16%作为成熟期番茄识别算法设置的占比。试验结果表明,该占比下改进后的算法的识别正确率为94.77%,相比于仅用YOLO v4增加了4.30个百分点,错误率比后者降低了5.29个百分点。为了测试算法的实用性,分别在工作站、微型工控机上调用本算法对Realsense深度相机获取的画面进行实时检测,并计算该算法从调用相机到检测到第一个目标番茄所用的平均时间,通过计算得到在工作站上调用相机检测到目标番茄所用的平均时间为0.51 s,在微型工控机上为1.48 s,可满足实际采摘需求。

[1] 刘继展. 温室采摘机器人技术研究进展分析[J]. 农业机械学报,2017,48(12):1-18.

Liu Jizhan. Research progress analysis of robotic harvesting technologies in greenhouse[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(12): 1-18. (in Chinese with English abstract)

[2] 王海楠,弋景刚,张秀花. 番茄采摘机器人识别与定位技术研究进展[J]. 中国农机化学报,2020,41(5):188-196.

Wang Hainan, Yi Jinggang, Zhang Xiuhua. Research progress of tomato picking robot recognition and location technology[J]. Journal of Chinese Agricultural Mechanization, 2020, 41(5): 188-196. (in Chinese with English abstract)

[3] 王文杰,贡亮,汪韬,等. 基于多源图像融合的自然环境下番茄果实识别[J]. 农业机械学报,2021,52(9):156-164.

Wang Wenjie, Gong Liang, Wang Tao, et al. Tomato fruit recognition based on multi-source fusion image segmentation algorithm in open environment[J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(9): 156-164. (in Chinese with English abstract)

[4] 苗中华,沈一筹,王小华,等. 自然环境下重叠果实图像识别算法与试验[J]. 农业机械学报,2016,47(6):21-26.

Miao Zhonghua, Shen Yichou, Wang Xiaohua, et al. Image recognition algorithm and experiment of overlapped fruits in natural environment[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(6): 21-26. (in Chinese with English abstract)

[5] 刘晓洋,赵德安,贾伟宽,等. 基于超像素特征的苹果采摘机器人果实分割方法[J]. 农业机械学报,2019,50(11):15-23.

Liu Xiaoyang, Zhao De’an, Jia Weikuan, et al. Fruits segmentation method based on superpixel features for apple harvesting robot[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(11): 15-23. (in Chinese with English abstract)

[6] 滕大伟,宋健,王凯. 基于区域生长的采摘机器人视觉识别方法[J]. 农机化研究,2017,39(3):17-21.

Teng Dawei, Song Jian, Wang Kai. Research on information model of plant breeding under cloud environment[J]. Journal of Agricultural Mechanization Research, 2017, 39(3): 17-21. (in Chinese with English abstract)

[7] 孙建桐,孙意凡,赵然,等. 基于几何形态学与迭代随机圆的番茄识别方法[J]. 农业机械学报,2019,50(增刊1):22-26,61.

Sun Jiantong, Sun Yifan, Zhao Ran, et al. Tomato recognition method based on iterative random circle and geometric morphology[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(Suppl. 1): 22-26, 61. (in Chinese with English abstract)

[8] 董建民,陈伟海,岳昊嵩,等. 基于Kinect视觉系统的西红柿自动识别与定位[J]. 中国农机化学报,2014,35(4):169-173.

Dong Jianmin, Chen Weihai, Yue Haosong, et al. Automatic recognition and location of tomatoes based on kinect vision system[J]. Journal of Chinese Agricultural Mechanization, 2014, 35(4): 169-173. (in Chinese with English abstract)

[9] 梁喜凤,金超杞,倪梅娣,等. 番茄果实串采摘点位置信息获取与试验[J]. 农业工程学报,2018,34(16):163-169.

Liang Xifeng, Jin Chaoqi, Ni Meidi, et al. Acquisition and experiment on location information of picking point of tomato fruit clusters[J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2018, 34(16): 163-169. (in Chinese with English abstract)

[10] 蔡舒平,孙仲鸣,刘慧,等. 基于改进型YOLOv4的果园障碍物实时检测方法[J]. 农业工程学报,2021,37(2):36-43.

Cai Shuping, Sun Zhongming, Liu Hui, et al. Real-time detection methodology for obstacles in orchards using improved YOLOv4[J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2021, 37(2): 36-43. (in Chinese with English abstract)

[11] Bochkovskiy A, Wang C Y, Liao H Y M. YOLOv4: Optimal speed and accuracy of object detection[J/OL].Computer Science, (2020)[2021-3-17]. https://arxiv.org/abs/2004.10934.

[12] Liu W, Anguelov D, Erhan D, et al. SSD: Single shotmultibox detector[C]//European Conference on Computer Vision. Cham: Springer, 2016: 21-37.

[13] 赵德安,吴任迪,刘晓洋,等. 基于YOLO深度卷积神经网络的复杂背景下机器人采摘苹果定位[J]. 农业工程学报,2019,35(3):164-173.

Zhao De'an, Wu Rendi, Liu Xiaoyang, et al. Apple positioning based on YOLO deep convolutional neural network for picking robot in complex background[J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2019, 35(3): 164-173. (in Chinese with English abstract)

[14] Tian Y N, Yang G D, Wang Z, et al. Apple detection during different growth stages in orchards using the improved YOLO-V3 model[J]. Computers and Electronics in Agriculture, 2019, 157.

[15] 武星,齐泽宇,王龙军,等. 基于轻量化YOLOv3卷积神经网络的苹果检测方法[J]. 农业机械学报,2020,51(8):17-25.

Wu Xing, Qi Zeyu, Wang Longjun, et al. Apple detection method based on light-YOLOv3 convolutional neural network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(8): 17-25. (in Chinese with English abstract)

[16] 吕石磊,卢思华,李震,等. 基于改进YOLOv3-LITE轻量级神经网络的柑橘识别方法[J]. 农业工程学报,2019, 35(17):205-214.

LüShilei, Lu Sihua, Li Zhen, et al. Orange recognition method using improved YOLOv3-LITE lightweight neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(17): 205-214. (in Chinese with English abstract)

[17] 杨长辉,刘艳平,王毅,等. 自然环境下柑橘采摘机器人识别定位系统研究[J]. 农业机械学报,2019,50(12):14-22,72.

Yang Changhui, Liu Yanping, Wang Yi, et al. Research and experiment on recognition and location system for citrus picking robot in natural environment[J].Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(12): 14-22, 72. (in Chinese with English abstract)

[18] 熊俊涛,郑镇辉,梁嘉恩,等. 基于改进YOLO v3网络的夜间环境柑橘识别方法[J]. 农业机械学报,2020,51(4):199-206.

Xiong Juntao, Zheng Zhenhui, Liang Jia’en, et al. Citrus detection method in night environment based on improved YOLO v3 network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(4): 199-206. (in Chinese with English abstract)

[19] 陈燕,王佳盛,曾泽钦,等. 大视场下荔枝采摘机器人的视觉预定位方法[J]. 农业工程学报,2019,35(23):48-54.

Chen Yan, Wang Jiasheng, Zeng Zeqin, et al. Vision prepositioning method for litchi picking robot under large field of view[J]. Transactions of the Chinese Society of Agricultural Engineering(Transactions of the CSAE), 2019, 35(23): 48-54. (in Chinese with English abstract)

[20] 刘芳,刘玉坤,林森,等. 基于改进型YOLO的复杂环境下番茄果实快速识别方法[J]. 农业机械学报,2020,51(6):229-237.

Liu Fang, Liu Yukun, Lin Sen, et al. Fast recognition method for tomatoes under complex environments based on improved YOLO[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(6): 229-237. (in Chinese with English abstract)

[21] 周伟亮,王红军,邹湘军. 基于机器视觉的荔枝品质快速自动检测[J]. 中国农机化学报,2020,41(1):144-147,204.

Zhou Weiliang, Wang Hongjun, Zou Xiangjun. Rapid automatic detection of lychee quality based on machine vision[J]. Journal of Chinese Agricultural Mechanization, 2020, 41(1): 144-147, 204. (in Chinese with English abstract)

[22] Ren S, He K, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]// IEEE. Transactions on Pattern Analysis and Machine Intelligence, 2015, 39(6): 1137-1149.

[23] He K, Gkioxari G, Dollar P, et al. Mask R-CNN[J]. IEEE Transactions on Pattern Analysis&Machine Intelligence, 2017, (99): 2961-2969.

[24] Cai Z W, Vasconcelos N.Cascade R-CNN: Delving into high quality object detection[C] //The IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Salt Lake City: IEEE, 2018: 6154-6162.

[25] 闫建伟,赵源,张乐伟,等. 改进Faster-RCNN自然环境下识别刺梨果实[J]. 农业工程学报,2019,35(18):143-150.

Yan Jianwei, Zhao Yuan, Zhang Lewei, et al. Recognition of rosa roxbunghii in natural environment based on improved Faster RCNN[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(18): 143-150. (in Chinese with English abstract)

[26] 岳有军,孙碧玉,王红君,等. 基于级联卷积神经网络的番茄果实目标检测[J]. 科学技术与工程,2021,21(6):2387-2391.

Yue Youjun, Sun Biyu, Wang Hongjun, et al. Object detection of tomato fruit based on cascade RCNN[J]. Science Technology and Engineering, 2021, 21(6): 2387-2391. (in Chinese with English abstract)

[27] Wang C Y, Liao H Y M, Wu Y H, et al. CSPNet: A new backbone that can enhance learning capability of CNN[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops, Seattle: IEEE, 2020.

[28] 王相友,李晏兴,杨振宇,等. 基于改进YOLO v4模型的马铃薯中土块石块检测方法[J]. 农业机械学报,2021,52(8):241-247,262.

Wang Xiangyou, Li Yanxing, Yang Zhenyu, et al. Detection method of clods and stones from impurified potatoes based on channel pruning YOLO v4 algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 202l, 52(8): 241-247, 262. (in Chinese with English abstract)

[29] 冯俊惠,李志伟,戎有丽,等. 基于改进Hough圆变换算法的成熟番茄果实识别[J]. 中国农机化学报,2021,42(4):190-196.

Feng Junhui, Li Zhiwei, Rong Youli, et al. Identification of mature tomato based on an algorithm of modified circular Hough transform[J]. Journal of Chinese Agricultural Mechanization, 2021, 42(4): 190-196. (in Chinese with English abstract)

[30] Liu G, Nouaze J C, Touko M P L, et al. YOLO-Tomato: A robust algorithm for tomato detection based on YOLOv3[J]. Sensors, 2020, 20: 2145.

Tomato recognition method at the ripening stage based on YOLO v4 and HSV

Li Tianhua1,2,4, Sun Meng1, Ding Xiaoming3, Li Yuhua1,2, Zhang Guanshan1,2, Shi Guoying1,2※, Li Wenxian1

(1.271018; 2.271018; 3.100125; 4.271018)

An accurate recognition of fruit and vegetable depends mainly on the occlusion of vine, leaf, and light during robotic harvesting at present. In this study, a feasible recognition algorithm was proposed to efficiently identify the ripe tomatoes in the natural environment using YOLO v4 and HSV. The data set of mature tomatoes was also collected to capture some obscure images with the vines and leaves or color-changing by light under the complex growth environment. Once the original YOLO v4 network was utilized to identify the tomatoes after learning these samples, some tomatoes in the green ripening and color transition stage were taken like in the mature stage. Therefore, an HSV processing was added into the detection box of the original YOLO v4 network, in order to segment the red region of tomatoes. The specific tomatoes were taken as the target output to improve the accuracy of recognition if the red areas of segmentation reached a critical proportion in the detection box. The size of the proportion presented an important impact on the accuracy of recognition. The recognition performance was also compared on the test set under different proportions. As such, the proportion of 16% was taken as the tomato recognition at the mature stage. At this time, the highest recognition accuracy of the combined YOLO v4 and HSV was 94.77%, 4.30 percentage point higher than that of the original. The detection speed of a single image in the workstation was 25.86 ms. It indicated that the addition of HSV processing was widely expected to improve the accuracy of the original network. Furthermore, the improved network was also used to effectively remove immature tomatoes that cannot be recognized by the improved Cascade RCNN. In addition, the running time was tested ranging from the calling RealSense D435i to the first target tomato on the workstation and the miniature industrial computer. It was found that the average time of recognition was 0.51 s on the workstation, and 1.48 s on the miniature industrial computer, using the combined YOLO v4 and HSV from turning on the camera to the first target detection. Consequently, the improved algorithm was fully met the real-time requirements of mechanical picking. This finding can also provide a strong theoretical basis for the accurate, efficient, and real-time recognition of fruit and vegetable picking using robots in a complex environment.

image segmentation; recognition; tomato; picking; YOLO; HSV

10.11975/j.issn.1002-6819.2021.21.021

S225.92

A

1002-6819(2021)-21-0183-08

李天华,孙萌,丁小明,等. 基于YOLO v4+HSV的成熟期番茄识别方法[J]. 农业工程学报,2021,37(21):183-190.doi:10.11975/j.issn.1002-6819.2021.21.021 http://www.tcsae.org

Li Tianhua, Sun Meng, Ding Xiaoming, et al. Tomato recognition method at the ripening stage based on YOLO v4 and HSV[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(21): 183-190. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.21.021 http://www.tcsae.org

2021-08-06

2021-09-16

山东省重大科技创新工程项目(2019JZZY020620);山东蔬菜产业技术体系(SDAIT-05-11)

李天华,教授,研究方向为智能农机装备。Email:lth5460@163.com

施国英,高级实验师,研究方向为设施机械与农机装备。Email: sgy509@sdau.edu.cn