一种松耦合的多模态标绘引擎设计

周妙林,凌飞,信欣,粟骏龙,3

(1. 广东数字生态科技有限责任公司,广东 韶关 512026;2. 广东云舜综合能源科技有限公司,广东 韶关 512029;3.武汉大学,湖北 武汉 430079)

0 引言

人机交互技术一直属于研究热点,人类不断挖掘其中各类信息传递所依赖的有效载体及其对应识别手段。标绘业务对于人机交互技术有着较强的依赖性,其绘制成果通常基于地理信息平台进行二三维可视化展示。由于计算机多模态识别技术的发展,用户对于标绘渠道的扩展有着潜在的现实需求,希望突破单一的鼠标键盘标绘模式的局限,引入更多标绘模态。通过融合处理多种模态输入信息,从中提取各种形态的用户交互命令,结合多模态语义理解技术,最终让计算机捕捉和识别用户的交互意图,充分发挥不同模态的数据处理优势,帮助用户更快捷、更方便的进行高效的标绘工作。

1 研究现状

语音识别和触控等技术的进步丰富了传统标绘的手段,广泛应用于各类业务系统,部分研究也探讨了文本标绘的策略与方法。

何丽明[1],杨若鹏[2]等人在军标通用标绘算法和组件化封装方面做了一些研究。

Guangsen Wang[3]、朱鸿展[4]、赵骞[5]、魏丽[6]等人在语音、手势、文件导入标绘等方面做了一些探索。

刘铭崴[7]、倪金生[8]、张利娟[9]、柳杨[10]分别在动态异构数据标绘、多源共享标绘等场景进行了研究和尝试。

分析发现,这些研究要么聚焦于某一单模态的标绘技术探索;要么实现多模态信息的简单集成,未涉及到信息融合的层次;或者融合特定两种模态的交互标绘,但是这类多模态信息融合是基于一种紧耦合的模型设计,即识别模型采用一种端到端的方式,将触控操作、语音等不同模态指令同时输入到一个通用处理模型中进行训练和识别处理,借助模态自适应转化和命令参数对齐技术,其标绘命令粒度可以细化到单一模态输入提供标绘命令内部参数级,两种模态交替输入融合的结果作为命令级的输出,但这种模型针对指令内部参数进行多模态的融合,导致处理难度较大,可靠性有待提高[11]。

所以,基于现有技术条件和标绘的特性,本文拓展多种可靠标绘渠道,设计了一种松耦合的多模态标绘引擎模型,通过对多模态输入采用松耦合的方式,即单独处理各个模态,包括语音数据、触控手势、格式化文书与传统的鼠标键盘等操作方式,识别粒度为标绘命令级,基于各个模态识别处理结果生成标绘定义文件,来实现多模态输入的可靠融合。

2 标绘业务流程

基于松耦合的多模态标绘引擎可以接收格式化的文书、语音、触屏动作及鼠标键盘操作等内容,经命令解析处理和数据融合后,将对应的标记要素显示在态势图上,并且支持多个用户协同对要图进行统一绘制,为用户及时、准确的了解业务场景及有关部署提供支撑。

根据上述业务需求,标绘业务流程设计如下图所示,多模态标绘引擎由交互式语音识别引擎、文书识别引擎、触控识别引擎、鼠标键盘识别引擎组成,分别用于接收音频设备、文书、触控屏及鼠标键盘等渠道采集的输入信息,并将这些形态各异的外部指令解析成标记对象的具体绘制命令,以图元绘制命令为最小融合粒度,将各类识别引擎产生的图元绘制列表融合成统一的标绘定义文件,并提交给标绘服务器端处理。标绘服务器端协同处理多用户的分布式标绘请求,在用户组范围内同步所有协作用户的标绘信息并消除绘制冲突,最终标绘服务器及时以标绘定义文件的形式分发给各标绘协作台位,借助地理信息平台进行对应的标绘二三维渲染展示(如图1所示)。

图1 标绘流程

3 模型结构设计

由于多模态标绘命令历经输入、识别、融合、多用户管理及展示等环节,本文将标绘模型设计为输入层、多模态绘制识别层、数据耦合层、分布式协同层及应用展示层等模块,对应的模型结构如图2所示。

图2 标绘模型结构设计图

其中,输入层包括音频设备、触控设备、格式化文书及鼠标键盘等多种信息采集渠道,方便用户根据任务需要选择合适的输入方式。

多模态绘制识别层分别设计了语音识别、触控识别、文书指令识别、鼠标指令识别功能模块,将差异化的用户指令通过对应的识别引擎进行形态转化,生成标绘对象的文本类型描述。

数据融合层使用自定义的标绘定义文件来融合各模态标绘指令。

分布式协同层用于协调处理多台位用户协作标绘所涉及到的管理机制。

应用展示层实现标绘成果可视化及文书生成等功能。

3.1 语音标绘

通过语音渠道输入的标绘命令,通过语音识别引擎准确识别并转化为文本信息,形成对标绘对象命令词的文本描述形态,以便融合成统一的标绘定义文件。由于战场指挥环境的复杂性,需要考虑语音输入过程中的噪音干扰,音频采样可能存在失真以及汉语多音字及生僻字识别难度高等现实因素,使得语音识别达不到绝对的精准,所以在语音匹配过程中需要采用模糊识别的方式。语音标绘的原理如图3所示。

图3 语音标绘原理

3.2 触控标绘

通过触摸屏动作产生系统触控事件,由对应的触控标绘引擎将单点或多点触控事件,通过用户定义的动作与功能模式映射,解析成该动作对应的绘制命令,以文本形态进行描述,以便进行标绘定义文件的融合。触控标绘的原理如图4所示。

图4 触控标绘原理

3.3 格式化文书标绘

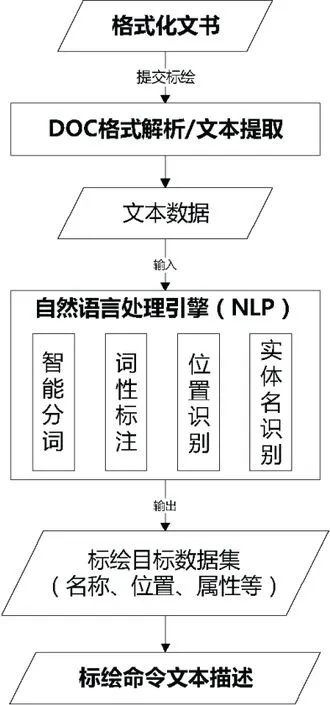

在各类业务领域,常常需要将格式化文书或预定义的格式化数据等文本信息作为标绘数据源。格式化文书经过DOC格式解析/文本提取来过滤掉干扰数据,方便自然语言处理引擎(NLP)分析并提取标绘关键词,形成标绘命令的文本描述,以便格式化为标绘定义文件。格式化文书标绘原理如图5所示。

图5 格式化文书标绘原理

3.4 鼠标、键盘标绘

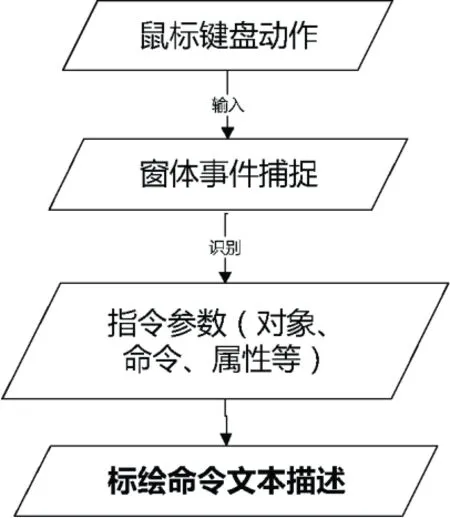

本方式属于最传统的标绘手段。通过鼠标点击的窗体事件触发捕捉机制,进而对标绘动作进行事件识别,分析当前鼠标点击或键盘操作,影响了哪一类的对象、产生了哪一种命令或者修改了哪一列属性,从而提取对应的指令信息及参数,如操作对象、对应的命令描述、设置或修改的属性信息等,以文本形态进行描述,以便生成标绘定义文件。鼠标键盘标绘原理如图6所示。

图6 鼠标键盘标绘原理

3.5 数据融合层

如前文所述,数据融合层融合无差异的多模态标绘文本命令,将命令融合成命令流的集合,以标绘定义文件为单位向标绘服务器提交标绘请求,从而优化多标绘台位与标绘服务器的信息传递机制。标绘模式管理用于切换多模态标绘输入渠道,并将识别后的结果融入到当前标绘定义文件。同时,本模块设计了标绘对象与其内部编号的索引服务,通过关联匹配表,建立标识对象与相应标号的对应关系,为标绘操作提供快速查询功能(如图7所示)。

图7 数据融合流程

标绘定义文件以列表的形式存储需要在地图上需要标绘的图元,该列表依据最后操作时间倒序排列。为满足分布式标绘的需要,每个标绘图元除了包含命令基本属性外,还包括创建时间、最后操作时间、是否锁定、锁定机位、是否显示等属性。其中,基本属性即通用的GIS属性,如图元大小、图元种类等,依据不同的地理信息平台而不同。在此基础之上,附加设计了其他用于多机位协作的额外的属性(如图8所示)。

图8 标绘定义文件

3.6 分布式协同层

分布式协同层处理多台位标绘客户端与标绘服务器之间数据的交互,客服端向服务器提交绘制请求,服务器端检测多台位绘制的冲突并消融冲突,将消融后的无冲突绘制命令分发给各绘制台位进行同步显示。这些标绘请求或命令都是基于标绘定义文件的形式传递。

历史操作列表存储在协同标绘时所有的有效操作,包括操作图元、操作时间、操作机位、操作内容等属性。当前操作列表存储在当前时刻中所有标绘台位的操作请求,根据冲突台位优先级对互斥操作进行消融,保证并发操作的正确性(如图9所示)。

图9 冲突消融机制

3.7 应用展示层

本层次用于实现标绘客户端的展示功能及有关实用工具。最终的信息表达阶段,标绘定义文件可以映射为标绘符号,并与标绘模板进行匹配,调用标绘组件的绘图接口,实现标绘的成果展示。根据具体业务部门的标绘标准与需求,基于特定维地理信息平台二次开发设计的标绘展示组件,加载所需的标绘接口的标绘定义文件,实现点、线、面等标记的综合态势展现。

4 结语

本文设计了一种多模态标绘引擎来适配各种标绘需求,融合语音,触控、文书以及传统的鼠标键盘等多种途径,方便用户根据使用场景选择合适的标绘手段。语音标绘可以避免在繁琐的标绘图标面板中寻找绘制元素的环节,触控标绘也让适应了智能手机的用户拥有良好的交互体验,格式化文书标绘利用了现有文本成果直接生成标绘要图。对多模态输入采用松耦合的方式,可以降低数据融合的难度,提高系统的可靠性和实用性,同时多源输入采集模块便于扩展,方便集成更多的标绘渠道。目前标绘定义文件基于数据融合的需要,命令格式稍显简单,后续需要优化标绘定义文件对于复杂指令的描述设计。