平台型媒体内容审核:动因、现状与突破

张杰 毛艺融

[摘 要] 探讨当下平台型媒体内容审核的逻辑动因、路径与发展现状,反思其存在的困境以及未來突破该种困境的策略。指出当前问题及挑战主要体现在内容量过大,算法和人工审核均存在歧视问题,且平台内容审核规则的透明度逻辑被遮蔽。未来内容审核机制会更加完善,内容生态中会催生新的社会分工;第三方内容审核机构涌现;更多审核工作将会被机器审核所取代;内容行业审核规则会逐步建立起来,并将多种社会力量纳入审核体系当中。

[关键词] 内容审核 平台型媒体 场域理论 数字出版 新媒体

[中图分类号] G237[文献标识码] A[文章编号] 1009-5853 (2021) 06-0076-08

[Abstract] Discusses the logical motivation, paths and development status of the content audit of the current platform media in China, and reflects on its existing dilemma and how to solve this dilemma in the future. The current problems and challenges facing by content audit are reflected in the excessive content, the discrimination in algorithm and manual audit. The transparency logic of platform content audit rules is masked. In the future, the content audit mechanism will be more perfect, and a new social division of labor will be created in the content ecology. The content risk controller will become a new profession, and the third-party content auditing institutions will emerge. Part of the human audit tasks will be replaced by machine audit, and the content industry rules will be gradually established. A variety of social forces will also enter into the audit system.

[Key words] Content auditing Platform media Field theory Digital publishing New media

1 绪 论

平台型媒体是指既拥有媒体的专业编辑权威性,又拥有面向用户平台所特有开放性的数字内容实体[1]。国内的平台型媒体如微博、微信、今日头条,既有着平台的开放属性,也有媒体的把关属性。近年来,随着互联网行业内容安全问题越来越凸显,不少平台型媒体纷纷在内容审核方面投入大量人力财力,但由于外部监管、商业竞争、内容生态等因素,内容审核仍然面临巨大挑战。为了审查不良内容,国内外平台型媒体都设立了内容审核员,英文叫“content moderator”。在此背景下,研究平台型媒体内容审核路径、发展现状、面临的困境与突破策略,是十分必要的。本文以布迪厄的场域理论为分析工具,研究以下问题:内容审核的惯习由何演变而来?个体与组织行动者如何适应与突破场域内的惯习?其保守性与革新性体现在何处?在场域理论视角下,内容审核已有的路径、发展现状、正面临的困境与突破的策略是什么?

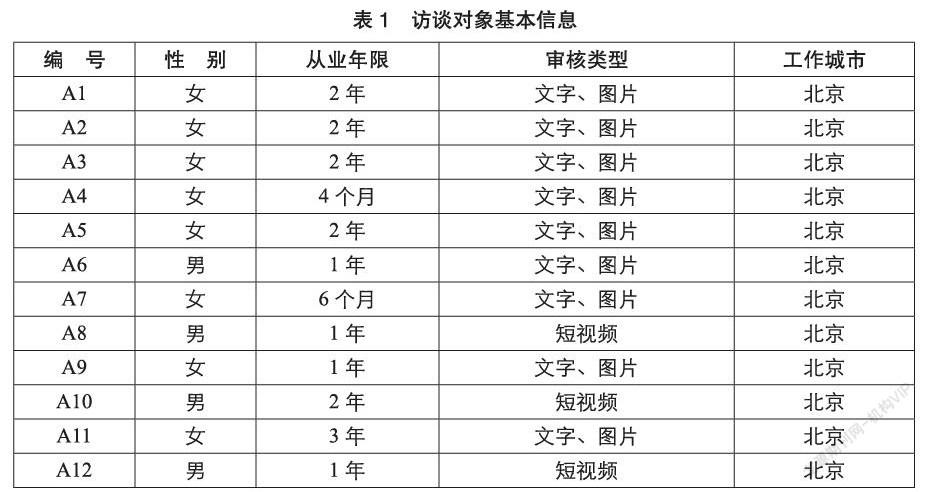

为更深入地了解和解决这些问题,本文采用深度访谈方法,在2019年11月—2020年5月期间采用滚雪球抽样方式,对12名在平台型媒体工作的内容审核与标准化人员进行半结构化访谈。其中,与5人进行了面对面访谈,与7人进行了微信语音访谈,平均访谈时间在40分钟左右。本文对受访对象进行匿名化处理,并以从业年限、审核类型、工作城市进行区分。

2 内容审核的逻辑动因、路径与现状

如今,我国传媒业呈现为混合所有制的新体制,既有纯国营体制、纯民营体制,还有民营和国营相结合的媒体以及纯个体经营的自媒体,这些媒体进入媒介场域中的身份、位置、资本、惯习会具有异质性。皮埃尔·布迪厄(Pierre Bourdieu)所谓“场域”是一个动态的斗争空间,不同位置的行动者拥有不同种类和数量的资本,运用包括惯习在内的各种策略进行权力斗争,来维持场域内的力量构型[2]。与传统媒体不同,迄今我国平台型媒体背后的行动逻辑更多的是基于对经济资本的追寻,因此探究其内容审核的逻辑动因、路径必须从场域内部与外部综合考虑。从场域外部来看,国家法律法规对平台内容及其生态有相关要求,迫使平台型媒体需要有类似传统媒体的把关功能。从场域内部来看,内容审核是平台型媒体算法迭代升级的必经之路,大量的审核样本能够帮助算法纠偏,提高商业竞争能力。

2.1 从传统媒体编辑到平台型媒体内容审核

传统媒体有编辑把关的传统,主要是对报纸、电视等内容进行稿件审核、制作加工。书报刊媒体一直遵循三审三校制度,即产品至少经过三层审核、三次校对才能签发[3]。而平台型媒体起初多以“新闻搬运工”“信息聚合者”等身份出现,内容生态则处于野蛮生长阶段。从2017年起,各平台型媒体的内容生态暴露出很多问题。不少内容创作者发布和传播的内容涉及违反国家法律法规、破坏社会公序良俗,并危害到平台生态健康以及广大用户的利益。如此,社会场域倒逼平台型媒体进行自我审查,逐步进行内容生态治理。政治场域里,相关部门如国家网信办等作为监管者约谈了部分平台型媒体;同时颁布《网络信息内容生态治理规定》等法规条例,督促平台型媒体进行内容规范和治理。于是,国内平台型媒体开始大量招募内容审核员,主动探索内容审核机制。

平台型媒体通过算法分发内容时,难免会出现偏差。为了减少优质内容流量低的状况,平台型媒体会加大运营审核力度,在平台内部素材库中筛选寻找优质内容注入精品池,提升其成为爆款或者热门内容的可能性。与此同时,根据平台媒体内部的产品运营和算法策略,如果该内容流量在一定时间内不达标则会停止推荐;或者成为爆款后继续评估该内容,判断其是否符合平台调性,是否需要助推更多流量[4]。因此,平台型媒体虽然表面看来继承沿袭了某些传统媒体的编辑把关机制,但在技术逻辑和审核手段上呈现完全不同的编辑把关特性。如平台内容审核员是针对平台媒体海量内容的质量底线进行审查;而传统编辑则是针对大量内容,根据有限展示位置进行过滤和筛选,筛选后的内容质量相对较高。

在深访过程中,A3 说:“你经过一段时间的培训就可以上岗,一般1—2周,最快2—3天就可以直接上岗了,可以选择自己熟悉的垂类队列展开审核,但这和真正的编辑差远了,没有什么成就感。” 可以发现,互联网内容审核员的职业进入门槛相对较低,难以产生传统媒体编辑那样的职业责任感和专业理想。而且,传统媒体的惯习根深蒂固,如编委会投票机制需要通过多位编辑进行选题投票、内容改版制作、修改加工等流程;编辑面对的是媒体内部专业化生产的内容。而平台型媒体的组织惯习中没有可继承、沿用的把关机制,当审核员遇到无法判定的情況,一般需要和同级审核员协商或者找上级来判定。此外,他们面对的是平台所有用户生产的信息,内容的范围更广、体量更大。

2.2 机器与人工并存的审核机制

在审核策略方面,国内平台型媒体大多采用人、机并用的方式,即:利用人工智能(Artificial Intelligence,AI)技术进行第一轮机器审核,确保快速得出结果;当内容涉及“灰色区域”时,则人工介入进行第二轮审核。从内容形式来看,平台型媒体审核类型包括文本审核、图片审核、语音审核、视频审核等;从审核对象来看,主要包括平台上用户昵称、用户头像、用户评论、用户发布的文字、图片、音视频动态等;从审核目标来看,重点包括不良内容、内容原创性、有无水印等。一般而言,针对不同业务线,平台媒体会采用不同策略,也就是决定“先审后发”还是“先发后审”。比如知乎发布用户问答时,采取“先审后发”策略,页面会显示“内容审核中,内容将在审核通过后自动发布”的字样。而微博用户在发布动态时,往往遵循“先发后审”策略,用户可以搜索或看到即时发布的内容,但平台方会在较短时间内完成审核。如果发布的内容违规,则该条内容会被设置为“用户自见”或者被删除处理。

“平台型媒体会给每条审核业务线设置一个阈值,当机器审核没有达到直接审核的阈值,就会流转到人工审核。审核员会在系统中接到审核任务,选择相关队列进行审核。平台型媒体会为内容审核业务建立中台,供内容审核人员使用。该中台会依据平台方的内容审核规则,设置审核的步骤操作,让审核员能够更机械、统一地作出判断。”(A7)

机器审核能够大规模处理内容审核,但文本、图片、语音、视频等内容对审核的要求较高,机器识别仍存在一定比例的误判,无法完全代替人工审核。在对音频内容进行审核时,机器识别语音转换成的文本,再匹配关键词,将与模型相似度最高的垃圾内容进行剔除。这是当前较为通用的方案。但是针对方言、有不同音轨的杂音等场景,机器无法妥善处理。另外,在对直播内容、短视频、长视频等内容进行审核时,机器往往会抽取关键帧对视频内容进行审核,无法覆盖到全部画面,因此会出现暴力或者色情内容的“闪现”。对于文本内容的审核常常采用关键词过滤技术,也会存在一定的误报率和漏检率。因此,机器并不能完全代替人。人工审核往往需要针对机器无法判断的内容进行再审核,因此人工是机器审核后的最后防线。

综合受访者观点,国内平台型媒体的人工审核往往要经过两三次人力审查。首先是对涉及敏感人物、涉黄涉暴涉政等违反底线的内容进行排查,严重违反规则的内容被设置为自见或者删除。符合内容质量要求的会进入二次审核的内容池,进一步判断其是否符合美食、旅游、科技、历史、教育、时尚等垂类优质内容的标准。审核重点包括内容抄袭率、是否有错别字、标点符号是否规范、图片是否清晰等。在二次审核内容池里,每条内容会被至少两个审核员判断,二者判断一致,则内容没有问题;二者判断不一致,则会有抽检监督员来进行最终判断。也就是说,机器能够在一定程度上自动剔除大量违规内容;而人工要做的是根据规则对其他内容维度进行标签化判断,在一定程度上纠正算法偏差,为算法保驾护航。

2.3 内容审核成为平台型媒体的游戏规则

从平台角度来看,内容审核是对平台内容生态的规范化治理,也是对内容消费者的一种保护,可以帮助用户规避虚假信息:

“如果用户有寻医问药的需求,看到了平台上相关的虚假广告,又没有甄别出来,其实是容易受到伤害的,我们审核也是帮助用户规避掉一些不实内容。”(A9)

平台型媒体鼓励用户生产内容,其中不可避免地会存在暴力内容、虚假广告,同时部分用户也不具备甄别虚假信息的能力。而平台内容审核人员往往经过一定训练,一定程度上可以减少不良内容,帮助用户规避风险和不必要的损失。从长远来看,内容审核也有利于平台型媒体的商业化发展。一方面,内容审核类似于信息清洗,可以帮助平台建立起健康的内容生态。而健康生态能够鼓励用户进行优质内容生产,形成比较好的内容生产与消费氛围。另一方面,平台的用户群会吸引品牌商进行广告投放。平台型媒体的内容审核行为能够管控与品牌相关的评论信息,帮助品牌构建和维护形象,从而有助于提高广告主的产品、品牌曝光率和投资回报率,实现商业上的价值闭环。如此,更多品牌将主动加入这一阵营,在平台型媒体投放广告。

3 内容审核的运行逻辑

在媒介场域中,平台型媒体居于重要位置,从其内容审核行动来看,需要考虑多种因素。一是使用机器审核内容需要有充实的内容资源库,也需要对算法进行迭代,势必是一个长期过程。二是内容审核的松紧度将影响内容生态的调性。对所投内容把控过紧,会降低内容创作者的积极性,压缩公共表达空间,进而降低平台生态活跃度。三是内容审核希望达到什么样的效果,即什么是可以被公众看到的内容?什么是所谓优质内容?何种内容适合该平台的生态?因此,本部分根据场域理论的3个关键概念,即行动者、资本、惯习来讨论平台型媒体内容审核的运行逻辑。

3.1 多元行动者成为内容审核主体

任何一个场域都是流动、变化的。变化往往源于行动者在场域内的斗争。他们需要适应场域游戏规则,不断超越场域内其他行动者,甚至与场域外部的环境展开斗争。在媒介场域中,平台型媒体、内容生产者、监管者等共同构筑了行动者主体。可以说,平台型媒体的发展催逼不同行动者入场,从生产到分发,逐步产生自查、外部审查等多级审核行为。

从内部来看,平台型媒体作为一个行动者共同体,特点是将企业组织的价值观传递给工作人员。表现在内容审核工作上,相关的算法、产品、审核等岗位人员需要接受和掌握平台的内容审核规则。如内容审核人员需要判断内容是否合规,内容是否有逻辑错误,内容是否能够吸引更多用户等。这也要求内容审核人員有一定的知识水平和专业素养。从外部来看,内容生产队伍逐渐从个人扩大到企业、政府机构等。平台型媒体的信息内容生产不再囿于纯粹的内部组织,用户自主创作过程取代了传统由编辑主导的生产流程。而围绕不同的生产者和传播者,将出现不同形态的内容生产方式;内容主体的资质与平台方的责任也难以界定。

内容生产者成指数级增长,平台型媒体上实时更新的内容也愈加海量,导致较短时间内平台方需审核处理大量内容,因而面临巨大的监管压力。为了尽可能保证内容分发的时效性,内容审核成本就会大幅提高。机器审核尽管能够大大缓解内容审核人员的工作量,但很多内容生产者还是会想尽办法突破平台规则。因此,平台需要不断完善机器审核的规则和逻辑,不断完善平台内部的审核规则。通常来说,平台内的头部生产者已经积累起较为丰富的经验,清楚平台型媒体审核规则的底线;而那些未获得流量的尾部小生产者,基于业务压力会在平台规则漏洞内寻找突围机会,这将加剧审核工作量。

3.2 资本逐利性弱化平台型媒体的公共性

在媒介场域斗争中,平台型媒体的最终目的是攫取和积累更多经济资本。它的商业属性往往强于其公共属性。也就是说,平台型媒体始终把商业利益作为场域内斗争的重要选择。经济资本占有巨大优势,在对内容的把控中积累起自身的文化资本。而在场域竞争中,平台型媒体不仅攫取了传统媒体的话语权,还聚集和蚕食着社会场域中各种资本力量。

审核的本质是为了帮助机器学习;毕竟存储庞大的数据非常简单,但要过滤数据很难。如果累积足够多且足够好的数据,机器就能提供更为精准的判断。为此,平台方会大量收集用户数据,也会大量收集人工审核样本,形成训练库。而当机器越来越大规模地、自动化地开展审核,一些隐患可能浮现。首先,审核权利让渡给技术后,平台型媒体将获得更多权利,决定什么是合适的内容,什么是优质的内容,从而导致社会场域对内容的话语权式微。其次,机器审核威胁着人的主体性。算法机制反映平台型媒体背后的价值观以及偏见。有观点认为只要积累足够的数据样本,算法就会解决所有审核问题。这也许是乌托邦式的想象与傲慢。因为审核的终极奥义绝不仅仅是剔除劣质内容,还在于发现优质内容;但优质内容的标准是无法通过数据训练向机器言说和传达的。因此,一旦将审核工作和权力让渡给机器,平台型媒体会对信息内容生态拥有更多话语权。通过对文化资本、经济资本、社会资本的积累与转化,平台型媒体将拥有对内容更大的掌控与解释权,进而对整个社会场域具有更大的影响力。如平台在公共表达空间中具有分配优质内容资源和用户注意力的权利,在平台有限的资源位置上有一套成熟的流量与资本置换标准,类似于传统媒体时代的广告位售卖逻辑,就可能会使商业性与公共性交织在一起,难以划定清晰的边界。然而需要警惕的是,如果平台型媒体过于追求商业利益,将公众舆论空间让渡给商业广告投放空间,其媒体属性将让渡给商业属性,从而有可能使自身乃至整个社会处于不可控的风险中。

3.3 行动者对惯习的适应与革新

布迪厄认为,惯习来自个体或者群体在实践中受到的教育积累,表现为一种内化的经验习性[5]。内容审核不仅是平台型媒体的组织惯习,也日益成为内容审核员的职业惯习。从组织惯习来看,国内平台型媒体的内容审核方式与规则往往是不公开的。这是因为审核体系的不完善和审核话题的特殊性,导致其规则与标准难以公开。近年来,内容审核规则已经从不公开走向部分公开,内容审核方式更为透明。如国外平台型媒体选择发布透明度报告,公开内容审核规则。康奈尔大学的塔尔顿·吉莱斯皮(Tarleton Gillespie)教授提出倡议,社交媒体平台应该在内容审核方式上更加透明[6]。透明度报告也有可能仅仅展现表象,但它比一些“服务条款”类的法律术语更为直白,可以告知用户不能触犯的底线,从而为平台内容审核行为合法性提供背书。

从职业惯习来看,内容审核员的职业角色与职业素养也逐渐明晰。而不同审核业务线的人员,其职业惯习也不一致。虽然审核人员、标准化人员、内容运营人员的工作场景都涉及对内容的判断,但往往偏向运营人员的门槛较高,而偏向内容合规检查的审核人员门槛较低。

“很多时候,我感觉自己就是工厂女工,每天面对电脑,做的都是流水线的重复劳动,而且不能停下来。越初级的审核,越不需要你有内容审美,只要你遵循业务线的细则就行了。”(A12)

“从审核出来之后比较难跳槽,大概率还是跟审核打交道。” (A4)

也就是说,内容审核员需要接受该工作的重复性以及职业路径的不确定性等。个体接受组织惯习的规训,成为平台机器的一个螺丝钉。不仅要遵循其审核规则,还要在实践中发挥能动性,反思实践,进而突破和超越场域惯习,甚至革新职业惯习。

4 困境突破:内容审核的竞争走向

内容审核遇到的问题及挑战体现在内容量过大,同时算法和人工审核均存在偏倚问题,且由于平台外部监管和内部规则的影响,导致审核标准充满不确定性。同时,平台内容审核规则的透明度逻辑也被遮蔽。场域为行动者提供场所,资本与惯习充实并建构着场域,并经由实践推动场域不断运行。因此,平台型媒体需要从社会场域、经济场域以及场域内部的资本、惯习入手,寻求突破困境的办法。具体来说,主要是将部分经济机会让渡给社会场域中的第三方机构,同时与场域中的其他行动者共同建立起内容生态的规则,且在场域内部进行机器算法的迭代升级,进而打造有自洁功能的内容生态。

4.1 多元化内容审核模式

正因场域内行动者群体构成复杂,场域内其他行动者也在寻求新的突破方法,甚至改变场域规则。具体来说,内容风控业务会逐渐延伸出更多元的模式;内容审核行业也会涌现新的人才。在平台型媒体的场域里,逐渐呈现出一种趋势,即“正式员工精英化、中低端工作外包化”,也就是缩减正式岗位,把机械化的工种交给外包临时工。

在访谈中,内容审核作为内容行业的底层工作,工作签约多为外包岗。相关外包公司也被称为第三方内容审核机构,目前有两类:一类是主流媒体主导建立的内容风控业务机构;一类是依托人工智能与大数据技术的外包技术公司。

主流媒体主导建立的内容风控业务是何种形式?2019年,人民网开始颁发互联网内容风控师证书,同时提供内容风控方面的业务:一是与大型客户签订长期外包服务协议;二是对中小客户提供云服务后台。如此一来,内容审核成为传统主流媒体新的盈利模式,同时也成为主流媒体提高引导力的新方式。主流媒体引领内容风控业务的标准与规则,原因在于在过去很长一段时间中,其在内容把关上积累起来的职业惯习,以及通过媒体业务在社会场域内积累起来的文化资本与社会资本。例如,主流媒体长期跟踪时政类内容,在该类内容风控上有更为老道的经验。不少平台型媒体也愿意高价招聘具有主流媒体编辑经验的人员,以保证内容生态的安全性。

与此同时,各大平台型媒体也将审核标准化业务外包给相应的技术公司。随着平台型媒体内容空间和市场规模的扩张,内容审核需求也会越来越大。不过,内容平台方能否坚持自身品牌特色,第三方机构与平台方审核标准是否统一,双方责任划分是否明确,等等。这些问题仍然需要进一步探索。

另外,目前国内内容行业规则的建立并非由互联网公司主导;政府主导建立的内容行业相关法律法规,包括互联网新闻信息服务条例等,发挥着主流作用。不过在行业内,平台型媒体可以自主建立审核样本库,弥补算法审核的缺陷与漏洞,通过对共性问题的搜集、分析和解决,建立起行业共通准则。

平台型媒体也可以将社会力量纳入审核体系当中,如用户监督与专家团队审核。具体来说,用户标记与举报能够在一定程度上为平台提供反馈,并且在此过程中参与到内容规则的执行中。用户参与审核体系,既可以节省审核资源,也可以对平台内容质量进行反馈。用户能够及时对个人首页出现的涉嫌违法犯罪、低俗色情的内容举报;同时用户标记或者举报的内容能够引起平台关注,被优先处理;此外,还可针对常被举报的内容类型建立审核准则。如新浪微博的“微博监督员”体系,对招募到的用户进行统一培训后,组成线上监督团队,根据工作量给予报酬。至于依托政府机构、新闻媒体、传播学者等建立的专家团队,平台方则可赋予更多功能权限,让其对内容质量进行把关与评鉴,从而在保证平台内容质量方面发挥持久的作用[7]。

4.2 审核机制的更迭

目前,国外以脸书(Facebook)为代表的平台型媒体,其内容审核标准主要由平台内部审核规则指南、突发事件中的补充性规则、审核员之间的共识、内部信息发布工具四个方面构成。国内平台型媒体的审核标准虽与之类似,但所涉及的因素可能更为复杂。

平台型媒体的审核现状仍然是人工审核与机器审核并存。一方面,机器能够降低人工成本;另一方面,人工能够判断机器无法识别的复杂内容问题,进行价值观判断[8]。人工审核结果还可为机器学习提供样本库;当样本量积累到一定程度时,更为精密准确的机器模型就被训练出来,然后更多人工审核内容就又可以交给机器审核。

“工作了半年后,我和组里另外3个人调到另外一条工作线做审核评估。审核线的岗位变动是经常的。一方面是业务可能转移到二三线城市来做;一方面是机器更精准了,取代了部分人力的审核工作。”(A5)

在访谈中,内容审核员们认为公司在审核方面最大的进展就是技术工具的突破。大部分暴力色情类视频和文字内容都是通过机器学习算法识别出来的,用户生产的不合规内容在较短时间内就被机器删除了。但机器审核也会存在一定程度的误判和漏判,如带货类商品内容的误判可能影响产品的投资回报率;对社会热点内容的误判可能导致内容失去时效性;对假新闻、假产品的漏判会影响用户信任。但算法模型的迭代升级并不意味着算法在审核方面具有正义性与公平性,其背后的歧视问题日益受到用户诟病:某些过滤掉的内容往往是社会热点;某些爆款内容让用户反感;此外,性别歧视、地域歧视等价值观都有可能隐藏在算法模型与人工审核员背后。

在访谈中发现,一方面,受限于算法技术,机器审核的准确率不是百分百;另一方面,审核员面临着庞大、密集与冗杂的工作情境,需要进行主观判断。A5陈述:“审核员的工作量非常大,用户动态如文字和图片每人每天至少要600条,要是文章的话每天可能需要处理1000—1200条,而且我们的操作时间与判断动作都会被机器记录下来,机器也会统计每个人每小时审核判断的正确率。”而且,内容审核员们承认在具体工作中也存有极强的主观性,导致偏见出现,因此难以保证审核的精确性和客观性。

5 结 论

从传统编辑主导到互联网时代的用户与编辑共同主导,从三审三校制到机器与人工双重审核,内容审核已然成为平台型媒体生存和发展的必要条件。当前机器审核并不能完全替代人工审核;人工能够为算法纠偏,担当最终裁定角色。而内容审核遇到的问题及挑战,主要体现在内容主体与内容类型杂多,需要审核的内容量过大,同时算法和人工审核均存在歧视问题;且由于平台外部监管和内部规则的影响,审核标准充满不确定性;同时,平台内容审核规则的透明度也在一定程度上被遮蔽。未来内容生态中会催生新的社会分工,内容风控师将成为新的职业,第三方内容审核机构将涌现出来,而随着海量样本训练库对算法的纠偏,更多审核工作将由机器来承担。随着多种社会力量加入到审核体系当中,内容行业的审核规则会逐步建立起来。尽管如此,平台型媒体的商业逻辑仍是主导内容审核的重要动力,也就是用平台内容吸引用户,再将用户打包给广告商。因此,平台型媒体的内容审核可能会成为一种结构性机制,无论是基于场域内部资本驱动—平台的商业创收和盈利目标,还是基于场域外部惯习影响—社会政治或文化期望的要求,并对社会其他场域发挥强大的他律作用。

注 释

[1]喻国明.互联网是一种“高维”媒介:兼论“平台型媒体”是未来媒介发展的主流模式[J].新闻与写作,2015(2):41-44

[2]Bourdieu P. The field of cultural production: Essays on art and literature[M]. Columbia University Press,1993:ISO 690

[3]吉正霞.图书质量全方位监控的研究与分析[J].传播与版权,2018(6):58-59

[4]闫泽华.内容算法[M].北京:中信出版社, 2018:4

[5]Benson R. News Media As a “Journalistic Field”: What Bourdieu Adds to New Institutionalism and Vice Versa [J]. Political Communication, 2006,23 (2) : 187-202

[6]脸书&油管透明度报告:引入用户审核,能真正净化平台内容吗?[EB/OL]. [2020-10-24]. https://mp.weixin.qq.com/s/mhSIj_gc97vzWsG-zRi_mg

[7]张志安,聂鑫,林功成.青少年网络权益保護的平台责任与多元共治[J].传媒观察,2018(11):5-12+2

[8]张志安,聂鑫.互联网内容生态变化:历程、路径与反思[J].新闻与写作, 2018(10):5-12

(收稿日期:2021-02-22)