向“原生”视觉和自动驾驶前进 直击特斯拉AI DAY

李实

特斯拉是一家特立独行的企业,不到20年时间,它从大众眼中的新能源车企,变成了一家高科技企业。2019年特斯拉自动驾驶日,展示它在自动驾驶方面的研究。2020年特斯拉电池日,它带来了大量电池技术方面的创新,并将电动车的续航里程持续推高。2021年8月,特斯拉全新的Al DAY(人工智能日)粉墨登场。这—次,特斯拉又带来了哪些新的技术和产品呢?

特斯拉在电动汽车上的努力有目共睹,如果仔细剖析电动汽车的话,可以发现它的架构分为车身和操控、驱动部分、电池部分以及电气系统部分。其中,车身和操控部分相对传统汽车而言变化不算特别大,且这部分材料和设计都已经到达了目前材料和物理规律的极限,进步空间有限。驱动部分主要是电机和相关电路,这部分设备的进步空间也基本上很小了。现在,电池部分和电气系统部分被认为是电动车上进步最大、最容易超越传统燃油车的地方。其中电池部分的进步对应着更长的续航,能够彻底解决电动车最核心的

“里程焦虑”问题。电气系统部分较为复杂,目前最重要的发展方向是智能化、数字化的座舱体验和自动驾驶系统。特斯拉在之前的自动驾驶日、电池日上已经展示了一部分自己在自动驾驶和增强电动汽车续航方面的研究和展望,但最终自动驾驶技术的发展依靠的还是强大的算力和全新的技术,尤其是AI技术的发展,这也是2021年特斯拉召开AI DAY这场大会的最大目的。

在AI DAY上,特斯拉带来了自己利用人工智能技术的发展,在自动驾驶方面的进展,包括在自动驾驶的视觉、数据标注和模拟、规划和控制以及硬件方面的创新。整个发布会长达3个小时,不过前面的等待和后期的问答占据了一部分时间,真正的持续时间大约为一个半小时,马斯克和特斯拉的工程师包括Andrej、Ashok、Ganesh等都亲临现场进行了讲解。从讲解内容来看还是比较艰涩难懂的,尤其是涉及一些计算模型和应用方面的处理。本文将尽量简单明了地解释这些内容。

感知道路信息:从图像空间转为矢量空间

在自动驾驶的视觉方面,特斯拉和现在业界呼声比较高的激光雷达方案存在很大差异。根本原因并不是某些设备或者采用摄像头与否的问题,而是形成立体视觉空间的问题。众所周知,摄像头在采集信息时会丢失几乎所有空间信息,最终计算机识别的信息中并不包含距离内容。相比之下,激光雷达在一定程度上可以解决这个问题,能够识别部分物体和车辆之间的距离。

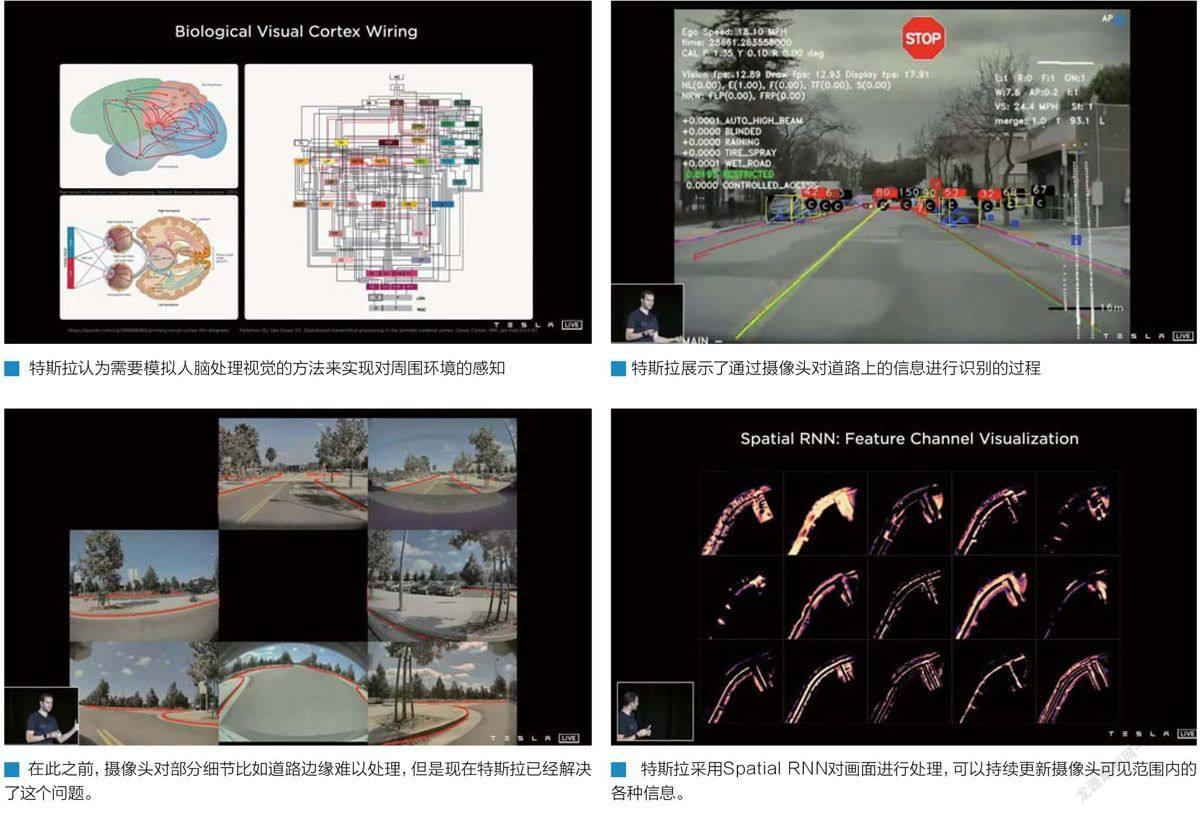

特斯拉一开始就鲜明地提出,他们计划模拟大脑的工作方式,只通过摄像头完成对事物本身以及空间信息的识别,也就是从图像空间转变为矢量空间。

为了达到这个目的,特斯拉使用了一个名为transformer的计算模块,这个模块采用注意力机制,可以在多个摄像头拍摄的画面之间建立联系,并且形成相对固定的空间关系,此外还包括摄像头矫正等。所谓注意力机制,实际上也是源自人脑和人眼的一种工作机制。简单来说,注意力机制就是人类的视觉系统倾向于在观察中关注图像里辅助判断的信息,而对那些不是特别相关的信息选择性忽略。这样一来,画面中有关判断、决策的内容或者关键的一些结合点就会被筛选出来。比如在道路画面中,有关地面的信息会被忽略,道路边缘的路肩、警示信息以及道路上的一些物体会被认为是关键信息。通过这样的机制,transformer模块能够将摄像头给出的图像信息进行筛选比对,进一步处理后就能将平面的图像空间转换为立体的矢量空间。

特斯拉也展示了摄像头在自家汽车上应用发展的历程,比如早期采用的是单摄像头单帧模型。随后由于单个摄像头范围比较窄,后期使用了多摄像头单帧模型予以改善。但是多摄像头单帧模型主要是画面未能很好地融合拼接,因此依旧采用的是孤立图像来判断,效果不好。现在加入了transformer模块后,特斯拉终于可以将所有的画面进行统一处理并矢量化了,进入了多摄像头多帧模型的新阶段。在这个阶段中,特斯拉可以保持连续多帧信息融合,实现对道路连续、不间断地监控。

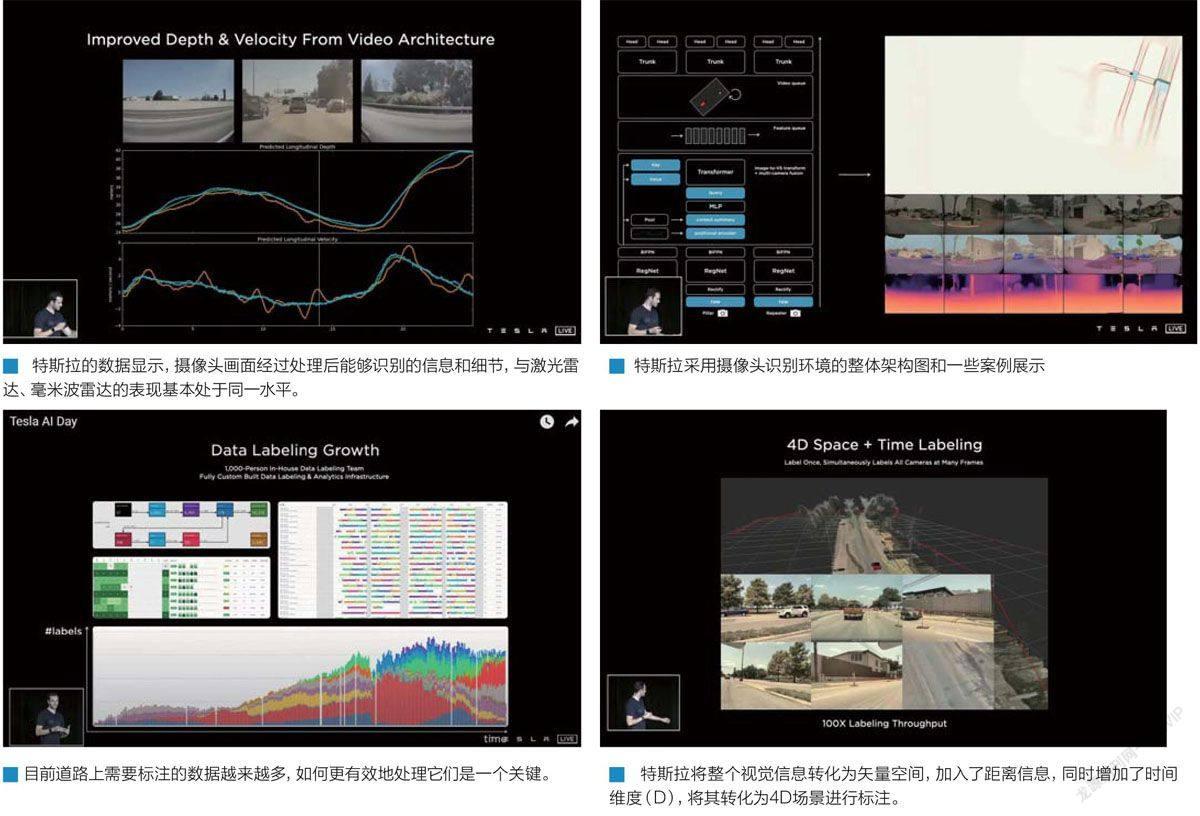

在实现了多帧信息融合后,特斯拉选择了Spatial RNN对视频进行处理。经过Spatial RNN的处理,特斯拉的汽车可以持续更新摄像头可见范围内的各种信息,并且还可以对物体的速度和距离进行估计。特斯拉的数据显示,他们的模型和方案相比毫米波雷达,效果基本相同。

识别道路状况:4D标注关键信息

当汽车通过摄像头完成了对空间结构的重现后,接下来一个重要的工作就是数据标注了。所谓数据标注,就是采用人工智能手段,将画面中那些需要特别重视的部分以不同的形式或者等级凸显出来。比如摄像头拍摄到了过马路的人、前方的汽车、道路边沿、固定障碍物以及道路标识和警示信息等,都需要及时识别并处理。

特斯拉将自己的数据标注功能称为4D。相比传统2D图像化标注,特斯拉已经将整个视觉信息转化为矢量空间,加入了距离信息,因此单帧2D画面也成了3D场景。但是特斯拉并非仅仅依靠3D场景进行标注,而是加入了时序信息,增加了时间维度(D),将其转化为4D场景进行标注。简单来说,之前的数据标注是利用一张张图片或者仅仅是一个静态的3D场景进行标注。现在特斯拉是在一个重建后的视频中进行标注,并且能够将标注后的信息反馈回摄像头,并进行跟蹤,后续就不用重复标注了,这在很大程度上节约了计算资源。

不过,虽然4D标注在功能实现和最终结果上表现优秀,但是也非常耗费计算资源,依靠传统的标注方法是难以处理的。为此,特斯拉专门开发了特别的4D自动标注工具,这个工具在展示中显示出了非常不错的效率,不但能够标注场景内的关键个体,还包括这些个体的运动速度、距离等内容,甚至可以预测它们未来的运动轨迹。特斯拉宣称新的4D标注功能相比传统的2D图像化标注效率提升了100倍。发布会上,特斯拉展示了通过在道路上行驶的大约100万辆特斯拉车辆,收集的250万个长度1分钟的片段,这相当于单个汽车驾驶1500年的时间,然后特斯拉使用上千个GPU和2万个CPU在—周内处理完了这些标注并且生成了模型。相比我们印象中单车或者数十车辆上路收集数据而言,特斯拉展示出的成长能力是相当惊人的。