红外可见光图像协同的弱光场景语义分割方法

陈诚 丁亚杰 高辉 胥峥

摘要:针对在昏暗条件下传统的基于可见光的语义分割方法精度较差的问题,本文提出了一种红外可见光图像协同的弱光场景语义分割方法。首先在多源特征自适应融合的编码器中提取可见光与红外图像的对应特征,并输入到自适应特征融合模块中进行增强与融合。接着将多源特征分别馈送入解码器进行处理,输出可见光与红外图像的独立语义分割结果。最后将自适应融合多源特征的数据送入多源特征聚合模块,并与不同模态的特征进行聚合解码,输出融合多源特征的语义分割结果。实验结果表明,在弱光场景下,该方法具有良好的分割效果,并在PST900数据集下较其他方法有较为优异的性能。

关键词:语义分割;可见光图像;红外图像;特征融合;弱光场景

1 语义分割方法

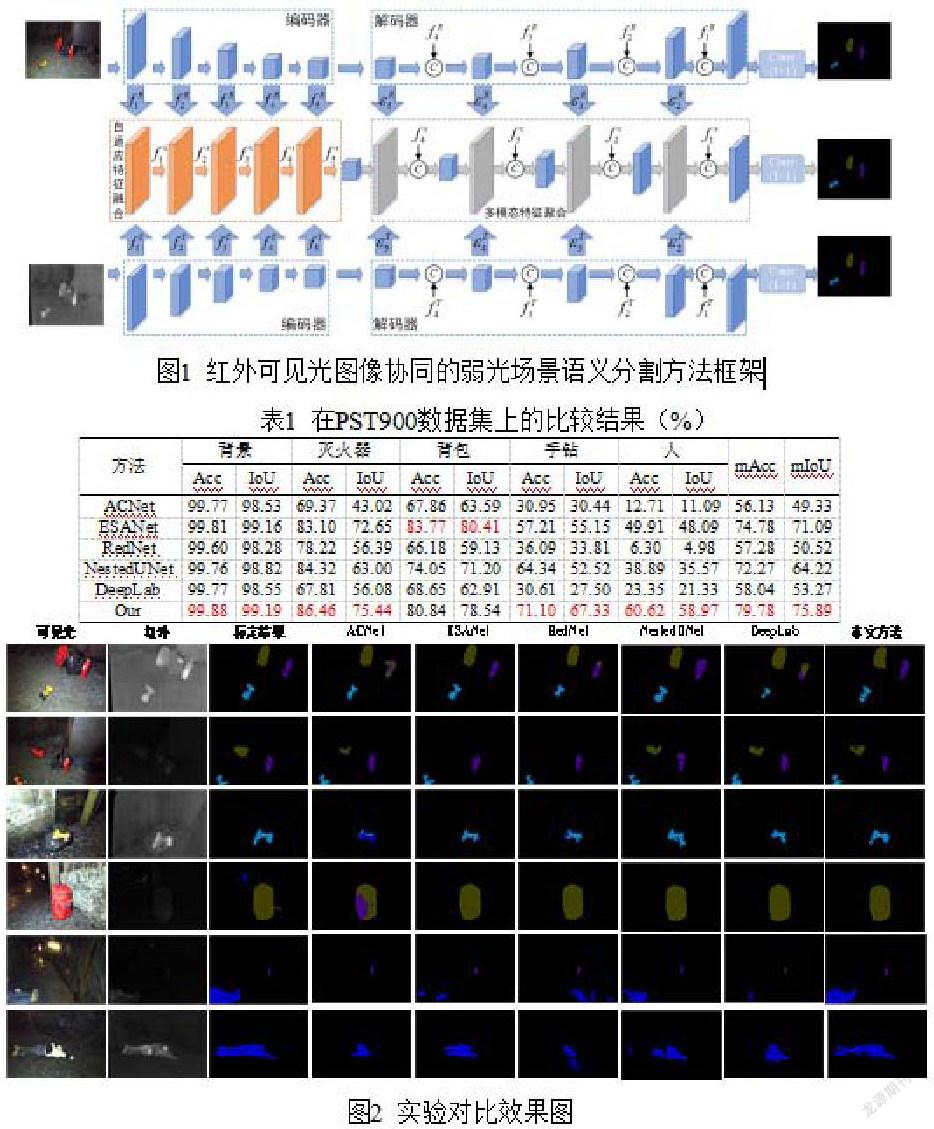

为了结合可见光图像与热红外图像的特征,本文提出了一种基于编码器—解码器结构的红外可见光图像协同的弱光场景语义分割方法。网络的整体架构如图1所示,由三个部分组成:

1.1.两条用于提取对应模态特征的编码器网络及其对应的解码器网络。采用预训练完毕的Res2Net-50[5]网络作为主干网络,两条对应模态的编码器子网具有相同的主干网络,因此在五个卷积层上都能生成对应的特征。解码器网络结构与层级相同的编码器子网相对应,并能输出可见光与红外图像独立的语义分割结果。

1.2.一个包含集成各卷积层对应模态特征的自适应特征融合模块。本模块采用剩余连接的方式对多源特征进行增强,并自适应地将增强后的特征与前一模块的输出进行充分地融合,以获得较为光滑且最大化结合多源互补信息的特征图。

1.3.一个多源特征聚合的解码器子网。本文设计了一个位于特征接收模块与级联操作之间且结合多源特征的特征聚合模块,通过集成来自多源的不同解码特征与上层解码输出,充分利用多源特征信息的特异性,大大提高语义分割的精准度。

2 实验结果分析

为了评估本文提出算法的有效性,本文将所提出的方法与表1中所示的5种先进的方法进行了比较。上述所有方法都在PST900数据集上进行训练。

实验结果表明,在地下矿洞这种黑暗狭小的场景中,本文由于充分结合可见光与红外图像的特征,其分割结果更加完整与精确。从表1可以看出,本文所提出的方法在所有网络的平均精度与平均交并比指标方面都取得了最好的结果。根据图2,本文所提的红外可见光图像协同的弱光场景语义分割方法较其他网络与标定结果匹配度最好,分割后的目标边缘更为清晰与完整,且不会出现对目标的漏检、错检等情况。因此与目前的最佳方法相比,我们的语义分割方法在此数据集上具有更高的效率以及精度。

结论

本文提出了一種红外可见光图像协同的弱光场景语义分割方法,包括两条用于提取对应模态特征的子网和一条用于集成多源信息的子网,三条子网均采用编码器—解码器结构,其中集成多源信息的子网包含自适应特征融合模块与多源特征聚合模块。自适应特征融合模块根据可见光与热红外图像之间的互补性,可自适应地让特定模态的特征进行融合,多源特征聚合模块能将自适应特征融合模块的输出与特定模态特征相结合,充分利用可见光与热红外图像的特异性。在PST900数据集下的实验结果表明,在弱光场景下本文所提的方法较于其他先进的分割网络,在精度以及效率方面有显著的提高。

参考文献

[1]秦飞巍, 沈希乐, 彭勇,等. 无人驾驶中的场景实时语义分割方法[J]. 计算机辅助设计与图形学学报, 2021, 33(7):12.