再融合,再超越

徐林

前传:一篇未能发出的文章

大约三个半月以前,我就写完了一篇关于华为P40系列影像能力的文章,但是因为一些复杂的原因没能发出,深感遗憾。我觉得引用那篇文章里的一些内容来做个引子,倒也不错。

面向手机影像未来的方向和技术研发,华为有自己的主张与思考,根据我使用的多款华为旗舰和与华为技术人员的交流来理解,华为手机影像未来的发展方向主要是两个:

第一,持续的解析力。手机影像无论做大底、做高感还是做高像素,最终的结果都是为了照片的解析力。华为在一段时间(中长期)里依旧会坚持RYYB这一异形CFA并持续优化调校,毕竟华为是唯一做到异形CFA千万级别商用的厂商,当然,在这个过程中华为还会同步研发和尝试其他形式的异形CFA,如果能比RYYB更好,也会考虑商用。

这个部分当然就包括大底传感器。华为也承认从目前的情况来看,进一步提升传感器的面积带来的增益会有递减,而且镜头慧差带来的边缘成像效果影响还是比较明显,即使可以通过软件的方式进行改善。所以,华为会在大底之外进行更多的思考。

第二,色彩。这是最复杂、难度也最大的一个部分。就算是同一个被摄物体,物体本身的色彩、环境光对色彩的影响以及拍摄者本身对被摄物体色彩的理解,就会形成对最终照片迥然不同的看法,这将会是一个长期的调校工作。

无论是与华为合作已久的徕卡风格的色彩,还是尼康、佳能的色彩风格,这些老厂都是经过数十年甚至上百年,才形成了让业界认可的风格,而对华为来说,未来的目标就是要形成自己的色彩风格,但是需要长期耐心地去建立。

有了这两个方向作为铺垫,我们就可以更加有的放矢地理解呈现在Mate 40系列上关于影像能力的一切了。

融合,解析力为上

记得Mate 40系列发布会之后与李小龙对话,我特别问到之前P40系列上拍照成像慢的问题。本以为随着麒麟9000系列性能的大幅度提升,这个问题在Mate 40系列上应该得到解决,但没想到得到的回答却是:“没有。因为我们的算法更看重画质,所以往往会超出ISP的运算能力,但我们觉得目前的速度还可以接受。你可以发现在复杂光源、逆光等环境下色彩表现提升非常大,但是这样成像速度就会下来。每当新的算力出现,我们就会想做到更多。”

而这次在与华为技术人员交流的过程中,这个问题又得到了更加系统的答案。目前在华为的相机解决方案中,已经分别在P、Mate和nova三个系列上形成了鲜明的特点:每一代P系列会以新型传感器和摄像头技术为牵引,提升静态影像的成像质量;Mate系列会在某些关键的技术上,尤其是以AI为准的,去进行提升,做動态影像的设计——个人觉得这个定义应该是从上一代的Mate 30系列开始的;nova主要聚焦于前置摄像头的解决方案,但随着前两个系列一些技术的铺开,nova系列的后置拍摄能力也是同样在提升。

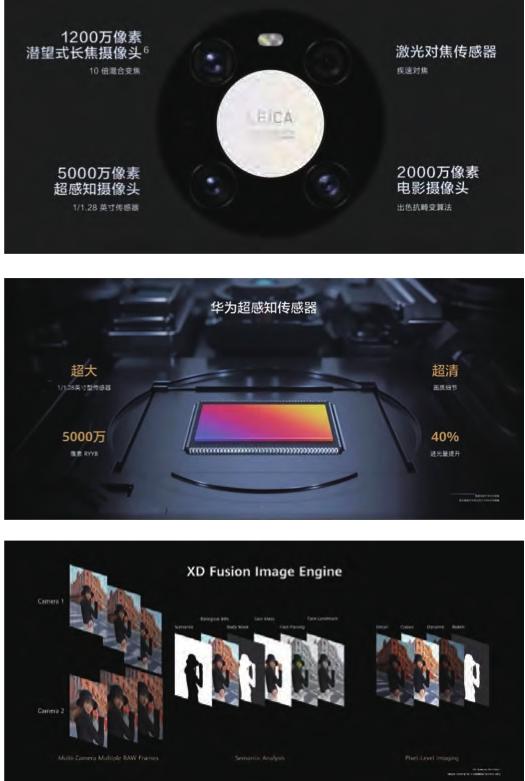

既然这篇文章主要聚焦在Mate系列身上,就简单回顾一下Mate系列影像的演进过程:Mate 10系列随着麒麟970的搭载,提出了AI摄影的概念,成为华为首款践行计算摄影的机型;Mate 20系列则引入超广角镜头和多焦段接力的变焦概念,16mm超广角和2.5cm微距成为这个系列的主要亮点;Mate 30系列上最大的改变就是电影镜头的引入,将视频赛道引入了华为的影像系统,而这个思路也一直演进到了P40系列和现在的Mate 40系列上;到了Mate 40这一代,动态影像的拍摄能力和广角成为了两个关键词。

自从在P40系列上引入了XD Fusion影像引擎之后,华为手机的成像画质的确是有了明显的提升,而Mate 40系列在引入算力更加强大的麒麟9000系列之后,画质的提升更加明显,我已经不止一次在摄影师那里听到“Mate 40 Pro的画质真好”这样的感叹了,而华为也表示他们有信心让IMX700的解析力超过亿级像素的传感器。

至于前边提到的为了画质更好将成像速度降下来,主要体现在两个方面,第一,按下快门之后整个系统对照片的运算需要明显的时间,如果动作快点,你可以明显在相册界面看到运算前后照片画面质量的提升过程,大部分时候运算的结果能符合预期;第二,复杂光线条件下快门时滞偏长,这一点在我做微博图文直播时的感知非常明显,但有意思的是,当按下第一次快门之后,随后的快门时滞又几乎可以忽略,个人认为可能的原因应该是影像系统对拍摄对象和环境的判断所致。

既然单张静态影像的画质已经可以保证,那么理论上动态影像的画质也同样可以得到保证。所以对比Mate 30系列和P40系列,Mate 40系列在动态影像的拍摄能力上又做了提升,达到了前后双4K的拍摄能力,为此Mate 40系列上的电影摄像头传感器又进行了升级,从之前的4合1(暗光16合1)模式工作的4000万像素改为了直出的2000万像素且尺寸不变(1/1.53英寸),所以单一像素尺寸变得更大,弱光性能和防抖表现也更好,这一做法也进一步改善了手机视频影像的解析力。同时,前置摄像头1300万像素摄像头的单像素尺寸也达到1.22μm,暗光表现相当不错。

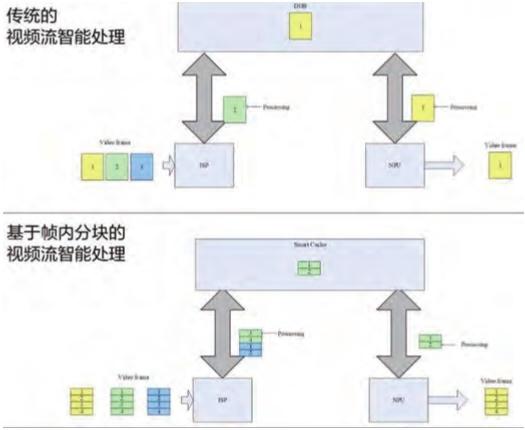

但是,视频并不是静态影像的简单合集,并且随着高帧率超高清视频的需求上升,对手机处理能力的要求也并非只是又快又好那么简单。功耗控制和发热在手持设备上是个永恒不变的主题,所以这次Mate 40系列的独家新秘籍就是“ISP+NPU融合架构”,即在麒麟9000内部处理影像数据时,让ISP与NPU两个模块实现硬件级别的联动响应,将色彩还原、细节还原和降噪等优秀表现带入视频拍摄领域。

简单理解“ISP+NPU融合架构”就是流程优化。现在常见的影像处理流程是顺序式的,即传感器数据交给ISP完成处理,置入片上缓存,然后再由NPU提取进行处理。由于两个模组之间工作交接的单位是帧,所以ISP和NPU处理不同复杂程度画面的能力不一,就可能造成某个模组“忙成狗”,另一个模组“闲到无聊”的失衡情况。

而“ISP+NPU融合架构”则是将两个模组之间的工作交接单位进行切片,目前是將一帧画面切分成四个部分,每个部分占四分之一多一点,因为画面最后要做整合输出,切片之间必须要有重合,然后再利用麒麟9000具备的Smart Cache 2.0技术,将高带宽大容量的片上缓存作为中续任务池,ISP和NPU两个模组会像打乒乓球一样,提取同一帧画面的不同切片部分进行处理,最后再合并输出。

这样的方式能平衡单位时间内ISP和NPU两个模组的任务负载,从而整体提升整个流程的工作效率:在4K分辨率下,这个组合的单帧处理时间仅为33ms,充分满足4K@30fps视频拍摄的数据吞量,这还是在加载了AI Demosaic和AI AWB等复杂算法之后得到的。当然,解决了流水线上效率的问题,功耗优化水平也随之得到了提升。

处理能力的提升也给Mate 40系列的视频玩法带来了更多花样。它的前后置模组都可以1080P@240fps的分辨帧率,无限制地拍摄慢动作视频;硬件级别的实时XD Fusion HDR,即录制视频时,每一帧都会采用长短曝光分别进行拍摄,然后再融合,达成画面宽容度的提升,而且前后置模组都能支持;双景录像功能,可实现后后、前后和画中画三种方式,让视频的创作方式更加丰富。

镜头,看得更广阔

更强的处理能力和算法,这些环节都处于影像处理的中后端,还有一个非常重要的前端环节,就是影像的原始数据。这里并非指大家马上就能想到的RAW格式传感器原始数据,而是还要更前端的物理元件——镜头,哪怕是常规手机的镜头模组不过芝麻绿豆大,但它对于光影的传达是否准确却对最后的画面解析力表现至关重要。

一说到这个话题,很多人可能都会想到Mate 40 Pro+上那枚自由曲面电影摄像头。是的,这是华为在光学设计上的又一个新尝试,是由华为2012实验室的专家团队基于广角畸变消除需求在物理层面的研究成果,将过去软件层面的广角畸变矫正更进一步。为什么叫“自由曲面”呢?

传统的镜片,包括做了D-Cut的长焦模组镜头,都是基于圆形镜片生成的,其光路特点会造成光线在入射传感器边缘时和中心产生慧差,常规的边缘画质下降和它有莫大的关系。这也是为什么很多超广角广角单反牛头会做得远比它的物理焦距长的原因,就是为了在投射到传感器之前,尽可能将所有光线都变得与传感器垂直,从而改善MTF曲线,同时改善握持操作手感,一举多得——当然,鱼眼镜头这种需要夸张效果的镜头除外。

但手机因为厚度的问题,不可能这样做,再加上物理焦距更短,这样的情况还会被放大。自由曲面镜头的做法,就是将广角镜头模组最后一片镜头的中央区域设计成矩形,从而完整覆盖住传感器的工作区域。因为传感器是矩形的,所以在矩形对准矩形的过程中,不管是通光还是滤光,都尽可能地减少了因为传统圆形镜头而引入的一系列的问题,你可以直接把它看成单反镜头后组镜片的集合体。这块曲率自由度极高的镜片,不仅减轻了四角的画质问题,也让同一个传感器在Mate 40 Pro上的等效18mm超广角视场角度,提升到了Mate 40 Pro+的等效14mm,提高了传感器的利用效率。

自由曲面镜头除了提升画质,它的另一个好处就是减轻了传统超广角镜头带来的透视畸变。传统的镜头系统有两种类型的畸变,一是不同焦段光学特性带来的桶形畸变和枕型畸变,好处坏处都有,前一种畸变会让人变胖但会让腿变长,后一种畸变会让人变瘦但对拉长腿却没什么好处,拍半身像效果出众,这也就是“人像焦段”的主要来历;另一种则是透视畸变,本来近大远小是一个人人都能接受的常识,但因为镜头的光学特性,却会在边缘让这种透视画面变得夸张,拍人则会出现不正常的拉伸。

过去手机上的做法是通过算法进行广角畸变校正,解决过度的透视拉伸问题,而在Mate 40 Pro+上,因为自由曲面镜头的加入,从物理层面就已经能明显减轻透视拉伸畸变,再结合最新的抗畸变边缘人脸算法,从而让广角人像的画面更出色。

当然,这个算法同样也作用于Mate 40系列的前置镜头模组。通过前置AI判断,在检测出多人自拍场景时,前置镜头会自动开启100°的视场角进行拍摄。这也就是Mate 40 Pro“前后100°双广角的来历”——其实100°只是18mm超广角的视场角,放在搭载自由曲面镜头的Mate 40 Pro+身上,14mm超广角的视场角会达到113°,相当可观。不过,现在最大的遗憾,则是这枚由华为与大立光联合研发的自由曲面镜头出现了严重的供应问题,使得Mate 40 Pro+一机难求,希望情况能尽快好转吧。

色彩,永不止步

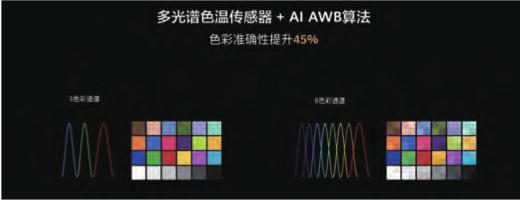

色彩这两个字,放在华为身上无疑是个矛盾体。与徕卡之间的跨界合作,给华为的手机影像赋予了辨识度极高的经典色彩,而自P30系列开始采用RYYB异型CFA傳感器,又给华为手机的色彩准确度表现带来了很多的争议。其实华为也知道RYYB传感器是非常不好驾驭的,所以对这类型传感器的认知和打磨一刻也没有停止过。

在P40上搭载的那枚独立的8通道色温传感器,目的就是为了解决这个问题。传统的传感器采用RGGB阵列,因此与之对应的色温传感器就是RGB三色的,但RYYB传感器中的Y(黄色)像素所包含的色彩信息量更加丰富,因为它可以同时吸收R(红色)和G(绿色),原来的G通道参数需要经过(Y-R)这样的差值计算得到,不仅算法复杂,而且需要额外的环境色彩信息参考,这便是这枚8通道色温传感器的重要用途。

在运算环节,前边提到的“ISP+NPU融合架构”也起到了重要作用。用于将拜尔格式转化为RGB格式的Demosaic算法、AWB和CCM(Color Corr Matrix)色彩校正管理模块等算法全部都有NPU加入运算,并整合进ISP图像处理的通路当中,其运作方式前边已有说明。各模块的神经模型网络经过大量的RYYB sensor RAW数据训练后,能有效找到物体细节和色彩分量之间的复杂映射关系,实现对RYYB异型CFA工作的支持。

由于平台能力的提升,使得8通道色温传感器最早在P40系列上只能判断光源的类型,在Mate 40系列上已经可以达到测量具体颜色数据,获取真实、准确、足够的色彩信息的程度;最重要的一点是在Mate 40这一代,华为第一次在静态影像拍照上,实现了DCI-P3色域拍显一致、全链路的色彩管理系统。这大约就是文章开头说到的:华为会慢慢形成自己的色彩风格。

特别要说明一下的是,XD Fusion属于计算摄影的领域,而这里提到的AI色彩、AWB算法和多光谱色温传感器,又是属于色彩科学团队的工作,两个团队的工作成果并行但也有交集。

此外,平滑变焦(SAT)是当下所有手机厂商都在多摄系统上着力解决的功能,这次在Mate 40系列上也有了提升,超广角与1倍之间的色彩一致性已经有了非常大的提升,但从我的使用来看,目前长焦的色彩问题还是有比较大的差异,比如肤色偏黄的问题还需要好好调校。总的来说,Mate 40系列在综合体验方面,比如白平衡的准确性、色彩的氛围感、防抖的基础能力和智慧的准确性等,都有很大的提升,是相当值得体验的。

写在最后

因为工作性质的原因,我有幸和很多华为的研发人员都有深入的交流。无论环境变得如何严苛,但从这部分华为人身上迸发出来的那股子信心、韧劲儿和随时随地表现出来的积极向上的心态,都让我感触颇深。另外,华为早就已经在着手进行平台切换的工作,以便能让华为自家的影像算法可以在其他平台上得到最大能力的发挥,而“ISP+NPU融合架构”的出现,就已经体现出很强的广适性,对于不同平台能力调用相当灵活。在手机影像上,华为的工程师意图融合和超越的不仅是自己已有的成果,更还有对未来的前瞻,保持进击,不要放松啊!