生成对抗网络图像类别标签跨模态识别系统设计

刘尚争 刘斌

摘 要: 針对传统图像类别标签识别系统只能单一模态识别图像类别标签的问题,设计一种生成对抗网络图像类别标签跨模态识别系统。将待识别图像输入系统跨模态多标签标定模块中,该模块采用卷积神经网络构建图像模型和文本模型,采用同质迁徙学习和混合迁徙学习训练两个模型,融合训练后的图像内容和说明文本两种模态,多模态类别标签标定图像;将标定图像传输到生成对抗网络中,该网络采用流行一致方法结合生成器生成的图像和隐变量、真实图像和编码器获取的图像特征,将结合结果传输到鉴别器后采用循环交替优化方式训练对抗网络,输出图像类别标签识别结果。经过实验分析发现,该系统能跨模态识别出原始图像中的花、电视图像类别标签,汉明损失数值均低于0.02,宏平均值高于0.97,系统跨模态识别图像类别标签效果好。

关键词: 生成对抗网络; 图像类别标签; 跨模态识别; 系统设计; 卷积神经网络; 训练模型

中图分类号: TN926?34; TP391 文献标识码: A 文章编号: 1004?373X(2020)08?0173?03

Design of cross?modal identification system for image category label in

generative adversarial networks

LIU Shangzheng, LIU Bin

(Nanyang Institute of Technology, Nanyang 473004, China)

Abstract: As the traditional image category label recognition system only can recognize the image category label with single mode, a cross?modal recognition system for the image category label in generative adversarial network is designed. The image to be identified is input into the multi?label calibration module of the cross?modal system, which constructs the image model and text model by means of the convolutional neural network, both models are trained by the homogeneous migration learning and hybrid migration learning. The two mode of trained image content and explanatory text of two modal category labels calibrate images are fused. The multi?mode category labels calibrate images, and transmit the calibrated images to the generative adversarial network, which combines the image generated by the generator with the hidden variables, real image and image feature obtained by the encoder by means of the popular consistent method. After the combined results are transmitted to the discriminator, the adversarial network is trained by means of the cyclic alternating optimization method to output the recognition results of the image category label. The experimental analysis results show that the system can cross?model recognize the flower and TV image category labels in the original image, the Hamming loss value is lower than 0.02, and the macro average value is higher than 0.97. The system cross?modal recognition of image category label effect is good.

Keywords: generative adversarial networks; image category label; cross?modal identification; system design; convolution neural network; training model

0 引 言

随着科技不断发展,海量图像资源涌现,如何对其精准高效地归类整理成为研究热点[1]。图像是一种多模态数据,而当前大部分学者主要采用单一模态识别方法,无法精准识别图像类别标签。因此本文采用跨模态方法识别图像类别标签,充分考虑图像的多种模态特征[2],将其作为识别图像类别标签的前提,提升图像类别标签识别精度。

跨模态标签定位图像后,需识别图像类别标签,选取具有较高识别率的方法识别图像类别信息。查阅相关文献发现,大部分学者采用生成对抗网络识别图像类别标签并优化生成网络[3],其具有较强的模拟能力,能从简单的隐变量中模拟产生复杂数据[4]。部分学者采用贝叶斯公式使生成对抗网络保持半监督学习状态,还有学者改变生成对抗网络训练误差,依照数据不确定熵信息训练生成对抗网络中的分类器[5]。但上述改进方法没有考虑从隐变量中提取图像特征,而在生成对抗网络中添加编码器,可充分提取隐变量中的图像特征,提升跨模态图像类别标签识别精度。

基于上述分析,本文设计一种生成对抗网络图像类别标签跨模态识别系统,先采用跨模态表多标签标定算法标定图像类别标签,再采用优化后的生成对抗网络识别标定后的图像类别标签。

1 跨模态识别系统设计

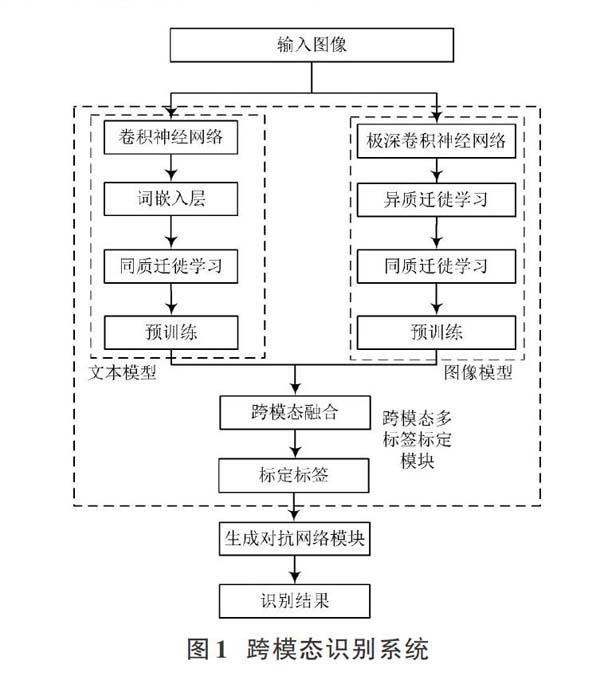

生成对抗网络图像类别标签跨模态识别系统设计,主要包含跨模态标签标定模块和生成对抗网络模块。系统总体结构图如图1所示。

系统先将待识别图像输入跨模态多标签标定模块中,采用卷积神经网络构建图像模型和文本模型,其中通过同质迁徙学习获取文本模型的预训练网络,依照预训练网络训练文本模型[6],通过同质迁徙学习和异质迁徙学习混合迁徙学习,获取预训练网络,依照获取的预训练网络训练图像模型,融合训练后的图像内容和说明文本两种模态,多模态类别标签标定图像[7],将标定后图像传输到生成对抗网络模块中,通过该模块处理标定后图像,识别图像类别标签。

1.1 跨模态多标签标定模块

多标签迁徙模型由文本模型和图像模型两部分构成,采用跨模态标签标定算法标定时,需采用相应方法構建图像模型和文本模型。

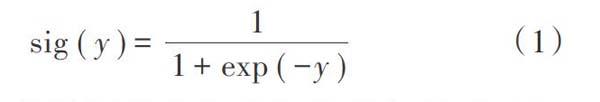

1) 图像模型。采用极深卷积神经网络处理图像模型,微调神经网络结构,使其适应跨模态标签标定算法。其中极深卷积网络是一种深度残差网络,深度为50层。图像模型中采用二元交叉熵损失函数[8],将最后一层softMax替换成激活函数,激活函数的表达式如下:

式中:[sig(y)]用于估计图像中每个标签的相关后验概率;[y]表示训练集中的样本。

2) 文本模型。需先收集所有文章的图像说明文本,再采用相关工具训练图像文本说明,获取词向量词典,采用卷积神经网络训练文本模型。卷积神经网络由嵌入层、两个全连接层、卷积层和全局最大池化层构成。其中嵌入层中包含词向量词典和采用训练集解释说明的文本,同构训练层转换输入文本,将其转变成词向量形式,缩放处理句子长度[9],将句子长度变成既定单词数。训练过程中采用同质迁徙学习方法,分类文字模型[10]。

1.2 图像类别标签跨模态识别

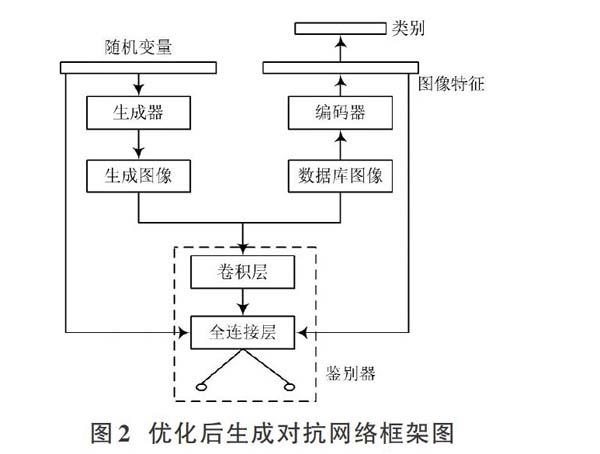

经过实际调查分析发现,原始生成对抗网络主要由生成器和鉴别器构成,如果想采用生成对抗网络跨模态识别图像类别标签,需在网络中添加一个提取特征的结构,即在生成对抗网络中添加一个编码器,作为生成结构的逆运算,通过既定训练方式训练编码器,获取图像原始数据本质特征[11],改进后的生成对抗网络鉴别器不仅输出图像数据,且输出对应的特征信息,达到跨模态识别图像类别标签的目的[12?13]。优化后生成对抗网络损失函数,采用损失函数调整训练方式,改善网络学习能力[14]。优化后的生成对抗网络结果如图2所示。

生成对抗网络先采用生成器映射随机隐变量,获取生成图像,通过编码器映射图像库中图像获取图像特征,将生成图像、真实图像以及图像对应的特征输入到鉴别器中。输入过程中采用流行一致方法,固定鉴别器采纳数后,采用鉴别器判断输入是否是真实图像数据。反向调整生成器和编码器的参数,直到网络收敛时不再调整参数,使生成图像与数据库中的图像之间相似度较高,此时编码器输出图像类别标签识别结果。

2 实验分析

2.1 系统识别图像结果

为验证本文系统图像类别标签识别效果,从图库中随机选取一幅图像进行识别测试,原始图像和识别结果如图3所示。

原始图像中包含多个类别标签,例如电视、桌子、灯和花等,本文系统能将其中的花、电视图像类别标签跨模态识别出来,说明本文系统能精准地跨模态识别出图像类别标签。

2.2 分析识别效果

为验证本文系统识别效果,需设置相应的评价指标,本文选取的评价指标为汉明损失、宏平均值。其中汉明损失表示误识别次数,汉明损失数值范围在0~1之间;宏平均值表示精度和召回率的调和平均,宏平均值数值范围在0~1之间,宏平均值数值越大表示识别效果越好,统计所选图像类别标签跨模态识别结果,统计结果如表1所示。

从表1可以看出,本文系统识别所选图像类别标签的汉明损失数值均低于0.02,宏平均值高于0.97,识别时间在5~6 ms的范围内,说明本文系统识别图像类别标签的误识别次数较低,识别精度较好,识别时间短。

3 结 论

本文设计一种生成对抗网络图像类别标签跨模态识别系统,通过生成对抗网络识别图像类别标签。本文系统可通过较少的图像标签数据训练得到识别效果较好的识别器,逆向利用生成器识别图像类别标签,使生成对抗网络具备直接学习图像本质特征的能力,减少处理过程中图像信息损失程度,提升识别图像类别标签效果,使本文系统适用性较强,可应用于实际识别图像类别标签中。

注:本文通讯作者为刘斌。

参考文献

[1] 于玉海,林鸿飞,孟佳娜,等.跨模态多标签生物医学图像分类建模识别[J].中国图象图形学报,2018,23(6):143?153.

[2] 李凯,彭亦功.基于生成对抗网络的图像识别改进方法[J].计算机工程与设计,2019,40(2):199?202.

[3] 唐贤伦,杜一铭,刘雨微,等.基于条件深度卷积生成对抗网络的图像识别方法[J].自动化学报,2018,44(5):90?99.

[4] 杜秋平,刘群.基于图像云模型语义标注的条件生成对抗网络[J].模式识别与人工智能,2018,31(4):379?388.

[5] 陈文兵,管正雄,陈允杰.基于条件生成式对抗网络的数据增强方法[J].计算机应用,2018,38(11):259?265.

[6] 李幼军,黄佳进,王海渊,等.基于SAE和LSTMRNN的多模态生理信号融合和情感识别研究[J].通信学报,2017,38(12):109?120.

[7] 征察,吉立新,李邵梅,等.基于多模态信息融合的新闻图像人脸标注[J].计算机应用,2017,37(10):3006?3011.

[8] 李志欣,郑永哲,张灿龙,等.结合深度特征与多标记分类的图像语义标注[J].计算机辅助设计与图形学学报,2018,30(2):318?326.

[9] 赵树阳,李建武.基于生成对抗网络的低秩图像生成方法[J].自动化学报,2018,44(5):64?74.

[10] 李健伟,曲长文,彭书娟,等.基于生成对抗网络和线上难例挖掘的SAR图像舰船目标检测[J].电子与信息学报,2019,41(1):148?154.

[11] 劉玉杰,窦长红,赵其鲁,等.基于条件生成对抗网络的手绘图像检索[J].计算机辅助设计与图形学学报,2017,29(12):2336?2342.

[12] 桑亮,高爽,尹增山.基于生成对抗网络的运动模糊图像复原[J].计算机工程与应用,2019(6):173?177.

[13] 杨真真,匡楠,范露,等.基于卷积神经网络的图像分类算法综述[J].信号处理,2018,34(12):84?99.

[14] 杨懿男,齐林海,王红,等.基于生成对抗网络的小样本数据生成技术研究[J].电力建设,2019,40(5):71?77.