AI从想象发展成为全球性现象

? 今天,我们发现自己已经被这种想象力所包围。

在今天演讲的开头,我想先跟各位分享一段多年前我还是本科科研实习生的经历。

那是凌晨 3 点,我和一群同学蜷缩在黑暗的实验室里。在我们面前的,是一只被全身麻醉的猫——它的视觉皮层连接着一连串电极。我们将这些电极连接到一个扬声器,并在猫的眼前投射出移动的线条。通过扬声器,我们听到了它神经元响应的声音。每一个噼里啪啦的声响都是大脑运作的一瞥,它们一起奏响了哺乳动物视觉系统的交响曲。

直至今天,当时那个时刻仍在影响着我。

这是一项最早由神经生理学家 David Hubel 和 Torsten Wiesel 进行的实验。他们所做的,是神经科学领域的突破和一个真正的转折点。这个实验为视觉智能奠定了基础,并给这两位科学家赢得了诺贝尔奖,为今天通过 AI 来改变世界的神经网络架构提供了蓝图。他们在 1959 年就完成了这一切。

这项实验不仅仅是科学的源泉,还是想象力的真正壮举。正是同样的好奇心,激发了从柏拉图,到笛卡尔,到图灵等思想家,向内心寻找心灵的奥秘,敢于追问心灵是如何运作的。别人只是看到魔法,但他们却窥见了科学的前沿,并进行探索。

今天,我们发现自己被这种想象力所包围。这是一个连接信息和技术发展的时代,可以被称为“第四次工业革命”,但这也是一个机遇和危险共存的世界。

在不到十年的时间里,AI 从一个学术领域的技术发展成了一个全球性的现象。不可否认的是,智能机器有可能会做坏事。它们容易受到算法偏差的影响,并且会引起人们对隐私、安全和工作被替换的担忧。这些都是 AI 的隐患。他们影响到了人类,要求紧急行动。

作为技术专家,我们有责任处理工具的缺陷,但也有责任充分发挥其潜力。2019 年世界非常复杂,我们对于事物理解的局限性也凸显出来。所以,我们要更智能的技术来帮助我们理解这个世界。

AI为了解世界带来新机会

气候变化,尽管事态非常严重紧急,我们很难收集到大规模和精细的数据,来全面理解气候变化,并且启用社会层面的节能措施。智能技术可以帮助你,它可以在全球范围内整合数据,从卫星图像到电网传感器,甚至是不分时间和地点持续运作的自主无人机。所有这些,都可以帮助优化从数据中心到家庭資源的分配方式。

然后,就是医疗保健。对世界上的许多人口来说,医疗保健的使用依然是他们无法企及的奢侈品。但随着计算机视觉算法将临床观察慢慢变成低成本技术,我们就可以说,AI 已经在悄然改变诊断。信息本身、文档、记录甚至是扫描文件的纷杂都远远超出人类能处理的程度。在这些杂乱的数据里,还有多少有用的知识未被发现?通过使用图像识别和自然语言处理方法的文档理解技术,我们或许就能找到答案。

这些都是关于人工智能如何增强人类功能,以及如何在超出我们能力的情况下,为需要帮助的受伤的人提供支持的故事。

但问题是,我们可以只受益,不受害?为了找到答案,我们必须在比历史上任何其他时间更大的范围内进行设想。而这种寻找将标志着 AI 新篇章的开始。AI 将以人为本,融合全球各种专业知识、理念和视角。

正是本着这一精神,我们宣布成立斯坦福以人为本人工智能研究院(Stanford institute of human centered AI, Stanford HAI)。它的使命是推动人工智能研究、教育、政策和实践,以改善人类状况。它的目标是成为一个全球对话中心,让每一个学科都能应对 AI 的挑战。这是对你们所有人的邀请,让我们通过承诺三个基本原则,一起畅想未来。

首先,为了让 AI 得到适当的发展,我们需要把它与正在进行的对其对人类社会影响的研究结合起来,并对它加以相应的指导。其次,AI 的最终目的应该是增加和增强我们的人性,而不是削弱或取代它。

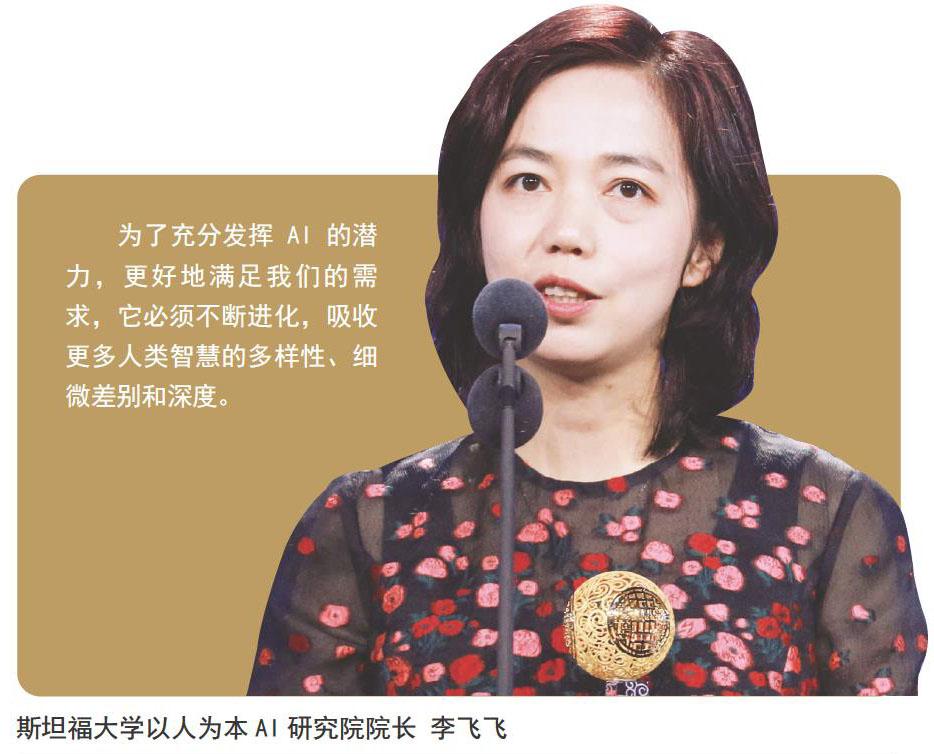

为了充分发挥 AI 的潜力,更好地满足我们的需求,它必须不断进化,吸收更多人类智慧的多样性、细微差别和深度。现在,你们可以和我一起想象,这种具有深度和多功能性的技术能做到什么?

例如,AI 正在改变医学诊断,因为算法可以更快、更精确、更一致地检测疾病。但这仅仅只是个开始。下一代的由 AI 驱动的医疗系统能做到什么?想象一下,它可以识别病人肢体或他们含糊不清的语音,并通过交叉参照来加快初步诊断的速度。

我们可以想象,它们能根据病人的面部表情和姿势对其情绪状态做出有根据的猜测。它可以在每个病人等待的时候,为他们戴上一只人造眼和一只人造耳,观察他们的医疗和情绪状态的变化,并让临床医生当天保持清醒。想象一下,这一切都是实时进行的,为急诊室内的每个人而工作。

这种医疗系统的效果将是革命性的。临床医生得以继续与患者面对面,但压力更小,注意力更集中。在急诊室里,节省时间往往就是拯救生命。

以人为本的 AI 不断进化它基本的判断和感知技能,在比较简单的工作上,更好地服务人类。总而言之,人类的能力可以专注于更高层次的任务,更安全,更少重复,更有创造力,最终更有意义。

让伦理成为人工智能研发的基本元素

AI不是要取代我们,而是让我们做得更好。这又把我们带回了人工智能陷阱的话题。现在,对我们所有人来说,重要的是要记住这是历史上独一无二的时刻,我们是第一代看到这种技术以如此规模和速度从实验室转移到现实世界的人。

这是第一次,人工智能的伦理不再是一个抽象概念或哲学实践。这项技术影响着现实生活中的人们。因此,我们有责任充分了解这项技术的影响,预测世界将如何作出反应,并据此作出指导。让我们从算法偏差和失业开始。这些都是重大问题,解决办法将采取多种形式。例如,有些偏差是技术性的,可以通过统计方法自动消除偏差数据集,但人的因素也很重要。当谈到失业问题时,尽管技术可以在提高技能方面发挥重要作用,但受到劳动力影响的同时,政策也将在为他们提供选择和支持方面发挥重要作用。但复杂性还不止于此。例如,随着人工智能在人类任务中发挥越来越多的协作作用,我们的法律将如何改变?随着人类专家越来越依赖于机器智能,我们的责任观念将会变成什么样?出了问题谁来负责?工程师们是时候面对这些问题了,政策制定者、法律学者和伦理学家也应该帮助寻找答案。

从历史上看,新技术的影响往往远远超出它们所提供的功能。例如,汽车的发明只是为了帮助我们更快地出行,但一个世纪后,世界已被高速公路、停车场和加油站重塑,更不用说对全球自然资源和气候的影响了。

智能机器的普及将会给我们的社区带来什么?它们将如何影响我们的文化? 我们已经生活在一个每天对技术陷阱提心吊胆的世界里。因为智能技术惊人的能力,它也伴随着非常高的风险。这些都是重大而棘手的问题,值得认真对待。它们要求我们投入时间、资源和广泛的专业知识来理解这项技术,预测它将带来的未来,并负责任地引导其进程。最重要的是,这是一个人性的呼吁。

这就是定义以人为本人工智能的三条原则,由此我们能确保它的设计是人性化的,它在社会中的角色是人性化的,它的影响是人性化的。

(本文根据李飞飞的公开演讲整理而成,未经本人确认。)