融合空间约束和梯度结构信息的视频篡改检测算法

普菡,黄添强,翁彬,肖辉,黄维

融合空间约束和梯度结构信息的视频篡改检测算法

普菡1,2,3,黄添强1,2,3,翁彬1,2,3,肖辉1,2,3,黄维1,2,3

(1. 福建师范大学数学与信息学院,福建 福州 350007;2. 福建省大数据挖掘与应用工程技术研究中心,福建 福州 350007;3. 数字福建大数据安全技术研究所,福建 福州 350007)

相邻帧间相似性原理的传统视频被动取证方法会对画面运动剧烈的视频发生大量误检测,针对这个问题,提出了一种融合空间约束和梯度结构信息的视频篡改检测方法。首先,利用空间约束准则,提取低运动区域和高纹理区域,并将两个区域进行融合,获取顽健的量化相关性丰富区域用于提取视频最优相似性特征;然后,改进原有特征的提取和描述方法,运用符合人类视觉系统特性的梯度结构相似性GSSIM来计算空间约束相关性值,最后,利用切比雪夫不等式对篡改点进行定位。实验证明,针对画面运动剧烈的视频,所提算法误检率更低,精确度更高。

空间约束;量化相关性丰富区域;梯度结构相似性;画面运动剧烈的视频

1 引言

由于数字视频的篡改检测在司法取证、新闻媒体等方面有重要的意义,因此近年来国内外对该领域展开了大量研究[1]。但现有的数字视频取证技术大多针对画面运动平缓的视频,对画面运动剧烈视频的取证会造成大量误检测[2]。因此,针对画面运动剧烈视频的篡改取证是一个亟待解决的问题,具有重要的研究意义。

目前,国内外的一些研究团队关于视频帧删除篡改的研究已经取得一定进展。Zhao等[3]首先通过比较视频相邻帧之间的HSV颜色直方图的相似性进行帧间篡改的粗检测,然后结合SURF特征提取和FLANN进行细检测,进一步确认篡改点,但由于HSV颜色直方图的基本原理是利用不同色彩在视频帧中所占的比例,并没有考虑不同色彩在视频帧中的空间位置信息,故该特征不能很好地代表帧图像信息,所以该方法的稳健性有待提高;Sowmya等[4]通过时空三元特征关系(STTFR,spatiotemporal triad feature relationship)技术对任何给定视频生成一个128 bit的信息数字,作为该视频唯一的指纹,利用视频时域上的篡改会破坏这种指纹的原理进行篡改取证,但该种方法属于主动取证,需要预先获得原始视频,所以其实用性受到一定限制。Wang等[5]提出一种基于非负张量分解的视频篡改检测方法,但该方法对细微的帧删除篡改和同源帧插入篡改会造成漏检测,具有一定的局限性。Lin等[6]提出一种融合音频的多通道视频帧间篡改检测方法,通过融合音频通道和视频帧序列通道的检测结果进行检测,然后结合QDCT特征进行细检测定位,但对于无声视频和画面运动剧烈的视频,该方法不能体现出它的优越性。Wang等[5]根据篡改视频重压缩保存后会导致离散余弦变换系数分布直方图出现周期性伪影,以及运动估计误差会显现周期性尖峰进行篡改取证,但该方法在检测含有噪声的视频时性能显著下降,而且无法检测到删除帧数是GOP整数倍时的篡改,同样不适用于使用恒定比特率编码模型的视频,所以该方法的适用局限性比较大。Liu等[6]提出了专门为H.264编码视频设计的帧删除检测方案,证明了在视频帧删除篡改的情况下P帧序列平均残差会在时域上表现出周期性,但该方法只适应于特定编码的视频。

由于视频本身的时域冗余性,相邻帧之间存在很大的相关性,所以基于视频内容连续性的检测方法对于大部分遭受帧删除篡改的视频有良好的性能。传统的帧删除篡改检测方法的主要步骤是:首先提取视频帧特征,然后计算相邻帧特征的相关性,最后通过相关性值出现的异常点进行篡改点的定位。然而,由于画面运动比较剧烈的视频相邻帧之间的相关性波动比较大,传统的检测方法会对其造成大量误检测。因此,本文提出一种融合空间约束和梯度结构信息的视频篡改检测方法,在更加精准地检测到篡改位置的同时,大大降低了误检率。鉴于视频的运动剧烈区域是影响检测精确率的主要因素,故本文算法首先采用自适应阈值最佳划分法对待检测视频进行空间约束,提取出低运动和高纹理区域,然后把两者进行融合,获取最优量化相关性丰富区域,并结合梯度结构相似性特征梯度结构相似性(GSSIM,gradient structure similarity)和GSSIM熵等方法,提高了特征的顽健性表达和检测的准确率。

由于在视频的量化相关性丰富区域提取的特征变化相对一致,所以该算法能够适用于不同画面运动剧烈程度的视频;同时利用基于人类视觉特性的GSSIM特征的顽健性表达,该方法不限制视频清晰程度以及视频类型,能检测到仅仅几帧的细微篡改。使用空间约束和梯度结构信息的结合方法,提高了检测方法的顽健性,针对画面运动剧烈的视频,与现有算法[5-7]相比,误检率更低,精确率更高。

2 视频空间约束

现有算法大多基于视频相邻帧之间的极大相关性原理进行篡改检测。对于画面运动剧烈的视频,鉴于相邻帧之间的相关性变化比较剧烈,仅利用传统的检测算法会造成大量误检测,因此可对视频进行空间约束,获取有利于篡改检测的空间区域,提高检测的精准率。视频空间约束是结合视频时空域上的相关信息对视频帧进行空域上的约束,通过定义一定的约束条件,过滤掉一部分影响篡改检测效果的区域,保留有利于篡改检测的空间区域。

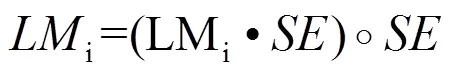

本文主要采用自适应阈值最佳区域划分法对视频进行空间约束,主要流程如图1所示,主要分为两部分的内容:①利用自适应低运动区域划分法获取视频的低运动区域;②首先通过自适应高纹理区域划分法实现对视频高纹理区域的空间约束;然后融合低运动和高纹理区域,获取有利于篡改检测的量化相关性丰富区域。

2.1 自适应低运动区域划分法

2.1.1 背景模型的初始化

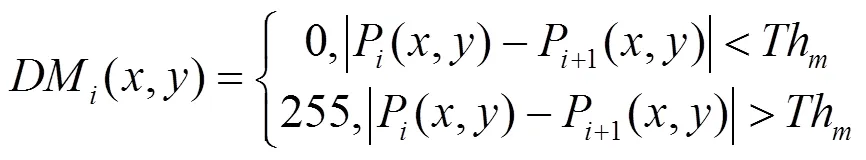

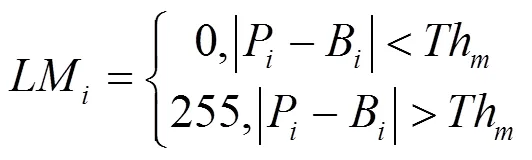

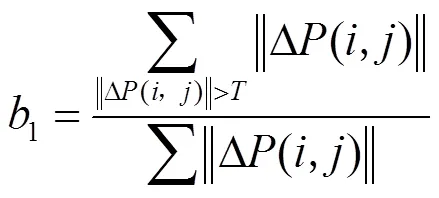

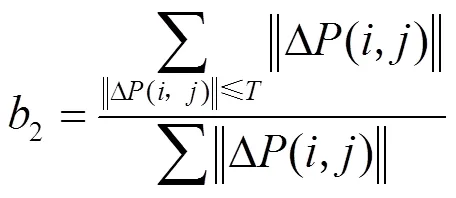

2.1.2 低运动区域的检测

首先通过当前帧与背景模型绝对差值的计算得到差图像,然后利用自适应阈值Th判断得到差图像对应的二维掩码,以此确定低运动区域。

图1 视频空间约束的流程

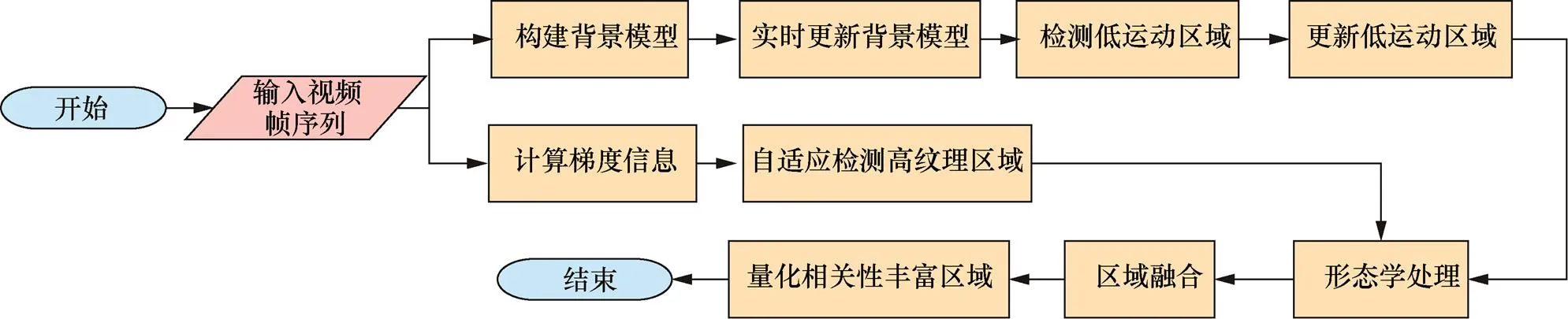

2.1.3 低运动区域的更新

由于视频的画面一直在变化,低运动区域也在实时变化,所以需要对低运动区域进行更新,主要包含两种更新方法:①当视频的场景微小变化时,进行像素级更新;②当视频的场景变化大时,进行帧级更新。具体更新的方法如下。

方法1 像素级更新

当低运动区域发生较大范围变化时,仅使用像素级更新,较难达到很好的效果,需要利用接下来介绍的帧级更新方法。

方法2 帧级更新

当低运动区域的面积小于整个帧图像面积超过一定百分比时,说明低运动区域发生了较大范围的变化。当连续多帧图像都出现这种情况时,需要利用上文低运动区域的检测方法对该区域进行重新获取。

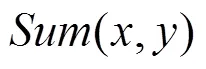

图2 差图像的直方图的简化模型

步骤1 把直方图的频数最大值点和频数最小值点进行连线,得到直线L。

步骤4 选取最大距离的点对应的横坐标(灰度值)作为二值掩码式(5)的阈值。

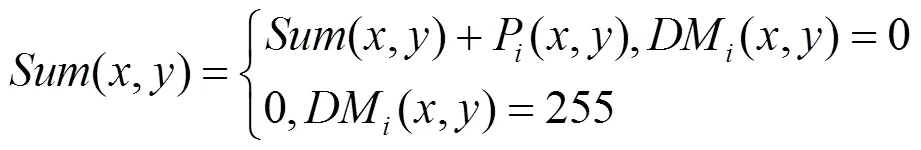

2.2 量化相关性丰富区域

2.2.1 自适应高纹理区域划分法

步骤1 首先计算当前帧灰度图像对应的梯度图像的最小像素值和最大像素值,然后计算二者的平均值作为阈值的初始值。

步骤2 通过初始阈值把当前帧划分为高纹理区域和低纹理区域,然后分别计算两区域梯度图像的平均灰度值1和2,及两区域梯度图像的灰度分别占整个帧梯度图像灰度的百分比1和2。

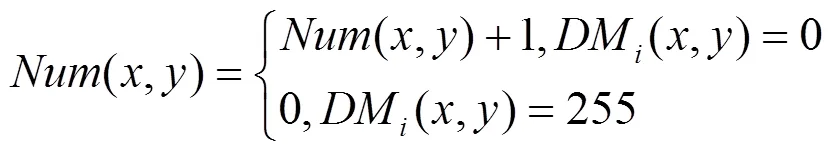

2.2.3 区域融合

3 篡改检测算法

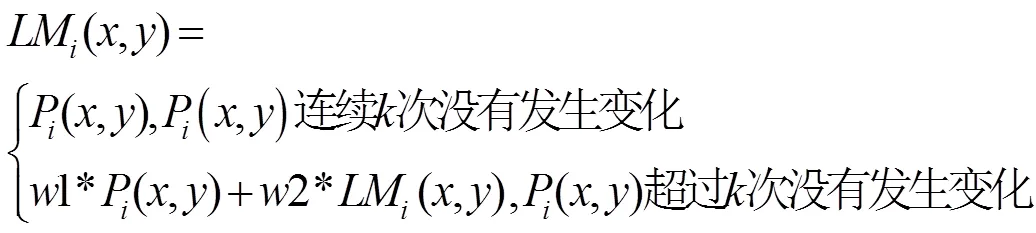

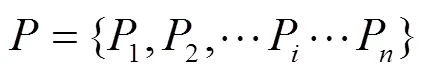

本文算法融合空间约束和梯度结构信息对给定视频进行篡改检测。首先,通过自适应低运动区域划分法获取视频的低运动区域,并结合自适应高纹理区域划分法获取视频的高纹理区域;然后,把两者进行融合,获取有利于基于相邻帧之间极大相关性原理检测方法的量化相关性丰富区域;其次,基于人类视觉特性改进原有的特征提取和描述方法,在此区域上提取梯度结构相似性特征GSSIM得到空间约束相关性值,并利用GSSIM商对其进行后处理;最后,利用切比雪夫不等式对篡改点进行定位。算法的具体流程如图3所示。

3.1 视频空间约束

考虑到视频本身的特性,视频的空间约束过程主要分为3部分:①首先对视频进行预处理,然后对视频的低运动区域进行空间约束;②视频高纹理区域的空间约束;③视频量化相关性丰富区域的空间约束。

步骤1 对视频低运动区域的空间约束。

为了减少计算复杂度,把待检测视频转换成帧序列图像,并对得到的帧序列图像进行灰度化的预处理。

画面变化剧烈的视频,由于原始视频的高运动区域使相邻帧之间相关性值比较小,使视频帧间篡改点的相邻两帧之间相关性值也会变小[8],因此为了减少误检率,可以定义一定的约束条件,过滤掉视频帧的高运动区域,获取视频的低运动区域。利用本文2.1节提出的自适应低运动区域划分法,对视频低运动区域进行空间约束的主要步骤如图4所示。首先,根据视频场景信息构建视频的背景模型;其次,当前帧和背景模型作差得到对应的差图像;然后,通过自适应阈值判断是否为低运动区域[9],并对低运动区域进行形态学操作来填补空隙和移除含有噪声的小面积区域;最后,根据视频场景的变化剧烈程度进行低运动区域的更新。

步骤2 对视频高纹理区域的空间约束。

由于视频帧的高纹理区域包含帧图像大量的梯度信息和边缘信息,所以对视频高纹理区域进行空间约束可以确保特征提取的有效性和精准性[10]。利用2.2节提出的自适应高纹理区域划分法,对视频高纹理区域进行空间约束的主要步骤如图5所示。首先,计算视频帧的梯度信息;然后,通过自适应阈值的判断得到视频的高纹理区域;最后,通过形态学操作来填补空隙和移除含有噪声的小面积区域。

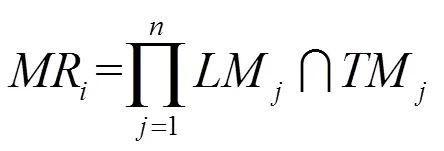

步骤3 对视频量化相关性丰富区域的空间约束。

为了避免造成误检测,可以获取视频的量化相关性丰富区域[11]。根据2.2节的内容,对视频的量化相关性丰富区域进行空间约束的主要步骤如图6所示,首先,对低运动和高纹理区域进行融合,取两个区域的交集;然后,通过形态学操作来填补空隙和移除含有噪声的小面积区域,获取视频的最优量化相关性丰富区域,实现对视频的空间约束。

3.2 特征提取

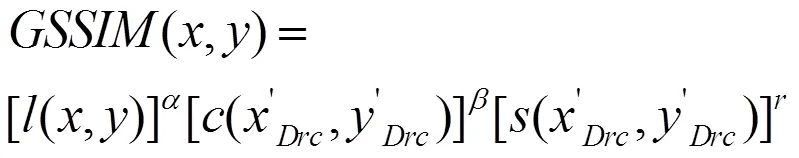

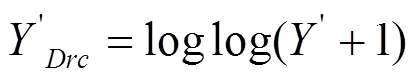

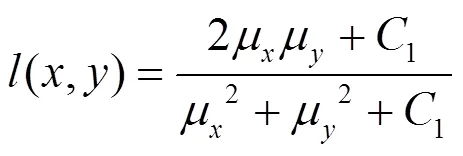

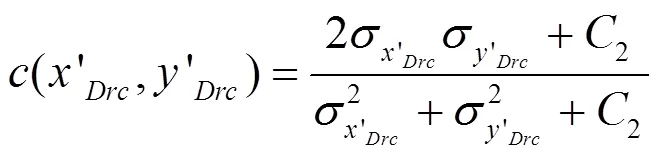

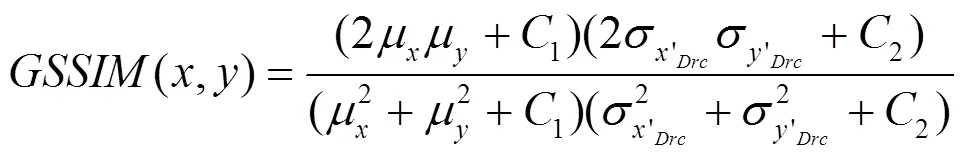

由于人类视觉系统具有对图像的边缘梯度信息比较敏感的特性,而梯度信息本身可以很好地反映出图像中微小的细节反差和纹理特征变化,因此可以将梯度作为重要的结构信息[12]。基于这一特性,改进原有结构相似性(SSIM,structural similarity)特征的提取和描述方法,在量化相关性丰富区域上采用梯度结构相似性(GSSIM),度量相邻帧的相似性。梯度结构相似性主要把从原始图像和梯度图像提取到的局部信息融合[13],从而提升传统SSIM在模糊图像上的性能,其中,梯度图像获取的具体步骤是:首先把原始帧图像进行Sobel边缘检测,然后进一步对其进行逐像素动态范围压缩,凸显图像的重要显著特征[14]。GSSIM的定义如下

图6 视频量化相关性丰富区域的空间约束

最后将图像块之间的梯度结构相似度取平均值(MGSSIM, mean gradient structural similarity),MGSSIM衡量的是两幅图像帧之间的相似度。两幅图像对应的所有图像块GSSIM的均值可以由式(26)得出。

3.3 特征处理

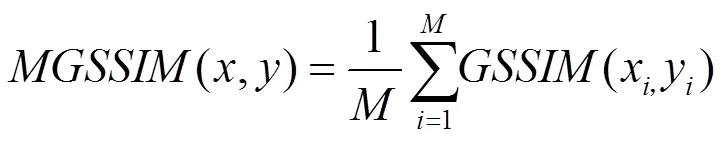

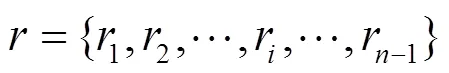

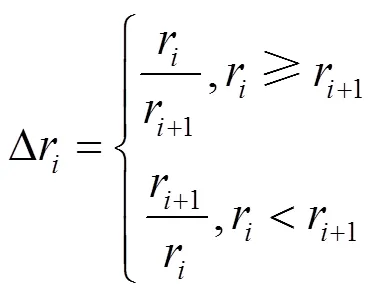

根据人类视觉系统的视觉停留现象,为了人类在视觉上能够感知连续的画面,视频的帧率一般是24~25 fp/s,所以相邻帧之间的相关性非常大,而经过人为帧删除恶意篡改之后,篡改点的相邻两帧之间相关性变小。但不能简单地通过分析相关性值的大小来判断视频是否被篡改[1],因为对于一个内容非静止的待检测视频,它的内容变化程度是未知的,同一视频的帧间相关性值也会出现变化。为了进一步消除视频内容运动变化对检测结果造成的影响,本文用MGSSIM商替换MGSSIM,MGSSIM商的定义如式(28)所示。

3.4 篡改点的定位

本文使用切比雪夫不等式[15]定位异常点。切比雪夫不等式衡量的是随机变量与均值之间的偏离程度,随机变量越远离平均值,概率越低。基于切比雪夫不等式的基本原理,可以用其进行离群点检测。切比雪夫不等式证明,对于任何一个随机变量,它的任何一个取值与均值的距离都遵循一定的概率,的取值只与它的方差有关[5]。切比雪夫不等式定义如式(30)和式(31)所示。

4 实验结果及分析

4.1 实验设置

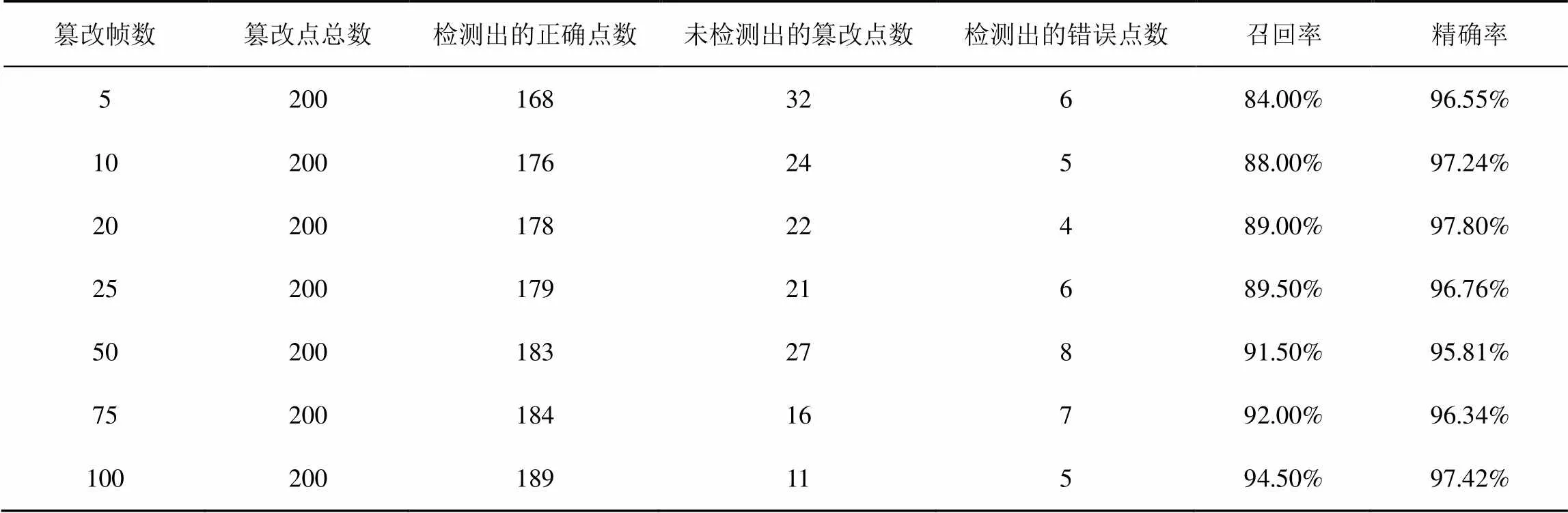

为了评估算法的检测效果,本文在3个公开数据集上进行了实验,分别是SULFA视频库(surrey university library for forensic analysis surrey university library for forensic analysis)[15]、CDNET视频库(a video database for testing change detection algorithms)[16],华南理工视频篡改检测数据库VFDD(Video Forgery Detection Database) Version1.0[17],共约200个视频。使用Adobe Premiere Pro CC软件对所有待检测视频进行不同数量程度的帧删除篡改,分别是5,10、20、25、50、75、100。本文的算法由Python和Matlab编程实现。以下为实验所使用的计算机配置:中央处理器Intel(R) Xeon(R) CPU,16 GB内存以及操作系统为Microsoft Windows 10PC。

4.2 实验结果

为了验证本文算法的有效性,分别针对不同运动剧烈程度的视频进行不同程度的帧删除篡改,具体步骤是:对所有视频运行检测算法并分析实验结果,同时和现有方法的检测结果进行比较和量化分析。为了验证本算法的顽健性,分别从空间约束、梯度结构相似度GSSIM两个角度进行对比实验,同时和现有的较优算法进行实验效果的比较分析。实验的具体流程如下。①验证空间约束对检测算法准确率的影响,具体步骤是:对于运动变化剧烈和平缓的两类视频,在同等条件下,分别对这两类视频进行空间约束和不进行空间约束进行篡改检测,对比实验效果。②验证GSSIM特征的顽健性,具体步骤是:在同等条件下,对画面模糊和清晰的两类视频分别提取特征SSIM和GSSIM进行对比实验。

4.2.1 对视频进行空间约束的实验结果

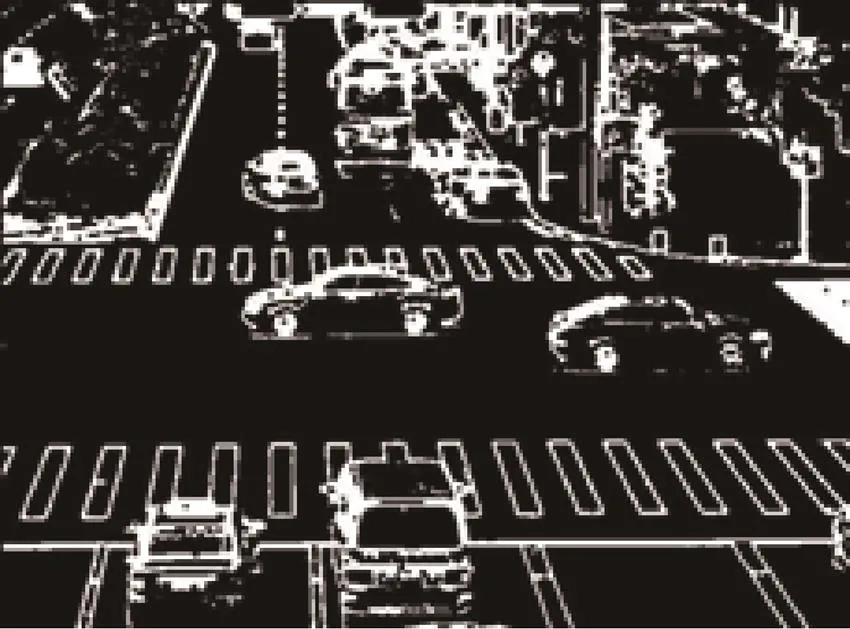

选取视频Camera Road 01.avi进行空间约束实验结果的展示说明。首先,运用自适应的运动区域检测算法对低运动区域进行空间约束。实验结果如图7所示,选取第8帧图像构建的原始背景模型如图7(a)所示,第8帧的背景模型如图7(b)所示,第8帧图像如图7(c)所示,图7(b)和图7(c)相减得到第8帧的差图像如图7(d)所示。对得到的差图像进行直方图统计如图7(e)所示,利用2.1节低运动区域阈值的自适应选取算法进行阈值的选取,该帧图像的阈值选取为20,进而得到第8帧的二值化掩码,如图7(f)所示,其中黑色区域是检测到的第8帧的低运动区域。然后,利用2.2节的方法对视频的高纹理区域进行空间约束,阈值为150,实验结果如图8所示,白色区域即为高纹理区域。最后,对视频帧的高纹理区域和低运动区域进行融合,取两区域的交集,得到第8帧的量化相关性丰富区域,如图9所示,实现对视频的空间约束。

4.2.2 篡改检测结果展示

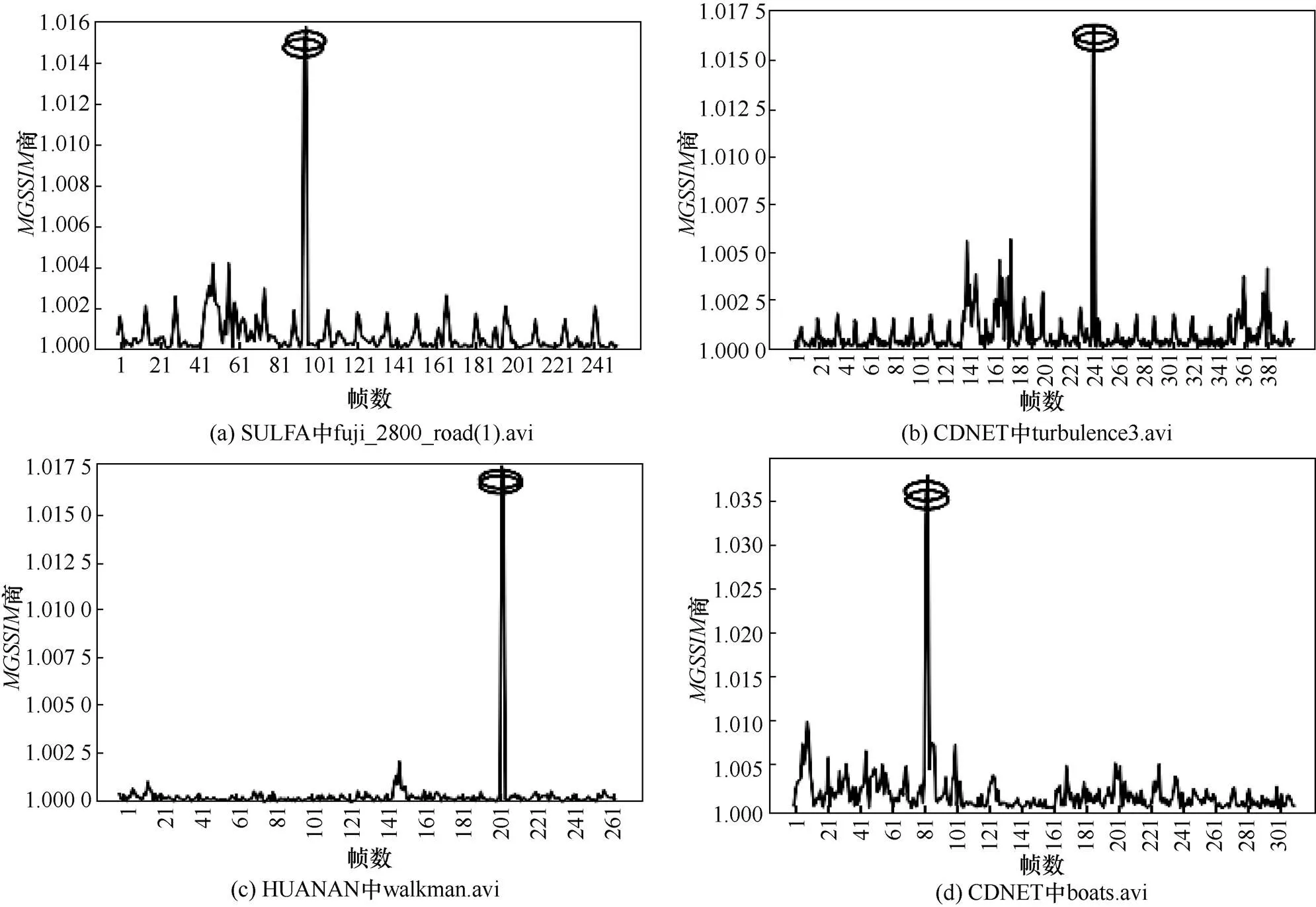

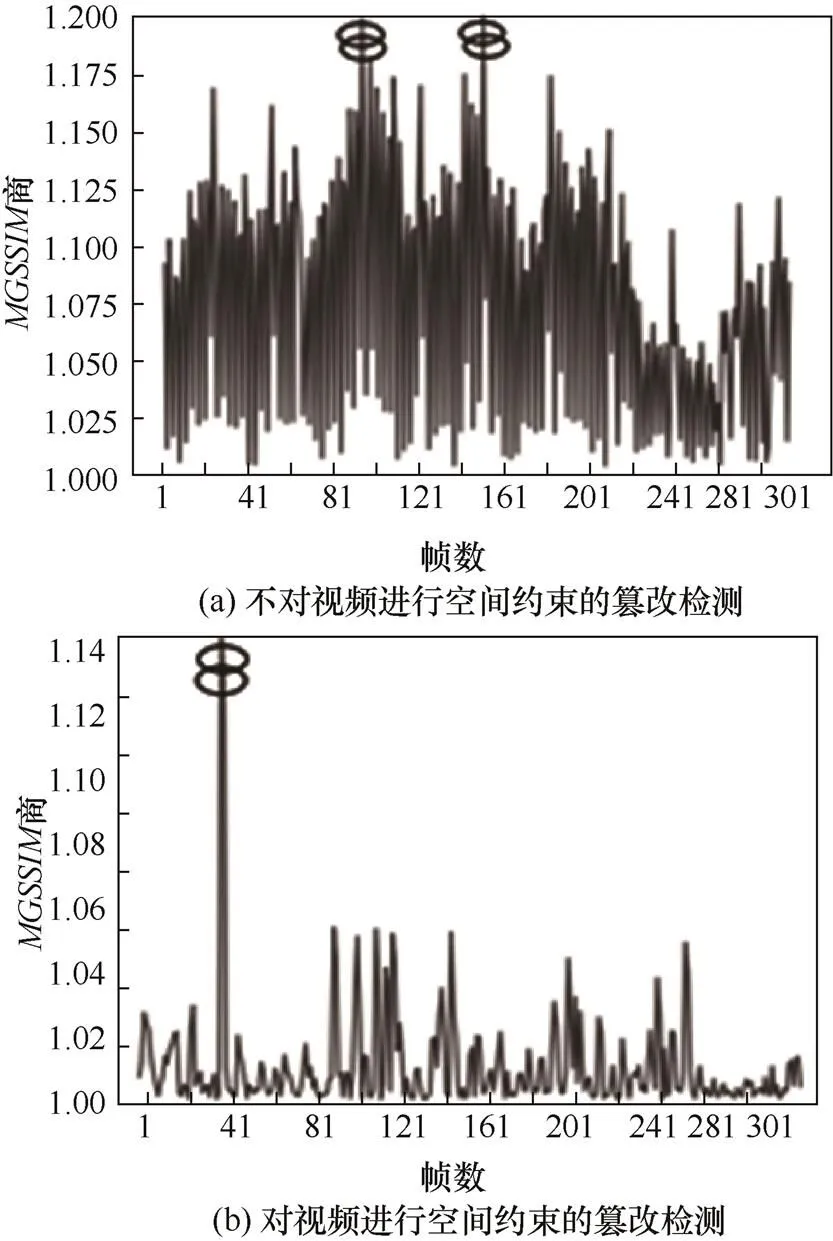

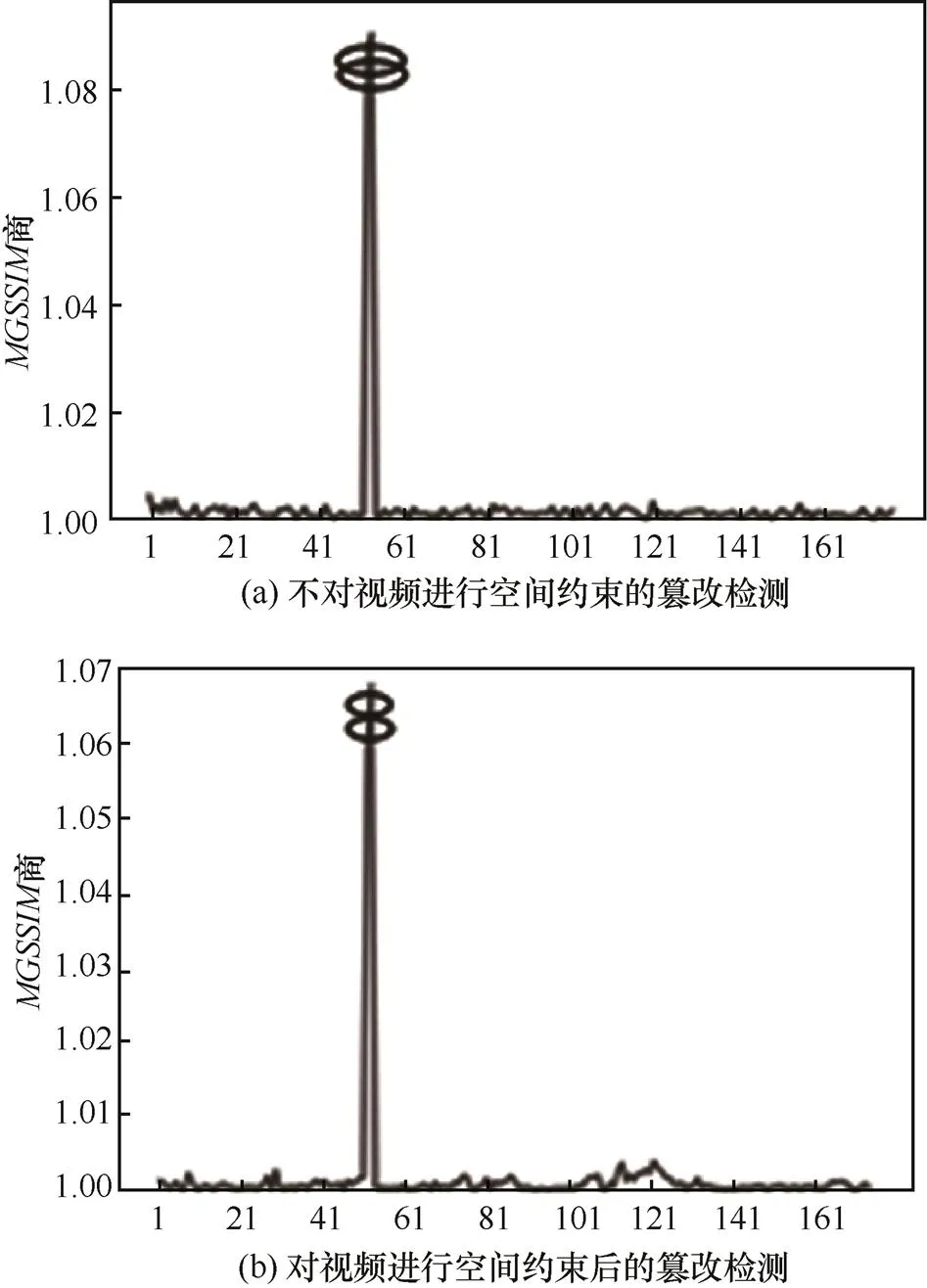

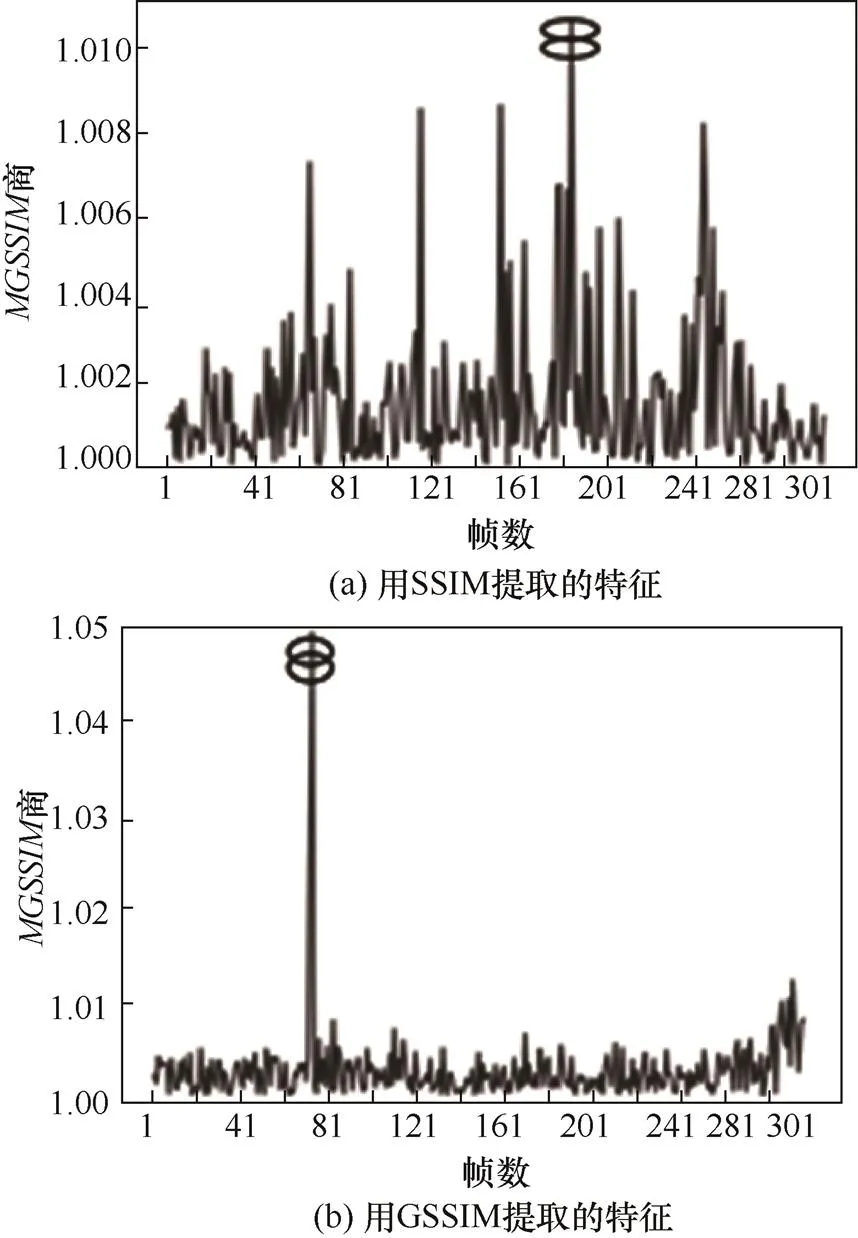

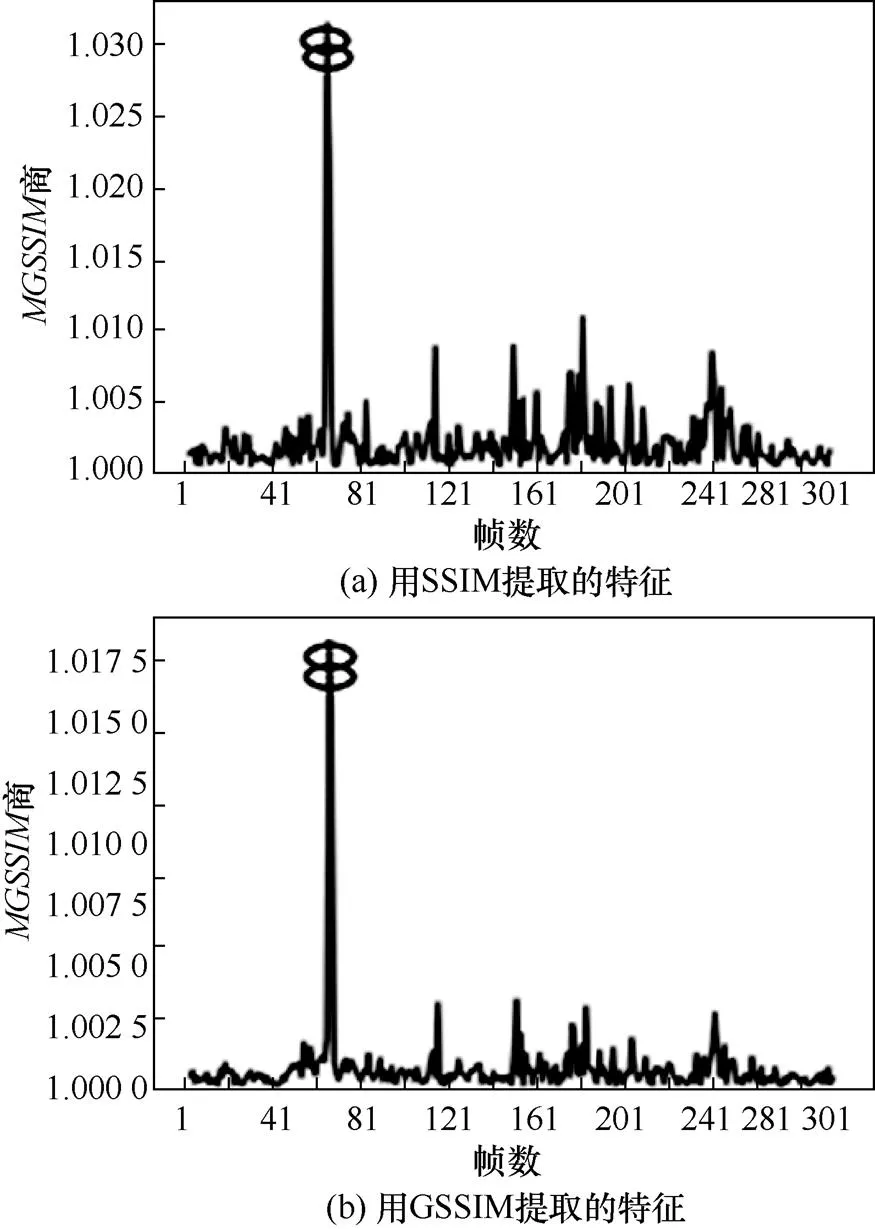

针对视频的帧删除篡改,可以通过观察检测结果中被篡改的位置是否出现尖锐峰值,及是否会定位到异常点来判断检测效果。根据GSSIM商公式的计算,在一个篡改点的位置产生两个异常点,相应地会导致一对相邻的峰值出现,篡改点的位置用黑色圆圈标记。

图8 视频高纹理区域的空间约束

图9 视频量化相关性丰富区域的空间约束

(1)验证本文算法对运动剧烈视频的有效性

为了验证本文方法的有效性,针对不同运动剧烈程度的视频均进行了篡改检测,检测结果如图10所示。对于画面运动较为剧烈的视频,选取的实验视频是SULFA视频库中fuji_2800_ road(1).avi,该视频中记录的是在高速公路上行驶的汽车,并对其在95帧处进行了10帧的帧删除篡改(95~105),检测结果如图10(a)所示,可以观察到在95帧处有尖锐明显的峰值出现,用黑色圆圈标记;如图10(b)所示,实验视频是CDNET视频库中turbulence3.avi,turbulence分组的视频画面运动较为剧烈,并在238帧处进行了75帧的帧删除篡改(238~313),可以观察到在238帧处有尖锐明显的峰值出现,同时篡改点用黑色圆圈标记。对于画面运动相对剧烈的视频,选取的实验视频是HUANAN视频库中walkman. avi,该视频记录的是奔跑的行人,同时对该视频在200帧处进行了25帧的帧删除篡改(200~225),检测结果如图10(c)所示,可以观察到在221帧处有尖锐明显的峰值出现,而且用黑色圆圈标记。如图10(d)所示,实验视频是CDNET视频库中dynamicBackground的boats.avi,由于它是动态背景的视频,所以整体画面运动相对剧烈,同时在82帧处进行了20帧的帧删除篡改(82~102),可以观察到在82帧处有尖锐明显的峰值出现,用黑色圆圈标记。

图10 运动变化剧烈视频的篡改检测结果

通过实验证明,本文算法对不同运动剧烈程度的视频检测性能都比较良好,均能精准地把篡改点定位出来。

(2) 验证空间约束效果的对比实验

为了验证本文算法所提的空间约束是否能提升检测的准确率,在同等条件下,针对运动变化剧烈和运动变化平缓的两类视频,对视频进行空间约束和不进行空间约束分别做对比实验。

①运动变化剧烈的视频

针对运动变化剧烈视频的对比实验结果如图11所示,实验视频是CDNET视频库中Night Video的Video1.avi,并在36帧处进行了5帧的帧删除篡改(36~51)。首先,对待检测视频不进行空间约束,篡改检测的效果如图11(a)所示。可以明显看到被篡改的位置36帧处没有出现尖锐的峰值,且并没有定位到异常点,却在92帧和151帧处标记了篡改点,存在严重的误检测。造成误检测的主要原因是该视频的运动变化较为剧烈,从图11(a)中可以观察到该视频相邻帧的相关性波动很大,因为该视频中存在高速运动的汽车,所以该视频的运动变化非常剧烈。然后,对视频进行空间约束,同样的条件下,对得到的量化相关性丰富区域进行视频篡改检测,检测效果如图11(b)所示,可以观察到在36帧处有尖锐明显的峰值出现,用黑色圆圈标记。

通过对比实验,证明了对视频进行适当的空间约束可以提高视频篡改检测的准确率,减少误检率。而且受视频内容变化的影响,现有算法对仅仅几帧的删除篡改往往检测不到,但本文算法却可以实现精确检测。说明本文算法不仅能适应于运动变化剧烈的视频篡改,还同样能检测到几帧的细微帧删除篡改,具有很强的顽健性。

②运动变化平缓的视频

针对运动变化平缓视频的实验结果如图12所示,实验视频是HUNAN视频库中的Yvmaoqiu.avi,并在53帧处进行了25帧的帧删除篡改(53~78)。首先,对视频不进行空间约束,篡改检测的结果如图12(a)所示。可以看到被篡改的位置53帧处出现尖锐的峰值,以及黑色圆圈标记的异常点。从图像中可以观察到该视频相邻帧的相关性波动很小,因为视频中不存在高速运动的物体,所以该视频的运动变化较为平缓。然后,对视频进行空间约束,同样的条件下,对空间约束区域进行篡改检测,检测效果如图12(b)所示。可以观察到在53帧有尖锐明显的峰值出现,用黑色圆圈标记。通过对比实验,说明本文算法同样适用于运动变化平缓的视频。

图11 运动变化剧烈视频的对比实验

图12 运动变化平缓视频的对比实验

(2) 验证特征GSSIM的顽健性

基于人类视觉特性的原理改进SSIM的特征提取和描述方法,本文算法提出在量化相关性丰富区域上提取梯度结构相似性GSSIM进行篡改检测。为了验证GSSIM特征具有较强的顽健性,能够适用于画面模糊视频的特征提取。在同等条件下,针对画面模糊和画面清晰两种类型的视频,分别提取SSIM和GSSIM进行对比实验。

①画面模糊的视频

针对画面模糊视频的对比实验结果如图13所示,实验视频是CDNET视频库中Night Video的Video1.avi,并在75帧处进行了20帧的帧删除篡改(75~95)。首先,用Adobe Premiere Pro CC软件对篡改后的视频进行高斯模糊处理,其中模糊因子设为10;其次,对空间约束后的视频提取SSIM特征进行篡改检测,检测的效果如图13(a)所示,可以看到被篡改的位置75帧处并没有出现尖锐的峰值,同时也没有黑色圆圈标记的异常点,但在170帧处标记到了异常点,造成了误检测;然后,同样的条件下,对视频提取GSSIM特征进行篡改检测,检测效果如图13(b)所示,可以观察到在75帧有尖锐明显的峰值出现,用黑色圆圈标记。通过对比实验,说明本文提出的GSSIM特征具有较强的顽健性,能够适用于模糊视频的篡改。

②画面清晰的视频

针对画面清晰视频的对比视频实验结果如图14所示,实验视频是SULFA视频库中的02_original.avi,并在61帧处进行了20帧的帧删除篡改(61~81)。首先,对空间约束后的视频提取SSIM特征进行篡改检测,检测效果如图14(a)所示,可以看到被篡改的位置61帧处出现尖锐的峰值,同时也有黑色圆圈标记的异常点;其次,同样的条件下,对同样的视频提取GSSIM特征进行检测,检测效果如图14(b)所示,可以观察到在61帧处同样有尖锐明显的峰值出现,而且用黑色圆圈进行了标记。通过对比实验,说明本文算法提出的GSSIM特征适用于清晰视频的篡改。

图13 画面模糊视频的对比实验

图14 画面清晰视频的对比实验

4.2.3 量化分析与讨论

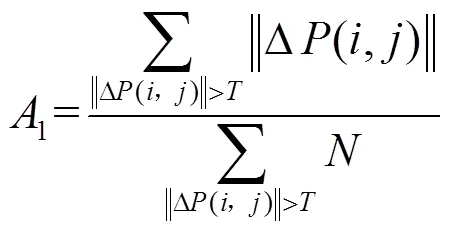

为了评价算法的性能,本文使用准确率(precision)、召回率(recall)对实验结果进行分析,计算公式如下。

其中,N是检测出的正确(correct)点数,N是检测出的错误(false)点数,N是未检测出(miss)的篡改点数,即漏检的篡改点的数量。

部分实验结果如表1和表2所示,从表1中可以看出本文算法对不同视频可以有效准确地检测到不同程度的帧删除篡改,其中篡改帧数为5帧时的召回率最低,原因是该篡改帧数较小,不足以影响到相邻帧间的相关性值的变化,造成了漏检的篡改点的数量较多;篡改帧数为100的检测准确率最高,因为该篡改帧数较大,漏检的篡改点的数量较少,同时误检率也比较低,所以精确率较高。表2是本文算法与对比文献算法的性能比较结果,通过分析表2可以得出结论,本文通过空间约束对量化相关性丰富区域进行篡改检测,在不同公开视频数据库上的检测结果在准确率和召回率上总体均优于文献[5]和文献[6]的算法。本文算法对CDNET库中夜间视频的检测性能相对不太理想,但也优于对比算法,原因可能是夜间视频光线比较暗,对该类视频提取到的帧特征不能很好地代表帧图像内容,所以算法在夜间视频的检测性能略微下降。

表1 视频的帧删除篡改检测结果

表2 各算法性能比较结果

5 结束语

本文提出了融合空间约束和梯度结构信息的视频篡改检测算法,首先对给定视频进行空间约束,分别自适应地提取出低运动和高纹理区域,把两区域进行融合,获取量化相关性丰富区域,通过在此区域上提取梯度结构相似性特征GSSIM得到空间约束相关性值,并利用GSSIM商对空间约束相关性值进行后处理,最后利用切比雪夫不等式实现对篡改点的检测和定位。通过对比实验证明,对视频进行空间约束可以过滤掉一些易造成误检的区域,使约束得到的量化相关性丰富区域的相邻帧之间相关性值大小较为稳定,使之能够适用于运动变化剧烈视频的篡改检测;同时基于人类视觉系统的特性改进了原有的特征提取和描述方法,提出了检测性能较好的梯度结构相似性特征GSSIM,可以适用于模糊视频的篡改取证。实验证明本文算法具有很高的精确率、极低的误检率及较强的顽健性,不足之处在于对夜间视频的篡改检测性能不太好,这也是后继需要重点研究的工作。

[1] 陈威兵,杨高波, 陈日超等. 数字视频真实性和来源的被动取证[J]. 通信学报, 2011, 32(6).177-183.

CHEN W B, YANG G B, CHEN R C, et al. Digital video passive forensics for its authenticity and source[J]. Journal on Communications. 2011, 32(6).177-183.

[2] SINGH, RAAHAT DEVENDE R, AGGARWAL N. Video content authentication techniques: a comprehensive survey[J]. Multimedia Systems, 2018:1-30.

[3] ZHAO D N, WANG R K, LU Z M. Inter-frame passive-blind forgery detection for video shot based on similarity analysis[J]. Multimedia Tools & Applications, 2018(1):1-20.

[4] SOWMYA K N, CHENNAMMA H R, LALITHA R. Video authentication using spatio temporal relationship for tampering detection[J]. Journal of Information Security and Applications, 2018, 41:159-169.

[5] WANG W, FARID H. Exposing digital forgeries in video by detecting double MPEG compression[C]//8th Workshop on Multimedia and Security (MM&Sec’06). NY, 2016: 37-47.

[6] LIU H, LI S, BIAN S. Detecting frame deletion in H.264 video[C]//10th International Conference ISPEC. 2017: 262-270.

[7] 左建军, 吴有富. 一种基于直方图的实时自适应阈值分割方法[J]. 毕节学院学报, 2014, 32(4):53-56.

ZUO J J, WU Y F. A real-time adaptive threshold segmentation method based on histogram[J]. Journal of Bijie University, 2014, 32(4): 53-56.

[8] 黄添强, 陈智文, 苏立超, 等. 利用内容连续性的数字视频篡改检测[J]. 南京大学学报(自然科学), 2011, 47(5):493-503.

HUANG T Q, CHEN Z W, SU L C, et al. Digital video forgeries detection based on content continuity[J]. Journal of Nanjing University(Natural Sciences), 2011, 47(5):493-503.

[9] 薛丽霞, 罗艳丽, 王佐成. 基于帧间差分的自适应运动目标检测方法[J]. 计算机应用研究, 2011, 28(4):1551-1552.

XUE L X, LUO Y L, WANG Z C. Detection algorithm of adaptive moving objects based on frame difference method[J]. Application Research of Computers, 2011, 28(4):1551-1552.

[10] 王晅, 毕秀丽, 马建峰, 等. 基于概率统计模型与图像主纹理方向分析的非线性滤波算法[J]. 中国图象图形学报, 2018, 13(5):858-864.

WANG X, BI X L, MA J F, et al. Nonlinear filtering algorithm using probability statistic and main texture direction analysis based on randon transforms[J]. Journal of Image and Graphics, 2018, 13(5):858-864.

[11] AGHAMALEKI J A, BEHRAD A. Inter-frame video forgery detection and localization using intrinsic effects of double compression on quantization errors of video coding[J]. Signal Processing: Image Communication, 2016: 289-302.

[12] 孙健钧, 赵岩, 王世刚. 基于图像梯度信息强化的SIFT特征匹配算法改进[J]. 吉林大学学报(理学版), 2018, 56(1):82-88.

SUN J J, ZHAO Y, WANG S G. Improvement of SIFT feature matching algorithm based on image gradient information enhancement[J]. Journal of Jilin University (Science Edition), 2018, 56(1): 82-88.

[13] NERCESSIAN S, AGAIAN S S, PANETTA K. A. An image similarity measure using enhanced human visual system characteristics[C]//SPIE Defense, Security and Sensing. 2011.

[14] QADIR G, YAHAYA S, HO A T. Surrey university library for forensic analysis (SULFA) of video content[C]// IET Conference on Image Processing (IPR 2012). 2012: 1-6.

[15] HE Z. The data flow anomaly detection analysis based on LipChebyshev method[J]. Computer System Application, 2009, 18(10): 61-64.

[16] GOYETTE N, JODOIN P M, PORIKLI F, et al. Changedetection.net: a new change detection benchmark dataset[C]// Computer Vision & Pattern Recognition Workshops. 2014: 1-8.

[17] HU Y J, AL-HAMIDI S. Construction and evaluation of video forgery detection database[J]. Journal of South China University of Technology (Natural Science), 2017, 45(12): 57-64.

Video tampering detection algorithm based on spatial constraint and gradient structure information

PU Han1,2,3, HUANG Tianqiang1,2,3, WENG Bin1,2,3, XIAO Hui1,2,3, HUANG Wei1,2,3

1. Mathematics and Informatics, Fujian Normal University, Fuzhou 350007, China 2. Fujian Provincial Engineering Research Center of Big Data Analysis and Application, Fuzhou 350007, China 3. Digital Fujian Big Data Security Technology Institute,Fuzhou 350007, China

The traditional video passive forensics method using only the principle of similarity between adjacent frames will cause a lot of false detection for the video with severe motion.Aiming at this problem, a video tamper detection method combining spatial constraints and gradient structure information was proposed. Firstly, the low motion region and the high texture region were extracted by using spatial constraint criteria. The two regions were merged to obtain the robust quantitative correlation rich regions for extracting video optimal similarity features. Then improving the extraction and description methods of the original features, and using the similarity of the gradient structure in accordance with the characteristics of the human visual system to calculate the spatial constraint correlation value. Finally, the tampering points were located by the Chebyshev inequality. Experiments show that the proposed algorithm has lower false detection rate and higher accuracy.

spatial constraints, the quantitative correlation rich regions, GSSIM(gradient structure similarity), videos with severe motion

普菡(1995− ),女,河南平舆人,福建师范大学硕士生,主要研究方向为信息安全、数字多媒体取证。

黄添强(1971− ),男,福建仙游人,博士,福建师范大学教授,主要研究方向为机器学习、数字多媒体取证。

翁彬(1981− ),男,福建福州人,博士,福建师范大学讲师,主要研究方向为机器学习及应用。

肖辉(1991− ),男,福建建瓯人,福建师范大学硕士生,主要研究方向为信息安全、数字多媒体取证。

黄维(1994− ),女,福建莆田人,福建师范大学硕士生,主要研究方向为信息安全、数字多媒体取证。

TP393

A

10.11959/j.issn.2096−109x.2019052

2019−04−14;

2019−06−06

黄添强,fjhtq@fjnu.edu.cn

国家重点研发计划专项基金资助项目(No.2018YFC1505805);应用数学福建省高校重点实验室基金资助项目(No.SX201803)

National Key Program for Developing Basic Science (No.2018YFC1505805),Applied Mathematics Fujian Provincial Key Laboratory Project (No.SX201803)

普菡, 黄添强, 翁彬, 等. 融合空间约束和梯度结构信息的视频篡改检测算法[J]. 网络与信息安全学报, 2019, 5(5): 64-79.

PU H, HUANG T Q, WENG B, et al. Video tampering detection algorithm based on spatial constraint and gradient structure information[J]. Chinese Journal of Network and Information Security, 2019, 5(5): 64-79.