基于Faster-RCNN的花生害虫图像识别研究

陶震宇 孙素芬 罗长寿

摘要:为实现花生害虫图像的准确分类,共收集花生主要害虫图片2 038张,针对目前在基于Faster-RCNN的图像识别领域较为成熟的VGG-16和ResNet-50这2种网络模型进行对比研究,并针对ResNet-50模型参数进行调整,提出了基于学习率、训练集和测试集以及验证集的比例选择、迭代次数等参数改进的ResNet-50卷积神经网络的模型。结果表明:该模型可以准确高效地提取出花生主要害虫的多层特征图像,在平均识别率上,经过改进的 ResNet-50 网络模型在识别花生害虫图像上优于ResNet-50原始网络模型。该模型可以准确地分类花生主要害虫图像,可在常规情况下实现花生害虫的图像识别。

关键词:Faster-RCNN;ResNet-50模型;花生害虫;图像识别

中图分类号:TP391.41 文献标志码: A 文章编号:1002-1302(2019)12-0247-03

我国作为世界上传统的农业大国,农业的发展情况对我国的经济发展具有深远的影响。花生在自然生长过程中很容易受到害虫的侵害和感染,近年来由于气候变化、环境污染等因素的影响,花生的虫害呈现出增长的趋势,而我国主要的害虫图像识别方法主要还是依靠传统识别方法,效率较低,因而将在人脸识别等领域较为先进的计算机图像识别技术引入农业领域迫在眉睫。

近年来,深度学习在图像识别领域发展迅猛,通过建立和模拟人脑的神经系统来解释图像中的各个特征数据,能够挖掘出图像中所需检测目标的深层次特征,这种数据特征对于识别目标的分类具有更好的表征能力,这样就避免了传统图像识别方法的缺陷,更精确地识别目标图像。因而本研究引入当前深度学习中的Faster-RCNN目标检测技术来进行花生害虫图像识别。

1 Faster-RCNN

Faster-R-CNN主要由2个部分组成,一是PRN候选框提取,二是Fast R-CNN检测。其中,RPN是全卷积神经网络,作用是提取目标区域候选建议框;Fast R-CNN基于RPN提取的建议区域检测并识别建议区域中的目标。Faster R-CNN采用通过RPN生成的区域,然后再接上Fast R-CNN形成了一个完全的首尾相连的卷积神经网络对象检测模型,RPN与后面的探测网络一起共享全图像卷积特征。

1.1 RPN候选框提取

为了生成建议区域,RPN在预训练的网络模型生成的特征图上滑动1个小网络,这个网络把特征图上的1个n×n窗口的特征作为输入,对于每个窗口,以窗口的中心点作为基准,通过不同的对象映射到原图从而得到一个个建议区域,之后通过对这些建议区域进行softmax分类与边框回归的学习,从而输出调优后的建议区域分数。

1.2 Fast R-CNN目标检测

在目标检测模块中,RPN和Fast R-CNN的特征通过13个卷积层形成共享,首先通过向CNN网络输入任意带下的图片,经过CNN网络前后传播至最后的共享卷积层,一方面得到由RPN网络输入的特征图片,另外一方面向前传播至特定的卷积层,产生更高维度的特征图。由RPN网络输入的特征图通过RPN网络得到区域建议和区域得分,并将其得分区域建议提供至RoI池化层,最后通过全连接层后,输出其该区域的得分以及回归后的边框回归。

2 试验样本集的生成和网络模型的对比

2.1 花生虫害图像获取

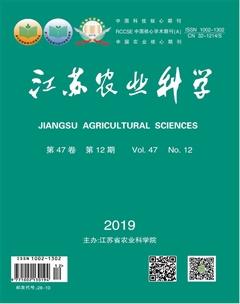

本研究通过查找农业虫害害虫数据库、实地拍摄、网络查找等方法采集花生主要害虫图片共计2 038张,分别为东亚飞蝗223张、蝼蛄229张、叶蝉223张、粉虱221张、金龟甲228张、蓟马224张、蚜虫220张、白色蛴螬225张、甜菜夜蛾245张,用于花生主要害虫图像识别的训练和测试。害虫图像如图1所示。

2.2 模型原理及对比

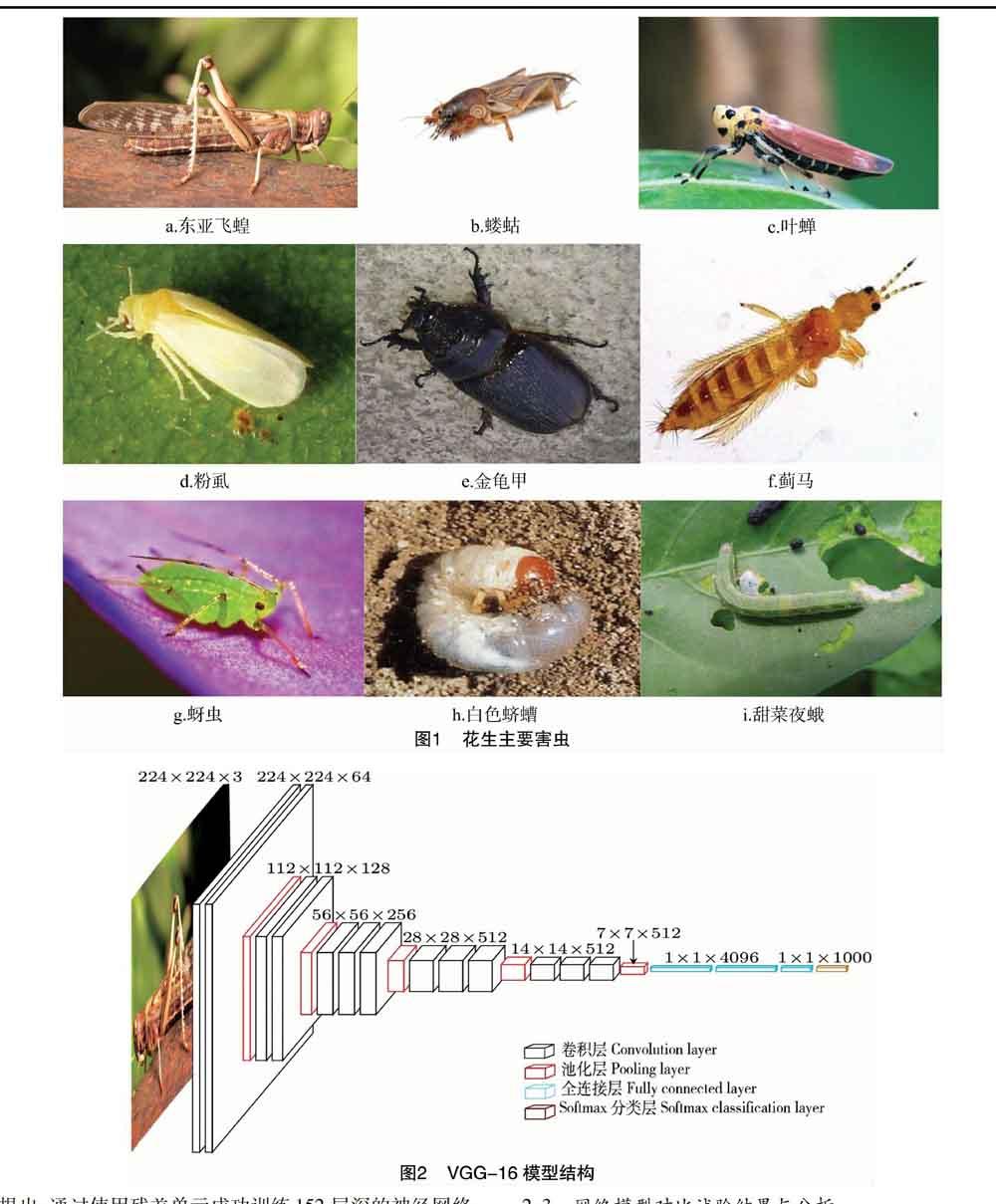

2.2.1 VGG-16 VGG(Visual Geometry Group)是2014年牛津大学科学工程系所创立的,该系发布了一系列以VGG开头的卷积网络模型,可以应用在人脸识别、图像分类等方面。VGG-16卷积网络全称为GG-Very-Deep-16 CNN,VGG在加深网络层数的同时为了避免参数过多,在所有层都采用3×3的小卷积核,卷积层步长被设置为1。VGG的输入被设置为224×244大小的RGB图像,在训练集图像上对所有图像计算RGB均值,将图像作为输入传入VGG卷积网络,使用3×3或者1×1的滤波器,卷积步长固定为1。卷积特征图针对所有的图片信息进行了编码,同时保持相对于原始图片所编码的位置信息不变(图2)。

2.2.2 ResNet-50 ResNet由微软研究院的何凯明等4名

华人提出,通过使用残差单元成功训练152层深的神经网络,在ILSVRC 2015比赛中获得了冠军,取得3.57%的top5错误率,同时参数量却比VGGNet低,效果非常突出[1]。ResNet-50的结构可以极快地加速超深神经网络的训练,模型的准确率也有非常大的提升。由图3、图4可知,ResNet-50是每隔2层或3层进行的相加求下一步的输入,这是与VGG-16网络不同的,VGG-16主要是直接进行卷积,送入到下一层,同时每一层的核大小都是固定的。ResNet-50里面也采用了每一层的核大小都是固定的原则,ResNet-50网络结构的设计遵循2种设计规则:一是对于相同的输出特征图尺寸,每一层具有相同数量的滤波器;二是如果特征图大小减半,则滤波器的数量加倍,以便保持每一层的时间复杂度[2]。

2.3 网络模型对比试验结果与分析

本研究通过对VGG-16网络模型和ResNet-50网络模型针对花生主要害蟲图像样本集识别率上的表现,选出合适的网络模型进行模型的参数优化。针对2个网络模型采用相同的配置对花生主要害虫图像的验证集进行识别,结果表明,ResNet-50网络模型针对本研究的花生主要害虫图像识别结果优于VGG-16网络模型(表1、表2),因此本研究将针对ResNet-50网络模型进行参数优化以提高识别精确度。

3 ResNet-50网络模型参数优化

3.1 学习率

在训练中,首先针对学习率进行修改,并针对不同学习率条件下的模型训练,通过进行学习率的修改,针对不同学习率下的ResNet-50模型进行识别结果的对比。针对相同环境下的ResNet-50模型进行学习率的调整,并分别对验证集和测试集进行识别结果的测试。验证集和测试集的识别结果(表3、表4)表明,当学习率为0.001 0时,害虫图像识别结果最优。

3.2 训练集、测试集以及验证集的比例选择

一般来说测试集和验证集各占总样本的5%~15%,因而本研究将对测试集和验证集各占总样本的5%、10%以及15%作为研究对象。在其他条件不变的前提下,设置学习率为0.001 0时,3种方式的平均识别率如表5所示。

由表5可知,当测试集和验证集所占总样本比例为10%时,害虫图片识别结果最优。

3.3 迭代次数

迭代次数的计算公式为:迭代次数=(图片数量×2×训练次数)/batch_size。为了研究识别精确度随着迭代次数逐渐增加的函数曲线图,本研究将训练次数作为更改对象,研究迭代次数对整体识别率的影响。在其他条件相同的情况下,训练次数与验证集和测试集图像识别率的关系分别如图5、图6所示。

由图5、图6可知,在不浪费训练资源的前提下,当训练次数为10时即迭代次数为37 060次,害虫图像识别精确度最高。

通过以上3个方面参数的调试,最终将ResNet-50模型的学习率改为0.001 0、测试集和样本集所占样本比例改为10%以及迭代次数改为37 060次。

3 結论

针对当前害虫图像样本数据库中样本较少的情况下,根据研究需求,通过网页收集、实地拍摄等方式收集了 2 038 张图片,并标记了其中1 853张图片,共涉及东亚飞蝗、蝼蛄、粉虱、金龟甲、蚜虫、甜菜夜蛾、蓟马、白色蛴螬、叶蝉9类害虫。

研究针对ResNet-50网络模型进行参数优化,针对优化参数后的ResNet-50网络模型进行识别,识别结果相对于ResNet-50网络模型在测试集和验证集中得到了明显的提升。结果表明使用优化参数之后的ResNet-50网络模型可以提升训练后的识别效果,该模型在花生害虫图像识别领域具有较高的识别水平,在农业害虫图像识别领域也具有一定的参考价值。

参考文献:

[1]齐 恒. 基于深度哈希学习算法的移动视觉检索系统设计与实现[D]. 北京:北京邮电大学,2018.

[2]梁晓旭. 基于卷积神经网络的遥感图像分类算法研究[D]. 西安:西安电子科技大学,2018.陆岱鹏,陶建平,王 珏,等. 基于Venturi效应的两相流雾化喷嘴设计与性能试验[J]. 江苏农业科学,2019,47(12):250-255.