基于深度自编码网络的舰船辐射噪声分类识别

严韶光,康春玉,夏志军,李昆鹏

(1. 海军大连舰艇学院 研究生队,辽宁 大连 116018;2. 海军大连舰艇学院 水武与防化系,辽宁 大连 116018)

0 引 言

水下被动目标的自动识别对于提高装备智能化程度有着重要意义,也是国内外水声领域的研究重点和难点。依靠舰船辐射噪声来解决目标分类识别问题是主要途径,近些年来陆续提出了一些新的解决方法,如提取连续谱特征,使用遗传算法改进的神经网络分类器完成目标分类识别[1];将免疫算法[2](Artificial immune algorithm,AIA)与支持向量机[3](Support vector machine,SVM)结合,不断选择适应度最高的SVM作为分类器[4];运用最小均方无失真响应(Minimu Variance Distortionless Response,MVDR)谱系数[5]作为特征参数,使用多分类支持向量机作为分类器等方法[6],但识别效果仍然有待提高。

2006 年,Hinton 提出的深度学习[7–9](Deep Learning,DL)直接掀起了人工智能又一轮研究热潮[10],且在语音识别[11–12]、图像识别[13–14]等模式识别领域取得了巨大的成功。但其在被动声呐目标识别这一模式识别领域的研究尚处于起步阶段。深度学习通过模拟人类大脑识别信息的过程,有意识的过滤无关信息,再从中逐层深入提取特征并据此完成分类识别。深度自编码器[15](Stacked Autoencoders,SAE)作为深度学习中的一种无监督学习网络,相比较线性的分类识别方法,SAE中的各层自编码器进行编码和解码的训练采用了非线性激活函数,它能够提取更充分的特征用于分类识别。相对于浅层神经网络而言,SAE能提取输入数据中最具代表性的深层特征来高效地完成目标的分类识别[16]。

本文在提取舰船辐射噪声Welch功率谱特征的基础上,提出了基于SAE的目标分类识别方法。首先通过深度自编码网络获得深层特征,然后在输出层使用softmax函对深层特征进行分类识别。并与文献[17]中搭建的BP神经网络(NN)分类器进行性能对比,通过对比实验结果证明了SAE分类器的优越性。

1 深度自编码网络

1.1 自编码器

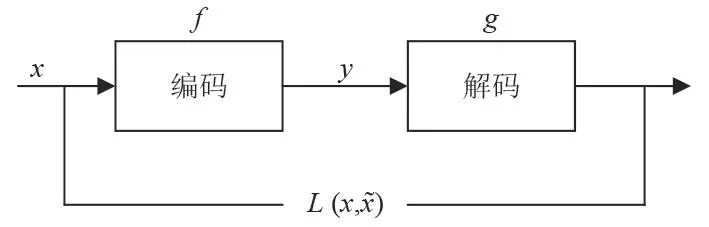

深度自编码网络的结构基础是自编码器(Autoencoder,AE)。每个AE包含输入层、隐含层、输出层,由输入层向前传播到隐含层的过程成为编码,由隐含层向前传播到输出层的过程成为解码,如图1所示。

图 1 自编码器Fig. 1 Autoencoder

AE权重的更新可采用随机梯度下降算法,权值更新公式如下式:

1.2 深度自编码

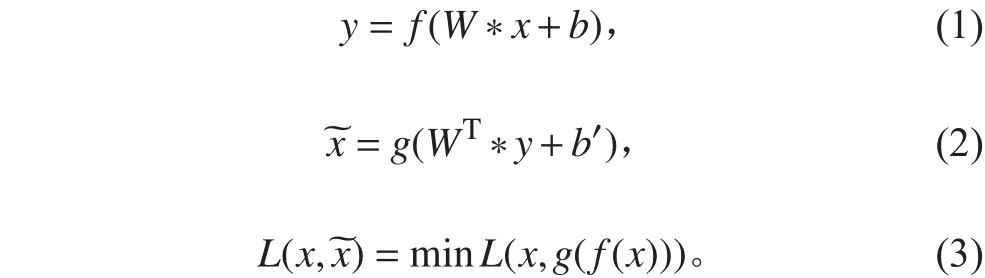

为了获取输入的深层低维特征,基于上述AE,采用堆栈的方式来构建深度自编码网络[18]。首先,按照AE的训练方式,使用输入层训练第1个隐含层的参数和,见图2,训练完成后只保留的编码阶段。

图 2 训练第1个隐含层Fig. 2 Training the first hidden laye

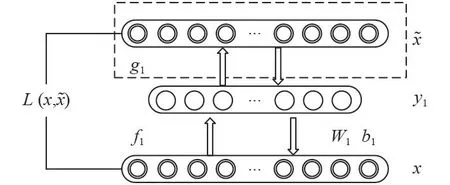

图 3 训练第2个隐含层Fig. 3 Training the second hidden layer

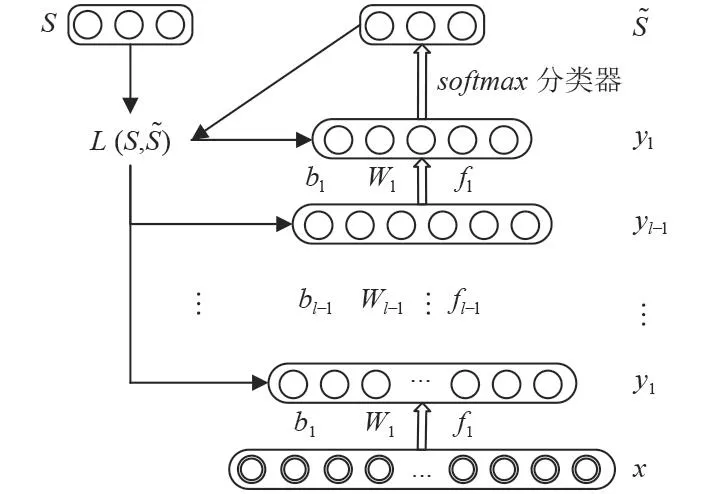

这样每一隐含层都可以充分的包含原始信号的信息[14],通过这种“堆栈”方式完成逐层非监督预训练就构建了深度自编码网络[19]。整个SAE训练完成后,接入softmax分类器完成分类任务,如图4所示。

图 4 SAE结构图Fig. 4 The System structure diagram of SAE

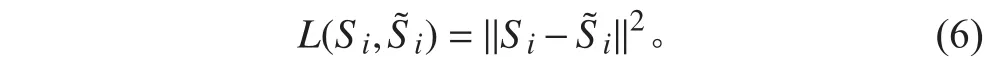

但由深度自编码训练好的权重直接堆叠构成的网络较为粗糙,需要使用有监督的方法对权重等参数进行微调,从而加强整体层级之间连接的紧密性以及反馈调节的连续性,保证网络处于最优状态,所以将输出分类结果和目标类别标记进行对比,利用反向传播算法对全局参数进行有监督调试。对所有输入样本个数求平均错误得到损失函数,如下式:

在后续分析中,损失函数选择经典平方损失函数

2 舰船辐射噪声分类识别

2.1 分类识别系统框架

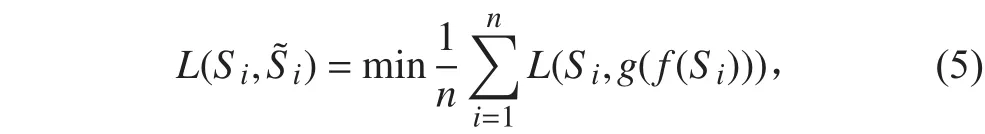

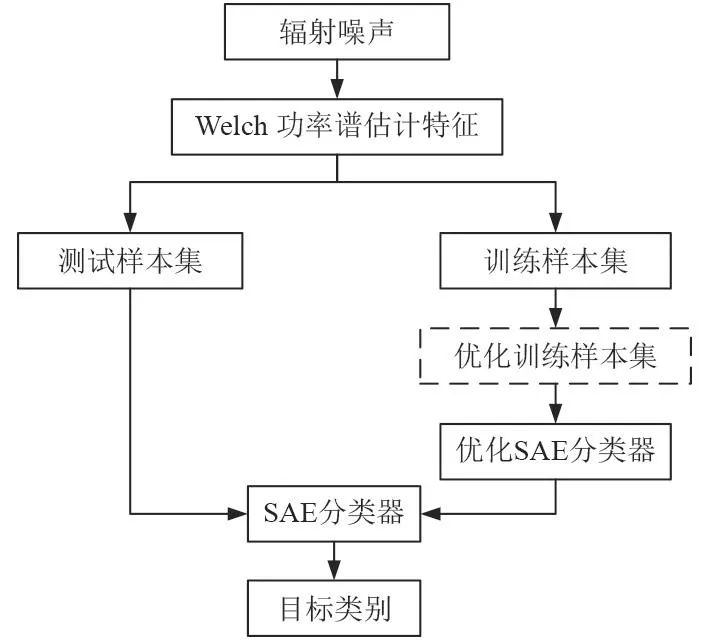

本文提出如图5所示的基于SAE的舰船辐射噪声分类识别框架。首先使用Welch功率谱估计方法对经过预处理的舰船辐射噪声信号提取功率谱特征,然后进行归一化得到样本特征库。将样本特征库分为训练样本集和测试样本集,并对训练样本集进行优化处理,得到新的训练样本集。使用新的训练样本集构建和优化SAE分类器,搭建好SAE分类器后,用测试样本对SAE分类器的效果进行检验。

2.2 训练样本集和测试样本集

图 5 基于SAE的舰船辐射噪声分类识别框架Fig. 5 The classification and recognition framework of ship radiant noise based on SAE

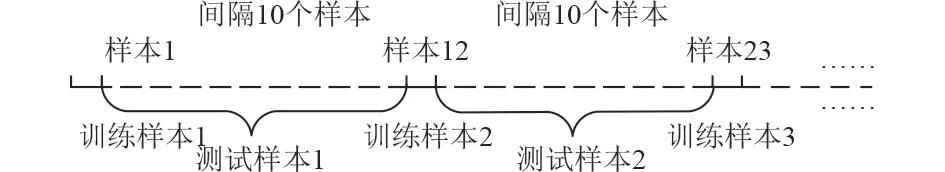

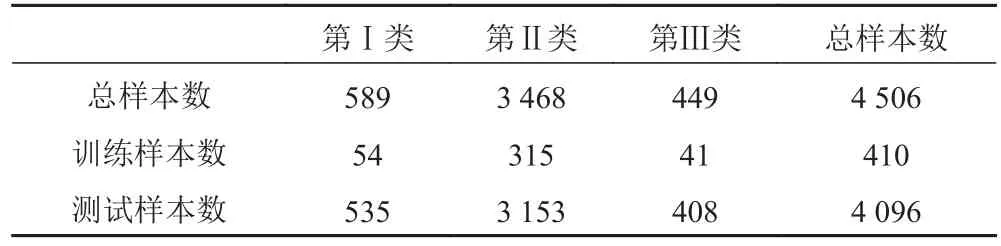

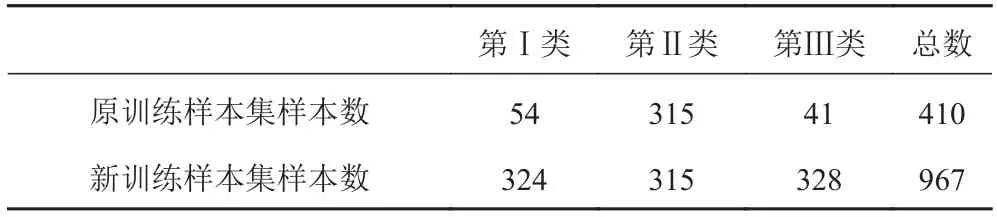

全部辐射噪声样本是在不同工况和水文气象条件下,实际录制的3类海上目标(分别用Ⅰ,Ⅱ和Ⅲ表示)的舰船辐射噪声。采样频率25 kHz,每个样本长度为6.553 6 s。对所有的4 506个样本集(共146艘不同工况舰船)采用文献[20]的方法估计得到513维的Welch谱特征向量。并将整个样本集分为训练样本集和测试样本集,其中训练样本和测试样本的选取方法如图6所示,相当于每间隔65.536 s选取一个样本进行训练,然后取这2个训练样本的中间样本作为测试样本。由此得到训练样本集和测试样本集各类样本数量如表1所示。

图 6 训练样本集和测试样本集选取方法Fig. 6 The selection method of training sample set and test sample set

表 1 训练样本集和测试样本集各类样本数量Tab. 1 The number of different training sample sets and test sample sets

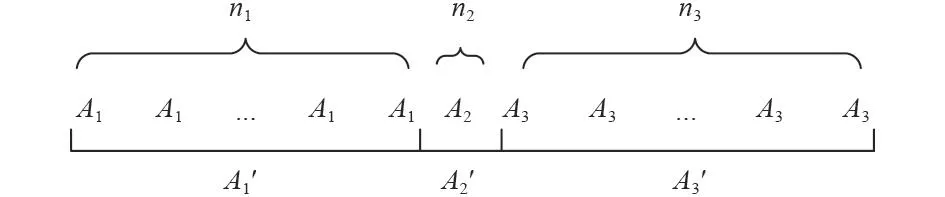

可以看出,原始训练样本集中各类样本在数量上存在较大差异。其中第Ⅱ类的样本数量最多,意味着原始训练集中第Ⅱ类样本不仅在数量上占有优势性而且更具有多样性。因此原始训练集训练下的SAE分类器对于第Ⅱ类样本会得到最充分的训练,因而在目标分类识别时会集中识别第Ⅱ类样本[21]。针对这种情况,本文提出一种顺次重复处于劣势样本的优化方法,即增加第Ⅰ类和第Ⅲ类样本数量,使每类样本数量基本处于均衡状态。具体步骤如下:

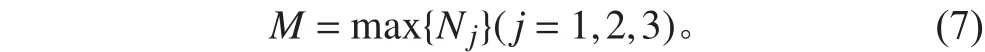

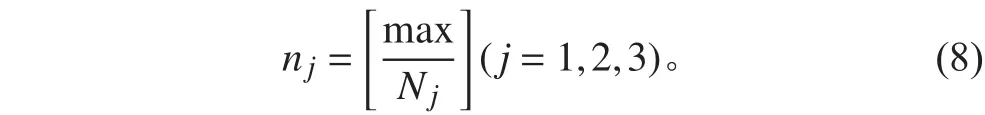

步骤1 根据训练样本集中每类样本的总数,得到训练样本数量最多一类的样本个数,如式(7)所示,其中表示原始训练样本集中第类样本的个数,表示训练样本中数量最多的一类样本的个数,即第Ⅱ类样本的个数。

步骤3 根据步骤2获得的重复次数对原始训练集中各类样本进行重复。如图7所示,原始训练样本集的三类样本和重复后获得的新训练样本集中的三类样本,分别用和表示。

图 7 新训练样本集Fig. 7 The new training sample set

通过上述步骤对训练样本集进行优化处理后,训练样本集中各类样本数量如表2所示。

表 2 训练样本集中各类样本数量Tab. 2 The number of samples in the training sample

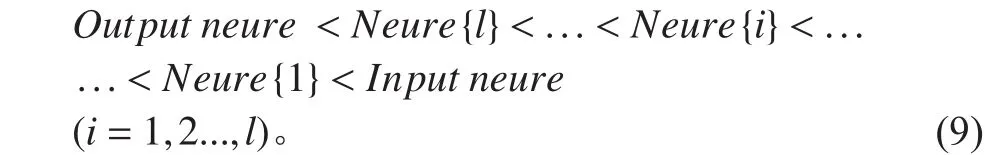

2.3 SAE网络结构

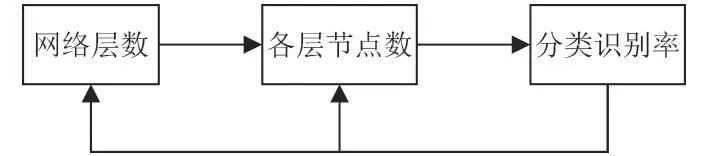

为了从输入的Welch功率谱特征中获取深层次的特征来提高SAE分类器的分类识别能力,要求自编码网络捕捉训练数据中最显著的深层特征,本文SAE分类器的各层自编码器均采用欠完备的自编码器,得到SAE分类器中各层节点数目之间的逻辑关系如式(9),其中表示隐含层第层的节点数目,表示输入节点数,表示输出节点数。

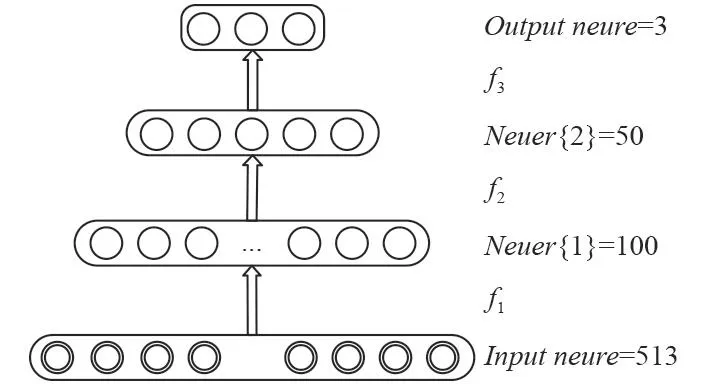

具体SAE网络结构设置如图8所示,以目标分类识别准确率为标准,设置恰当的网络深度保证网络获取的深度特征不会因为过于抽象而无法识别,也不会因为提取的不够深而得不到有效的深层特征。调整各层节点数,使该层节点输出的深层特征具有维度低和有效性强的特点。

最终设置的网络结构为4层,隐含层数为2层,具体各节点数如图9所示。

图 8 网络层数和各层节点数设置Fig. 8 The number of network layer number and nodes in each layer

图 9 SAE网络结构Fig. 9 The structure diagram of SAE

2.3.1 激活函数选择

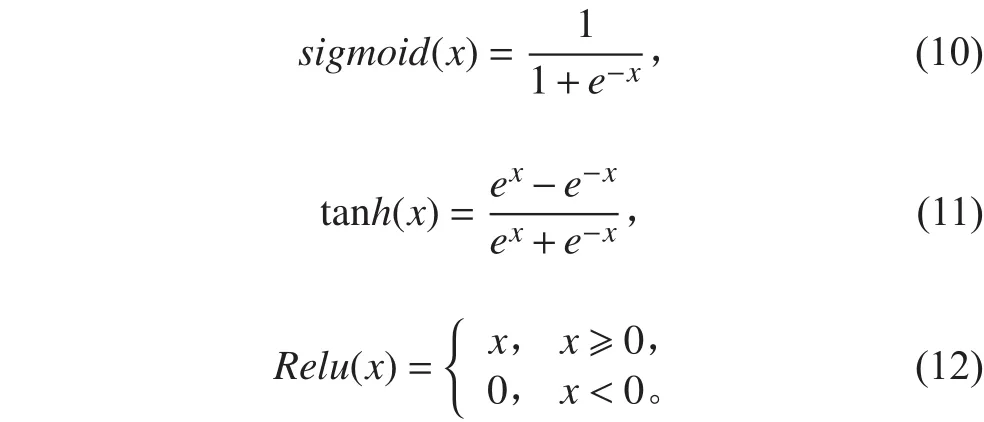

将上述激活函数分别作为2个隐含层自编码器的激活函数,通过对比SAE分类器的识别效果来选择最合适的激活函数组合。

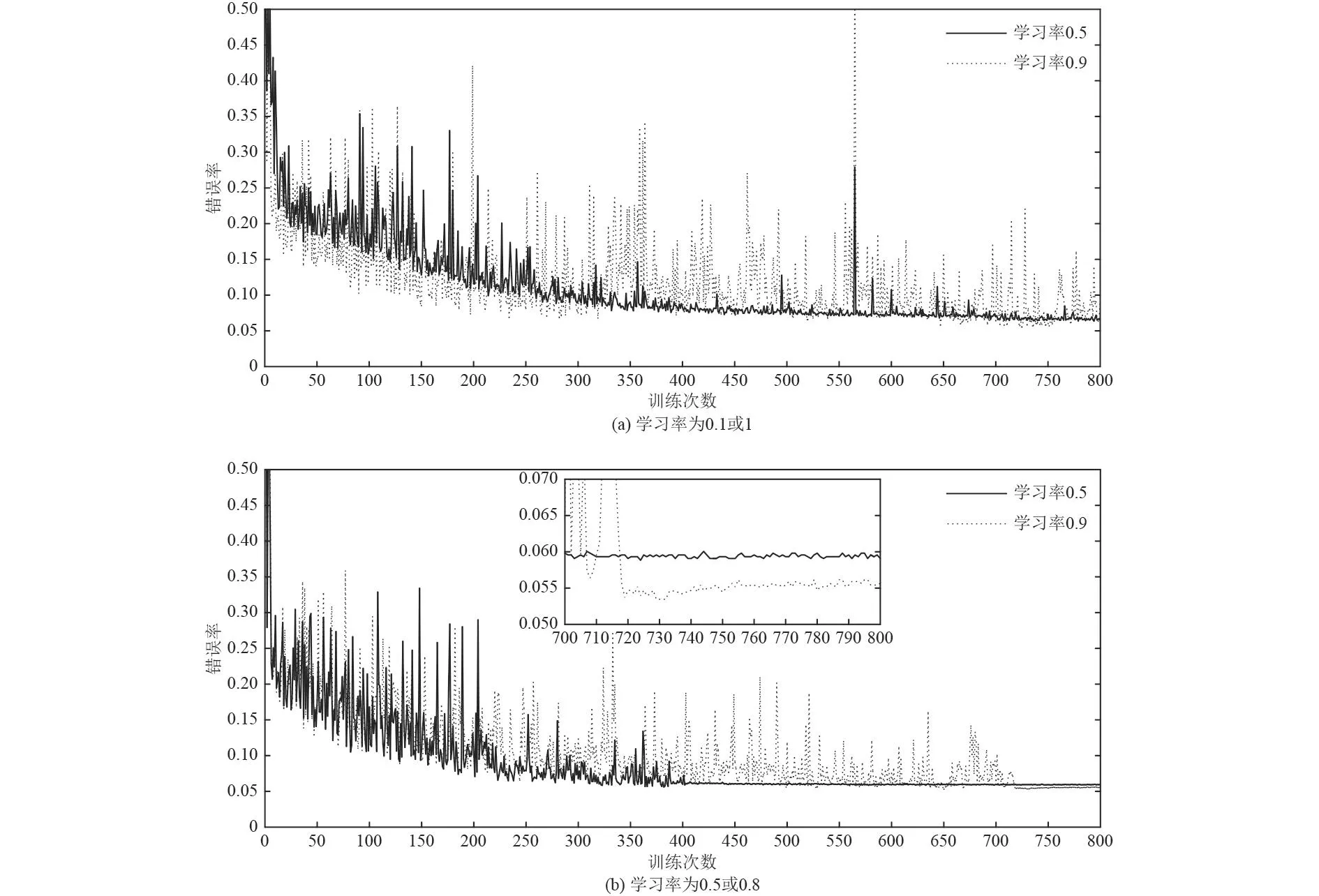

SAE分类器的识别效果如表3所示,fj为第 i层激活函数,Rj为第类目标识别精度,为总体识别精度。通过表3对比可知,当第1层和第2层激活函数均为sigmoid时,SAE分类器分类识别效果最好,故选择sigmoid作为第1层和第2层的激活函数,选择softmax作为输出层的激活函数完成分类。

表 3 不同激活函数组合下SAE分类器的正确分类识别概率Tab. 3 Correct classification and recognition probability of SAE classifier with different activation functions

2.3.2 学习率和训练次数的选择

在上述SAE分类器设计的基础上,进一步对影响网络效率的参数——学习率和训练次数进行选择。因为采用随机梯度下降算法对SAE的权重进行更新,结合权值更新式(4),可知在每次训练中权值更新的梯度都在下降以便更有效的逼近最优值,所以SAE分类器的分类识别效果在训练次数和学习率共同作用下才能够达到较好效果。

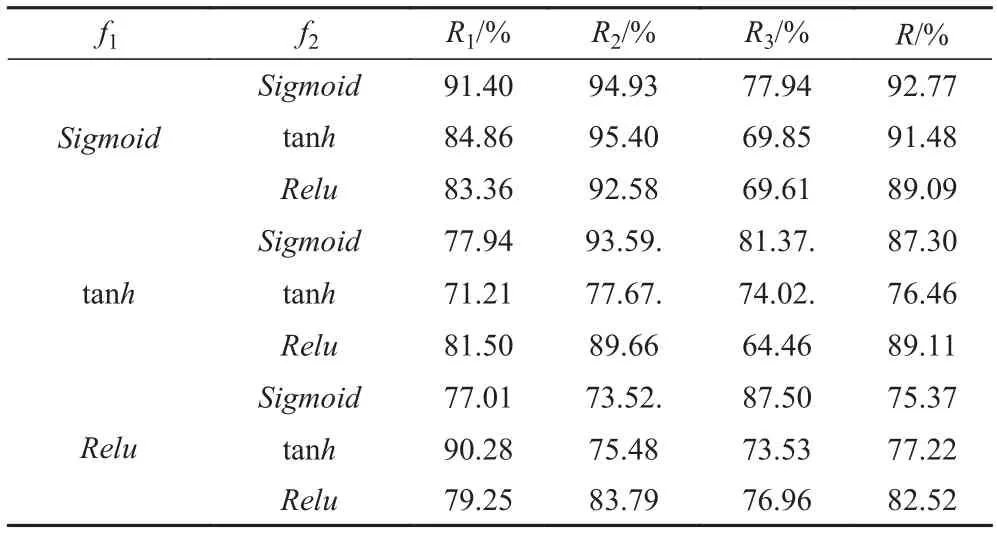

学习率的经验值区间一般为0~1,分别选择0.1,0.5,0.9,1作为学习率代表,得到训练次数和错误的下降曲线,如图10所示。

可以看出,在采用梯度下降算法更新权重时,学习率较大则每次下降的步长越大,能够在较少的训练次数下快速逼近最优值,但可能存在由于步长过长使权重值在最优值点附近徘徊,无法接近最优值点;选择的学习率过小时,虽然能够接近最优值,但需要很多次训练,权重逼近最优值点的速度慢,同时可能会出现过拟合的现象。因此,需要选择恰当的学习率才能在尽可能少的训练次数下,实现在耗时较短的前提下获得较好的权重值。

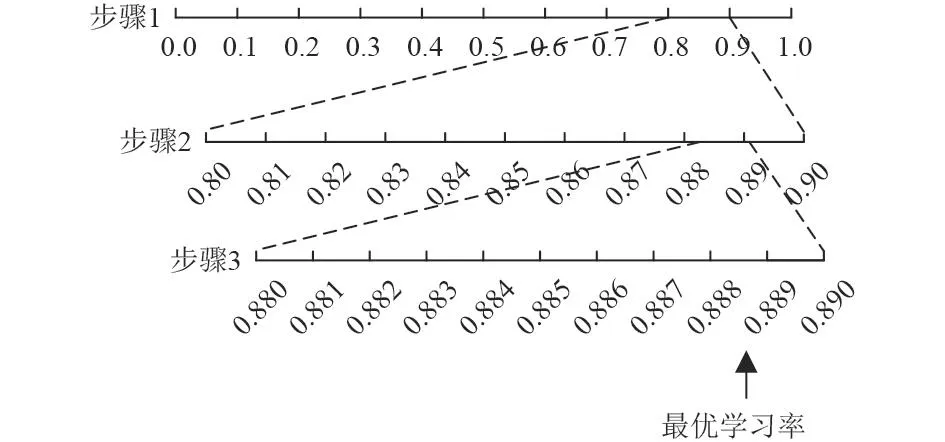

根据上述分析,以错误率收敛为准则,按如图11所示流程对SAE分类器的训练次数和学习率进行选择,具体步骤如下:

步骤1 将学习率经验区间0~1划分为10份区间间隔0.1,结合各点错误率曲线初步筛选区间为0.8~0.9;

步骤2 在初步筛选区间0.8~0.9基础上,按照0.01间隔长度将0.8~0.9划分为10份,再次结合各点错误率曲线进行选择,进一步确定区间为0.88~0.89;

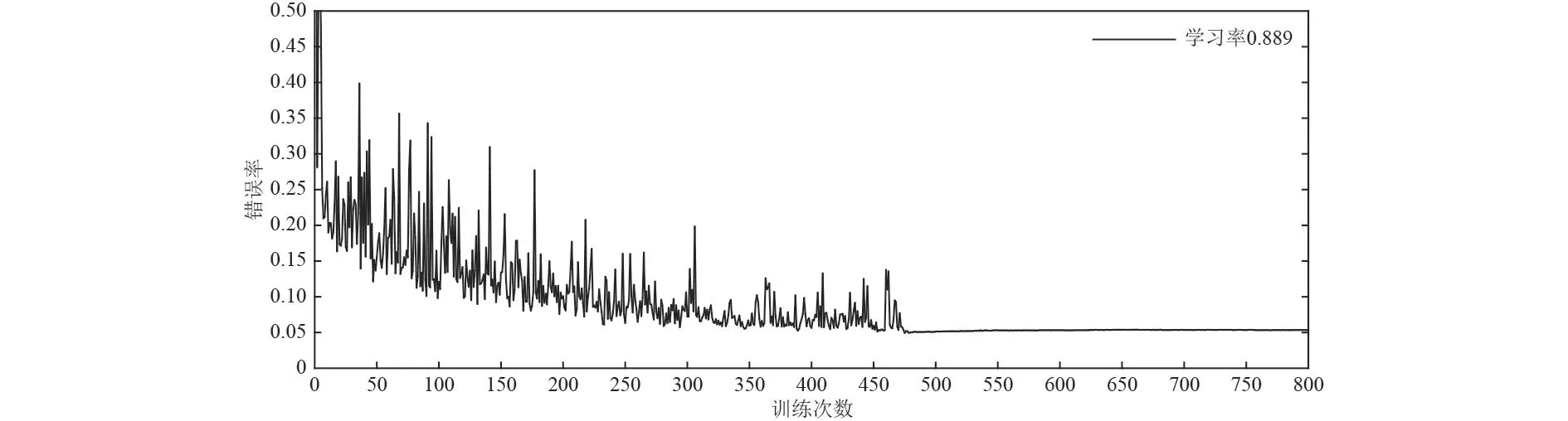

步骤3 在0.88~0.89区间内按照0.001间隔将0.88~0.89划分为10份再次细化学习率,最终确定学习率为0.889,得到图12学习率0.889时训练次数和错误率下降曲线。

图 10 不同学习率下训练次数与错误率关系Fig. 10 The relationship between the number of training and the error rate under different learning rates

图 11 学习率选择流程Fig. 11 Learning rate selection process

在如图12所示学习率为0.889的错误率曲线中可得训练次数在470~480之间已经达到稳定状态,为提高SAE分类器的实效性,在470~480之间经过对比最终选取的训练次数为475。

3 分类识别实验及分析

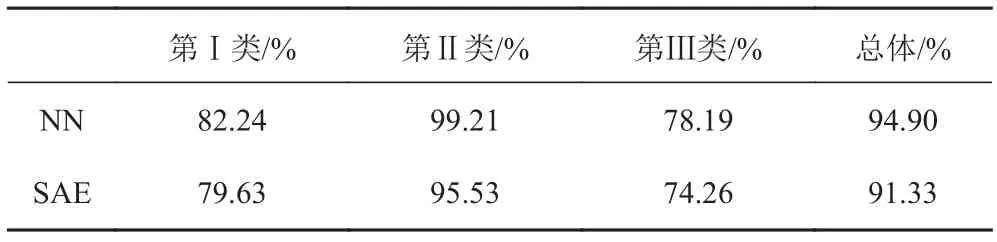

使用原始训练样本集分别对构建好的SAE分类器和NN分类器进行训练,SAE和NN的参数设置训练完成后使用测试样本集对进行测试,得到如表4所示的正确分类识别概率。

分析可知,在三类训练样本数目不均匀的条件下,由于第Ⅱ类样本数目最多,更具有多样性,分类器对于第Ⅱ类样本能够提取更为丰富的特征,强化分类器对第Ⅱ类目标的分类识别能力,使分类器权值偏向第Ⅱ类目标。相比之下,第Ⅰ类和第Ⅲ类样本样本数目较少使得这两类样本的特征提取的不够全面,导致分类器对这两类目标的分类识别能力得不到充分训练,识别率较低。

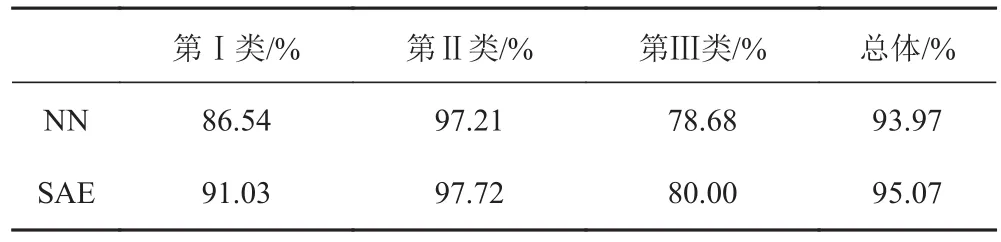

使用新训练样本集训练再次训练SAE分类器与NN分类器,然后使用同一测试样本集对分类器的分类识别能力进行测试,得到表5所示2种网络分类器的正确分类识别概率。

NN属于浅层网络,不具备提取数据深层特征的能力。NN分类器只能根据输入的Welch谱特征向量进行分类识别,其分类效果受样本数量和样本多样性影响。对于同一类样本而言,数量越多、多样性越强、识别效果就越好。对比表4和表5可以看出,新训练样本集增加了样本数量,但没有增加样本的多样性,因而NN分类器的分类识别能力没有得到改善。

SAE属于深度学习网络模型,能够提取深层特征,同时SAE的结构还能抑制过拟合。SAE分类器通过对Welch谱特征向量进行深层特征挖掘,找到样本之间的本质区别,用来对目标进行高效准确地分类识别。结合表1和表4分析可以看出,原始训练样本集中3类目标数量差距较大、SAE分类器稀疏性强,所以在运用原始训练集训练SAE分类器时,提取的深层特征不全面,导致SAE分类器分类识别不准确。从表2和表5分析得到,新训练样本集中增加了第Ⅰ类样本和第Ⅲ类样本的数量,从而解决了由于这两类样本数量太少导致的深层特征提取不全面的问题,并且SAE分类器的稀疏度能够有效抑制NN分类器中出现的过拟合现象。从表5可以看出,通过新训练样本集的训练,SAE分类器对第Ⅰ类样本和第Ⅲ类样本的分类识别能力得到了明显提升,改善了SAE分类器的整体分类识别能力。

图 12 学习率为0.889时训练次数与错误率关系Fig. 12 The relationship between the number of training and the error rate when the learning rate is 0.889

表 4 2种分类器在原始训练样本集训练下的正确分类识别概率Tab. 4 The correct classification probability of two classifiers under the training of the original training sample set

表 5 2种分类器在新训练样本集训练下的正确分类识别概率Tab. 5 The correct classification probability of two classifiers under the training of new training sample set

4 结 语

深度学习多层非线性的特点,使它能够通过简洁的参数学习来表达复杂数据之间的关系。欠完备AE本身具有很好的特征提取能力,能够提取样本低维度的重要特征。AE堆叠而成的SAE发挥了这种优势,在降低数据维度的同时能够充分挖掘数据的深层特征,更好地完成对舰船辐射噪声的分类识别。并且简单的数据重复与SAE分类器自身的稀疏能力相配合,能够在提高各类目标的分类识别率的同时防止过拟合现象的出现,SAE分类器在实际应用中与传统浅层神经网络相比具有很强的优越性。同时,该分类网络也可推广应用于舰船其他特征下的分类识别。