人工智能开源平台发展态势研究

陈 丝 中国信息通信研究院信息化与工业化融合研究所助理工程师

1 引言

近年来,人工智能成为全球信息领域产业竞争的新一轮焦点,对促进技术进步、推动产业升级、实现社会发展的重要性愈发显现。从产业角度讲,开源平台占据人工智能产业生态的核心地位,具有统领产业进步节奏、带动终端场景与云端服务协同发展的重要作用,处于承上启下的关键地位,其意义媲美移动互联网操作系统。我国应密切关注开源平台发展,促进开源平台与产业布局的双重提升,构筑我国人工智能发展的先发优势。

2 产业总体发展态势

2.1 发展历程

(1)2016年人工智能产业爆发——“发展元年”

人工智能历经3次发展浪潮,目前正在进入第四次浪潮。

第一次浪潮是在20世纪50年代,即计算智能时代,以1956年达特茅斯会议首次提出人工智能概念为标志,该阶段重视逻辑忽略知识。由于机器翻译的失败,人工智能跌入低谷。

第二次浪潮发生在20世纪70年代,即感知智能时代,以1965年第一个专家系统诞生为标志,该阶段重视知识,但学习能力不足。由于专家系统应用效果不佳,人工智能再次陷入低谷。

第三次浪潮发生在20世纪80年代,即认知智能时代,以1986年BP神经网络算法提出为标志,具备自主学习能力。但由于计算能力不足,人工智能又陷入低谷。

当前,人工智能进入第四次浪潮,以2006年Hitton提出深度学习理论为标志。2016年3月,A lphaGo以4:1战胜世界传奇选手李世石九段,人工智能在围棋领域的水平超过人类,该事件成为人工智能应用的里程碑事件。互联网、云计算、大数据等技术的发展,GPU、芯片、软件计算能力的提升,深度学习算法的不断进步和资本的大批进入,都促进了人工智能进一步发展,但整体来看人工智能技术仍处在较为初级的发展阶段。

(2)2017年开源平台成为人工智能产业的战略制高点

2017年,人工智能产业快速发展,芯片、数据、开源平台、算法、应用是人工智能产业生态的五大关键要素。从产业角度讲,开源平台更是产业要素重中之重。开源开放平台能够提供人工智能基础算法的底层架构和接口,具有统领产业进步节奏、带动终端场景与云端服务协同发展的核心作用,占据承上启下的关键地位,具有媲美移动互联网操作系统的意义。在移动互联网时代,Android系统通过GMS与下游云服务松耦合,通过版本控制与上游芯片、整机厂商紧耦合,实现以Android系统为核心的移动互联网闭环。以Google开源平台TensorFlow为例,其与机器学习算法紧密相关,体现出平台能力和应用性能,TensorFlow向上与谷歌云紧密绑定,以云平台模式提供云机器学习服务,向下与芯片和硬件厂商紧密耦合做定制优化,谷歌TPU专用于TensorFlow。

2.2 全球发展态势

(1)国际巨头企业竞相布局人工智能开源平台,意图占领产业制高点

人工智能国际企业均在开源其人工智能平台,意图加快掌握技术产业组织的主动权,占领客户、应用和数据资源,逐步建立新的产业格局和技术标准。

2015年11月9日,Google发布深度学习框架TensorFlow并宣布开源,迅速得到广泛关注,在图形分类、音频处理、推荐系统和自然语言处理等场景下都被大面积推广,由于开源算法和模型最丰富,吸引了ARM、京东等大批合作伙伴,是GitHub最受欢迎的机器学习开源项目。2015年5月,Facebook正式宣布开源深度学习框架Caffe,Caffe是一种经典的图形领域框架,使用简单,也是第一个主流工业级深度学习工具。2016年1月25日,微软开源其深度学习与人工智能领域研究成果 Computational Network Toolkit(CNTK),CNTK在语音和图像辨识能力方面,比Google的Tensor等4个开发者常用的Toolkit有更快的运算速度,支持自动调参功能,应用在Skype、微软小冰、必应搜索、Xbox商用开发等场景。2015年9月,亚马逊开放了深度学习框架MXNet,其具有优异分布式计算性能,拥有卡耐基梅隆、英特尔、英伟达等众多合作伙伴,国内图森互联和地平线等公司也有使用。2015年11月,IBM宣布开源机器学习平台SystemML。它是一种灵活的可伸缩机器学习(ML)语言,可根据数据和集群特性使用基于规则和成本的优化技术动态地编译和优化,应用在不同工业领域。2016年9月,百度开源其深度学习平台Paddle,可提供机器视觉、自然语言理解、搜索引擎排序、推荐系统等功能。2017年6月,腾讯和北京大学、香港科技大学联合开发的高性能分布式计算平台 Angel正式开源,具有较强的容错设计和稳定性。众多开源学习框架促进人工智能应用程序发展。据IDC预测,到2020年,60%的人工智能应用程序将在开源平台上运行。

(2)谷歌开源平台TensorFlow占据优势领先地位

无论是从关注度、下载量、贡献者数量以及发布版本数量来看,谷歌开源平台TensorFlow都占据优势领先地位。根据Github开源框架热度(截至2017年11月10日)统计,TensorFlow关注度接近8万次,下载量接近4万次,成为最受欢迎的深度学习平台,Caffe、CNTK、MXNet等关注度远低于TensorFlow。根据Github开源框架贡献者、Releases数量(截至2017年11月10日)统计,TensorFlow贡献者数量达到1128人次,吸引了最广泛的人工智能开发者,说明其生态活跃、成长性极强。从发布版本数量看,其数量为42次,证明谷歌因严谨的审核机制和发布要求具备较强的实用性能。

(2)企业以平台为核心呈现多元化发展模式

企业以平台为核心呈现上升、拓展、下沉、打通4种发展模式。纵向打通模式,从硬件到开源平台,再到云平台至应用服务,贯通产业链上下游,构建全产业生态,谷歌为其典型代表;向上抢占行业应用服务模式,以业务为导向,通过核心平台向上抢占重点行业应用,如亚马逊、阿里等;算法下沉于硬件模式,核心算法固化于硬件,以硬件形态提供行业通用或专用计算能力,如寒武纪;拓展基础能力,以核心平台开放基础能力,为行业提供基础能力,如讯飞为行业提供基础语音识别基础技术、商汤为行业提供人脸识别基础技术等。在4种发展模式中,云平台和应用服务产生的所有数据均回流于训练平台进行数据反哺,可有效提升平台的综合能力。

3 核心关键技术

3.1 开源平台核心架构实现从设备层到工作层的一体化设计

以TensorFlow架构为例,从底向上分为设备管理和通信层、数据操作层、图计算层、API接口层、工作层和视图层。其中,设备管理和通信层、数据操作层、图计算层是核心层;底层设备通信层直接面向硬件,负责网络通信和设备管理,设备管理可以实现TF设备异构的特性,支持CPU、GPU、Mobile等不同设备,网络通信依赖gRPC通信协议实现不同设备间的数据传输和更新;数据操作层决定算法逻辑的完备性,图计算层体现算法设计的集团流程,接口层实现功能模块的接口封装,工作层直接面向开发者;视图层是TensorFlow特有的,可实现计算流图可视化。

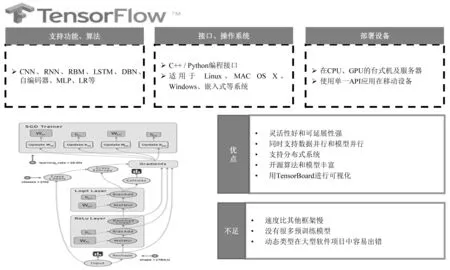

3.2 TensorFlow:机器学习框架,算法与模型丰富,适用大规模多应用部署

TensorFlow是谷歌研发的第二代人工智能学习系统。第一代人工智能学习系统DistBelief诞生于2011年,之后谷歌对DistBelief进行了各方面的改进,在此基础上研发出TensorFlow。Tensor(张量)意味着N维数组,Flow(流)意味着基于数据流图的计算,TensorFlow为张量从图像的一端流动到另一端的计算过程。TensorFlow是将复杂的数据结构传输至人工智能神经网中进行分析和处理过程的系统。TensorFlow可被用于语音识别或图像识别等多项机器深度学习领域。TensorFlow在GitHub上开源,任何人都可以用。谷歌的产品均基于TensorFlow开发,如AlphaGo(见图1)。

图1 TensorFlow

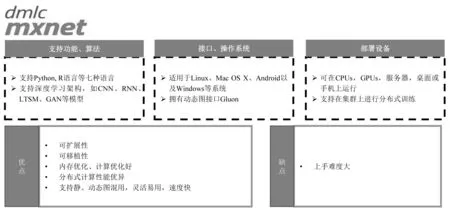

3.3 MXNet:深度学习开发框架,亚马逊基于此建立生态

MXNet是机器学习社区(DMLC)发布的深度学习框架。编程方式采用混合符号编程和命令式编程,从而最大限度提高效率和生产力,其核心是动态的依赖调度,能够自动并行符号和命令的操作。图形优化层,使得符号执行速度快,内存使用高效。MXNet便携、轻量,而且能够扩展到多个GPU和多台机器。MXNet结构从上到下分别为各种主语言的嵌入、编程接口(矩阵运算、符号表达式、分布式通讯)、两种编程模式的统一系统实现以及各硬件的支持(见图2)。

3.4 Caffe:第一个主流工业级深度学习工具,图形领域的经典框架

Caffe深度学习框架结构清晰、执行速度快,由加利福尼亚大学伯克利分校博士生贾扬清开发,后转交给加利福尼亚大学伯克利视觉与学习中心(BVLC)维护。Caffe支持视觉领域的算法框架,可移植性好,Intel针对Caffe做了定制优化,整合了Intel的MKL,支持 Intel Xeon(见图3)。

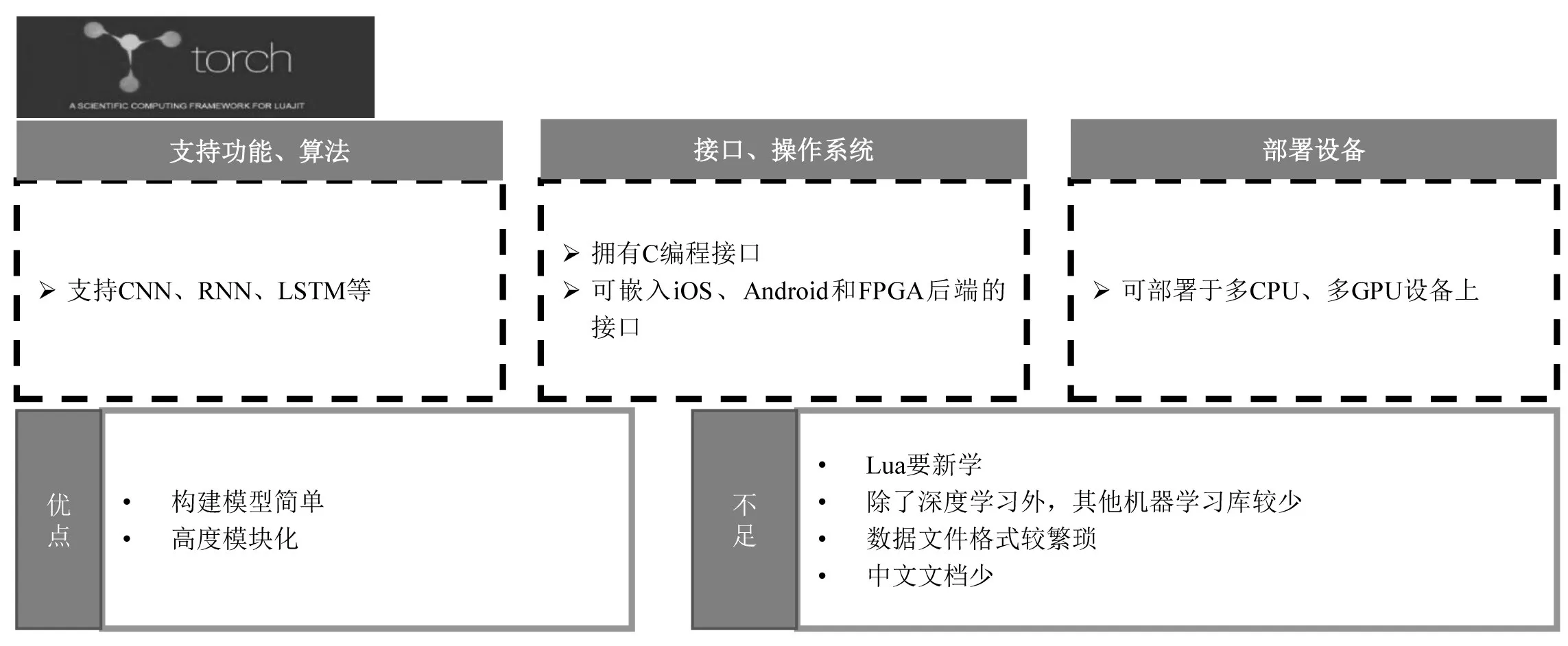

3.5 Torch:机器学习开发框架,网络结构设计灵活,适合学术研究用

Torch由Facebook人工智能研究院(FAIR)于2015年1月发布,其开源的内容包括Fbcunn、ConvNets等,Fbcunn用于对图像识别、自然语言处理以及其它大规模深度学习系统的深度学习加速环节,ConvNets是基于FFT的快速卷积层,采用基于NVIDIA的cuFFT库构建的自定义CUDA内核。此外,还包括许多其它基于CUDA的模块和容器(Container)(见图4)。

3.6 开源平台呈现集大成趋势

开源平台呈现集大成趋势,通用算法、典型算法均可支持,对通用CPU、GPU等部署环境大多支持。总体来说呈现3种趋势:一是命令式和符号式编程相结合,即结构灵活调试方便,节省内存,提高运行时间;二是云侧和端侧协同共生,大多数框架支持云侧部署,端侧部署是发展热点,同时支持训练和推理;三是支持多元化算法,支持多种算法逻辑,更新迭代及时,能够支持最新的算法和硬件。

4 我国发展态势

4.1 我国发展策略从引导到推动,打造人工智能开放协同生态

(1)国家层面

2017年7月,国务院发布《新一代人工智能发展规划》,明确指出要统筹布局人工智能创新平台,强化对人工智能研发应用的基础支撑,形成促进人工智能软件、硬件和智能云之间相互协同的生态链。规划强调按照“构建一个体系、把握双重属性、坚持三位一体、强化四大支撑”进行布局,其中“一个体系”指构建开放协同的人工智能科技创新体系,“双重属性”指把握人工智能技术属性和社会属性高度融合的特征,“三位一体”指坚持人工智能研发攻关、产品应用和产业培育推进,“四大支撑”指全面支撑科技、经济、社会发展和国家安全。规划从顶层设计为我国人工智能技术和产业发展指明了方向。

图2 MXNet

图3 Caffe

图4 Torch

(2)部委层面

发改委人工智能创新发展重大工程中提出面向深度学习应用的开源平台建设及应用。科技部人工智能重大项目中提出开展国家人工智能开源开放创新平台建设,依托BAT和科大讯飞开展第一批试点。工信部《促进新一代人工智能产业发展三年行动计划(2018—2020年)》中也提出支持开源开放平台建设。这些项目及计划与国家《新一代人工智能发展规划》一脉相承,同时从具体领域细化了发展目标,更具有可操作性。

4.2 我国企业积极布局,上升、拓展、下沉模式并存,打通模式尚未形成

在企业层面,BAT和科大讯飞等企业加紧布局。例如,百度建设自动驾驶国家新一代人工智能开放创新平台,无人驾驶小巴将于2018年量产;阿里云建设城市大脑国家新一代人工智能开放创新平台,在杭州等城市开展城市大脑建设;腾讯建设医疗影像国家新一代人工智能开放创新平台,旗下首款人工智能医疗产品“腾讯觅影”于2017年11月全面落地河北省;科大讯飞建设智能语音国家新一代人工智能开放创新平台,产品切入教育、安防等领域。总之,企业通过建设开源创新平台增强技术实力和产业竞争力,是产业生态不可或缺的环节。

上升、拓展、下沉模式是我国企业主要模式,打通模式有待形成。上升模式,以大型互联网企业为主,提供云服务和行业级、消费级产品,如百度、阿里、腾讯等;拓展模式,以算法类公司和由算法进入垂直行业的应用公司为主,提供云服务和行业产品,如讯飞、商汤、旷视、云从、思必驰等;下沉模式,以初创芯片公司为主,凭借技术领先与芯片巨头错位发展,需与应用厂商密切绑定,如寒武纪、地平线、深鉴科技等。

5 结束语

发展开源平台至关重要,笔者从政策推动、核心突破、产业发展、生态建设4个方面提出建议:

(1)在国家政策方面分析,要聚焦开源平台建设重点,统筹专项;引进消化再吸收,鼓励企业加大研发;发挥基金撬动作用,鼓励社会资本加入。

(2)在核心突破方面,加大对机器学习核心理论的研究探索,加强对有监督学习、弱/无监督学习理论的突破,加大对量子、类脑等前沿技术的布局。

(3)在产业发展方面,要鼓励大型互联网企业发展自主开源平台,鼓励初创企业发展垂直领域专用平台,在联盟内开展有关开源平台的推介和支持。

(4)在生态建设方面,加强产业链上下游协同,注重产学研联动,加速基于平台的成果转化,积极吸取开源经验,加大运维投入。