基于神经网络算法的大数据分析方法研究

周林腾

(山东科技大学山东青岛266590)

大数据蕴含着庞大的社会经济和科学价值,且随着近年来基于大数据的新应用、新行业不断兴起,已在全世界掀起一股大数据研究的热潮。2015年,国务院发布发展纲要,将大数据纳入其中。大数据价值的体现在其中蕴藏的大量信息,要真正发掘出数据的信息价值,需要克服“4 V特性”(价值稀疏、多源异构、数据海量、指数生长)带来的挑战[1-2]。而人脑作为天然的数据处理引擎,具备超乎想象的数据分析处理能力。可以同步解析图像、气温、触感、声音多种形式数据,每秒的信息传递量可达1 000亿次。

深度神经网络算法仿生人脑数据处理模式,是目前最为高效的大数据分析算法之一[3-4]。本文将基于大数据和神经网络的核心技术,梳理了神经网络大数据分析的基本框架,并对以数据驱动的自动化特征提取模式为核心的深度学习方法做深入研究。同时,对其在图像理解中的应用进行实例分析。

1 大数据与深度神经网络

1.1 大数据关键技术

1.1.1 大数据概念

大数据一词诞生于1997年,通常指信息庞大复杂的数据集合。大数据具备4个突出特征:

1)数据海量

大数据包含的是全样本数据和超高维的复杂数据,而非少量的抽样数据。

2)价值稀疏

单条数据蕴含的价值极低且数据间相关性差。

3)多源异构

数据来源复杂、渠道广泛,且大多是非结构化的数据混杂结构化数据,难以分类整理。

4)指数生长

大数据包含的数据量会随着产出指数变化,流量可达到TB级[5-9]。

1.1.2 大数据核心技术

要跨过大数据的特征门槛,发掘出大数据的信息价值,其关键技术分为3个部分层[10-11]:

1)数据平台

数据平台负责大数据的采集和分类存储管理。对收集到的数据需要进行清理、再标记。标记数据时刻清理更新,蕴含着海量数据的大部分研究价值。

2)分析平台

分析平台负责大数据计算、分析,是价值具象化的重要途径。转化过程需要强大的计算平台支撑,现常用的分布式大数据计算框架有:MapReduce、Parameter Server等,分析方法常用人工建模或神经网络分析。

3)展示平台

展示平台通常以流量渠道进行大数据产品的推广,包括大数据研究规律或价值研究模型等。大数据完整的分析、标记、提取流程如图1所示。

图1 三层架构下元数据管理

1.2 神经网络算法

1.2.1 算法模型

神经网络算法是一种模拟大脑分析机制的仿生计算方法,研究内容涵盖神经网络结构模拟、网络通信模型、记忆模型及学习算法等[12]。

目前,研究实现的神经网络算法模型主要有:前馈神经网络、回复式神经网络、时序记忆神经网络。本文主要研究基于前馈神经网络,这也是最为高效的一种网络模型。其突出的特征学习能力,可广泛运用于语音、图像识别中。前馈神经网络分为多层结构,每层由多组神经元构成,信息沿着前馈层输入,单向流动传输[13]。基于此特性,前馈神经网络可有效提取数据空间结构特征,最为著名的实现方法如感知机、深度自动编码机等,均已在计算机视觉与人工智能开发领域作出卓著贡献。

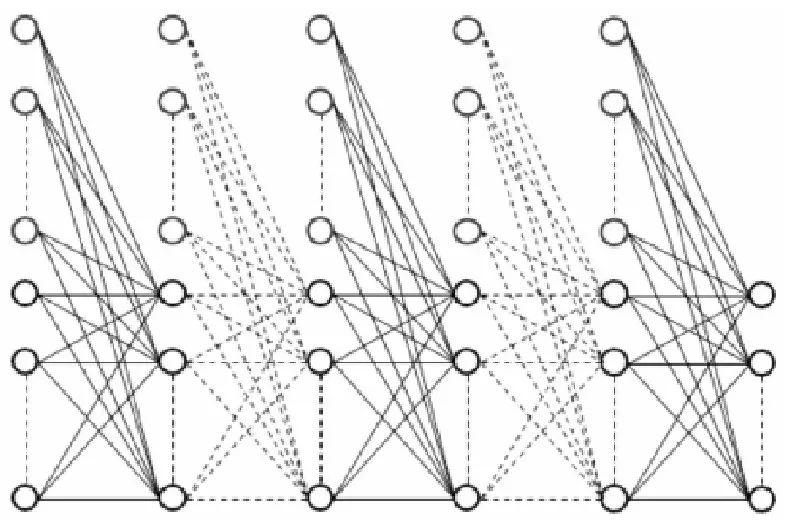

1.2.2 无限深度神经网络

深度神经网络,通常指具有一定层级深度的前馈式神经网络,且无“时间参数”限制,适合处理静态数据,拓扑如图2所示。而无限深度神经网络则在反馈结构上建立回复式互联,在时间维度上展开,随着不断分支,网络可以“无限深”,使其具备可处理动态数据的能力。其拓扑示意如图3所示。

图2 前馈式深度神经网络拓扑

图3 无限深度神经网络拓扑

2 神经网络学习算法

深度神经网络任务的核心在于对数据变化趋势的预测,即时序特征。时序是一个时间相关的动态函数,常以“Bus Driver”来验证算法的动态提取能力。

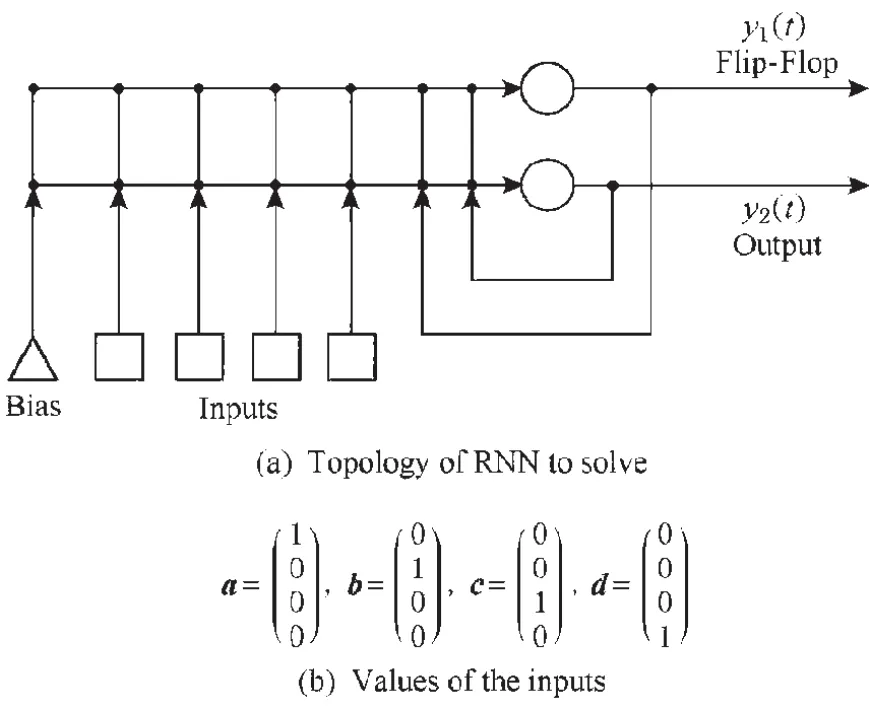

“Bus Driver”问题要求在动态干扰中识别顺序发生的两个事件。如图4所示,对于a,b,c,d 4个事件,只有在a后出现了事件b才会输出1,否则为0。

图4 Bus Driver问题

在深度神经网络算法模型中,以一个神经元作为触发器,另一个为输出。划定4端口输入,1值在端口随机转换,其余默认为0,便可实现“Bus Driver”目标输出规则:在a后出现第一个b输出1。拓扑如图5所示。

2.1 性能函数分析

以上算例凸显出了记忆、学习能力与时间判断相结合的时序深度分析能力。而神经网络的计算分析能力,是建立在模拟神经元连接权值上的。因此,学习算法的效率核心就在于网络节点权值的调节上。

图5 解决Bus Driver问题的无限深度神经网络拓扑

权值调节的最终目标是从数据中抽取有效知识,达成计算任务。常用性能函数J(w)来进行权值优化。α为学习效率,∇wJ为参数梯度

以一个监督有序学习序列作为输入,在任意t时刻性能函数:

若划定起止时间t0和t1,性能函数转变为:

以上两种方式分别称为阶段训练和连续训练,其特点如表1所示。

表1 连续训练与阶段训练特性对比

2.2 深度神经网络学习算法

作为最经典的前馈网络算法,BPTT算法按照无限深度神经网络展开为回复式网络,每层有其相对应的权值。根据2.1所示的两种训练学习方式,可实现两种经典算法:Epoch-BPTT、Real-BPTT[14-16]。同时,为了解决无限深度神经网络普遍存在的“梯度爆炸、消失”问题,本文研究采用“长短时记忆”的改进LSTM学习算法。

其具体解决原理在于将非线性的激活函数变为线性函数,拓扑结构如图6所示(称为CEC神经元)。但线性结构也限制了其学习能力,且存在特殊情况下的输入输出冲突。因此,将CEC结构进一步发展为LSTM memory cell。即一个block中可包含多个 memory cell,由 Gate、Output、Forget三块区域采用全连接方式控制,如图7所示。

图6 A CEC of LSTM

图7 LSTM memory block

3 算法分析实例

无限深度学习适用于海量数据的特征提取,获取到有用知识。以LSTM模型为例,其在视频识别中可对人肢体行为进行分析,并排列出动态时序信息,从而处理复杂的视频序列。而在图像处理领域,也无须建立任何语法结构和语言库,可将图像甚至视频映射为一个自然语句。

测试图像、视频库中存有8 w+训练图像。本文从测试图库随机抽取一张图像或视频的一帧为目标,输入到卷积网络中,得到一个固定长度的特征向量。然后,将特征序列输入到LSTM学习模型得到时序特征,预测出时序上的单词空间分布概率。进而标记提取出正确行为信息,按时序级联表达,转化为自然语句输出。

整体网络架构分为:1个卷积神经网络,4个长短时记忆网络连接分类器。通过分析结果可知,LSTM相比其他语义理解算法能够取得更高的精准度,其优势尤其体现在短句的理解与翻译中。

4 结束语

文中主要研究“大数据+神经网络”模式下,深度学习在非结构化数据中动态时序分析方法。介绍了大数据特性、大数据关键技术及深度神经网络在时间维度展开的回复式互联结构。并就其性能函数优化问题,提出采用改进LSTM学习算法,良好平衡“学习能力”与“输入输出冲突”的矛盾问题。总而言之,无限深度神经网络方法在图像、语音、视频的实例处理中表现出极高的精准度和学习能力,可高效实现大数据价值转化。

参考文献:

[1]张蕾,章毅.大数据分析的无限深度神经网络方法[J].计算机研究与发展,2016,53(1):68-79.

[2]工业和信息化部电信研究院.大数据白皮书[M].北京:工业和信息化部电信研究院,2014.

[3]Silver D,Huang A,Maddison C J,et al.Mastering the game of go with deep neural networks and tree search[J].Nature,2016,529(7587):484-489.

[4]Intel IT Center.大数据101:非结构化数据分析[EB/OL].(2015-07-01)[2017-11-05]www.intel.com.

[5]Hochreiter S,Schmidhuber J.Long short-term memory[J].Neural Computation,1997,9(8):1735.

[6]Gers F A,Schmidhuber J,Recurrent nets that time and count[C].Piscataway,NJ:IEEE,2000.

[7]Donahue J,Hendricks L A,Guadarrama S,et al,Long-term recurrent convolutional networks for vi⁃sual recongnition and description[J].ArXiv Pre⁃print,2014,14(11):4389-4395.

[8]Gravers A.Generating sequences with recurrent neural networks[J].ArXiv Preprint,2013,13(11):850-859.

[9]Fu X L,Cai L H,Liu Y,et al. A computational cognition model of perception,memory,and judg⁃ment[J].Science China Information Sciences,2014,57(3):1-15.

[11]缪林松.基于代价敏感神经网络算法的软件缺陷预测[J].电子科技,2012,25(6):75-78.

[12]常政威,谢晓娜,桑楠,等.MPSoC软硬件划分的自动波竞争神经网络算法[J].电子科技大学学报,2010,39(5):752-756.

[10]刘玉儒,张振华,刘陵顺,等.一种基于BP神经网络算法PID控制器的研究与仿真[J].电子设计工程,2012,20(12):140-142.

[13]梁玉强,陈劲杰,叶其含.基于AdaBoost和BP网络的机器人动作理解[J].电子科技,2017,30(8):63-66.

[14]刘天舒.BP神经网络的改进研究及应用[D].哈尔滨:东北农业大学,2011.

[15]刘蕊蕊,于合谣,冀鹏飞.基于遗传算法改进的BP神经网络算法[J].德州学院学报,2017,33(4):38-41.

[16]张袅娜,刘美艳.一种基于RTRL的神经网络驾驶员巡航模型[J].电子科技,2016,29(6):5-7.