一种兴趣区域检测的H.265码率控制方法

,,

(1.天格科技(杭州)有限公司,浙江 杭州 310015;2.浙江工业大学 计算机科学与技术学院,浙江 杭州 310023)

码率控制是视频编码中至关重要的模块,根据目标比特率来调整编码器输出的实际比特率,避免视频编码帧输出过大或过小,影响到解码器的设计和网络传输.多种码率控制算法已在视频编码标准发展过程被提出,例如MPEG-2测试模型TM5和MPEG-4验证模型(VM)8,H.264/AVC中的JVT-N046.H.265中也提出了一些新的码率控制算法.例如HM6推荐的码率控制算法,基于二次R-Q模型[1]和二次像素为基础的统一的速率量化(URQ)模型[2],Li等[3]提出了一种线性的R-λ模型,基于速率控制算法λ模型,由于基于线性R-λ模型的码率控制算法其优异的压缩性能,此码率控制算法已成为H.265参考软件(HM)推荐的码率控制算法.因其LCU级比特分配是基于已编码帧同一位置的LCU平均绝对差(MAD),导致LCU层的比特分配不是最优.现有码率控制方法都没有考虑人类视觉系统的特点,存在一个区域有很高的平均绝对差值,但这区域并不会受到人类视觉系统的关注.笔者提出的算法主要思想是如何在视频帧内分配有限的位资源,以达到让人感兴趣区域的视频质量更好,即感兴趣区域在此码率控制算法下,使主观视觉质量可以得到提高.基于感兴趣区域视频编码的码率控制算法已受到研究者的关注.Liu等[4]考虑到在视频通话中的人脸检测方案,提出了一种基于感兴趣区域的比特分配技术.Li等[5]提出一种H.264/AVC改进的码率控制算法,分多个优先级别来得到感兴趣区域,能更好地控制感兴趣区域块视频质量,同时通过位再分配过程来约束视频帧其他部分视频质量变化过程.还有像进行精准比特率控制的[6]、增加压缩比的[7],然而,这些算法都是基于H.264/AVC编码器设计的,H.265在编码结构和算法设计上与H.264存在差异,这些改进的码率控制算法不能直接应用过来,所以在H.265R-λ模型码率控制算法基础上,将已在H.264/AVC上应用的改进码率控制算法[8]结合进来,提升了笔者的改进算法.

1 显著图产生和感兴趣区域决策

1.1 空间域上的显著图

为了产生所需的空间域上的显著图,笔者采用著名的基于图(GB)的显著图模型[11],利用与Itti模型相同的特征提取方法[12].该算法特征通道参数通常采用颜色、强度、方向和对比度,在实验中所有通道的加权因子都采用这些参数,有关特征提取更详细的说明参考文献[11].假设一个特征映射产生,其表达式为M:[n]2→R,下一步是操作在M域上活化区域或显著图,基于图(GB)的显著图模型引入了一个马尔可夫随机过程.对于特征映射中的两个节点p和q,它们的差异性可以定义为

d(p‖q)

(1)

A点一个完全连接的有向图GA可以通过连接M域中的每个节点与所有其他n-1节点得到.有向图GA边缘节点到节点q和q加权重表达式wA(p,q)为

wA(p,q)d(p||q)·F(px-qx,py-qy)

(2)

式中:F(a,b)分别为节点P和Q的坐标;σ为自由参数.

在相反方向的边缘节点也具有相同权重值.在GA马尔可夫链可以通过规范各节点出境边的权重绘制节点和状态之间的一个等价定义,和边权值和转移概率.这条链的平均分布,从长远来看反映随机游走在各个节点或状态下的时间分量,相比周围节点,在这个节点上会自然有较高的积累,因为转移到这样的子图概念就高,不可能转移到具有相似的M值节点上,此结果是一个来自两两比较有用的衡量.

在获得所有激活图后,它们应该在加性组合之前进行归一化处理.通过另一个马尔可夫算法进行规范化过程如下:假设有一个激活图A:[n]2→R,一个完全连接的有向图GN可以通过连接在与所有其他N-1个节点每个节点构造.对于在A域的二个节点p和q,其边加权函数表达式为

wN(p,q)A(p)·F(px-qx,py-qy)

(3)

式中A(p)为节点p的激活值.通过计算的马尔可夫链平均分布,得到归一化的激活图.图1为视频图像,图2为图1对应的空间域的显著图.

图1 原始视频Fig.1 The original figure

图2 空间域上视频显著图产生Fig.2 Video on significant figure in the spatial domain

1.2 时域上显著图

通常情况下,移动的物体是观众极大的兴趣点.运动矢量(MV)是时域显著图中一重要的特征参数,因为它可以表示物体的运动强度.它是基于块匹配提取的,在前面的帧中搜索的最佳匹配块,由于平均绝对差(MAD)相对较低的计算复杂度,故作为算法和自适应十字模式搜索(ARPS)的搜索算法[13].块大小设置为16×16,搜索范围为7,MV的幅度M可以表示其块的运动强度.视频序列中有2种情况:物体在移动,背景相对静止;背景在运动,物体相对静止.在第2种情况下,运动向量的大小是不能够代表它的块的显著特性.图3为时域中视频显著图.

图3 时域中显著图Fig.3 Significant figure in time domain

1.3 显著图和感兴趣区域组合决策

为了获得时空显著图SF,基于相干规范融合方法[13-14]结合了空域和时域的显著图,即

SF=SmSpθ1Sm+θ2Sp+θ3

(4)

式中:θ1,θ2,θ3分别为加权因子,根据经验分别设置为0.5,0.3,0.5.给时域显著图选择较大的加权因子,因为移动的物体总是更吸引人的眼睛.前2个参数是通过时空域显著图来提升像素独立属性,第3参数是通过空域显著图来对时域显著图进行加权,反之亦然,可以根据显著图来确定感兴趣区域.每一帧的LCU显著特性可以通过计算得到,即

(5)

式中:ws(i)为第i个LCU显著图的加权值;SF(i,m,n)与坐标(m,n)的值对应的帧中的第i个LCU的显著图,m和n分别为该块的宽度和高度.通过计算一个视频帧中所有的ws(i),然后从大到小进行排序,选定一个阈值T,LCU的ws(i)大于T将被设定为感兴趣区域,小于T将被认为非感兴趣区域.

2 ROI/NROI下目标码率设定和λ选择

算法中,针对ROI和NROI数据位分配是独立去决策的,ROI和NROI各自有目标位.需要注意的是设定帧目标比特位与HM10一致,然后根据质量因子K将帧的目标比特数分成2部分,质量因子K为ROI和NROI所需比特数的比值.ROI和NROI目标比特数表达式分别为

T=TROI+TNROI

(6)

TROI=K·TNROI

(7)

式中:T,TROI,TNROI分别为当前帧;下标ROI和NROI为各自的目标比特位.设定目标比特位后,λROI,λNROI,QPROI,QPNROI能通过文献[3]中式(1,2)来计算.为了保证时域上的质量稳定,参数λ和QP需要限定在一个较小的范围,λ取值范围为

(8)

(9)

QP的取值范围为

QPXlastSameLevel-3≤QPXcurrPic≤QPXlastSameLevel+3

(10)

QPXlastPic-10≤QPXcurrPic≤QPXlastPic+10

(11)

式中:X为ROI或NROI;下标currPic,lastPic,lastSameLevel分别为当前帧相关参数、上一帧编码参数以及同当前帧同一层次的前编码帧.

在LCU层级的码率控制,每个LCU的目标比特位设定应该与当前LCU显著度值成正比例,其表达式为

(12)

(13)

QPXcurrPic-2≤QPcurrLCU≤QPXcurrPic+2

(14)

式中:X为ROI或NROI,依赖于当前LCU分类;currLCU为当前LCU相应的参数,LCU的λ和QP值也应该由邻近的LCU在空间域平滑进行约束.如果当前LCU及其左相邻LCU,属于同一类型,或者最后的编码LCU单元,其ROI或NROI的λ和QP值修正式为

(15)

QPlastLCU-1≤QPcurrLCU≤QPlastLCU+1

(16)

式中lastLCU代表着与前一个编码LCU相关的参数.

通过上述方法获取ROI和NROI的λ和QP后,将这2个参数代入H.265码率控制算法模型中,它可以分为2部分:第1部分是位分配,第2部分是根据已分配的位来调整编码参数.第2部分涉及R-λ模型,即

λ=α·Rβ

(17)

式中:α,β分别为与视频源相关的参数;R为目标设码率.λ为拉格朗日算子,它在率失真优化(RDO)过程中起到非常重要的作用.这样针对视频ROI和NROI区域得到最佳视觉体验上的码率控制参数,在不增加视频量化的位数的提升下极大的提升了视频的视觉质量.

3 实验结果与分析

为了评估改进算法的性能,笔者在HM10标准

工程中验证提出的改进码率控制算法.选取JCT-3V中3种不同的分辨率频序列对改进码率控制算法的效果进行评估,所有的序列都是选用“随机存取编码(RA)”进行编码.将笔者提出的改进算法与HM10码率控制[6]进行比较.每一帧的ROI和NROI码率目标比设为3.通过失配误差来研究比特位不匹配的准确度,其表达式为

(18)

式中:Rtarget,Ractual分别为测试编码序列的目标码率和实际码率值.

表1显示了不同序列在不同目标比特率的实验结果,与HM10比较,该算法在比特率波动为0~1%情况下,在感兴趣区域(ROI)视频质量提升的1.15~1.5 db,付出的代价是非感兴趣区域(NROI)视频质量有0.76~1.49 db损失.表1中序列1为Kimono序列,序列2为ParkScene序列,序列3为PeopleOnStreet序列;PA为笔者提出的改进算法.

表1 测试对比数据Table 1 Test data to compare

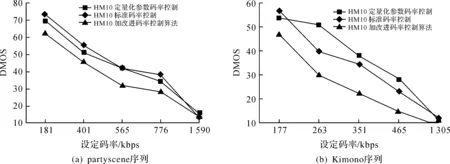

图4为2个序列在HM10.0固定QP,HM10.0码率控制和改进码率控制算法下的主观视觉测试的比较结果.DMOS为10次客观测试平均MOS值,较低的值代表更好的视觉质量.首先,这2个序列是固定的QP分别设置为32,38,40,42,46,它们的输出比特率设置作为在HM10.0码率控制算法的测试目标比特率.如图3,4所示,笔者提出的算法在同行码率情况下能得到更好的视觉质量.改进算法主要思想是感兴趣区域分配更多的比特位,非感兴趣区域分配少一点比特位,特别是在低码率情况下,能大大提升整个视频的主观视觉质量.在高码率的情况下,3种算法均能提供非常良好的主观质量,人类的眼睛很难大致区分它们之间的区别.

图4 2种测试序列视觉评估曲线Fig.4 Two kinds of test sequence visual evaluation curves

4 结 论

提出了一种感兴趣区域的H.265改进码率控制算法.基于每帧的时空域线索来检测出显著图,根据显著图来区分感兴趣和非感兴趣区域,并单独对感兴趣区域和非感兴趣区域进行比特位分配.经过计算每个LCU的λ和QP值,进行编码.兴趣区域检测的H.265码率控制方法在编码序列的整体主观视觉质量上比HM10标准中自带的码率控制算法有了很大的提高.实验结果也表明:该算法可以使输出比特率达到目标值,同时有效地提升了视频帧的兴趣区域峰值信噪比(PSNR),因此编码序列的整体主观视觉质量相比HM10标准中自带的码率控制算法大大提高.

本文得到了财政部2015年度文化产业发展专项资金项目的资助.

参考文献:

[1] KANG J W, KIM C S. On DCT coefficient distribution in video coding using quad-tree structured partition[C]//Signal and Information Processing Association Summit and Conference. Cambodia: IEEE,2014:1-4.

[2] CHOI J A, HO Y S. Implicit line-based intra 16×16 prediction for H.264/AVC high-quality video coding[J]. Circuits, systems, and signal processing,2012,31(5):1829-1845.

[3] LI B, LI H, LI L, et al. Domain rate control algorithm for high efficiency video coding[J]. IEEE transactions on image processing a publication of the IEEE signal processing society,2014,23(9):3841-3854.

[4] LIU Y, LI Z G, SOH Y C. Region-of-interest based resource allocation for conversational video communication of H.264/AVC[J]. IEEE transactions on circuits & systems for video technology,2008,18(1):134-139.

[5] LI F, LI N. Region-of-interest based rate control algorithm for

H.264/AVC video coding[J]. Multimedia tools and applications,2016,75(8):1-24.

[6] 周骏华,石旭刚,宋玮.一种基于运动复杂度的新的H.264码率控制跳帧算法[J].浙江工业大学学报,2006,34(6):672-675.

[7] 周志立,阮秀凯.基于H.264的码率控制的改进方法研究[J].浙江工业大学学报,2008,36(5):519-522.

[8] PRATIKC, NARENDRA P, KANUP. Region of interest based image compression[J]. International journal of innovative research in computer and communication engineering,2014,2(1):2743-2754.

[9] MEDDEB M, CAGNAZZO M, PESQUET-POPESCU B. ROI-based rate control using tiles for an HEVC encoded video stream over a lossy network[C]//IEEE International Conference on Image Processing. Quebec City: IEEE,2015:1389-1393.

[10] ITTI L, KOCH C, NIEBUR E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE transactions on pattern analysis & machine intelligence,1998,20(11):1254-1259.

[11] LASMAR N E, BERTHOUMIEU Y. Gaussian copula multivariate modeling for texture image retrieval using wavelet transforms[J]. IEEE transactions on image processing a publication of the IEEE signal processing society,2014,23(5):2246-61.

[12] BAI LIXUN, SONG LI, XIE RONG, et al. Saliency based rate control scheme for high efficiency video coding[C]// Signal and Information Processing Association Annual Summit and Conference(APSIPA).UK: Cambridge University Press,2016:10-15

[13] LEE S H, KANG J W, KIM C S. Compressed domain video saliency detection using global and local spatiotemporal features[J]. Journal of visual communication & image representation,2016,35:169-183.

[14] CHAMARET C, CHEVET J C, MEUR O L. Spatio-temporal combination of saliency maps and eye-tracking assessment of different strategies[C]//IEEE International Conference on Image Processing. Hong Kong: IEEE Xplore,2010:1077-1080.