基于特征融合与稀疏表示的人耳识别

张雅倩,曾卫明,石玉虎

(上海海事大学 信息工程学院,上海 201306)

基于特征融合与稀疏表示的人耳识别

张雅倩,曾卫明,石玉虎

(上海海事大学 信息工程学院,上海 201306)

人耳识别是一种新兴的生物识别技术,具有较高的理论研究价值和市场应用前景,并随着图像处理、模式识别等领域的发展而逐步发展。在人耳识别中特征提取是生物特征识别技术的关键环节,对最终分类结果的准确性起着决定性作用。因此为了提高人耳识别技术中分类结果的正确率,提出了一种基于特征融合和稀疏表示的人耳识别方法。该方法采用四个方向上的Sobel算子检测边缘,并在每个边缘图上提取边缘特征;同时利用灰度共生矩阵提取四个方向上人耳图像的纹理特征,结合边缘特征和纹理特征,最后通过稀疏表示模型对人耳进行分类识别。实验结果表明,采用边缘特征和纹理特征相融合的方法能较大提升人耳识别的准确率,从而验证了该方法在人耳识别技术中的有效性能。

人耳识别;模式识别;特征融合;稀疏表示;图像处理

0 引 言

生物特征识别技术是指通过计算机与光学、生物传感器等原理密切结合,利用人体自身的生理特征和行为特征来进行的个人身份识别的技术[1]。人耳识别是以人耳作为识别特征来进行身份认证的一种生物特征识别技术[2]。与其他个体生物特征识别技术相比具有独特的优势,例如人耳纹理特征、结构特征等具有相对较强的稳定性。这使得人耳生物特征识别技术有着广泛的应用前景,然而该技术目前仍存在许多需要进一步研究和完善的地方。

人耳识别系统主要由人耳的图像采集、预处理、边缘检测和分割、特征提取、模式识别等主要环节组成。其中人耳的特征提取是整个人耳识别系统中至关重要的环节,特征提取方法的好坏将直接决定了所设计的人耳识别系统的性能,是人耳识别系统成功与否的关键因素。迄今为止,学者们已经提出了很多人耳识别方法,例如文献[3]提出一种基于局部二值模式特征的稀疏表示人耳识别方法。该方法利用局部二值模式对二维图像进行纹理分析,并通过求解稀疏表示模型得到稀疏编码系数,最后根据测试人耳图像的重建误差来进行识别,实验结果表明该方法有着较高的识别准确率。

文中根据边缘能显示图像局部亮度变化的部分,纹理图像或其中小块区域的空间颜色分布和光强分布,提取并综合图像边缘和纹理特征以准确描述其人耳特征,采用稀疏表示模型对人耳进行分类,并且通过实验对其准确率进行验证。

1 人耳特征提取

1.1 Sobel边缘特征提取

Sobel算子边缘提取算法是一种较为常用的边缘检测方法,计算简单、速度快,受噪声影响较小,同时对噪声具有平滑作用,并且能提供较多边缘方向的信息。文中借鉴Sobel算子来检测水平、垂直、两对角线四个方向上的边缘特征信息,并在每个边缘图上提取像素点所在局部窗口的特征[4]。

设原始图像为A,对原图像分别应用这四个算子得到四个方向(00,450,900和1350)上的边缘强度图Gx、Gxy、Gy、Gyx,其计算方式如下:

(1)

(2)

(3)

(4)

其中,*表示二维卷积运算。

通常边缘图上具有较高边缘强度和密度的区域是人耳特征。还可以根据提取像素点所在的窗口提取一些能量、熵和惯性等统计特征[5],具体算法如下:

(5)

当图像纹理比较细致、灰度分布均匀时,能量值(Eg)较大,反之较小。

(6)

熵(Et)是体系混乱程度的度量,反映了图像的复杂程度,当复杂程度越高时,熵值越大,反之则越小。

(7)

惯性矩(I)也称对比度,表明了图像的清晰度和纹理深浅的程度。当对比度大的像素对越多,惯性越大,反之越小。

(8)

相似度(H)是指度量空间的灰度共生矩阵元素在行或列方向上的相似程度,相关值大小表明了图像中局部灰度相关性。当矩阵元素值均匀相等时,相关值就较大,反之则较小。

其中Gx,y表示各个方向上的边缘图,(x,y)是图像中像素点的坐标。由于每个方向能够给出四个边缘特征,因此总共可以提取出16个特征来描述图像的边缘特征。

1.2 灰度共生矩阵纹理特征提取

纹理是一种反映图像中同质现象的视觉特征,通过像素及其周围空间邻域的灰度分布来表现。由于它体现了物体表面具有缓慢变化或者周期性变化的表面结构组织排列属性,因此可以成为描述与识别图像的重要依据。对于纹理特征的提取,可大致分为基于结构的方法和基于统计数据的方法,但对于图像中的纹理识别,基于统计数据的方法效果更好。因此文中采用基于局部统计特性的灰度共生矩阵特征。

1.2.1 灰度共生矩阵的定义

灰度直方图是对图像在某一个灰度值处所具有的像素个数进行统计得到的结果,灰度共生矩阵则是对图像上具有某确定距离的像素对出现的分布状况进行统计得到的结果。

设图像水平和垂直方向上各有Nc×Nr个像素,将每个像素出现的灰度量化为Ng层,设Lx={1,2,…,Nc}为水平空间域,Ly={1,2,…,Nr}为垂直空间域,G={1,2,···,Ng}为量化灰度层集。Lx×Ly为行列编序的图像像素集,则图像函数f可表示为一个函数:指定每一个像素具有Ng个灰度层中的一个值G,即f:Lx×Ly→G。灰度共生矩阵定义在图像域Lx×Ly范围内,两个相距为d,方向为θ的像素在图像中出现的概率,即:

P(i,j|d,θ)=#{[(k,l),(m,n)]∈(Lx×Ly)×(Lx×Ly)|d,θ,f(m,n)=j}

(9)

其中,#{x}表示成立的像素对数。如距离为d时,水平方向上的灰度共生矩阵计算公式为:

P(i,j|d,0)=#{[(k,l),(m,n)]∈(Lx×Ly)×(Lx×Ly)|k-m=0,|l-n|=d,f(k,l)=i,f(m,n)=j}

(10)

同理,距离为d,对角方向的灰度共生矩阵为:

P(i,j|d,45)=#{[(k,l),(m,n)]∈(Lx×Ly)×(Lx×Ly)|k-m=d,|l-n|=

-d,f(k,l)=i,f(m,n)=j}

(11)

P(i,j|d,135)=#{[(k,l),(m,n)]∈(Lx×Ly)×(Lx×Ly)|k-m=-d,|l-n|=d,f(k,l)=i,f(m,n)=j}

(12)

灰度共生矩阵不仅反映亮度的分布特性,也反映具有同样亮度或接近亮度的像素之间的位置分布特性,因此可根椐共生矩阵计算一些相应的特征值并以此来表示图像的纹理信息[6]。

1.2.2 灰度共生矩阵的特征

从直观上来说,图像的像素块灰度值的变化引起对应的对角线元素值的变化。为了能更直观地利用共生矩阵描述纹理的状况,从共生矩阵14种特征参数[7-8]中找出代表性强和独立性好的特征,综合对灰度共生矩阵的研究成果[9-12],采用能量、熵、惯性、局部相似度作为提取图像纹理的特征参数[13-14],计算方法如下:

(13)

(14)

(15)

(16)

其中,Wx,y(x,y)表示归一化后的灰度共生矩阵。

在每个方向上提取4个特征,因此总共提取了16个特征来描述每个像素点所在局部窗口的纹理特征。再结合1.1中所提取的16个边缘特征,共提取了像素点所在局部窗口的32维特征作为人耳检测分类器的特征向量。

1.3 稀疏表示分类

稀疏表示是近年来信号处理领域的热点之一,简单来说,它其实是对原始信号的一种分解方法。该方法借助一个事先得到的字典,将输入信号作为字典的线性近似,从而能更容易地获取信号中所包含的信息,并进一步对信号进行加工处理,如压缩、编码等[15]。

Wright等[16]根据模式间的稀疏性,设计了一种基于稀疏表示的分类方法。该方法将需要识别的图像表示为所有训练图像的稀疏线性组合。借鉴稀疏表示的分类方法,假设有m个人,第i个人有n幅训练图像,首先提取每幅人耳训练图像的边缘特征和纹理特征,记为d1,d2,…,d32;稀疏表示假设输入图像可以表示为来自同一类图像的稀疏线性组合,对于属于同一类别i的测试样本提取特征,记为Y,那么Y就可以表示成同类训练样本的特征线性组合,即Y=a1d1+a2d2+…+a32d32,然后将来自第i个人的n个训练样本的32个特征归一化为矩阵D,称为稀疏表示的字典,即D=[D1,D2,…,D32]=[d1,d2,…,d32]。

利用原始对偶算法求解下列模型:x1=argmin‖x‖1满足Y=Dx+e,得到稀疏系数x,其中e为误差项。若每一类的样本数目与总的训练样本数目相比占的比例很小,那么所得到的编码系数x就十分稀疏。并利用ri(Y)=‖Y-e-Dδ1‖2(i=1,2,…,32)计算余项,δi(x)为x中保留对应于第i类的系数,然后将其余的系数全部赋值为0,最后将测试样本归为使余项ri(Y)最小的那类i,并作为测试样本Y的识别结果。

2 实验结果与分析

实验采用北京科技大学提供的人耳库,选取图像库ΙΙ中77个人的人耳图,每个人有4幅图像,分别是正面一张、角度变化两张及光照变化一张。第一幅与第四幅图像均为人耳的正面图像,但是光照条件的变化较大,第二幅和第三幅图像与第一幅图像光照条件相同,但是分别相对于第一幅图像旋转了+30°和-30°。第一幅图像作为测试,其余人耳图像将作为训练样本。部分图像见图1。

图1 人耳图像库Ⅱ

对于人耳图像库Ⅱ中79人的人耳图像,包括向右转、向左转两种情况。选取从5°至20°以5°为间隔旋转变化,其中每种情况拍摄一幅用来训练,其他同角度变化的人耳图用于测试,共790幅图像。部分图像如图2所示。实验结果如图3所示。

图2 人耳图像库Ⅲ

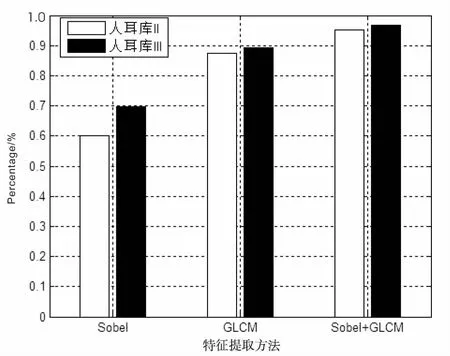

图3 实验结果

从图3数据分析可以得出,分别使用Sobel算子和灰度共生矩阵方法进行人耳特征提取并分类,识别的准确率并不高。因为Sobel算子并没有基于图像灰度进行处理,所以不能严格地模拟人的视觉生理特征,提取的图像特征并不能令人满意。然而利用灰度共生矩阵进行特征提取后的识别率明显高于利用Sobel的识别率,主要是由于灰度共生矩更好地兼顾了图像宏观性质与细微结构两个方面的信息,因此可以提取出更重要的特征。从图中可以看出,利用基于Sobel和灰度共生矩阵相融合的特征提取方法进行人耳识别,其分类结果的识别率明显高于基于单一边缘或纹理特征分类结果的识别率,这主要是因为前者克服了基于单一特征识别方法所具有的局限性。

3 结束语

文中提出一种基于特征融合和稀疏表示的人耳识别方法。首先,采用Sobel算子对四个方向进行边缘检测,并在每个边缘图上提取像素点所在局部窗口的特征,同时,利用灰度共生矩阵对人耳图像进行纹理的特征提取,以反映出图像上的细节信息;其次,结合边缘和纹理的特征以准确反映出人耳图像中人耳的特点;最后,通过稀疏表示模型对人耳进行分类识别。实验结果表明,与基于单一边缘或纹理特征的识别方法相比,采用边缘和纹理特征相融合的识别方法能较大提高人耳检测的准确率,表明了该方法在人耳识别中的有效性。

[1] 杨 艳.生物特征识别技术概述[J].中国自动识别技术,2006(1):58-62.

[2] 王 瑜,穆志纯,徐正光.多模态生物特征识别技术进展综述[J].计算机应用与软件,2009,26(2):31-34.

[3] 黄宏博,穆志纯,张保庆,等.基于局部特征和稀疏表示的鲁棒人耳识别方法[J].工程科学学报,2015,37(4):535-541.

[4] 肖 荣. 复杂背景下彝文古籍文本提取方法研究[D].武汉:中南民族大学,2011.

[5] LIU C,WANG C,DAI R.Text detection in images based on unsupervised classification of edge-based features[C]//Eighth international conference on document analysis and recognition.[s.l.]:IEEE Computer Society,2005:610-614.

[6] HARALICK R M, SHANMUGAM K, DINSTEIN I.Textural features for image classification[J].IEEE Transactions on Systems Man and Cybernetics,1973,3(6):610-621.

[7] LIUG H,YANG J Y.Image retrieval based on the texton co-occurrence matrix[J].Pattern Recognition,2008,41(12):3521-3527.

[8] HARALICK R M.Statistical and structural approaches to texture[J].Proceedings of the IEEE,1979,67(5):786-804.

[9] BARALDI A,PARMIGGIANI F.Investigation of the textural characteristics associated with gray level cooccurrence matrix statistical parameters[J].IEEE Transactions on Geoscience & Remote Sensing,1995,33(2):293-304.

[10] 陈 红,夏 青,左 婷,等.基于纹理分析的香菇品质分选方法[J].农业工程学报,2014,30(3):285-292.

[11] 章海亮,朱逢乐,刘雪梅,等.基于图像光谱信息融合的鱼不同冻藏时间及冻融次数鉴别[J].农业工程学报,2014,30(6):272-278.

[12] 王昊鹏,李 慧.基于局部二值模式和灰度共生矩阵的籽棉杂质分类识别[J].农业工程学报,2015,31(3):236-241.

[13] 苑丽红,付 丽,杨 勇,等.灰度共生矩阵提取纹理特征的实验结果分析[J].计算机应用,2009,29(4):1018-1021.

[14] 黄 曜,许华虎,欧阳杰臣,等.基于混合特征提取的图像来源鉴别算法[J].计算机技术与发展2016,26(4):11-15.

[15] 郭金库,刘光斌,余志勇,等.稀疏信号表示理论及其应用[M].北京:科学出版社,2013.

[16] WRIGHT J,YANG A Y,SASTRY S S,et al.Robust face recognition via sparse representation[J].IEEE Transactions on Pattern Analysis & Machine Intelligence,2009,31(2):2368-2378.

EarRecognitionBasedonFeatureFusionandSparseRepresentation

ZHANG Ya-qian,ZENG Wei-min,SHI Yu-hu

(School of Information Engineering,Shanghai Maritime University,Shanghai 201306,China)

Ear recognition is an emerging biometric recognition technology,with high theoretical research value and market prospect,and develops gradually with the development of image processing,pattern recognition and other fields.Feature extraction is the key to this technology which plays a decisive role in the accuracy of the final classification result.Therefore,in order to improve the accuracy of classification result in the technology of ear recognition,a method of ear recognition based on feature fusion and sparse representation is presented.In this method,the Sobel operator from four direction is adopted to detect the edges and extract their feature.At the same time the GLCM (Gray Level Co-occurrence Matrix) is used to extract texture feature of ear images.Finally sparse representation model is utilized to conduct classification recognition of ear in combination of edge and texture features.The experiment shows that the proposed method can improve ear recognition accuracy greatly,thus confirming its effectiveness in the survey of ear recognition.

ear recognition;mode recognition;feature fusion;sparse representation;image processing

TP301

A

1673-629X(2017)12-0007-04

10.3969/j.issn.1673-629X.2017.12.002

2016-12-18

2017-04-20 < class="emphasis_bold">网络出版时间

时间:2017-09-27

上海市科委计划重点项目(14590501700)

张雅倩(1990-),女,硕士,研究方向为图像处理与模式识别;曾卫明,博士,教授,研究方向为图像处理与模式识别、脑功能连通性检测与神经认知等。

http://kns.cnki.net/kcms/detail/61.1450.TP.20170927.0958.024.html