一种基于监控视频的有效的行人自动跟踪方法*

宗智嵩,王夏黎,张明辉,安毅生

(长安大学 信息工程学院,陕西 西安 710064)

一种基于监控视频的有效的行人自动跟踪方法*

宗智嵩,王夏黎,张明辉,安毅生

(长安大学 信息工程学院,陕西 西安 710064)

行人跟踪是智能视频监控领域一个重要的研究内容,受到广泛关注。在实际应用中,对视频中行人跟踪处理的实时性和准确性都有很高要求,因此,如何在场景复杂多变的视频图像中完成对多行人自动、快速而准确的跟踪,是行人跟踪方法的研究热点。提出了一种有效的行人自动跟踪方法,该方法通过AdaBoost+Haar的检测框架以及SURF特征点匹配,改进原始的在线Boosting跟踪算法,解决了跟踪过程中由于目标尺度变化造成的跟踪误差问题并实现了对视频图像中多行人自动检测跟踪。使用校园内实际监控视频进行实验,实验结果证明该方法有较好的跟踪效果。

智能监控视频;运动目标检测;多目标跟踪;AdaBoost;在线Boosting

0 引言

对监控视频图像中的行人进行检测和跟踪以及对行人的行为和运动状态进行分析是计算机视觉的一个重要研究方向,也是实现智能视频监控的关键,在社会安保、城市规划、经济决等方面有着广泛的应用,具有一定的研究和应用价值。

目前的跟踪算法主要是将目标跟踪看作概率密度函数估计问题,如卡尔曼滤波、粒子滤波等。根据颜色直方图的跟踪算法Meashift及其改进的Camshift[1]算法使用也较多,该方法计算效率高,但易受颜色等因素影响。近几年比较流行的是基于学习的目标跟踪方法,即把目标和背景看作分类问题,通过前期训练分类器,在之后的跟踪中将目标和背景进行分类,如TLD[2]等方法,但由于监控视频数据量大,使用这些方法的效率较低,实时性差。并且由于在实际监控视频中光照影响明显,行人间遮挡频繁,遮挡面积较大,对行人进行整体检测的跟踪方法,在现实场景中计算量大,效果不佳。本文是基于倾斜视角[3-5]的行人跟踪方法,该视角下行人面部和头部特征明显,在图像中所占面积较小,有效地降低了计算量,且遮挡情况极少,有较高的实际使用价值,故将人脸和人头作为行人跟踪的具体对象。另外,目前研究的跟踪算法大都需要手动初始化跟踪对象,不满足自动跟踪的实际使用需求,本文通过对人脸和人头检测,在检测区域内对跟踪目标进行自动初始化,并在跟踪阶段可以对多个目标进行跟踪。

本文采用的方法是在视频画面外围设定检测人脸和人头的区域。在外围检测区域内,通过高斯背景建模的方法,缩小检测范围提高检测效率,并将检测到的目标自动初始化为跟踪对象。在里层跟踪区域内,使用SURF特征点匹配改进原始的在线Boosting跟踪方法,实现对纵向运动尺度变化的目标尺度自适应跟踪。

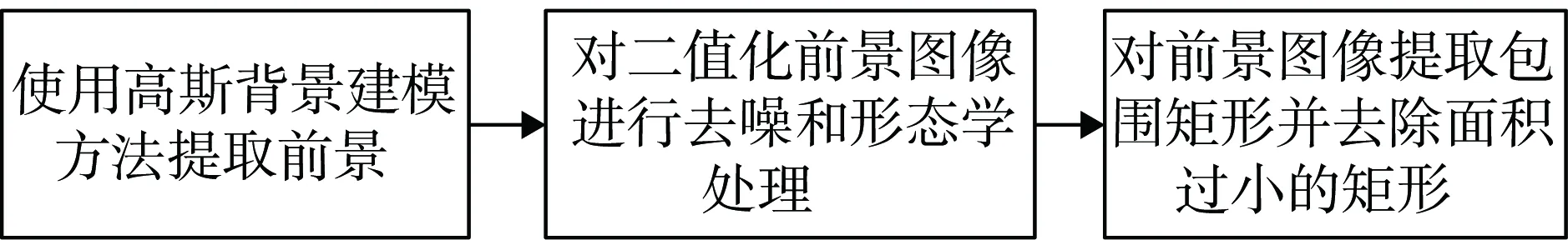

1 运动目标范围确定

本文的行人检测是在行人检测区域内检测,通过混合高斯背景建模[6]的方法获得前景区域并对前景区域进行边缘检测,获取轮廓矩形,将检测范围进一步缩小至运动目标可能出现的区域,并根据视频的实际情况,去除面积较小的区域,后续目标检测只需要对这些区域进行检测,而不用对整个检测区域检测,从而实现对算法效率的提高。流程如图 1所示。

图1 精确目标检测范围

混合高斯背景建模是由斯托弗等人提出的经典的自适应混合高斯背景提取方法,该方法认为各像素点之间相互独立,而其在视频图像中的变化可以用高斯分布来描述其像素值的变化规则,并依此建立背景模型。当新的一帧图像到来时,根据建立的背景模型判断每个像素点是前景点还是背景点,并对高斯模型进行不断的更新。

2 基于Haar特征的行人目标检测

在行人检测中,较为常用的是使用HOG特征[7]的检测方法,但是该方法计算量较大且受行人间相互的遮挡以及环境影响较大,因此对人头人脸进行检测不仅会降低计算量,还能够提高检测效率。在监控视频中,行人的头部信息可能是正面人脸、侧面人脸、背面人头三种情况,四个方向,将正面、侧面人脸定为一个人脸分类器,将背面人头定为人头分类器。

本文采用Haar特征和AdaBoost[8-9]方法使用大量样本训练两个分类器,其主要思想是通过积分图计算所需分类对象正样本的Haar特征值,每一个特征值对应一个弱分类器。使用训练不同的弱分类器形成强分类器,并将多个强分类器串联为瀑布式级联架构分类器。

训练正样本包括从实际监控中采集以及对MIT人脸库和INRIA行人数据库中的人脸和人头的提取,负样本自行选择大量不包含检测内容的图片,每个分类器的训练正样本数为5 000,负样本数为4 000。

3 在线Boosting行人跟踪方法及改进

3.1 在线Boosting算法跟踪原理

本文采用在线Boosting[10-12]跟踪方法,对离线分类器检测出的目标在跟踪区域进行跟踪。在线Boosting算法将跟踪问题看作跟踪目标和背景的更新问题,接收到每一帧时,将此帧中的目标作为正样本,从正样本周围选取若干与正样本大小相同的背景块作为负样本加入到之前训练好的分类器中进行学习并更新分类器。具体原理如下:

(2)训练弱分类器hk,计算分类错误率:

(1)

(3)根据分类错误率设置弱分类器的权重:

(2)

(4)更新样本权重:

(3)

(5)最终生成强分类器:

(4)

对于新到来的一帧图像,使用上一帧生成的强分类器对搜索区域内提取的N个样本进行测试,并生成置信图。通过置信图的顶点确定目标的新的位置。将该目标作为正样本并在周围选取若干负样本,并将这些样本重复上述的强分类器过程,生成新的强分类器。对以上过程进行迭代,不断对目标和背景进行分类,就达到了对目标进行跟踪的目的。

但是该方法由于跟踪框保持尺度不变,在目标尺度变化的过程中,尤其是目标远离摄像头的过程中容易引入错误,而这种错误的不断累积将导致跟踪漂移。故本文提出了依据SURF特征描述算子的改进方案解决以上问题,并实现了自动多目标行人跟踪。

3.2 SURF描述算子原理及匹配

在计算机视觉领域,SIFT[13]局部特征描述算子由于尺度不变性、旋转不变性等特性应用较为广泛。但是该算法计算量大、效率低,这也就促成了SURF局部特征描述算子[14]的产生,该算法的运算效率是SIFT的数倍。

SURF算法依赖于Hessian矩阵,并将Hessian 矩阵加上尺度σ的描述。设图像I中的像素点X坐标为(x,y),则矩阵被重新定义为:

(5)

Bay等人通过计算逼近值对其计算进行简化,使用与尺度线性相关的权值修正两者之间的误差,并证明当Hessian决定因子为0.9时效果最佳,得到:

det(Happrox)=DxxDyy-(0.9Dxy)2

(6)

根据上式遍历图像所有像素点,得到该图像在尺度σ下的响应图像,在使用不同尺度的模版进行高斯卷积时,将每个像素点的特征值与空间邻域内其他26个点进行比较,判断该像素点是否为局部极值,也就是特征点。

得到两幅图像的特征点集合后,使用快速临近匹配库(Fast Library for Approximate Nearest Neighbors,FLANN)[15-17]中的随机KD树进行匹配。KD树是一种适用于高维向量匹配的搜索树,所有维度中方差最大的维度的中间值作为树的节点,并不断重复该过程直到叶子节点。

3.3 算法改进

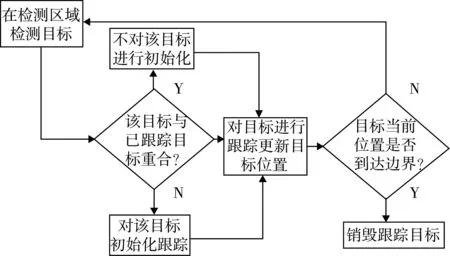

现有的跟踪算法大多不能自动选择跟踪目标且只能跟踪单目标,本文通过对人脸和人头的检测,自动初始化跟踪目标。当跟踪目标位置更新后记录跟踪目标位置,在检测出人脸或者人头时,遍历所有跟踪目标的更新框,若二者中心的距离小于跟踪框的宽度,则认为是同一目标,不对跟踪框进行初始化。在实验中,使用STL中的容器保存跟踪框初始化的位置和更新位置,实现对多目标进行自动跟踪。具体流程及跟踪效果如图2所示。

图2 行人检测跟踪流程

经实验发现,使用该方法能达到较好的跟踪效果及效率,如图3所示。

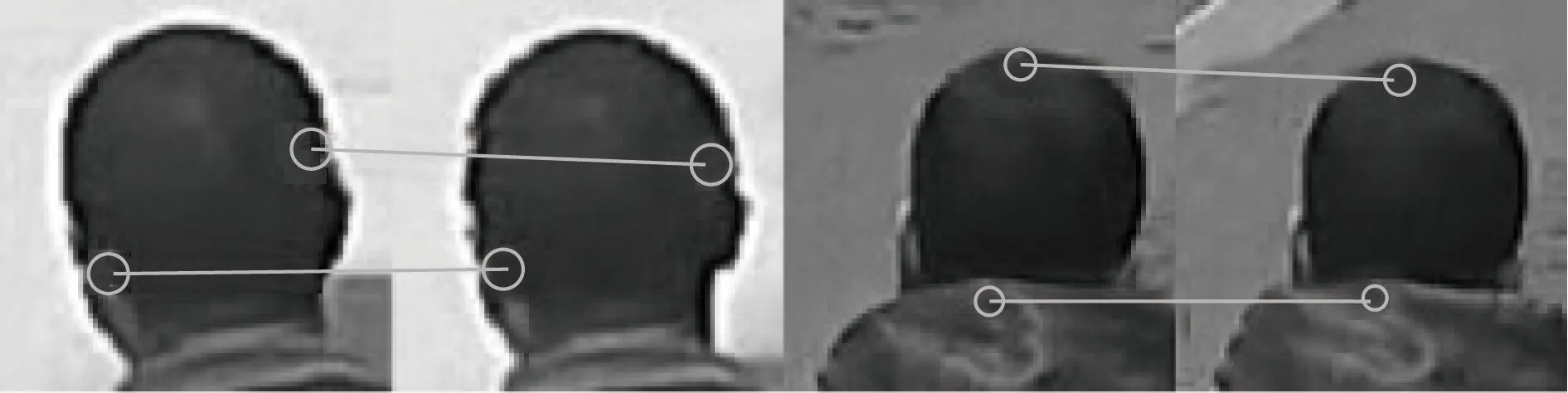

由图3可以看出,行人在由近至远的运动过程中,头部及人脸的尺度会产生变化,当行人运动到摄像头的远处时,原始的跟踪框远大于实际人头或者人脸,若此时有其他目标进入跟踪框中,则会对另外一个目标产生误检。故在跟踪的过程中,间隔n帧对跟踪框内的图像进行SURF特征点匹配,得到t帧中匹配度最好的两个点p1、p2以及t+n帧中对应的点p3、p4。跟踪过程特征点匹配如图4所示。

图4 跟踪过程特征点匹配

设原始跟踪框尺度为1,分别计算两幅图像中两点之间的欧氏距离比值即可得图像在t+n帧的尺度S′,其中dp3p4和dp1p2分别表示在第t帧和第t+n帧中两点之间的距离。

(7)

由于匹配点间的距离并非绝对的匹配(距离为0),但是基本小于0.1,故使用类似线性函数归一化的方法计算对该尺度的置信度:

(8)

其中Dp1p3和Dp2p4表示根据KD树匹配后两点匹配的距离。可依据置信度对尺度进行加权计算得到校正后的尺度S:

S=1×(1-conf_ratio)+S′conf_ratio

(9)

(10)

(11)

此时只使用一个最佳匹配特征点,故此时计算对该特征点的置信度为:

(12)

对在线Boosting在t+n帧置信度最大跟踪框Rectt+n(xt+n,yt+n,w,h)的左上顶点加权更新:

(13)

(14)

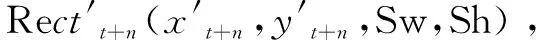

得到校正后的跟踪框Rectt+n(xt+n,yt+n,Sw,Sh)。若间隔帧数n过大,则目标可能形变较大,无法匹配,若过小,目标变化有限,造成不必要的计算。实验中将n设为5,即间隔5帧进行尺度变换及跟踪框校正。实验效果如图5所示,在跟踪过程中,跟踪框不断进行尺度变换,避免其他无关目标进入跟踪框内被误认为正样本。

图5 跟踪误检及改进效果

4 实验结果

本文实验采用Windows 7平台运行,处理器为3.6 GHz Intel Core i7,内存为8 GB,C++编译环境为VS2013。实验视频采用校园内实际监控视频录像作为处理对象,分别使用本文方法和原始的在线Boosting方法进行实验,实验中将跟踪框与实际目标包裹,对目标进入视区直至离开视区的整个过程稳定跟踪视为准确跟踪。实验结果如表1所示。原始的跟踪算法在行人纵向运动尺度发生变化情况下会产生跟踪框漂移等情况,并保留在图像中,对后续的行人检测跟踪产生影响,改进后的方法,对目标的包裹更为准确,也避免了引入错误,达到了较好的跟踪效果。算法改进部分增加了一定的时间消耗,但是仍能达到15 f/s(帧/秒)的实时性要求,能满足日常监控使用需求。

表1 实验结果对比

5 结论

本文提出的划分检测区域和跟踪区域的行人检测跟踪方法,可自动初始化跟踪目标,并利用SURF特征点进行匹配,达到了尺度自适应的效果,将理论方法应用到具体的应用中有普遍适应性和较好的运行效率。但是该方法在检测和跟踪精度上还有优化的空间,另外在该方法的基础上,可以对行人的特征、运动路径、视野内逗留时间进行有效的提取,为进一步的研究提供帮助,后续将开展相关研究。因此,本文提出的监控视频行人跟踪算法具有一定的理论和实际意义。

[1] 顾裕丰, 刘国栋. 一种复杂场景下的运动目标跟踪算法[J]. 电子技术应用, 2012,38(1):122-124.

[2] KALAL Z, MIKOLAJCZYK K, MATAS J. Tracking-learning-detection[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2011, 34(7):1409-1422.

[3] Liu Xiafeng, TU P H, RITTSCHER J, et al. Detecting and counting people in surveillance applications[C]. Advanced Video and Signal Based Surveillance, 2005 IEEE International Conference on Video and Signal Based Surveillance, 2005:306-311.

[4] Zeng Chengbin, Ma Huadong. Robust head-shoulder detection by PCA-based multilevel HOG-LBP Detector for People Counting[C]. International Conference on Pattern Recognition, 2010:2069-2072.

[5] SIDLA O, LYPETSKYY Y, BRANDLE N, et al. Pedestrian detection and tracking for counting applications in crowded situations[C]. IEEE International Conference on Video and Signal Based Surveillance, 2006:70-70.

[6] STAUFFER C, GRIMSON W E L. Adaptive background mixture models for real-time tracking[C]. IEEE Computer Society Conference on Computer Vision & Pattern Recognition, 1999:2246.

[7] 石志强, 赵向东, 李文军,等. 基于HOG和block权重的快速人体检测方法[J]. 微型机与应用, 2012, 31(11):44-46.

[8] VIOLA P, JONES M J. Robust real-time object detection[J]. International Journal of Computer Vision, 2004, 57(2): 131-154.

[9] 王小兰,蔡灿辉,朱建清.一种改进的快速人脸检测算法[J]. 微型机与应用, 2013, 32(15):37-40.

[10] GRABNER H, BISCHOF H. On-line Boosting and vision[C]. IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2006:260-267.

[11] 沈丁成. 基于在线Boosting算法的目标跟踪研究[D]. 天津:天津理工大学, 2013.

[12] 孙来兵, 陈健美, 宋余庆,等. 改进的基于在线Boosting的目标跟踪方法[J]. 计算机应用, 2013, 33(2):495-498.

[13] LOWE D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2):91-110.

[14] BAY H, TUYTELAARS T, GOOL L V. SURF: speeded up robust features.[J]. Computer Vision & Image Understanding, 2006, 110(3):404-417.

[15] MUJA M. Fast approximate nearest neighbors with automatic algorithm configuration[C]. Visapp 2009-Proceedings of the Fourth International Conference on Computer Vision Theory and Applications, Lisboa, Portugal, February, 2009:331-340.

[16] MUJA M, RUSU R B, BRADSKI G, et al. REIN-A fast, robust, scalable recognition infrastructure[C]. IEEE International Conference on Robotics & Automation, 2011:2939-2946.

[17] MUJA M, LOWE D G. Fast matching of binary features[C]. Ninth Conference on Computer and Robot Vision. IEEE Computer Society, 2012:404-410.

Effective automatic pedestrian tracking method based on surveillance video

Zong Zhisong, Wang Xiali, Zhang Minghui, An Yisheng

(School of Information Engineering, Chang’an University,Xi’an 710064, China)

Pedestrian tracking is an important research content in the field of intelligent video surveillance, which is being widely concerned. In practice, the pedestrian tracking in video processing has a high requirement of real-time and accuracy. Therefore, how to complete automatic, fast and accurate pedestrians tracking in the complex video scene is a hot spot. In this paper, an effective method of pedestrian tracking is proposed. This method combined with AdaBoost+Haar detection framework and improved online Boosting algorithm with the SURF feature matching solves the error caused by multi-scale window and realizes the automatic detection and tracking of multi pedestrians in video images. Experiments with actual surveillance videos on campus show that the proposed method has a better processing effect.

intelligent visual surveillance; moving objects detection; multi-objects tracking; AdaBoost; on-line Boosting

中国博士后科学基金资助项目(2012M521729)

TP391.4

A

10.19358/j.issn.1674- 7720.2017.12.014

宗智嵩,王夏黎,张明辉,等.一种基于监控视频的有效的行人自动跟踪方法[J].微型机与应用,2017,36(12):46-49.

2016-12-29)

宗智嵩(1992-),男,硕士研究生,主要研究方向:图形图像处理与智能交通。

王夏黎(1965-),男,博士,副教授,主要研究方向:图形图像处理与智能交通。

张明辉(1990-),男,硕士研究生,主要研究方向:智能交通与图形图像处理。