农业机器人并联采摘臂视觉伺服控制*

薛 梁, 周 俊

(南京农业大学 工学院 江苏省农业智能化装备重点实验室,江苏 南京 210031)

农业机器人并联采摘臂视觉伺服控制*

薛 梁, 周 俊

(南京农业大学 工学院 江苏省农业智能化装备重点实验室,江苏 南京 210031)

介绍了一种基于视觉伺服的农业机器人并联采摘系统,该系统由视觉系统、上位机、下位机、并联机构等4部分组成。视觉系统采集目标图像并传递给上位机,上位机对图像进行处理,识别和定位目标,计算并联机构的运动控制量,通过串口通信发送给下位机,下位机接收到控制量后,根据运动控制量驱动继电器模块作相应的开关动作,完成并联采摘臂的控制。实验证明:该系统对于实现农业机器人采摘作业具有可行性。

视觉伺服; 农业机器人; 采摘; 并联机构

0 引 言

我国是农业大国,拥有众多果蔬和农副产品,大多数果蔬采摘都要由人工完成,而采摘作业辛苦劳累,环境恶劣[1]。农业机器人应运而生,它的应用可减轻工人劳动强度,提高采摘效率[2,3]。视觉传感器是重要的传感器,为机器人提供外界环境信息[4]。采摘机构是农业机器人完成采摘作业的基础性部件,其特点决定机器人采摘性能,因此,研究基于视觉传感器的农业机器人采摘系统具有重要意义。

视觉传感器在各领域的应用已经相当广泛。杨福刚[5]利用视觉传感器,实现了在线对输液中异物和杂质的检测。杜东亮等人[6]运用视觉传感器采集烟叶图像,根据烟叶颜色特征实现自动分级。丁萌等人[7]通过安装在无人机上的视觉传感器获得无人机与跑道边缘的夹角,为无人机安全着陆提供帮助。日本Hayashi等人[8]利用视觉传感器识别定位草莓位置,研制了草莓采摘机器人。南京农业大学的顾宝兴等人[9]使用视觉传感器实现目标苹果的识别与定位,研制了一种智能移动式水果采摘机器人。

目前,应用较多的采摘臂是关节型串联机械臂,但并联机构相比串联机构在农业生产中具有独特的优势,比如刚度好、响应速度快、精度高且无累积误差等[10]。正因为上述优点,使得并联机构可用于末端采摘口姿态的快速调整。本文设计了基于视觉伺服的并联采摘系统,选取棉花作为典型的采摘对象,以摄像头作为视觉传感器,计算机作为上位机处理图像,对目标进行识别定位,找到图像中目标位置信息与并联采摘机构运动控制量之间的对应关系,计算出运动控制量,以串口通信将控制量发送给单片机,单片机通过继电器模块完成对并联采摘机构的运动控制。该视觉伺服的采摘臂可以广泛应用于采摘西红柿,苹果,草莓等果蔬。

1 并联采摘机构设计

本文在机器人机构学相关研究成果的基础上,根据农业机器人采摘作业时采摘口位姿调整的需要,建立了可调整性强的3—SPS/S并联机构作为采摘时的姿态调整机构,实现对目标的快速采摘。

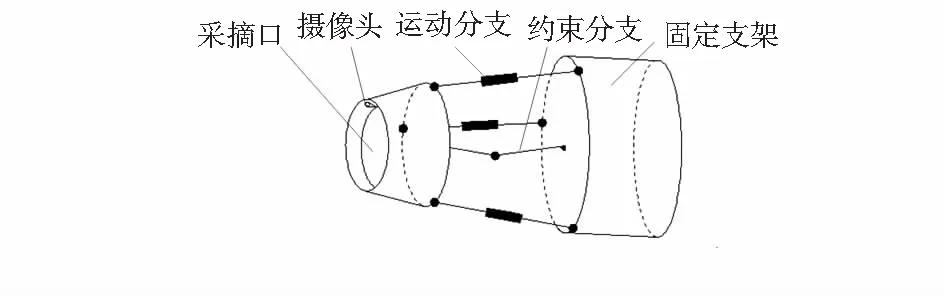

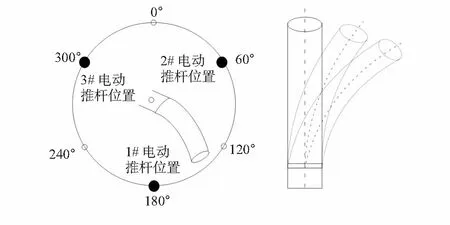

如图1所示为3—SPS/S并联采摘臂简图,其主要由采摘口、3—SPS/S并联机构和固定支架组成。该3—SPS/S并联机构有固定平台和运动平台两个平台,3个均匀对称分布的运动链分支分别与运动平台和固定平台组成球副连接,中间约束分支分别固定在运动平台与固定平台的中心,中间为球副连接。采摘口与运动平台固定,固定支架与固定平台连接。三个运动分支伸缩,可以实现固定在运动平台上的采摘头作出姿态的相应调整。

图1 3—SPS/S并联采摘臂简图

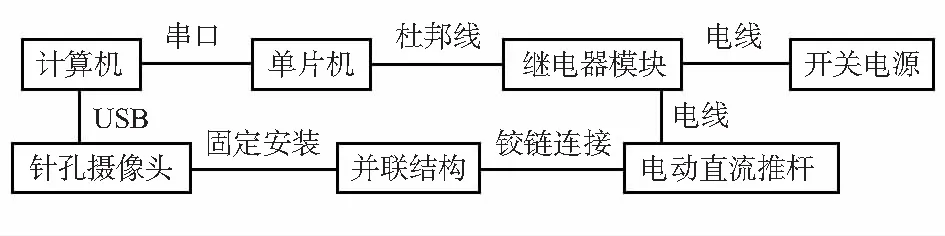

在采摘头内侧固定安装直径5.5 mm、30万像素的内窥镜摄像头,采摘系统硬件连接如图2所示。

图2 采摘系统硬件连接示意图

2 视觉伺服系统

2.1 图像采集和处理

本文实验所使用的棉花来自南京市江浦农场,将摄像头与PC相连,打开图像采集程序,得到大小为320像素×240像素的原始图像,如图3(a)所示。由于摄像头直接获取的图像包含大量无用背景,所以将原始图像进行恰当的处理是下一步进行特征提取、识别和定位必不可少的重要环节。

如果直接处理RGB彩色图像,计算量将会十分庞大,计算分析方法也会更加复杂,运算时间大大增加。图像灰度化后可以减少运算数据量,加快后续处理速度,图3(b)为灰度化后的图像。棉花灰度值与其余背景的灰度值有明显的差别,这就提供了基于阈值化处理来划分区域的可操作性。经过实验验证,当阈值为128时处理效果最佳,不仅可以去除大量无用的背景信息,而且可以十分鲜明地突出目标棉花区域和轮廓。阈值化后的图像如图3(c)所示。

在结构元素选择时,应尽可能的使图像中杂乱无章的背景小亮点去除,提高棉花区域在图像中的可区分性,同时也要尽可能的使棉花区域轮廓与棉花实际轮廓相似,轮廓平滑度较好。经过比较分析后,发现选用10×10的结构元素对阈值化后的图像进行开闭运算效果最好,图像经过开闭运算后,背景中细微的干扰信息有明显的消除,平滑了较大目标轮廓边界。开闭运算后的图像如图3(d)所示。

图3 图像处理效果

2.2 目标定位与控制策略

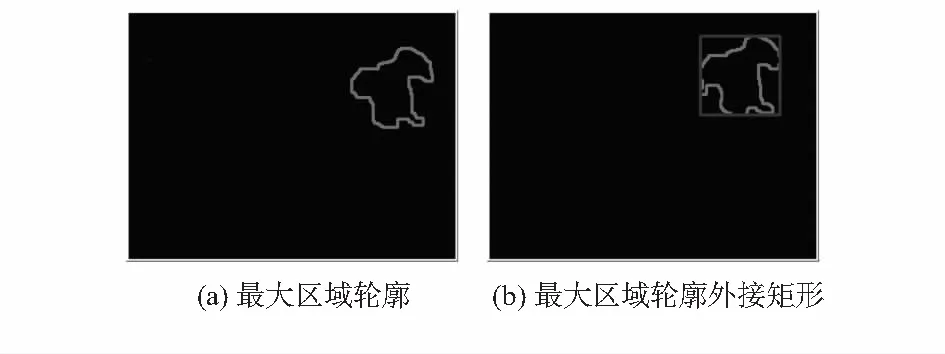

在摄像头视场中往往会出现多个棉花,而采摘口的结构形式决定了每次只能采摘一朵。由于摄像头安装在采摘口前端,且靠近棉花,通常待收获棉花直径相差不大,说明图像中面积最大轮廓对应的棉花距离采摘口最近,采摘机构姿态调整量最小,采摘最为容易,优先采摘该目标棉花。图4(a)中曲线区域为该幅图像中面积最大的棉花区域轮廓。

图4 目标轮廓区域

棉花轮廓复杂且不规则,直接求取其质心坐标比较困难,为了简便计算和提高运算效率,作该轮廓的外接矩形,如图4(b)所示。把矩形任意两个对角坐标代入式(1),可以计算出该矩形中心点的坐标,即为该朵棉花质心坐标

(1)

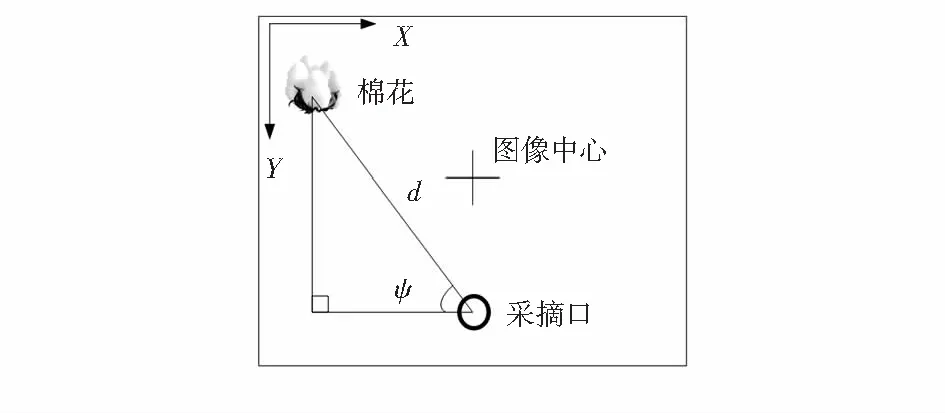

摄像头采集的图像坐标原点位于图像左上角,X轴水平向右,Y轴垂直向下,采摘算法的原理如图5所示。摄像头光轴中心位于图像中心处,光心在图像中坐标为(160,120)。设计的采摘口位于摄像头正下方40mm处,通过实验得到采摘口在图像中对应坐标为(160,190)。

图5 采摘算法原理图

设棉花坐标(x1,y1);采摘口坐标(x2,y2);采摘口与棉花直线距离为d;采摘口和棉花的连线与X轴的夹角为ψ。那么通过式(2)可以计算出采摘口与棉花的距离d,通过式(3)可以计算出棉花和采摘口的连线与X轴的夹角ψ。距离d决定并联采摘机构弯曲的角度,表征并联采摘机构弯曲程度;夹角ψ决定采摘口弯曲方向,因为采摘口可以朝向整个圆周的任意方向,必须同时给定弯曲的角度和方向才能实现目标棉花的采摘

(2)

ψ=arctan[(y2-y1)/(x2-x1)]

(3)

图6为采摘机构弯曲方向和角度示意图,将圆周360°等分成6份,每份60°,共定义6个方向,分别为0°,60°,120°,80°,240°,300°,用字符‘a’~‘f’代表这6个弯曲方向。设计的并联机构能够弯曲的最大角度为24°,等分成3份,每份8°,定义为0°,8°,16°,24° 4种弯曲程度,当计算出的弯曲角大于24°时,将其设置成24°,用字符‘g’~‘j’代表这4种弯曲程度。

图6 采摘机构弯曲方向和弯曲角度示意图

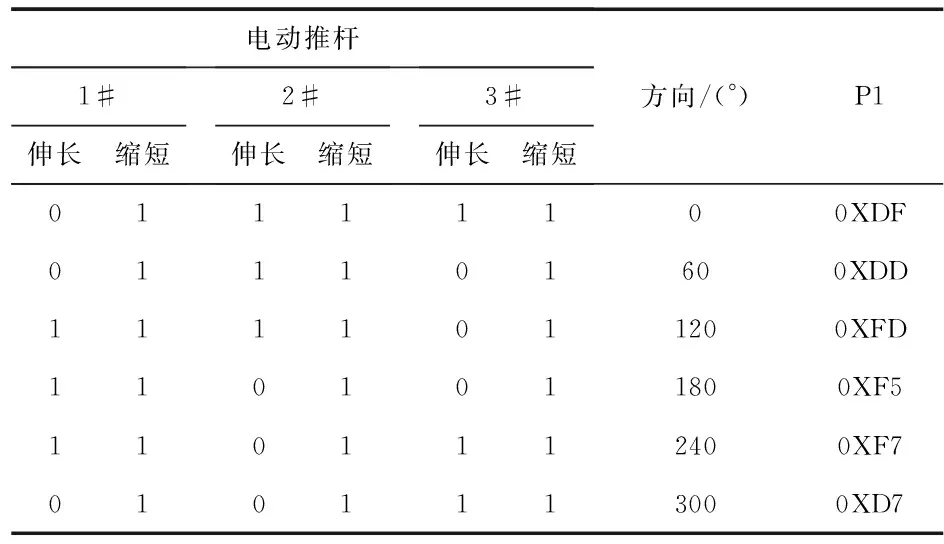

弯曲方向和角度分别用字符表示后,由上位机发送给单片机,单片机接收后还原出相应的弯曲方向和角度。初始时3根推杆为完全收缩状态,1根推杆完全伸出,其余2根静止,或者1根推杆静止,另外两根推杆完全伸出时弯曲角度最大。每根推杆分别由2个继电器控制其伸缩,总共使用6个继电器,他们的IN控制输入引脚分别连接单片机P1.0~P1.5引脚,继电器模块低电平触发,按要求对单片机P1.0~P1.5引脚分别赋值,完成相应动作。方向角与各杆状态之间的对应关系描述如表1所示。

给定P1引脚值只能确定运动方向,弯曲程度得由P1引脚值的保持时间决定。通过实验知道推杆整个行程在延时函数中对应的时间参数为930,平均3等分:0°时时间参数值为0;8°时时间参数值为310;16°时时间参数值为620;24°时时间参数值为930,达到最大弯曲角。到达相应角度后,令P1=0XFF关闭所有继电器,等待采摘完成后,使并联采摘机构复位,等待下次采摘任务。

表1 方向角与各杆状态的对应关系

3 采摘实验

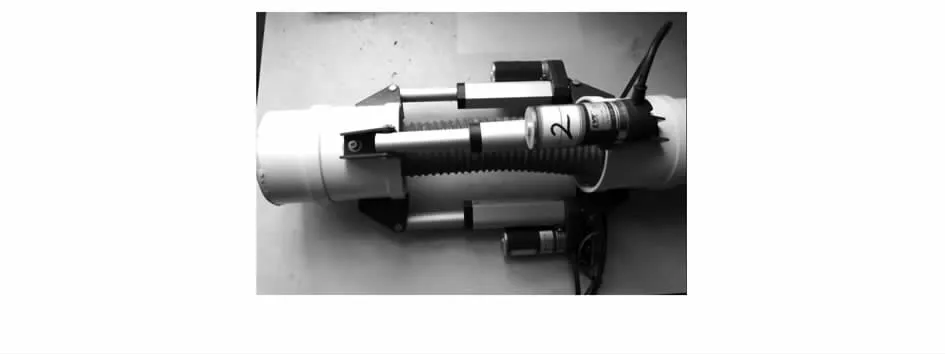

为了验证所提出的基于视觉伺服的农业机器人并联采摘机构的有效性和可行性,搭建了并联采摘臂实物如图7所示。选取棉花作为实验对象,初始时采摘口靠近棉花,3根推杆全部处于完全收缩状态。

图7 并联采摘臂实物图

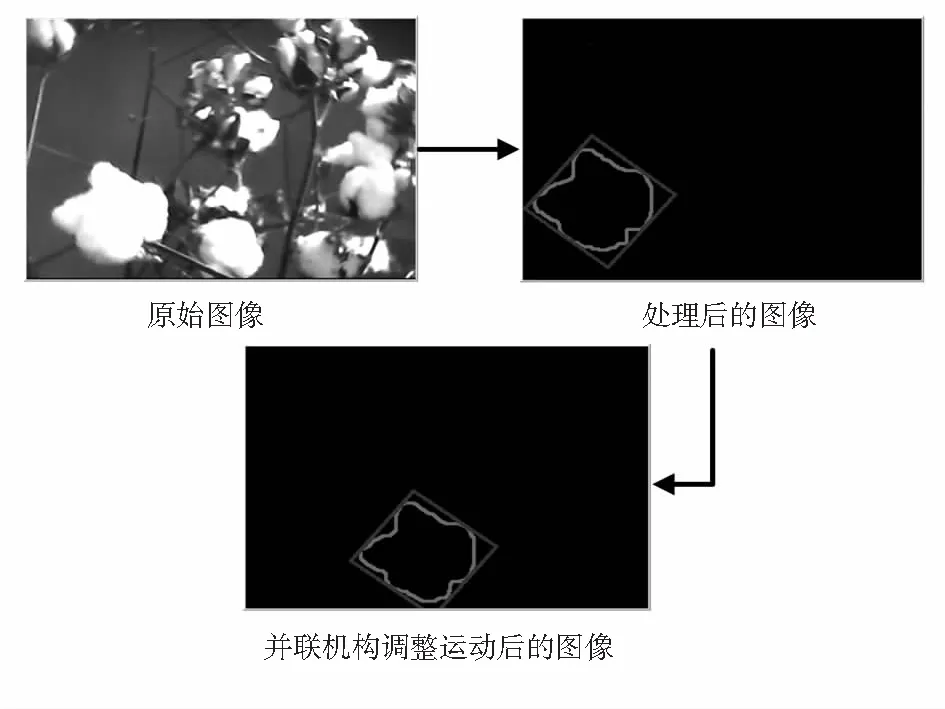

实验过程如下所述:运行上位机程序采集棉花图像,处理后得到最大棉花区域轮廓,计算出棉花质心坐标,得到采摘口与棉花之间的像素距离d和理论弯曲方向角β及需要弯曲的角度和方向,PC发送2个代表方向和角度的字符给单片机,单片机通过继电器模块驱动并联采摘机构作出相应调整。

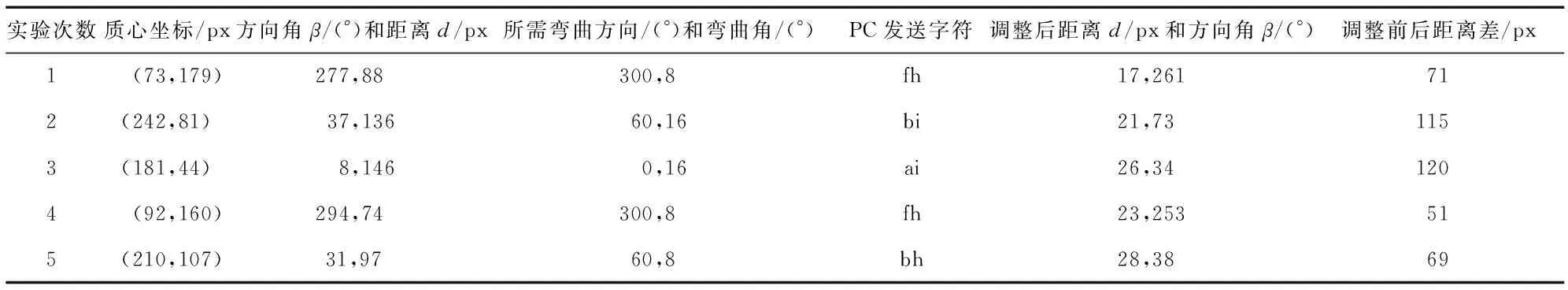

本文在不同的场景中,进行了5次实验,图8为第1次实验的过程图,表2列出了实验过程中采摘系统各参数的实验结果。

图8 实验过程图

图8中可以观察到:经过并联采摘机构姿态调整后,以前偏离采摘口位置的目标棉花,现在处于采摘口附近区域;表2中可以看到:以前采摘口与目标棉花之间距离d较大,姿态调整后,它们之间的距离缩小。说明本文设计的基于视觉传感器的农业机器人并联采摘系统对于目标采摘是有效可行的。

表2 采摘系统实验结果

4 结 论

本文基于视觉传感器设计了农业机器人并联采摘系统。视觉传感器采集目标图像并传递给上位机,上位机对图像进行处理,识别和定位目标,计算并联机构运动控制量,发送给下位机,下位机接收到控制量后驱动继电器模块作相应的开关动作,完成并联机构的控制。实验证明,该系统对于实现农业机器人采摘作业具有可行性。

[1] 宋 健,张铁中,徐丽明,等.果蔬采摘机器人研究进展与展望[J].农业机械学报,2006,37(5):158-162.

[2] 方建军.移动式采摘机器人研究现状与进展[J].农业工程学报,2004,20(2):273-278.

[3] 汤修映,张铁中.果蔬收获机器人研究综述[J].机器人,2005,27(1):90-96.

[4] 何东健,张海亮,宁纪锋,等.农业自动化领域中计算机视觉技术的应用[J].农业工程学报,2002,18(2):171-175.

[5] 杨福刚.基于视觉传感器的输液中异物检测系统设计[J].传感器与微系统,2010, 29(3):74-76.

[6] 杜东亮,毛鹏军,王 俊,等.基于计算机视觉的烟叶自动分级系统硬件设计[J].传感器与微系统,2008,27(4):77-79.

[7] 丁 萌,曹云峰.利用计算机视觉获取无人机飞行姿态角[J].传感器与微系统,2007,26(11):65-68.

[8] Hayashi S,Shigematsu K,Yamamoto S,et al.Evaluation of a strawberry-harvesting robot in a field test[J].Biosystems Engineering,2010,105(2):160-171.

[9] 顾宝兴,姬长英,王海青,等.智能移动水果采摘机器人设计与试验[J].农业机械学报,2012,43(6):153-160.

[10] 张艳伟,韦 斌,王 南,等.空间转动3—SPS—S并联机构运动学性能分析[J].农业机械学报,2012,43(4):212-215.

Visual servo control of parallel manipulator of agricultural robot*

XUE Liang, ZHOU Jun

(Key Laboratory of Intelligent Equipment for Agriculture of Jiangsu Province,College of Engineering,Nanjing Agricultural University,Nanjing 210031,China)

A kind of agricultural robot parallel picking system based on visual servo is presented,which is composed of 4 parts:the visual system, the upper computer,the lower computer and the parallel mechanism. Images of targets are acquired by the visual system and transfer to the upper computer.The upper computer processes images,and identifies and locates object,calculates motion control quantity of parallel mechanism,send the motion control quantity to the lower computer through the serial communication.According to the motion control quantity,the lower computer drives relay modules to finish corresponding switch action and complete parallel manipulator control.Experiments show that the system is feasible for the implementation of agricultural robot picking operation.

visual servo; agricultural robot; picking; parallel mechanism

10.13873/J.1000—9787(2017)05—0123—04

2016—06—22

国家自然科学基金资助项目(31471419);教育部博士点基金资助项目(20130097110043)

TP 391

A

1000—9787(2017)05—0123—04

薛 梁(1992-),男,硕士,从事农业机器人及模式识别工作。