基于颜色传递和对比度增强的夜视图像彩色融合

薛模根, 刘存超, 周浦城

(1. 偏振光成像探测技术安徽省重点实验室,安徽 合肥 230031;2. 陆军军官学院军用光电技术与系统实验室,安徽 合肥 230031)

基于颜色传递和对比度增强的夜视图像彩色融合

薛模根1,2, 刘存超2, 周浦城1,2

(1. 偏振光成像探测技术安徽省重点实验室,安徽 合肥 230031;2. 陆军军官学院军用光电技术与系统实验室,安徽 合肥 230031)

针对基于颜色传递夜视图像彩色融合算法存在的热目标不突出问题,提出一种基于颜色传递和对比度增强的彩色融合算法。该算法首先利用非线性扩散和迭代阈值分割方法提取出图像中的热目标,然后在HSI颜色空间利用热目标和灰度融合图像对颜色传递得到的初步彩色融合图像进行调整,接着将处理结果变换回RGB颜色空间,得到最终的融合图像。实验结果表明,利用该算法得到的融合图像不仅与人眼视觉感知习惯一致,而且显著增强了目标与背景的对比度,从而有效提高了目标的可探测性。

图像融合;彩色夜视;颜色传递;稀疏表示

红外热像仪与微光夜视仪获取的热红外图像与微光图像具有互补性及冗余性,通过融合相互取长补短,可以有效增强目标的细节信息[1]。然而这两种夜视仪获得的都是表征场景空间信息的灰度图像,缺少场景的颜色信息。基于人类视觉系统研究表明,人眼对彩色图像的分辨率要远远高于灰度图像。因此,热红外和微光图像的彩色融合更加有利于人眼对目标的观察与场景理解。

传统的基于彩色空间映射的MIT法和Toet方法得到的伪彩色图像,与真实自然场景的颜色差别较大,不能达到期望的自然彩色效果,从而影响对目标的准确识别。2003年,Toet[2]提出一种颜色传递理论,把白天自然场景的颜色特征传递给多波段夜视图像,得到一幅符合人眼视觉观察的近自然彩色融合图像,但该图像中目标与背景相近,导致目标变淡不利于人眼观察。2009年,殷松峰等[3]提出一种提高夜视融合图像目标可探测性的颜色对比度增强方法,但该方法在增强热目标对比度的同时也使噪声等非目标信号对比度得到增强,从而影响人眼对目标的观察和快速识别。

针对基于颜色传递理论生成融合图像的目标与背景颜色相近、目标变淡的问题,本文提出一种基于颜色传递和对比度增强的夜视图像彩色融合算法,该算法首先采用基于稀疏表示的最优化融合算法生成一幅灰度融合图像,然后提取出红外图像中的热目标,并利用颜色传递理论得到初步彩色融合图像,最后在HSI颜色空间利用提取的热目标和灰度融合图像对得到的初步彩色融合图像进行调整,从而达到改善夜视融合图像的质量、提高彩色融合图像探测性能的目的。

1 基于稀疏表示的红外与微光图像最优化融合

为了生成一幅目标突出、场景清晰的融合图像,本文采用基于稀疏表示的最优化融合方法。稀疏表示的本质是用过完备字典代替传统信号表示中的正交基。由于过完备字典具有冗余性,因此信号能够表示为过完备字典中少数原子的线性组合,可以获得信号更为简洁的表示方式,从而更容易获取信号中蕴含的信息。稀疏表示的数学模型为:

稀疏表示的关键是过完备字典的构造和稀疏分解方法。其中字典构造是一种寻找稀疏表示下最优基的构造,原始信号能否尽可能稀疏表示与字典的优劣有很大的关系。本文采用DCT字典作为初始化过完备字典,待融合夜视图像为样本数据,利用K-SVD算法[4],训练出所需的过完备字典D,然后采用追踪算法求得稀疏系数。

假设红外图像IR在过完备字典D下的稀疏系数为α,微光图像LL对应的稀疏系数为β,融合图像F的系数为γ,那么,融合图像的优劣等价为系数γ从α和β中选择的好坏。为了生成一幅质量好的融合图像,建立一个融合图像中的方差最大与源图像的差别最小目标函数:

残留量F-IR和F-LL表征了源图像与融合图像的差别, ▽ IR和 ▽ LL是残留量的权重,求解该最优化方程,便可获得红外与微光图像的灰度融合图像[5]。

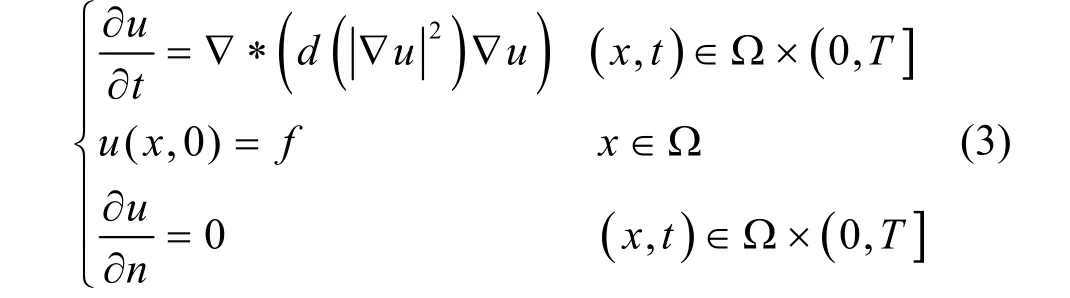

2 基于非线性扩散和迭代阈值分割的热目标提取

传统的图像分割与目标提取方法主要有迭代阈值分割法[6]、均值漂移[7]、水平集分割[8]等。由于红外图像中的噪声比较多,背景环境比较复杂,干扰物较多,采用单一传统图像分割方法提取红外图像中的热目标,很难得到理想的效果。鉴于非线性扩散是一种偏微分方法,能构选择性的平滑图像,有效地平滑掉图像中噪声和一些平坦区域,并保持增强图像中边缘细节,因此,本文采用Perona和Malik提出的P-M模型[9],对红外与微光图像的融合图像和微光图像分别进行非线性扩散,其数学表达式为:

对于融合图像与微光图像的扩散结果 E1和E2,取两者的差值 E=E1-E2,然后采用迭代阈值分割[6]从差值图像中分割出红外图像中的热目标,其算法流程如下:

(1) 求出图像中的最大和最小灰度值t1和tk,并令初始阈值为T0=(t1+tk)/2。

(2) 利用阈值Tk将图像分为前景R1和背景R2,分别求出这两部分的均值μ1和μ2。

(3) 更新阈值Tk+1=(μ1+μ2)/2。

(4) 如果Tk=Tk+1或k>M,则迭代结束,否则k←k+1,转到第(2)步继续迭代。其中,M表示设定的最多迭代次数。

(5) 利用确定的阈值T分割出热目标HT。

3 基于热目标对比度增强的颜色传递

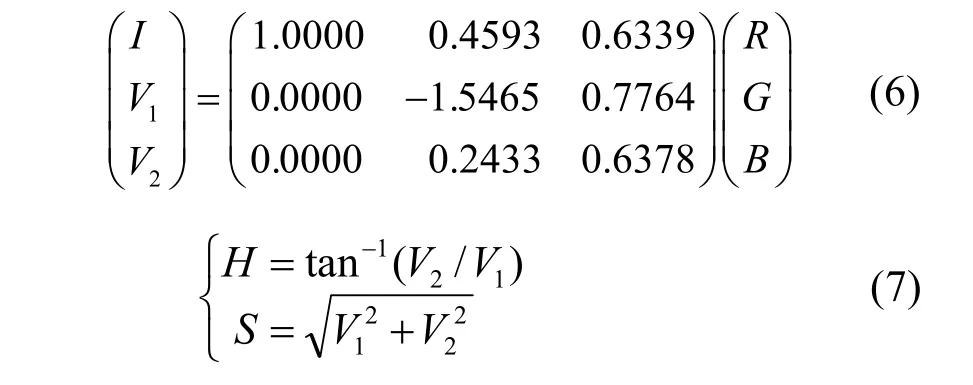

仿照Toet伪彩色融合结构,在YCbCr空间的伪彩色融合方案为:

式(4)中Cb、Cr分量增加了伪彩色图像的色彩对比度,为进一步颜色传递提供丰富的光谱特征和空间信息[11]。

采用伪彩色融合可获得较自然的色彩效果,算法简单,但在细节方面稍显劣势。为了获得更佳的自然感彩色融合图像,进一步采用颜色传递技术对伪彩色融合图像进行色彩增强:

其中下标S、R和Fc分别指伪彩色融合图像、参考图像和彩色融合图像;μ和σ分别为相应颜色通道的均值和方差。将调整后的伪彩色图像由YCbCr空间变换回RGB空间即可获得初步彩色融合图像。

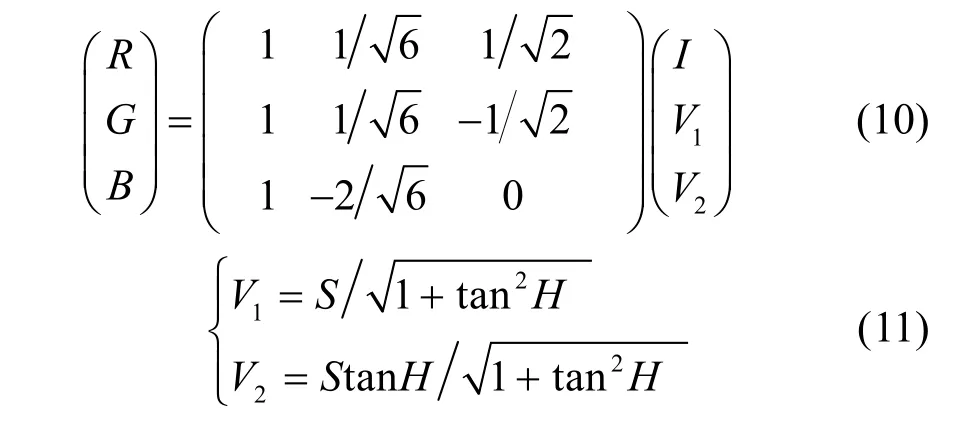

为了进一步突出彩色融合图像中的目标,提高目标与背景之间的对比度,使人眼能够快速地识别出目标,考虑到HSI颜色空间符合人眼的视觉观察系统,采用的热目标颜色对比度增强方法为:

(1) 将得到的初步彩色融合图像从 YCbCr空间变换到HSI空间:

(2) 利用热目标HT分别对初步彩色融合图像Fc的色调分量H和色饱和度分量S分别进行调整:

式中,E(·)表示求平均值。根据式(8),若当前像素属于目标区域,则其色调调整为当前像素的色调和整幅图像的平均色调的平均值的补色。式(9)表明若当前像素属于目标区域,那么首先需求出该像素点的色饱度和整幅图像的平均色饱和度之差的绝对值,然后求其绝对值的平均值,利用两者的比值作为该像素点的色饱和度值。

(3) 利用基于稀疏表示的最优化融合算法得到红外与微光图像的融合图像,用来表征彩色融合图像的I2分量,增加融合图像的细节信息。

(4) 将融合图像在 HSI空间的值(H2,S2,I2)变换回RGB空间,得到最终的彩色融合图像,变换式如下:

4 实验结果与分析

为了验证本文提取热目标算法的有效性,与几种典型的图像分割算法迭代阈值分割[6]、均值漂移[7]、水平集分割[8]做比较。实验采用荷兰人力因素研究所(TNO)提供的两组场景不同的红外与微光图像样本进行仿真实验,分辨率为360×270。对于非线性扩散的数值求解采用 AOS[9],其中正则化因子σ=0.4,扩散函数采用全变分扩散,时间步长为20,迭代次数60。

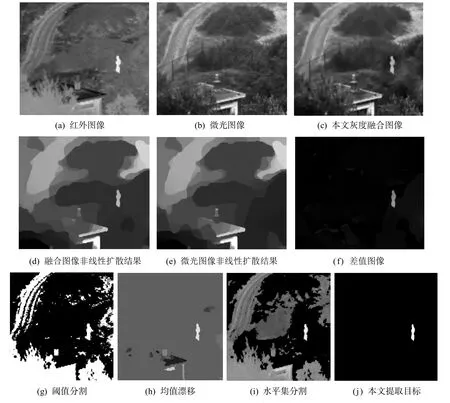

红外图像热目标的提取实验如图 1所示。在图1中,(g)迭代阈值分割结果[6]中热目标被分割出来,但与热目标像素值相近的非目标景物也被分割出来了(如山路,部分草丛);(i)水平集分割[8]与阈值分割结果类似,不但得到热目标而且还有部分干扰物;(h)均值漂移[7]分割结果较好,但仍不能完全剔除干扰(如亭子中部分物体及场景中一些其他物体)。而利用本文提取热目标的算法则可以很好地去除场景中的其他(非热目标)的干扰,取得较好地分割效果,优于迭代阈值分割[6]、均值漂移分割[7]和水平集分割[8]方法分割效果。

为了进一步验证本文彩色融合算法的可行性与有效性,选取文献[2]、[3]融合算法与本文融合算法作比较,3种融合算法采用同一个参考图像,实验结果如图2所示。文献[2]融合结果目标与背景颜色相近,致使目标不突出,场景中的一些事物(如近处的草丛变黑)色彩不自然;文献[3]融合结果中的场景清晰,红外图像中的热目标突出,但该方法是对红外图像中所有灰度值偏离平均值的区域进行对比度增强,场景中亮度较大的值(如亭子的边缘)也进行对比度增强(变为红色),与场景的实际颜色相背离;而本文融合结果的场景颜色与文献[2]和[3]相比颜色更接近自然色,视觉效果更舒适,目标与背景的对比度更高。

图 1 场景1红外图像热目标提取

图2 场景1彩色融合结果

为在不同场景下验证本文提取热目标的可行性和有效性,图3给出了另一组红外图像热目标提取实验效果及其彩色融合图像的实验效果。从融合效果的视觉效果来看,利用本文彩色融合算法得到的融合图像目标更突出,场景更清晰(如远处的山坡,近处的爬坡路),色彩效果更好。

图3 场景2热目标提取和彩色融合效果

5 结 论

根据红外与微光图像之间的互补性和冗余性,采用基于稀疏表示的最优化融合算法得到一幅灰度融合图像。依据人眼视觉系统对彩色图像的高灵敏性,在YCbCr颜色空间采用颜色传递理论得到一幅初步彩色融合图像。为了提高彩色融合图像的目标探测性,利用迭代阈值分割从灰度融合图像与微光图像非线性扩散结果的差值图像中提取热目标,在HSI空间利用热目标和灰度融合图像对初步彩色融合图像的H、S、I分量分别进行调整,得到最终彩色融合结果。实验结果表明,本文算法得到的彩色融合图像目标与背景对比度高、细节清晰、色彩较好,提高了人眼对场景的理解和目标的快速识别。

[1] 何卫华, 郭永彩, 高 潮, 周东国. 利用 NSCT实现夜视图像的彩色化增强[J]. 计算机辅助设计与图形学学报, 2011, 23(5): 884-889.

[2] Toet A. Natural colour mapping for multiband nightvision imagery [J]. Information Fusion, 2003, 4(3): 155-166.

[3] 殷松峰, 曹良才, 杨 华, 谭峭峰, 何庆声, 凌永顺,金国藩. 提高夜视融合目标可探测性的颜色对比度增强方法[J]. 红外与毫米波学报, 2009, 28(4): 281-284.

[4] Aharon M, Elad M, Bruckstein A. The K-SVD: an algorithm for designing of over complete dictionaries for sparse representation [J]. IEEE Transactions on Signal Processing, 2006, 54(11): 4311-4322.

[5] 薛模根, 刘存超, 徐国明, 袁宏武. 基于多尺度字典的红外与微光图像融合[J]. 红外技术, 2013, 35(11): 696-701.

[6] 张 震, 胡洪涛. 基于VC++的迭代阈值分割算法在图像处理中的应用[J]. 矿山机械, 2008, 36(8): 41-43.

[7] Comaniciu D, Meer P. Mean shift: a robust approach toward feature space analysis [J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2002, 24(5): 603-619.

[8] Li Chunming, Huang Rui, Ding Zhaohua, Gatenby J C, Metaxas D N, Gore J C. A level set method for image segmentation in the presence of intensity inhomogeneities with application to MRI [J]. IEEE Trans on Image Processing, 2011, 20(7): 2007-2016.

[9] Pietro P, Jitendra M. Scale-space and edge detection using anisotropic diffusion [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1990, 12(7): 629-639.

[10] Weickert J, Romeny B H, Viergever M A. Efficient and reliable schemes for nonlinear diffusion filtering [J]. IEEE Transactions on Image Processing, 1998, 7(3): 398-401.

[11] 徐铭蔚, 李郁峰, 陈念年, 张 笙, 熊 平, 唐遵烈.多尺度融合与非线性颜色传递的微光与红外图像染色[J]. 红外技术, 2012, 34(12): 722-728.

Night Vision Image Color Fusion Method Using Color Transfer and Contrast Enhancement

Xue Mogen1,2, Liu Cunchao2, Zhou Pucheng1,2

(1. Anhui province Key Laboratory of Polarization Imaging Detection Technology, Hefei Anhui 230031, China; 2. Laboratory of Military Electro & Optical Technology and System, Army Officer Academy of PLA, Hefei Anhui 230031, China)

As the traditional color fusion algorithm based on color transfer has an issue that the hot target is not highlight, a kind of color fusion algorithm of infrared and low-level-light image based on color transfer and contrast enhancement is proposed. This algorithm uses nonlinear diffusion and the iterative threshold segmentation to extract the target image firstly. And then, it adjusts the initial color fusion image obtained by color transfer using thermal target and gray fusion image in the HSI space. Next, the resultant image is transformed back into RGB color space, thus the final fused image is obtained. Experimental results show that, the proposed method has the merit that the fused result is consistent with the habit of human vision perception, and makes the contrast of target region within the cluttered background more outstanding. And then target detectability can be improved by the method.

image fusion; coloring night-vision; color transfer; sparse representation

TN 219

A

2095-302X(2014)06-0864-05

2014-03-17;定稿日期:2014-06-27

安徽省自然科学基金资助项目(1208085QF115)

薛模根(1964-),男,安徽合肥人,教授,博士,博士生导师。主要研究方向为图像融合及图像处理。E-mail:lcc426426@126.com